前言:在创作的道路上,找到合适的工具就像找到了一位贴心的好伙伴。思源笔记以其强大的编辑功能、灵活的整理方式和丰富的插件支持,成为了许多写作者的心头好。无论是记录闪现的灵感火花,还是撰写复杂的文档,它都能轻松胜任。

然而,创意的激发才是写作的核心。大语言模型在这一过程中发挥着举足轻重的作用。它们能够基于海量数据生成高质量内容,为用户提供宝贵的参考和启发。但传统的在线服务往往让人望而却步------数据隐私泄露、网络延迟等问题层出不穷。

今天,我要给你介绍一个绝招------如何利用 **cpolar** 内网穿透技术,将思源笔记与本地大语言模型 **Ollama** 进行远程对接。让你无论身处何地,都能享受到大语言模型的强大支持,让灵感如泉水般涌现!

目录

[1. 下载运行Ollama框架](#1. 下载运行Ollama框架)

[2. Ollama下载大语言模型](#2. Ollama下载大语言模型)

[3. 思源笔记设置连接Ollama](#3. 思源笔记设置连接Ollama)

[4. 测试笔记智能辅助写作](#4. 测试笔记智能辅助写作)

[5. 安装Cpolar工具](#5. 安装Cpolar工具)

[6. 配置Ollama公网地址](#6. 配置Ollama公网地址)

[7. 笔记设置远程连接Ollama](#7. 笔记设置远程连接Ollama)

[8. 固定Ollama公网地址](#8. 固定Ollama公网地址)

1. 下载运行Ollama框架

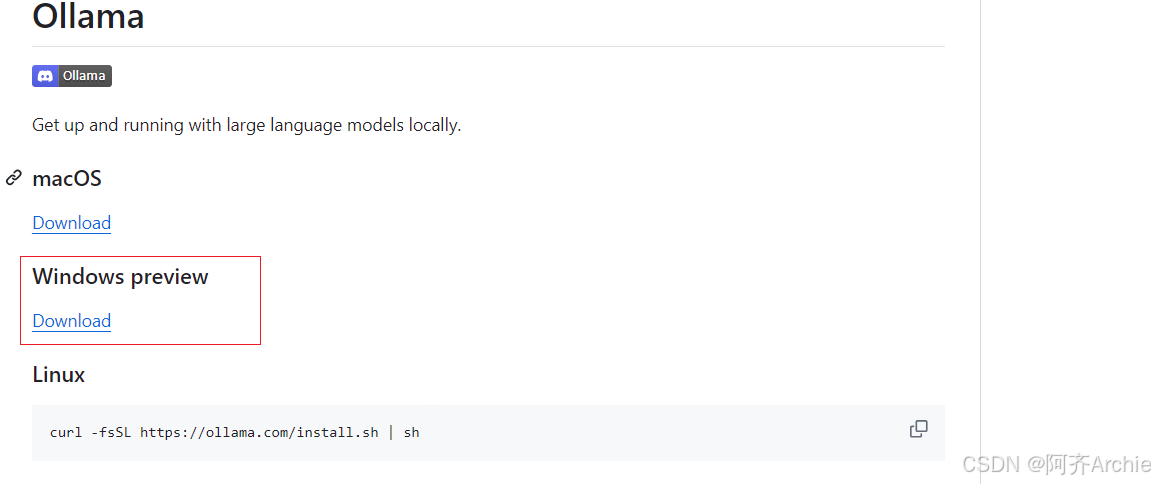

进入Ollama Github 界面:https://github.com/ollama/ollama?tab=readme-ov-file ,我们选择Windows版本下载

下载后,双击进行安装,默认会安装到C盘,然后等待安装完成,安装完成后正常会自动运行,如果没有运行,可以去应用列表双击运行即可

然后打开命令窗口,输入:`ollama` -v,可以看到版本信息

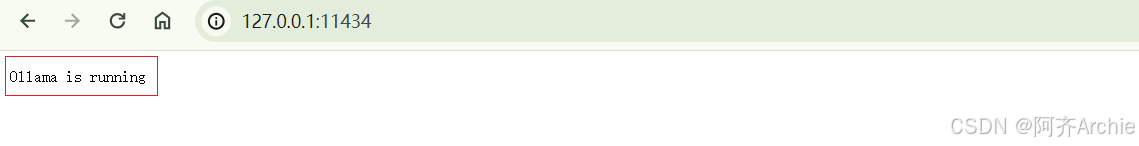

同样,在浏览器输入`http://127.0.0.1:11434/\`访问ollama服务,即可看到,运行的字样,表示本地运行成功了,下面进行安装大语言模型.

2. Ollama下载大语言模型

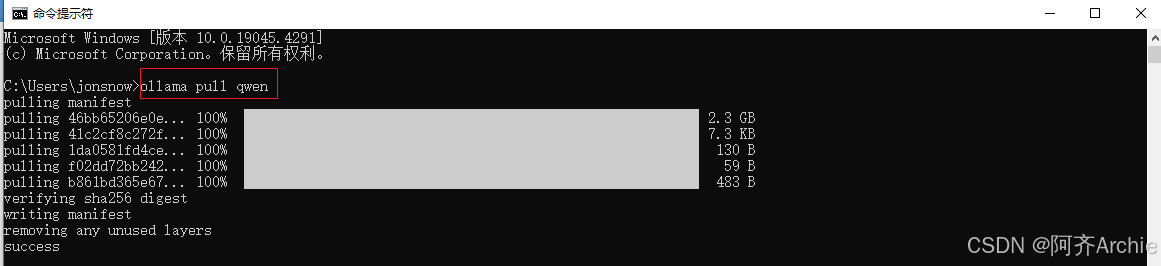

ollama安装完成后,下面进行下载运行大语言模型,本例采用`qwen`模型,,qwen这个模型运行开销比较小,对配置低的设备响应会快一些,如果自己设备配置高,可以下载llama3那些运行也是可以,其他模型,可以到github上面选择,下面我们打开命令窗口输入下面命令进行下载`qwen`模型

```shell

ollama pull qwen

```然后等待安装完成即可,出现success 表示下载完成了,然后按`ctrl+d` 退出,

然后再输入`ollama list` 即可看到下载的大语言模型列表,本例下载了两个,所以显示两个,下面我们进行本地测试

3. 思源笔记设置连接Ollama

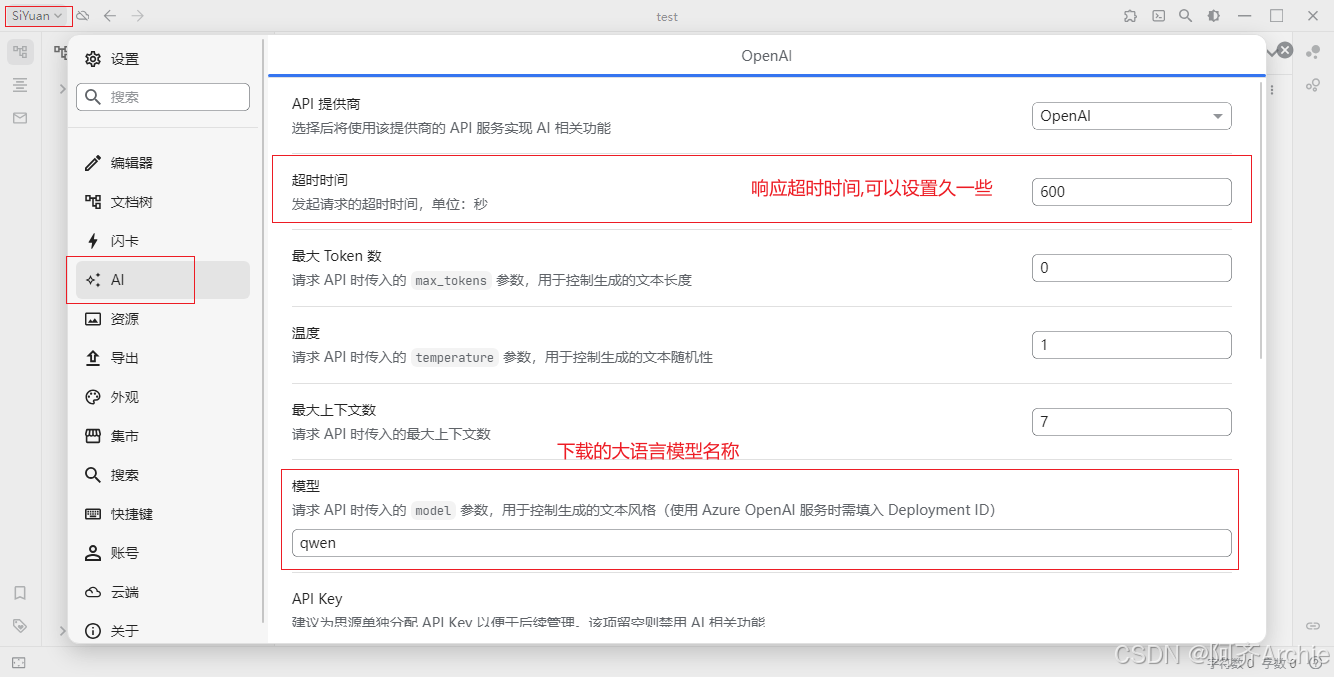

打开思源笔记,如果没有下载思源笔记,可以先去网上进行下载安装好,打开笔记后,点击左上角打开设置,点击AI,开始设置,首先设置超时时间,这个时间是模型响应时间,可以设置久一些,下面设置600秒,然后下面模型名称,填写`qwen`,然后继续往下设置

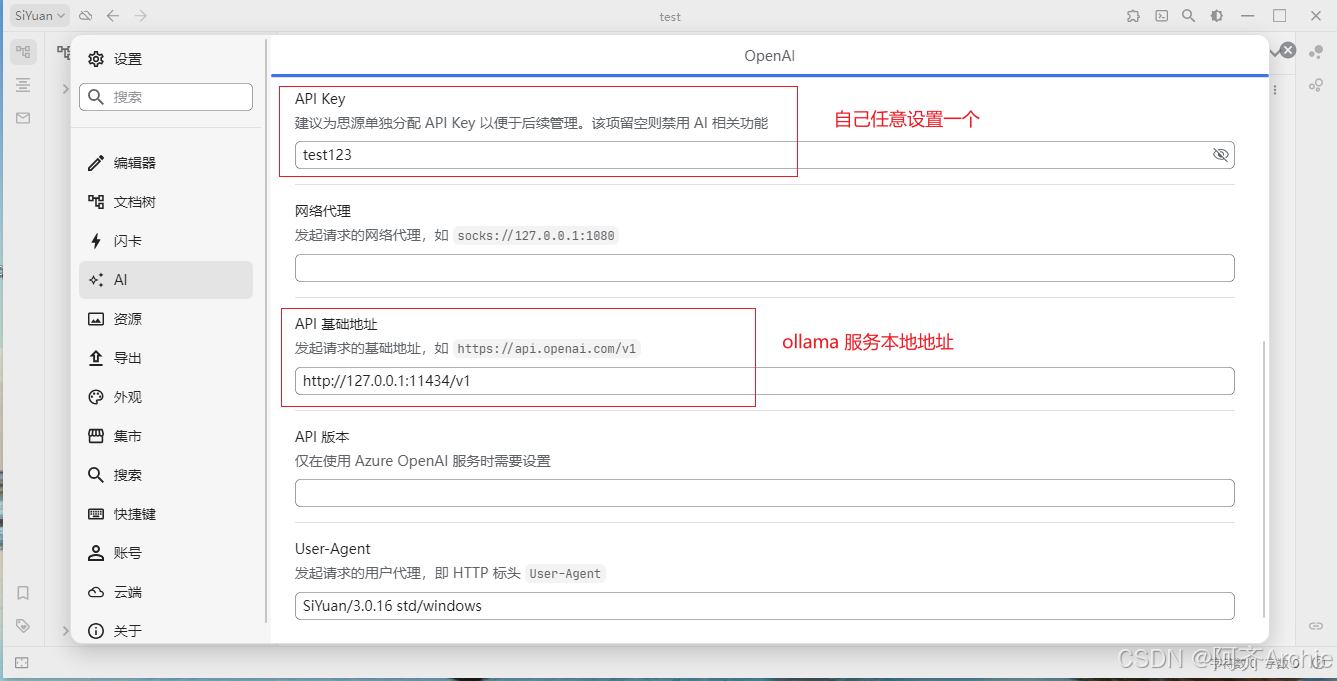

然后填写API Key,这个可以任意设置一个即可,下面设置ollama服务的地址,本地测试,我们只需要填写本地地址:`http://127.0.0.1:11434/v1\`,即可,下面进行笔记智能补全测试

4. 测试笔记智能辅助写作

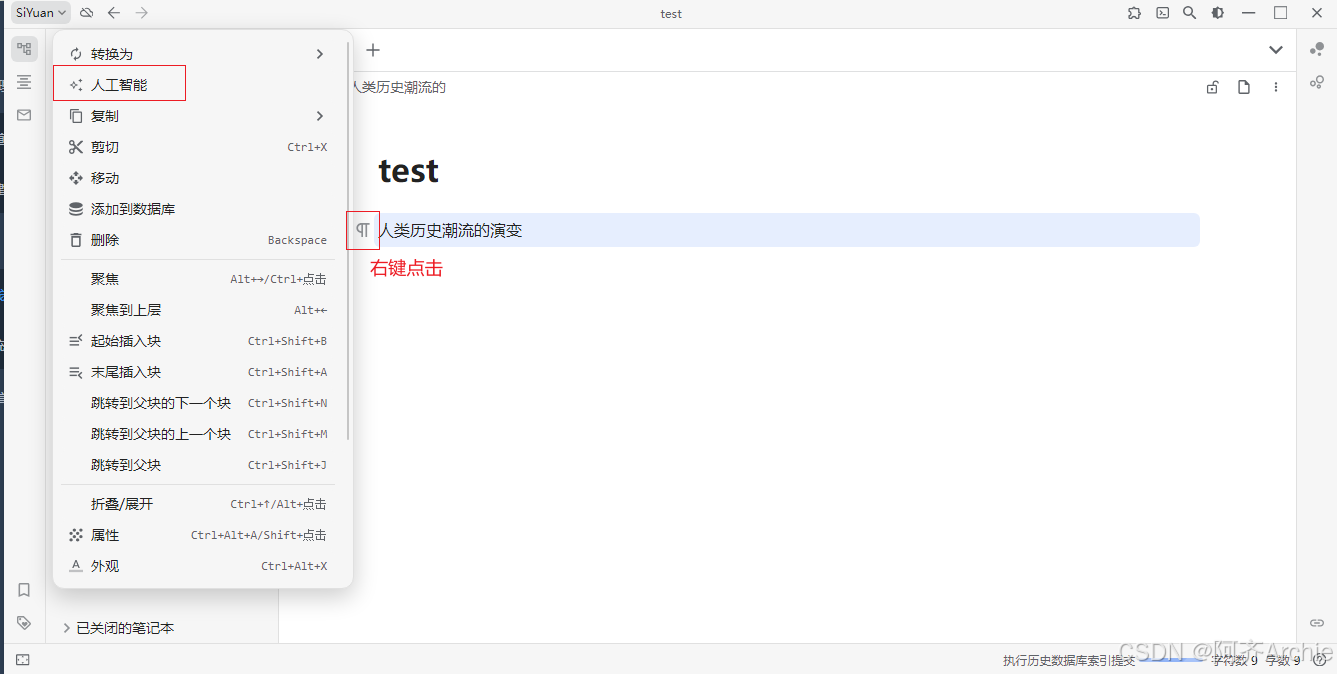

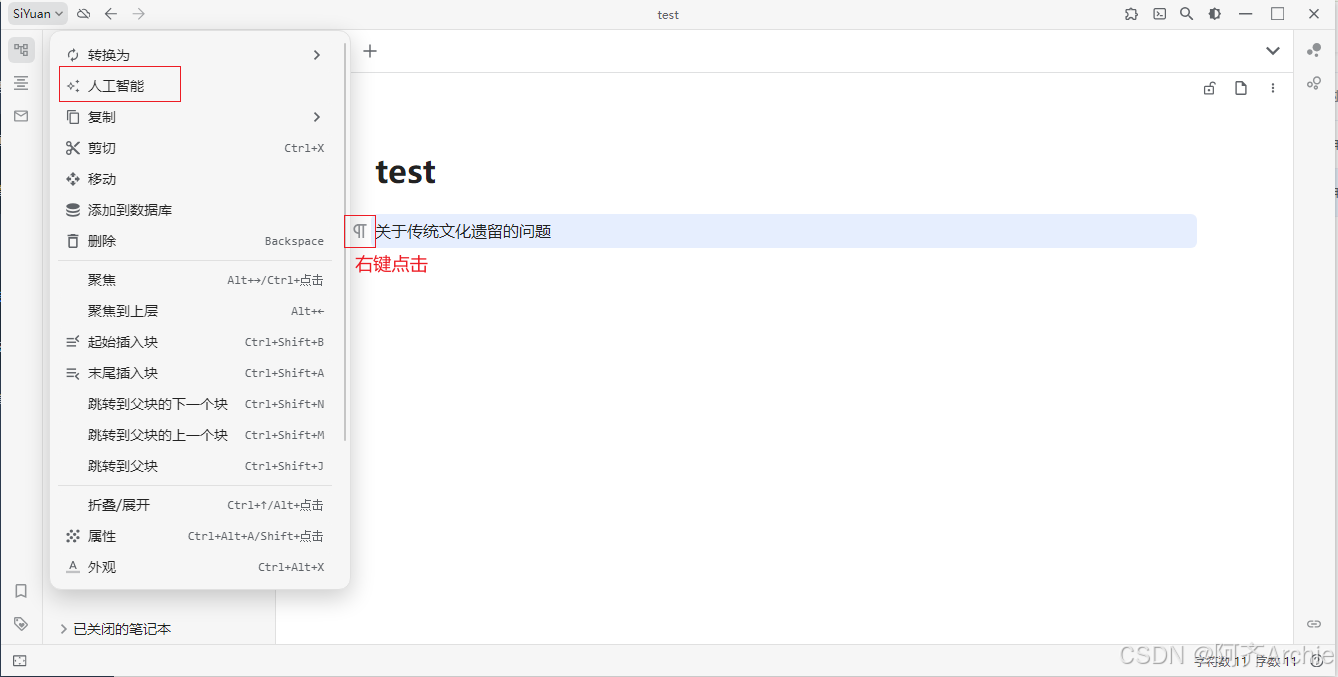

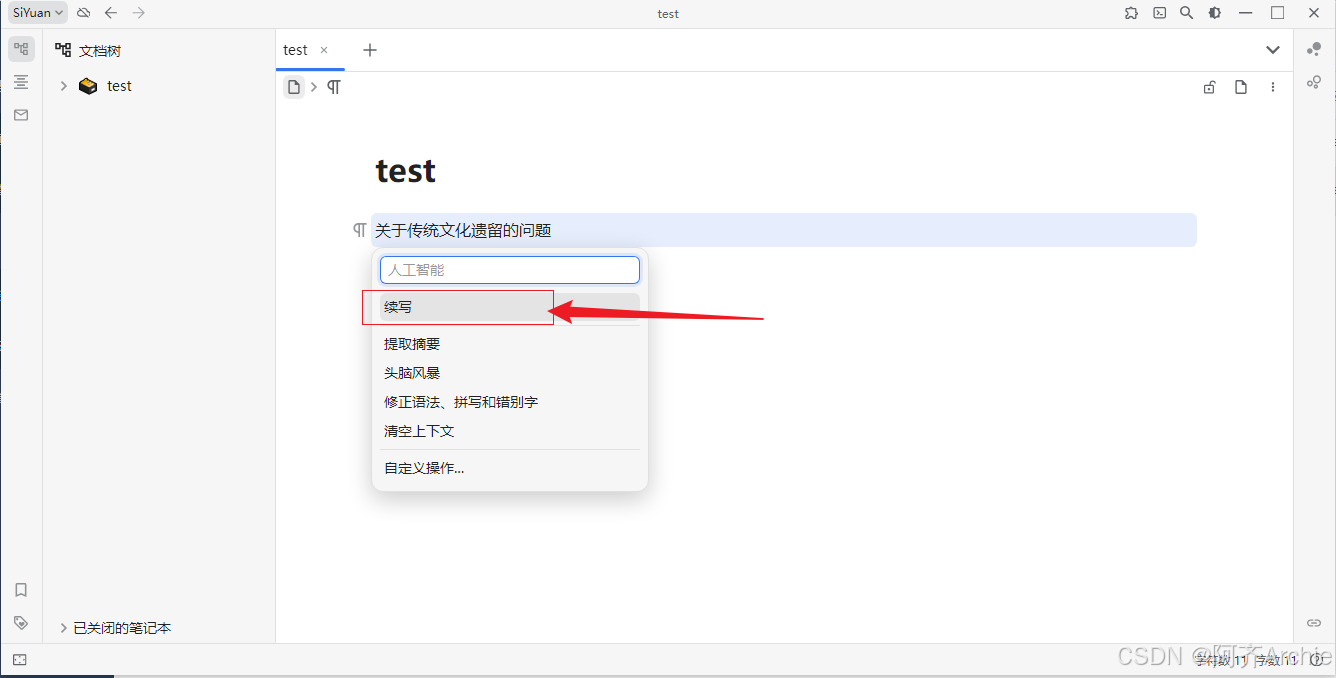

返回笔记,我们打开一个页面,随便输入一些内容,右键点击选择人工智能

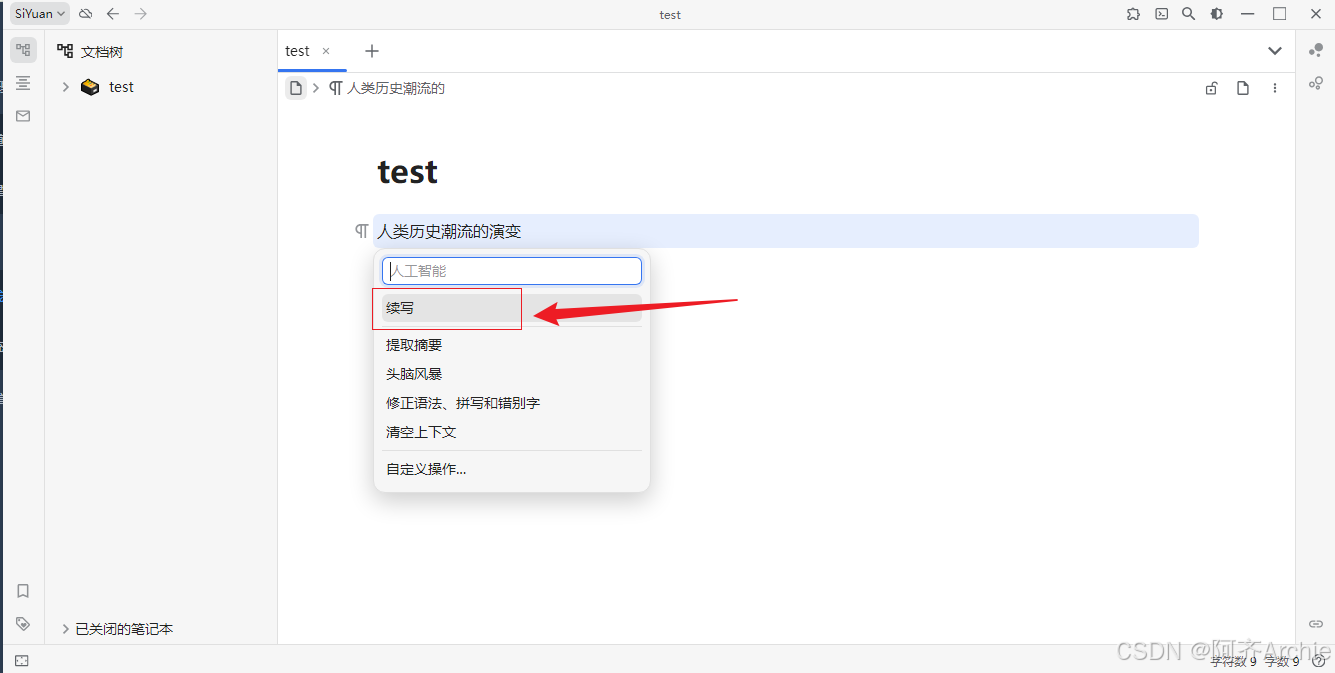

这里选择续写,下面有其他选项,可以自己选择,续写相当于辅助写作

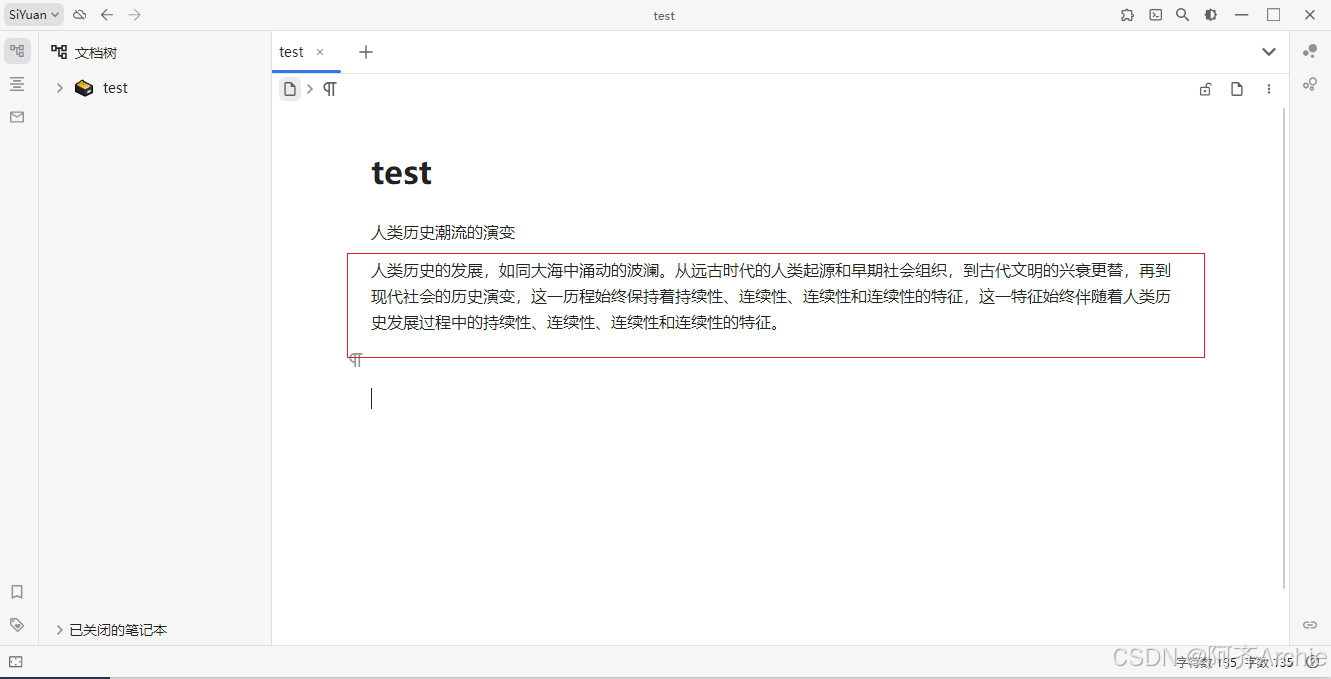

然后稍等一下,我们可以看到,后面大语言模型为我们后面自动生成了一段话,测试就完成了,但是为了能实现异地或者当我们和Ollama不处于一个局域网时也可以进行使用这个人工智能,所以我们需要安装cpolar内网工具,穿透本地Ollama大语言模型服务,使得远程也可以调用,下面我们安装cpolar

5. 安装Cpolar工具

本例介绍的是windows系统,所以cpolar安装在windows上,点击下面地址访问cpolar官网,注册一个账号,然后下载并安装客户端.

> Cpolar官网:[https://www.cpolar.com/\](https://www.cpolar.com/)

- *windows系统:在官网下载安装包后,双击安装包一路默认安装即可。*

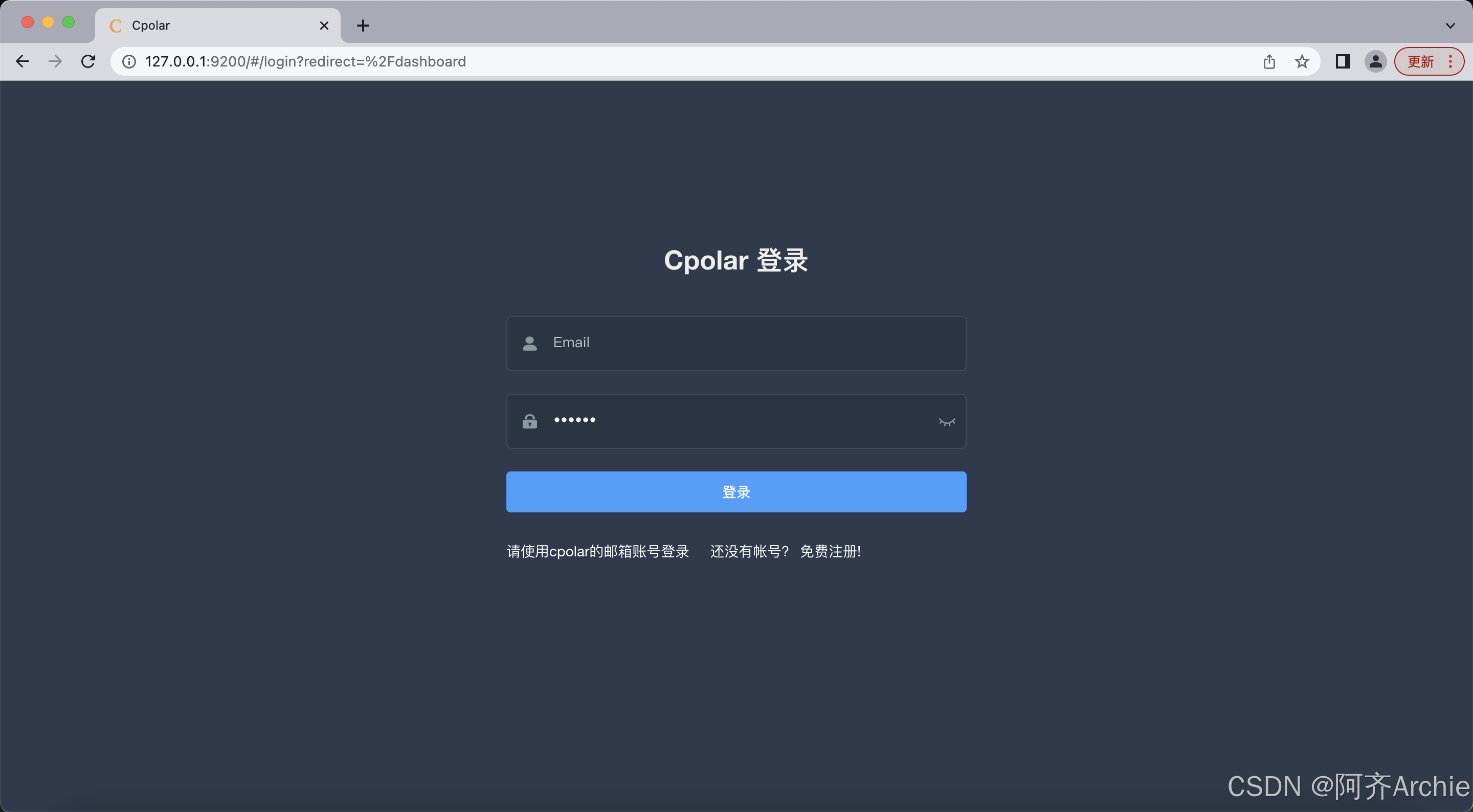

cpolar安装成功后,在浏览器上访问本地9200端口【[http://localhost:9200](http://localhost:9200/)】,使用cpolar账号登录,即可看到Cpolar 管理界面,然后一切设置只需要在管理界面完成即可!

6. 配置Ollama公网地址

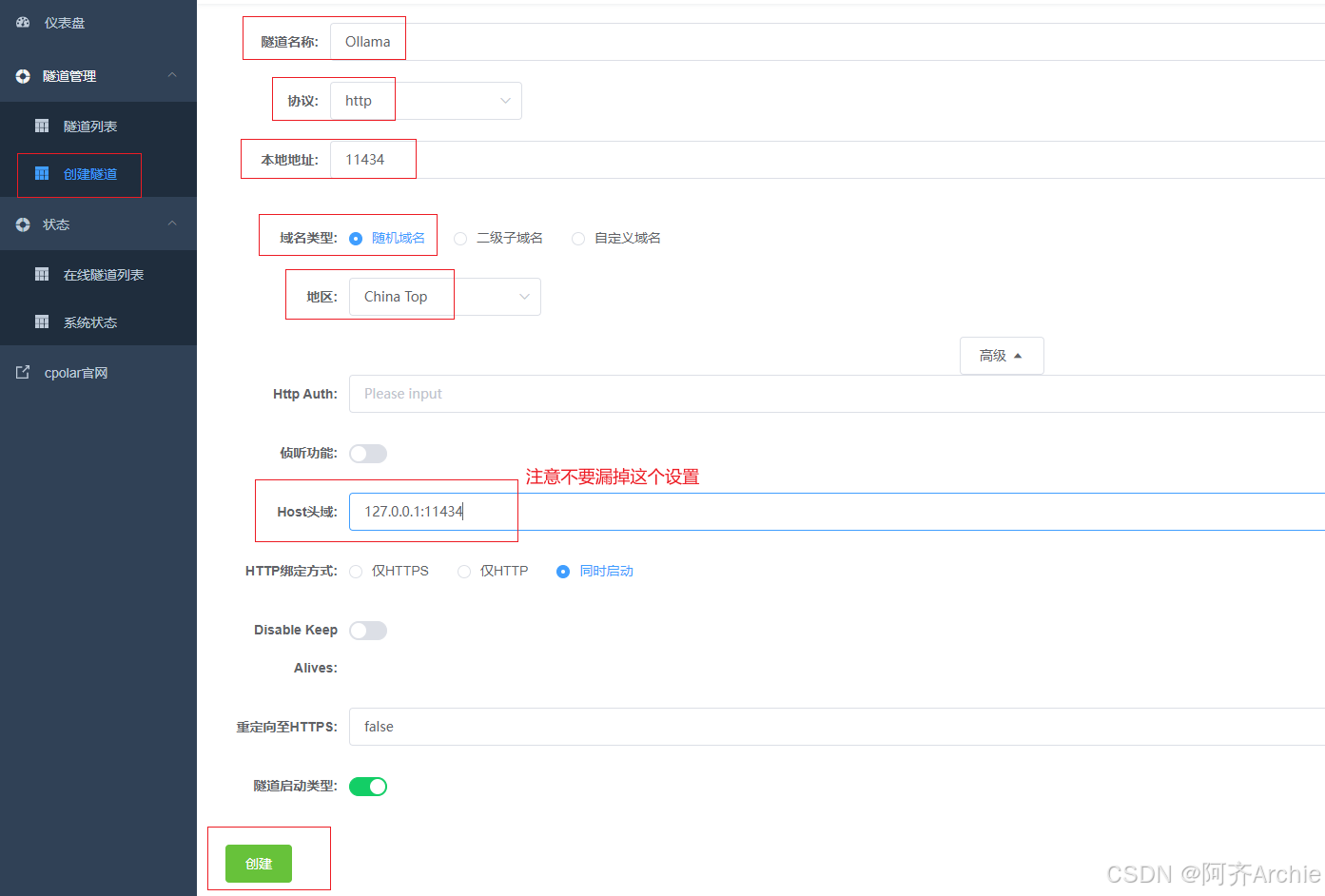

点击左侧仪表盘的隧道管理------创建隧道,创建一个ollama的公网http地址隧道!

-

隧道名称:可自定义命名,注意不要与已有的隧道名称重复

-

协议:选择http

-

本地地址:11434

-

域名类型:免费选择随机域名

-

地区:选择China

-

Host头域: 127.0.0.1:11434

点击`创建`(点击一次创建按钮即可,不要重复点击!)

隧道创建成功后,点击左侧的状态------在线隧道列表,查看所生成的公网访问地址,有两种访问方式,一种是http 和https,两种都可以访问,下面选择其中一种进行远程访问,下面我们替换掉笔记中的本地地址,改为公网地址.

7. 笔记设置远程连接Ollama

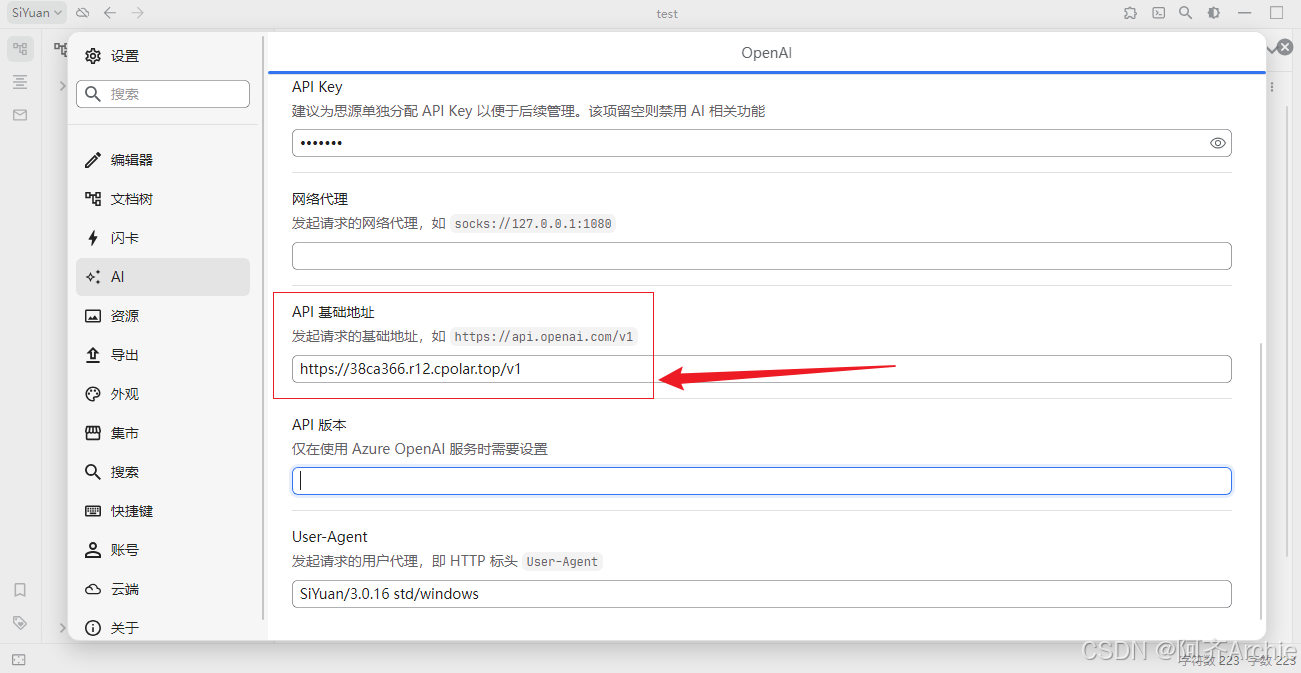

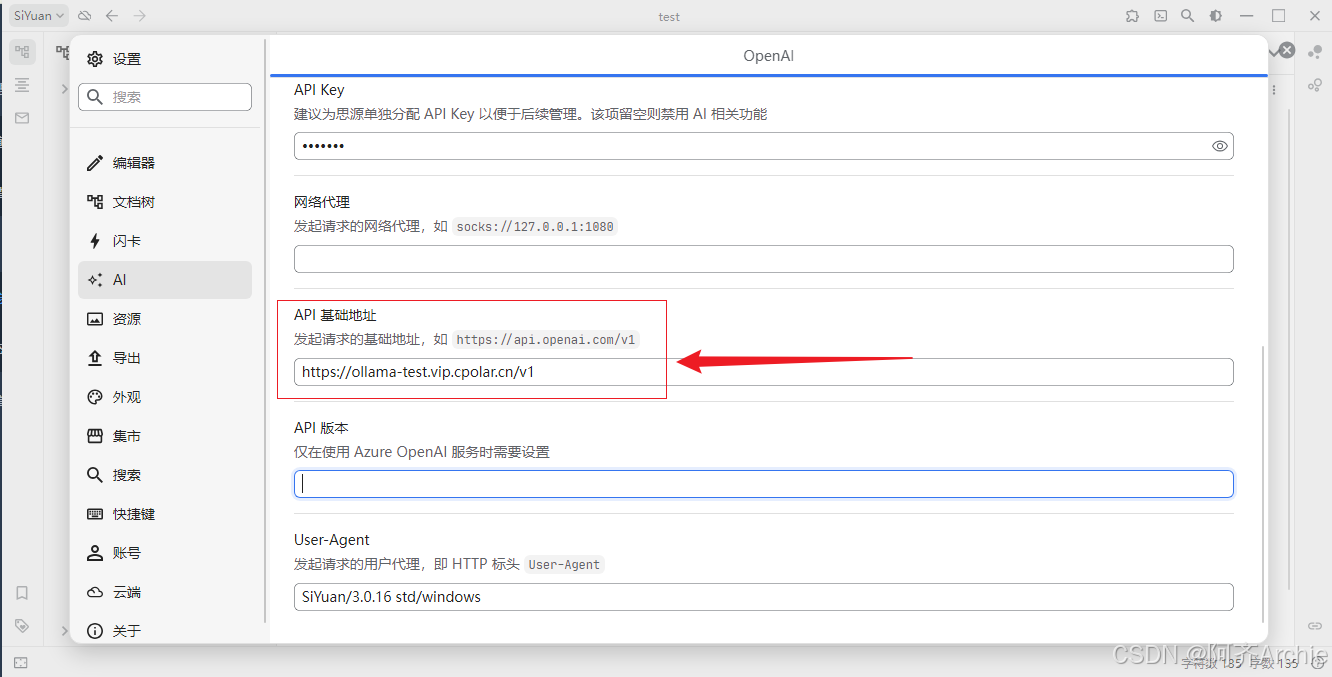

再次打开思源笔记AI设置界面,把之前的本地地址改为cpolar的公网地址,注意后面的V2不要漏掉,然后返回笔记,我们再测试一下

写一段话,然后右键打开人工智能

让AI帮我们续写

可以看到,同样可以进行AI智能续写我们的笔记,这样远程设置就完成了,即使不在本地Ollama的服务,笔记也可以远程去调用它,帮我们完成AI写作

**小结**

为了更好地演示,我们在前述过程中使用了cpolar生成的隧道,其公网地址是随机生成的。

这种随机地址的优势在于建立速度快,可以立即使用。然而,它的缺点是网址由随机字符生成,不太容易记忆(例如:3ad5da5.r10.cpolar.top)。另外,这个地址在24小时内会发生随机变化,更适合于临时使用。

我一般会使用固定二级子域名,原因是我希望将网址发送给同事或客户时,它是一个固定、易记的公网地址(例如:ollama.cpolar.cn),这样更显正式,便于流交协作。

8. 固定Ollama公网地址

由于以上使用cpolar所创建的隧道使用的是随机公网地址,24小时内会随机变化,不利于长期远程访问。因此我们可以为其配置二级子域名,该地址为固定地址,不会随机变化。

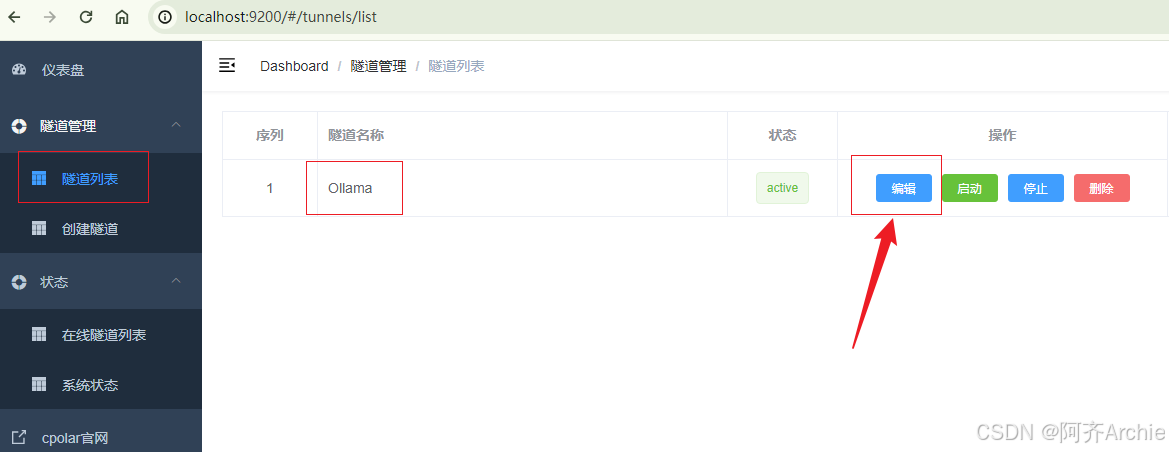

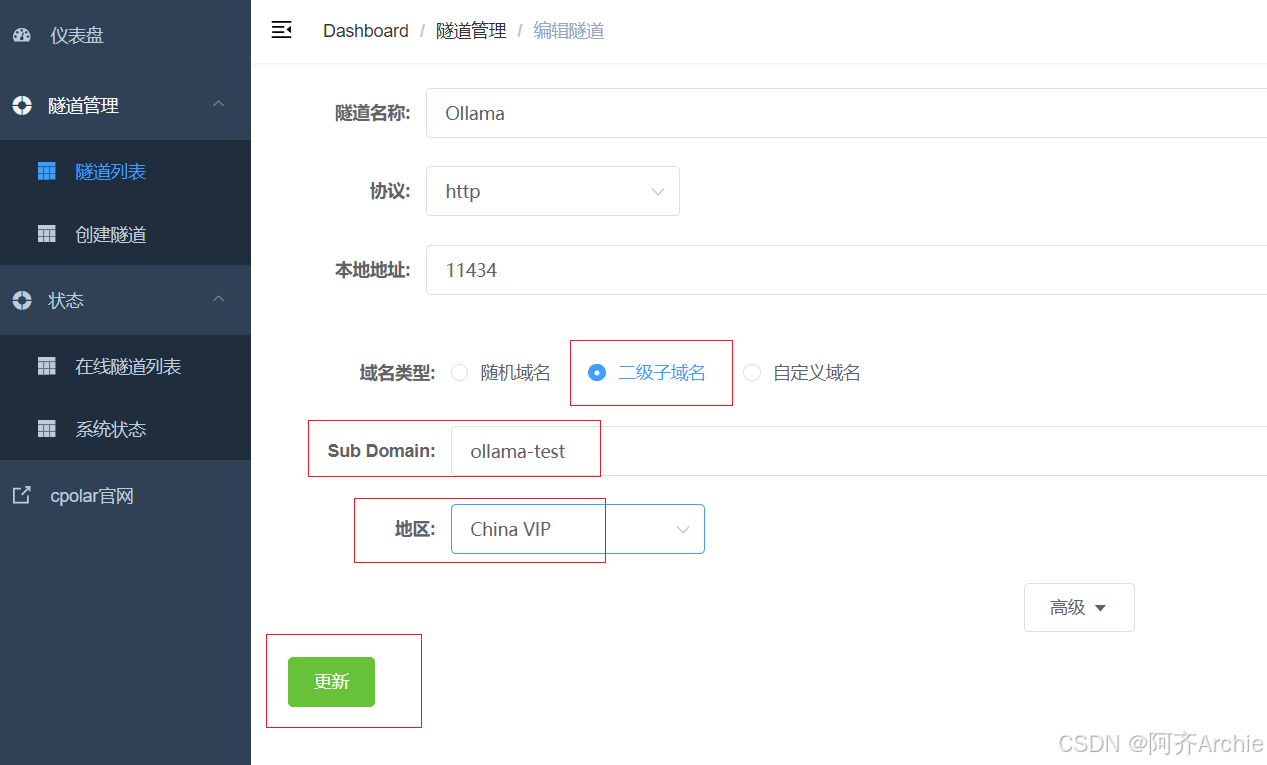

登录cpolar官网\](https://dashboard.cpolar.com/),点击左侧的预留,选择保留二级子域名,设置一个二级子域名名称,点击保留,保留成功后复制保留的二级子域名名称  保留成功后复制保留成功的二级子域名的名称  返回登录cpolar web UI管理界面,点击左侧仪表盘的隧道管理------隧道列表,找到所要配置的隧道,点击右侧的编辑  修改隧道信息,将保留成功的二级子域名配置到隧道中 - 域名类型:选择二级子域名 - Sub Domain:填写保留成功的二级子域名 点击\`更新\`(注意,点击一次更新即可,不需要重复提交)  更新完成后,打开在线隧道列表,此时可以看到公网地址已经发生变化,地址二级名称变成了我们自己设置的二级子域名名称  然后打开思源笔记,把之前的随机地址改为固定的地址,然后返回笔记,再次测试  自己定义一个开头,然后点击打开人工智能  让AI帮我续写后面的内容  可以看到,也是成功可以实现AI辅助为我们写了一段话,这样固定地址就设置好了,任意地点也可以使用该地址配置到思源笔记里面,实现AI功能!  通过 \*\*cpolar\*\* 和 \*\*Ollama\*\* 的完美结合,你不仅能够大幅提升写作效率,还能确保数据的安全和隐私。从此,再也不会有网络延迟或数据泄露的烦恼了。希望这篇分享能让你在创作的道路上更加得心应手,轻松搞定各种文案、文章。如果你对这种方法感兴趣或有任何疑问,欢迎在评论区留言交流。别忘了点赞、收藏,让更多小伙伴也能受益哦!