背景

本文主要快速部署一个带有web可交互界面的大模型的应用,主要用于开发测试节点,其中涉及到的三个组件为

首先 Ollama 是一个开源的本地化大模型部署工具,提供与OpenAI兼容的Api接口,可以快速的运行大模型服务,我们用他来部署deepseek。

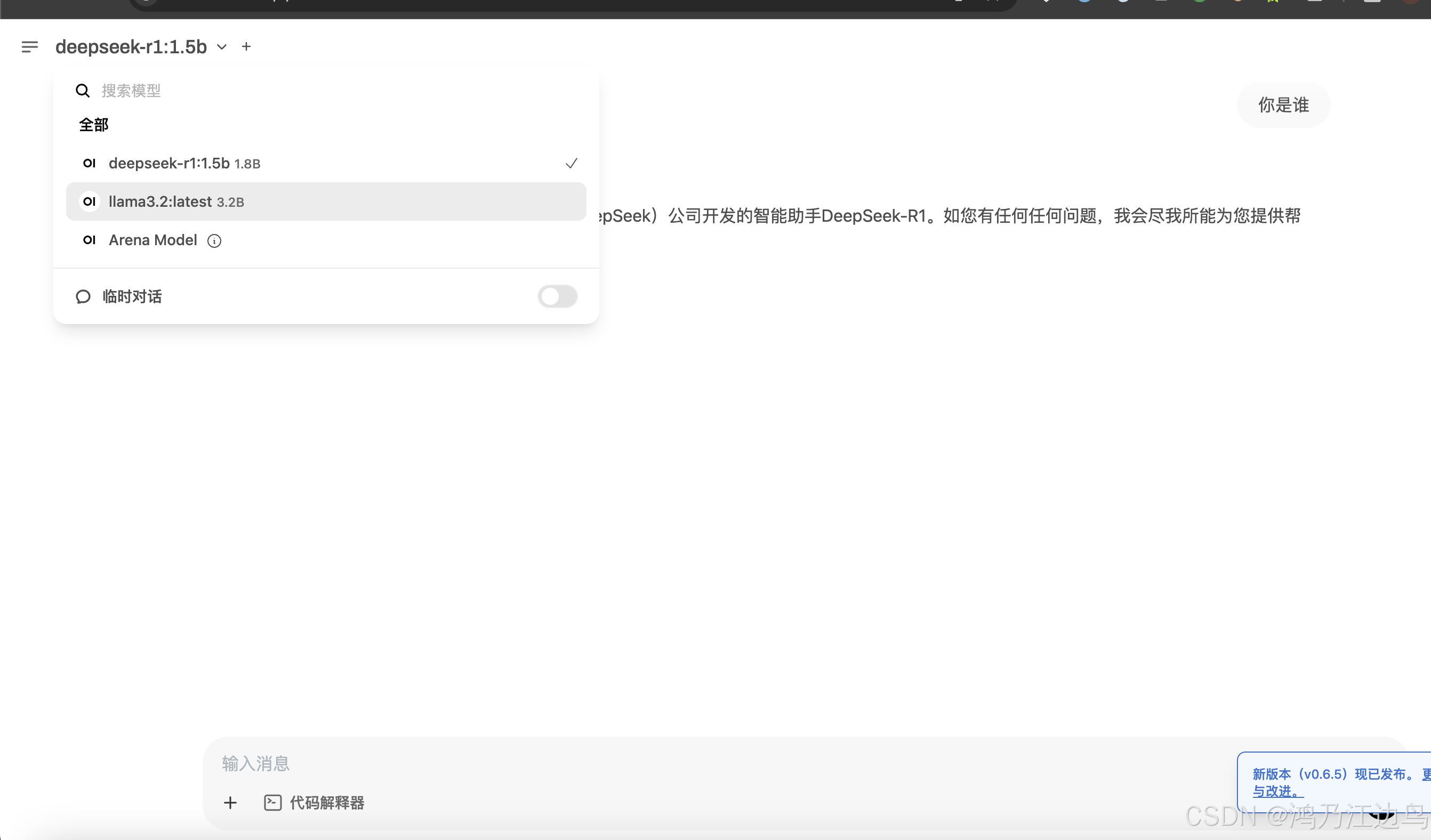

open-webui 提供了用户友好的 AI 界面(支持 Ollama、OpenAI API 等),且能够支持多种大模型,我们可以部署除了deepseek以外的其他模型,可以很方便的在模型之间切换等功能。

部署步骤

Ollama的部署

因为我这边是Mac系统,直接点击下载Ollama-darwin.zip,之后安装就可以了.

安装好后,运行ollama --version,显示如下:

ollama version is 0.6.3运行 DeepSeek-R1模型

Ollama 支持下载部署 在 ollama lib以及 HuggingFace Modelscope的模型。

我们这里以ollama lib上的模型为例进行演示,运行如下命令就会下载并运行deepseek-r1模型

ollama run deepseek-r1:1.5b这样我们就能够进行对话了

ollama run deepseek-r1:1.5b

>>> Send a message (/? for help)在这里可以进行提问了。

可以看到这里的交互界面很简单

运行 open-webui

在这里我们可以用conda新建一个虚拟环境

conda create --name python3.12 python=3.12之后安装open-webui

pip install open-webui启动open-webui

open-webui serve浏览器输入http://localhost:8080/就可以访问并和deepseek进行交互了,默认是8080端口,也可以通过open-webui serve --port 8070这种方式指定端口去启动

注意第一次进去的时候,需要输入管理员密码。且需要等一段时间才能看到运行的模型

额外

我们可以直接访问deepseek提供的在线chat平台deepseek去聊天