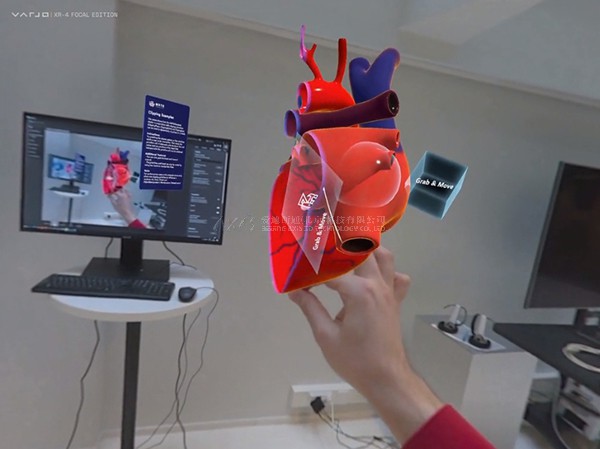

手部跟踪功能作为Varjo Base 4.10软件新发布的一个全新功能现在可支持Varjo XR-4系列全部头显。这一强大的新功能是免费提供的,可通过Varjo基本设置自动启用。

请注意:手部跟踪作为一种测试功能。虽然它已经实现了一些全新的可能性,但也有一些已知的限制,包括手势可靠性和延迟。用户的使用反馈将帮助Varjo在未来的更新中完善体验。

与OpenXR应用程序无缝集成

集成的手部跟踪功能适用于定焦和自动对焦的XR-4头显。用户现在可以通过OpenXR APIs在任何支持手部跟踪的应用中享受身临其境的交互。具体来说,Varjo现在可实现包括对XR _ EXT _ hand _跟踪和XR _ EXT _ hand _交互的OpenXR扩展。

-

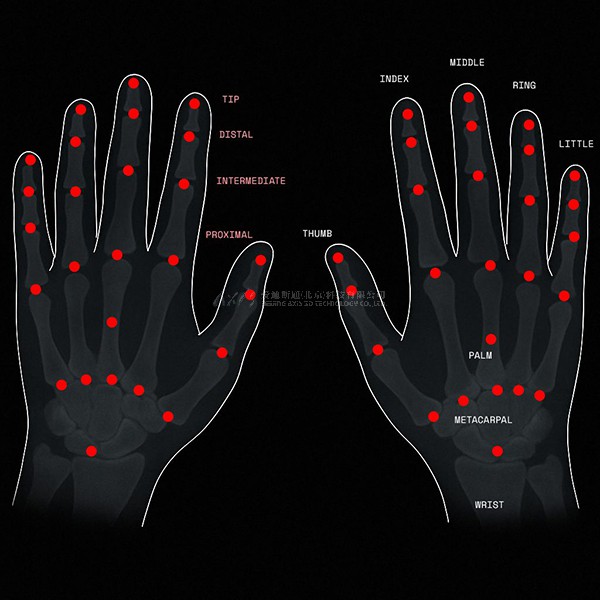

XR _ EXT _ hand _跟踪支持完全连接26个手形标志,提供详细的骨骼跟踪。

-

XR _ EXT _ hand _交互支持四种直观的手势:瞄准、捏、抓、戳。为了获得最佳用户体验,建议使用利用此扩展的应用程序。

对于正在使用Ultraleap Leapotion Controller 2,或者更愿意继续使用它的用户来说,其仍然完全兼容。在自动的模式下,如果Ultraleap设备已连接,系统将优先考虑该设备。

基于摄像头的跟踪--不需要额外的硬件

这一新功能是通过利用XR-4的视频透视(VST)摄像机流实现的。这意味着不需要额外的硬件---您的手直接在头显的可视区域内被跟踪。

在90赫兹和75赫兹VST模式下都支持手部跟踪,但跟踪帧速率在最初的版本中略有降低。(对于使用XR-4 FE的用户,请注意75 Hz模式提供了更大一点的垂直视野。)

针对真实环境进行了优化

该系统针对典型的办公室照明条件(200-500勒克斯)进行了优化。为了实现最佳性能,请确保您的环境光线充足,让VST相机捕捉高质量的帧。

无论是使用Varjo自带的内向外跟踪(IoT)或者Steam VR跟踪,手部跟踪都独立于头显的位置跟踪方法进行工作。

由机器学习驱动

该功能的核心是一个在Varjo内部训练的机器学习模型。该系统使用以下组合来检测和解释3D中的真实人类手部:

-

立体视觉通过头显的VST摄像头捕获

-

深度数据通过内置飞行时间传感器测量

通过对来自广泛领域的个人数据进行模型训练,确保了头显可稳定识别不同年龄、肤色、大小和性别的手部。

该推断是在CPU上执行的,因此具有高性能处理器的计算机将提供更加稳定的手部跟踪。GPU不用于手部跟踪,使用时请区分用户应用程序的优先级。