摘要

一 介绍

问题一:以往的研究尝试利用相关图像之间的一致性,通过探索不同的共享线索12, 13, 14或语义连接15, 16, 17,来助力图像组内的共同显著目标检测(CoSOD),什么意思?

一方面是探索不同的 "共享线索",这里的共享线索可以理解为在这组相关图像中,共同显著目标所具有的一些共通的、可被检测和利用的特征或信息线索,比如颜色特征、纹理特征等方面的共性线索。

另一方面是探索 "语义连接",语义连接指的是从语义层面上去挖掘图像之间的联系,比如这些图像中共同显著目标在语义概念上的关联,像它们都属于某一个特定的语义类别,或者它们在语义上存在某种逻辑关系等,通过这种语义连接的探索来助力共同显著目标检测任务。

二 有关工作

问题一:而共同显著目标检测(CoSOD)则旨在分割几张相关图像中的共同显著目标。 以往的研究主要利用图像间的线索来检测共同显著目标。图像间的线索是什么?

在共同显著目标检测(CoSOD)任务中,图像间的线索(Inter-image Cues) 是指从多张相关图像中提取的、能够帮助模型识别和定位共同显著目标的关联性信息。

1. 视觉相似性(Visual Similarity)

2. 语义一致性(Semantic Consistency)

3. 共现模式(Co-occurrence Patterns)

4. 对比性线索(Contrastive Cues)

5. 几何对应(Geometric Correspondence)

6. 时序或上下文关联(Temporal/Contextual Relations)

7. 以往研究的典型方法

-

传统方法:

-

低层特征聚类:如Li et al. 2014利用颜色直方图和区域聚类。

-

图模型:如Zhang et al. 2016构建图像间的马尔可夫随机场(MRF)。

-

-

深度学习方法:

-

注意力机制:如GCoNet中的组内协作模块(GAM)通过非局部注意力捕捉共性。

-

记忆库:如MCLNet通过记忆原型存储类别特征,增强跨图像检索能力。

-

总结

图像间线索是CoSOD任务的核心,本质是通过跨图像关联性分析从冗余信息中定位共性目标。当前研究正从传统特征匹配转向深度语义建模,结合对比学习和几何对齐进一步提升鲁棒性。

三 小组协作学习网络

3.1 体系结构概述

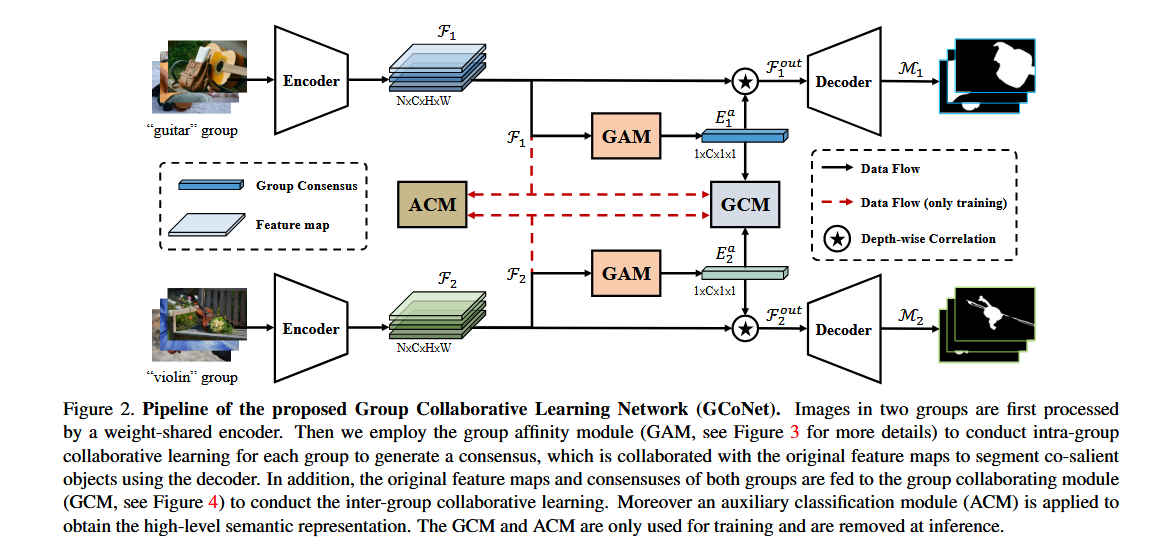

**图2.**所提出的群体协作学习网络(GCoNet)的流程。首先,两个图像组中的图像由一个权重共享的编码器进行处理。然后,我们使用群体亲和模块(GAM,更多细节见图3)对每个图像组进行组内协作学习,以生成一种一致性表示。这种一致性表示会与原始特征图相结合,通过解码器来分割出共同显著目标。 此外,两个图像组的原始特征图和一致性表示会被输入到群体协作模块(GCM,见图4)中,以进行组间协作学习。而且,会应用一个辅助分类模块(ACM)来获取高级语义表示。群体协作模块(GCM)和辅助分类模块(ACM)仅用于训练阶段,在推理阶段会被移除。

问题一:详细解释一下这张图?

这张图展示了 组协作学习网络(GCoNet) 的完整流程,其核心是通过 组内协作(GAM) 和 组间协作(GCM) 学习共显著目标的共性特征,最终生成分割掩码。以下是基于图中信息的逐步解析:

1. 输入与编码器(Encoder)

- 输入图像组 :图中示例为两组图像:

"guitar"组和"violin"组,每组包含多张同类别的图像(如不同角度/背景的吉他或小提琴)。 - 权重共享编码器 :

- 两组图像通过同一个 共享权重的编码器(如VGG16或ResNet)提取特征,生成原始特征图 F1 和 F2(尺寸:C×H×W)。

- 目的:确保不同组的特征空间一致,便于后续协作学习。

2. 组内协作学习(GAM: Group Affinity Module)

-

功能 :

对每组图像内部的特征进行融合,生成 组共识特征图(Group Consensus Feature Map),捕捉组内共显著目标的共性。 -

流程 :

- 输入:原始特征图 F1(吉他组)和 F2(小提琴组)。

- 组内特征融合 :

- 通过 深度相关性(Depth-wise Correlation) 计算组内图像特征间的相似性,筛选出共性强的高响应区域。

- 生成共识特征图 F1′(吉他组)和 F2′(小提琴组)。

- 输出:每组一个统一的共识特征图,抑制组内非共性的背景噪声。

3. 组间协作学习(GCM: Group Collaborative Module)

-

功能 :

利用两组共识特征图 F1′ 和 F2′ 进行 跨组对比学习,强化共显著目标的判别性特征。 -

流程 :

- 输入:原始特征图 F1,F2 + 共识特征图 F1′,F2′。

- 跨组交互 :

- 通过注意力机制或特征对比,让模型学习"吉他"和"小提琴"组的 差异特征(如形状、纹理),避免将不同类别的物体误判为共显著。

- 输出优化后的特征 Fout。

- 注意 :GCM 仅在训练时使用,推理时移除,以提升效率。

4. 辅助分类模块(ACM: Auxiliary Classification Module)

- 功能 :

通过高层语义分类(如"吉他" vs "小提琴")约束特征学习,增强共显著目标的语义一致性。 - 实现 :

- 在共识特征图 F1′ 和 F2′ 上附加分类头(全连接层+Softmax),预测图像组类别。

- 损失函数:交叉熵损失,与分割任务联合训练。

- 作用:防止模型将不同类别的共性背景(如舞台、灯光)误判为共显著目标。

5. 解码器(Decoder)与输出

- 输入 :

- 训练时:融合后的特征 Fout(含GCM优化)。

- 推理时:仅使用组共识特征图 F1′ 或 F2′。

- 解码器结构 :

- 通过上采样和跳跃连接(可能来自编码器的低层特征)逐步恢复空间分辨率。

- 输出分割掩码 M1(吉他组)和 M2(小提琴组),尺寸与输入图像相同。

6. 数据流与训练/推理区别

- 数据流标注 :

- 蓝色实线:训练和推理均存在的数据流(如编码器→GAM→解码器)。

- 红色虚线:仅训练时的数据流(GCM和ACM)。

- 关键设计 :

- 训练时通过 跨组对比(GCM) 和 语义监督(ACM) 提升模型鲁棒性,推理时简化流程,仅保留组内协作(GAM)。

7. 核心创新点总结

- 组内协作(GAM):通过深度相关性生成共识特征,解决组内图像差异问题(如视角变化)。

- 组间协作(GCM):跨组对比学习,避免不同类别间的共性干扰(如乐器 vs 背景)。

- 端到端训练:联合优化分割损失(如IoU Loss)和分类损失(ACM),提升语义一致性。

3.2 小组亲和力模块

问题一:群体亲和模块(GAM)通过计算一个图像组中所有图像之间的全局亲和度来实现。什么意思?

群体亲和模块(Group Affinity Module, GAM) 的核心是通过计算 图像组内所有图像间的全局相似性 ,提取多张图像中 共显著目标的共性特征 。其作用类似于CONDA模型中的 超关联计算(HAC) ,但专注于 组内 (同一类别多图像)而非 跨图像(不同场景)的关联。

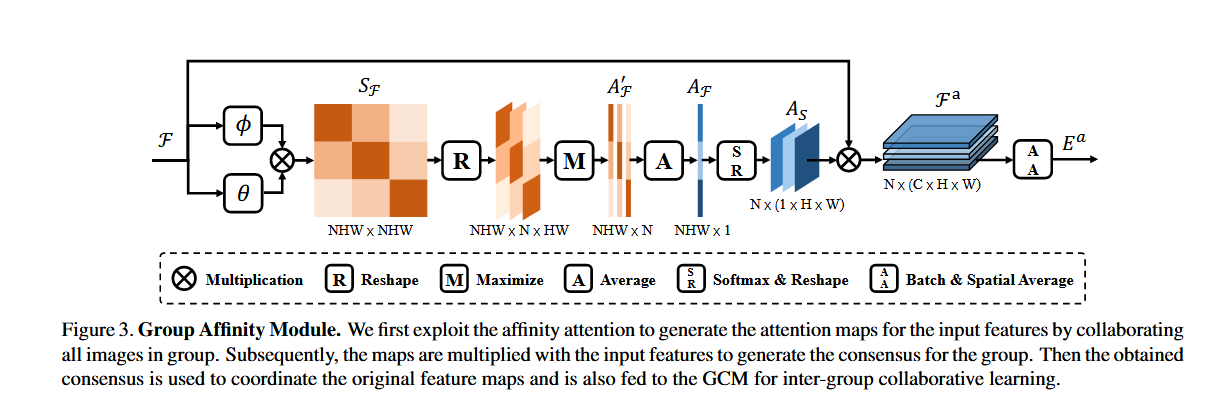

图3. 群体亲和模块。我们首先利用亲和注意力机制,通过协同处理图像组中的所有图像,为输入特征生成注意力图。随后,将这些注意力图与输入特征相乘,从而为该图像组生成一致性特征。接着,所得到的一致性特征将用于协调原始特征图,并且也会被输入到群体协作模块(GCM)中,以进行组间协作学习。

问题二:详细解释一下这张图?

这张图展示的是 组亲和模块(Group Affinity Module, GAM) 的详细流程,其核心是通过 亲和注意力(Affinity Attention) 从输入的一组图像特征中提取共显著目标的共性特征,生成注意力图并融合到原始特征中。

1. 输入与符号说明

-

输入特征:

-

形状为 N×C×H×W 的张量 F,表示一组 N 张图像的特征(每组图像共享共显著目标,如多张"吉他"图像)。

-

例如:N=4, C=256, H=16, W=16。

-

-

关键操作符号:

-

⊗:矩阵乘法(Multiplication)

-

R:重塑(Reshape)

-

M:最大化(Maximize)

-

A:平均(Average)

-

Φ:特征变换函数(如卷积+激活)

-

θ:可学习参数(如注意力权重)

-

2. 流程分步详解

(1) 生成亲和注意力图

-

特征变换 :输入特征 F 通过函数 Φ 和参数 θ 处理,得到中间特征

(可能与 F 同维度)。

(可能与 F 同维度)。 -

重塑为关联矩阵 R:

-

将

重塑为 NHW×HW 的矩阵 R,其中每行代表一个空间位置(共 NHW 个)与所有图像所有位置的关联性。

重塑为 NHW×HW 的矩阵 R,其中每行代表一个空间位置(共 NHW 个)与所有图像所有位置的关联性。 -

目的:计算组内所有图像特征间的全局相关性。

-

(2) 最大化与平均操作

-

最大化操作 M:

-

对矩阵 R 沿特定维度(如列)取最大值,得到 NHW×NW 的矩阵

。

。 -

作用:筛选每组图像中最显著的关联区域(共性强的高响应区域)。

-

-

平均操作 A:

-

对

进一步平均,得到 NHW×N 的矩阵

进一步平均,得到 NHW×N 的矩阵 。

。 -

作用:生成每组图像的注意力权重,表示每组内各图像对共识特征的贡献。

-

(3) Softmax归一化与重塑

-

Softmax & Reshape R:

-

对

沿最后一维(N)应用Softmax,得到归一化注意力权重。

沿最后一维(N)应用Softmax,得到归一化注意力权重。 -

重塑为 N×(C×H×W) 的矩阵

。

。

-

(4) 特征融合

-

矩阵乘法 ⊗:

-

将注意力权重

与原始输入特征 F(重塑为 N×(C×H×W))相乘,得到加权特征

与原始输入特征 F(重塑为 N×(C×H×W))相乘,得到加权特征 。

。 -

物理意义:增强共显著目标的特征,抑制非共性背景。

-

(5) 批量和空间平均 As

-

平均操作 As:

-

对

沿批量和空间维度(H×W)求平均,得到 N×C 的矩阵

沿批量和空间维度(H×W)求平均,得到 N×C 的矩阵  。

。 -

作用:生成每组图像的共识特征向量,用于后续的组间协作(GCM)或解码。

-

3. 核心设计思想

-

亲和注意力机制:通过全局关联矩阵 R 和最大化-平均操作,从组内图像中挖掘共性特征,避免单张图像的噪声干扰。

-

动态权重分配:Softmax确保不同图像对共识特征的贡献自适应调整(如某些图像视角更优,权重更高)。

-

与GCM的衔接 :输出的共识特征 Ea 会输入到 组间协作模块(GCM),通过跨组对比进一步区分共显著目标与干扰项。

4. 与图3标注的对应关系

-

图中标注的符号(如 Sf、Af、A5)可能为中间变量或笔误,实际流程应以文字描述为准。

-

关键路径 :

5. 技术优势

-

鲁棒性:对组内图像的视角、遮挡、背景变化具有适应性。

-

端到端学习:所有操作(重塑、最大化、平均)可微分,支持反向传播。

3.3 小组协作模块(GCM)

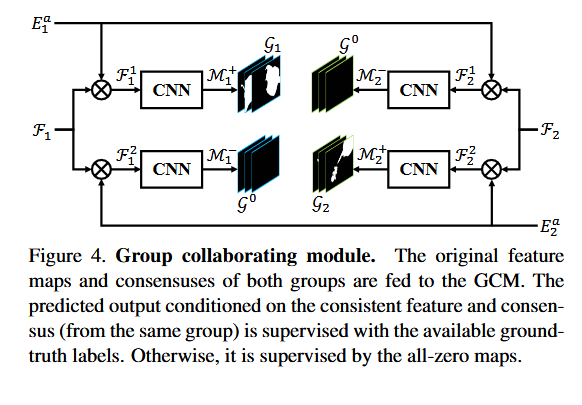

**图4.**群体协作模块。两个图像组的原始特征图和一致性特征都被输入到群体协作模块(GCM)中。基于一致的特征和一致性特征(来自同一图像组)所预测的输出,会使用可用的真实标签进行监督。否则,该输出将由全零图进行监督。

问题一:详细解释一下这张图?

这张图展示的是 组协作模块(Group Collaborative Module, GCM) 的详细流程,其核心是通过 跨组对比学习 和 双重监督机制 ,从两组图像的原始特征和共识特征中提取共显著目标的判别性特征。

1. 输入与模块功能

-

输入特征:

-

原始特征图:F1(组1,如"吉他"组)和 F2(组2,如"小提琴"组),形状为 C×H×W。

-

共识特征:E1a 和 E2a,来自组内协作模块(GAM)的组共识特征向量(形状 N×C)。

-

-

功能:

-

通过跨组对比,强化共显著目标的共性特征,同时抑制不同组间的干扰(如背景共性)。

-

仅在训练时使用,推理阶段移除以提升效率。

-

2. 核心流程分步解析

(1) 特征输入与分支处理

-

输入分配:

-

组1的原始特征

和共识特征

和共识特征 输入到 上分支(Group 1分支)。

输入到 上分支(Group 1分支)。 -

组2的原始特征

和共识特征

和共识特征  输入到 下分支(Group 2分支)。

输入到 下分支(Group 2分支)。

-

(2) 并行CNN处理

-

CNN特征变换:

-

每个分支通过两个独立的 CNN模块(图中标注为"CNN")处理:

-

正监督路径 (

):

):-

输入:原始特征

同组共识特征

同组共识特征  。

。 -

输出:掩码预测

(监督信号:真实标签

(监督信号:真实标签  )。

)。

-

-

负监督路径 (

):

):-

输入:原始特征

跨组共识特征

跨组共识特征  。

。 -

输出:掩码预测

(监督信号:全零掩码

(监督信号:全零掩码  )。

)。

-

-

-

同理,组2分支生成

(监督:

(监督: )和

)和 (监督:

(监督: )。

)。

-

(3) 特征融合与输出

-

跨组特征交互:

-

正负路径的输出

、M1− 与原始特征

、M1− 与原始特征  融合,生成优化后的特征

融合,生成优化后的特征  。

。 -

同理,组2生成

。

。

-

-

最终输出 :两组优化特征

作为后续解码器的输入(图中未展示解码器部分)。

作为后续解码器的输入(图中未展示解码器部分)。

3. 监督机制设计

-

正监督(

) :使用 真实标签

) :使用 真实标签  监督同组共识特征生成的掩码

监督同组共识特征生成的掩码 ,确保共显著目标被正确分割。

,确保共显著目标被正确分割。 -

负监督(

) :使用 全零掩码

) :使用 全零掩码  监督跨组共识特征生成的掩码

监督跨组共识特征生成的掩码  ,强制模型忽略不同组别的共性干扰(如背景)。

,强制模型忽略不同组别的共性干扰(如背景)。 -

目的 :通过对比学习,模型学会区分 组内共性 (如吉他形状)和 跨组共性(如舞台灯光),提升鲁棒性。

4. 关键符号与图中标注对应

5. 技术优势与创新点

-

双重监督机制:正负监督联合优化,避免模型将跨组背景误判为共显著目标。

-

轻量化设计:仅训练阶段引入GCM,推理时仅保留GAM,兼顾性能与效率。

-

端到端训练:与GAM、解码器联合训练,形成完整的共显著目标检测 pipeline。

6. 与GAM模块的协作关系

-

GAM:负责组内共性提取(如吉他组内部的共同特征)。

-

GCM:负责组间差异学习(如吉他 vs 小提琴的区分)。

-

协同作用 :GCM依赖GAM提供的共识特征

,进一步优化判别能力。

,进一步优化判别能力。

7. 总结

GCM模块通过 跨组对比监督 和 特征交互,解决了共显著检测中的两大难点:

-

组内共性强化(正监督路径)。

-

跨组干扰抑制 (负监督路径)。

最终输出的优化特征

能够更精准地定位共显著目标。

能够更精准地定位共显著目标。

3.4 辅助分类模块(ACM)

问题一:辅助分类模块(ACM)的提出是为了解决什么问题,他的作用是什么?

1. 解决的问题

(1) 共显著目标的语义混淆

-

问题背景 :在多组图像(如"吉他"组和"小提琴"组)中,可能存在 跨组别的共性背景干扰(例如舞台灯光、木质纹理),模型可能错误地将这些背景特征误判为共显著目标。

-

ACM的作用:通过高层语义分类(如"吉他" vs "小提琴"),强制模型区分不同组别的语义类别,避免将背景共性误认为目标共性。

(2) 组内特征一致性不足

-

问题背景:组内协作模块(GAM)生成的共识特征可能因图像差异(如视角、遮挡)而包含噪声。

-

ACM的作用:通过分类任务约束共识特征的语义一致性,确保组内图像的特征融合聚焦于真正的共显著目标(如吉他的琴弦、琴身)。

2. ACM的核心作用

(1) 语义监督(Semantic Supervision)

-

实现方式:在共识特征图(来自GAM)上附加分类头(如全连接层+Softmax),预测图像组的类别标签。

-

效果:

-

增强模型对 共显著目标类别 的敏感性(如"吉他"组的特征应更关注乐器部分,而非背景)。

-

抑制跨组别的无关共性(如"吉他"和"小提琴"组共享的舞台背景)。

-

(2) 联合优化(Joint Optimization)

-

训练机制:

-

ACM与分割任务(GAM/GCM)联合训练,损失函数包含两部分:

-

分割损失(如IoU Loss):优化共显著目标的分割精度。

-

分类损失(如交叉熵损失):优化组别分类准确性。

-

-

梯度反传:分类损失通过共识特征反向传播,间接优化GAM的特征提取能力。

-

(3) 推理阶段的简化

-

部署方式:

-

ACM 仅在训练阶段使用,推理时移除,不增加计算负担。

-

训练后,模型仅依赖GAM和GCM生成的共识特征进行分割,但分类任务已隐含提升了特征判别性。

-

3. 与GCM的协同关系

-

GCM :通过跨组对比(正/负监督)解决 空间特征干扰(如背景相似性)。

-

ACM :通过语义分类解决 高层语义干扰(如类别相关性)。

-

协同效果:

-

GCM确保组间特征差异(吉他 vs 小提琴的形状差异)。

-

ACM确保组内特征语义一致(吉他组的特征聚焦乐器本身)。

-