1、Ollama官网下载安装

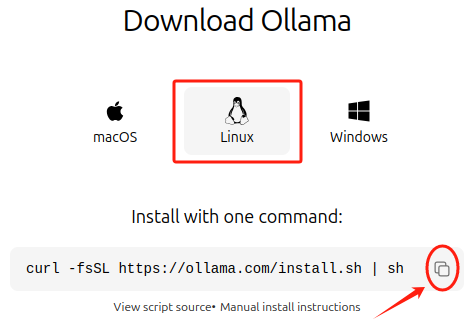

在Ubuntu系统中打开浏览器,打开Ollama官网:Ollama,点击下载。在下载页面,复制下载地址:

打开终端,输入复制的命令,即可自动下载安装。

但是速度很慢很慢!

2、离线下载安装

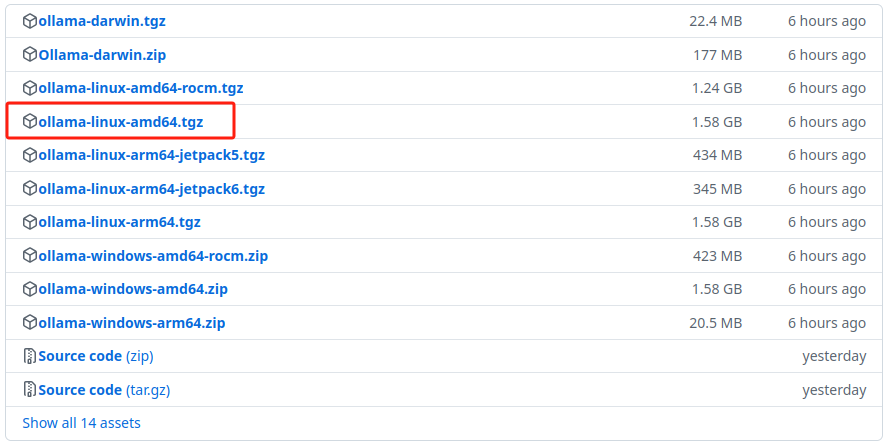

可以直接到Ollama的Github仓库(Releases · ollama/ollama · GitHub)下载对应的安装包安装。

对于运行在Intel和Amd芯片上的Ubuntu系统,一般选择ollama-linux-amd64,这是一个通用版本,旨在运行于标准Linux系统上的x86_64架构CPU上,并未特别集成任何GPU 或者其他专用硬件的支持;ollama-linux-amd64-rocm专门针对AMD ROCm (Radeon Open Compute)平台进行了优化和支持。ROCM 是由AMD 开发的一套用于 GPU 加速计算的开源软件栈,适用于特定型号的AMD显卡。

但是,下载速度其实和Ollama官网下载一样的,官网安装下载时也是从这个仓库下载安装包。

参考:Linux Ollama离线安装方法_ollama linux安装-CSDN博客

下载好的程序包上传至需要离线安装的Linux主机,执行解压命令解压:

# 以amd构建程序包为例

sudo tar -C /usr -xzvf ollama-linux-amd64.tgz然后启动ollama服务

ollama serve3、使用Git加速器下载安装

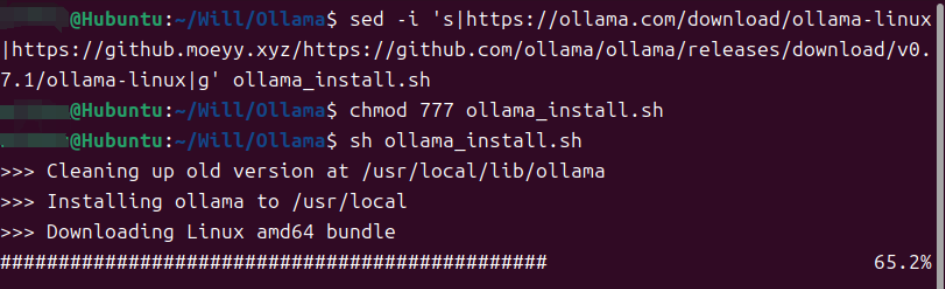

首先,下载ollama_install.sh并保存。在home目录下的或者是工作空间下的某一个地址执行:

curl -fsSL https://ollama.com/install.sh -o ollama_install.sh目录下面会生成ollama_install.shCopy文件。使用github文件加速替换github下载地址,加速地址可以百度搜索,比如:GitHub 文件加速。在ollama_install.sh文件目录下执行命令:

sed -i 's|https://ollama.com/download/ollama-linux|https://github.moeyy.xyz/https://github.com/ollama/ollama/releases/download/v0.7.1/ollama-linux|g' ollama_install.sh # https://github.moeyy.xyz 是Git加速器地址;https://github.com/ollama/ollama/releases/download/v0.7.1/ollama-linux是最新版本Ollama的Github仓库地址前缀。对文件中下载链接地址进行替换。其中:https://github.moeyy.xyz 是Git加速器地址;https://github.com/ollama/ollama/releases/download/v0.7.1/ollama-linux 是最新版本Ollama的Github仓库地址前缀。可在Ollama的Github仓库中目标安装包右击复制链接得到,注意要删除链接中最后的目标架构字段,如:https://github.com/ollama/ollama/releases/download/v0.7.1/ollama-linux-amd64.tgz只取:https://github.com/ollama/ollama/releases/download/v0.7.1/ollama-linux

增加可执行权限

chmod 777 ollama_install.sh执行sh下载安装

sh ollama_install.sh下载速度会快很多!

安装完成后,显示:

>>> Creating ollama user...

>>> Adding ollama user to render group...

>>> Adding ollama user to video group...

>>> Adding current user to ollama group...

>>> Creating ollama systemd service...

WARNING: systemd is not running

>>> The Ollama API is now available at 127.0.0.1:11434.

>>> Install complete. Run "ollama" from the command line.

WARNING: No NVIDIA/AMD GPU detected. Ollama will run in CPU-only mode.

>>> The Ollama API is now available at 127.0.0.1:11434.

>>> Install complete. Run "ollama" from the command line.随后使用命令启动Ollama:

sudo ollama serve