AI领域每隔一段时间都有新的概念和技术出来:年初DeepSeek火热带动深度推理模型,五一前阿里推出的Qwen3就升级为混合推理模型;3月份manus展示号称全球首款通用型智能体,到现在OpenAI和阿里也都有类似的通用Agent;Anthropic去年11月提出MCP标准,今年逐渐得到各大厂商的认可以后,Google今年4月份又提出A2A协议;Google去年底推出的DeepResearch研究报告,现在OpenAI和阿里也都有类似产品;还有之前的提示词工程,7月初大佬Andrej Karpathy提出上下文工程更重要等。

这么多层出不穷的新概念和技术,我们要怎么学习呢?如果我们刚开始入门,要进行AI应用场景的落地,我们应该掌握哪些技术?是否有一套基础技术体系,能让我们建立起对AI应用层面的核心认知框架,当新的概念和技术出来了,我们都能有序应对,合理判断在自己的业务场景是否适用。

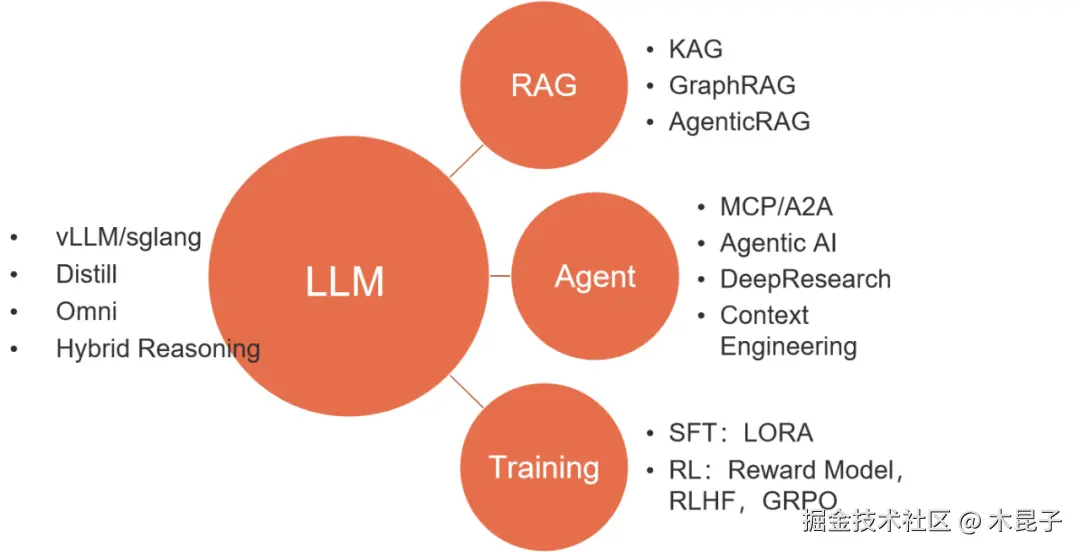

本文以容易理解的信息化视角,结合实际项目经验,梳理一套AI应用层面的基础技术体系,按投入成本和落地难度从小到大分别是:LLM基础对话<RAG<Agent<Training,同时将近期出现的一些新技术和新方向都归纳到这个体系层次中去,助力读者建立起对AI的核心认知框架。

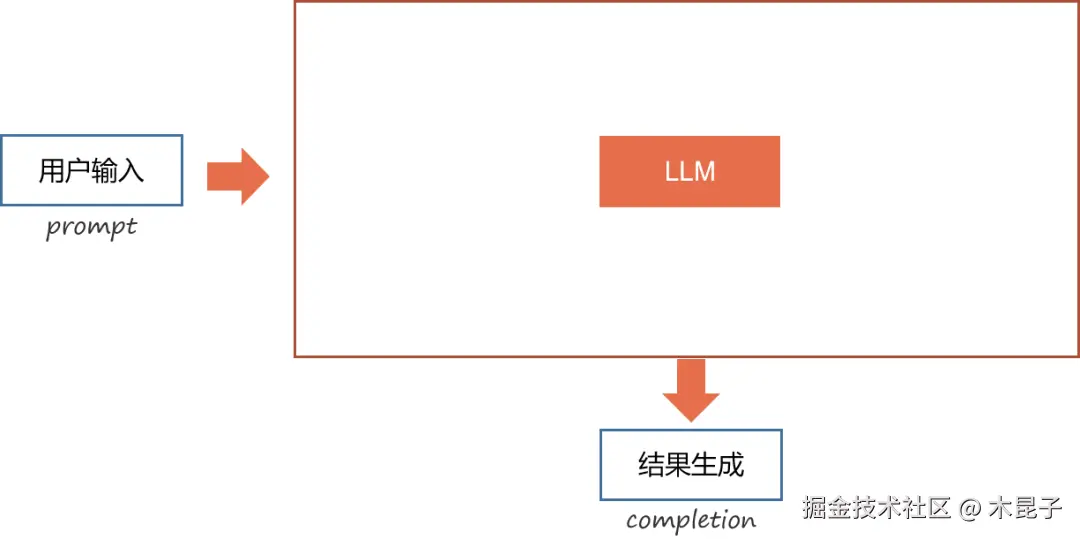

LLM基础模式

一些最基础的问答场景中,你会要求LLM模仿某种角色来回答用户的提问,或者要求LLM根据用户的输入来生成相应的内容,同时要求遵守某种结构进行生成答案,并做一些限制(比如不能随意发挥)等。这类LLM的基础使用模式,主要就是利用LLM的系统提示词,其核心结构非常简单大致如下:

在LLM这个层面,当我们落地部署和使用时经常碰到的基础概念有:token、向量、参数、参数量(模型尺寸)、量化压缩、精度提升等等,这部分入门概念和技术有很多文章介绍,在此不做赘述,只要清楚这些概念都属于LLM层面即可。

在LLM基础模式之上,接下来我们逐步拓展RAG<AI Agent<Training的使用模式和技术体系。

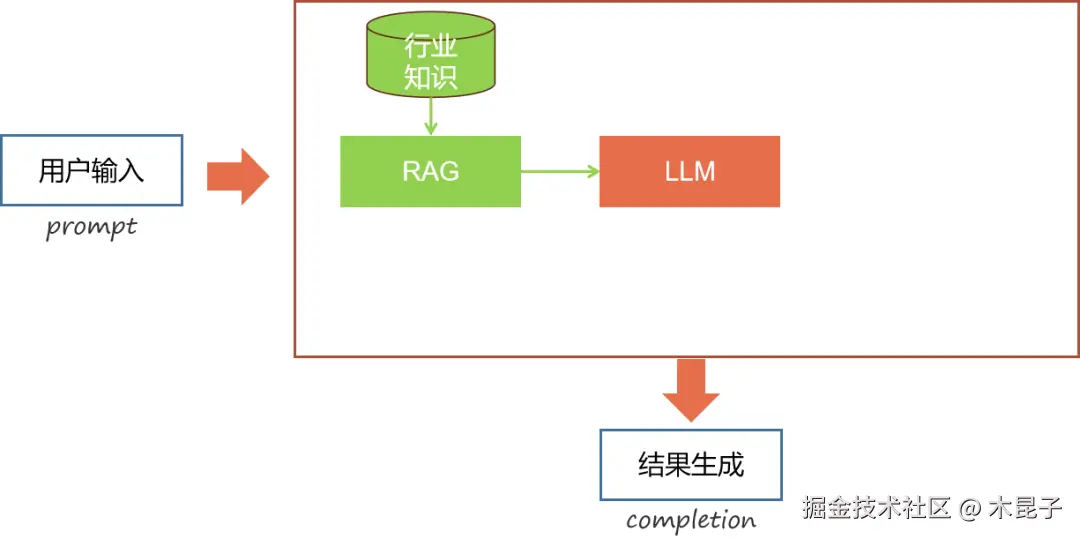

RAG检索增强生成模式

在以上利用LLM进行对话的基础上,当你发现LLM缺少最新知识、或者缺乏某个行业领域内部知识,造成大模型产生幻觉时,通常就需要采用RAG方案了(Retrieval-Augmented Generation 对应检索增强生成),也就是要通过检索外挂知识库来增强LLM的生成能力,其核心结构演变如下:

RAG模式里从知识准备到知识检索过程中,涉及到一些基础技术概念包括:文档解析预处理、文档切片/分段、向量化、知识检索(标签筛选、关键词检索、全文检索、语义检索等)、检索召回率和准确率等,具体可以参考《RAG基础逻辑介绍》这篇文章。

上图只是简单场景示意,在调用LLM之前,先利用RAG检索行业知识或内部知识,然后输入给LLM来增强生成。但实际场景中远远比这复杂,甚至有可能要依据LLM来动态规划何时需要检索知识库,动态决策要检索内容,这就是Agentic RAG了。

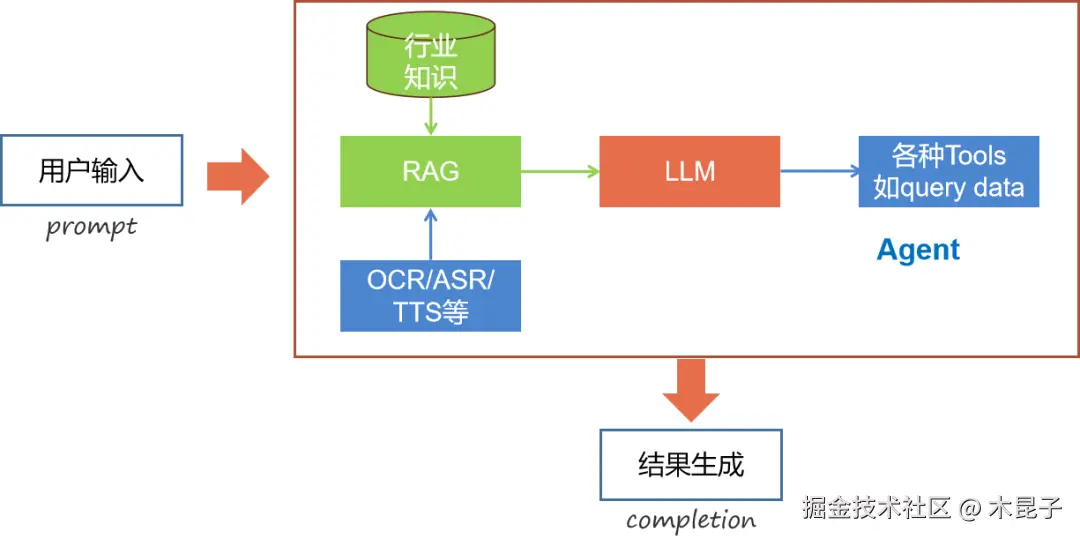

AI Agent智能体模式

在以上RAG的基础上,如果你还需要进一步调用工具,比如要调用工具查询数据库,比如要调用查询天气、订票的工具等,比如在知识库检索之前,需要先进行OCR识别,或者先基于ASR进行语音识别,得到文本再进行检索,比如在大模型和工具调用之后,需要将文字转成语音输出,利用TTS进行转换等。

总之就是为了满足某个业务场景,就不仅是简单调用LLM,也不仅是进行RAG知识检索,还需要进行业务逻辑组合,包括工具调用和各种小模型的串联等等,这就进入到AI Agent的范畴了,其核心结构演变如下:

AI Agent核心就是根据处理逻辑需要,组合串联工具、大模型和小模型,甚至包含多次LLM调用。其处理逻辑执行范式大概有两种,一种是有明确处理流程的workflow模式,一种是需要动态决策,边执行边修正的ReAct模式,详见笔者之前写的这篇文章《从workflow到ReAct提升AI Agent智能化水平》。

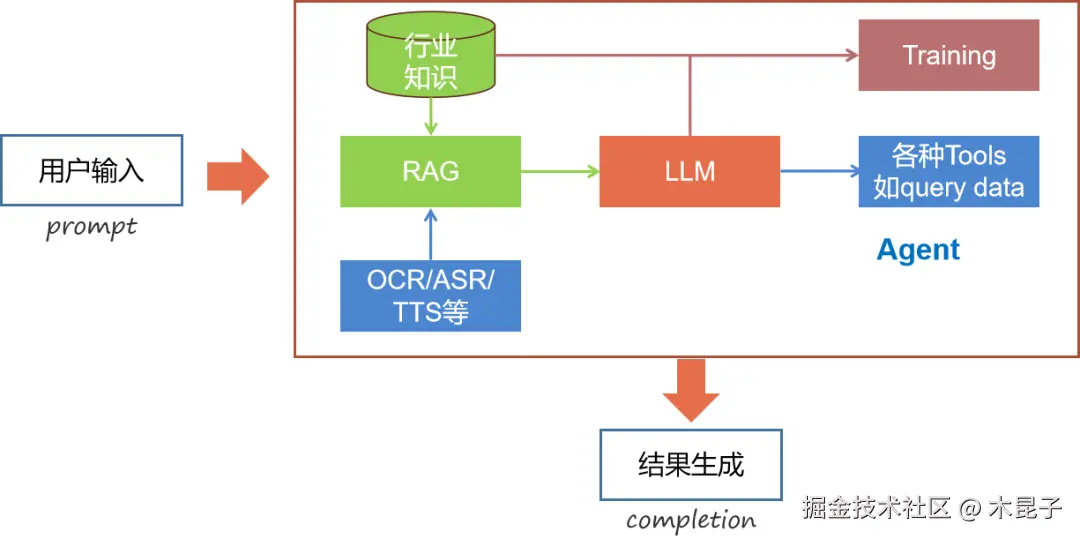

Training训练模式

在以上AI Agent基础上,假如你发现增加了知识库RAG,增加了各种工具调用后,实现效果还是不够理想,生成结果还是不够精准的话,这个时候你可以考虑对LLM进行一定的微调训练,利用你知识库中准备好的行业知识来进行微调,得到垂域大模型,再应用到AI Agent中去,其核心结构演变如下:

这种模式相当于把外挂知识库内化到通用LLM中去了,需要依赖一定的硬件算力来做训练,比单纯推理使用时需要的算力更多,人员能力上的要求也更高,所以这种模式从投入成本和落地难度来说都是最高的。

当然本文所说的训练,主要不是指预训练,因为我们不是大模型厂商,我们更多是从落地使用角度出发,关注微调和强化学习等后训练技术,具体可以参考笔者之前文章《大模型如何"练成"?详解训练、微调与强化学习的基础逻辑》。

四个层次的技术发展趋势

从落地角度看,以上四个层次是逐层递进,同时回到本文开头提到近期AI领域涌现的这些新技术、新概念,其实都是可以归纳到这四个层次,笔者简单梳理如下:

如图LLM层面技术趋势都是围绕着如何让LLM使用代价更小、能力更强两个方向,使用代价更小的技术包括各种量化压缩、推理加速框架的创新、模型蒸馏Distill(从大模型蒸馏出小尺寸的模型)等,能力更强方向包括各家厂商都推出自己的多模态大模型Omni、从DeepSeekR1深度推理模型演变到Qwen3的混合推理模型等。

RAG层面技术更多是围绕着如何更精准、如何更智能的知识检索等方向,包括图中所列KAG、GraphRAG、AgenticRAG等,其中KAG是基于图谱结构的知识来进行增强,和传统文本分片知识区别在于图谱知识之间的关联性更强,详见《论文解读:KAG出道,RAG已死》,而GraphRAG虽然也是基于知识图谱,但其核心是在于社区聚类层层汇总摘要,详见《论文解读|一种GraphRAG方法》。

AI Agent层面上半年最热闹的话题就是MCP和A2A两个协议规范了,一个用于规范Agent调用工具的规范,另一个用于规范多个Agent之间协作的规范,此外还有DeepResearch,以及最近比较热的上下文工程Context Engineering等,这些技术都是越来越接近应用层面了。

Training后训练层面的微调SFT和强化学习RL,其实笔者对发展趋势还没有太多研究,现阶段能把微调LORA落地实践一把就很不错了。

这篇文章拖延了半个多月,主要是之前把框架搭好以后,就看到已经有大神有类似主题的总结文章了,所以就一直在纠结还有没有必要写,再加上最近共工作又很忙,就找到理由拖下来了。

但最近看到"完成比完美重要"这句话,就反复暗示自己哪怕文章主题差不多,也许多一种视角来描述也会更有强化作用,也许多一个号来讲解就会多一点传播,能多帮助到一个正在上下求索的同学也就有价值了。

另本文所述更多是AI应用层面的技术体系,不涉及LLM的技术原理,对于Transformer架构、Attention注意力机制、Q/K/V矩阵等,说实话不甚精通(虽然也仔细研读过相关文章),毕竟不是专业算法人员,笔者只是根据工作需要,正在从信息化、数字化领域过渡到智能化领域,所以更多关注LLM如何落地应用,将个人实践和工作中的一些心得和体会总结成文,希望对和我一样正在转型的同学有所帮助。

---End---