基于YOLOv8的有无戴安全帽检测识别项目|完整源码数据集+PyQt5界面+完整训练流程+开箱即用!

源码包含:完整YOLOv8训练代码+数据集(带标注)+权重文件+直接可允许检测的yolo检测程序+直接部署教程/训练教程'

项目摘要

本项目集成了 YOLOv8 安全帽检测模型 与 PyQt5 图形界面工具 ,实现了包括图片、文件夹、视频与摄像头等多种输入方式的自动识别功能。配套完整源码与训练流程说明,让你开箱即用、快速部署自己的安全帽检测系统。适用于建筑工地、工厂车间、实验室等对人员安全有严格要求的场所。

前言

在工业场景与施工现场中,佩戴安全帽是保障人员人身安全的基本措施。然而,人工巡查耗时低效且难以全面覆盖。借助深度学习目标检测模型,结合摄像头监控或图片采集设备,我们可以构建自动化安全帽识别系统,大幅提升安全管理水平。

本项目以轻量化、开源、可部署为目标,基于 YOLOv8模型 实现安全帽目标检测,支持"未佩戴"和"已佩戴"两类目标识别,配合 PyQt5界面交互,适合在实际项目中快速落地应用。

一、软件核心功能介绍及效果演示

1.1 模型检测效果

使用YOLOv8进行训练后,模型对两类目标(佩戴 / 未佩戴安全帽)识别精准、响应快速:

- 检测精度:mAP@0.5 达到 90%以上

- 响应速度:GPU实时检测速度可达 30 FPS+

- 适配场景:复杂工地、多人重叠、角度变化等情况均可识别

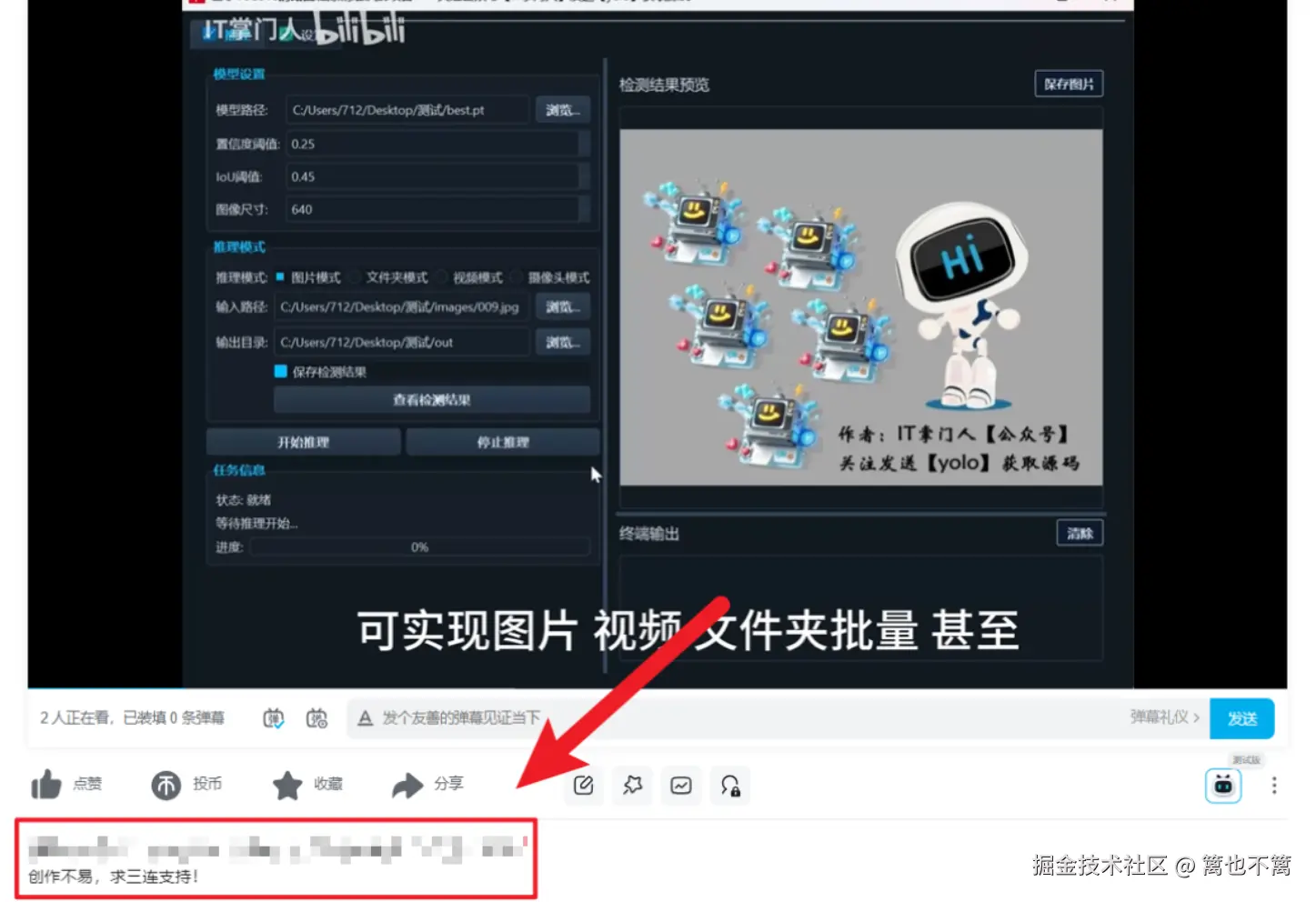

1.2 图形界面功能(PyQt5)

主界面功能一览:

| 功能模块 | 描述 |

|---|---|

| 图像检测 | 加载本地图片进行识别 |

| 视频检测 | 支持MP4/AVI格式视频检测 |

| 摄像头检测 | 可直接调用本地摄像头 |

| 文件夹检测 | 可自动遍历文件夹中所有图片 |

| 结果保存 | 自动保存标注后图片及结果数据 |

二、软件效果演示

为了直观展示本系统基于 YOLOv8 模型的检测能力,我们设计了多种操作场景,涵盖静态图片、批量图片、视频以及实时摄像头流的检测演示。

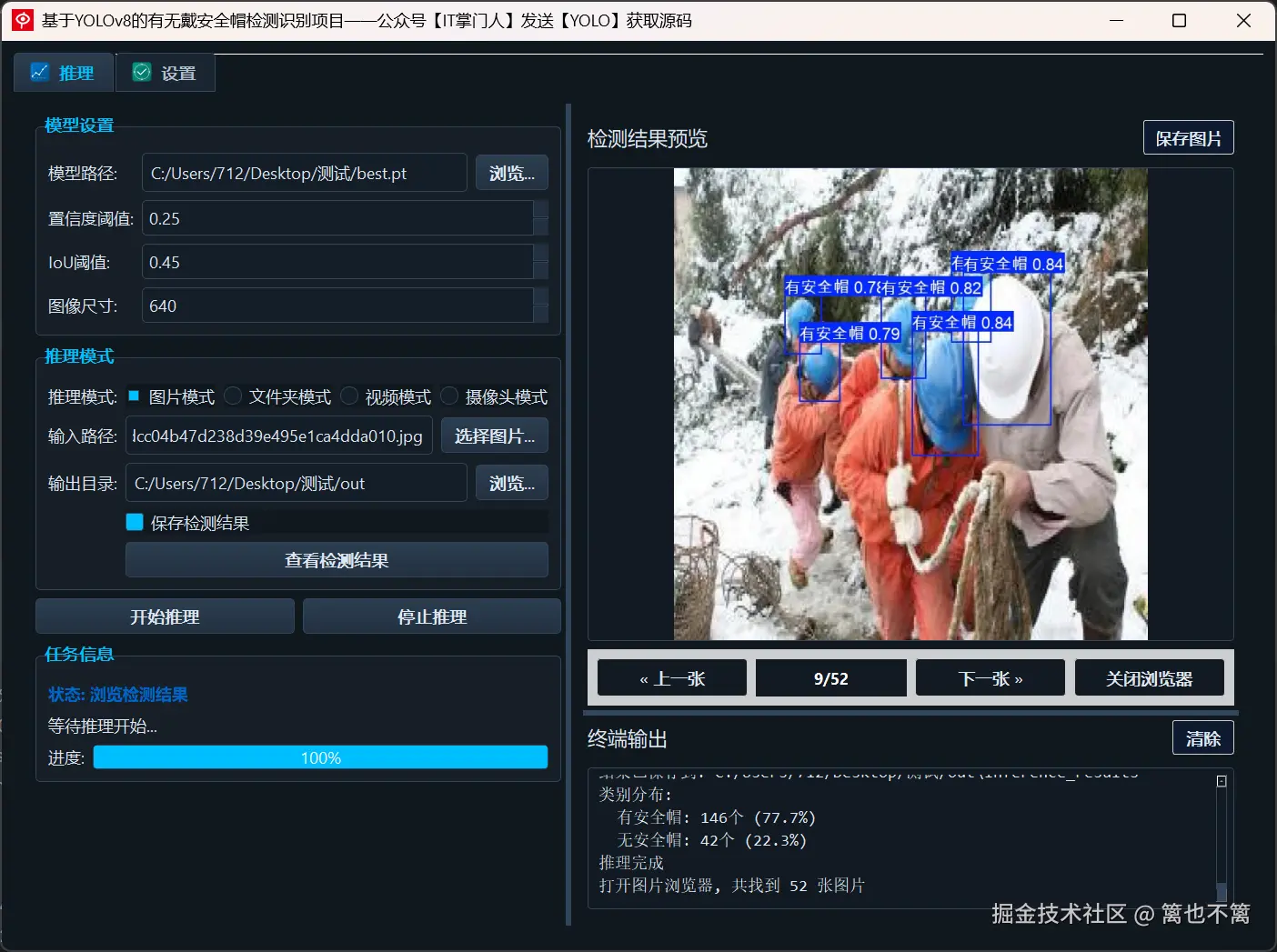

(1)单图片检测演示

用户点击"选择图片",即可加载本地图像并执行检测:

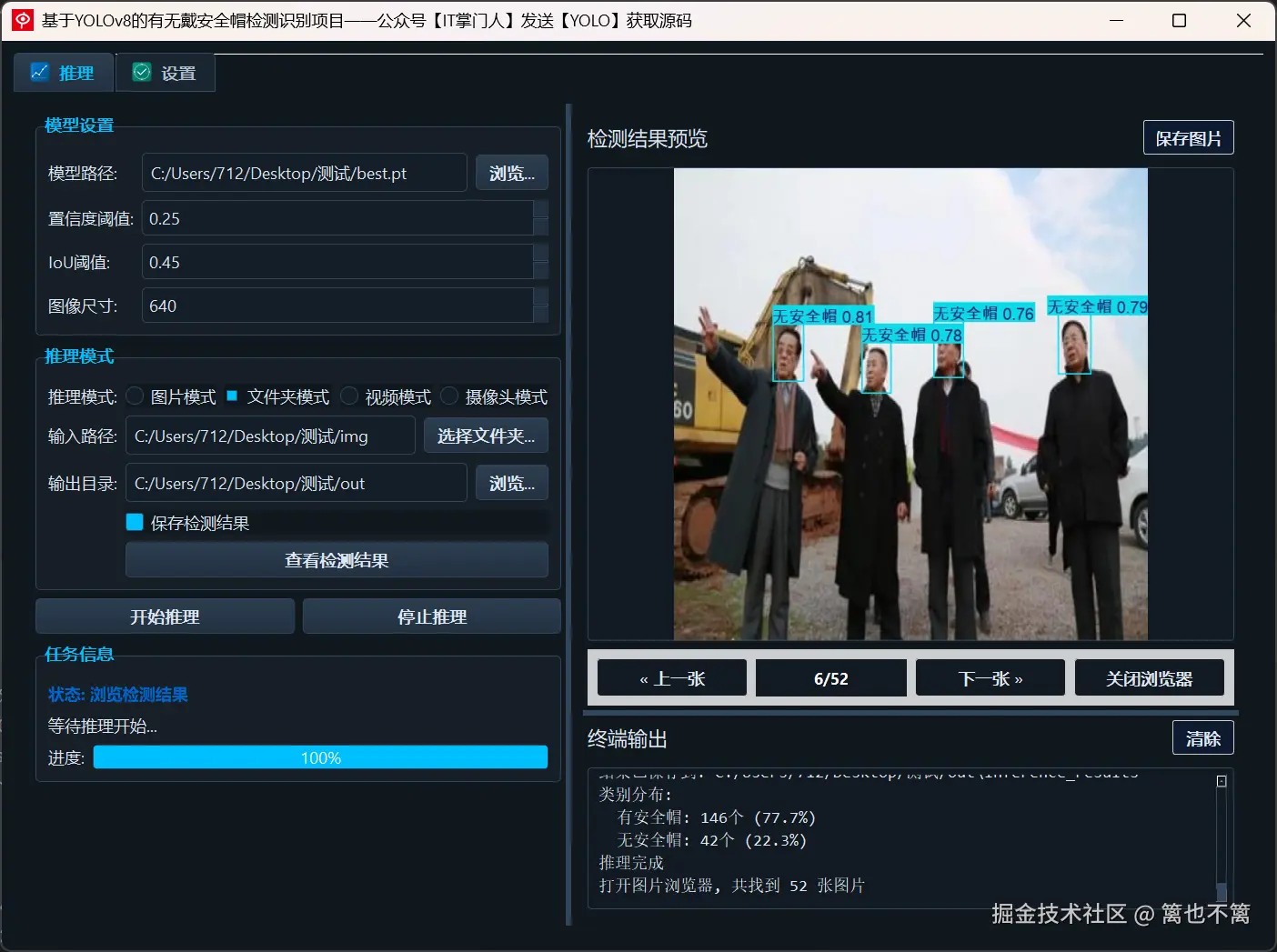

(2)多文件夹图片检测演示

用户可选择包含多张图像的文件夹,系统会批量检测并生成结果图。

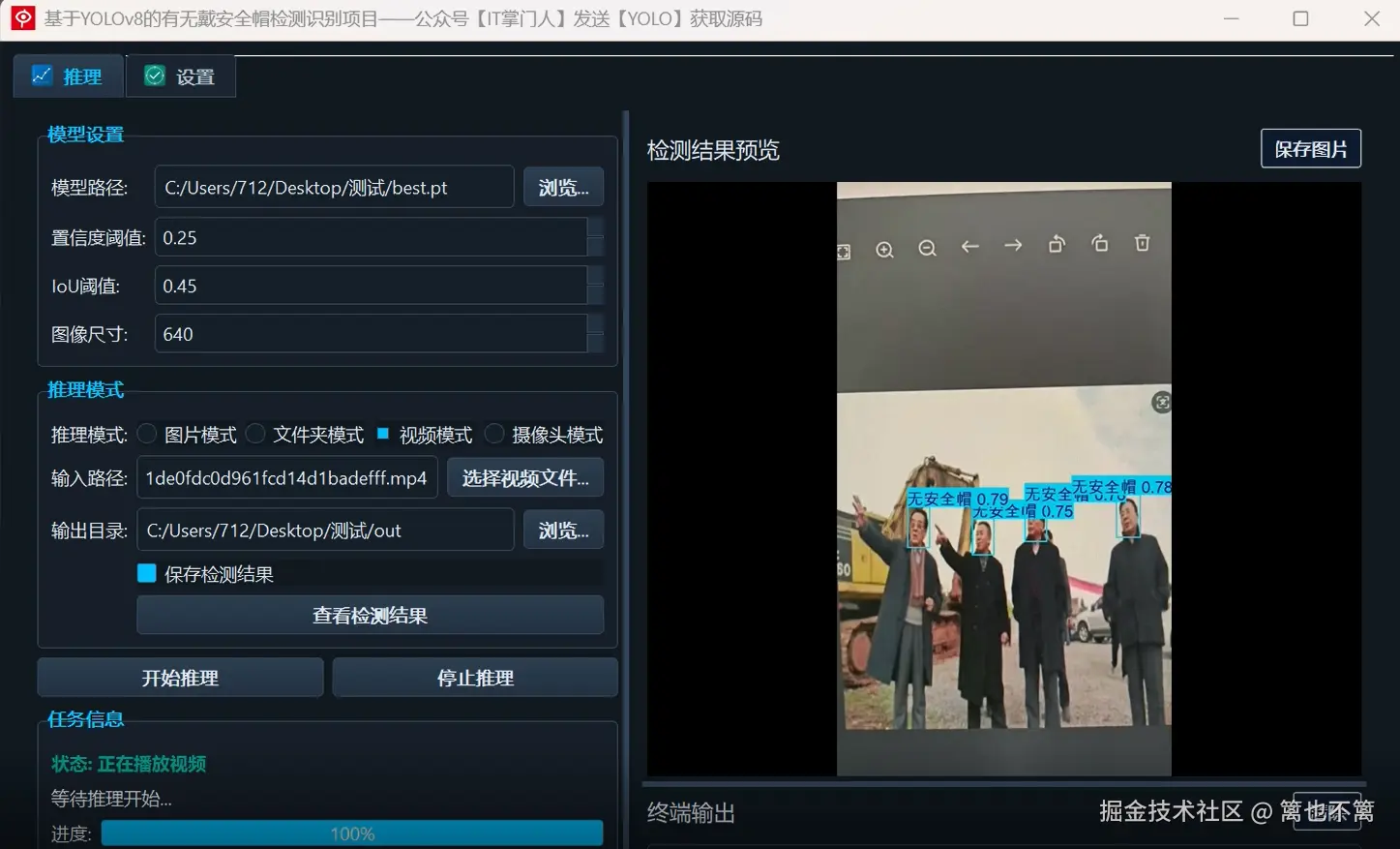

(3)视频检测演示

支持上传视频文件,系统会逐帧处理并生成目标检测结果,可选保存输出视频:

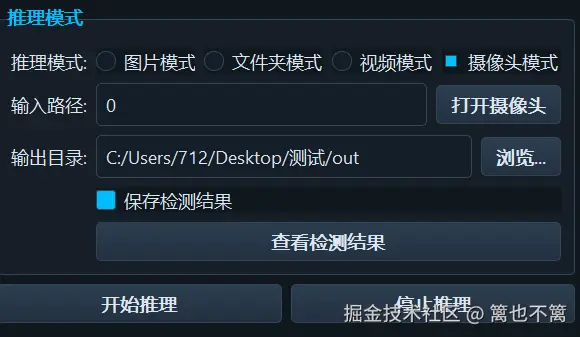

(4)摄像头检测演示

实时检测是系统中的核心应用之一,系统可直接调用摄像头进行检测。由于原理和视频检测相同,就不重复演示了。

(5)保存图片与视频检测结果

用户可通过按钮勾选是否保存检测结果,所有检测图像自动加框标注并保存至指定文件夹,支持后续数据分析与复审。

三、模型的训练、评估与推理

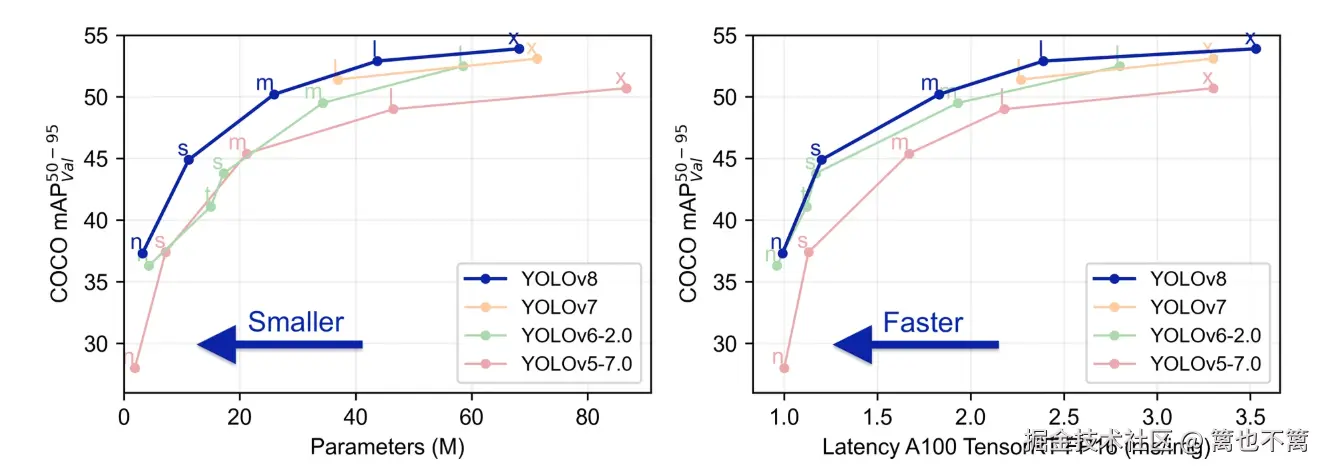

YOLOv8是Ultralytics公司发布的新一代目标检测模型,采用更轻量的架构、更先进的损失函数(如CIoU、TaskAlignedAssigner)与Anchor-Free策略,在COCO等数据集上表现优异。 其核心优势如下:

- 高速推理,适合实时检测任务

- 支持Anchor-Free检测

- 支持可扩展的Backbone和Neck结构

- 原生支持ONNX导出与部署

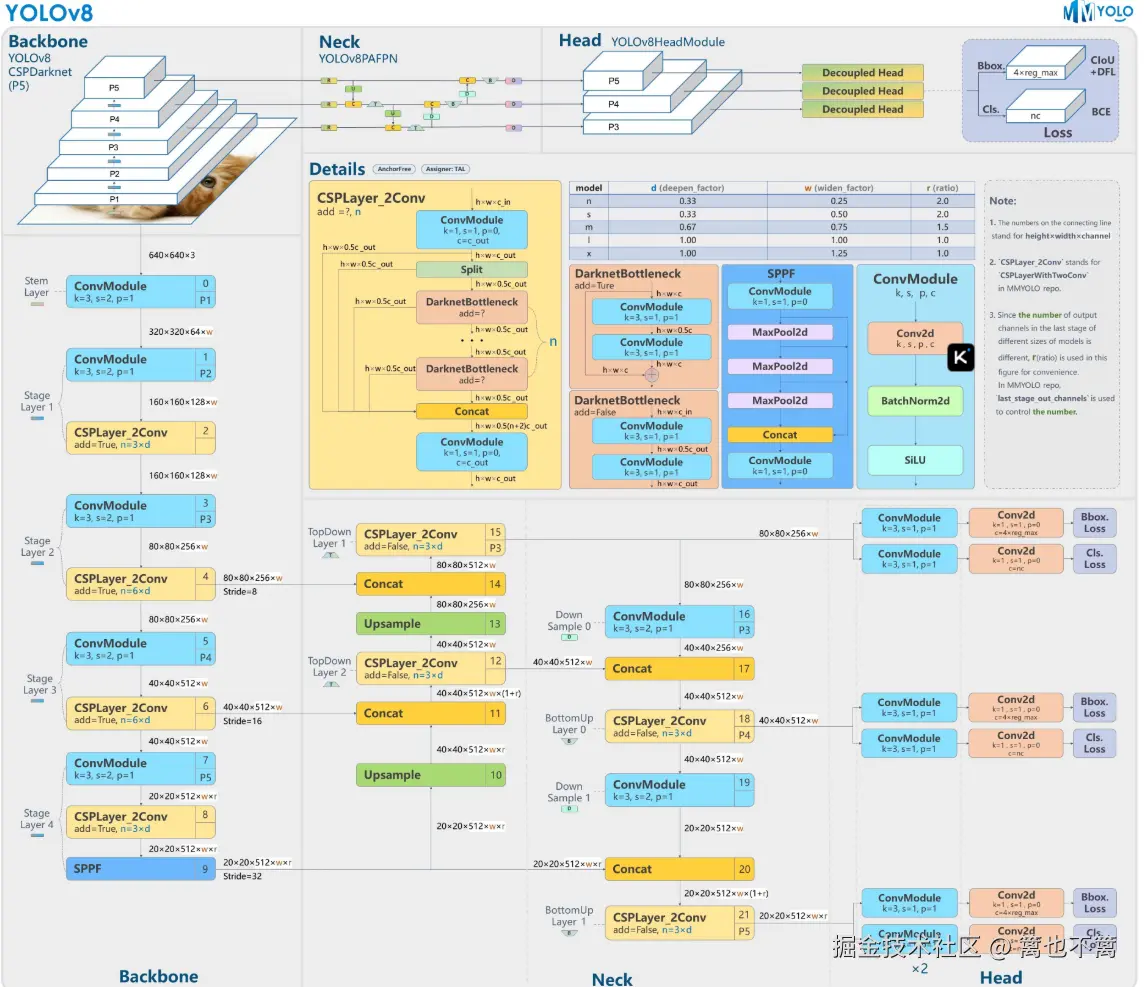

3.1 YOLOv8的基本原理

YOLOv8 是 Ultralytics 发布的新一代实时目标检测模型,具备如下优势:

- 速度快:推理速度提升明显;

- 准确率高:支持 Anchor-Free 架构;

- 支持分类/检测/分割/姿态多任务;

- 本项目使用 YOLOv8 的 Detection 分支,训练时每类表情均标注为独立目标。

YOLOv8 由Ultralytics 于 2023 年 1 月 10 日发布,在准确性和速度方面具有尖端性能。在以往YOLO 版本的基础上,YOLOv8 引入了新的功能和优化,使其成为广泛应用中各种物体检测任务的理想选择。

YOLOv8原理图如下:

3.2 数据集准备与训练

采用 YOLO 格式的数据集结构如下:

kotlin

dataset/

├── images/

│ ├── train/

│ └── val/

├── labels/

│ ├── train/

│ └── val/每张图像有对应的 .txt 文件,内容格式为:

bash

4 0.5096721233576642 0.352838390077821 0.3947600423357664 0.31825755058365757分类包括(可自定义):

3.3. 训练结果评估

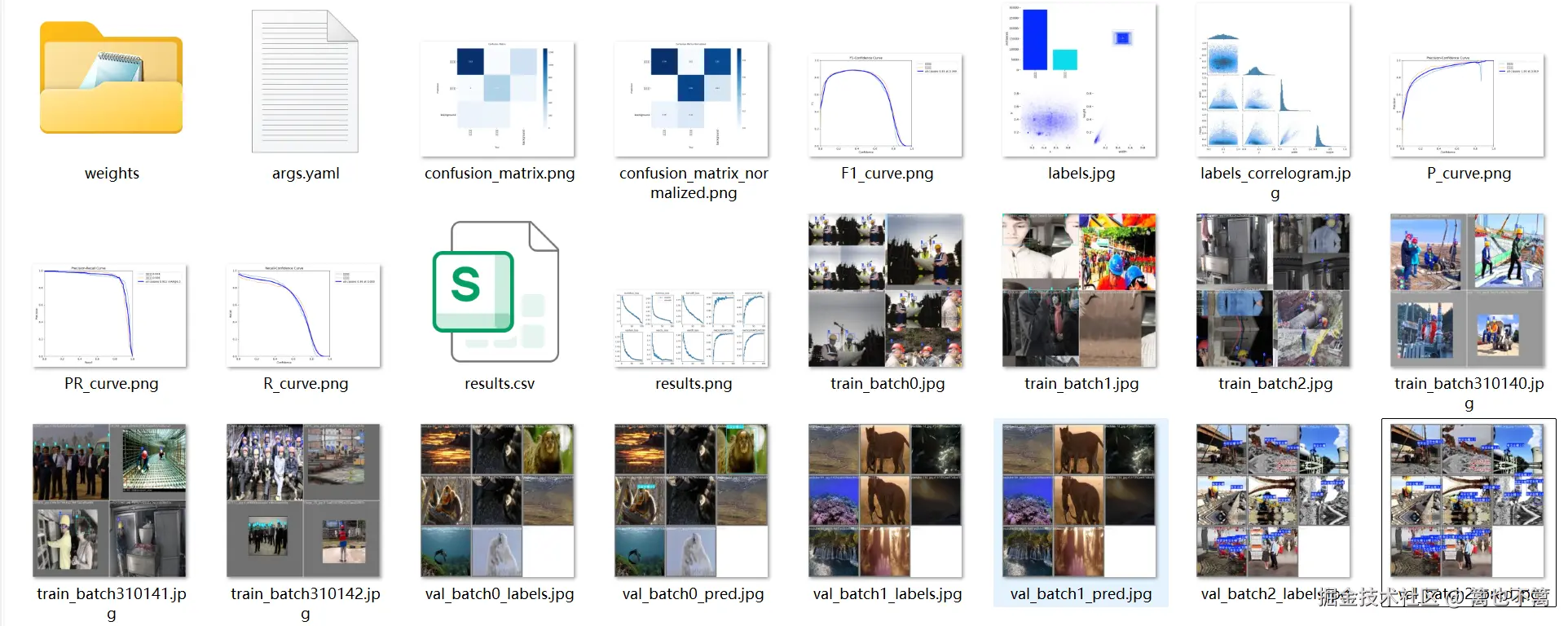

训练完成后,将在 runs/detect/train 目录生成结果文件,包括:

results.png:损失曲线和 mAP 曲线;weights/best.pt:最佳模型权重;confusion_matrix.png:混淆矩阵分析图。

若 mAP@0.5 达到 90% 以上,即可用于部署。

在深度学习领域,我们通常通过观察损失函数下降的曲线来评估模型的训练状态。YOLOv8训练过程中,主要包含三种损失:定位损失(box_loss)、分类损失(cls_loss)和动态特征损失(dfl_loss)。训练完成后,相关的训练记录和结果文件会保存在runs/目录下,具体内容如下:

3.4检测结果识别

使用 PyTorch 推理接口加载模型:

python

import cv2

from ultralytics import YOLO

import torch

from torch.serialization import safe_globals

from ultralytics.nn.tasks import DetectionModel

# 加入可信模型结构

safe_globals().add(DetectionModel)

# 加载模型并推理

model = YOLO('runs/detect/train/weights/best.pt')

results = model('test.jpg', save=True, conf=0.25)

# 获取保存后的图像路径

# 默认保存到 runs/detect/predict/ 目录

save_path = results[0].save_dir / results[0].path.name

# 使用 OpenCV 加载并显示图像

img = cv2.imread(str(save_path))

cv2.imshow('Detection Result', img)

cv2.waitKey(0)

cv2.destroyAllWindows()预测结果包含类别、置信度、边框坐标等信息。

四.YOLOV8+YOLOUI完整源码打包

本文涉及到的完整全部程序文件:包括python源码、数据集、训练代码、UI文件、测试图片视频等(见下图),获取方式见【4.2 完整源码下载】:

4.1 项目开箱即用

作者已将整个工程打包。包含已训练完成的权重,读者可不用自行训练直接运行检测。

运行项目只需输入下面命令。

bash

python main.py读者也可自行配置训练集,或使用打包好的数据集直接训练。

自行训练项目只需输入下面命令。

bash

yolo detect train data=datasets/expression/loopy.yaml model=yolov8n.yaml pretrained=yolov8n.pt epochs=100 batch=16 lr0=0.0014.2 完整源码下载

至项目实录视频下方获取:www.bilibili.com/video/BV11a...

包含:

📦完整项目源码

📦 预训练模型权重

🗂️ 数据集地址(含标注脚本)

总结

本项目通过集成 YOLOv8 强大的目标检测能力与 PyQt5 的可视化界面,构建了一个 实用性强、易于部署、安全帽自动识别系统。无论是单张图片、视频监控,还是实时摄像头输入,该系统均可稳定工作,准确判断佩戴与未佩戴状态,极大减轻了传统人工巡查压力。

项目特点总结如下:

- ✅ 高精度检测:mAP@0.5 超过 90%,适应复杂工地场景;

- ✅ 操作简便:图形界面直观,支持一键检测与结果保存;

- ✅ 源码开源:支持训练、推理、部署全流程开箱即用;

- ✅ 适配场景广泛:适用于建筑工地、实验室、工厂等安全监管领域。

本项目不仅适合科研学习使用,也具备实际应用落地能力,是一套完整、易扩展的 AI安全监管解决方案。如需获取完整源码与训练数据,请前往文末哔哩哔哩视频简介处下载体验。