就在昨天,AI 圈子迎来了一次不大不小的地震。当大家还在讨论下一个千亿模型将如何改变世界时,阿里通义千问悄悄扔出了一颗重磅炸弹:Qwen3-30B-A3B-Thinking-2507。

别被这串复杂的代号劝退,简单来说,这是一个你可以在自己电脑上运行,但在"思考"这件事上,足以让一些闭源巨头捏一把汗的"本地怪兽"。

硬核到离谱的推理能力

我们先不谈虚的,直接上战绩。

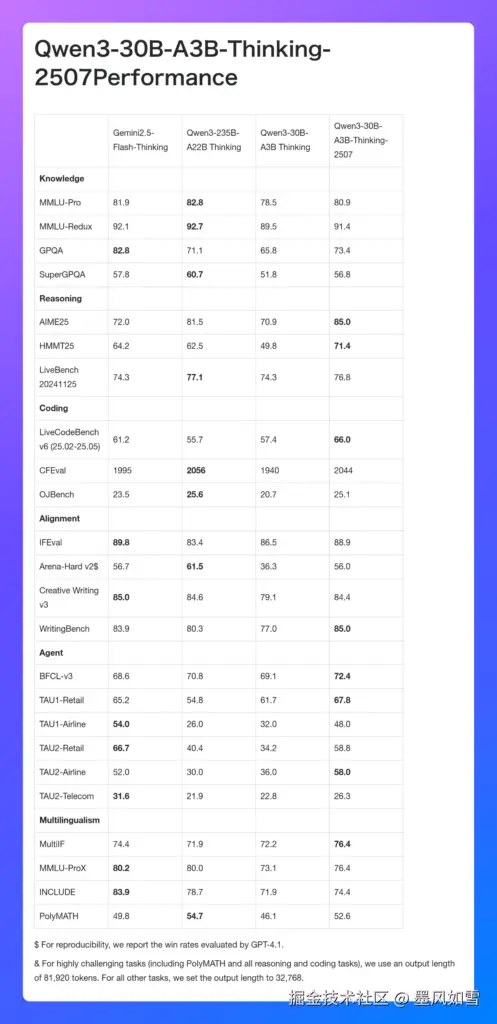

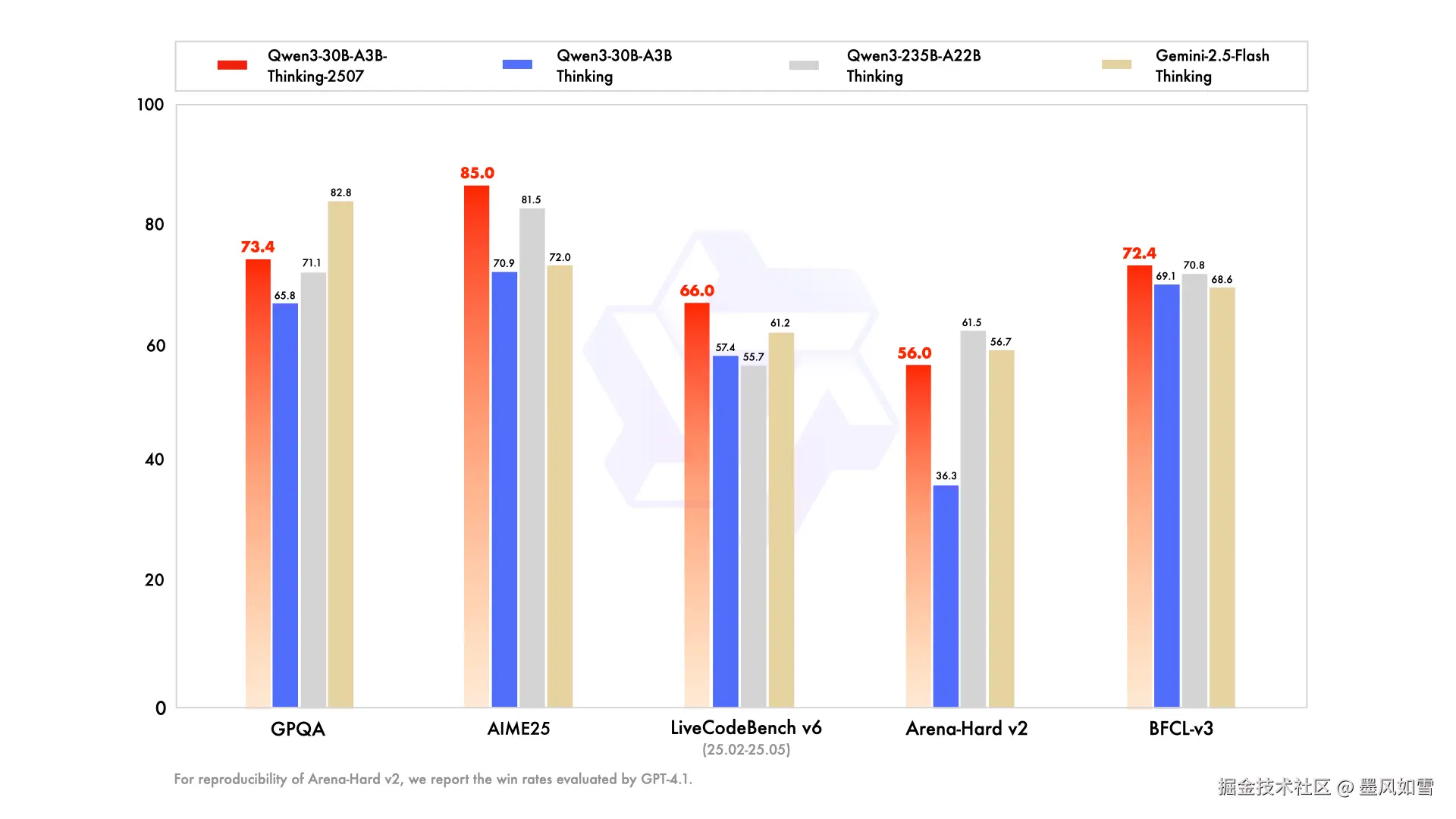

过去,中等尺寸的模型在专业数学和复杂逻辑上总是力不从心,这几乎成了一条铁律。但 Qwen3-30B-Thinking 打破了它。在顶级的专业数学评测 AIME25 中,它拿下了 85.0 的高分。这是什么概念?这个分数不仅超越了谷歌的 Gemini 2.5-Flash,甚至把自己家族的旗舰大哥 Qwen3-235B 都甩在了身后。

这不再是量变,而是质变。它意味着模型不再是靠"背答案"来解题,而是真正拥有了深度、严谨的逻辑推导链条。

代码和逻辑方面同样惊艳。在 LiveCodeBench v6 代码生成测试中,它取得了 66.0 分的成绩,而在考验逻辑思维的 ZebraLogic 测试里,90.0 的得分已经非常接近 GPT-4o 的水平。这些冰冷的数字背后,是一个温热的事实:一个开源的、可以私有化部署的模型,在核心的"脑力"上,已经追上了第一梯队。

轻量化下的"思考"艺术

你可能会问,30B(300亿)参数,怎么能叫"本地怪兽"?这就要说到它的技术核心------MoE 架构。

你可以把它想象成一个由顶尖专家组成的团队。模型总共有 300 亿参数,但处理任务时,它只会动态调用其中最相关的几位专家,激活的参数量仅有 3B 左右。这种"按需唤醒"的机制,极大地降低了推理时的资源消耗。

结果就是,你只需要一台消费级的 RTX 3090 显卡,或者一台新款的 Mac ,就能让这个"思考专家"在你的桌面上跑起来。社区里已经有开发者在 Mac M4 Max 上跑出了 80 tokens/秒 的速度,这流畅度,几乎可以媲美云端 API 的体验。

更妙的是它独特的 "思考模式" 。官方推荐,在处理复杂任务时,可以给它增加一点"思考预算"(thinking length)。这就像是告诉模型:"别急着回答,多想一会儿。" 在这多出来的思考时间里,它会构建更复杂的推理路径,从而解决那些初看之下无从下手的问题。加上原生 256K 、可扩展至 1M 的超长上下文窗口,分析一部长篇小说或者一个复杂的代码库,对它来说都不在话下。

一个时代的开始

当然,它并非完美。在某些极其复杂的领域,比如前沿的 3D 算法生成,它仍有进步空间。但瑕不掩瑜。

Qwen3-30B-A3B-Thinking-2507 的发布,最大的意义在于它重新定义了"本地模型"的天花板。它告诉所有开发者:你不必再为高昂的 API 费用和数据隐私而焦虑,顶级AI的推理能力,现在触手可及。

它是一个思考者,一个专为复杂任务而生的推理专家。对于我们这些在 AI 浪潮中探索的人来说,这不仅仅是一个新工具,更像是一个新时代的序幕。一个由开源、开放、高效的本地模型驱动的时代,正向我们走来。

如果你已经迫不及待,现在就可以去 Hugging Face 或魔搭社区下载它,亲自感受一下这位"桌面推理之王"的威力。

如果你也对最新的AI信息感兴趣或者有疑问 都可以加入我的大家庭 第一时间分享最新AI资讯、工具、教程、文档 欢迎你的加入!!!😉😉😉

公众号:墨风如雪小站