多模态大模型MLLMs 能够处理高分辨率图像、长视频序列和冗长音频输入等复杂上下文,但自注意力机制的二次复杂度使得大量输入 token 带来了巨大的计算和内存需求。

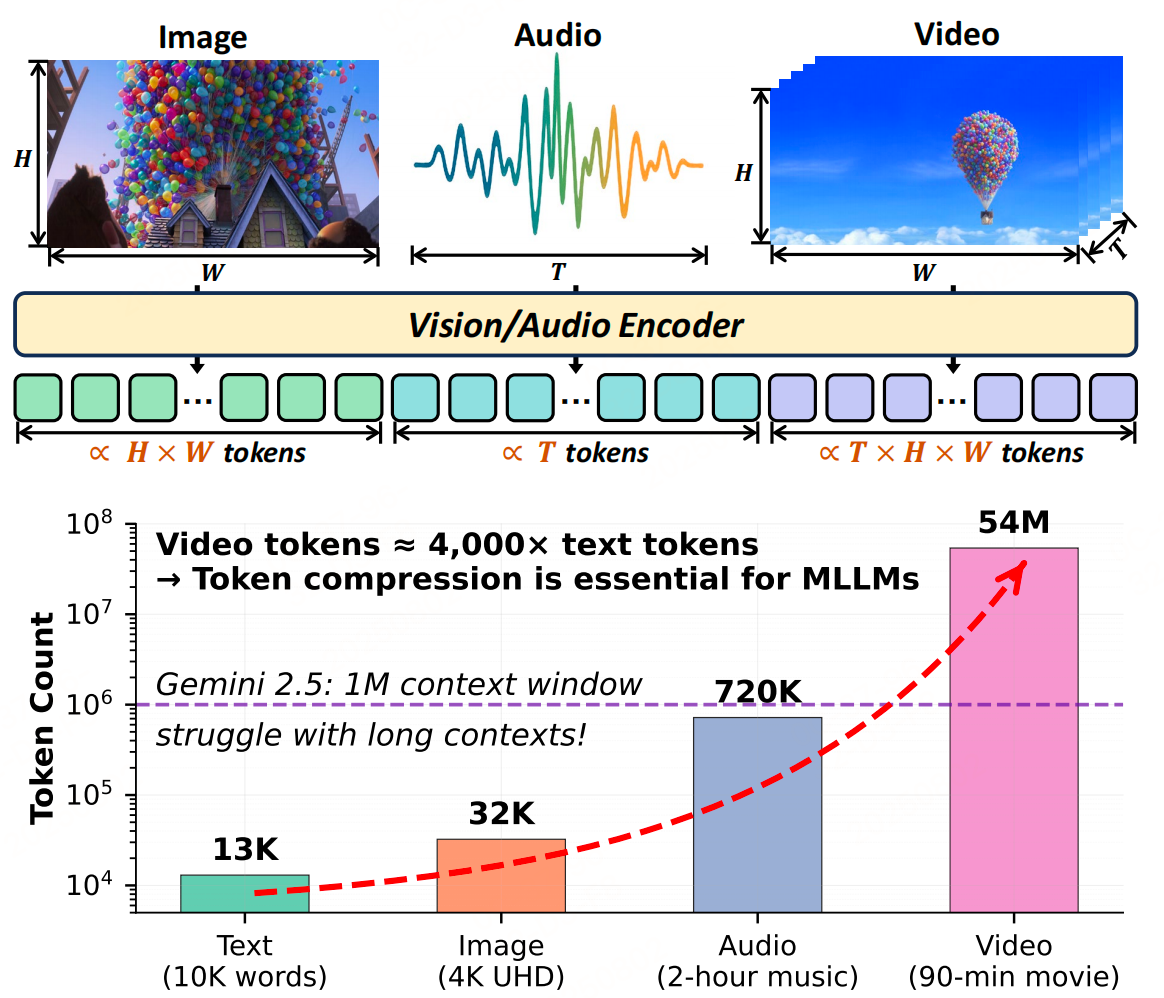

如下图,上:图像、视频和音频数据类型可以在其表示维度上进行扩展,从

而导致 token 数量的相应增加。下:表现最佳的多模态大模型无法满足

现实世界的需求,因为多模态输入(尤其是视频)的 token 数量远远超

过文本,并且大多数视觉 token 是冗余的 。

因此 token 压缩对于解决这一限制至关重要。

一些概念

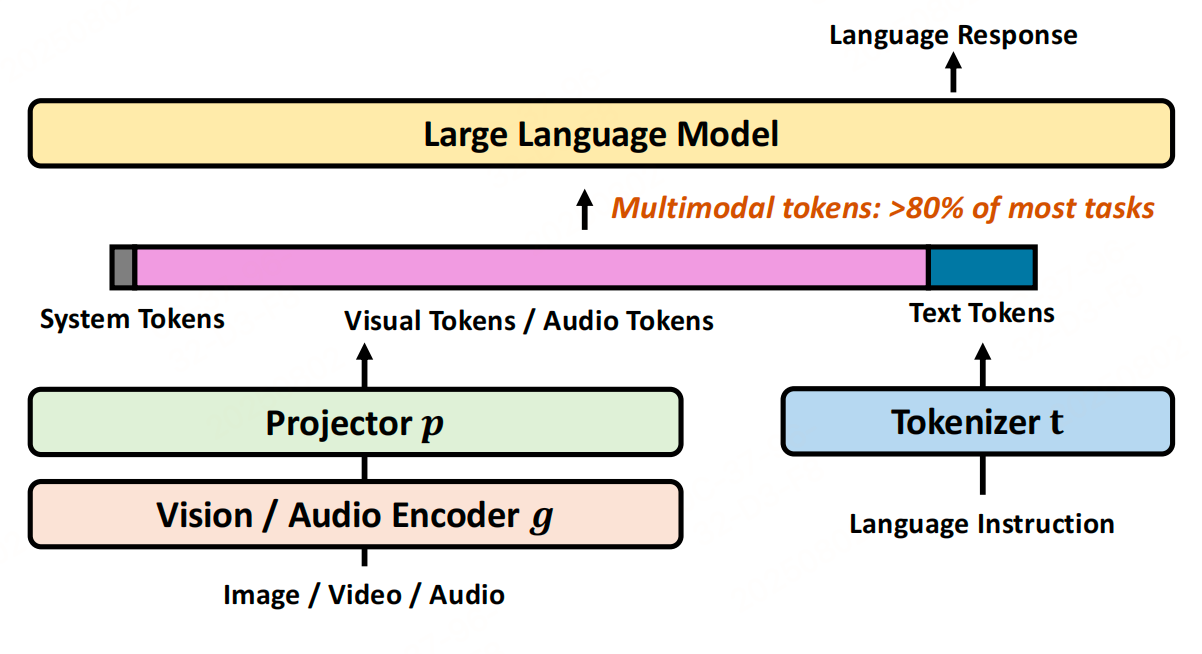

1、多模态结构

MLLMs通常框架由三个组件构成:

- 特定模态编码器((g)):负责处理图像、音频等原始输入,将高维数据压缩为紧凑的语义嵌入序列(如图像通过视觉编码器转化为视觉token,音频通过音频编码器转化为音频token)。常用的视觉编码器包括CLIP、SigLIP等,音频编码器包括Whisper、Audio-CLIP等。

- 投影器(连接器)模块((P)):将编码器输出的嵌入映射到与语言模型(LLM)文本嵌入相同的潜在空间,使多模态数据能与文本指令融合。

- 大语言模型(LLM):接收投影后的多模态嵌入与文本提示嵌入的拼接序列,通过自回归解码生成响应。

2、大模型的token压缩

MLLMs的核心通常基于文本大型语言模型(LLMs)微调而来,因此文本LLMs的token压缩技术(常称为"prompt压缩")是重要基础。这些技术旨在处理长文本上下文(如整本书、代码库),方法包括:

- 自编码器与摘要压缩:如AutoCompressor将上下文压缩为摘要向量,SentenceVAE用单个token表示句子。

- 选择性修剪:如Selective Context通过自信息度量移除低信息token,LLMLingua系列通过层级修剪和语义密度排序减少token。

- 查询引导过滤:如QUITO利用注意力分数筛选与查询相关的token,AdaComp根据查询复杂度动态提取关键信息。

- 概念蒸馏与递归框架:如Concept Distillation通过抽象意义表示(AMR)图提炼核心概念,RCC通过递归融合生成分段摘要。

然而,文本压缩技术难以直接应用于MLLMs,因为多模态数据(图像、视频、音频)存在独特的冗余模式(如空间相关性、时空连续性),需要专门的压缩策略。

3、视觉Transformer的token压缩

视觉Transformer(ViTs)的token压缩技术为MLLMs的视觉token压缩提供了借鉴,其核心是解决图像的空间冗余(如相邻patch的相似性、前景与背景的语义不平衡):

- 动态修剪:如DynamicViT、EViT通过注意力分数量化token相关性,修剪低显著性token。

- token合并与学习:如ToMe通过相似性度量合并语义相近的token,TokenLearner通过学习的空间注意力生成紧凑token集。

- 蒸馏与跨模态过滤:如DeiT用轻量级"学生头"从压缩token子集预测标签,MADTP利用跨模态对齐过滤token。

与MLLMs的差异:MLLMs不仅包含视觉token,还需处理文本token和更长的序列,因此其token压缩面临更复杂的挑战,但ViTs的技术思路(如注意力引导修剪、相似性合并)更具参考价值。

下面来看下具体的token压缩方法。

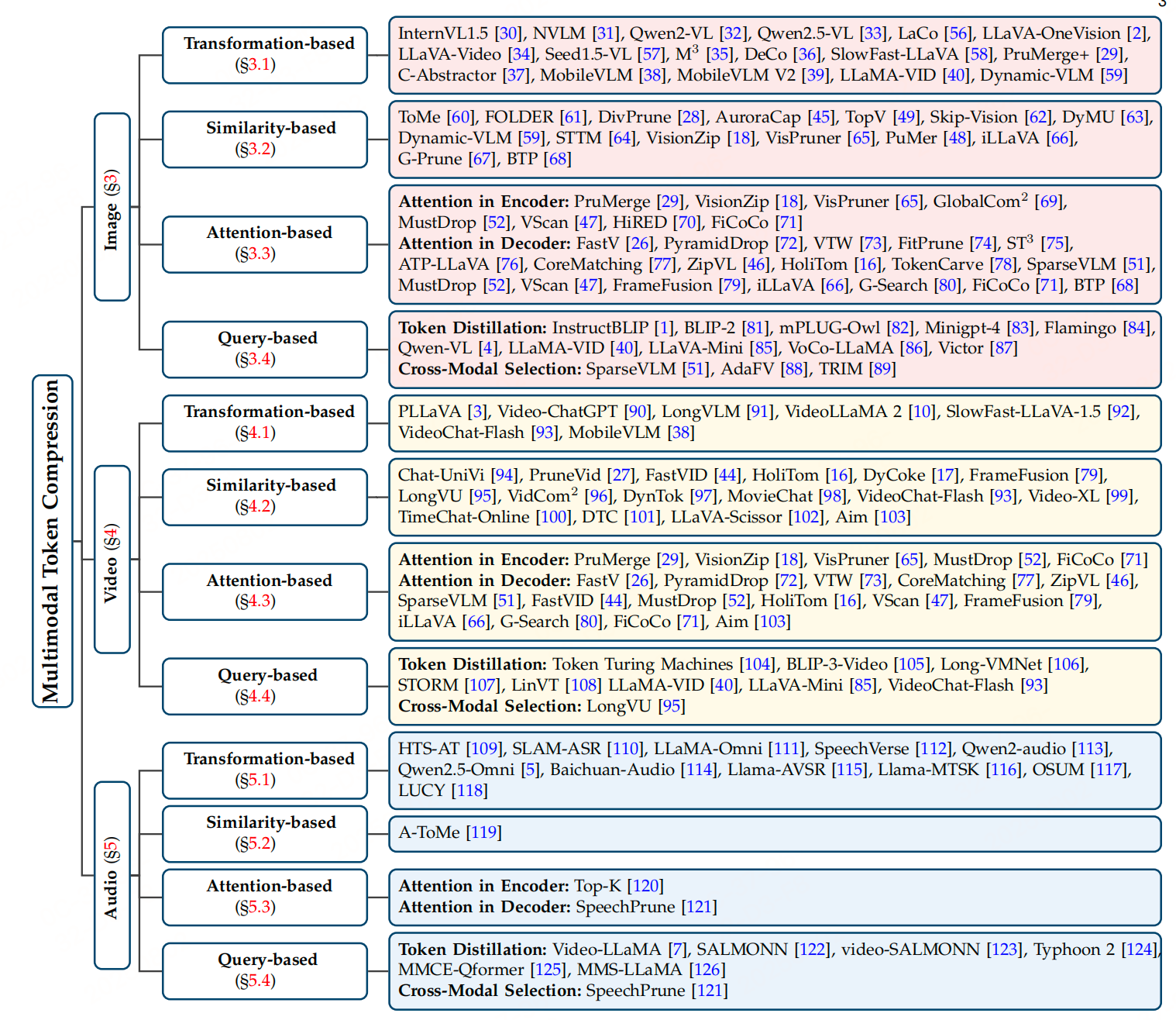

多模态token压缩方法

1、 以图像为中心的Token压缩

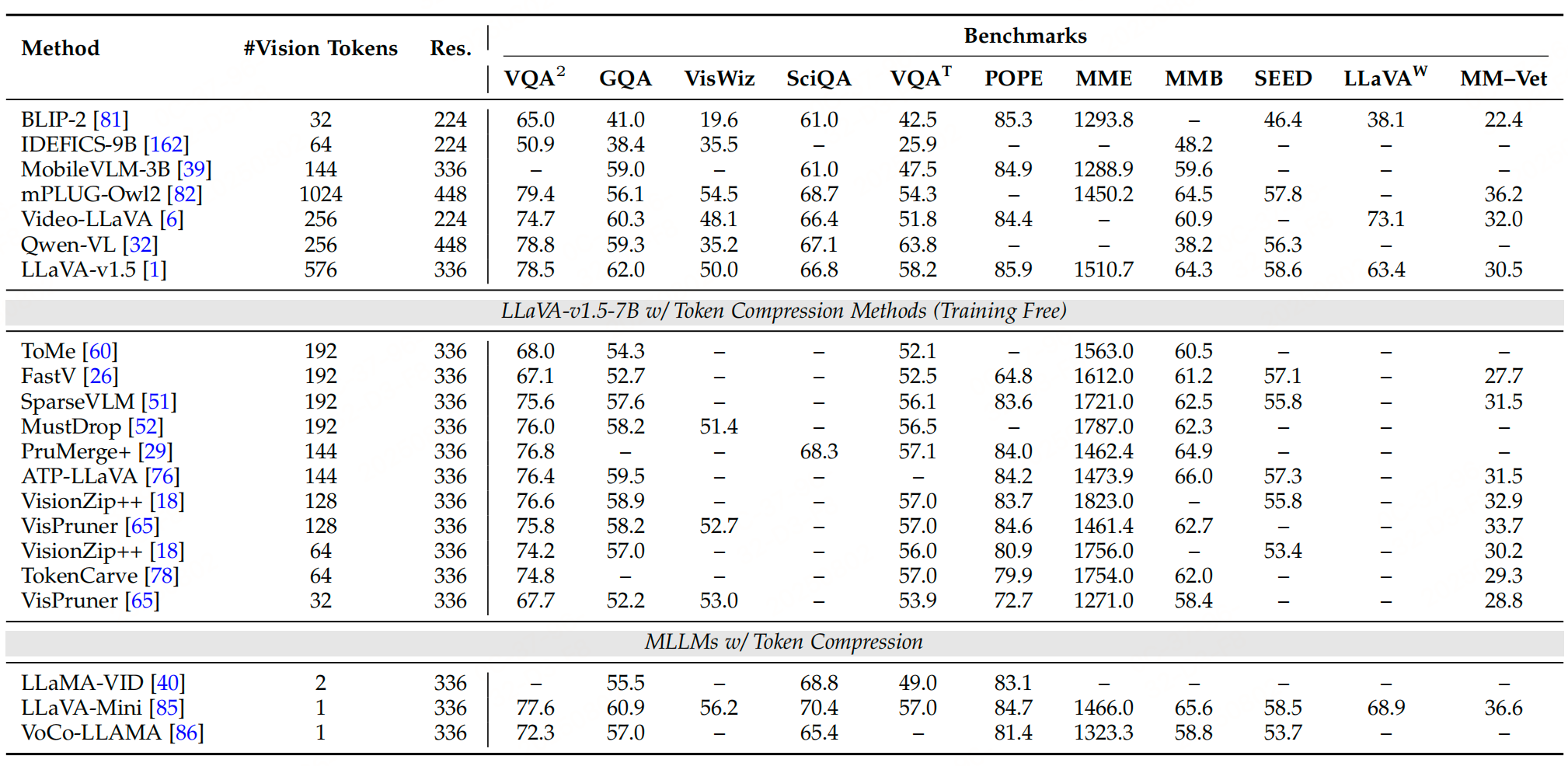

总结:

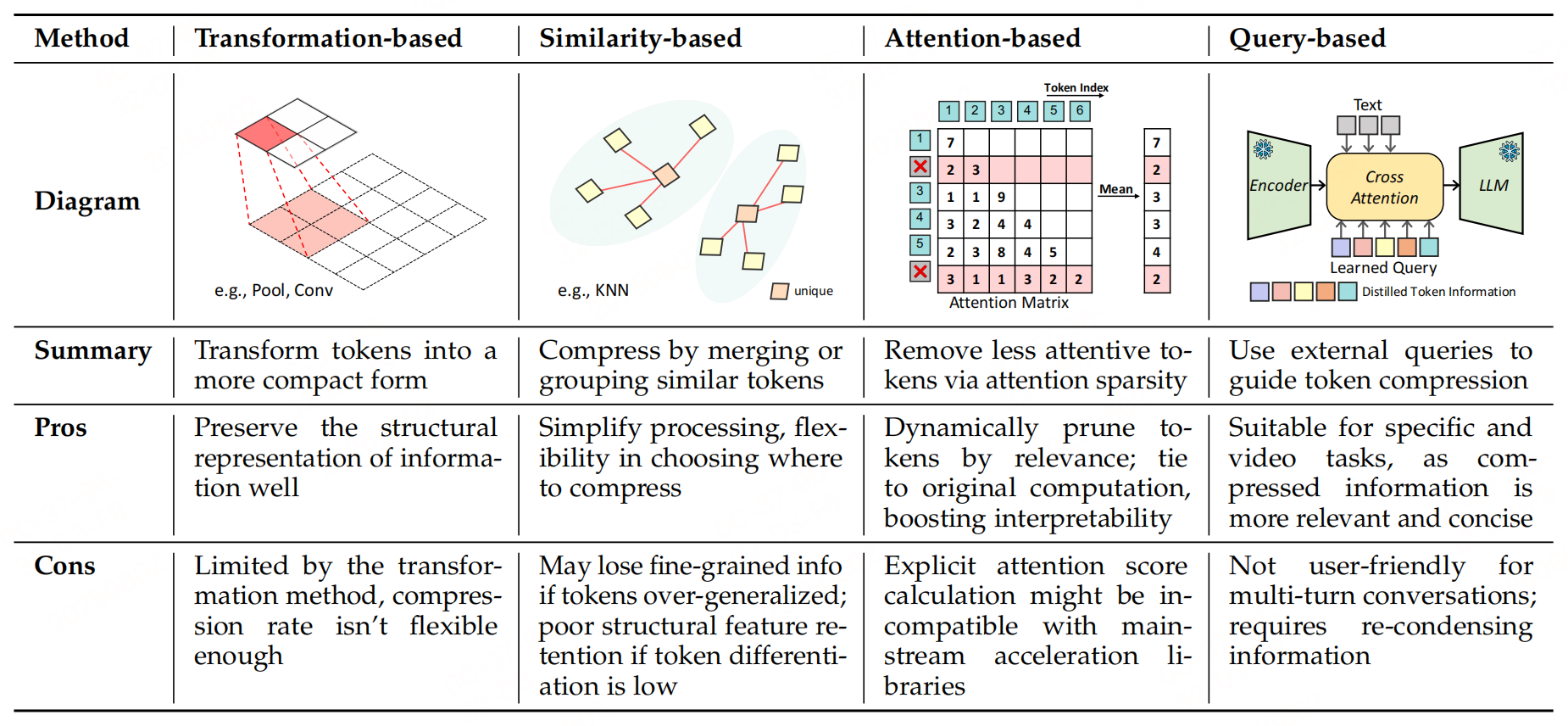

图像中心的 token 压缩方法针对空间冗余,从变换、相似性、注意力、查询四个维度提出解决方案:

- 变换方法通过下采样直接减少 token 数量,适合保留空间结构;

- 相似性方法合并语义重复 token,适合去除冗余;

- 注意力方法动态筛选高重要性 token,可解释性强;

- 查询方法聚焦任务相关信息,适合交互式场景。

下面具体看看。

1.1 基于Transformer的图像中心压缩

这类方法通过对图像特征进行空间变换(如下采样)来减少token数量,核心是利用图像的空间结构特性,在保留关键信息的同时降低维度。主要包括以下四类操作:

-

像素重排(Pixel Unshuffle)

像素重排是像素洗牌(Pixel Shuffle)的逆操作,将高分辨率、低通道的特征图转换为低分辨率、高通道的特征图,从而减少token数量:

H×W×D→Hr×Wr×(D⋅r2) H \times W \times D \to \frac{H}{r} \times \frac{W}{r} \times (D \cdot r^2) H×W×D→rH×rW×(D⋅r2)其中,H、WH、WH、W 为特征图的高和宽,DDD 为通道数,rrr 为下采样率。

代表性工作:InternVL系列、Qwen2系列、NVLM等,通过像素重排将视觉编码器生成的token数量减少为原来的1/4,再通过MLP对齐视觉与文本的维度。

优势:无额外参数,不增加模型权重。

-

空间池化/插值

直接对token进行二维下采样,不改变通道维度,数学表达式为:

H×W×D→HS×WS×D H \times W \times D \to \frac{H}{S} \times \frac{W}{S} \times D H×W×D→SH×SW×D其中,SSS 为下采样因子。

代表性工作 :LLaVA-OneVision采用双线性插值,LLaVA-Video使用平均池化,M3M^3M3 通过池化学习多粒度表示,在推理时用更少token保持性能。

优势:可无训练实现,直接作用于对齐后的token维度。

-

空间卷积(Spatial Convolution)

通过卷积操作学习局部信息抽象,同时降低空间维度,数学表达式为:

H×W×Din→HS×WS×Dout H \times W \times D_{in} \to \frac{H}{S} \times \frac{W}{S} \times D_{out} H×W×Din→SH×SW×Dout其中,SSS 为步长(下采样因子),Din、DoutD_{in}、D_{out}Din、Dout 为输入/输出通道数。

代表性工作:Honeybee的C-Abstractor模块用卷积提取压缩信息,MobileVLM的LDP模块通过深度卷积减少75%的token。优势:通过可学习权重捕捉更复杂的局部特征。

对比总结:

- 像素重排、池化、插值均为无参数操作,不增加权重开销;卷积引入可学习参数,能更精细地抽象局部信息。

- 像素重排会改变通道维度,需后续MLP对齐文本维度;池化和插值可直接作用于对齐后的维度,无需额外处理。

- 压缩率通常有限(常见为25%),受限于二维下采样的特性。

1.2、基于相似性的图像中心压缩

这类方法通过度量token在隐空间中的相似性(如距离或相似度),合并相似token,保留代表性的"簇中心"token,从而减少冗余。核心思路是通过聚类或匹配算法识别语义相近的token,将其合并为单个代表性token,降低序列长度。

代表性工作:

- ToMe:在ViT的注意力和MLP模块间插入token合并模块,通过二分软匹配合并相似token。

- FOLDER:在视觉编码器的最后一个注意力块中插入合并模块,减少传入LLM的token。

- DivPrune:将压缩问题转化为"最大-最小多样性"问题,筛选内部差异最大的token子集。

- TopV:在LLM层中综合特征的相似性和距离函数,直接在多模态表示空间中压缩token。

优势:能有效去除语义重复的token,保留关键信息。

局限性:过度合并可能丢失细粒度信息;聚类算法的复杂度可能引入额外计算开销。

1.3、基于注意力的图像中心压缩

这类方法利用注意力机制的稀疏性,通过注意力分数筛选高重要性token,修剪低关注度token,分为编码器内和解码器内两种策略。

-

编码器内注意力(Attention in Encoder)

基于视觉Transformer(ViT)的注意力分数,在视觉编码器内部筛选关键token,减少传入LLM的数量。通常通过视觉token与[CLS] token的注意力分数选择top-K token:

Tencoder=TopKk({Attention(vi,vcls)∣vi∈V}) \mathcal{T}_{\text{encoder}} = \text{TopK}k\left(\left\{\text{Attention}(v_i, v{cls}) \mid v_i \in \mathcal{V}\right\}\right) Tencoder=TopKk({Attention(vi,vcls)∣vi∈V})其中,V\mathcal{V}V 为原始视觉token集,vclsv_{cls}vcls 为[CLS] token。

代表性工作:- PruMerge:基于[CLS]注意力选择簇中心,通过KNN合并低关注度token。

- VisionZip:保留高注意力token,聚类合并剩余token。

- VisPruner:先保留高注意力token,再通过多轮相似度修剪重复token,保留多样性。

-

解码器内注意力(Attention in Decoder)

利用LLM解码器的注意力分数,在视觉token与文本token的联合空间中筛选关键token。通过计算视觉token从所有其他token(视觉+文本)获得的平均注意力分数选择top-K token:

A‾(vi)=1∣S∣∑sj∈SAttention(vi,sj),Tdecoder=TopKk({A‾(vi)∣vi∈V}) \overline{A}(v_i) = \frac{1}{|\mathcal{S}|} \sum_{s_j \in \mathcal{S}} \text{Attention}(v_i, s_j), \quad \mathcal{T}_{\text{decoder}} = \text{TopK}_k\left(\left\{\overline{A}(v_i) \mid v_i \in \mathcal{V}\right\}\right) A(vi)=∣S∣1sj∈S∑Attention(vi,sj),Tdecoder=TopKk({A(vi)∣vi∈V})其中,S\mathcal{S}S 为当前层注意力窗口中的所有token。

代表性工作:- FastV:在第二层后基于注意力分数修剪50%的视觉token,保持性能。

- ZipVL:通过解码器注意力动态压缩token,平衡效率与精度。

- SparseVLM:结合编码器和解码器注意力,筛选与文本相关的视觉token。

优势:基于注意力的动态筛选能自适应保留任务相关token, interpretability(可解释性)强。

局限性:需显式计算注意力分数,与优化加速库(如FlashAttention)不兼容,可能引入额外计算开销。

1.4 基于查询的图像中心压缩

这类方法利用文本查询(prompt)引导视觉token压缩,分为token蒸馏 和跨模态选择两类,聚焦于保留与查询相关的信息。

-

Token Distillation(token蒸馏)

将视觉token蒸馏为少量与文本相关的token,同时实现模态对齐。

代表性工作:- Q-Former系列:通过可学习查询和交叉注意力提取与文本相关的视觉线索,压缩为固定数量token。

- LLaMA-VID:用文本查询聚合视觉嵌入中的文本相关线索,将整幅图像表示为2个token。

- LLaVA-Mini:将视觉信息预融合到文本token中,仅需1个视觉token即可保持性能。

- Victor:引入少量可学习"寄存器token",通过大模型浅层将视觉信息蒸馏到寄存器中,丢弃原始视觉token。

-

Cross-Modal Selection(跨模态选择)

利用模态间的对齐关系,通过一种模态的token筛选另一种模态的关键token。

代表性工作:- SparseVLM:用视觉token预筛选相关文本token,缩小文本搜索空间。

- AdaFV:结合文本-图像相似度和视觉显著性,选择语义对齐且视觉突出的token。

- TRIM:先通过文本-视觉相似度识别"离群token"(视为重要),再聚类合并剩余token。

优势:压缩后的token与查询高度相关,适合任务驱动场景(如视觉问答)。

局限性:依赖文本查询的质量;多轮对话中需重新计算压缩,可能增加开销。

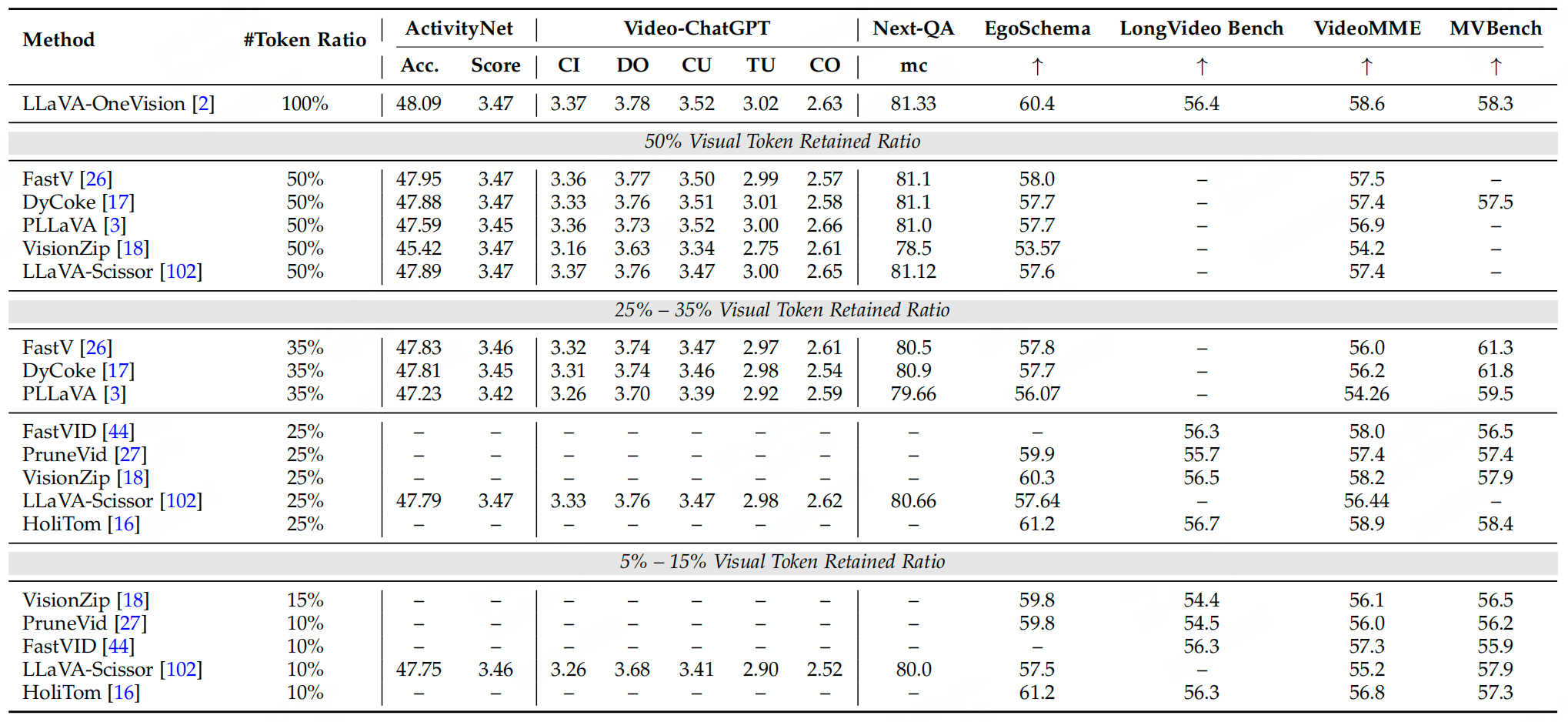

2、以视频为中心的Token压缩

视频数据因包含空间和时间维度的双重信息,其token数量远超静态图像(如90分钟视频可生成5400万token),成为多模态大型语言模型(MLLMs)处理的主要瓶颈。视频中心的token压缩需同时解决空间冗余 (同帧内相邻区域的相似性)和时间冗余(连续帧间的重复性),该部分按底层机制分为四类方法,因为视频的每一帧是图像,因此图像部分和前面是一样的,重点看下针对时间维度的优化策略。

总结:

视频中心的token压缩需同时应对空间和时间冗余,核心策略包括:

- 变换方法通过时空池化/卷积直接减少token,适合保留全局结构;

- 相似性方法通过帧聚类合并时间冗余,效率高但需避免丢失动态信息;

- 注意力方法动态筛选关键token,可解释性强但受限于加速库兼容问题;

- 查询方法聚焦任务相关帧,适合交互式场景。

2.1、基于Transformer的视频中心压缩

这类方法延续图像压缩中的变换思路,结合视频的时间维度特性,通过池化或卷积操作减少token数量,核心是在空间压缩基础上增加时间维度下采样。

-

2D/3D池化(2D/3D Pooling)

- 空间池化:对单帧图像进行下采样(如LLaVA-Video用平均池化减少单帧token),但对长视频效果有限。

- 时间池化 :针对视频帧序列进行下采样,降低帧率以减少时间维度的token。例如:

- PLLaVA、Video-ChatGPT、LongVLM等采用 temporal pooling(时间池化),实验表明模型性能对时间池化更敏感。

- LLaMA-VID对单图像保留原始分辨率,对视频帧则压缩为单个token,大幅减少数据量。

- 混合策略:SlowFast-LLaVA-1.5采用双路径架构------"慢路径"采样少量高分辨率帧,"快路径"采样更多低分辨率帧,拼接后输入LLM,在减少token的同时保留时空细节。

-

2D/3D卷积(2D/3D Convolution)

与池化的简单聚合不同,卷积通过学习滤波器捕捉时空特征并压缩维度。例如: VideoLLaMA 2对比2D和3D卷积后发现,3D卷积能更好地学习复杂的时空关系,在性能和效率间取得平衡。

特点:

- 空间变换(池化/卷积)与图像压缩方法类似,时间变换是视频特有的优化。

- 需平衡帧率/分辨率与信息保留(如24 FPS是捕捉完整动作的最低帧率,但实际常采用1 FPS采样)。

2.2、基于相似性的视频中心压缩

针对视频的时间冗余(相邻帧高度相似),通过聚类或相似度匹配合并冗余帧或token,优先压缩时间维度。核心思路主要包括:

- 对视频帧进行聚类(基于帧级表示的相似度),合并非关键帧;

- 在聚类后的帧内进一步合并空间冗余token,最终保留"时空紧凑表示"。

- 代表性工作 :

- Chat-UniVi:先将每帧池化为单个帧级token,再用DPC-KNN(基于K近邻的密度峰值聚类)合并相似帧,最后在簇内对多帧token二次聚类,得到时空紧凑表示。

- PruneVid:与Chat-UniVi类似,但先合并时间上静态的token(如静止背景),再进行时空token合并,减少冗余。

- HoliTom:将时间冗余压缩视为优化问题,最大化聚类帧内的可压缩冗余特征,更全面地处理时间维度冗余。

- FrameFusion:针对流式视频,在模型浅层直接合并超过相似度阈值的时间冗余token,适合实时处理。

优势:通过聚类针对性减少时间冗余,压缩效率高于单纯空间压缩。

局限性:过度合并可能丢失关键动态信息(如快速动作帧)。

2.3、基于注意力的视频中心压缩

利用注意力机制的稀疏性筛选重要token,与图像压缩思路类似,但需结合视频的时序特性。

-

编码器内注意力

将视频视为独立帧的序列输入图像编码器,通过帧内注意力分数筛选高重要性空间token(如PruMerge、VisionZip)。但此类方法忽略帧间关系,本质仍是"图像级压缩"的扩展。

-

解码器内注意力

在LLM解码器中处理帧序列的拼接token,通过跨帧注意力捕捉时间关联,并筛选关键时空token。例如:

- FastV、ZipVL等延续图像解码器的注意力筛选策略,计算视频token与文本查询的交叉注意力,保留高相关token。

- 对长视频采用窗口注意力(windowed attention),仅关注局部时间窗口内的帧,降低计算复杂度。

2.4、基于查询的视频中心压缩

以文本查询为引导,筛选与任务相关的关键帧或token,减少无关时序信息的冗余。

-

token蒸馏

通过专用适配器模块(如Q-former、Token Turing Machines)将长视频token蒸馏为少量紧凑表示:

- Token Turing Machines(TTMs):维护外部"摘要token内存",通过Transformer的读写机制逐帧压缩输入token与内存,支持长视频的高效处理。

- BLIP-3-Video:用时间编码器将数百帧的视觉token抽象为16--32个时空token,平衡效率与信息保留。

- LinVT:通过线性视频tokenizer,结合时空评分和文本条件聚合,将帧级token压缩为紧凑视频token,使图像LLM可直接处理视频。

-

跨模态选择

基于查询与视频帧的相关性动态调整压缩率,保留关键帧的更多信息:LongVU:计算每帧与查询的相关性分数,对高相关帧采用低压缩率(保留更多token),低相关帧采用高压缩率,确保总token数在模型上下文窗口内。

优势:聚焦查询相关的时空信息,适合视频问答、行为识别等任务。

局限性:依赖查询质量,对无明确任务的场景(如视频摘要)适用性有限。

3、以音频为中心的Token压缩

音频数据作为多模态输入的重要组成部分,其token数量随采样率和时长增加而显著增长,给MLLMs的高效处理带来挑战。音频信号本质是时间维度上的振幅变化(1D信号),通常通过频谱图(如梅尔频谱图)转换为类图像的2D表示,以便复用视觉处理技术。音频中心的token压缩需解决时间冗余 (如长静音段)和频谱冗余(如特定频率的重复信号),该部分也分为四类方法。

3.1、基于Transformer的音频中心压缩

这类方法通过下采样操作直接减少音频token数量,借鉴图像压缩中的变换思路,针对音频的时间或频谱维度进行压缩。

-

token堆叠

类似图像的"像素重排"操作,将连续的多个音频token沿隐藏维度堆叠,减少总token数。例如:

- HTS-AT最早将梅尔频谱图的2D特征通过像素重排减少音频token;

- SLAM-ASR、LLaMA-Omni等采用该技术,通过堆叠调整隐藏维度后,需用MLP对齐其他模态的维度。

-

Pooling(池化)

直接对音频序列进行时间维度下采样,无额外参数。例如:

- Qwen2-audio、Qwen2.5-Omni使用步长为2的池化层,直接缩短音频表示长度;

- Llama-MTSK采用"套娃式(matryoshka)"训练,通过多尺度平均池化或堆叠,实现推理时动态调整token数量,平衡压缩率与性能。

-

时间卷积

用1D卷积在时间维度上压缩token,同时调整隐藏维度以适配后续LLM。例如: SpeechVerse、Baichuan-Audio等采用该技术,下采样后音频表示的有效采样率通常为12.5 Hz,在减少token的同时保留关键时序特征。

特点:Transformer的方法均通过降低时间或频谱维度减少token,其中池化和堆叠为无参数操作,卷积通过学习权重捕捉更复杂的局部特征。

3.2、基于相似性的音频中心压缩

通过度量音频token的相似度,合并冗余token,保留独特信息。核心思路类似视觉领域的ToMe方法,在音频Transformer的层间插入token合并模块,合并高相似度的相邻token(如通过余弦相似度度量)。

- 代表性工作 : A-ToMe:在多头自注意力(MHSA)和前馈网络(FFN)之间插入模块,合并余弦相似度高的相邻音频token,减少冗余。

优势:针对性去除时间或频谱上的重复信息,适合处理包含长静音或固定背景噪声的音频。

局限性:过度合并可能丢失短时关键信号(如突发声音)。

3.3、基于注意力的音频中心压缩

利用注意力机制的稀疏性,通过注意力分数筛选高重要性token,修剪低关注度token。

-

编码器内注意力

在音频Transformer块中,基于自注意力分数保留top-K token。例如: Top-K:直接保留音频频谱图Transformer中注意力分数最高的K个token,聚焦关键频谱特征。

-

解码器内注意力

在LLM解码器中,基于音频token与文本token的交叉注意力分数筛选关键token。例如:SpeechPrune:利用LLM第一层的注意力分数,在处理早期修剪低重要性音频token,减少后续计算量。

优势 :动态适配音频内容的重要性,保留与任务相关的关键信号(如语音中的关键词)。

局限性:需显式计算注意力分数,与优化加速库(如FlashAttention)兼容性差,可能增加额外开销。

3.4、基于查询的音频中心压缩

以文本查询或其他模态信息为引导,压缩与任务无关的音频token,分为token蒸馏 和跨模态选择两类。

-

token蒸馏

用可学习查询token提取音频的关键信息,压缩为固定长度的紧凑表示。例如:

- Video-LLaMA、SALMONN系列:通过音频Q-former将变长音频输入转换为固定长度的可学习查询序列,供LLM处理;

- MMCE-Qformer:结合全局声学上下文(通过可学习查询提取)和局部文本相关声学特征(通过文本引导的交叉注意力),蒸馏出紧凑的音频表示;

- MMS-LLaMA:先通过"早期音视频融合模块"减半序列长度,再用AV Q-Former进一步压缩为固定数量的查询token,捕捉完整语音上下文。

-

跨模态选择

利用音频与其他模态(如文本)的相关性筛选关键token。例如:SpeechPrune:计算音频-文本的余弦相似度矩阵,基于跨模态相关性修剪无关音频token,保留语义重要的片段。

优势 :压缩后的token与查询高度相关,适合语音识别、音频问答等任务。

局限性:依赖查询质量,对无明确任务的场景(如音频摘要)适用性有限。

总结:音频中心的token压缩针对时间和频谱冗余,核心策略包括:

- 变换方法通过堆叠、池化或卷积直接减少token,适合保留全局时序结构;

- 相似性方法合并高相似度token,有效去除重复信号;

- 注意力方法动态筛选关键token,可解释性强但受限于加速库兼容性;

- 查询方法聚焦任务相关音频信息,适合交互式场景。

参考文献:When Tokens Talk Too Much: A Survey of Multimodal Long-Context Token Compression across Images, Videos, and Audios,https://arxiv.org/pdf/2507.20198