在当今的互联网世界,音视频技术已无处不在。从短视频、直播到在线会议,这些应用的背后都离不开强大的音视频技术栈。而在众多技术中,FFmpeg 和 WebRTC 无疑是最核心、最值得深入学习的两大支柱。

一个处理离线音视频 ,是瑞士军刀;一个实现实时通信,是未来之星。

本文将为你梳理一条清晰的学习路线,带你逐一攻克这两大技术,为你的技术栈增添核心竞争力。

一、FFmpeg:音视频处理的瑞士军刀

FFmpeg 不仅仅是一个命令行工具,更是一套强大的开源库,是几乎所有音视频应用的底层核心。掌握它,你就掌握了音视频数据的一切。

阶段一:从命令行入门

别小看命令行,它是你快速理解 FFmpeg 功能的入口。

- 格式转换 :学会将一个视频文件从

mp4转换为flv,或将音频从mp3转换为aac。 - 剪辑与合并 :使用

-ss和-t参数进行视频裁剪,或用concat协议合并多个片段。 - 滤镜与特效 :尝试给视频添加水印 (

overlay滤镜),调整画面色彩(eq滤镜)。

阶段二:深入 libav 库

当命令行无法满足需求时,你需要进入 FFmpeg 的底层世界,使用 C/C++ 调用其 libav 库。这是构建自定义播放器、转码服务的基础。

- 解封装(

libavformat) :学习如何打开一个音视频文件,解析出其中的音频流、视频流,并读取数据包(AVPacket)。 - 编解码(

libavcodec) :掌握如何将AVPacket解码为原始帧(AVFrame,即 YUV/PCM 格式),或将原始帧编码为压缩数据。 - 滤镜处理(

libavfilter) :在代码中实现滤镜链,对音视频帧进行处理,如缩放、裁剪或美颜。

二、WebRTC:实时通信的未来

WebRTC 是一项革命性的技术,它让浏览器和移动端应用能够直接进行点对点(P2P) 通信,实现了超低延迟的音视频传输。

阶段一:核心概念的理解

WebRTC 的工作原理并不神秘,但需要理清其独特的概念体系。

- SDP :理解 Session Description Protocol。它就像通信双方的"名片",包含了各自的音视频能力、网络信息等。

- Offer/Answer 模型 :这是 WebRTC 连接建立的"握手协议"。一方向另一方发送

Offer,另一方以Answer回应。 - ICE/STUN/TURN 服务器 :它们是 WebRTC 建立连接的基础设施。STUN 帮助获取公网 IP,而 TURN 则在 NAT 穿透失败时作为中继。

阶段二:信令服务器的搭建

WebRTC 本身没有信令机制,它需要一个外部服务器来交换 SDP 和 ICE 候选。

- 协议选择 :通常使用 WebSocket,其全双工、持久连接的特性非常适合信令交换。

- 技术栈 :你可以使用 Node.js + Socket.io 快速搭建一个简单的信令服务器,它只需要负责将一个客户端的消息转发给另一个客户端。

阶段三:实战 P2P 视频通话 Demo

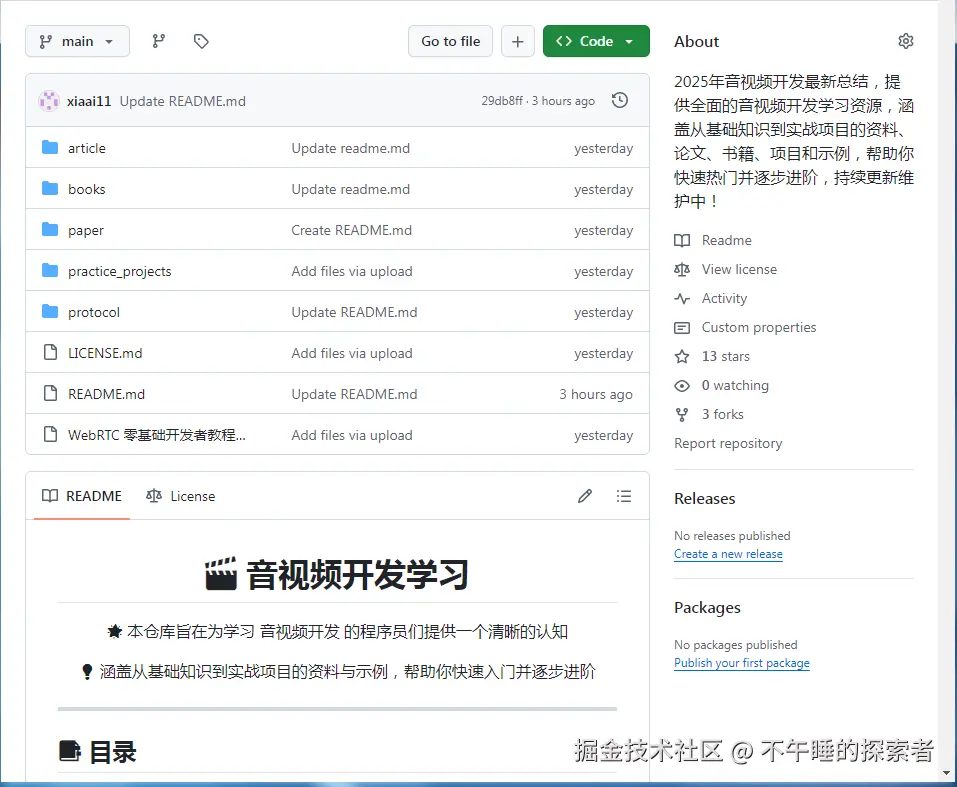

理论终究要回归实践。一个完整的视频通话 Demo 能让你将所有概念串联起来。项目详情可以看 GitHub 仓库

-

前端 :使用

getUserMedia获取本地流,创建RTCPeerConnection对象,监听onicecandidate和ontrack事件。 -

完整流程:

- 用户 A 发起呼叫,通过信令服务器发送

offer。 - 用户 B 收到

offer,创建answer,并通过信令服务器返回。 - 双方交换

ice candidate。 - 连接建立,开始传输音视频数据。

- 用户 A 发起呼叫,通过信令服务器发送

三、进阶与优化:成为专家

当你掌握了 FFmpeg 和 WebRTC 的基础后,可以进一步探索以下领域,让自己在面试中更具竞争力。

- 性能优化 :解决卡顿、延迟、花屏 等问题。学习码率控制 (VBR/CBR)、播放器缓存 和 Jitter Buffer 的实现。

- 音视频处理 :研究美颜、滤镜 (基于 OpenGL/Metal)、降噪 、回声消除(AEC) 等技术。

- 跨平台开发 :了解 FFmpeg 在 iOS/Android 平台上的集成与优化,如硬件编解码的调用。

总结

FFmpeg 和 WebRTC 是音视频开发的两大核心,分别代表了离线处理 和实时通信。它们相辅相成,构成了现代流媒体应用的技术基石。

希望这个 GitHub 仓库能为你提供明确的指引,让你在音视频开发的道路上走得更远。

如果你觉得这篇文章对你有帮助,不妨点赞、收藏,给 GitHub 仓库一个 star 让更多同学看到!