【论文阅读】SegCLIP:用于高分辨率遥感图像语义分割的多模态视觉语言和快速学习

文章目录

SegCLIP: Multimodal Visual-Language and Prompt Learning for High-Resolution Remote Sensing Semantic Segmentation

基于深度学习的语义分割方法层出不穷,取得了重大突破

目前的研究主要集中在视觉特征空间的表征学习上,多模态数据源的潜力还有待充分挖掘

视觉语言的基础模型,即对比语言图像预训练(CLIP),在视觉领域建立了一个新的范式

提出了一种基于语言描述的提示方法,使CLIP能够为遥感图像生成语义上不同的上下文信息

已经适应CLIP提取文本信息,从而指导视觉模型区分类

分利用文本数据的潜力,使用额外的真实的文本来细化模糊查询特征

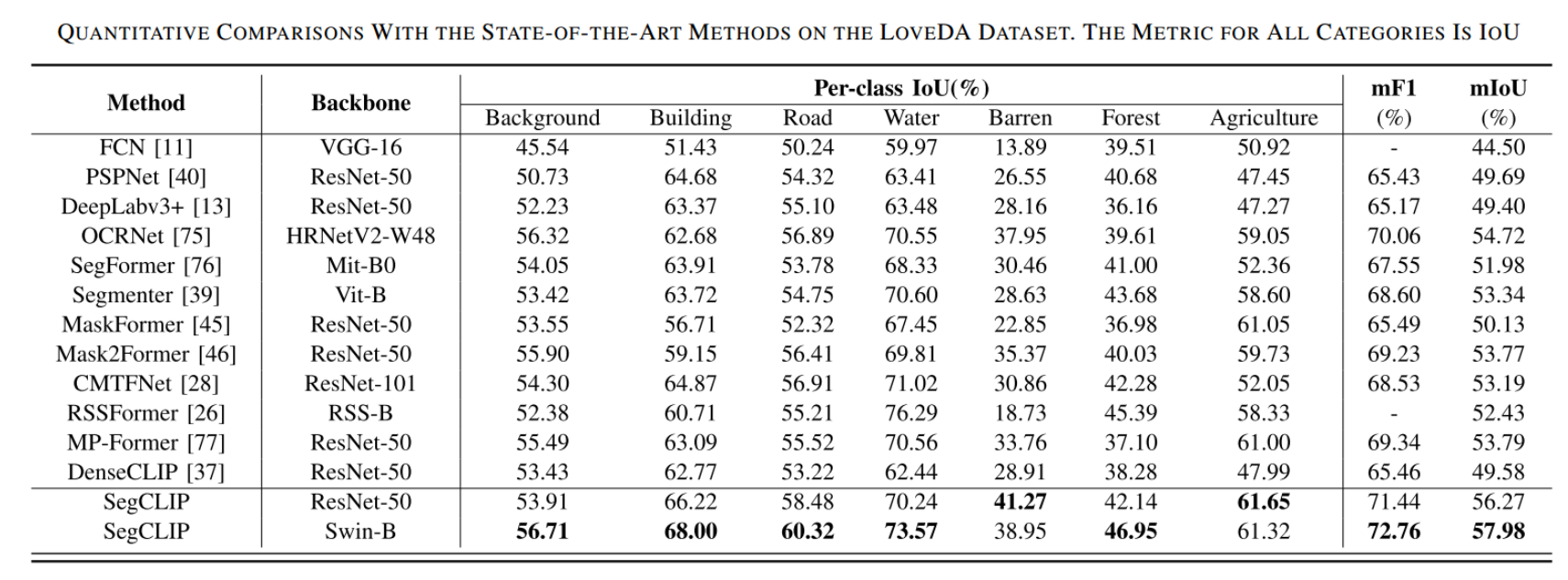

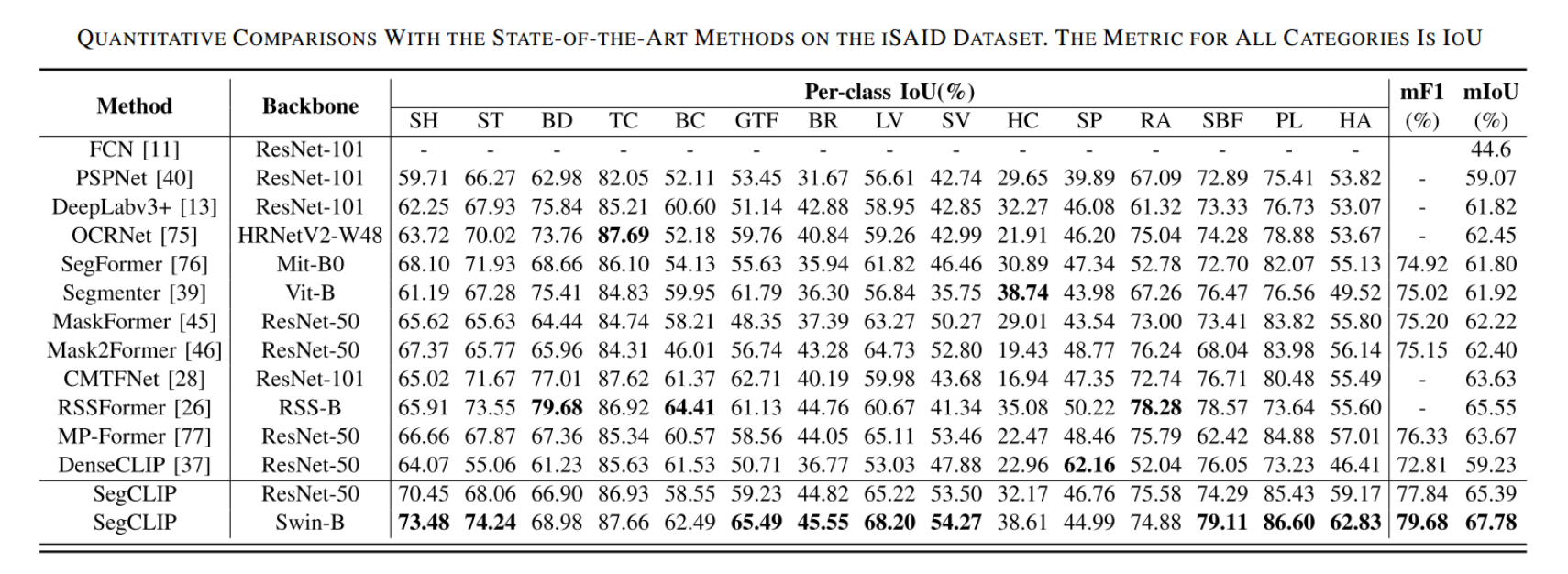

实验结果表明,该方法在LoveDA、iSAID和UAVid公共语义分割数据集上表现出了上级的性能

一、介绍

高分辨率遥感图像的语义分割是现代空间信息技术的重要组成部分

遥感语义分割作为一项基本的计算机视觉任务,试图精确地将遥感图像的每个像素分类到具有特定语义信息的类中

语义分割依赖于

- 阈值分割

- 边缘检测

- 传统机器学习

这些方法通常难以处理复杂场景和动态环境,并且由于有限的手动特征表达、泛化能力差和准确性低

随着深度学习的发展,图像语义分割取得了重大进展

- 交叉融合网络CF-Net引入了HRRS图像的交叉融合模块,扩展了低层特征的感受野

- S-RA-FCN通过分析空间位置和特征图之间的全局关系来增强关系特征表示

基于Transformer的架构在HR-RS图像语义分割方面取得了很好的效果

但由于只关注单模态数据,而忽略了多模态数据丰富的语义潜力,导致性能瓶颈

开发一个多模态HRRS语义分割框架对于克服这一局限性至关重要

随着传感器的多样性和遥感图像数量的不断扩大

多模态方法在语义分割任务中的应用越来越受到关注29

常见的遥感数据包括

- 多光谱图像

- 激光雷达(LiDAR)

- 合成孔径雷达(SAR)数据

Pan等人证明,将LiDAR数据合并到2-D多光谱图像中可以有效地解决建筑物高度的变化

Li等人开发了一种用于土地覆盖分类的融合架构,采用神经结构搜索(NAS)将分层光学特征与SAR数据融合

Kang等人通过光学图像的知识转移增强了SAR图像分割性能

视觉语言表征学习成为计算机视觉研究的一个重要领域,其目标是利用深度学习技术从图像-文本对中提取统一的跨模态特征表征,从而增强各种多模态任务

相关的工作:

- Li等人33将文本元素与相应的图像区域对齐,从而增强语言和视觉组件之间的关联

- Rahhal等人34引入了多语言Transformer模型,该模型通过集成多语言特征和提高理解能力来提高跨模态检索的准确性

- 对比语言图像预训练(CLIP)35在视觉分类任务中取得了显着的成功

- Dong等人36利用CLIP通过将其与描述性文本信息相结合,显着提高了遥感图像中变化检测的准确性和效率

- Rao et al 37和Yang et al 38通过像素-文本对齐将CLIP纳入语义分割网络,显着提高了分割性能

我们将CLIP集成到掩模分类中,并提出了一种新的多模态HRRS语义分割框架SegCLIP

与像素文本匹配方法不同,我们提出了一种使用文本信息作为查询条件的新方法

每个Mask确定相应的区域是否属于查询文本所描述的对象

这些掩码不仅准确地识别特别是,受提示学习的启发,我们使用CLIP来生成描述遥感图像的语言提示

以开发复杂的跨模态映射能力,为进一步提高遥感图像语义分割的多模态融合能力

设计了一个跨模态特征融合(CFF)模块

该模块将遥感影像的高层语义特征与相应的文本描述进行协调和整合,有效解决了模态间的信息异构,增强了跨模态的信息互补和协同理解

为了充分利用文本信息的优势,这些真实的文字提示被巧妙地引入

贡献如下:

- 集成了一个多模态视觉语言框架到语义分割网络的基础上掩码分类,它采用Mask来保持详细的类别和边界信息

- 为了解决多模态特征对齐的关键问题,我们开发了一个专门的多模态遥感语义分割CFF模块,为了语义一致性

- 为了充分挖掘文本信息的潜在价值,我们提出了一种额外的文本信息描述来引导模糊query特征

二、联系工作

基于深度学习的语义分割

语义分割的目标是为给定图像中的每个像素分配语义标签,以便每个像素都正确地标记其相应的类别

语义分割任务面临着由于类内和上下文变化而带来的困难

语义分割方法大致可以分为两大类:

- 逐像素分类的分割方法

- 基于掩码分类的分割方法

模分类模型预测图像中每个对象实例的类特定掩模,而不是独立地对每个像素进行分类

掩码分类广泛应用于实例级分割任务中

相关工作:

- 基于掩码区域的卷积神经网络(Mask R-CNN)结合了对象检测和像素级分割的集成方法

- 检测变换器(DETR)引入了一种集成预测机制,可以在对象查询的帮助下为每个区域生成类预测结果

- (MaskFormer)和掩蔽注意力Mask Transformer(Mask2Former)统一了语义分割和实例分割

- 混合掩码变换器(MMT)首次将掩码分类引入遥感图像解码

- 多尺度原型对比度网络(MPCNet)提出了一种基于原型比较的Mask分类网络

我们提出了一种基于掩模分类技术的HRRS图像语义分割方法,该方法深入探索并充分利用了多模态融合策略

多模态prompt学习

计算机视觉任务的学习范式主要以"预训练和微调"方法为特征

监督学习]或自监督学习在自然图像上进行预训练

在预训练模型的基础上,针对各种特定的下游任务,进一步对模型参数进行有针对性的微调和优化

作为适应不同视觉理解和识别需求的一种方式

这一过程主要依赖于像ImageNet这样的大型自然图像数据集进行预训练

方法转向一个新的阶段:"预训练和提示"

重点转移到使用提示重新设计输入以与原始预训练任务保持一致的下游任务上

最大限度地减少了预训练模型和特定任务微调之间的语义偏差

越来越多的研究人员将多模态学习用于计算机视觉任务

- Language aware domain generalization network for cross-scene hyperspectral image classification

- A distance-constrained semantic autoencoder for zero-shot remote sensing scene classification

- Few-shot object detection in aerial imagery guided by textmodal knowledge

- Tan和Bansal 通过共享的Transformer结构联合建模来自两种模态的信息,学习统一且相互关联的跨模态表示

- Li等人提出了一种结合视觉和语言表示的学习的方法,通过动量蒸馏技术预先对齐它们,以改善来自两种模态的信息融合

- Huo et al 67介绍了一种大规模的多模态预训练方法,旨在通过图像和文本数据的联合训练,有效地构建和桥接视觉和语言之间的联系

CLIP 35是自监督和多模态深度学习的里程碑,它使用了大规模的比较学习机制

以有效地将图像与相关的文本描述进行配对,从日常自然场景到遥感和医学成像等专业领域

Rao等人37使用CLIP模型对图像中的每个像素进行分类,通过将图像-文本匹配转换为像素-文本匹配来实现更精确和密集的语义分割预测

Yang等人38在此基础上,通过整合多模态和多尺度信息,实现了遥感图像的语义分割

SegCLIP集成了掩模分类和基于文本的视觉遥感语义分割,与像素-文本匹配相比,每个掩模不仅可以准确地识别目标对象的位置,而且可以更好地保留其边界信息

三、方法

在本节中,我们首先详细介绍SegCLIP框架,这是一种使用CLIP进行语义提示的HRRS语义分割任务的学习方法

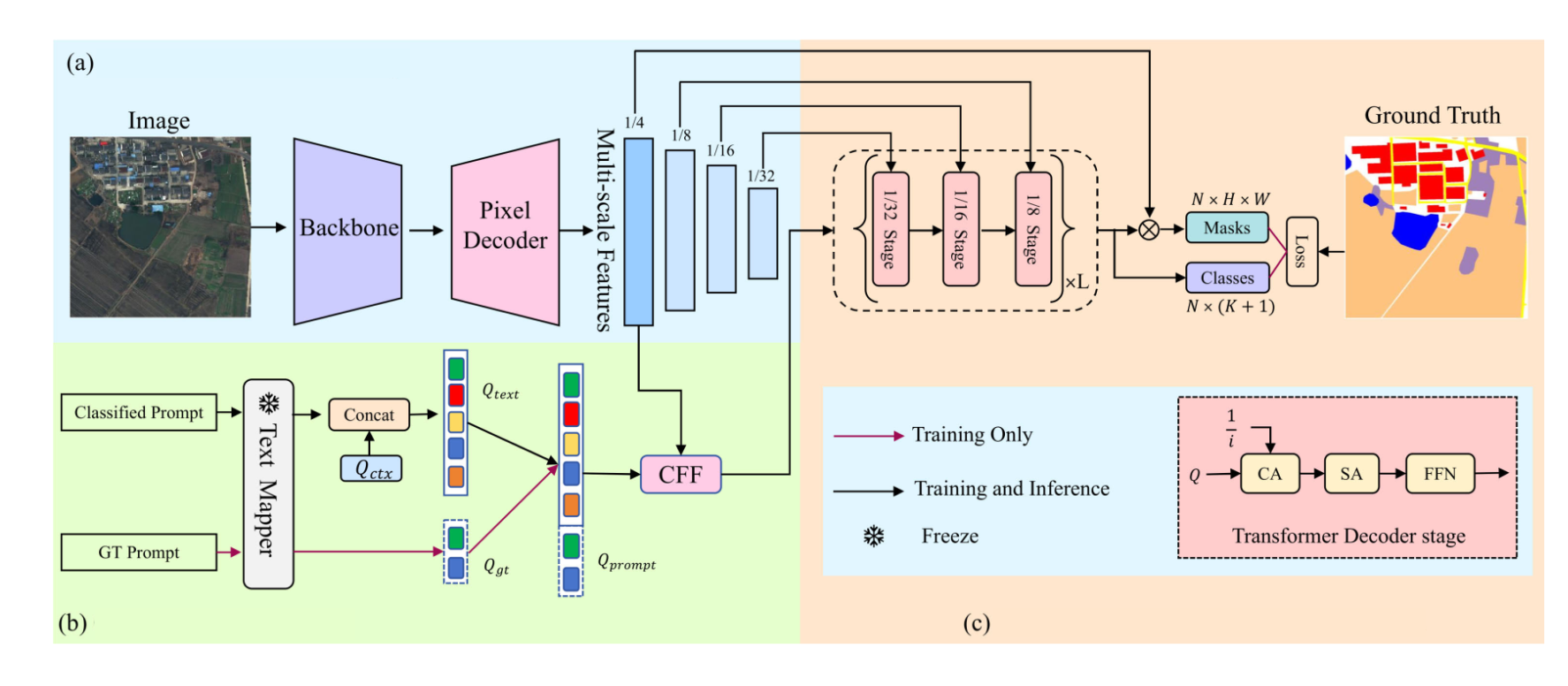

SegCLIP的整体架构分为三个核心组件:

- 多尺度特征建模

- 跨模态文本提示和Transformer解码

- 类别预测

重点研究:

- 跨模态文本提示

- Transformer解码

- 文本映射提示(TMP)

- CFF模块

- 地面真实文本引导(GTG)

SegCLIP整体框架:该框架分为三个主要部分:

**(a)**提取多尺度特征

**(b)**为随后的文本提示生成语言描述

**(c)**生成分类及其相应的掩码

在多尺度特征建模阶段,选择ResNet-50 作为主干网络结构来提取图像的多级特征表示

然后由像素解码器细化,以实现每个像素级的准确预测

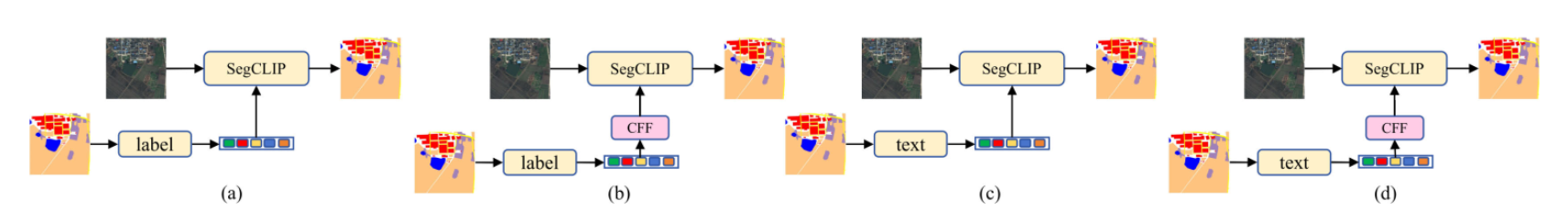

跨模态文本提示主要包括TMP、CFF模块和GTG,这也是我们工作的重点

利用CLIP模型的无监督分类能力,生成文本提示,用于多模态输入数据,侧重于语义分割

仅使用CLIP的文本编码器,冻结其参数,这个过程是由TMP完成的

文本和图像数据的表示和结构差异较大,直接使用文本特征指导图像中的语义特征提取可能会导致模型学习困难

因此通过CFF模块将联合收割机的文本和视觉特征结合起来

在跨模态文本提示中,通过GTG引入地面实况(Ground-Truth,GT)文本信息

经过多层Transformer解码器运算,最终得到维数为N ×(K + 1)的类预测向量

二进制掩码预测Pmask的维数为N × H × W

通过对掩码嵌入和类别预测向量Pclass进行逐元素乘积运算得到,最后通过矩阵运算将Pclass和Pmask结合得到最终的语义分割结果

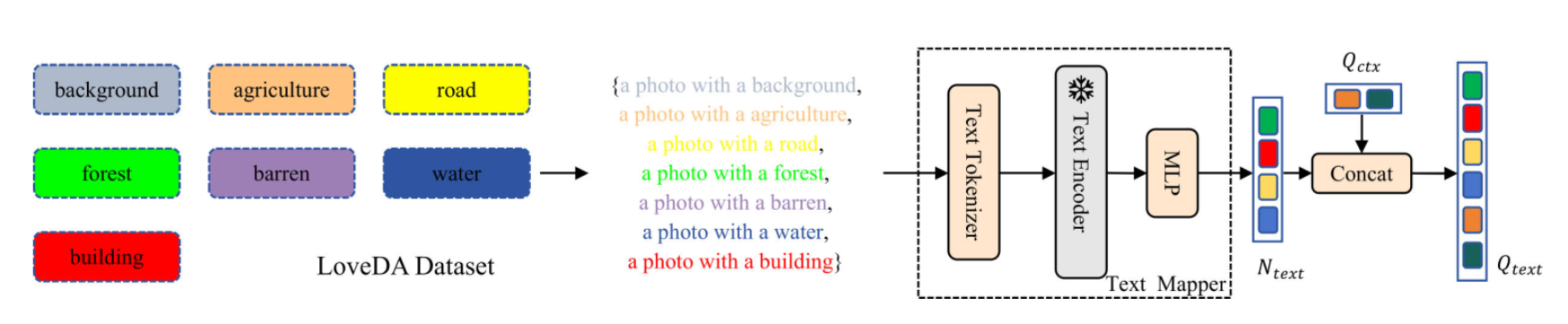

文本映射提示

建了一种自适应的方法来生成这样的描述,旨在协调掩模分类与视觉文本

过引入联合视觉-语言学习机制,我们将交叉注意学习转化为探索视觉数据和语言描述之间内在联系的过程

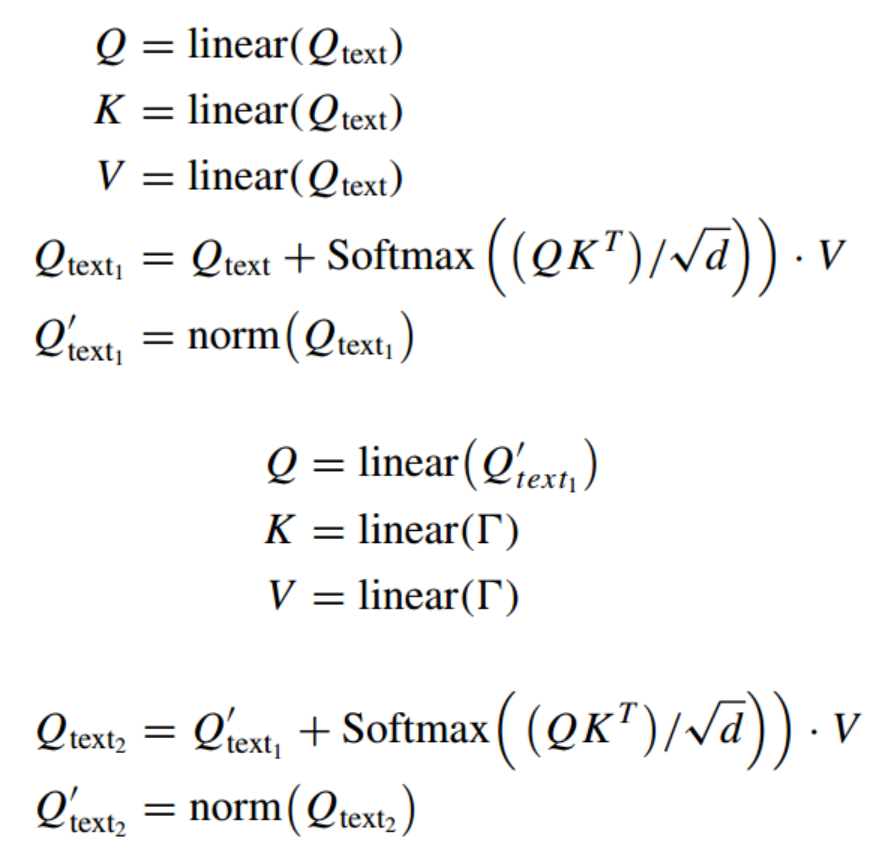

我们选择LoveDA数据集70作为示例

它涵盖了七个核心类:背景、建筑物、道路、水、荒地、森林、农业,对于这n个类,我们构造了相应的文本描述

我们使用模板"a photo with a {class}"为每个类编译一个文本描述列表,其中"class"表示类名

文本映射器包括文本标记器,冻结文本编码器,

- 该组件生成视觉上相关的文本提示查询嵌入(Ntext)

- 随后将其与可学习的文本上下文嵌入(Qctx)

- 集成以形成文本提示(Qtext)

文本结构为text = a photo with a {class~i~},其中i ∈ 1,7

使用称为文本标记器的序列数据处理方法将这些自然语言描述转换为文本编码特征

编码器是一个包含12层转换器的架构。

因此,文本嵌入不仅包含图像中的二进制掩码信息,还包含每个类别的概率分布,从而为模型提供丰富的语义信息

为了进一步增强模型的语义理解能力,我们引入了一组可学习的文本上下文嵌入Qctx

反过来又会生成N个文本查询项(Qtext)

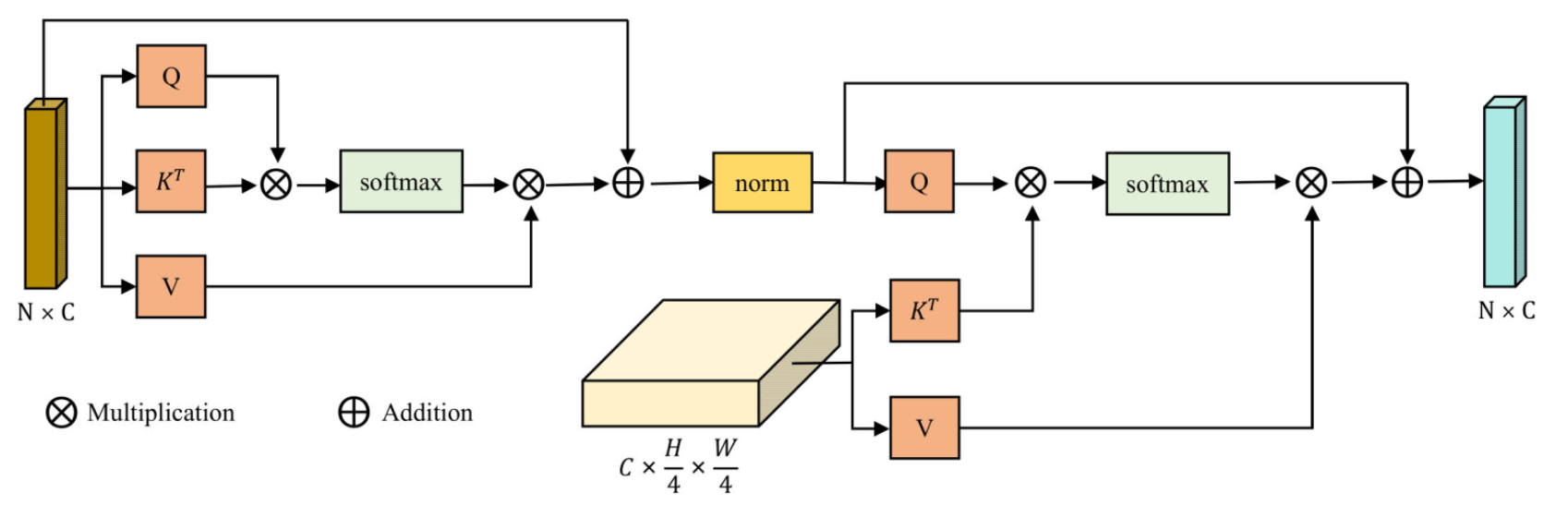

CFF模块

由于遥感图像本身的复杂性,文本编码器提取的文本信息很难与特定的遥感图像准确对应,这对多模态遥感图像语义分割提出了挑战

设计了一个CFF模块,旨在有效地集成图像的高级语义特征和文本嵌入特征

以增强不同模态之间的协同作用和相关性

class的数量(n)小于query的数量(N)

当构造文本提示时,原始文本嵌入可能包含冗余的"空白"信息,这对于在分割任务中引导提示没有帮助

采用注意机制来促进每个位置特征按照其顺序进行信息的交互和整合

旨在增强和协调内部特征表征的一致性,从而抑制冗余信息的表达

这种方法对于严重依赖文本上下文的信息特别有利

这些特征包含了丰富的上下文信息,能够捕捉和表达内部复杂的细节和结构关系,通过交叉注意机制对齐这些特征,使模型能够更好地理解文本和图像之间的内在关系

使用闭集合中的类标签作为文本提示来精确定义查询范围,但是,这个过程未能充分利用文本信息的潜力

虽然我们在图4中为遥感图像

指定了"背景"、"农业"、"道路"、"森林"、"荒地"、"水"和"建筑物"的文本提示

但在(b)中只有"背景"、"道路"和"建筑物"标签相关,其余提示都不相关,提示使用率低

虽然目前的方法通过标签定义查询范围,但不能有效利用文字提示,如何制定更准确的指引?

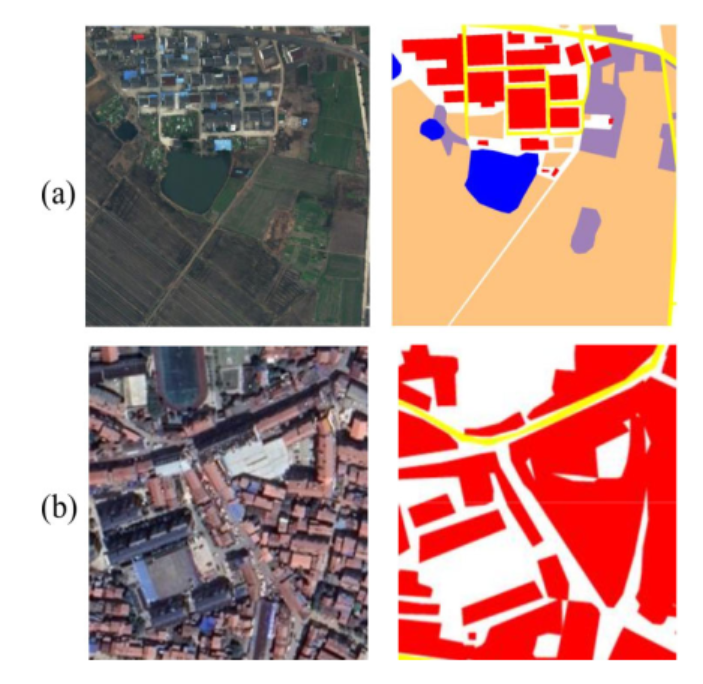

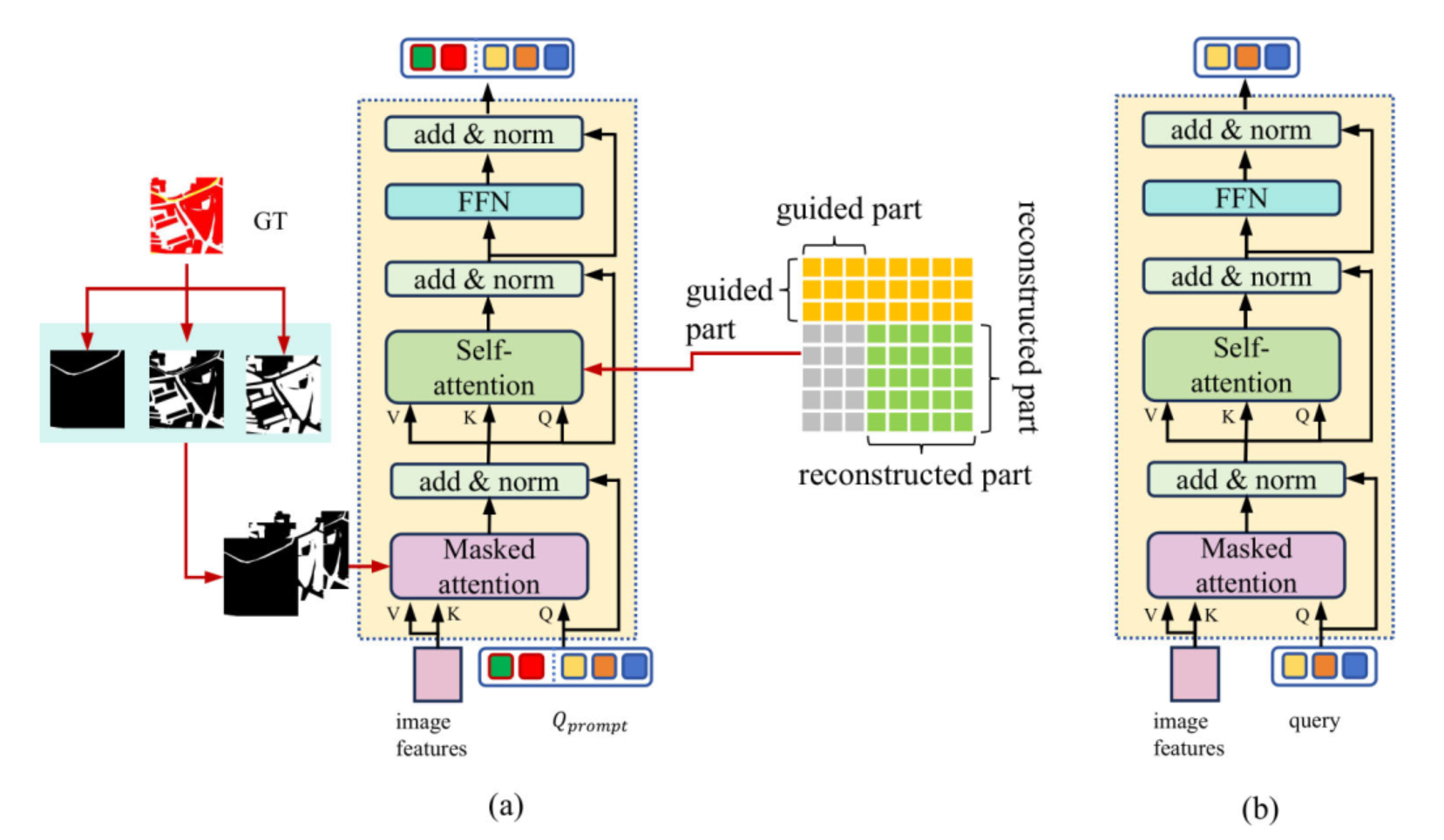

如图5所示,(a)和(B)的提示内容由类(c)和(d)采用GT来获取语言描述作为提示内容,利用相应的提示内容作为附加查询

采用方法(d)可以获得上级性能

为了便于计算,假设GT包含前t类的前景。因此,textgt被公式化为具有{class~i~}的照片,其中i ∈ 1,t

textgt经过文本标记器(Tt)和文本编码器(encodertext)的处理,以生成文本映射(Qgt),然后将其作为附加查询嵌入

因此,在解码器的训练阶段,查询被分为两部分:

引导部分(Qgt)

重建部分(Qtext)

重建部分来自数据集中的类别描述

我们从GT中获得与每个类别对应的前景区域作为二进制掩码

掩码注意阶段,我们联合将这些类别特定的二进制掩码与原始掩码相结合,并使用GT的二进制掩码来指导原始掩码的重建过程

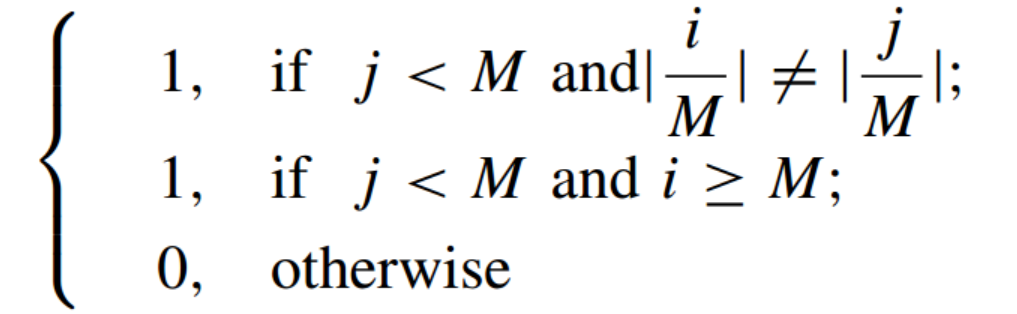

自我注意阶段,我们引入了注意力掩模方法

损失函数

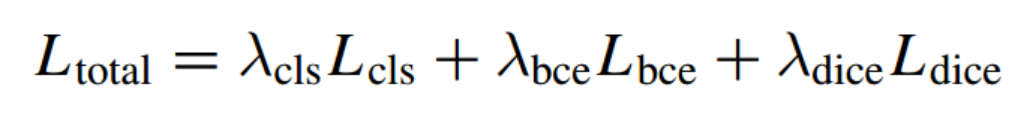

egCLIP训练过程涉及计算两个主要损失:预测分类损失和预测掩码损失

四、实验结果

数据集

LoveDA数据集

- 1024 × 1024像素

- 2522张图像进行训练

- 1669张图像进行验证/测试

iSAID 数据集

- 512 × 512

- 1411幅训练集图像进行训练,

- 458幅图像进行验证

UAVid 数据集

- 1024 × 1024像素

- 200幅图像用于训练

- 70幅图像用于验证

文中还给了更多对应的消融实验