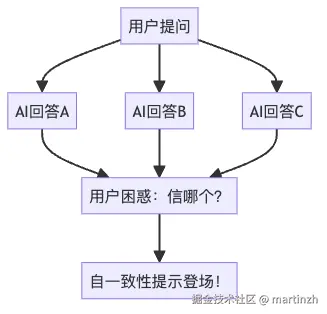

一个让人头疼的AI场景

你正在准备一个重要的技术方案,需要用AI帮你计算一些关键数据。你满怀信心地问了ChatGPT一个数学问题,它给出了答案A。但是你心里有点不踏实,于是重新问了一遍,这次它给了答案B!你再问一次,天哪,又是答案C!

这时候你的内心独白大概是:"兄弟,你到底行不行啊?这是要我相信哪个答案?"

图1:传统单次提问的困惑场景

如果你遇到过类似的情况,恭喜你,你已经发现了大语言模型的一个"小秘密"------它们有时候会像那个考试时改来改去的同学一样,对同一个问题给出不同的答案。

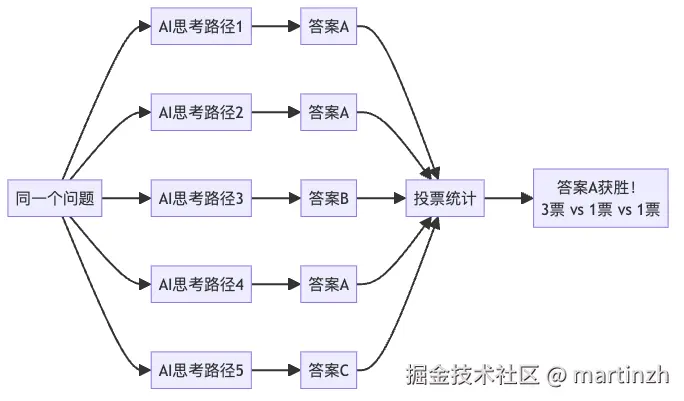

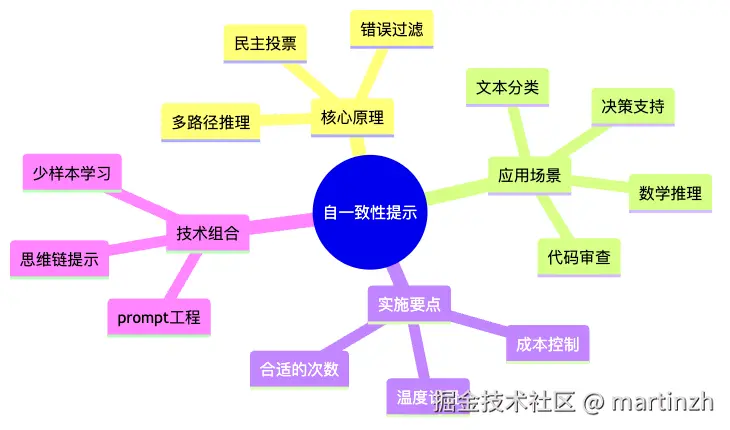

什么是自一致性提示?AI界的"民主投票"

自一致性提示(Self-Consistency Prompting)是一个听起来很高大上,但原理却出奇简单的技术。说白了,就是:

既然你AI一次给不准答案,那我就让你答好几次,然后看哪个答案出现得最多!

图2:自一致性提示的"民主投票"机制

就像班级选班长一样,让AI"投票"选出最靠谱的答案。这种方法的核心思想是:如果一个答案是正确的,那么AI通过不同的思考路径应该都能得出这个答案。

为什么要"折磨"AI?

你可能会问:"为什么要让AI重复回答同一个问题?这不是浪费时间和算力吗?"

其实这就像你做重要决定时会征求多个朋友的意见一样。AI虽然很聪明,但它的"大脑"工作方式有点像人类的直觉思维------同一个问题可能会触发不同的思考路径。有些路径可能会走错,但正确的路径通常会更稳定地出现。

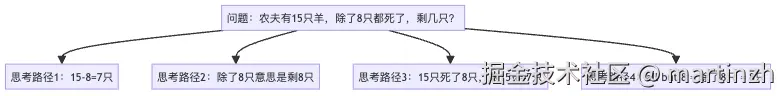

自一致性提示的工作原理:AI的"头脑风暴"

让我用一个生动的比喻来解释这个过程:

步骤1:生成多条思考路径

图3:AI的多路径思考过程

就像让AI开"头脑风暴"会议,每次都用不同的角度思考同一个问题。

步骤2:收集所有答案

AI像勤奋的学生一样,把每次思考的结果都记录下来:

- 路径1的答案:7只

- 路径2的答案:8只

- 路径3的答案:7只

- 路径4的答案:8只

步骤3:民主投票

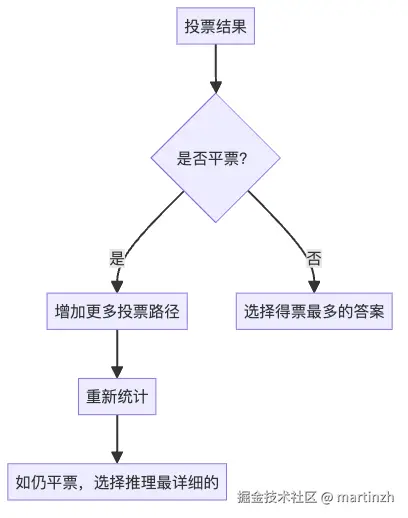

现在到了最关键的环节------数票!

- 答案"8只":2票

- 答案"7只":2票

咦,平票了?这时候我们可能需要更多的思考路径来打破平衡,或者仔细分析哪种推理更合理。

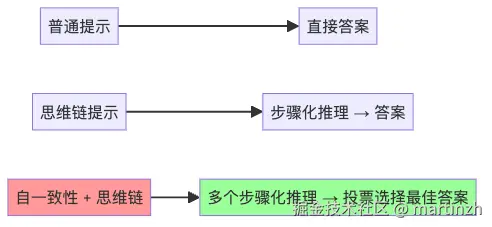

自一致性 vs 思维链:天作之合的技术组合

你可能听说过另一个厉害的技术叫"思维链提示"(Chain-of-Thought)。如果说思维链是让AI"显示工作过程",那么自一致性就是让AI"多做几遍作业"。

图4:不同提示技术的对比

这就像:

- 普通提示:直接问"1+1等于几?"

- 思维链提示:问"请解释1+1为什么等于2,写出计算过程"

- 自一致性+思维链:问"请用3种不同的方法解释1+1等于几,每种方法都要写出详细过程"

为什么这个组合这么厉害?

想象一下,你让AI解一道复杂的数学题:

单纯的思维链:AI很认真地一步步推理,但如果第二步算错了,后面全错。就像多米诺骨牌,一倒全倒。

自一致性+思维链:AI用多种方法推理,即使其中一两种方法在某个步骤出错,其他正确的方法依然能给出正确答案。就像多条备用路线,总有一条能到达目的地。

实战演练:让AI帮你解决真实问题

场景:智能客服的困境

假设你在开发一个智能客服系统,需要AI准确理解用户的退款请求。客户说:"我昨天买的那个东西不太满意,可以退吗?"

传统方式可能让AI这样回答:

- 第一次:"可以退款"

- 第二次:"需要查看具体商品政策"

- 第三次:"请联系人工客服"

使用自一致性提示:

css

请分析以下客户咨询的意图,用3种不同的分析角度:

客户说:"我昨天买的那个东西不太满意,可以退吗?"

分析角度1 - 从时间维度:

[推理过程]

意图分类:

分析角度2 - 从情感表达:

[推理过程]

意图分类:

分析角度3 - 从具体需求:

[推理过程]

意图分类:

最终一致性判断:通过这种方式,AI会更稳定地识别出这是一个"退款咨询"请求。

实际代码示例:数学推理

让我们看一个实际的Python实现思路:

ini

def self_consistency_prompting(question, num_paths=5):

"""

自一致性提示的简化实现

"""

# 设置不同的温度参数,鼓励多样化思考

temperature = 0.7

all_answers = []

base_prompt = f"""

请解决以下问题,使用步骤化推理:

问题:{question}

推理步骤:

最终答案:

"""

# 生成多个响应

for i in range(num_paths):

response = call_ai_model(base_prompt, temperature=temperature)

answer = extract_final_answer(response)

all_answers.append(answer)

print(f"路径 {i+1} 的答案:{answer}")

# 统计投票结果

final_answer = majority_vote(all_answers)

return final_answer

# 使用示例

question = "小明有10个苹果,吃了3个,又买了5个,最后有几个?"

result = self_consistency_prompting(question)

print(f"自一致性推理的最终答案:{result}")不同场景的应用技巧

1. 数学题场景

css

解决这个数学问题,请提供3种不同的解题思路:

问题:[具体题目]

解题思路1:

解题思路2:

解题思路3:

最一致的答案:2. 分类任务场景

arduino

对以下文本进行情感分析,从3个不同角度评估:

文本:"这个产品真的让我很无语..."

角度1 - 词汇分析:

角度2 - 上下文语境:

角度3 - 整体语调:

最终分类:进阶技巧:让自一致性提示更智能

1. 设置合适的"投票次数"

就像选举一样,参与投票的人越多,结果通常越可靠。但也不是越多越好:

- 3-5次:适合简单问题,快速验证

- 5-10次:适合中等复杂度问题

- 10次以上:适合高风险决策,但要考虑成本

2. 温度参数的艺术

AI的"温度"设置就像人的思考状态:

- 温度太低(0.0-0.3) :AI像机器人一样死板,每次答案都一样

- 温度适中(0.5-0.8) :AI有创意但不发散,最适合自一致性

- 温度太高(0.9-1.0) :AI像喝醉了一样胡言乱语

3. 处理平票情况

当出现平票时,可以这样处理:

图5:平票情况的处理流程

实际应用场景:解决真实世界的问题

场景1:AI写作助手

你在开发一个AI写作助手,用户要求写一篇关于"人工智能未来发展"的文章大纲。

问题:单次生成的大纲可能偏向某个角度,不够全面。

自一致性解决方案:

arduino

请为"人工智能未来发展"这个主题设计文章大纲,从3个不同视角:

视角1 - 技术发展角度:

视角2 - 社会影响角度:

视角3 - 商业应用角度:

综合最佳大纲:这样生成的大纲会更全面、更平衡。

场景2:智能诊断系统

医疗AI需要根据症状描述给出可能的诊断建议。

问题:单一推理路径可能遗漏重要信息。

自一致性解决方案:让AI从多个医学角度分析同一组症状,最后综合判断,提高诊断的准确性和可靠性。

场景3:代码审查助手

你需要AI帮你审查代码中的潜在问题。

问题:AI可能只发现某一类问题,遗漏其他问题。

自一致性解决方案:

请从以下3个角度审查这段代码:

角度1 - 语法和逻辑错误:

角度2 - 性能优化问题:

角度3 - 安全漏洞风险:

综合评估报告:注意事项:不要把AI累坏了

1. 成本考虑

自一致性提示会增加API调用次数,就像:

- 单次提问:花1块钱

- 5次自一致性:花5块钱

所以要在准确性和成本之间找平衡,不是所有问题都需要用自一致性。

2. 时间成本

多次调用意味着更长的等待时间。想象用户在聊天界面等待,3秒和15秒的体验差别巨大。

3. 什么时候使用自一致性?

适合使用的场景:

- 数学计算问题

- 逻辑推理任务

- 重要决策支持

- 分类任务验证

不适合的场景:

- 创意写作(需要多样性,不需要一致性)

- 简单问答(大炮打蚊子)

- 实时对话(速度要求高)

总结:让AI变得更可靠的魔法

自一致性提示技术就像给AI请了几个"顾问",让它在做决定前多听听不同意见。这个看似简单的技巧,却能显著提升AI在复杂推理任务中的表现。

图6:自一致性提示技术全景图

记住这个技术的核心思想:当你不确定AI的单次回答时,让它多试几次,然后选择出现频率最高的答案。

就像古人说的"三个臭皮匠,顶个诸葛亮",多个AI推理路径的组合,往往能得出比单次推理更准确的结果。

下次遇到重要问题时...

不要再纠结AI给的第一个答案是否正确,试试自一致性提示吧!让AI像一个负责任的老师一样,反复确认答案,直到你满意为止。

毕竟,在AI的世界里,"多想几遍"从来不是坏事!