主要思想:在看某个类别c预测时,最后一层卷积特征图里,哪些空间位置对该类别的得分贡献最大。

为什么选用最后一层卷积特征图:1)语义最强 ,厚层聚合了大量前层证据,学到的往往是高级形态(核形、颗粒、核染色、Auer小体等),更贴近临床语言,早层只会告诉你"这里有条纹/对比度高";2)保留空间分辨率 ,最后一层卷积"是最靠近分类器且仍有空间网格 的位置,用它做热力图,既类相关又能定位到细胞/核区域;3)感受野刚刚好 ,随着层级的加深,感受野逐渐增大,最后几层的感受野已经足够覆盖整个细胞或其关键结构,而不是零碎纹理;4)数值更稳定 ,早层梯度非常嘈杂、容易受颜色/纹理干扰;最后一层卷积的梯度更类相关,热力图稳定性好。这是语义性、空间性和稳定性的折中点。

回答两个问题:1)这些探测器里,谁对这次"某类别 c"的判断更关键 ?2)在图上的哪些位置真正"驱动"了这次 c 的判定?

实现过程过程:

最后一层卷积的第k个通道特征图Ak,H*W维(这里要计算所有通道);

类别c的logit:yc(这个是什么:是模型对类别c的原始打分,还没有经过softmax和sigmoid的数值,一个样本对每个类别都会计算出一个值);

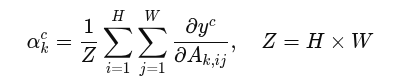

计算通道权重(通过梯度给每个通道分配话语权):

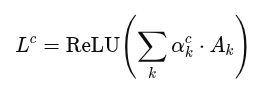

类别c的Grad-CAM热力图(未上采样前):

把Lc双线性差值回到输入大小,叠加到原图即可可视化(这一步是如何操作的)

适用于哪些情况:Grad-CAM 主要适用于有卷积层、能保留空间结构的深度学习模型(典型是 CNN 及其变体)。在 ViT 等 Transformer 中也能通过改造应用;而对没有空间维的模型(RNN、MLP),则不合适。