一、介绍

MultiTalk 是由中山大学、美团和香港科技大学联合研发的一款音频驱动的多人对话视频生成框架。它能够根据多路音频输入、参考图像和文本提示,生成包含多个角色互动且唇形与语音高度同步的视频内容。简单来说,它能让静态图片中的人物"开口说话",并且还能进行"对话"。其特点为:

💬 逼真的对话 - 支持单人和多人生成

👥 交互式角色控制 - 通过提示指导虚拟人

🎤 泛化表演 - 支持卡通人物和歌唱的生成

📺 分辨率灵活性:任意纵横比下的 480p 和 720p 输出

⏱️ 长视频生成:支持长达 15 秒的视频生成

二、本地部署

注意:本文主要介绍部署到 ComfyUI 中使用

| 环境 | 版本号 |

|---|---|

| Python | =3.12 |

| PyTorch | =2.8.0 |

| cuda | =12.6 |

| Ubtuntu | 22.0.4 |

1.安装 Miniconda

步骤 1:更新系统

首先,更新您的系统软件包:

sql

sudo apt update

sudo apt upgrade -y步骤 2:下载 Miniconda 安装脚本

访问 Miniconda 的官方网站或使用以下命令直接下载最新版本的安装脚本(以 Python 3 为例):

arduino

wget https://repo.anaconda.com/miniconda/Miniconda3-latest-Linux-x86_64.sh步骤 3:验证安装脚本的完整性(可选)

下载 SHA256 校验和文件并验证安装包的完整性:

bash

wget https://repo.anaconda.com/miniconda/Miniconda3-latest-Linux-x86_64.sh.sha256

sha256sum Miniconda3-latest-Linux-x86_64.sh比较输出的校验和与.sha256 文件中的值是否一致,确保文件未被篡改。

步骤 4:运行安装脚本

为安装脚本添加执行权限:

bash

chmod +x Miniconda3-latest-Linux-x86_64.sh运行安装脚本:

./Miniconda3-latest-Linux-x86_64.sh步骤 5:按照提示完成安装

安装过程中,您需要:

阅读许可协议 :按 Enter 键逐页阅读,或者按 Q 退出阅读。

接受许可协议 :输入 yes 并按 Enter。

选择安装路径 :默认路径为/home/您的用户名/miniconda3,直接按 Enter 即可,或输入自定义路径。

是否初始化 Miniconda :输入 yes 将 Miniconda 添加到您的 PATH 环境变量中。

步骤 6:激活 Miniconda 环境

安装完成后,使环境变量生效:

bash

source ~/.bashrc步骤 7:验证安装是否成功

检查 conda 版本:

css

conda --version步骤 8:更新 conda(推荐)

为了获得最新功能和修复,更新 conda:

sql

conda update conda2.部署 ComfyUI

2.1 克隆代码仓库

bash

git clone https://github.com/comfyanonymous/ComfyUI.git2.2 安装依赖

- 创建 conda 虚拟环境

ini

conda create -n comfyenv python==3.12

conda activate comfyenv- 安装依赖

bash

cd ComfyUI

pip install -r requirements.txt- 安装 ComfyUI Manager

bash

#进入插件的文件

cd /ComfyUI/custom_nodes/

#下载ComfyUI Manager

git clone https://github.com/Comfy-Org/ComfyUI-Manager.git3.下载模型

在huggingface中下载模型

bash

#进入项目文件

cd ComfyUI

#下载模型文件到指定文件夹

#下载huggingface_hub

pip install huggingface_hub

huggingface-cli download --resume-download Comfy-Org/Wan_2.2_ComfyUI_Repackaged --local-dir /ComfyUI/models/diffusion_models --include "split_files/diffusion_models/wan2.2_i2v_low_noise_14B_fp8_scaled.safetensors"

huggingface-cli download --resume-download Comfy-Org/Wan_2.2_ComfyUI_Repackaged --local-dir /ComfyUI/models/diffusion_models --include "split_files/diffusion_models/wan2.2_t2v_low_noise_14B_fp8_scaled.safetensors"

#下载text_encoders模型

huggingface-cli download AUTOMATIC/stable-diffusion-3-medium-text-encoders --local_dir /models/text_encoders/4.启动 ComfyUI

css

python main.py输入网址进入 ComfyUI:

arduino

http://127.0.0.1:8188

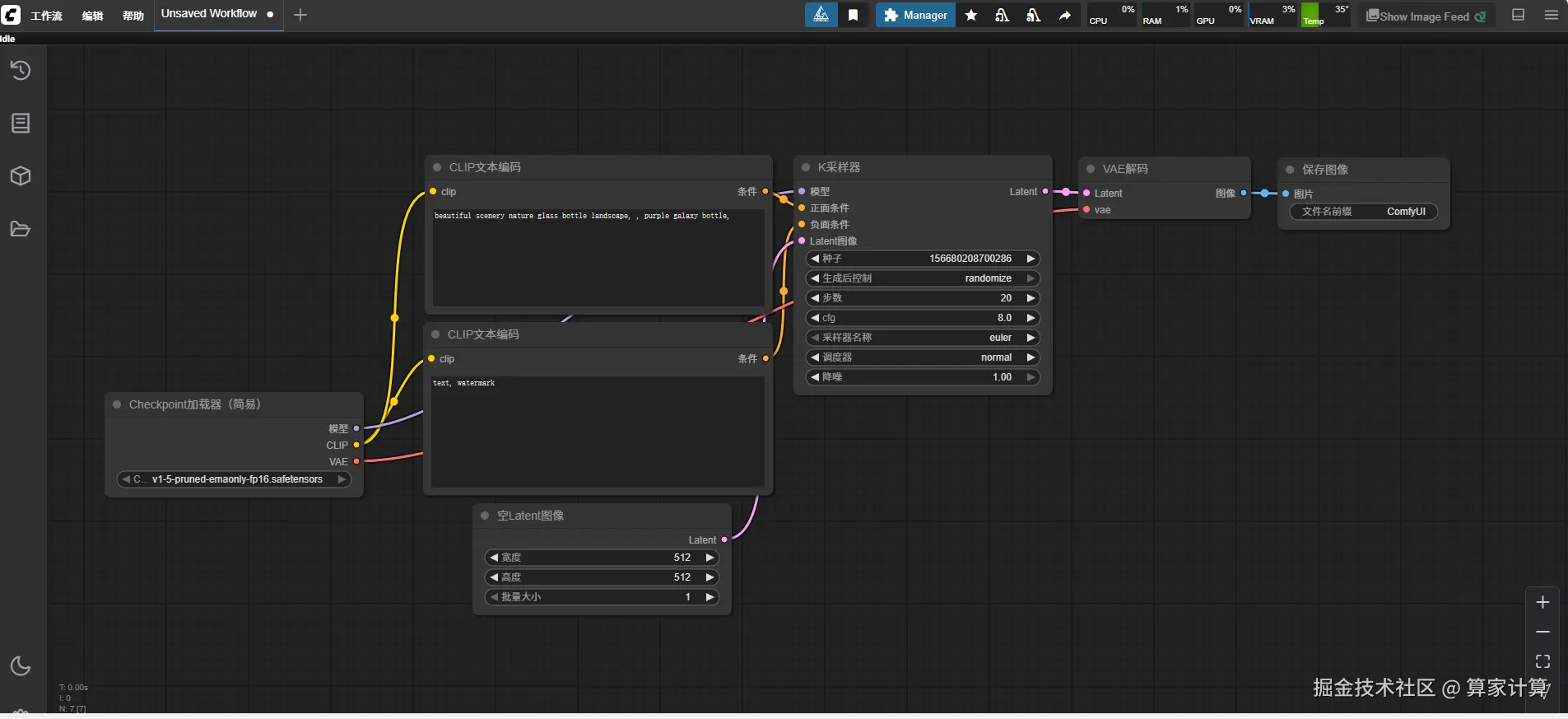

5.工作流

本镜像工作流已改动过,原工作流可以在kijai的仓库中找到