如果每次查数据、改状态、触发工作流,都需要你离开聊天窗口,去翻 API 文档、写 curl 命令或者跑一个单独的脚本,那 Chat 的效率其实大打折扣。真正的集成,应该是让工具主动适配你的工作流程,而不是反过来。

为了解决这个断层,302.AI 支持把用户现有的任何 API 配置成一个 MCP Server,并即刻在 Chat 中像调用内置功能一样使用它。

化繁为简,我们做的就是帮你将第三方 API 的 URL、请求方法、参数和认证信息一键映射为符合 MCP 协议的 Tools 和 Resources,无需手动处理 Stdio、SSE 以及 Streamable HTTP 的传输细节,也不用关心不同 AI 模型在调用格式上的差异。只需专注于定义 API 的业务逻辑,剩下的接入和兼容工作都由我们的 MCP Server 自动完成。

本篇教程将详解如何在 302.AI 将任意 API 转换为可在 Chat 中直接调用的 MCP Server,方便用户更快捷地部署工作流。

Ⅰ. 接入自定义API

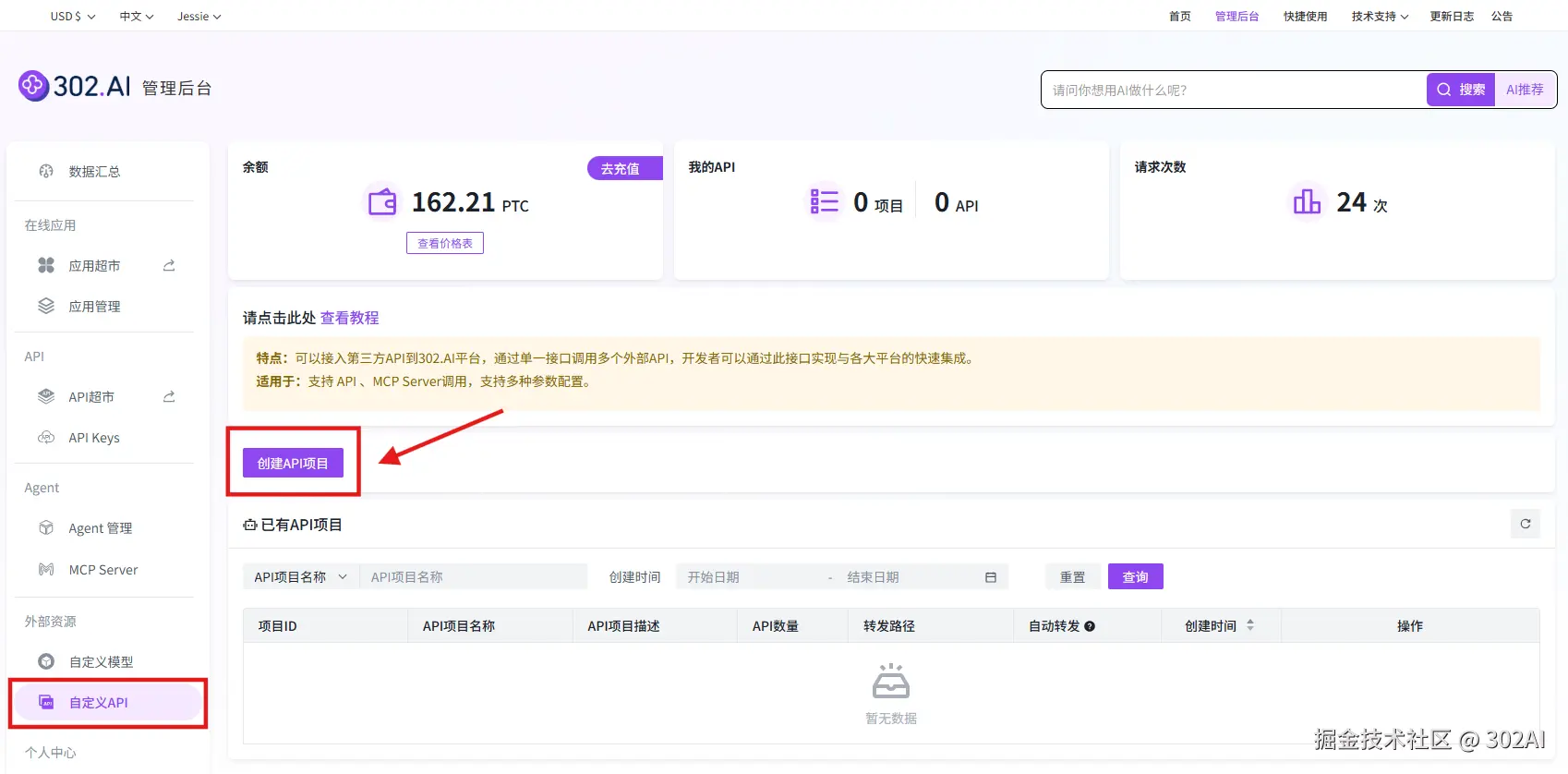

1. 创建API项目

进入 302.AI 管理后台界面,选择外部资源→自定义API→创建API项目

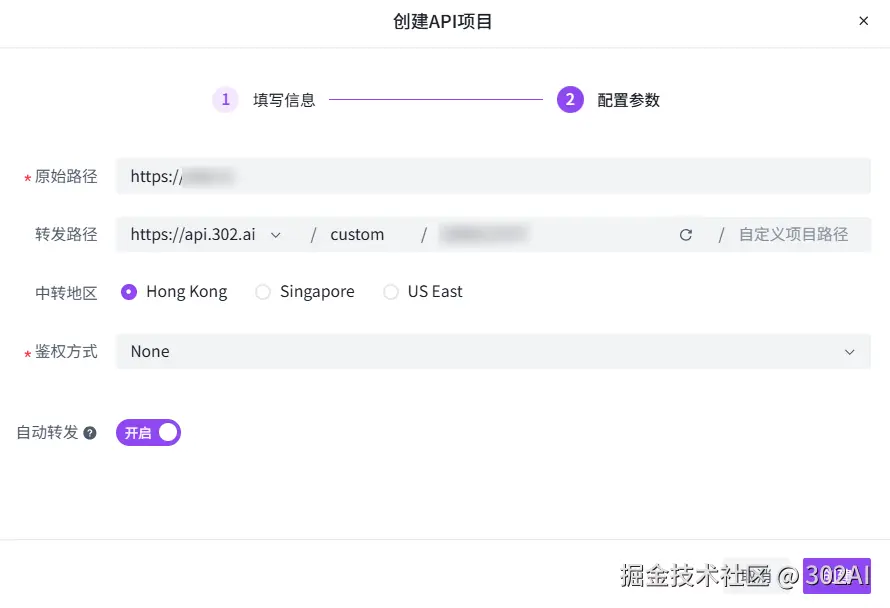

填写项目信息:API项目名称(必填)、API项目描述

此处支持两种两种方式导入数据:

(1)OpenAPI URL 导入:输入 json 或 yaml 数据文件的 URL 直链

(2)文档导入:直接将 json 或 yaml 文件拖拽导入

配置项目参数:原始路径(必填)、转发路径、中转地区、鉴权方式(必填)

- 自动转发 开启:原始路径的所有API路径将自动转发,可在API列表中禁用特定路径

- 自动转发 关闭:仅转发手动添加且启用状态的API路径

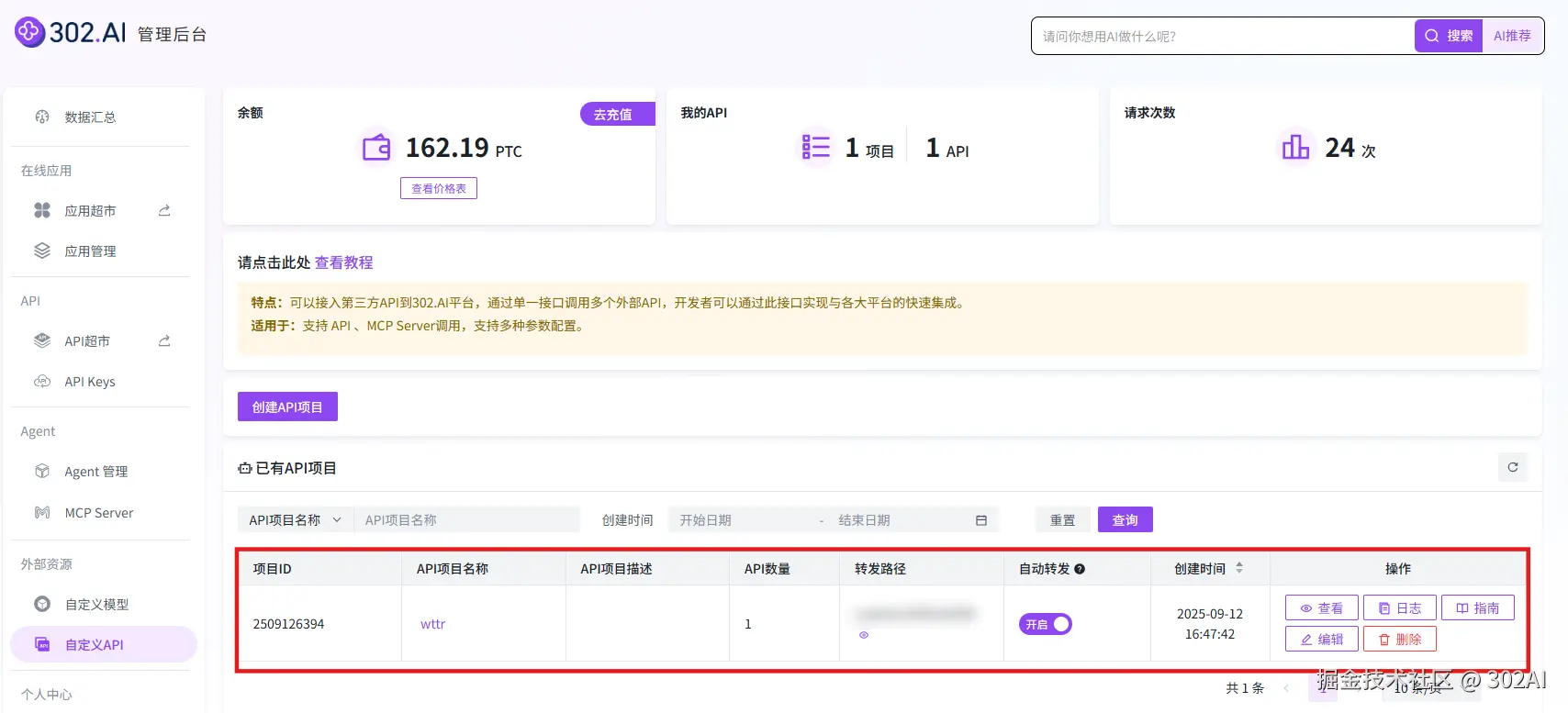

创建API项目成功

2. 添加API

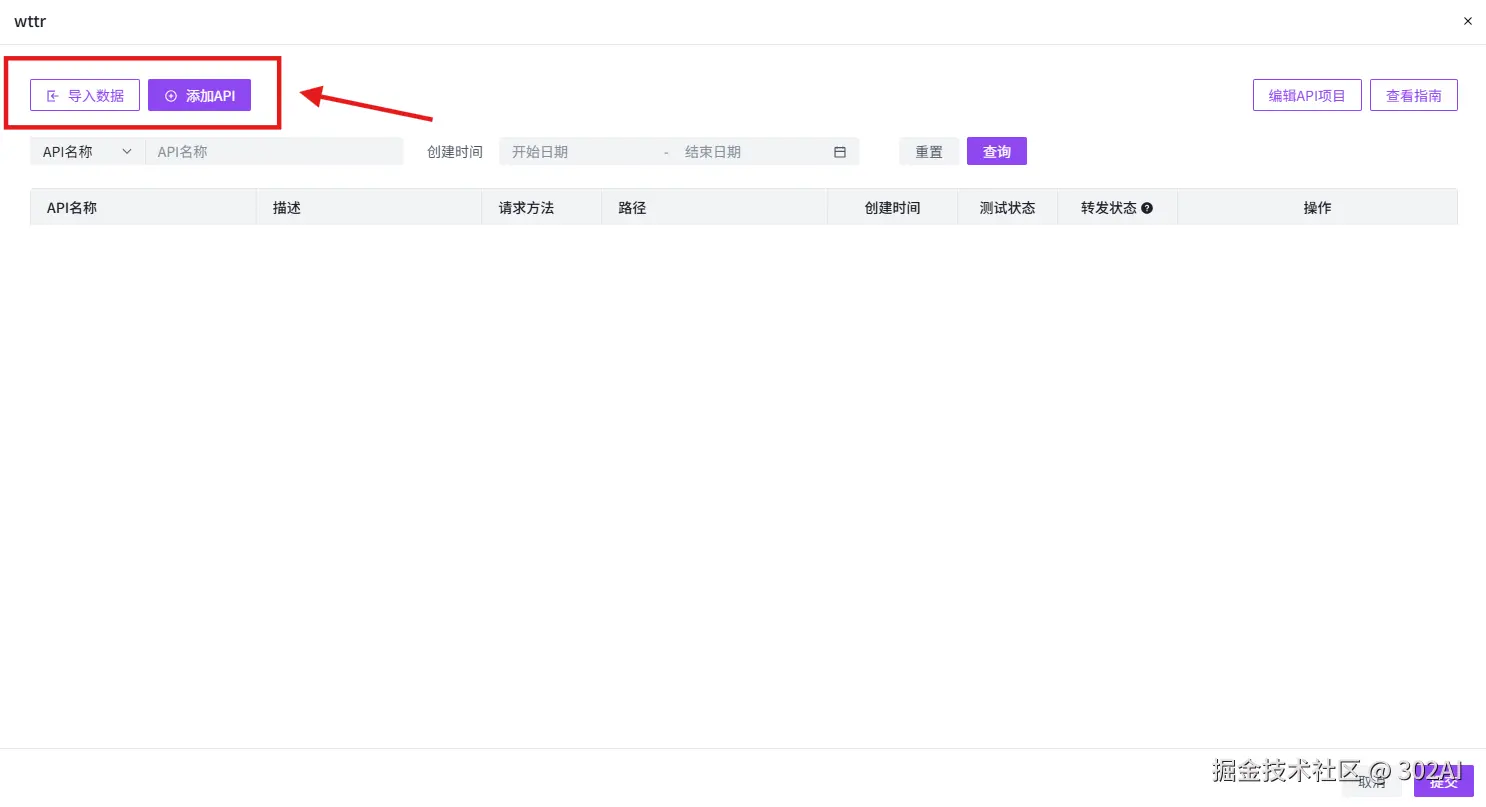

API的添加方式有两种:

(1)导入数据添加:支持导入 OpenAPI 3、Swagger 1、2、3 数据格式的 json 或 yaml 文件

(2)手动添加:

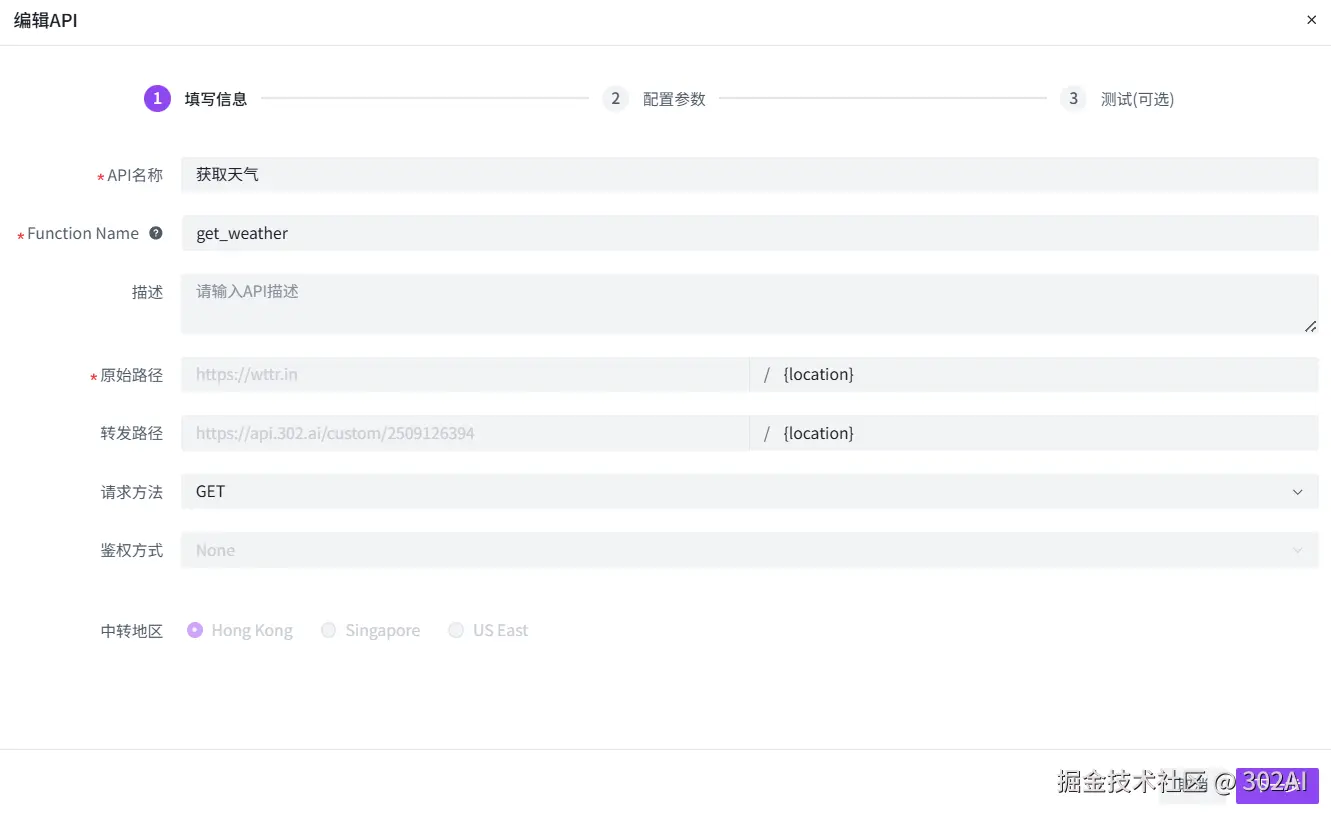

- 点击「添加API」,将API信息填写完整,点击「下一步」

💡Function Name 用于调用 MCP Server,类似 mcptoolname。为提升 LLM 理解效果,建议命名与功能一致,仅支持字母、数字和下划线 _

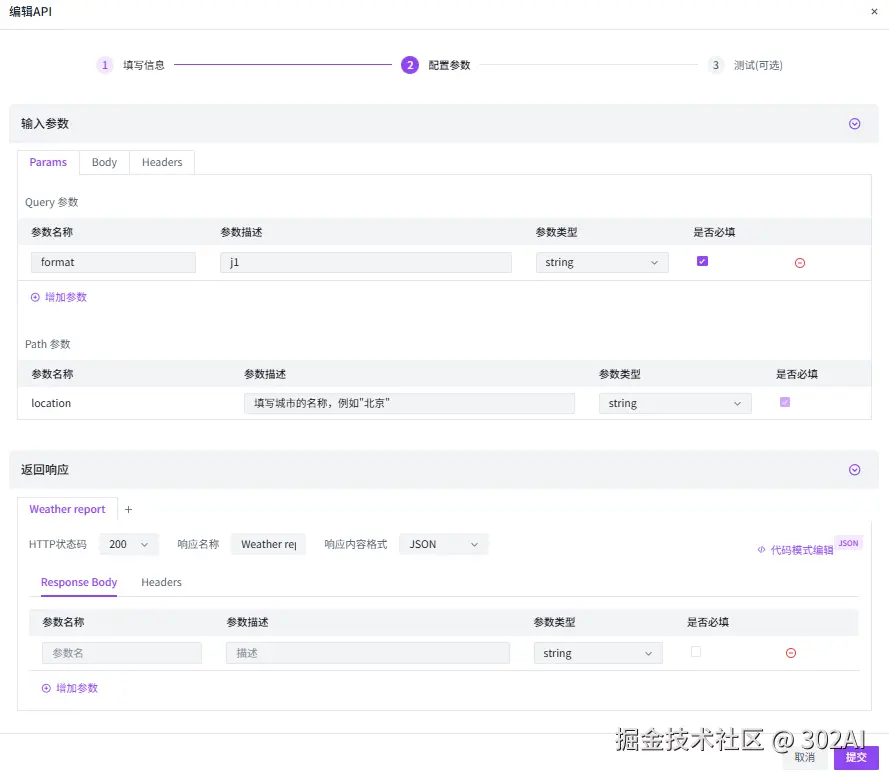

- 填写完整API配置参数,点击「提交」

💡Body 支持切换 JSON 编辑

- 填写参数值进行测试(此步骤为可选项,测试可执行也可跳过)

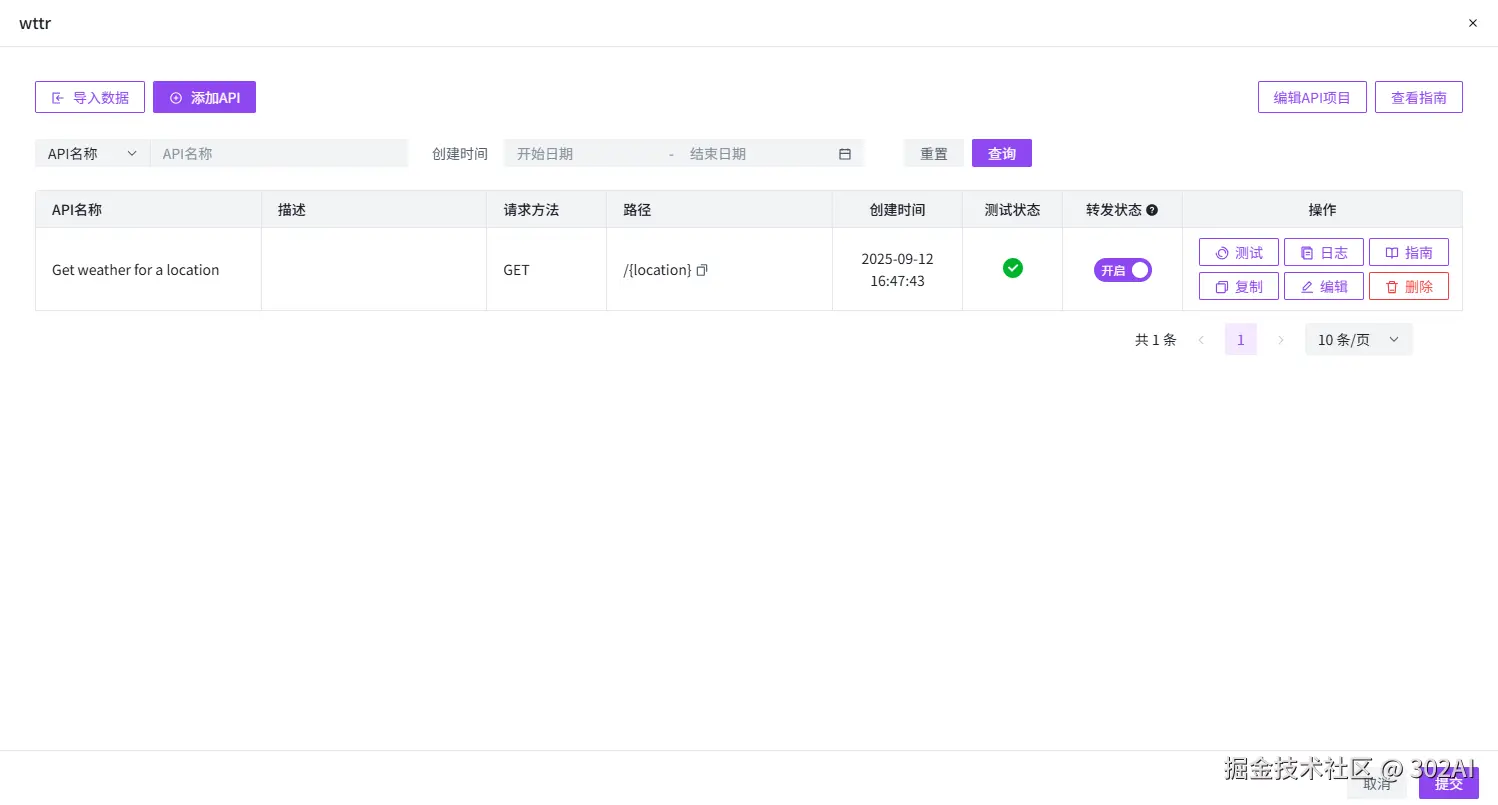

- API添加成功

Ⅱ. 配置API到MCP Server

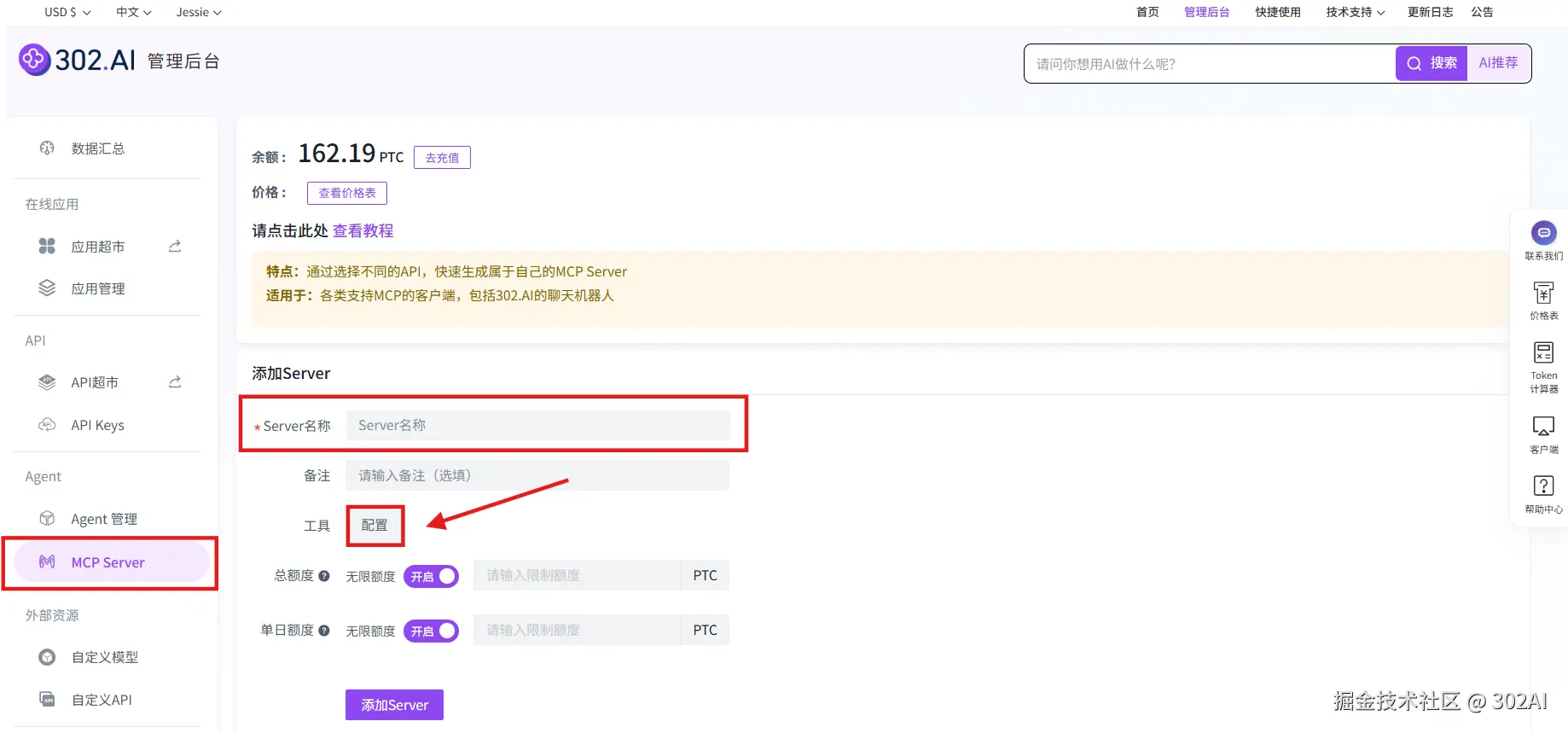

在管理后台界面找到Agent→MCP Server,输入自定义Server名称,点击「配置」

可选择302内置的API工具,也可选择上一步中自定义的API工具

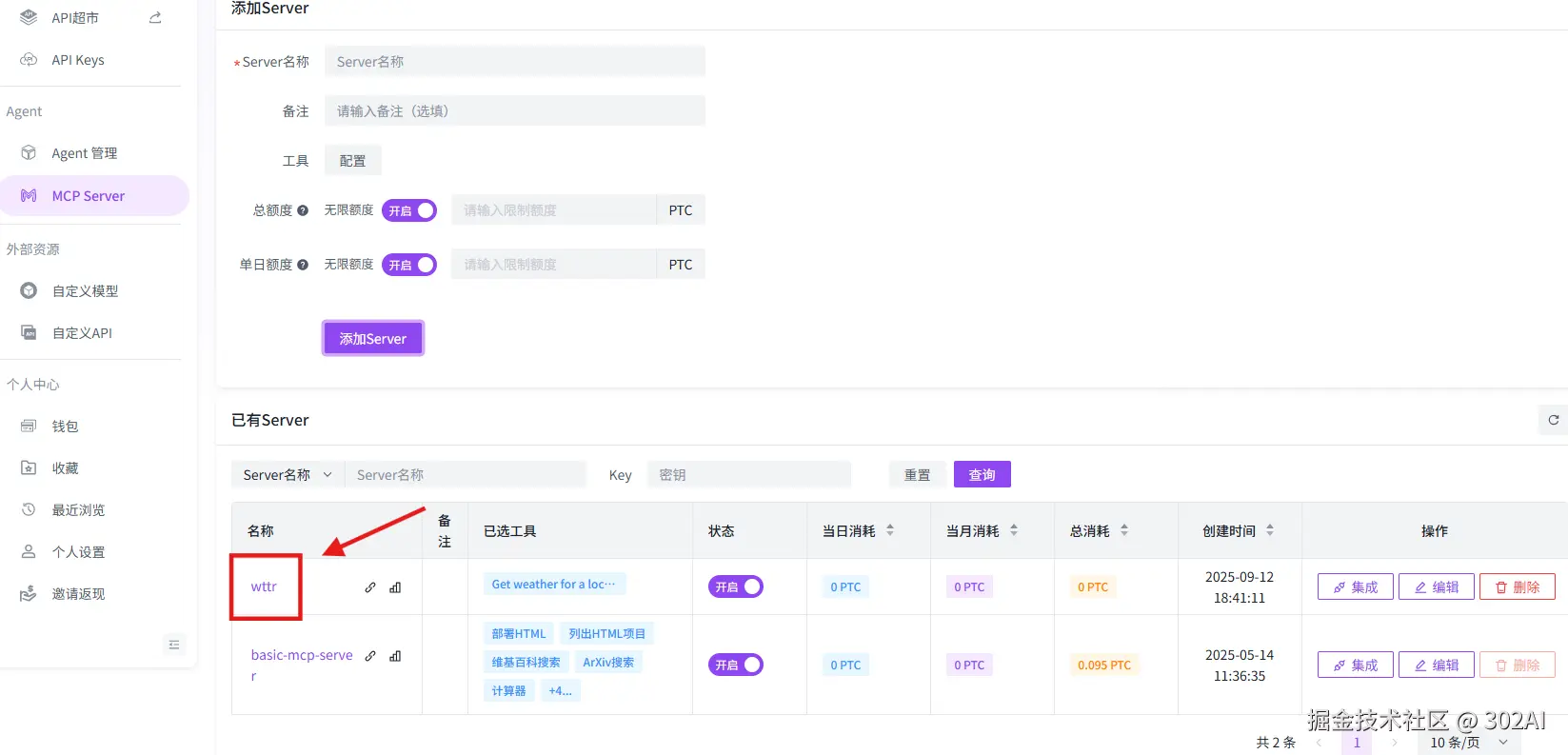

添加成功的Server显示在下方,可点击Server名称以查看Server配置

💡不同的Server根据不同的KEY来获取工具配置,客户端只需安装一次,无需重复安装,切换不同的Server只需要更改不同的API_KEY即可。

Ⅲ. 在聊天机器人中使用MCP Server

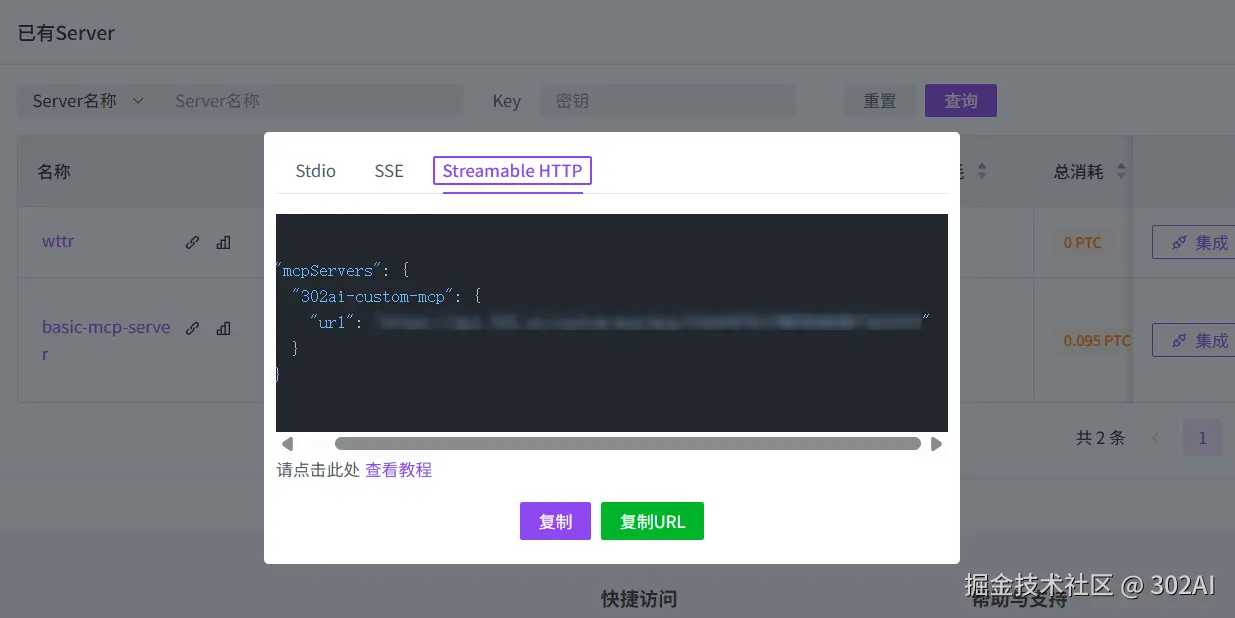

在聊天机器人中打开MCP Server服务器设置

点击「添加服务器」,输入服务器名称和上一步创建的URL,打开Server开关即可使用。

IV. 总结

目前的 MCP 生态已经趋于成熟,在 Chat 中支持 MCP,可以使其从一个简单的"对话工具"进化成一个高效的"生产力平台",这也意味着 AI 的交互从单纯的"问答"阶段,转变为了"操作"和"执行"阶段。Chat 不再是我们获取信息的终点,而是我们通过 AI 驱动万物、完成工作的起点。

302.AI 支持将任意 API 配置成一个 MCP Server,本质上是帮你完成了将 API 适配到 MCP 协议的所有工作,让它能被任何兼容 MCP 的客户端(如 ChatGPT)直接识别和调用。剩下的,就是你和 AI 之间的事了------你可以用它查日志、调数据、处理工单,或者任何你能通过 API 做到的事情。

如果你已经有一些反复需要手动调用的 API,现在或许可以试试给它套上一个 MCP 的壳。你会发现,让 AI 直接去操作底层工具,比和它描述如何操作要直接得多。我们相信,最好的工具不应该规定你的工作流,而是提供足够灵活的底层协议,让你能自由地组装和搭建。

工具已经就绪,试试看,它能如何简化你的下一个任务。