摘要: 本文旨在为人工智能生成内容(AIGC)领域的爱好者和开发者提供一份详尽的Fooocus部署指南。Fooocus作为一款基于Gradio的开源图像生成软件,凭借其简化的操作和高质量的输出,受到了广泛关注。我们将通过两种截然不同的部署路径------传统的本地手动环境配置与现代化的云平台一键部署------来全面探索Fooocus的落地过程。本文将深入剖析手动部署中的每一个步骤、每一条命令及其背后的技术逻辑,详细记录可能遇到的环境冲突与解决方案,并将其与云端部署的流畅体验进行客观对比,为读者在不同场景下选择最合适的部署策略提供坚实的技术参考。

第一章:引言------Fooocus与AIGC部署的挑战

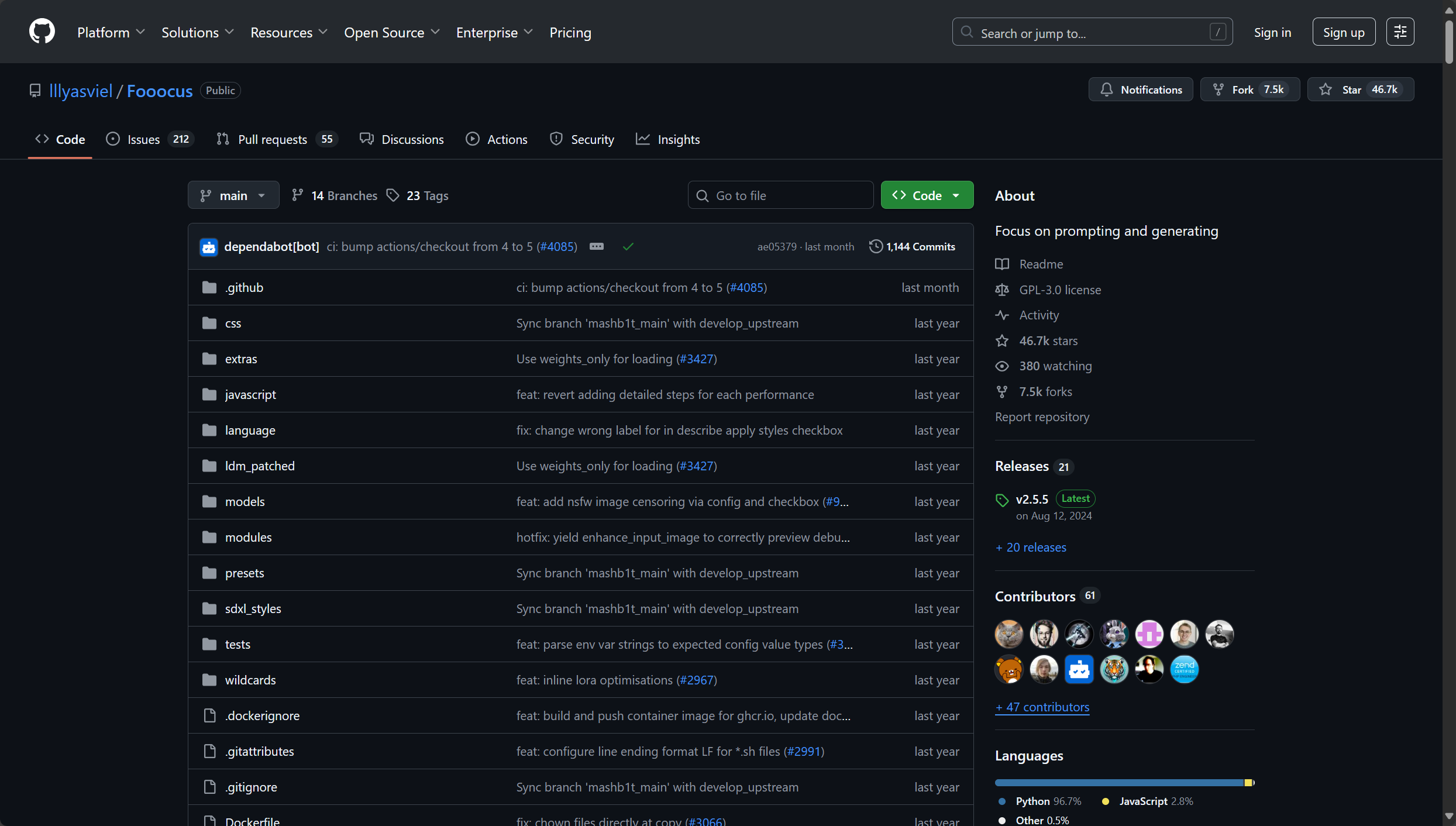

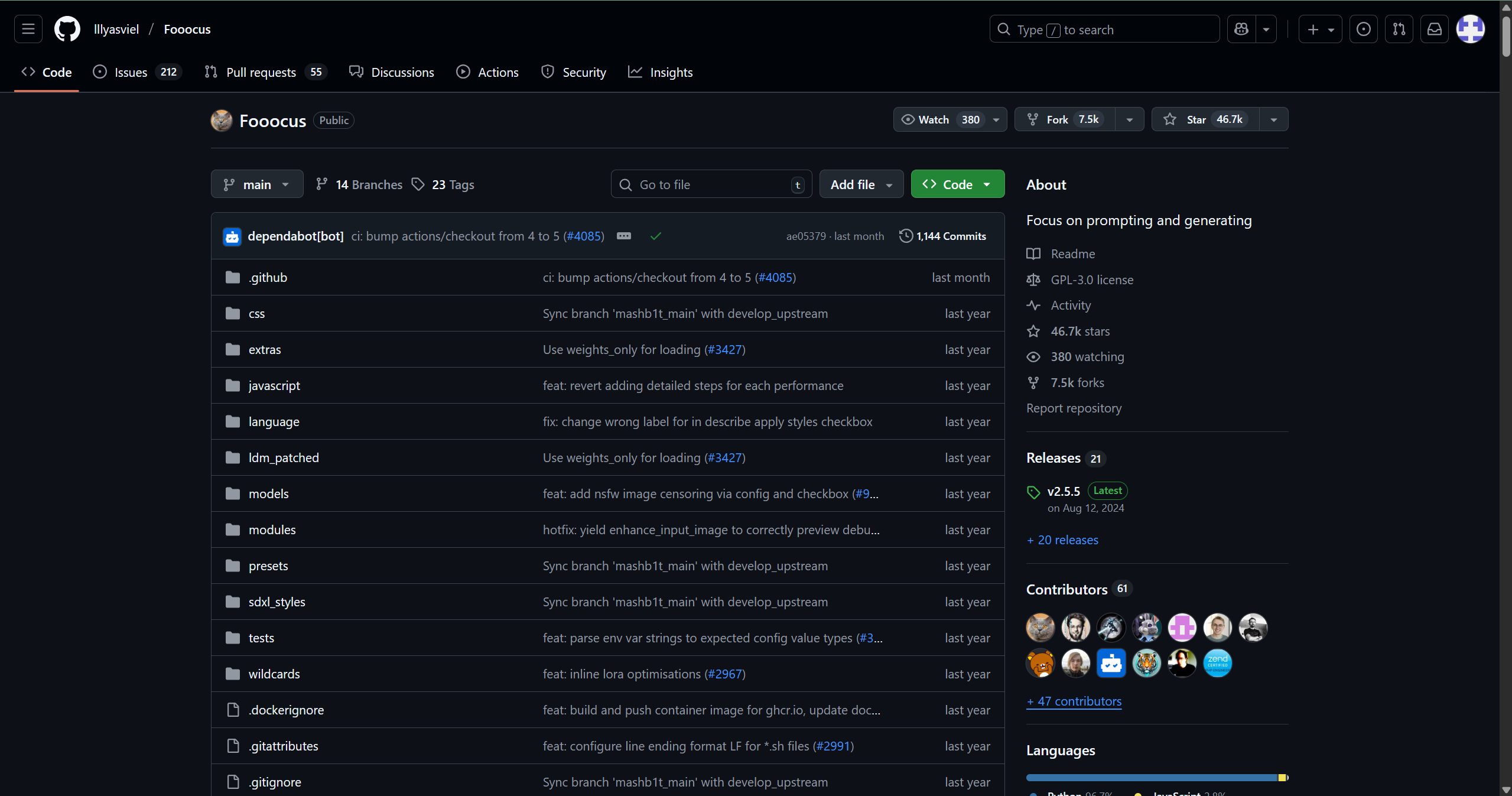

随着Stable Diffusion等底层模型的开源,AIGC技术,特别是文生图领域,迎来了爆发式的增长。各种应用和WebUI层出不穷,极大地降低了普通用户接触和使用前沿AI模型的门槛。在众多工具中,由lllyasviel(ControlNet的作者)开发的Fooocus,以其独特的哲学脱颖而出。Fooocus的设计理念是"化繁为简",它在保留Stable Diffusion XL(SDXL)强大能力的同时,将复杂的参数设置和工作流内部化,用户只需聚焦于创意和提示词(Prompt),即可获得媲美专业级软件(如Midjourney)的图像质量。

然而,对于许多满怀热情的用户而言,将这样一个强大的工具成功运行在自己的设备上,是开启创意之旅的第一个,也往往是最具挑战性的关卡。AI应用的部署,尤其是深度学习模型的部署,通常涉及复杂的软硬件环境配置。这包括操作系统依赖、GPU驱动、特定的Python版本、繁多的第三方库以及它们之间错综复杂的版本兼容性问题。任何一个环节的疏忽,都可能导致安装失败或运行时错误,这个过程对于非专业开发者来说,无疑是一道高墙。

本文的目的,正是要拆解这道高墙。我们将以Fooocus的部署为例,完整呈现两种截然不同的解决路径。

路径一:本地化手动部署。 这是一条"亲力亲为"的道路。我们将从一个纯净的Linux服务器环境开始,一步步安装环境管理器Conda,搭建独立的Python虚拟环境,克隆项目源码,处理系统级依赖,安装Python库,解决版本冲突,下载模型权重,并最终启动服务。这条路径充满了学习机会,它能让你深刻理解Fooocus运行所需的技术栈和环境细节,是提升个人技术能力的绝佳实践。但同时,它也布满了"陷阱",需要投入大量的时间和精力进行调试。

路径二:云平台集成化部署。 这是一条"站在巨人肩膀上"的道路。我们将利用如"蓝耘"等提供AI应用镜像的云计算平台,跳过所有繁琐的环境配置步骤,实现"一键式"部署。平台预先构建了包含操作系统、驱动、Conda环境、Python库乃至Fooocus项目本身的完整镜像,用户只需选择合适的GPU资源,即可在数分钟内启动一个功能完备、优化良好的Fooocus实例。这条路径的优势在于其极致的效率和易用性,让用户可以将全部精力投入到AI应用本身的使用和创作中。

通过对这两条路径的详细记录和对比分析,我们不仅希望能为Fooocus的部署提供一份可操作的说明书,更希望能够引发读者对于AI时代开发与部署模式的思考。当技术工具本身趋于复杂化时,我们是应该深入每一个细节,还是应该利用更高效的平台服务,将专业问题交由专业平台解决?这两种选择没有绝对的优劣,而是适应于不同需求、不同场景的策略。现在,让我们从最基础的环境检查开始,踏上这次部署之旅。

第二章:崎岖而富有洞察的道路------Fooocus本地化手动部署详解

选择手动部署,意味着我们选择了一条能够深入了解软件运行机理的路径。这个过程虽然复杂,但每解决一个问题,都会加深我们对系统环境和软件依赖的理解。本章将严格按照部署步骤,对每一个操作进行细致入微的讲解。

2.1 基石:Conda环境管理器的安装与配置

在部署任何复杂的Python项目之前,首要任务是建立一个隔离、纯净的运行环境。直接使用系统自带的Python解释器是一种极不推荐的做法,因为它可能导致不同项目间的库版本冲突,即所谓的"依赖地狱"。Conda是一个开源的包管理系统和环境管理系统,它允许我们轻松创建、保存、加载和切换环境。Miniconda是Conda的轻量级安装程序,包含了conda、Python以及它们依赖的少量必要包。

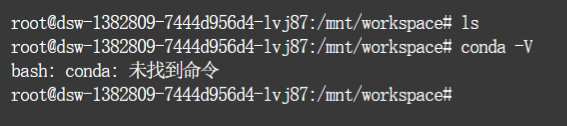

步骤一:检查系统环境

在动手安装之前,我们首先需要确认系统中是否已存在Conda环境。通过执行以下命令来检查:

bash

conda -V

如果终端返回了Conda的版本号(例如 conda 23.7.4),说明Conda已经安装,可以跳过后续的安装步骤。如果系统提示 conda: command not found 或类似的错误,则表明我们需要从头开始安装Miniconda。

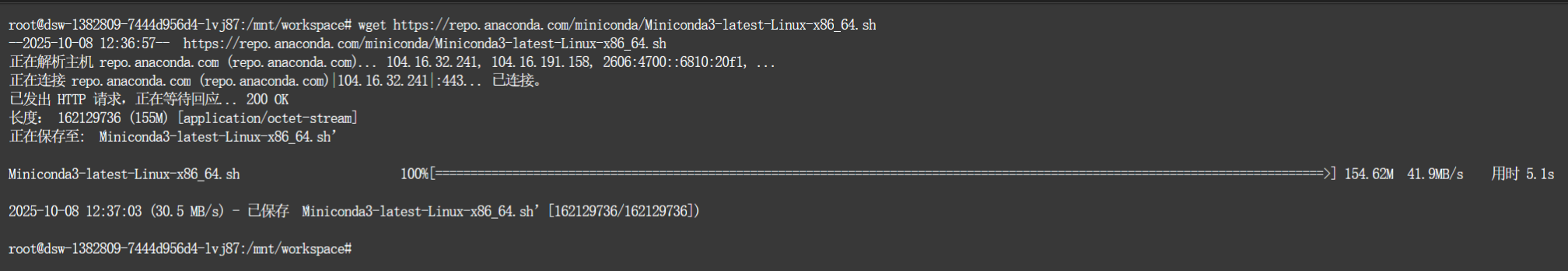

步骤二:下载Miniconda安装脚本

我们需要从官方渠道获取Miniconda的安装脚本。官方文档页面(https://docs.conda.io/en/latest/miniconda.html)列出了适用于Windows, macOS和Linux不同架构的安装包。在Linux服务器环境中,使用wget命令是一个高效的下载方式。以64位Linux系统为例,执行以下命令:

bash

wget https://repo.anaconda.com/miniconda/Miniconda3-latest-Linux-x86_64.sh

这条命令会从Anaconda的官方仓库下载最新的Miniconda3安装脚本。下载完成后,当前目录下会多出一个名为 Miniconda3-latest-Linux-x86_64.sh 的文件。

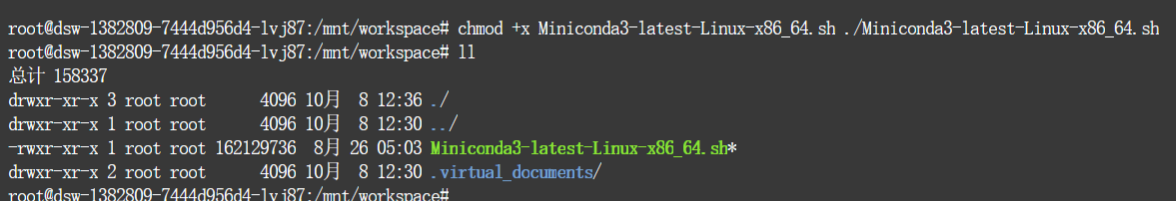

步骤三:执行安装脚本

下载的.sh文件是一个shell脚本,需要赋予其可执行权限才能运行。

bash

chmod +x Miniconda3-latest-Linux-x86_64.shchmod +x 命令为文件添加了执行权限。随后,运行该脚本以启动安装程序:

bash

./Miniconda3-latest-Linux-x86_64.sh

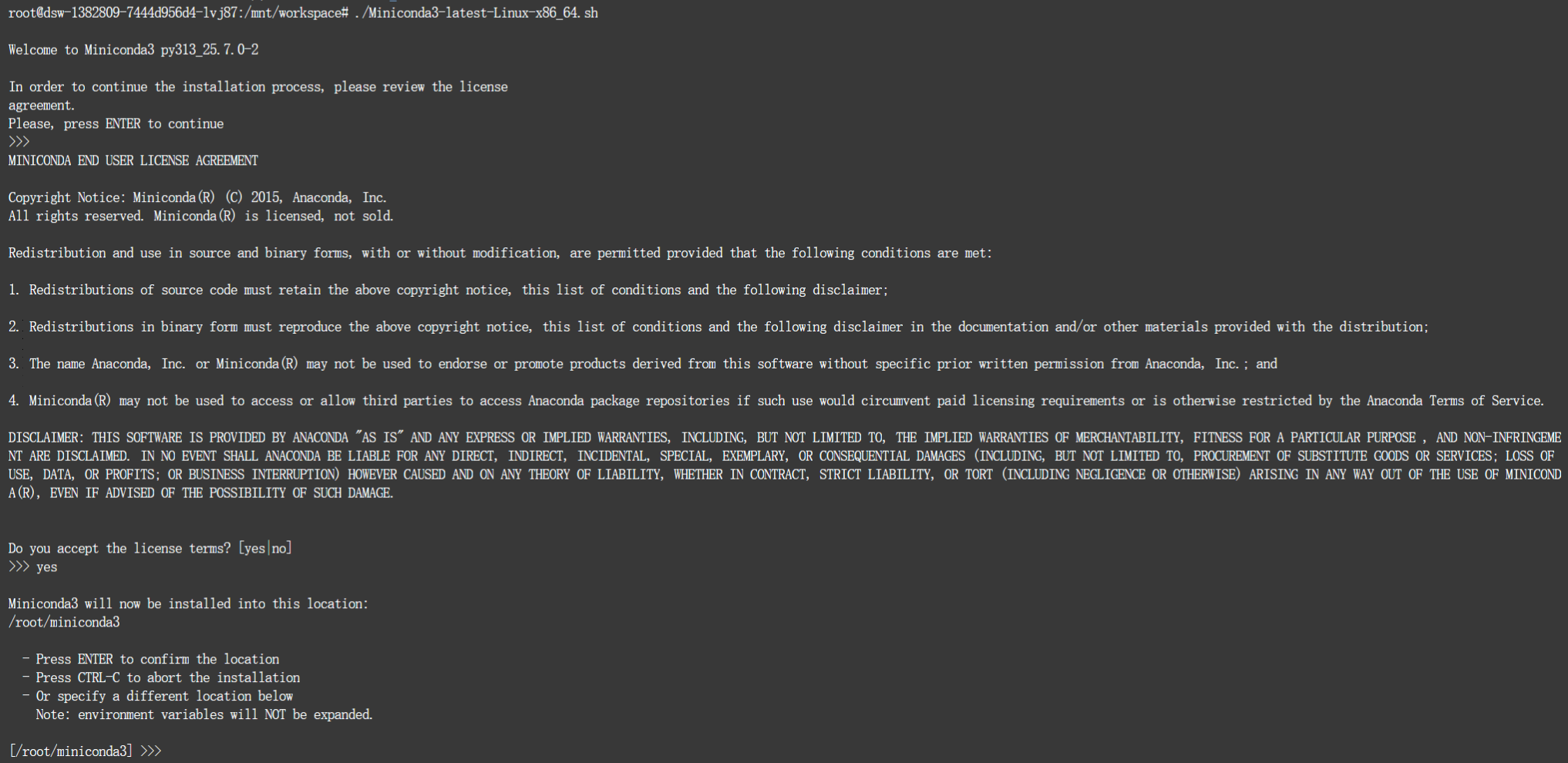

安装程序启动后,会进入一个交互式的安装流程:

-

许可协议 :程序会首先展示许可协议。你需要按

Enter键来逐页阅读。在阅读完毕后,程序会询问你是否接受协议条款,此时需要输入yes并按回车。 -

安装路径 :接下来,安装程序会询问安装位置。默认路径通常是当前用户主目录下的

~/miniconda3。对于大多数情况,这个默认设置是合适的。直接按Enter键确认即可。当然,你也可以根据需求输入一个自定义的绝对路径。

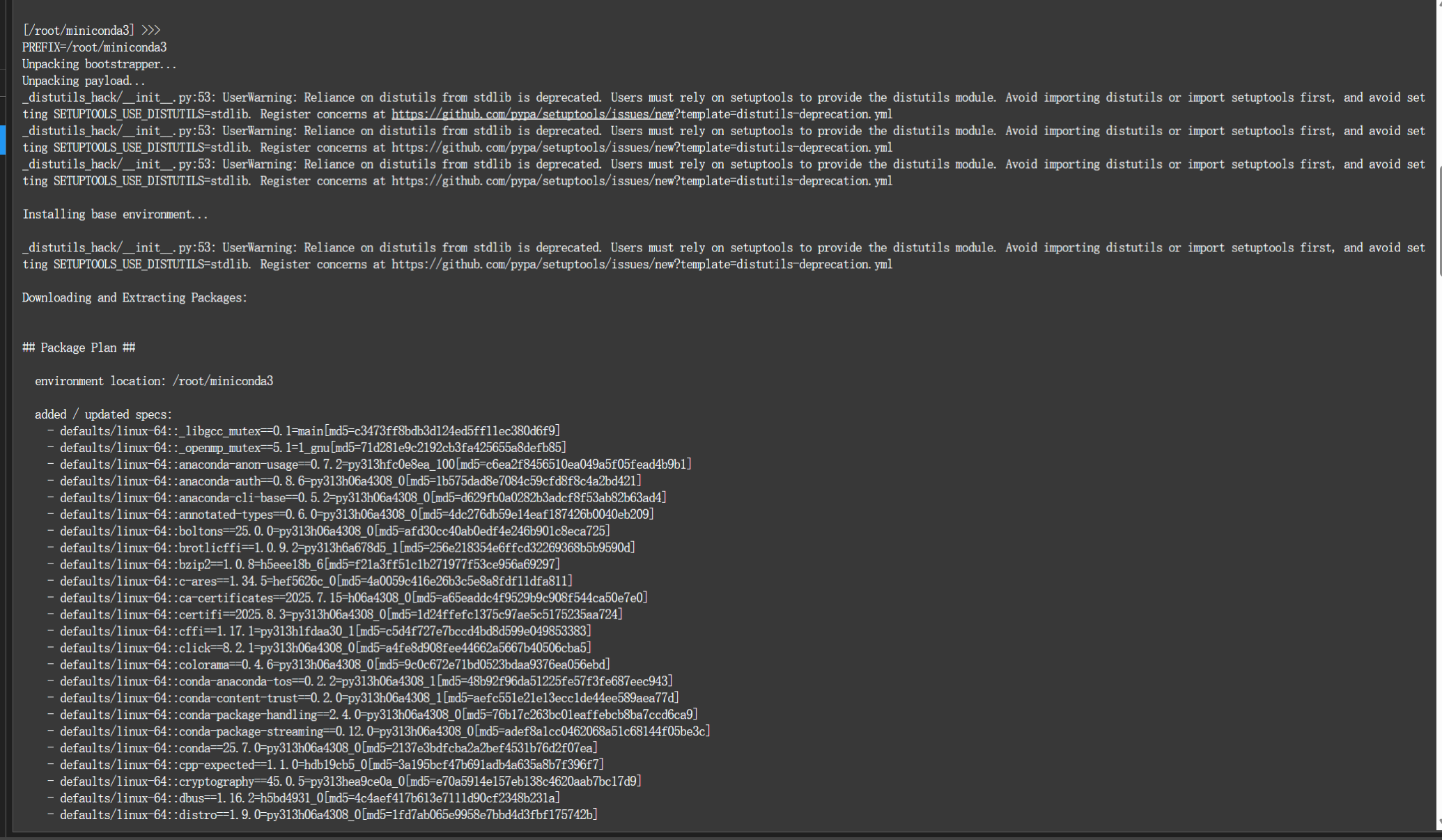

从截图中可以看到,安装路径被确认为了

/root/miniconda3。之后,安装程序会开始解压并将Conda环境的相关文件部署到指定位置。

-

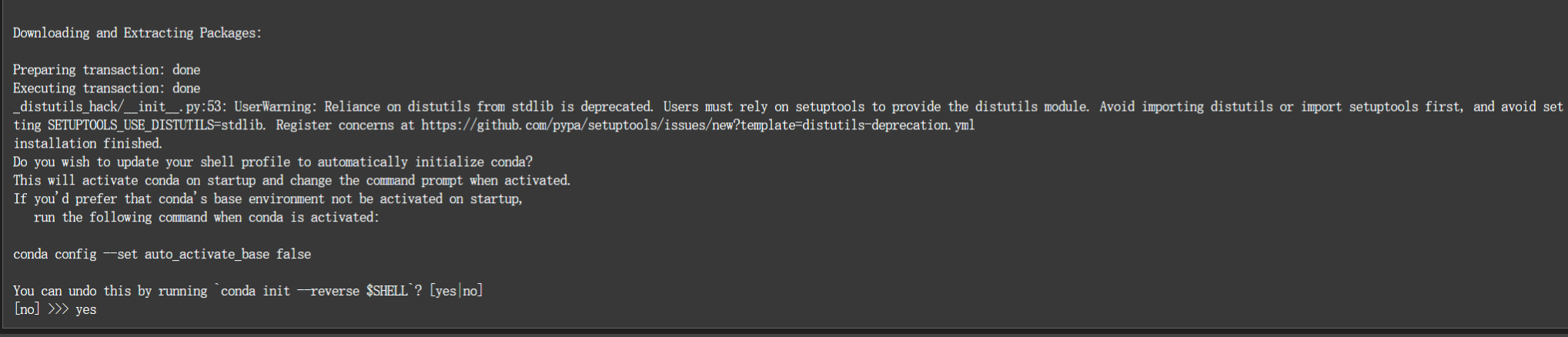

初始化Conda :在安装的最后阶段,程序会询问是否要运行

conda init。

这是一个至关重要的步骤。强烈建议选择

yes。conda init的作用是修改你当前shell的配置文件(如~/.bashrc或~/.zshrc)。它会添加一小段脚本,确保每次启动新的终端会话时,Conda的命令都能被系统正确识别和执行。如果不执行这一步,你每次都需要手动去激活Conda,非常不便。

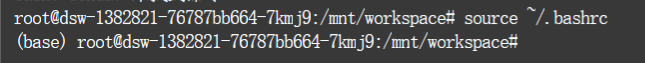

步骤四:使配置生效并验证安装

conda init 修改了配置文件,但这些修改只对新打开的终端会话生效。为了在当前会话中立即使用Conda,你有两个选择:

- 关闭当前终端,然后重新打开一个新的。

- 手动加载配置文件,使其立即生效。使用

source命令即可:

bash

source ~/.bashrc

加载配置后,你会发现终端提示符的前面出现了一个 (base) 的字样。这表示你当前正处于Conda的 "base" 环境中,这是Conda安装时自带的一个默认环境。

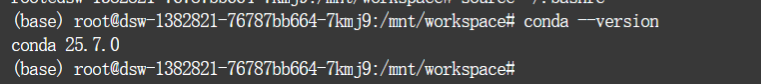

此时,再次运行版本检查命令:

bash

conda --version

如果成功显示版本号,恭喜你,Conda环境管理的基础已经搭建完毕。这是我们后续所有工作的前提。

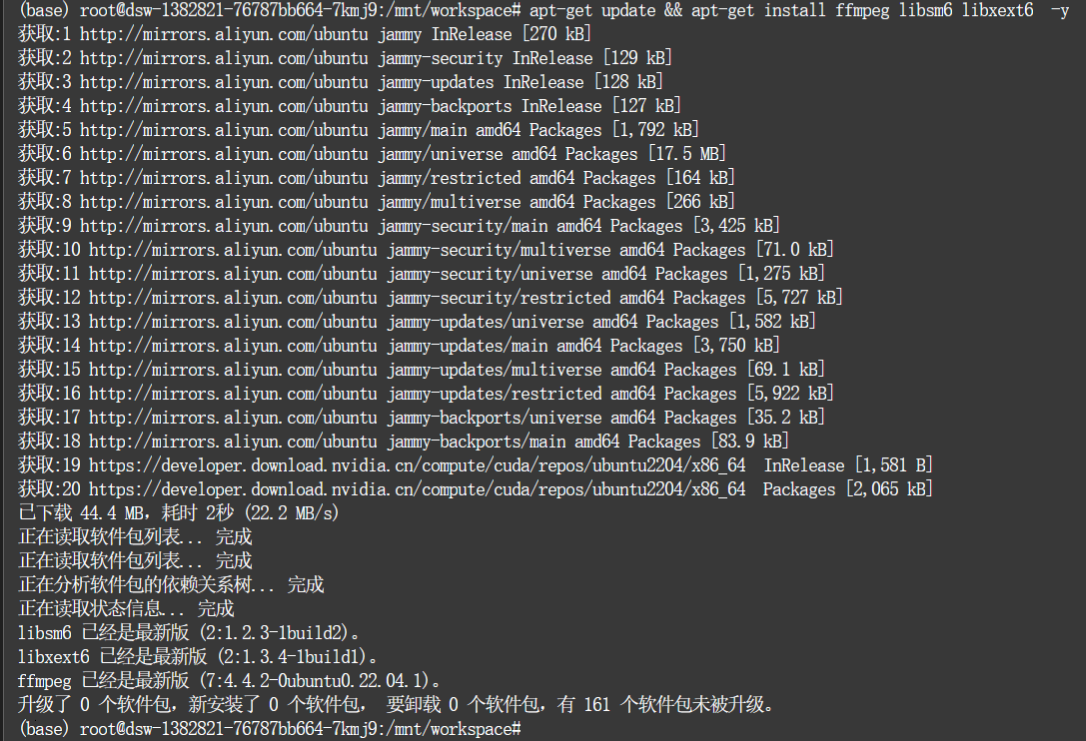

2.2 系统级依赖的准备

Fooocus的运行不仅依赖于Python库,还可能需要一些底层的系统库来处理图像和视频。例如,ffmpeg 是一个强大的多媒体处理工具,而 libsm6 和 libxext6 是一些图形界面库所需要的依赖。使用 apt-get(适用于Debian/Ubuntu系统)可以方便地安装它们。

bash

apt-get update && apt-get install ffmpeg libsm6 libxext6 -y

这个命令包含两个部分:

apt-get update: 更新本地的软件包列表,确保能获取到最新的软件版本信息。apt-get install ffmpeg libsm6 libxext6 -y: 安装指定的三个软件包。-y标志表示自动对安装过程中的所有提示回答"是",适用于自动化脚本。

2.3 获取Fooocus项目源码

环境基础打好后,下一步就是获取Fooocus的源代码。源代码托管在GitHub上,我们可以使用 git 命令来克隆整个仓库。

bash

git clone https://gitclone.com/github.com/lllyasviel/Fooocus.git

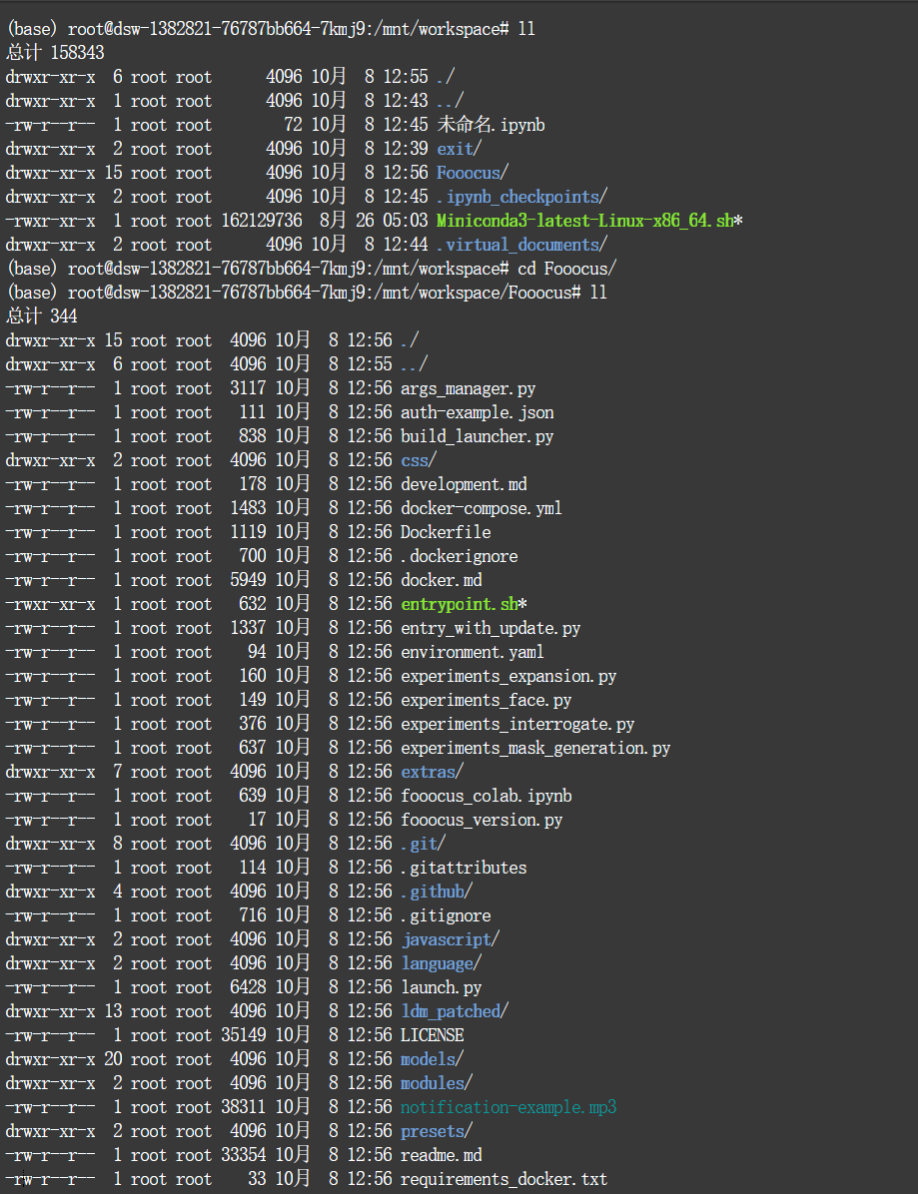

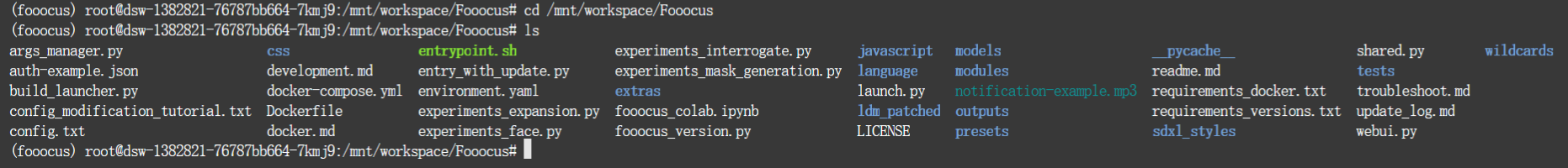

这里的 gitclone.com 是GitHub的一个镜像,有时可以提供更快的下载速度。命令执行后,会将Fooocus项目的完整代码下载到当前目录下的一个名为 Fooocus 的文件夹中。

下载完成后,我们需要进入到这个项目目录中,后续的操作都将在此目录下进行。

bash

cd Fooocus/

2.4 创建并配置Fooocus专属Python环境

现在,我们进入了整个手动部署过程中最核心也最容易出错的环节:创建和配置Python虚拟环境。

方法一:使用项目自带的environment.yaml文件(初次尝试)

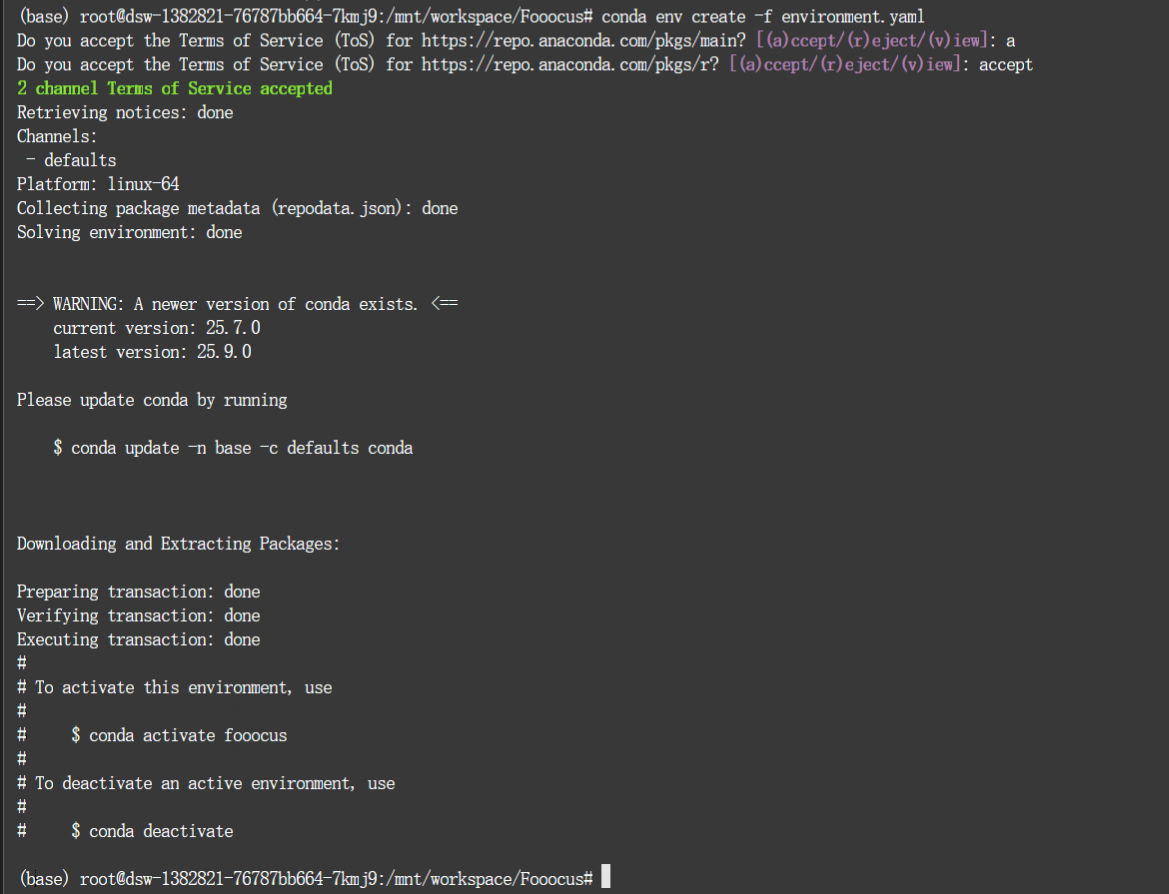

Fooocus项目非常贴心地提供了一个 environment.yaml 文件。这是一个Conda环境的声明式配置文件,它定义了该环境需要的所有依赖项,包括Python的版本和需要安装的库。我们可以使用一条命令来根据此文件自动创建环境。

bash

conda env create -f environment.yamlConda会解析这个文件,并自动下载和安装所有指定的包。这个过程可能会持续一段时间。在安装过程中,可能会遇到服务条款的接受提示,根据截图显示,需要输入 accept 来继续。

环境创建成功后,Conda会提示如何激活它。根据environment.yaml的定义,这个环境的名字是 fooocus。我们使用以下命令来激活:

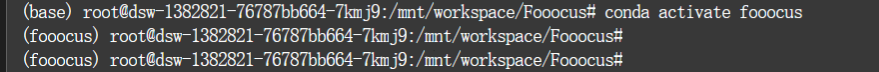

bash

conda activate fooocus

激活后,终端提示符会从 (base) 变为 (fooocus),表明我们已经成功进入了为Fooocus量身定制的隔离环境中。

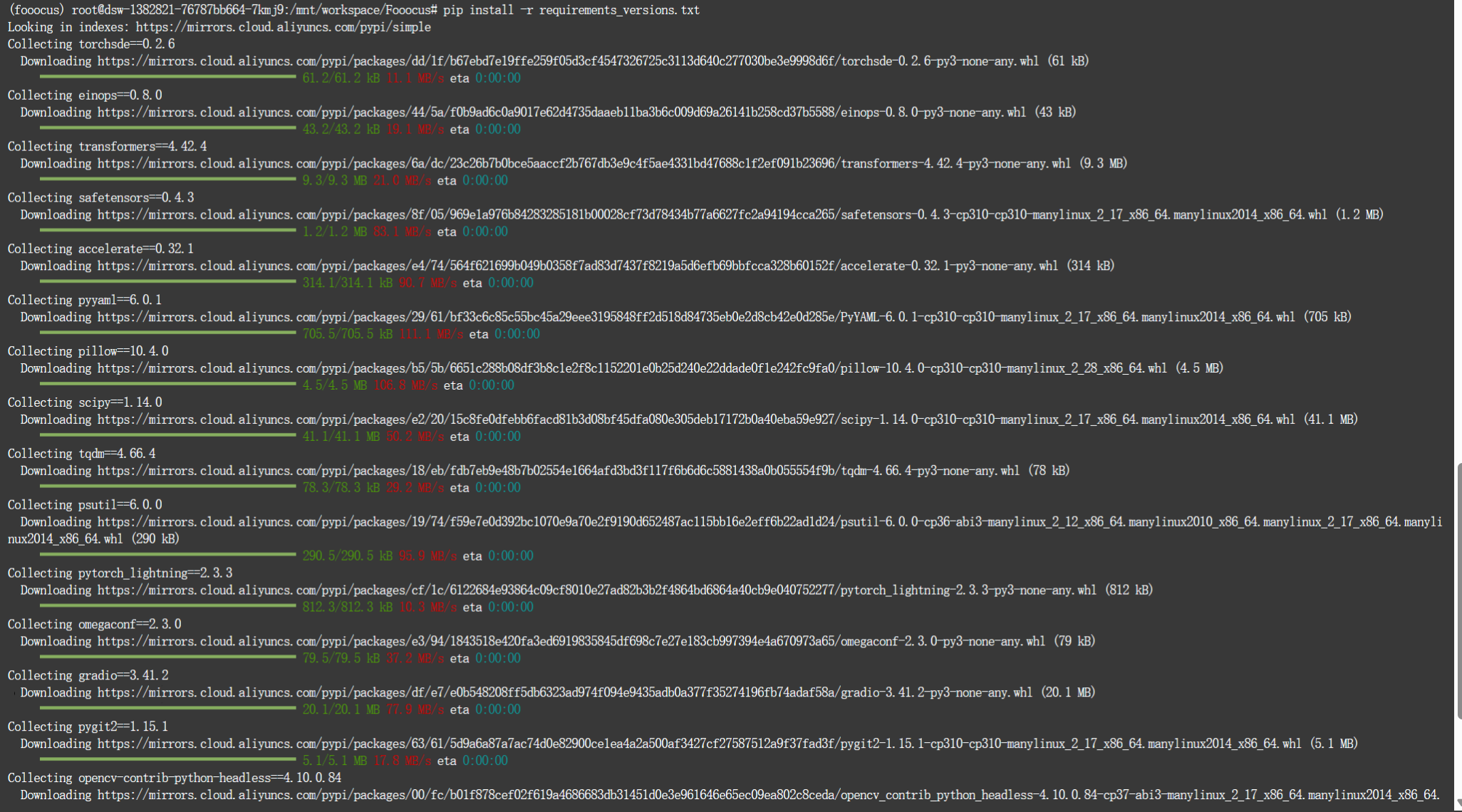

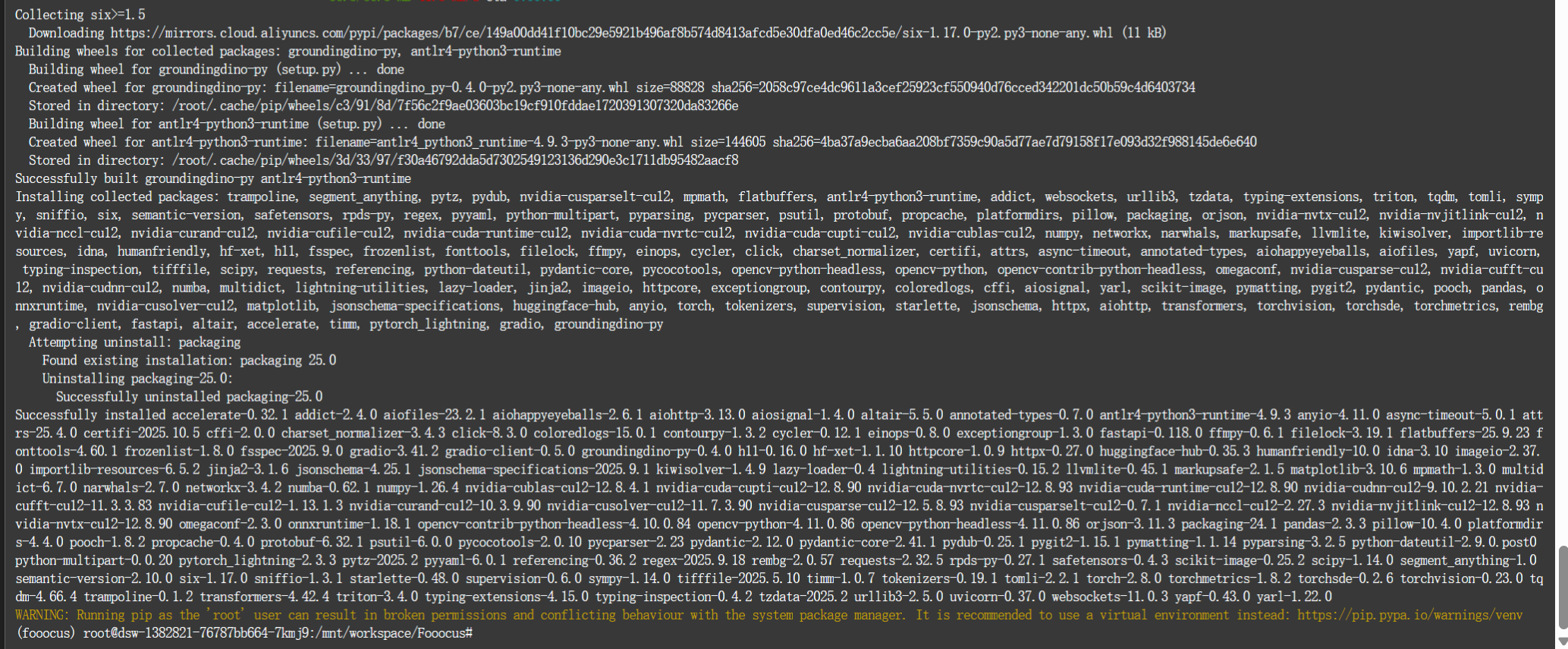

接下来,项目还提供了一个 requirements_versions.txt 文件,它使用 pip 来安装一些Conda源中可能没有的,或者需要指定精确版本的包。

bash

pip install -r requirements_versions.txt

pip 会读取文件中的每一行,并安装相应的Python库。当所有库都安装完成,并看到 Successfully installed ... 的提示时,理论上,环境配置就完成了。

步骤五:启动程序与模型下载

万事俱备,我们尝试启动Fooocus的主程序。

bash

python entry_with_update.py```

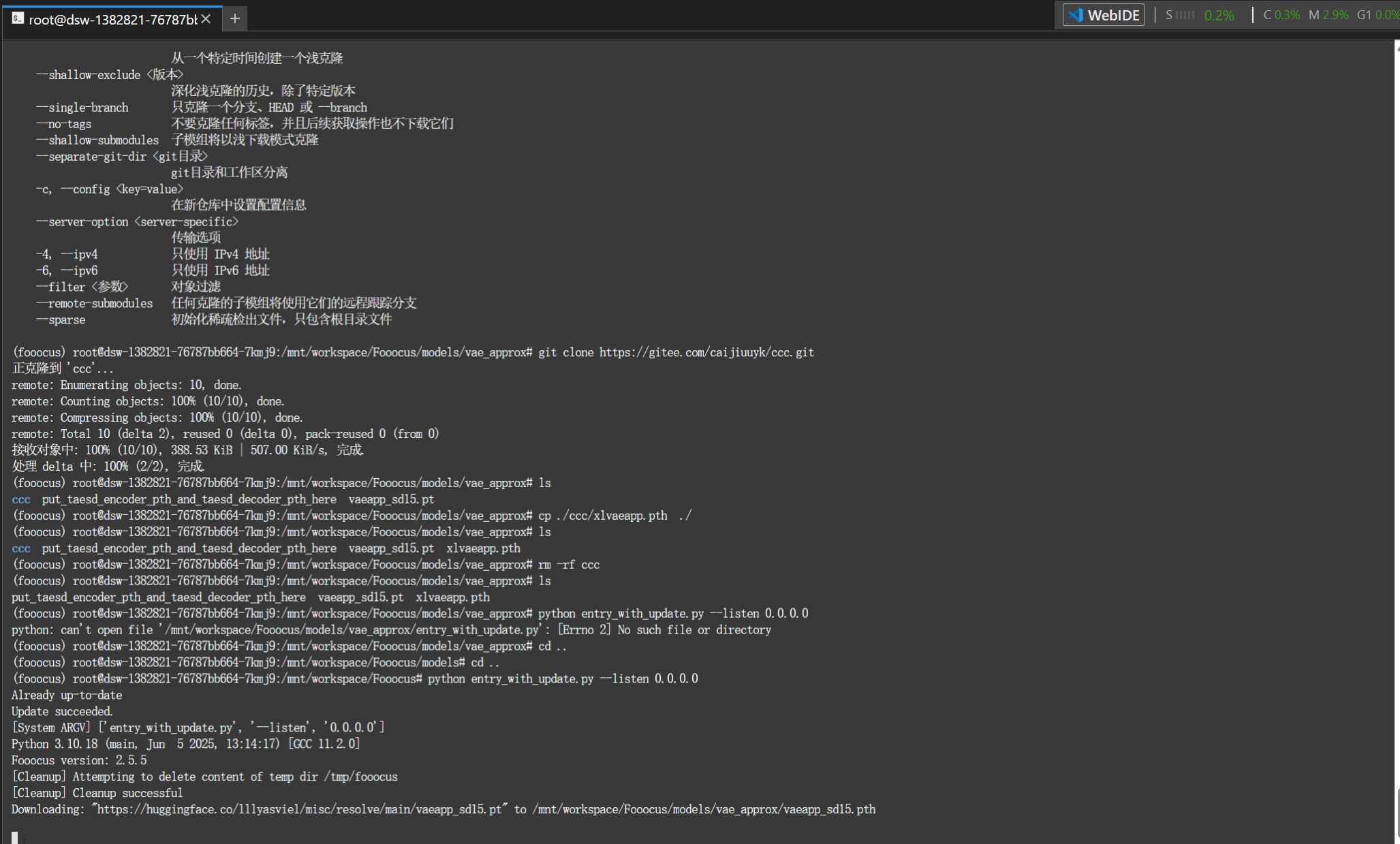

首次运行时,Fooocus会自动检查并下载所需的模型权重文件。这些文件是AI模型的核心,体积通常很大(数GB)。下载过程受网络影响很大,可能会非常缓慢甚至失败。如果遇到这种情况,一种常见的解决方法是:先运行一次命令,让程序创建出目标文件夹,然后手动从其他渠道(如Hugging Face官网、镜像站)下载所需的 `.pth` 或 `.safetensors` 文件,再将其上传到程序指定的目录中。

例如,文档中提到了需要 `xlvaeapp.pth` 文件,并将其放置在 `/mnt/workspace/Fooocus/models/vae_approx/` 目录下。

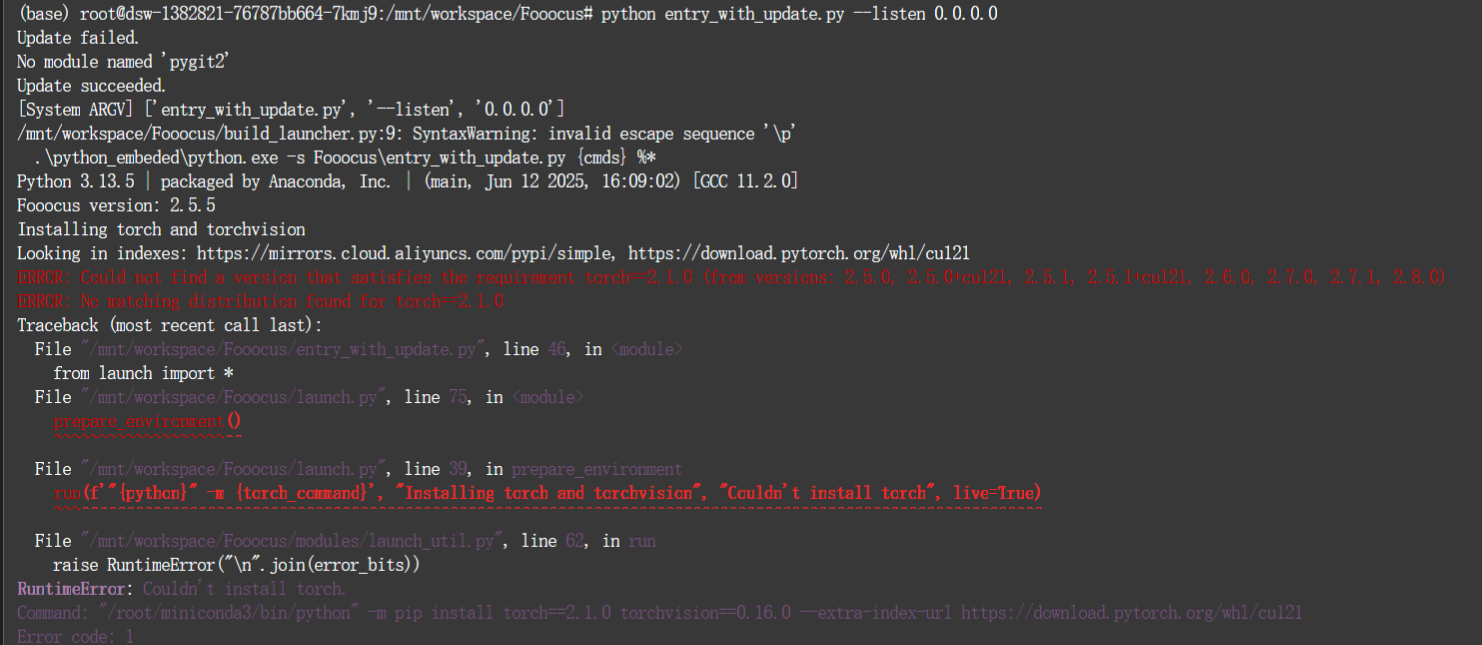

**步骤六:遭遇重大挫折------Python版本不兼容**

当所有模型文件都准备就绪后,我们再次尝试启动,并添加 `--listen 0.0.0.0` 参数,使得服务可以在网络上被访问,而不仅仅是本机 `127.0.0.1`。

```bash

python entry_with_update.py --listen 0.0.0.0然而,此时却遇到了一个致命的错误:

错误信息 Could not find a version that satisfies the requirement torch==2.1.0 直指问题核心:pip 找不到一个与当前Python环境兼容的 torch 库版本 2.1.0。

问题分析:

这是手动配置环境中最典型、也最令人沮丧的问题之一。问题的根源在于Python生态系统的版本依赖关系。

- Python版本过新 :从错误日志的上下文分析,当前Conda环境中的Python版本(可能是文档中提到的

3.13.5)过于前沿。 - PyTorch库的兼容性 :

torch(PyTorch) 是一个底层的深度学习框架,它的每一个发布版本都是针对特定范围的Python、CUDA版本编译的。torch 2.1.0在发布时,Python 3.13 甚至还未正式发布,因此官方的PyPI仓库中根本不存在为Python 3.13编译的torch 2.1.0。 environment.yaml的局限性 :尽管environment.yaml文件试图定义一个可复现的环境,但如果它没有严格锁定Python的版本,Conda在创建环境时可能会选择一个它认为"最新"或"最合适"的Python版本,从而导致了这次的冲突。

这个错误宣告了我们第一次基于 environment.yaml 的尝试失败了。但这正是手动部署的"魅力"所在------它强迫我们去理解问题的本质,并寻找解决方案。

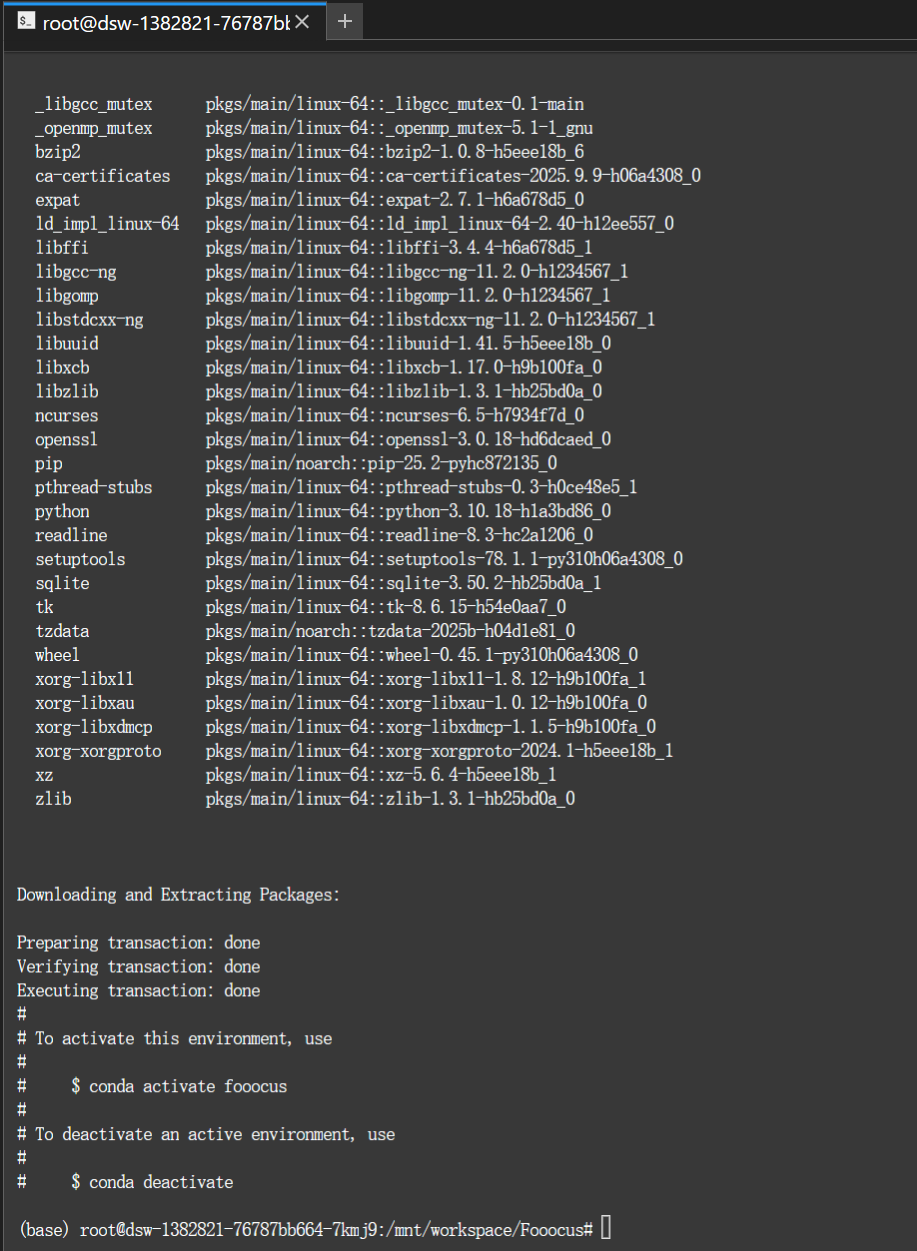

方法二:手动创建指定Python版本的环境(修正路线)

Conda的强大之处在于它能精准控制环境中的每一个组件版本,包括Python本身。既然问题是Python版本太新,那么解决方案就是创建一个使用旧版本Python的新环境。根据社区经验,Python 3.10 或 3.11 是当前许多AI应用的稳定选择。

-

创建新环境 :我们使用

conda create命令,创建一个名为fooocus的新环境(如果已存在同名环境,需要先用conda env remove -n fooocus删除或另取新名),并明确指定python=3.10。-y参数用于跳过确认提示。bashconda create --name fooocus python=3.10 -y

-

激活新环境:创建成功后,激活这个全新的、纯净的环境。

bashconda activate fooocus

注意,此时终端提示符再次变为

(fooocus),但我们身处的是一个Python版本为3.10的环境,而非之前失败的那个。 -

重新安装依赖 :进入Fooocus项目目录,然后再次运行

pip安装命令。bashcd /mnt/workspace/Fooocus pip install -r requirements_versions.txt

因为当前环境是Python 3.10,

pip现在能够顺利地在PyPI仓库中找到与之兼容的torch==2.1.0以及其他所有依赖库,安装过程得以顺利进行。

步骤七:最终的尝试与新的困境

在解决了Python版本这一重大障碍后,我们满怀信心地再次启动Fooocus。

bash

python entry_with_update.py --listen

然而,根据文档的描述,启动"还是失败了"。尽管没有给出具体的错误日志,但我们可以推断,手动部署的复杂性远不止于此。可能的原因包括但不限于:

- CUDA版本不匹配:PyTorch不仅与Python版本绑定,还与NVIDIA的CUDA工具包版本紧密相关。如果服务器的NVIDIA驱动、CUDA版本与PyTorch编译时所用的版本不兼容,会导致运行时错误。

- 缺失其他系统库:除了我们之前安装的几个库,可能还有其他未被文档化的隐式依赖。

- 网络问题:在启动过程中,程序可能还需要下载或更新一些小文件,网络不稳定可能导致启动失败。

- 权限问题:程序可能需要读写某些目录,如果文件系统权限设置不当,也会引发错误。

文档在此处以一句"就很烦,配置信息十分的复杂"结束了手动部署的尝试。这句感慨真实地反映了许多开发者和AI爱好者在实践中遇到的困境。手动部署过程就像是在走迷宫,每一步都需要专业知识和大量的耐心,一次成功的部署背后,可能隐藏着数十次的失败尝试和Google搜索。

至此,我们完整地体验了手动部署Fooocus的全过程。这个过程虽然最终未能一帆风顺地达成目标,但它极具价值。我们深入了解了Conda的使用、Python环境管理的重要性、版本兼容性的微妙与严苛,以及AI应用部署的普遍难点。这些知识和经验本身,就是一笔宝贵的财富。

第三章:效率的范式转移------通过蓝耘云平台部署Fooocus

在经历了手动部署的种种挑战之后,我们转换视角,探索一种截然不同的部署模式。云计算,特别是提供了特定应用优化服务的平台,旨在将用户从复杂的底层环境配置中解放出来。蓝耘应用云广场便是此类服务的代表,它将Fooocus这样的热门AI应用打包成一个标准化的"商品",用户只需"购买"(即使是按量计费的免费开通)即可使用。

3.1 发现与选择

打开蓝耘平台

在蓝耘的控制台中,提供了一个"应用云广场",用户可以在其中找到许多预配置好的应用。

在这里,Fooocus赫然在列。这表明平台方已经完成了我们上一章所经历的全部工作,并将其固化成一个可供所有用户随时调用的模板。这个模板被称为"镜像",它是一个包含了操作系统、所有必要的软件、库、依赖项,乃至应用代码和预置模型的完整环境快照。

3.2 一键部署流程

部署过程被简化为几个直观的点击操作:

-

点击部署:在Fooocus应用卡片上,用户只需点击"部署"按钮,即可进入配置页面。

-

选择资源:配置页面的核心是选择计算资源。对于Fooocus这类AI绘图应用,最重要的资源是GPU。

- GPU型号 :平台提供了多种GPU选项,文档中选择了

RTX 4090。这是一款消费级的旗舰显卡,拥有强大的计算能力和大量的显存(24GB),非常适合运行SDXL这类对资源要求较高的模型,能够显著提升图像生成的速度。 - 计费方式:选择了"按量计费"。这种模式对用户非常友好,意味着只有在实例(即运行着Fooocus的云服务器)开机时才会计费,关机后则只收取极低的存储费用。用户可以根据自己的使用频率灵活控制成本,无需前期投入高昂的硬件费用。

- GPU型号 :平台提供了多种GPU选项,文档中选择了

-

确认与创建:完成资源选择后,点击购买或确定,平台即开始自动化部署流程。

这个过程后台发生了一系列复杂的操作:

- 资源调配:平台从其资源池中分配一台配备了RTX 4090的物理或虚拟服务器。

- 镜像加载:将预先制作好的Fooocus镜像部署到这台服务器上。这个镜像已经解决了所有我们在第二章遇到的问题:它内置了合适的Linux操作系统、兼容的NVIDIA驱动和CUDA版本、一个预先创建好的包含Python 3.10的Conda环境,以及所有安装好的pip依赖包。

- 数据挂载:平台可能还会将包含模型权重文件的存储卷挂载到实例中,免去了用户手动下载和上传的麻烦。

- 网络配置:自动配置网络,并为应用分配一个可供访问的公网IP地址和端口。

整个过程对用户是完全透明的,用户看到的只是一个短暂的"创建中"状态。

几分钟后,实例创建完成。平台清晰地展示了,它已经为我们准备好了一个"将Fooocus的环境搞好"的即用型工作空间。

3.3 快速启动与使用

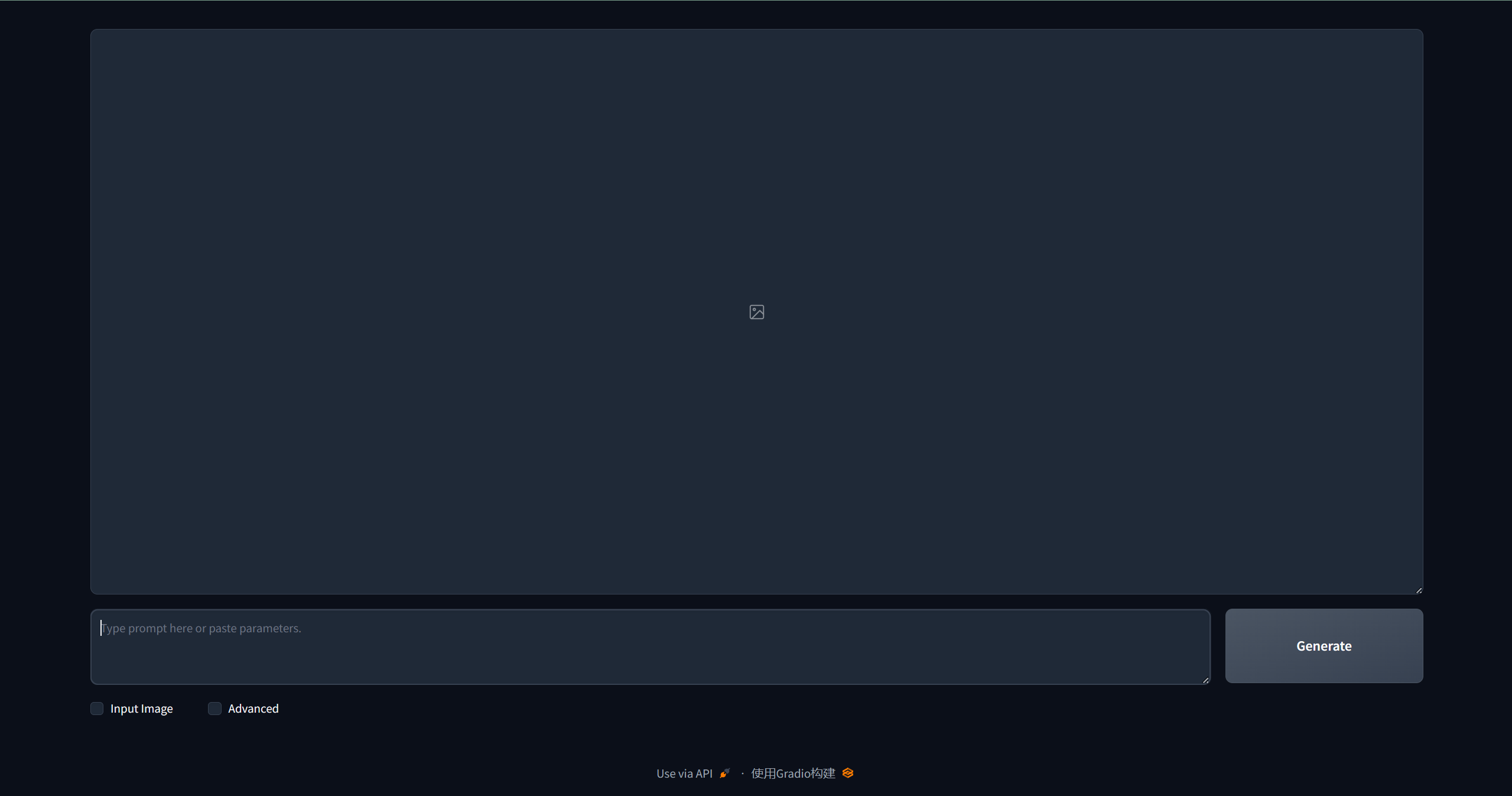

部署完成后,平台上会提供一个"快速运行应用"的入口。

点击后,系统可能会自动执行类似于 python entry_with_update.py --listen 0.0.0.0 的启动命令,并直接将WebUI的访问地址呈现给用户。用户无需登录服务器,无需输入任何命令行代码,直接在浏览器中打开链接,即可看到Fooocus熟悉的操作界面。

从一个空白的服务器到能够生成第一张图片,手动部署可能需要花费数小时甚至一天的时间,且成功与否充满不确定性。而在云平台上,这个过程被压缩到了几分钟,并且是100%可复现的成功。这就是平台化、服务化带来的巨大效率提升。

第四章:创作的喜悦------在Fooocus中生成艺术作品

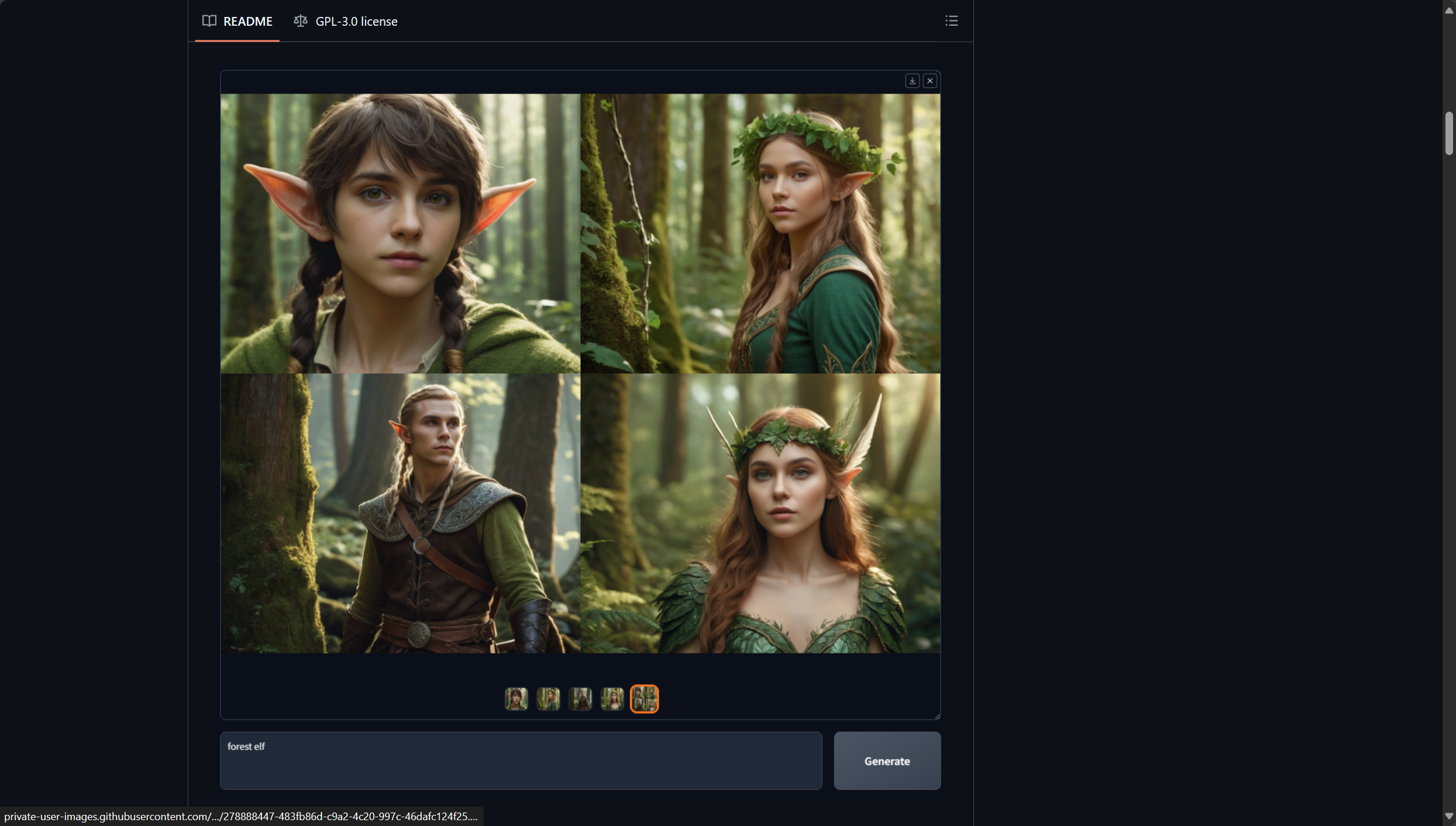

无论是通过何种方式部署,最终目的都是为了使用Fooocus进行创作。本章将展示在成功部署的Fooocus环境中,如何通过精确的提示词生成高质量的图像,并对几个示例进行简要分析。

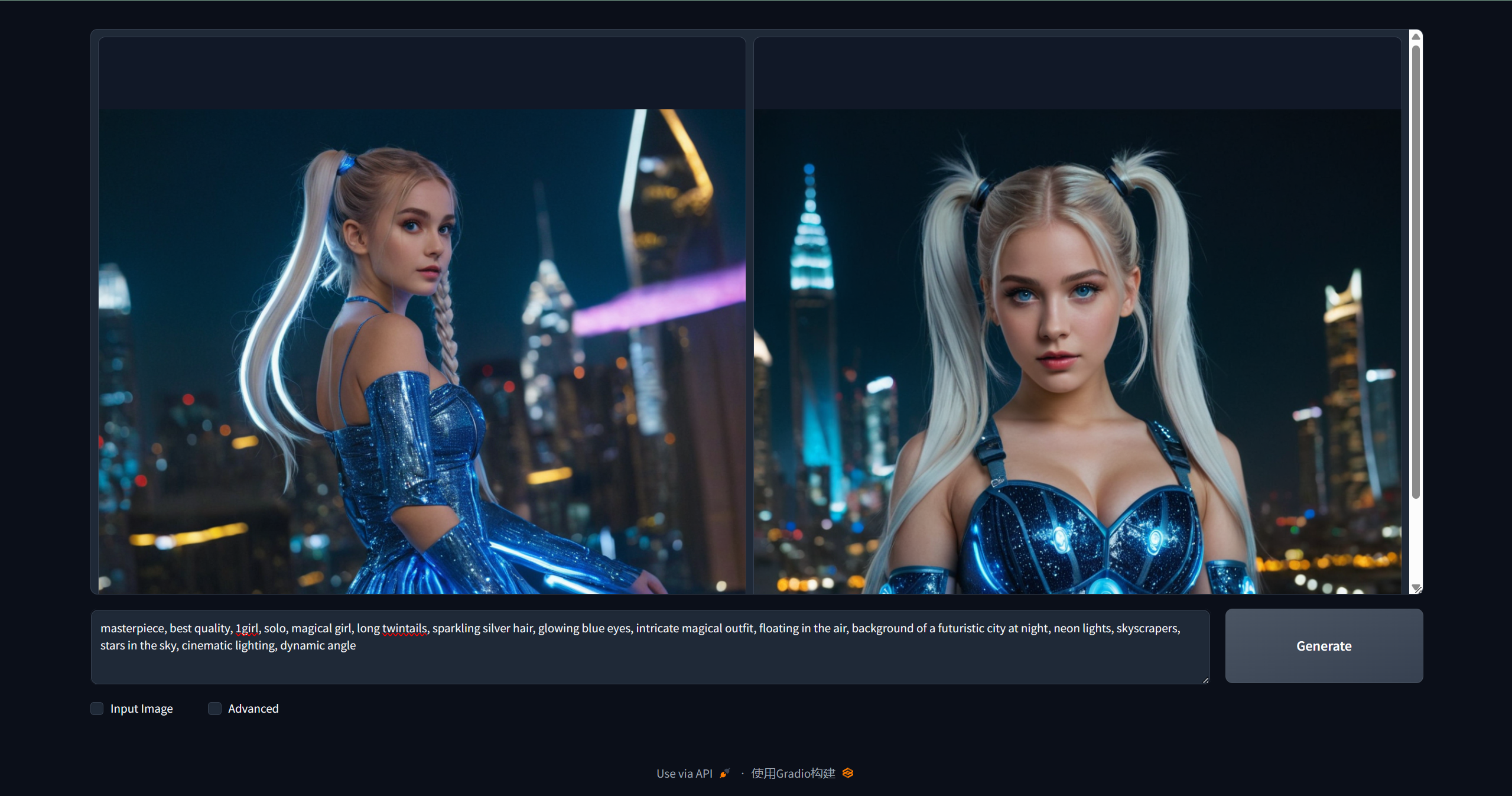

示例一:未来都市的魔法少女

- Prompt :

masterpiece, best quality, 1girl, solo, magical girl, long twintails, sparkling silver hair, glowing blue eyes, intricate magical outfit, floating in the air, background of a futuristic city at night, neon lights, skyscrapers, stars in the sky, cinematic lighting, dynamic angle - 中文释义:杰作,最高品质,1个女孩,单人,魔法少女,长长的双马尾,闪亮的银色头发,发光的蓝色眼睛,复杂的魔法服装,漂浮在空中,背景是未来城市的夜景,霓虹灯,摩天大楼,天空中的星星,电影级光照,动态视角。

分析:这个提示词结构非常典型。它以"质量词"(masterpiece, best quality)开头,确保模型向高质量区域生成。接着是主体描述(1girl, solo, magical girl...),详细定义了角色的外观和姿态。最后是背景和氛围设定(futuristic city, neon lights, cinematic lighting...),共同构建了一个完整、动态的场景。Fooocus精准地捕捉了这些元素,生成了一幅光影效果出色、细节丰富的图像。

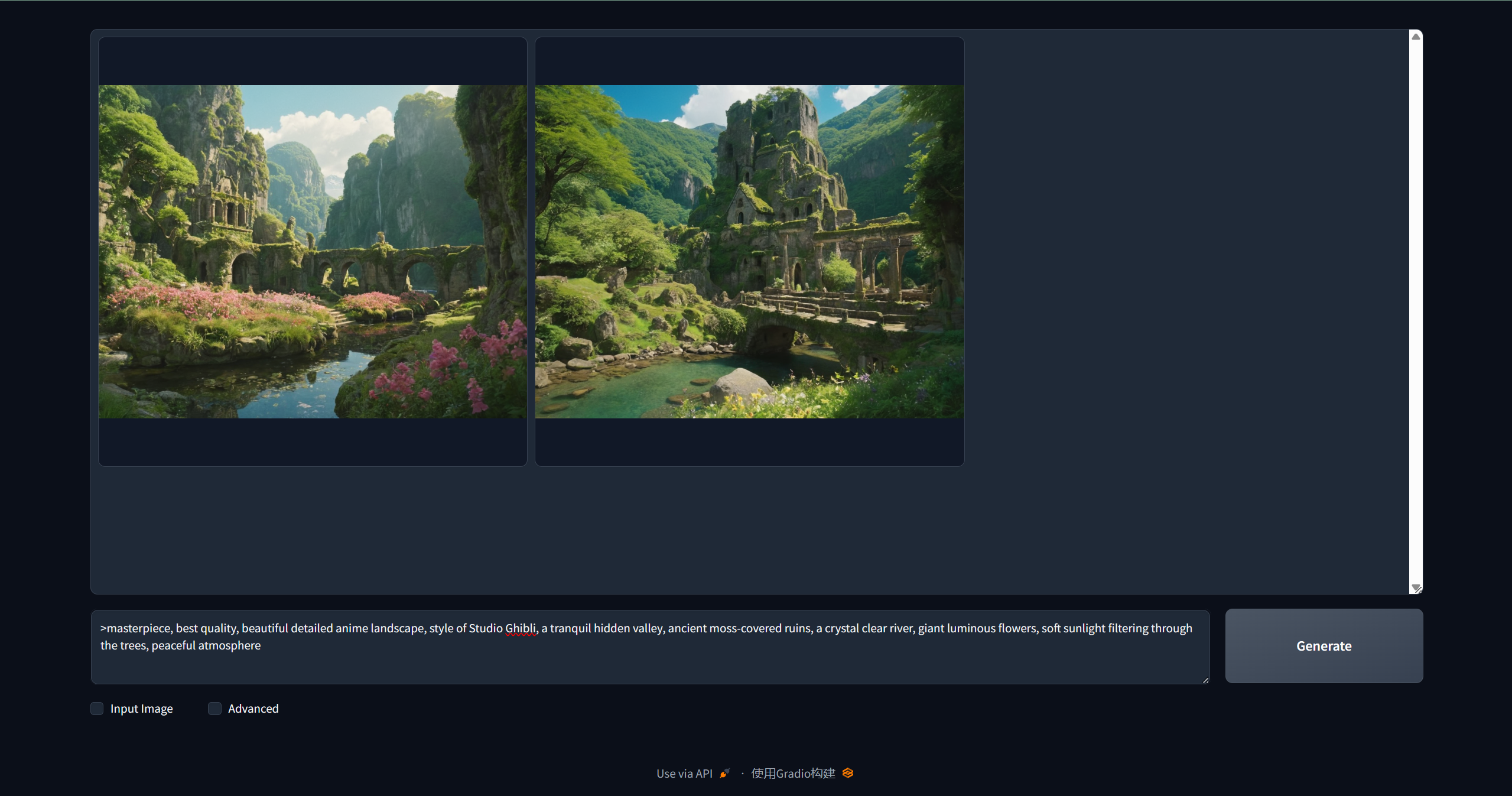

示例二:吉卜力风格的静谧山谷

- Prompt :

masterpiece, best quality, beautiful detailed anime landscape, style of Studio Ghibli, a tranquil hidden valley, ancient moss-covered ruins, a crystal clear river, giant luminous flowers, soft sunlight filtering through the trees, peaceful atmosphere - 中文释义:杰作,最高品质,精美细致的动漫风景,吉卜力工作室风格,宁静的隐藏山谷,长满苔藓的古老废墟,清澈见底的河流,巨大的发光花朵,柔和的阳光穿过树林,祥和的氛围。

分析 :这个提示词的核心是风格指定------style of Studio Ghibli。Fooocus的基模型SDXL及其微调版本对大量艺术风格有很好的理解。提示词通过描绘一系列意象(废墟、河流、发光花朵),成功引导模型生成了具有鲜明吉卜力动画电影感的画面,色彩柔和,充满自然气息和神秘感。

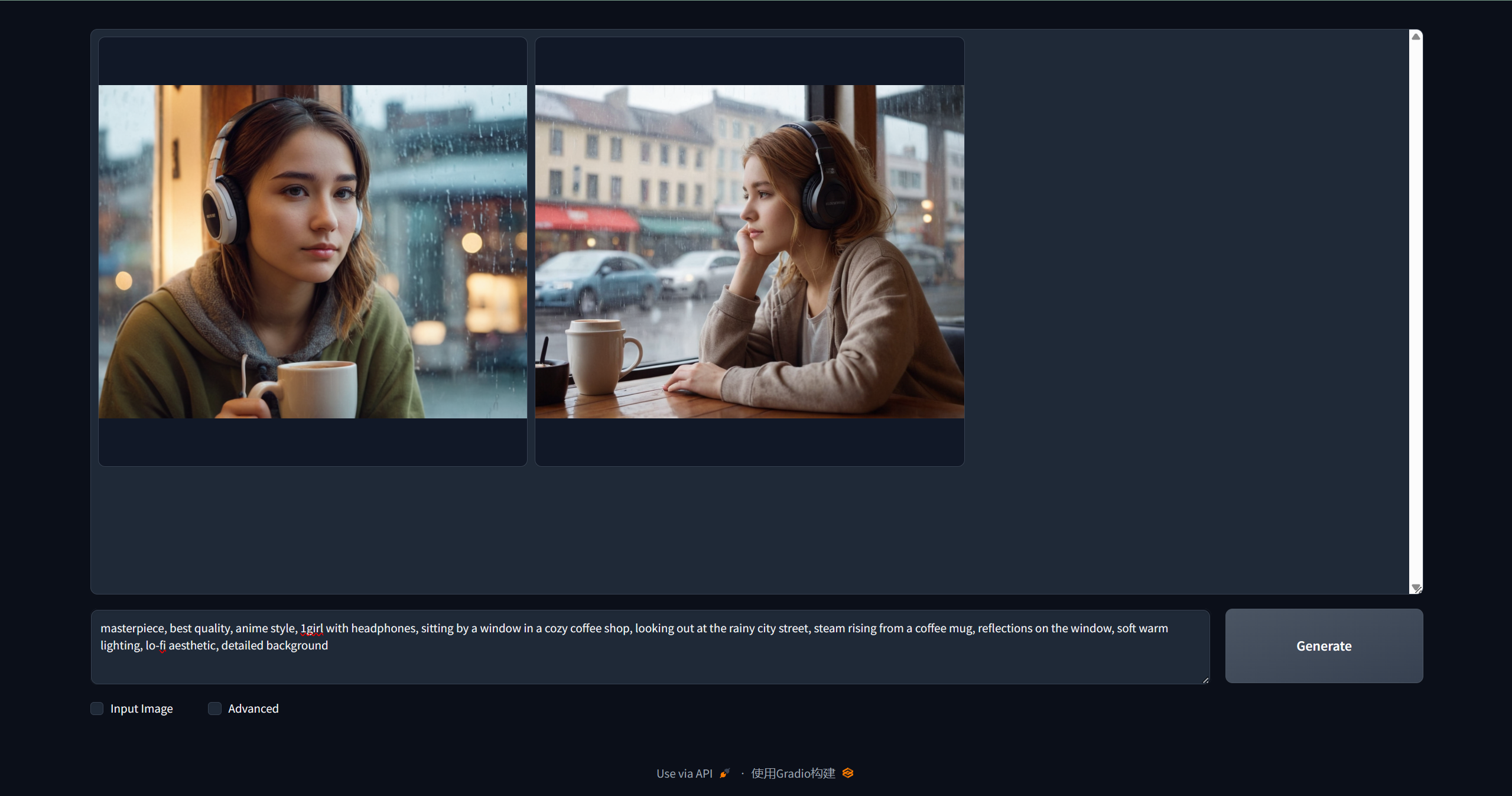

示例三:雨中咖啡店的Lo-fi女孩

- Prompt :

masterpiece, best quality, anime style, 1girl with headphones, sitting by a window in a cozy coffee shop, looking out at the rainy city street, steam rising from a coffee mug, reflections on the window, soft warm lighting, lo-fi aesthetic, detailed background - 中文释义:动漫风格,1个戴着耳机的女孩,坐在舒适咖啡店的窗边,望着窗外下雨的城市街道,咖啡杯冒着热气,窗户上的倒影,柔和温暖的灯光,lo-fi氛围,精细的背景。

分析 :此提示词重在营造氛围(lo-fi aesthetic)。通过一系列细节描述,如窗外的雨、杯中的热气、窗户的反光和柔和的灯光,精确地构建了一个安静、舒适、略带忧郁的场景。这展示了Fooocus不仅能处理宏大场景,也能细腻地刻画生活化的瞬间和情绪。

这些成功的生成案例,是部署工作最终价值的体现。而能够快速、无障碍地进入到这一创作阶段,正是云平台部署模式的核心优势所在。

第五章:结论------两种部署路径的比较与思考

通过对Fooocus手动部署与云平台部署的全过程实践,我们可以从多个维度对这两种方法进行一个客观的总结和比较。

| 维度 | 手动部署(本地/传统云服务器) | 云平台一键部署(如蓝耘) |

|---|---|---|

| 时间成本 | 高。数小时到数天不等,取决于操作者的经验和遇到的问题。 | 极低。从选择到可用通常在5-10分钟。 |

| 技术门槛 | 高。需要熟悉Linux命令行、Conda、Git、Pip,并具备解决环境冲突的能力。 | 极低。几乎为零,只需基本的网页操作能力。 |

| 成功率 | 不确定。新手可能因无法解决的错误而放弃。 | 极高。平台保证了环境的兼容性和可复现性。 |

| 学习价值 | 极高。是深入学习AI应用技术栈、Linux系统管理和软件工程实践的绝佳机会。 | 低。用户直接使用应用,对底层技术细节无感知。 |

| 硬件成本 | 极高(若本地配置)。需要购买昂贵的GPU。 | 零前期投入。按实际使用付费,成本可控。 |

| 灵活性与控制力 | 最高。用户拥有root权限,可以任意修改环境、代码和配置。 | 有限。平台提供的是标准化环境,深度定制可能受限。 |

| 适用人群 | 学生、研究人员、软件开发者、希望深入学习底层技术的爱好者。 | 艺术家、设计师、内容创作者、需要快速验证想法的产品经理、所有希望聚焦于应用本身的用户。 |

总结性思考:

手动部署和云平台部署并非相互替代,而是服务于不同目标群体的两种模式。

手动部署的价值在于过程。 它是一次深刻的学习体验。在这个过程中所遇到的每一个错误、每一次调试,都在构建你对整个技术体系的认知。对于致力于成为AI工程师或深度学习研究者的人来说,这种底层实践是必不可少的。它锻炼的不仅仅是解决问题的能力,更是对技术复杂性的敬畏和理解。

云平台部署的价值在于结果。 它将复杂的部署过程抽象成一个简单的服务,其核心理念是"赋能"。它为那些不具备深厚技术背景但拥有无穷创意的用户,铺平了通往AIGC世界的道路。对于一个艺术家来说,他的时间应该花在构思画面和雕琢提示词上,而不是在黑色的终端窗口中与版本号作斗争。对于一个小型创业团队来说,快速将应用跑起来并进行业务验证,远比从零搭建一套环境重要。

文档中从手动部署的"烦"到云平台部署的"爽"的转变,生动地体现了技术发展的趋势之一:基础设施的"隐形化"和"服务化"。随着技术栈越来越复杂,必然会出现更高级的抽象层,来屏蔽底层细节,让更多人能够享受到技术带来的红利。蓝耘这样的算力平台,正是扮演了这个"抽象层"的角色。它没有消除复杂性,而是将复杂性"内包"和"托管",以一种更友好的方式呈现给最终用户。

因此,在选择部署方式时,我们应该问自己一个问题:我当前的目标是什么?是为了学习和探索,还是为了创造和产出?对这个问题的回答,将自然而然地引导我们走向最适合自己的那条路。而对于整个AIGC生态而言,这两种路径的共存,共同构成了其健康发展的基石------既有深入底层的硬核开发者不断推动技术边界,也有广大的创作者在上层应用中释放想象力,共同繁荣这个激动人心的新领域。

bash

https://console.lanyun.net/#/register?promoterCode=5663b8b127