空间智能(Spatial Intelligence)以空间坐标为核心,通过感知、分析、建模实现对物理空间中 "人、物、事件" 的位置关联与规律挖掘,为各类场景提供精准的空间决策依据。其核心价值在于打破空间数据的碎片化局限,构建 "空间 - 实体 - 行为" 的关联体系,例如通过空间拓扑分析优化资源布局,依托位置匹配实现多设备协同。

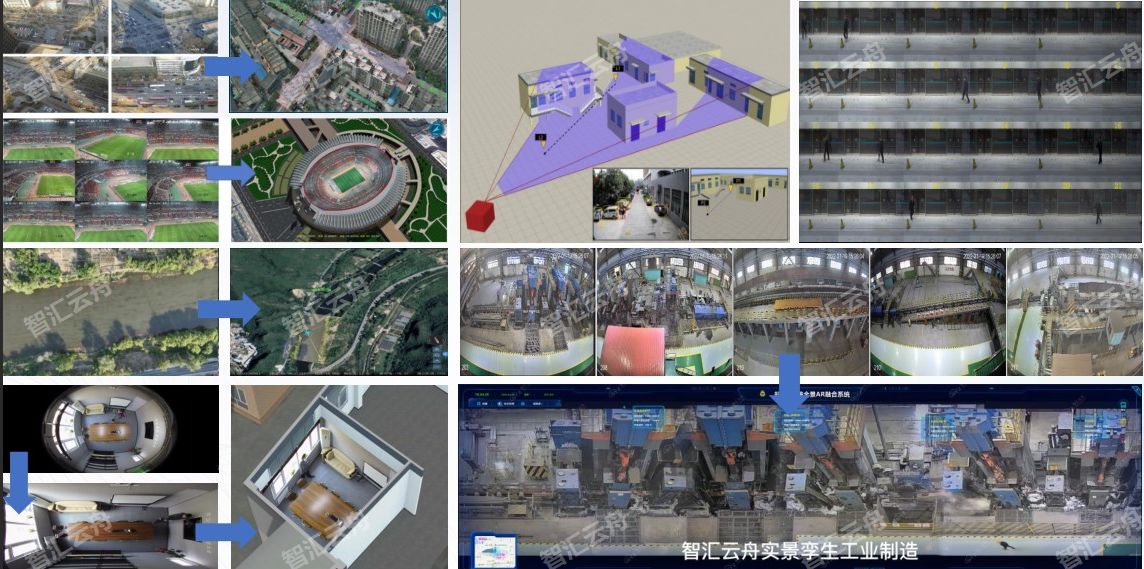

由国内数字孪生头部企业智汇云舟首倡的视频孪生则是 "实时视频流 + 三维数字场景" 的深度融合产物,它跳出传统数字孪生 "静态建模" 的框架,将物理世界的动态变化以视频形式实时映射至数字空间,让数字场景具备 "实时可视、动态追踪" 的特性。当空间智能与视频孪生相遇,形成的是 "精准空间锚点 + 实时动态呈现" 的技术闭环:空间智能为视频孪生提供统一的空间坐标系,让分散的视频画面转化为可定位、可关联的空间数据;视频孪生则为空间智能搭建具象化的展示载体,使抽象的空间分析结果(如轨迹预测、区域风险)通过实时实景直观呈现,解决了 "数据懂但看不见" 的痛点。

这种融合的关键突破在于 "空间坐标与视频像素的精准绑定"。借助空间映射算法与三维地理信息引擎,系统可将监控画面中任意目标(如行人、车辆、设备)的像素位置,转化为地球空间网格中的精确坐标,实现 "看到即定位、定位即关联",为后续的空间分析与决策奠定基础。

一、技术内核:从像素到坐标的时空革命

1.1 视频孪生的三维定位突破

传统视频监控长期面临"重监视、轻量测"的局限,而视频孪生技术通过三维视觉定位引擎,将视频画面中的每个像素反演为三维空间坐标。智汇云舟的"孪舟"三维地理信息引擎采用三角测量与深度估计算法,在某港矿石码头项目中实现3000米堆场货物堆存状态的毫米级识别,误差率低于0.5%。这种纯视觉定位方案突破了GPS、UWB等硬件依赖,在地下隧道等封闭场景中仍能保持厘米级定位精度。

1.2 空间智能的多维感知体系

空间智能作为人工智能的核心分支,通过整合视觉、激光雷达、惯性导航等多模态数据,构建起动态、精确的三维世界模型。其技术架构包含六大核心能力:

- 立体视觉:利用双目摄像头模拟人眼视差,生成稠密点云

- SLAM技术:在未知环境中实现厘米级地图构建与自我定位

- 场景图生成:构建包含物体、属性与关系的空间语义网络

- 动态预测:通过强化学习算法预测行人、车辆运动轨迹

- 语义地图:叠加物体标签与功能信息的环境模型

- 人机交互:支持手势识别、空间锚定等自然交互方式

1.3 时空基准的统一编码标准

GB/T 40768-2021《视频流与时空信息融合编码规范》的出台,标志着视频孪生技术进入标准化发展阶段。该标准规定视频流需包含时间系统(UTC/北京时间)、空间基准(CGCS2000坐标系)、传感器参数等静态要素,以及帧号、经纬度、姿态角等动态信息。通过H.264/H.265码流中的SEI补充增强信息,实现视频与时空数据的紧耦合编码,为技术落地提供了"通用语言"。

二、场景应用落地:空间智能驱动视频孪生的价值释放

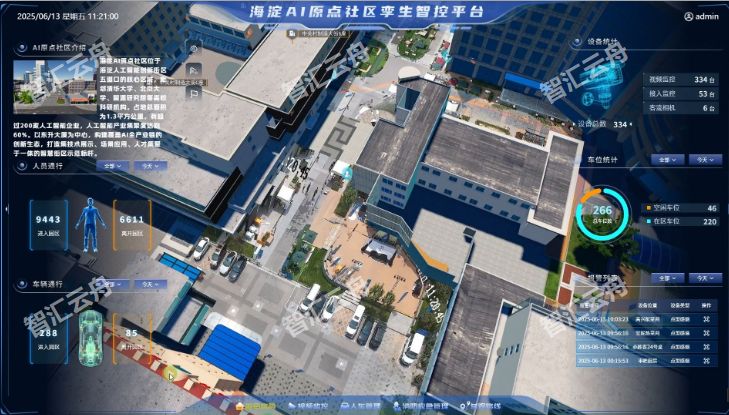

2.1智慧城市:从 "平面监控" 到 "立体治理"

在城市交通领域,融合系统通过空间智能整合 GPS、路侧雷达与路口视频数据,在视频孪生场景中构建 "动态交通沙盘"。系统可基于车辆空间轨迹分析通行规律,提前识别拥堵节点。

在城市安防场景,空间智能赋予视频孪生 "区域关联分析" 能力。当某商圈出现异常人员聚集时,系统不仅能在视频孪生场景中标记聚集区域的精确坐标,还能通过空间拓扑关系,联动周边监控设备追踪人员来源与流动路径,辅助警方快速判断事件性质,实现从 "被动监控" 到 "主动预警" 的转变。

2.2场景落地:视频孪生赋能空间智能的价值释放

2.2.1智能制造场景

工业厂区的视频孪生系统,依托空间智能实现设备、物料、人员的 "空间坐标统一管理"。系统可定位生产线上每台设备的空间位置,并关联其运行数据 ------ 当某台机床出现故障时,不仅能在三维视频场景中精准标记设备坐标,还能通过空间距离分析,自动匹配最近的维修人员与备件存放位置,缩短故障处置时间。同时,通过分析人员空间移动轨迹,优化作业路线,减少跨区域作业浪费,提升生产效率。

2.2.2智慧物流场景

大型物流园区借助 "视频孪生 + 空间智能",解决了货物、车辆、货架的 "空间调度难题"。系统通过空间智能实时定位货车在园区内的坐标、货架的空间位置,在视频孪生场景中模拟货物装卸最优路径,避免车辆拥堵。

2.2.3智慧园区场景

写字楼或产业园区的视频孪生平台,通过空间智能整合安防、能耗、后勤等数据。当园区某楼层出现消防告警时,系统可在视频孪生场景中标记告警区域的精确空间坐标,结合空间疏散路径分析,自动生成最优逃生路线,并同步推送至楼内人员手机端;同时,联动周边监控确认告警真实性,避免误报导致的资源浪费,实现 "空间安全事件的闭环处置"。

三、未来趋势:构建空间智能生态体系

随着技术发展,"视频孪生 + 空间智能" 将向三个方向深度进化:

其一,空间认知智能化------ 融合 AI 大模型与空间推理技术,使系统不仅能 "定位空间目标",还能 "理解空间关系",例如通过分析人员空间聚集模式,预判群体行为趋势;

其二,多场景空间协同------ 打破单一场景的空间边界,实现跨区域、跨领域的空间数据共享与协同,例如城市交通与周边高速的视频孪生场景联动,统一调度跨区域车流;

其三,交互体验空间化------ 结合 AR/VR 技术,打造 "沉浸式空间交互",用户可在视频孪生场景中以 "空间视角" 操作设备(如远程控制工业机械臂、调整园区照明系统),实现 "虚实空间的无缝交互"。

在这场空间认知革命中,视频孪生与空间智能的融合,正从 "技术组合" 升级为 "产业基础设施"。它不仅重构了物理空间的数字化表达形式,更通过 "空间数据驱动决策",为智慧城市、智能制造、智慧物流等领域注入新动能,推动社会生产生活向 "更精准、更高效、更协同" 的空间管理模式迈进。