动态范围与HDR技术:从人眼感知到AI增强的工程实践

一、从生活现象到技术问题

生活场景:当你站在窗前拍摄室内场景时,要么窗外过曝变成一片死白,要么室内欠曝成为漆黑一片。这就是典型的动态范围不足问题------相机无法同时捕捉最亮和最暗区域的细节。

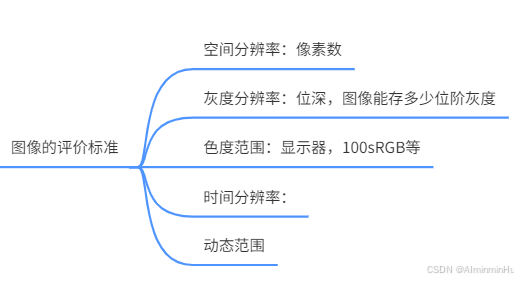

工程本质 :动态范围本质上是系统能够处理的最大不失真信号与噪声底层的比值,用公式表达就是:

DR = 20log(最大有效信号 / 最小有效信号)

在LED显示领域,我们面临同样的问题:如何在一块屏幕上同时呈现烛光晚餐的温馨细节和城市夜景的璀璨灯光?

二、动态范围的工程化理解

2.1 核心矛盾

理论上,提高sensor的bit宽度就能扩展动态范围。但工程上,这会导致:

- 成本指数级增长

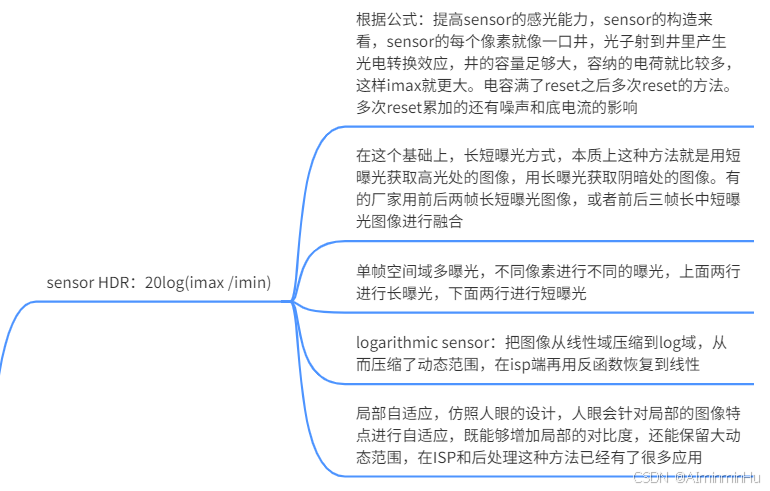

- 动态范围:一个信号系统的动态范围被定义为最大不失真电平和噪声电平的差。sensor的动态范围就是sensor在一幅图像中能够同时体现高光和阴影部分内容的能力。最大的有效信号/最小的有效信号做20log。所以从数学上来看,提高sensor输出的bit width就可以提高动态范围,解决HDR问题。现实中提高sensor后sensor的成本和整个图像处理器的成本都高了,内存也消耗的很多。导致系统成本大幅提高。所以为了既能解决HDR问题,又不增加太多成本,

- 内存消耗剧增

- 处理链路复杂化

这就好比:为了运送更多货物,不是简单地把卡车加长,而是需要重新设计整个物流系统。

2.2 传统HDR技术路径

Sensor级HDR:硬件层面的智慧

- 长短曝光融合:用短曝光捕捉高光,长曝光提取暗部细节

- 空间调制:不同像素采用不同曝光策略(如上下行不同曝光)

- 对数压缩:在sensor端进行非线性压缩,ISP端还原

LED显示的经验映射 :这与我们在LED屏上实现的时空混合调制异曲同工------通过控制不同区域、不同时间的亮度分布,在有限的硬件条件下扩展有效灰度级数。

后处理HDR:算法驱动的突破

典型流程:

- 图像配准:消除多帧间的抖动(如同LED校正中的像素对齐)

- 权重融合:基于高斯分布的智能加权,保留中间调细节

- 色彩恢复:重建自然的色彩表现

工程挑战:

- 鬼影消除(运动物体带来的伪影)

- 曝光时间优化

- 色彩一致性保持

三、Tone Mapping:动态范围的"翻译官"

3.1 为什么需要Tone Mapping?

现实困境:真实世界动态范围(10 ^ 6:1)远大于显示设备能力(10 ^ 3:1)。直接截断会导致细节丢失,如同把交响乐压缩到手机喇叭播放。

- Tone Mapping:动态范围压缩,传统、真实世界、人眼能看到多少坎德拉(多少根蜡烛的光)。真实世界场景,我拍了之后,假如18bit,如何显示到8bit的显示屏上呢,不能直接砍掉,会失真,8bit显示器只能显示0+255,Tone Mappint可以让人眼看到18bit的一个效果,也就是高bit转到低bit,并且视觉上无损

3.2 技术路径的权衡

Global Tone Mapping

- 优势:计算简单,时域稳定

- 劣势:局部对比度损失,饱和度下降

- LED显示类比:类似于全局Gamma校正,简单但无法解决局部均匀性问题

Local Tone Mapping

- 优势:保持局部对比度,细节丰富

- 劣势:halo效应,时域抖动

- LED显示经验 :这就像我们的区域亮度调节,能够根据画面内容动态调整不同区域的驱动参数

3.3 JND理论指导

Just-Noticeable Difference理论告诉我们:人眼对亮度的感知是对数关系而非线性。这指导我们在Tone Mapping中应该保留相对差异而非绝对数值。

四、LED显示工程的经验迁移

4.1 硬件约束下的优化智慧

在LED显示中,我们通过PWM+PAM混合调制在有限的硬件条件下实现了:

- 低灰阶的平滑过渡

- 高亮度的精准控制

- 功耗与画质的平衡

这直接映射到HDR问题:如何在有限的sensor动态范围内,通过算法扩展有效动态范围。

- 真正的HDR技术:HDR成像系统始终以高精度记录数据,而且与显示设备无关,只有在显示阶段,图像的色彩空间才因为显示的局限被压缩了,而普通成像则在图像采集、处理和压缩阶段都已经压缩了色彩空间

4.2 多帧融合的工程实践

LED的时空混合调制 与HDR的多曝光融合有着相同的数学本质:

- 时间维度:不同时刻的不同曝光/不同灰度表现

- 空间维度:不同区域的不同处理策略

-

多曝光的HDR流程:提取灰度图像,在进行图像配准(去掉图像的抖动,为融合做准备,让融合的更准),在进行灰度融合(相同图像位置的像素融合起来,希望将图像有用的信息放到中间,或者说人眼比较明显看清楚的地方。像素融合时,比如三帧融合,根据右边曲线和人眼的感官趋势一致,三帧图像最左边权重最低,最右边权重最高,最后根据权重,中间像素权重最高,那么最终融合出来的更靠近中间的像素,那么对于过饱和等,可以适当调整权重,调整融合结果),最后及逆行图像色彩恢复

exp(-(i - 0.5) 2/(2δ2))

-

4.3 校准与一致性问题

如同LED屏需要逐点校正来保证均匀性,HDR系统也需要:

- 多帧间的精确配准

- 色彩的一致性保持

- 噪声的系统性抑制

五、AI驱动的HDR技术演进

5.1 传统方法的局限性

传统HDR pipeline的串行处理会累积误差:

- 配准不准 → 融合模糊多

- 权重设计主观 → 细节丢失

- 手动调参 → 效率低下

5.2 AI HDR的技术突破

端到端学习

python

# 伪代码示例:AI HDR网络结构

class AI_HDR_Net(nn.Module):

def forward(self, multi_exposure_frames):

# 1. 特征对齐:学习复杂的运动补偿

aligned_features = self.alignment_net(frames)

# 2. 智能融合:像素级权重学习

fusion_weights = self.fusion_net(aligned_features)

# 3. 色调映射:感知驱动的动态范围压缩

hdr_result = self.tone_mapping_net(fusion_weights)

return hdr_result与传统方法的对比优势

- 对齐精度:光流网络 > 特征点匹配

- 融合智能:数据驱动 > 手工设计权重

- 异常处理:端到端学习 > 规则式处理

5.3 工程化挑战与解决方案

模型轻量化

借鉴LED算法中的稀疏采样思想:

- 关键帧选择:只处理信息量最大的帧

- 区域自适应:对不同区域采用不同计算复杂度

- 知识蒸馏:大模型指导小模型训练

实时性优化

如同我们在LED驱动中的流水线优化:

- 多帧并行处理

- 计算与传输重叠

- 硬件感知的算法调度

5.4 与LED技术的深度结合

前景展望:

- 感知一致的HDR :结合JND理论,在关键区域分配更多资源。

- 什么是HDR:一种改善动态对比度的技术,高动态范围技术,提升最亮和最暗画面的对比度,这样用户就能看到更多的细节。

- HDR图像的来源:

- 高bit HDR sensor

- 多曝光

- alternate row 、zigzag HDR

- 内容自适应的Tone Mapping:根据画面语义调整映射曲线

- 跨平台的画质一致性:从采集到显示的端到端优化

六、技术展望

未来的HDR技术将不再是孤立的图像处理模块,而是贯穿整个成像链路的系统工程。从sensor的智能曝光控制,到ISP的语义感知处理,再到显示设备的自适应映射,形成一个完整的画质增强闭环。

对工程师的启示:既要深入理解传统的信号处理理论,又要拥抱数据驱动的AI方法,在硬件约束与画质追求之间找到最优的工程平衡点。

本文融合了显示领域工程实践与计算摄影技术洞察,希望能为同行提供有价值的参考。技术之路,贵在持续迭代与跨界思考。