一、MiMo-V2-Flash的亮点

①API 定价为输入

$0.1/M tokens,输出$0.3/M tokens,且目前限时免费,推理成本仅为Claude 4.5 Sonnet的2.5%。②在多个Agent测评基准中保持全球开源模型Top 2,代码能力强。

③使用场景多为智能通场景设计,支持深度思考和联网搜索。

④架构上使用混合注意力机制和多层MTP进行推理加速。

⑤模型权重和推理代码使用的是MIT协议,适用商业场景。

二、技术剖析①窗口大小为128

②原生支持32K 上下文,外扩技术支持可达256K的上下文处理

③多层MIT推理加速,并行效率倍增

三、在线体验①体验链接:https://aistudio.xiaomimimo.com

②API地址(限时免费哦!各位白嫖党抓紧机会!!!):https://platform.xiaomimimo.com/

③收费定价:输入 0.1/M tokens,输出 0.3/M tokens

③本地部署:

a.模型权重:https://hf.co/XiaomiMiMo/MiMo-V2-Flash

b.GitHub仓库:https://github.com/xiaomimimo/MiMo-V2-Flash

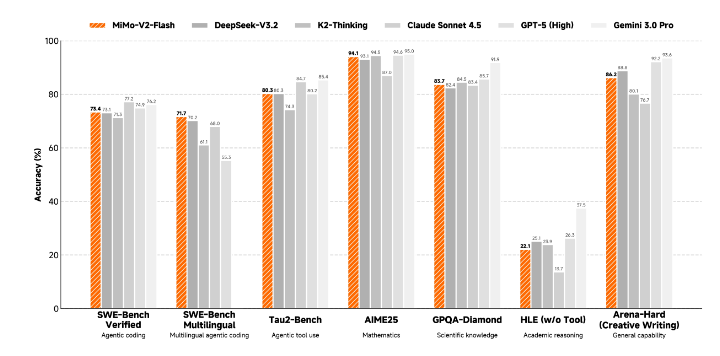

四、模型效果

从公布的基准测试图中看,性能上有了些许提升,主要的提升应该还是在Agent场景、推理效率的提升和价格吧!但是目前架不住他免费呀!!!

五、调用方法由于MiMo-V2-Flash 已封装成 OpenAI-Compatible HTTP 服务,启动后直接用**OpenAI SDK 或curl -i http://localhost:9001/v1/chat/completions**,模型路径、推理参数全部在启动命令里一次性配好,无需再写 .from_pretrained()。以下是四种不同场景的调用方式:

python# ①启动服务 pip install sglang python3 -m sglang.launch_server \ --model-path XiaomiMiMo/MiMo-V2-Flash \ --served-model-name mimo-v2-flash \ --tp-size 8 --trust-remote-code \ --host 0.0.0.0 --port 9001 # ②API调用 from openai import OpenAI client = OpenAI(base_url="http://localhost:9001/v1", api_key="dummy") response = client.chat.completions.create( model="mimo-v2-flash", messages=[{"role": "user", "content": "Nice to meet you MiMo"}], max_tokens=4096, temperature=0.8, top_p=0.95, stream=True, extra_body={"chat_template_kwargs": {"enable_thinking": True}} ) for chunk in response: print(chunk.choices[0].delta.content or "", end="") # ③curl方式 curl http://localhost:9001/v1/chat/completions \ -H "Content-Type: application/json" \ -d '{ "model": "mimo-v2-flash", "messages": [{"role": "user", "content": "Nice to meet you MiMo"}], "max_tokens": 4096, "temperature": 0.8, "top_p": 0.95, "stream": true, "chat_template_kwargs": {"enable_thinking": true} }' # ④JaveScript方式 const { OpenAI } = require('openai'); const client = new OpenAI({ baseURL: 'http://localhost:9001/v1', apiKey: 'dummy' }); const stream = await client.chat.completions.create({ model: 'mimo-v2-flash', messages: [{ role: 'user', content: 'Nice to meet you MiMo' }], max_tokens: 4096, temperature: 0.8, top_p: 0.95, stream: true, chat_template_kwargs: { enable_thinking: true } }); for await (const chunk of stream) { process.stdout.write(chunk.choices[0]?.delta?.content || ''); }使用流程:启动服务一次 → 拿到 http://localhost:9001/v1 → 当成 OpenAI 接口 用即可,模型、推理参数全部在启动命令里配置完成,无需再加载模型或写 .from_pretrained(

重要的事情说三遍:限时免费!限时免费!!限时免费!!!

Agent学习——小米MiMo-V2-Flash使用方法

爱吃泡芙的小白白2025-12-18 20:31

相关推荐

米小虾9 小时前

AI Agent 上下文管理实战:让你的智能体不再"失忆"冬奇Lab11 小时前

Agent 系列(17):Harness Engineering——给自主 Agent 装上安全护栏Solo社区12 小时前

不做通用AI助手,先做好一个垂直Agent周易宅14 小时前

Hermes Agent 内部/后端命令速查表大模型真好玩15 小时前

智能体从入门到精通:6个必学GitHub开源项目阿里云云原生16 小时前

AI Agent 资源利用率瓶颈如何破?AI 任务调度 + Sandbox 实现动态休眠与唤醒MELF晓宇16 小时前

多模态向量对齐:从 Embedding 到多模态大模型leeyi16 小时前

Graph 编排:不只是 ReAct 的通用 DAG心之伊始18 小时前

Spring AI MCP Client 实战:让 Java 后端通过 stdio 调用本地工具服务李燚18 小时前

Eino 的数据是怎么建模的:Message、ToolCall、流式管道