在AI绘画和视频生成卷到飞起的今天,不管是大厂还是开源社区,大家似乎都陷入了一个怪圈:拼命堆算力去训练更大的Diffusion Transformer(DiT),指望通过增加生成模型的参数来获得更好的画质。

但就在前两天,凭借海螺视频(Hailuo AI)在圈内名声大噪的MiniMax团队,突然开源了一个名为VTP(Visual Tokenizer Pre-training)的项目。看完他们的论文和代码,我不得不说,这帮人可能刚刚掀翻了视觉生成领域的桌子。

他们抛出了一个极其反直觉的结论:如果我们一直在错误的地方用力呢?如果你画不出好图,可能不是因为你的画笔(DiT)不够好,而是因为你的眼睛(Tokenizer)根本没看懂这个世界。

传统的死胡同:只做复读机,不做理解者

为了理解VTP的突破,我们得先聊聊现在的视觉模型是怎么工作的。通常,我们用一个Tokenizer(比如VAE)把图片压缩成Latent(潜在表示),然后让生成模型去学习这个Latent。

在这个过程中,传统Tokenizer的唯一KPI就是"还原度"。它就像一个极其死板的复印店老板,只在乎压缩后的图片解压出来跟原图像不像。像素对上了,任务就完成了。

这就导致了一个严重的问题:Scaling Law在Tokenizer上失效了。

不论你给传统VAE投多少算力、喂多少数据,只要它只盯着像素重建,下游的生成模型就很难从中受益。甚至有时候,重建得越完美,生成的画质反而越差。因为模型把算力都浪费在了描绘墙纸的细微纹理上,却忘了理解画面里站着的是个人还是条狗。

MiniMax的解题思路:理解驱动生成

MiniMax团队这次干的事情,就是重新发明了Tokenizer。他们提出的VTP框架,核心逻辑非常性感:一个好的Tokenizer,不应该只是像素的搬运工,而应该是语义的翻译官。

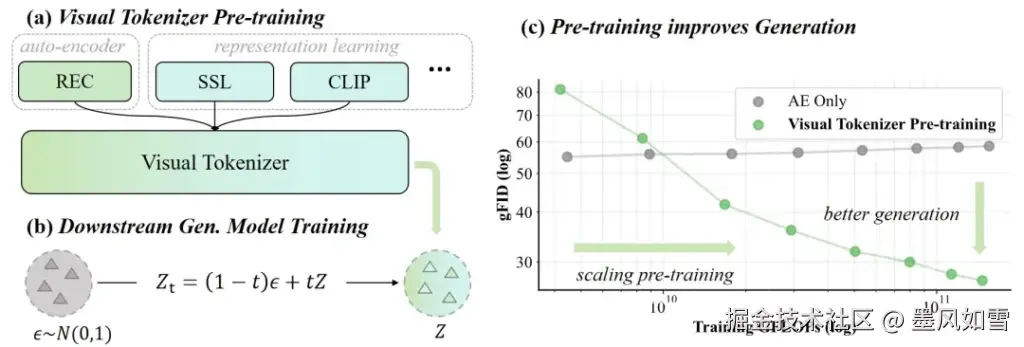

VTP不再单纯追求"画得像",而是追求"听得懂"和"看得懂"。为了做到这一点,他们在预训练阶段搞了一个"混合双打",强行让Tokenizer同时从三个维度学习:

- 像素级重建:老本行不能丢,保证基本的视觉细节(但权重降低了)。

- 语义理解(CLIP风格):让Tokenizer理解这张图对应什么文字,知道"猫"长什么样。

- 结构认知(DINO风格):通过自监督学习,搞清楚物体的空间结构和局部关系。

这就像是教一个学画画的学生,不再让他没日没夜地临摹照片(纯重建),而是先教他解剖学、光影原理和艺术史(语义与结构理解)。结果显而易见,懂原理的学生,创作能力完爆只会临摹的学生。

数据不会骗人:Scaling Law终于生效了

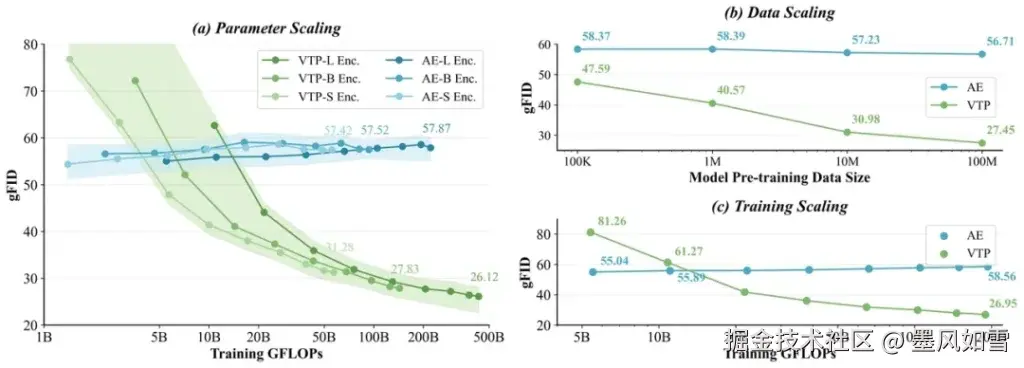

VTP最让开发者兴奋的,不是它用了什么新架构(其实还是ViT),而是它证明了视觉Tokenizer也存在Scaling Law。

根据MiniMax公布的实验数据,当你增加VTP的参数量、训练数据和计算量时,下游的生成模型性能呈现出一条漂亮的上升曲线。

这组对比数据非常震撼:

- 在同样的生成模型算力下,仅仅是将Tokenizer换成VTP,FID(图像质量指标)直接提升了65.8%。

- 收敛速度快了4.1倍。这意味着如果你在训练自己的SD或DiT模型,用VTP可能让你省下一大笔显卡电费。

- 在ImageNet的零样本分类测试中,VTP甚至跑出了78.2%的准确率,比原版CLIP还高。这说明这个Tokenizer是真的"看懂"了图片。

给行业的一记重拳

MiniMax这次开源VTP,实际上是给所有做文生图、文生视频的团队指了一条新路。

在过去,当生成效果遇到瓶颈时,大家的反应通常是:"加层数!加数据!把DiT做大!"但VTP告诉我们,这种蛮力也许并非最优解。与其无止境地扩大生成模型的规模,不如回头看看最基础的Tokenizer。

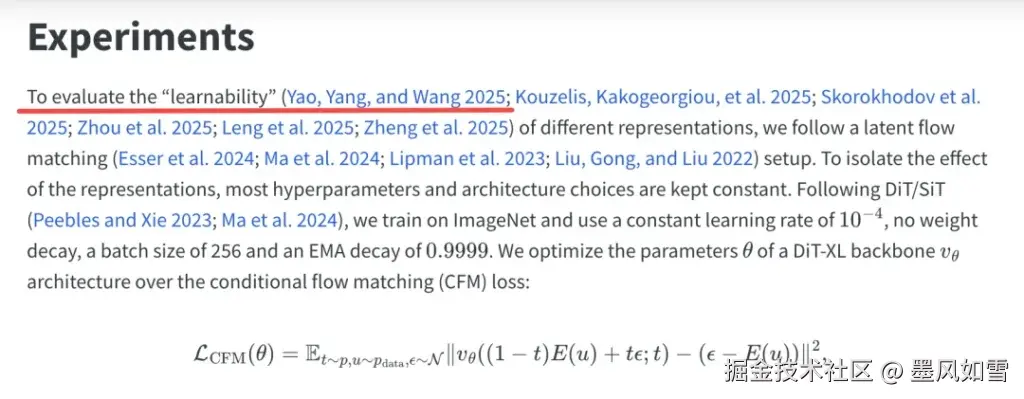

这一步"磨刀不误砍柴工"的策略,极具性价比。它证明了在第一阶段(Tokenizer)注入更多的理解能力,会直接让第二阶段(生成)变得如虎添翼,也就是所谓的"Latent易学性"。

总结

如果你是一名AI工程师或研究者,建议立刻去GitHub上拉取VTP的代码试试。MiniMax提供了完整的预训练权重和微调脚本。

VTP的出现或许标志着视觉生成进入了一个新阶段:我们不再满足于生成像素完美的图像,而是开始追求生成具备深层语义一致性的视觉内容。

有些时候,突破瓶颈的钥匙,往往就藏在你觉得最不起眼的那个组件里。

如果你也对最新的AI信息感兴趣或者有疑问 都可以加入我的大家庭 第一时间分享最新AI资讯、工具、教程、文档 欢迎你的加入!!!😉😉😉

公众号:墨风如雪小站