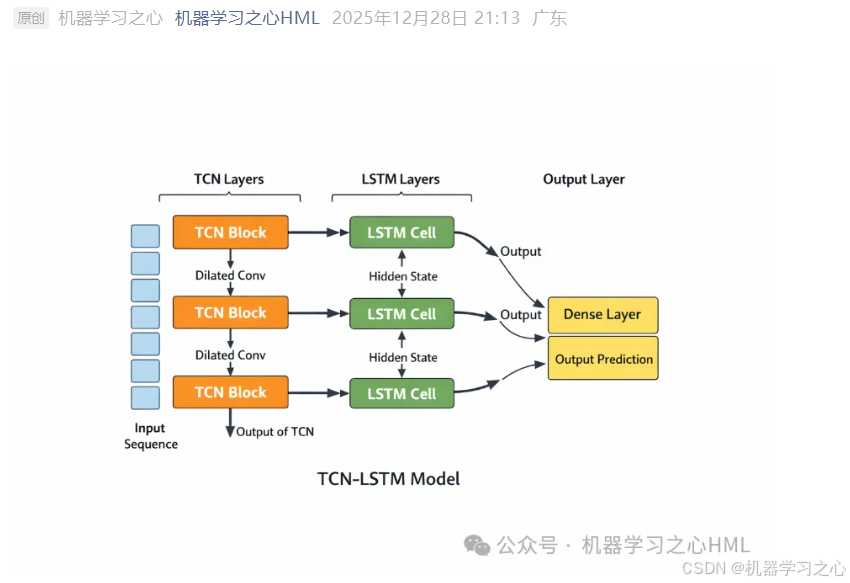

模型整体结构

这是一个时序预测模型,结合了时序卷积网络(TCN)和长短时记忆网络(LSTM)的优势,用于处理时间序列数据。整体结构分为三部分:

TCN 层:提取输入序列的局部与长期依赖特征。

LSTM 层:进一步捕捉序列中的时序动态与长期依赖。

输出层:生成最终的预测结果。

各层详细说明

- TCN 层

由多个 TCN Block 堆叠而成。

每个 TCN Block 包含 扩张卷积(Dilated Convolution),允许模型以指数级扩张的感受野捕捉长期依赖,而无需过多层数。

TCN 的优势:

并行计算,训练速度快。

可控制感受野大小,适合长序列。

避免梯度消失问题。

- LSTM 层

由多个 LSTM Cell 组成。

每个 LSTM Cell 接收 TCN 层的输出,并传递隐状态(Hidden State)给下一时刻。

LSTM 的优势:

适合建模序列中的时序动态。

能够记住长期信息,适用于具有复杂时间依赖的任务。

- 输出层

通常是全连接层(Dense Layer),将 LSTM 的最终输出映射到预测目标维度(如单步或多步预测)。

数据流向

输入序列 → TCN 层:提取高层次时序特征。

TCN 输出 → LSTM 层:进一步建模时序依赖。

LSTM 输出 → 输出层 → 预测结果。

TCN-LSTM 混合模型的优势

TCN:高效提取局部与长期特征,感受野大。

LSTM:强时序建模能力,适合动态系统。