一、模型能力深度解析

1. 图像生成的六边形战士:doubao-seedream-4-0-250828

字节跳动推出的 doubao-seedream-4-0-250828 是目前即梦平台画图功能的核心多模态引擎。相比于传统的 Stable Diffusion,它在以下几个维度实现了降维打击:

- 全流程创作集成 :在一个统一的框架内整合了文生图、图像编辑、多图组合生成。支持单次输入最多 10 张图像作为上下文,进行复杂的复合编辑。

- NLP 指令级编辑:不再需要复杂的 ControlNet 参数,直接通过自然语言(如"把背景换成赛博朋克风格")即可实现精准修改。

- 中文语境与 4K 输出:针对中文 Prompt 进行了深度对齐,并支持原生 4K 分辨率输出,完美适配国内商业落地场景。

2. 视频生成的王者:Sora-2

OpenAI 的 Sora-2 无需多言,其物理世界的模拟能力处于断层领先地位。但官方 API 价格昂贵且对普通开发者不开放。本文将介绍如何通过聚合渠道实现低成本调用。

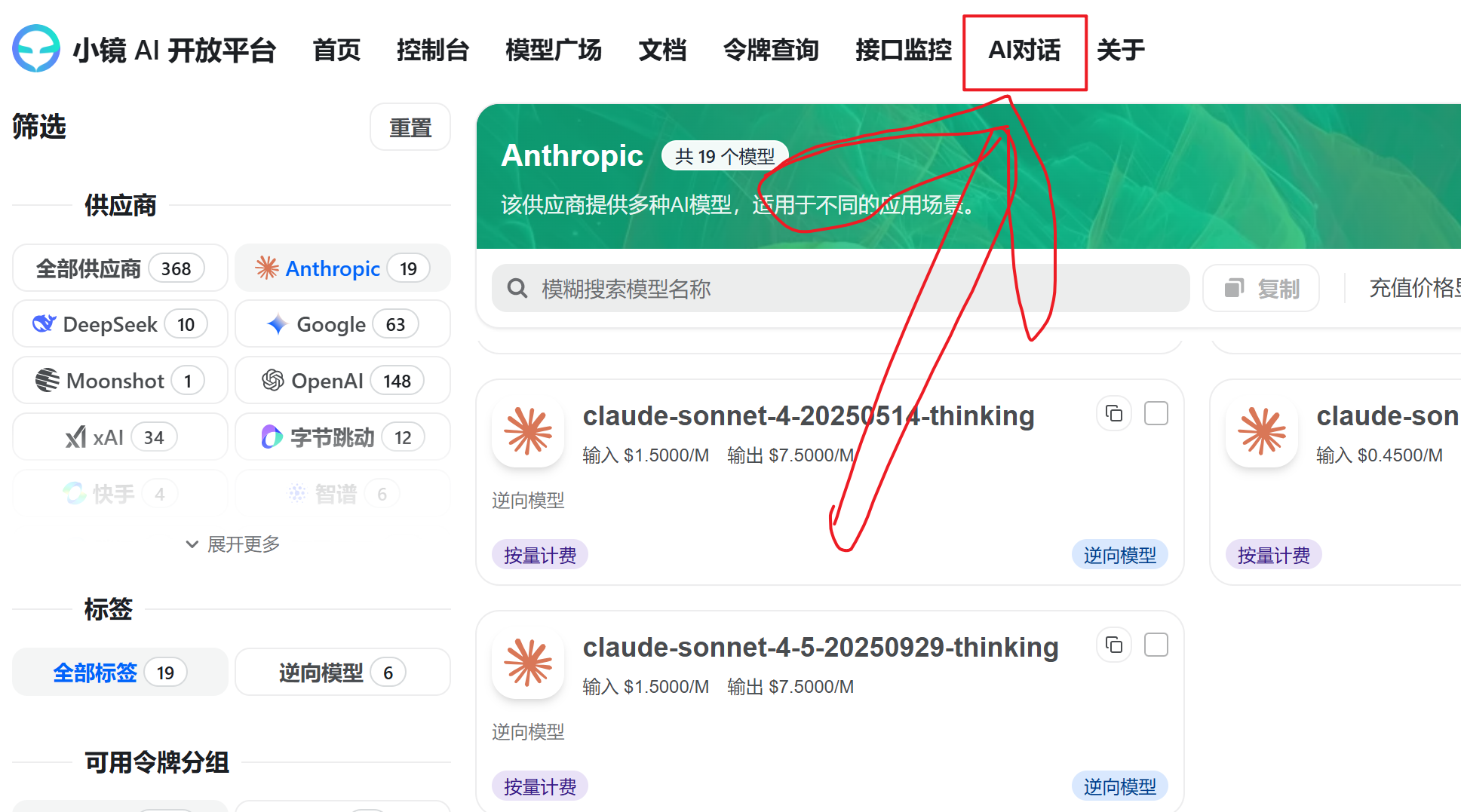

二、开发准备:基础设施选型

为了解决"账号管理难、汇率换算烦、网络不稳定"的痛点,推荐使用小镜 AI 开放平台作为中间件。它提供了兼容 OpenAI 官方 SDK 的接口,无需重构代码。

为什么选择小镜AI开放平台?

- 一站式聚合(All-in-One) :

- 国产模型 :集成

IQuest-Coder-V1、DeepSeek-V2.5。 - 国际大模型 :包含

GPT-4 Turbo、GPT-5.2、claude-sonnet-4-5-20250929-thinking以及Sora-2系列。

- 国产模型 :集成

- 极致的成本控制 :

- 综合调用成本相比官方直连降低约 80%。

- Sora-2 特权:生成失败(如触发风控)自动退回余额,真正零风险。

- 科研级稳定性 :

- 基于华为云/火山引擎/Azure 混合云架构,保障 99.9% 可用性。

- 目前已被中科大、中山大学等科研团队采纳。

三、实战教程:三步对接 Sora-2

第一步:获取 API Key

- 前往 小镜AI开放平台 注册账号。

- 在后台创建 API Key(支持设置额度上限,防止超支)。

- 注:非开发者也可直接在小镜开放平台首页,点击"AI对话",即可体验所有模型。

第二步:选择模型参数

Sora-2 在该平台提供了多种微调版本,以适应不同场景:

| 模型标识 (Model ID) | 描述 | 默认时长 | 推荐场景 |

|---|---|---|---|

sora_video2 |

标准版 | 15s | 通用测试 |

sora_video2-portrait |

竖屏版 | 15s | 抖音/TikTok短视频 |

sora_video2-landscape |

横屏版 | 15s | 影视素材/B站长视频 |

sora_video2-portrait-hd |

竖屏高清 | 15s | 广告投放 |

sora_video2-portrait-hd-15s |

强制15s高清 | 15s | 高质量交付 |

提示 :标准版支持 15s,Pro 版支持 25s(需在 extra_body 中指定

seconds: 25)。

第三步:编写 Python 调用代码

由于平台完全兼容 OpenAI 接口5`)。

第三步:编写 Python 调用代码

由于平台完全兼容 OpenAI 接口规范,我们可以直接使用 openai 库:

python

import os

from openai import OpenAI

# 初始化客户端,替换为小镜AI的 Base URL

client = OpenAI(

api_key="sk-xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx", # 替换你的 Key

base_url="https://api.xiaojingai.com/v1" # 关键配置

)

def generate_sora_video(prompt, model="sora_video2-landscape"):

print(f"正在使用模型 {model} 生成视频...")

try:

response = client.chat.completions.create(

model=model,

messages=[

{

"role": "user",

"content": prompt

}

],

# 如果是 Pro 模型想要生成 25秒,取消下面注释

# extra_body={"seconds": 25}

)

# 成功返回,通常是视频 URL

video_url = response.choices[0].message.content

print(f"生成成功!视频地址: {video_url}")

return video_url

except Exception as e:

print(f"生成失败: {e}")

return None

if __name__ == "__main__":

prompt_text = "一只赛博朋克风格的猫在霓虹灯闪烁的未来城市屋顶上奔跑,4k画质,电影感,雨夜。"

generate_sora_video(prompt_text)四、避坑指南与风控说明

在进行大规模批量生成前,请务必注意以下几点,以免浪费 Token:

- 内容审查机制 :

- API 平台对接了严格的内容风控系统。

- 禁止生成:真人拟真图像(Deepfake风险)、色情、暴力、政治敏感人物。

- 退费保障 :

- 如果在生成进度达到 90% 时因"内容审查"不通过而失败,平台机制会自动回滚消耗的 Token,资金安全有保障。

- Prompt 技巧 :

- 建议使用英文 Prompt 以获得更精准的理解,尽管模型支持中文,但在复杂光影描述上英文表现更佳。

- 结构建议:

主体 + 动作 + 环境 + 风格/光影 + 镜头语言。

五、总结

通过整合 Doubao-Seedream 的图像编辑能力与 **Sora-2 的视频生成能力,开发者可以构建出极具竞争力的 AIGC 应用。借助第三方聚合平台,我们不仅能解决"由于网络原因无法访问"的问题,更能将单个视频的生产成本压缩至 **0.1元 0.5元** 区间,极大降低了试错门槛。

🚀 下一步建议:

先注册获取少量额度,运行上面的 Python 脚本进行一次 Hello World 测试,跑通流程后再集成到业务系统中。

原文链接: https://open.xiaojingai.com/register?aff=xeu4

*著作权归作者有。商业转载请联系作者获得授权,非商业转载请注明出处。*