+----------+-------------+--------+--------+--------+---------------------+---------+---------+---------+

| cyber_id | create_time | data_y | data_m | data_d | full_create_date | data_y1 | data_m1 | data_d1 |

+----------+-------------+--------+--------+--------+---------------------+---------+---------+---------+

| 685133 | 1769272225 | 2026 | 01 | 25 | 2026-01-25 00:30:25 | 2026 | 01 | 25 |

| 685131 | 1769192451 | | | | 2026-01-24 02:20:51 | 2026 | 01 | 24 |

| 685126 | 1769160939 | | | | 2026-01-23 17:35:39 | 2026 | 01 | 23 |

| 685125 | 1769086420 | | | | 2026-01-22 20:53:40 | 2026 | 01 | 22 |

| 685124 | 1769073568 | | | | 2026-01-22 17:19:28 | 2026 | 01 | 22 |

| 685123 | 1768987247 | | | | 2026-01-21 17:20:47 | 2026 | 01 | 21 |

| 685122 | 1768980367 | | | | 2026-01-21 15:26:07 | 2026 | 01 | 21 |

| 685121 | 1768977682 | | | | 2026-01-21 14:41:22 | 2026 | 01 | 21 |

| 685120 | 1768977195 | | | | 2026-01-21 14:33:15 | 2026 | 01 | 21 |

| 685119 | 1768977190 | | | | 2026-01-21 14:33:10 | 2026 | 01 | 21 |

+----------+-------------+--------+--------+--------+---------------------+---------+---------+---------+

未来之窗运维订单表字段补齐操作指南(按年 / 月 / 日维度)

本文针对未来之窗运维订单 表,按照「数据备份→查询验证计算逻辑→单条替换测试→批量更新补齐」的标准化流程,完成data_y(年)、data_m(月)、data_d(日)统计字段的补齐,同时说明各操作步骤的核心重要性,以及年 / 月 / 日字段在统计分析中的关键作用。

一、完整操作步骤(附可直接执行的 SQL)

步骤 1:做好数据备份(不可逆操作的安全底线)

对未来之窗运维订单表进行备份,是所有数据修改操作的前置必备步骤,避免批量更新出错导致数据丢失 / 异常,且无恢复渠道。根据数据量大小,提供 3 种备份方案,按需选择即可。

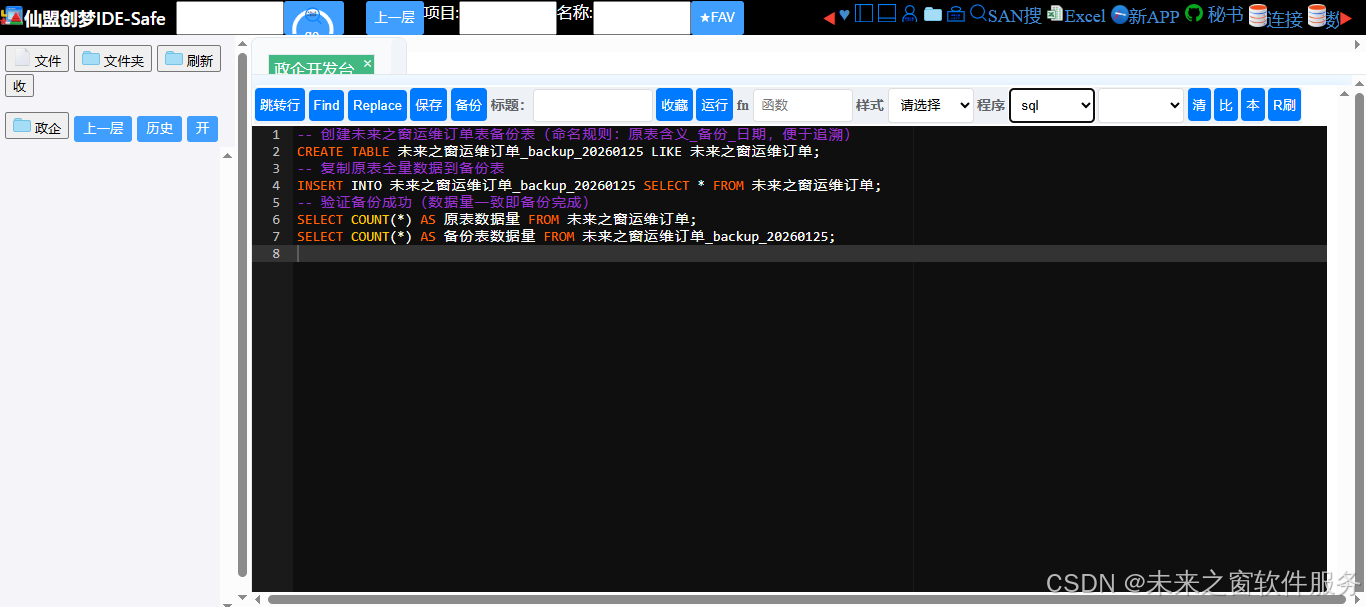

方案 1:整表备份(推荐,数据量适中场景)

创建与原表结构、数据完全一致的备份表,后续可直接从备份表恢复全量数据。

sql

-- 创建未来之窗运维订单表备份表(命名规则:原表含义_备份_日期,便于追溯)

CREATE TABLE 未来之窗运维订单_backup_20260125 LIKE 未来之窗运维订单;

-- 复制原表全量数据到备份表

INSERT INTO 未来之窗运维订单_backup_20260125 SELECT * FROM 未来之窗运维订单;

-- 验证备份成功(数据量一致即备份完成)

SELECT COUNT(*) AS 原表数据量 FROM 未来之窗运维订单;

SELECT COUNT(*) AS 备份表数据量 FROM 未来之窗运维订单_backup_20260125;方案 2:仅备份待更新数据(适合超大规模数据场景)

仅备份需要补齐字段的数据集(create_time > 0),节省存储空间和备份耗时。

sql

-- 创建待更新数据专属备份表

CREATE TABLE 未来之窗运维订单_待更新备份_20260125 AS

SELECT * FROM 未来之窗运维订单 WHERE create_time > 0;

-- 验证备份数据量

SELECT COUNT(*) AS 待更新数据量 FROM 未来之窗运维订单 WHERE create_time > 0;

SELECT COUNT(*) AS 备份待更新数据量 FROM 未来之窗运维订单_待更新备份_20260125;方案 3:导出为 SQL 文件(终端执行,双重保障)

通过mysqldump将表数据导出到本地文件,作为物理备份,适合核心业务数据。

bash

运行

# 格式:mysqldump -u数据库用户名 -p 数据库名 表名 > 备份文件保存路径.sql

mysqldump -uroot -p 你的数据库名 未来之窗运维订单 > ./未来之窗运维订单_backup_20260125.sql步骤 2:查询验证(确保计算逻辑正确,避免更新失真)

先不执行任何更新操作,通过查询验证年 / 月 / 日字段的计算结果 是否符合统计要求(4 位年、2 位月 / 日补 0),确保与create_time时间戳转换后的完整日期完全匹配,从源头规避逻辑错误。

sql

-- 验证查询:核对待更新数据的年/月/日计算结果

SELECT

cyber_id,

create_time,

-- 待写入data_y/data_m/data_d的核心计算逻辑(与后续更新逻辑完全一致)

DATE_FORMAT(FROM_UNIXTIME(create_time), '%Y') AS calc_data_y, -- 4位年

DATE_FORMAT(FROM_UNIXTIME(create_time), '%m') AS calc_data_m, -- 2位月(补0,如1月=01)

DATE_FORMAT(FROM_UNIXTIME(create_time), '%d') AS calc_data_d, -- 2位日(补0,如5日=05)

-- 辅助核对:完整日期时间,用于验证年/月/日的准确性

FROM_UNIXTIME(create_time) AS full_create_date

FROM 未来之窗运维订单

WHERE create_time > 0 -- 仅筛选需要补齐字段的有效数据

ORDER BY cyber_id DESC

LIMIT 200; -- 可扩大条数,多抽样验证核心验证要点

calc_data_y/calc_data_m/calc_data_d需与full_create_date中的年、月、日完全一致;- 月、日必须为2 位补 0 格式(统计场景的标准格式,避免 1/2 位混合导致统计错误);

- 无

NULL值(create_time > 0为有效时间戳,转换后不会出现空值)。

步骤 3:单条替换测试(小范围验证,降低批量风险)

查询验证通过后,禁止直接批量更新,先选取一条具体数据进行单条更新测试,验证更新 SQL 的语法正确性、条件筛选准确性,且仅影响单条数据,即使出错修复成本极低。

sql

-- 步骤3.1:单条更新测试(选取cyber_id=685131作为测试数据,精准限定范围)

UPDATE 未来之窗运维订单

SET

data_y = DATE_FORMAT(FROM_UNIXTIME(create_time), '%Y'),

data_m = DATE_FORMAT(FROM_UNIXTIME(create_time), '%m'),

data_d = DATE_FORMAT(FROM_UNIXTIME(create_time), '%d')

WHERE

create_time > 0 -- 批量更新的核心条件

AND cyber_id = 685131; -- 单条测试专属条件,避免影响其他数据

-- 步骤3.2:验证单条更新结果(核对字段是否成功补齐且数据准确)

SELECT

cyber_id,

create_time,

data_y,

data_m,

data_d,

FROM_UNIXTIME(create_time) AS full_create_date

FROM 未来之窗运维订单

WHERE cyber_id = 685131;测试验证要点

- 执行后数据库返回「受影响行数 = 1」,说明仅更新了目标单条数据;

data_y/data_m/data_d已成功赋值,且与full_create_date的年 / 月 / 日完全匹配;- 若结果不符合预期,直接通过备份表恢复该条数据,修改 SQL 后重新测试即可。

步骤 4:批量替换(最终执行,高效补齐所有数据)

单条测试通过,说明更新逻辑、语法、条件均无问题,此时移除单条筛选条件,执行批量更新,完成未来之窗运维订单表中所有有效数据的年 / 月 / 日字段补齐。

sql

-- 批量更新:补齐所有create_time>0数据的data_y/data_m/data_d字段

UPDATE 未来之窗运维订单

SET

data_y = DATE_FORMAT(FROM_UNIXTIME(create_time), '%Y'),

data_m = DATE_FORMAT(FROM_UNIXTIME(create_time), '%m'),

data_d = DATE_FORMAT(FROM_UNIXTIME(create_time), '%d')

WHERE

create_time > 0; -- 仅更新有效数据,避免更新create_time=0的无效记录

-- 批量更新后验证(抽样查询,确保整体更新效果无异常)

SELECT

cyber_id,

create_time,

data_y,

data_m,

data_d,

FROM_UNIXTIME(create_time) AS full_create_date

FROM 未来之窗运维订单

WHERE create_time > 0

ORDER BY cyber_id DESC

LIMIT 300;批量更新注意事项

- 若表数据量为百万 / 千万级,建议避开业务高峰期执行,避免占用数据库资源影响线上业务;

- 执行后核对「受影响行数」,需与步骤 2 中查询的「待更新数据量」完全一致,避免遗漏更新;

- 若更新后发现异常,立即停止所有操作,通过步骤 1 的备份表全量 / 局部恢复数据,排查问题后重新执行。

二、四步骤的核心重要性(层层递进,全方位规避风险)

针对未来之窗运维订单 表的字段补齐操作,「备份→查询验证→单条测试→批量更新」是数据库批量修改的行业标准化流程,核心是 "从安全到高效、从局部到全局",层层规避数据风险,缺一不可,具体重要性如下:

1. 数据备份:所有操作的 "后悔药"

未来之窗运维订单 表为业务核心表,UPDATE操作无默认回滚机制,一旦批量更新出错(如条件写错、逻辑错误),无备份则数据永久丢失,造成业务统计、订单管理的重大损失。备份是不可逆操作的安全底线,确保任何意外都能快速恢复数据。

2. 查询验证:低成本规避逻辑错误

很多更新出错并非语法问题,而是日期计算逻辑错误(如格式化符号写错、时间戳转换异常)。通过查询验证,在不修改任何数据的前提下,快速发现并修正逻辑漏洞,相比 "更新后发现错误再恢复",成本降低 90% 以上。

3. 单条替换测试:小范围验证整体方案

单条测试是批量更新的 "试金石" ,既验证了更新 SQL 的语法、条件准确性,又仅影响单条数据,即使出错修复成本极低。可有效避免 "漏掉核心条件create_time > 0,导致整张表字段被错误更新" 的严重问题。

4. 批量替换:高效完成目标,且风险可控

前三个步骤已排除 99% 的操作风险,此时批量更新是 "水到渠成" 的操作,既能高效完成未来之窗运维订单表所有数据的字段补齐,又因为有前序的安全保障,即使出现异常也能快速回滚,实现 "效率" 与 "安全" 的平衡。

三、data_y/data_m/data_d 在统计中的核心作用

data_y(年)、data_m(月)、data_d(日)是未来之窗运维订单 表时间维度统计的核心粒度字段 ,相比直接使用create_time时间戳或完整日期字段,在运维订单的统计分析中具备不可替代的价值,核心作用如下:

1. 支撑运维订单的多维度分层统计,满足各类业务需求

运维订单的统计核心是 "按时间聚合分析",年 / 月 / 日字段对应时间的三个核心粒度,可快速满足企业对运维订单的各类统计需求:

- 年度统计 :如 "2025/2026 年运维订单总量对比、年度订单处理效率分析",直接按

data_y分组(GROUP BY data_y),无需额外格式化; - 月度统计 :如 "2026 年每月运维订单增长趋势、各月故障订单占比",按

data_y+data_m分组(GROUP BY data_y,data_m),支持跨年度月度对比; - 日度统计 :如 "2026 年 1 月每日运维订单量、高峰时段订单分布",按

data_y+data_m+data_d分组(GROUP BY data_y,data_m,data_d),支撑精细化运营; - 衍生统计 :结合三个字段可快速实现季度统计(

data_y + LEFT(data_m,1))、周统计(关联日历表)等,满足多样化的业务分析需求。

2. 提升运维订单统计的查询效率,优化数据库性能

- 若直接使用

create_time统计,需对每条记录实时执行DATE_FORMAT格式化操作,属于 "计算型查询",数据量较大时查询速度极慢; data_y/data_m/data_d为预存储的结构化字段,无需实时计算,直接用于分组 / 筛选,查询效率提升数倍甚至数十倍;- 可对三个字段建立联合索引 (

INDEX idx_ymd (data_y,data_m,data_d)),进一步优化大规模统计查询的性能,减少数据库 IO 开销,避免统计操作影响线上订单业务。

3. 简化运维订单统计的业务开发门槛

对于开发人员、数据分析人员而言,直接使用data_y=2026、data_m=01即可筛选目标时间段的运维订单,无需记忆复杂的日期格式化语法、时间戳转换逻辑,简化了统计 SQL 的编写难度,减少了因日期处理失误导致的统计错误,同时方便不同人员之间的需求对接和 SQL 复用。

4. 支撑运维数据的仓库建模与可视化

在企业数据仓库建设中,时间维度表是核心维度表,data_y/data_m/data_d是时间维度的核心字段,可快速与未来之窗运维订单表进行关联,支撑离线统计、运维报表自动生成、数据可视化(如订单趋势大屏)等高级需求,为企业运维决策提供精准、高效的数据支撑。

四、总结

- 针对未来之窗运维订单表的字段补齐操作,必须严格遵循「备份→查询验证→单条测试→批量更新」的标准化流程,层层递进规避数据风险,确保核心业务数据的安全性和准确性;

- 备份是安全底线,查询验证规避逻辑错误,单条测试控制小范围风险,批量更新高效完成目标,四个步骤环环相扣,缺一不可;

data_y/data_m/data_d是运维订单时间维度统计的核心字段,其核心价值是支撑多维度分层统计、提升查询效率、简化业务逻辑,是后续运维订单统计分析、数据仓库建设的基础

阿雪技术观

在科技发展浪潮中,我们不妨积极投身技术共享。不满足于做受益者,更要主动担当贡献者。无论是分享代码、撰写技术博客,还是参与开源项目维护改进,每一个微小举动都可能蕴含推动技术进步的巨大能量。东方仙盟是汇聚力量的天地,我们携手在此探索硅基生命,为科技进步添砖加瓦。

Hey folks, in this wild tech - driven world, why not dive headfirst into the whole tech - sharing scene? Don't just be the one reaping all the benefits; step up and be a contributor too. Whether you're tossing out your code snippets, hammering out some tech blogs, or getting your hands dirty with maintaining and sprucing up open - source projects, every little thing you do might just end up being a massive force that pushes tech forward. And guess what? The Eastern FairyAlliance is this awesome place where we all come together. We're gonna team up and explore the whole silicon - based life thing, and in the process, we'll be fueling the growth of technology