当AI获得"系统权限"安全边界在哪里?

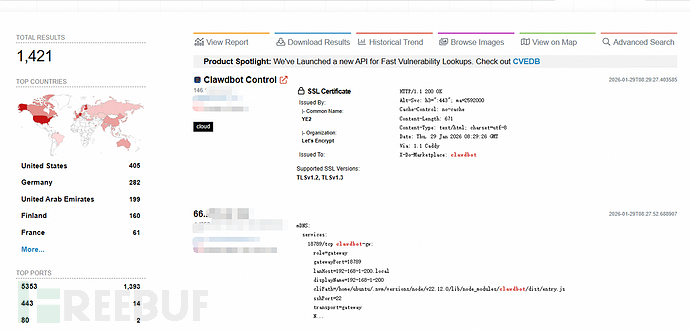

2026年1月Clawdbot(已更名Moltbot)爆火,1月23日安全研究人员于互联网上披露Clawdbot Gateways未授权访问漏洞。目前已发现的包括1000+网关暴露、数百个实例存在未授权访问,API密钥泄露风险等。主要原因是开发者对"易用性"的追求和安全基线缺失之间的矛盾没有做好平衡。

事件全景:Moltbot为何成2026开年安全焦点?

近期在GitHub上爆火的开源项目:星标数一周破9万+!它不是一个简单的聊天机器人,而是一个运行在你本地设备、拥有"手脚"和"记忆"的AI智能体,其所有的记忆和配置以Markdown格式存在本地,保证了数据隐私的同时可以随着本地数据的积累获得更多的能力。

业务便利与安全性在很多时候都是福祸相依的关系,在经历病毒式的火爆传播后,安全问题随之扩散开来。2026年1月23日,大规模暴露确认------安全研究员发现上千个Moltbot(Clawdbot)Gateway实例暴露在公网,其中数百个实例存在未授权访问。

技术剖析:AI获得root权限

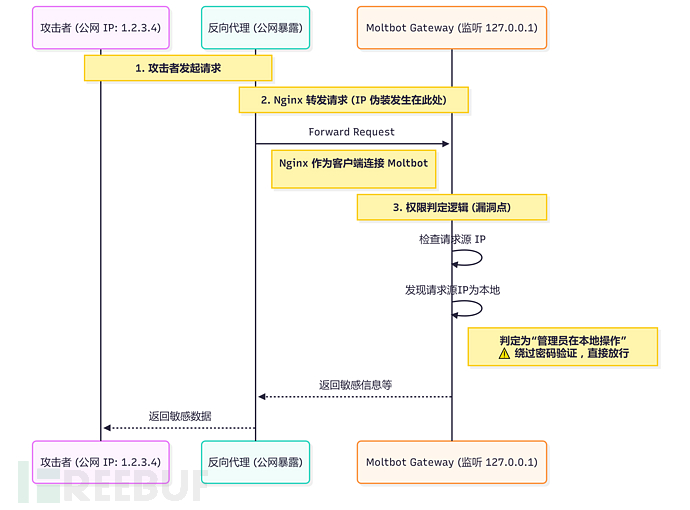

由于Moltbot的网关服务(Gateway)在设计上默认信任本地连接(Localhost),当用户通过反向代理(如Nginx)将其部署时,所有外部请求经代理转发后,源IP均显示为127.0.0.1,导致Moltbot Gateway将互联网流量误判为本地连接,从而攻击者可构造恶意请求绕过身份验证,直接调用Moltbot的相关功能。

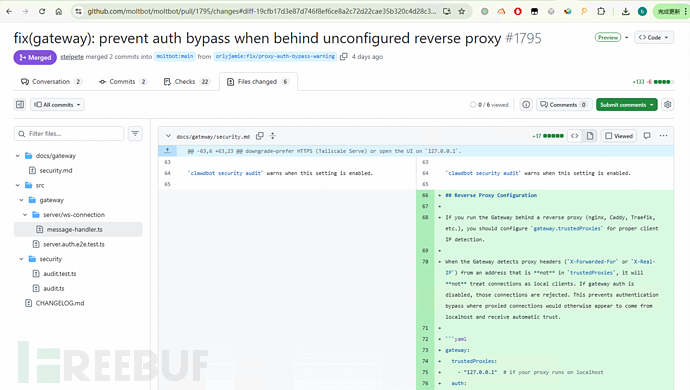

Moltbot官方于2026年1月25日发布相关补丁,修复此漏洞。补丁链接可参考 https://github.com/moltbot/moltbot/pull/1795

风险量化:你的数据正在被谁"看见"?

AI时代,Agent智能体不仅是生产力工具,更是企业内网的新威胁暴露面。

一旦Agent框架/工具(如Moltbot)存在未授权访问漏洞,其风险将从传统的"数据泄露"升级为"系统接管"。攻击者所面对的不只是一个静态数据库或者工具,而是一个拥有高权限、高上下文关联、且具备执行能力的"虚拟雇员"。在此背景下,一旦被攻破,将面临如下的风险:

凭据窃取与信息泄漏

由于Moltbot往往集成有OpenAI、Claude等主流大模型的API Key,以及内网各类数据库、云服务等访问凭据。攻击者获取这些凭据后,可进一步作为跳板进入云端基础设施,实施更大规模的横向移动与资源窃取。

智能体功能劫持与恶意滥用

攻击者可直接接管Moltbot Agent智能体身份,利用其已建立的信任关系向他人发送带有欺骗性的指令或钓鱼链接。由于Agent通常被视为"官方/自动化助手",此类攻击的成功率极高。

任意命令执行

诸如Moltbot等此类高级Agent框架通常具有执行代码的高级权限以解决复杂问题。攻击者可直接操控Agent在服务器上执行任意系统命令,控制承载Agent的服务器。

防护实战:从检测到加固的完整方案

如果您已在阿里云服务器上部署Moltbot(Clawdbot),我们建议您使用云安全中心从资产梳理、风险发现、安全加固和响应处置四个阶段对您的AI服务进行防护。

资产梳理:清点环境中有哪些已部署的Moltbot

**方式一:**资产中心 → 主机资产→ 进程,输入进程名Moltbot(Clawdbot)筛选所已部署服务器

**方式二:**资产中心→ 主机资产→ AI组件→AI工具,输入Moltbot(Clawdbot)筛选所已部署的服务器。

漏洞扫描:发现当前所部署的Moltbot是否存在未授权访问漏洞

方式一:风险治理→ 漏洞管理→ 一键扫描(应用漏洞),扫描后在应用漏洞分类下关注查看漏洞:Moltbot(Clawdbot)Gateways 未授权访问漏洞

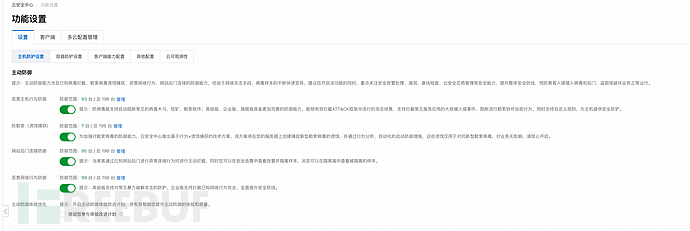

运行时防御:监控"AI服务及资产的异常行为"

1.开启防勒索对重要文件定期备份,以防止重要数据被破坏后无法恢复。

2.开启病毒查杀:周期性对主机文件做扫描,以防止被植入恶意病毒文件。

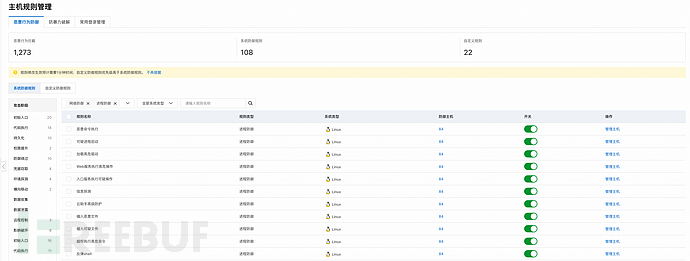

3.主机规则管理:开启所有网络防御和进程防御规则,对攻击者的恶意行为实施拦截防护。

4.核心文件监控:对重要文件配置监控规则,非白名单进程试图读取这些文件时,立即上报告警。

检测分析响应

**安全告警:**云安全中心支持对攻击者的恶意行为实时检测并上报告警,实时感知资产的安全状况。

AI Agent安全治理的"无人区"

AI Agent"自主性"与安全"可控性"的冲突源于安全模型的过时

进入2026年,AI Agent正从"助手"向"数字人"快速演进,Moltbot(Clawdbot)从"一夜爆红"到被揭示存在严重的安全隐患而引发广泛关注,核心冲突在于:Agent自主性被赋予解决复杂问题的能力,但这种"不受控"的行为模式却"天然"挑战着现有的安全体系。

AI Agent的自主性意味着,它能独立完成"规划-工具调用-执行"的闭环。然而,传统安全模型是为人类设计的单点防护的静态机制,无法适应Agent的"机器速度",以及对于多个安全技术层面同时发起的全面挑战。

通过统一的AI安全治理构建"受控的自主"

针对AI Agent的安全风险,补丁式升级已不足以应对。企业真正需要的考虑的是将现有的安全体系转型到面向AI应用(包含Agent)的新的安全框架,从基础网络、供应链、授权、数据到应用以及业务各个层面的全面治理,实现统一的AI安全管理。