LangSmith 是一个用于构建生产级 LLM 应用程序的平台。 它允许使用者调试、测试、评估和监控基于任何 LLM 框架构建的链和智能代理,并无缝集成 LangChain(用于构建 LLM 的首选开源框架)。

一、注册与登录

登录 https://smith.langchain.com/ 可以直接用Discord、GitHub、Google账号登录,也可以用自己邮箱注册。现在已经不需要邀请码。

二、环境配置

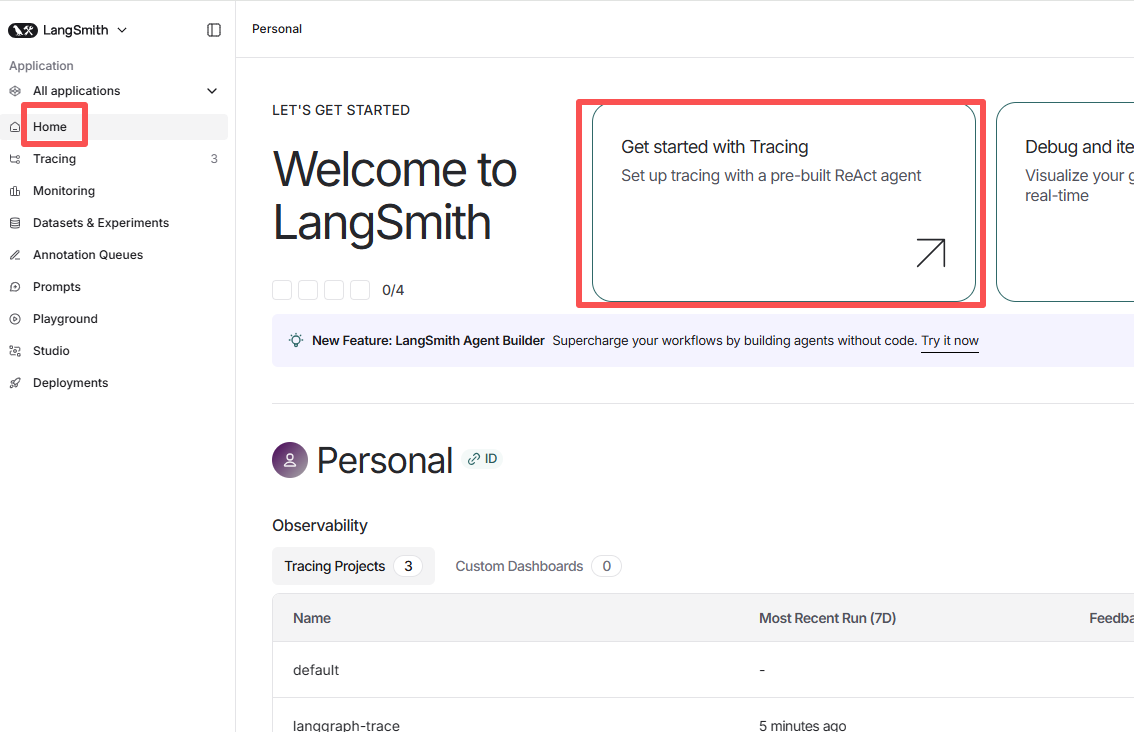

LangSmith的节目也有过多次改版,现在直接在初学者节目就能直接生成API Key了。

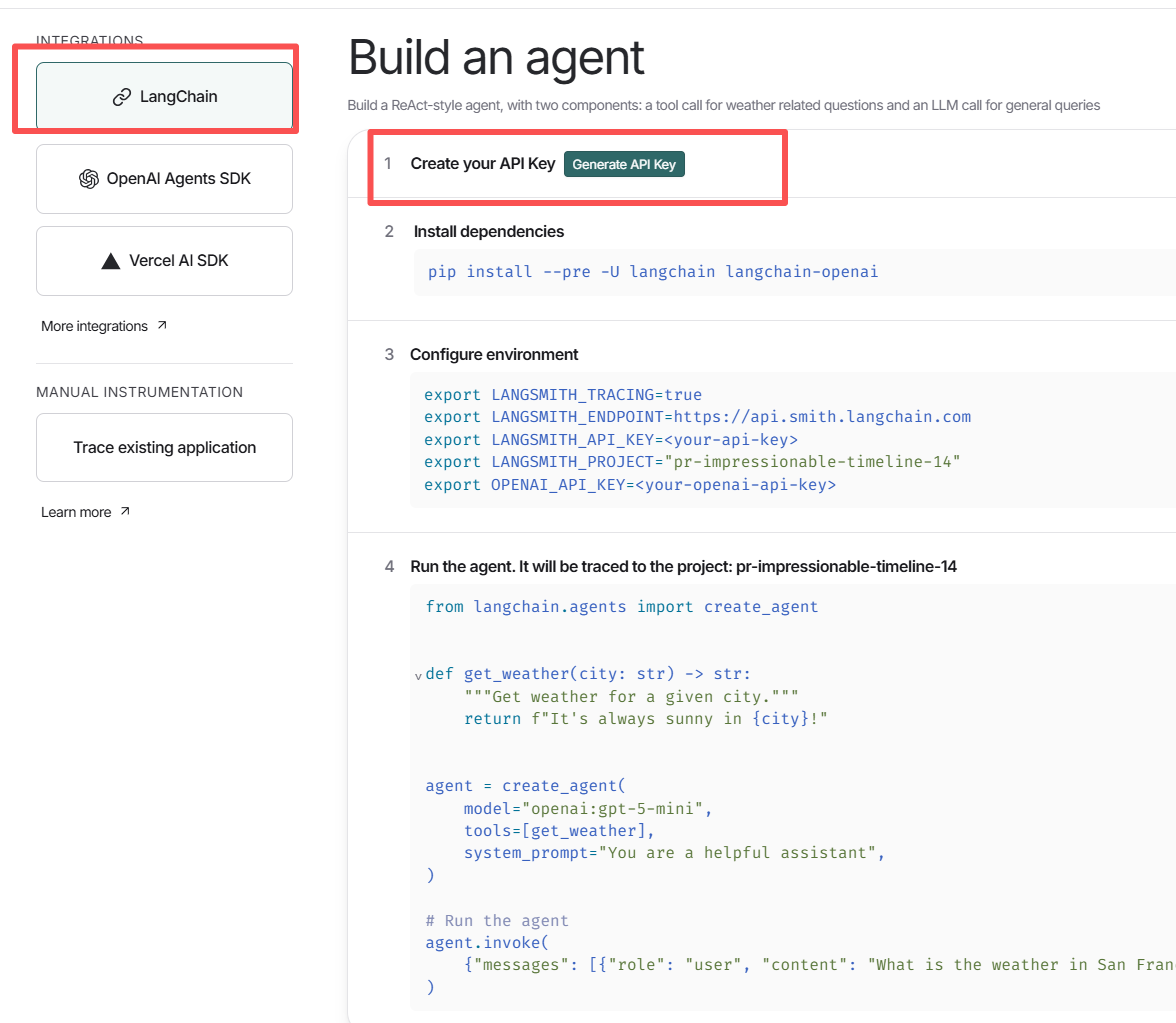

1. 生成API Key

2. 配置环境变量

如果是Linux环境就按照上图指南上来用export命令,如果是Windows PowerShell就如下:

setx LANGSMITH_TRACING true

setx LANGCHAIN_ENDPOINT "https://api.smith.langchain.com"

setx LANGSMITH_API_KEY ******

setx LANGSMITH_PROJECT langgraph-trace

setx OPENAI_API_KEY *****其中LANGSMITH_API_KEY 就是上一步生成的API Key, OPENAI_API_KEY 是大模型的Key, 比如千问的Key,PROJECT名字可以自己随便取。

对于workspace, 设置环境变量的LANGSMITH_PROJECT ,LangSmith控制台的Project,实际运行的PROJECT三者的区别下文会介绍。

⚠️ 注意: powershell需要重启后,配置才会生效哦。

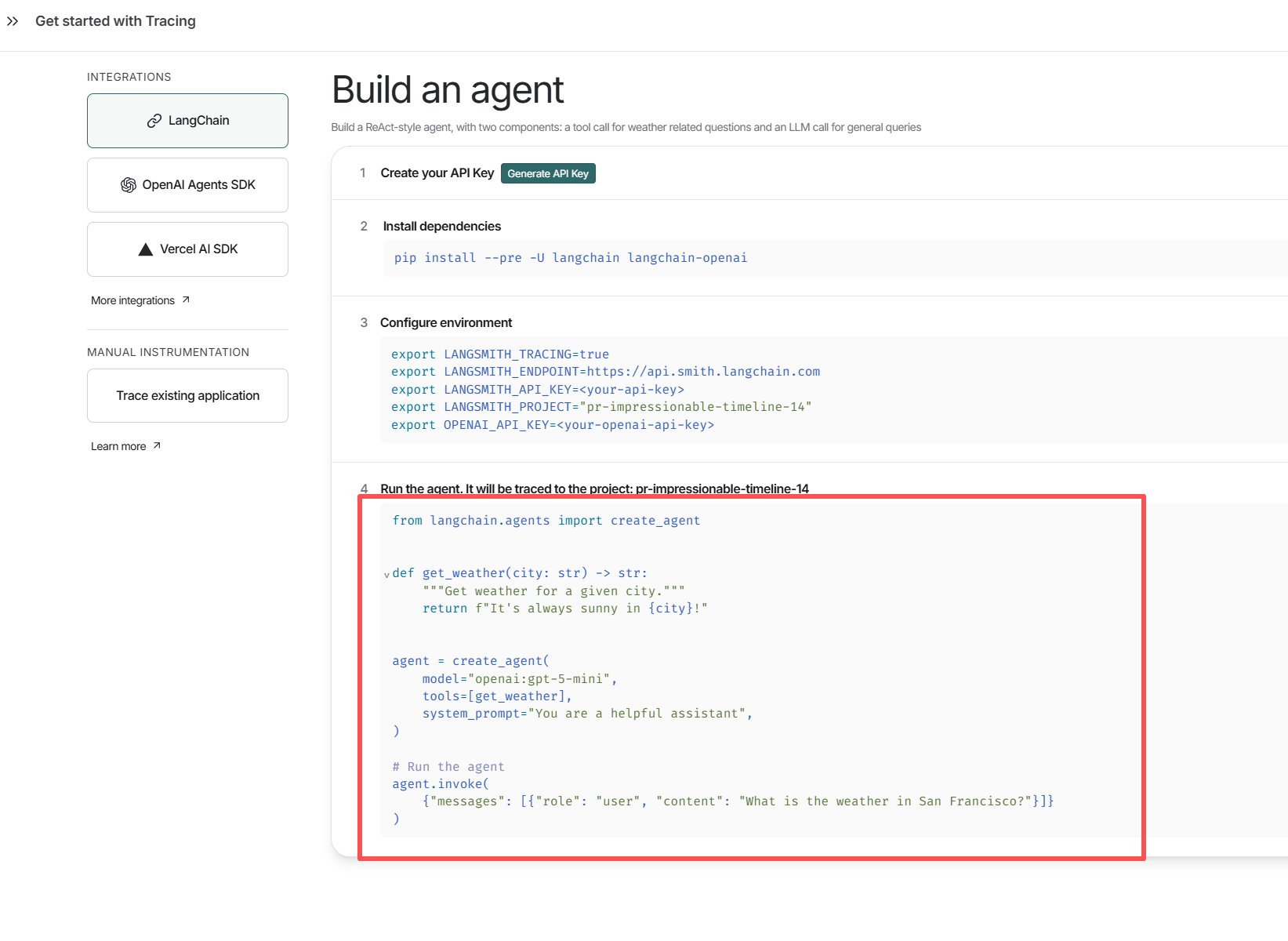

3.运行agent,这个也可以用指南里的示范代码

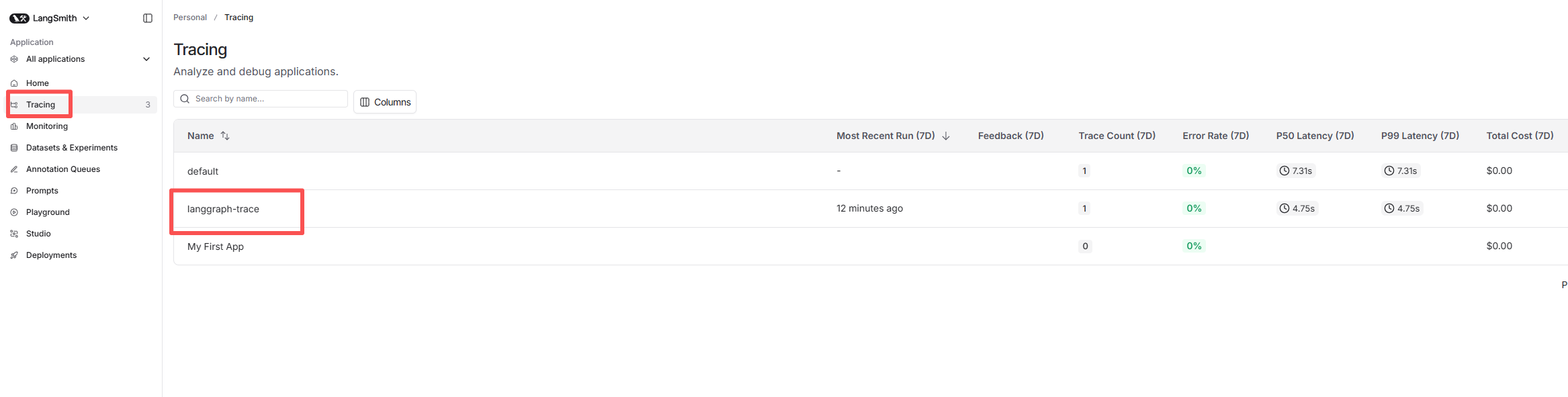

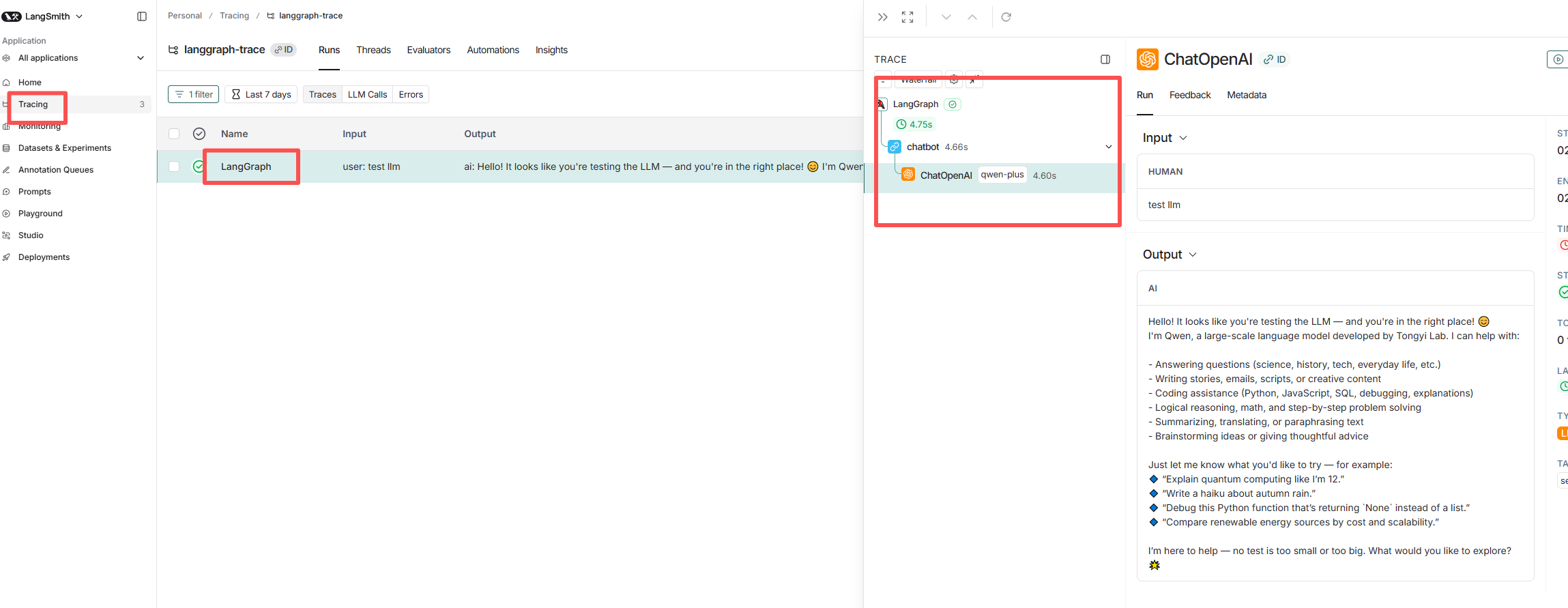

4.查看langSmith trace跟踪

三、Workspace / Project / 本地 LANGCHAIN_PROJECT 这三者的关系

1. Workspace(LangSmith 上的 Workspace)

这是 LangSmith 里的"组织/空间",类似GitHub 的 organization、Notion 的 workspace。一个账号可以有多个 Workspace,API Key 是 绑定在 Workspace 下的。

2. LangSmith 上的 Project

Project 是 Workspace 里的一个逻辑分组,用来区分不同应用 / 实验 / 服务。比如你可以有:

Workspace: my-team

├─ project: langgraph-demo

├─ project: agent-weather

├─ project: llm-prod-chatbot

👉 LangSmith 页面左侧Tracing点开后,看到的 Projects 列表,就是这个。

3. 环境变量的LANGCHAIN_PROJECT(你本地设置的)

setx LANGCHAIN_PROJECT langchain_for_llm_application_development

它的含义是:

告诉 LangChain / LangGraph:

"把这次运行的 trace 归类到哪个 Project 里"

⚠️ 重要的是:

如果这个 Project 不存在

👉 LangSmith 会 自动帮你创建,不需要你提前手动建。

⚠️ 所以其实 LangSmith 上的 Project和环境变量的LANGCHAIN_PROJECT是一致的,如果你已经在LangSmith上有这个Project,那么会归类到里面,如果没有,LangSmith会帮你新建。

4、 本地代码的Project名字

LangSmith并不关心你本地代码的Project名字,你可以起任何名字。

👉 比如你本地是:D:\code\agentDemo\,LangSmith 完全不在意。

它只看:LANGCHAIN_PROJECT=xxx

👉 如果我随便写一个名字会怎样?

setx LANGCHAIN_PROJECT my_test_123

结果是:

LangSmith Workspace 下会自动出现一个新的 Project:my_test_123,所有 trace 都进这个 Project

👉 一个非常推荐的命名实践

推荐规则

LANGCHAIN_PROJECT = 应用名 / 服务名 / 实验名

例如:setx LANGCHAIN_PROJECT langgraph-chatbot

四、 注意事项

如果你是在windows上运行这个智能体,那么区分开powershell运行和pycharm运行。

- 如果你用powershell运行,配置环境变量后,记得重启powershell使其生效,并且之后请继续在powershell里运行python脚本,例如Python ./agentDemo.py。

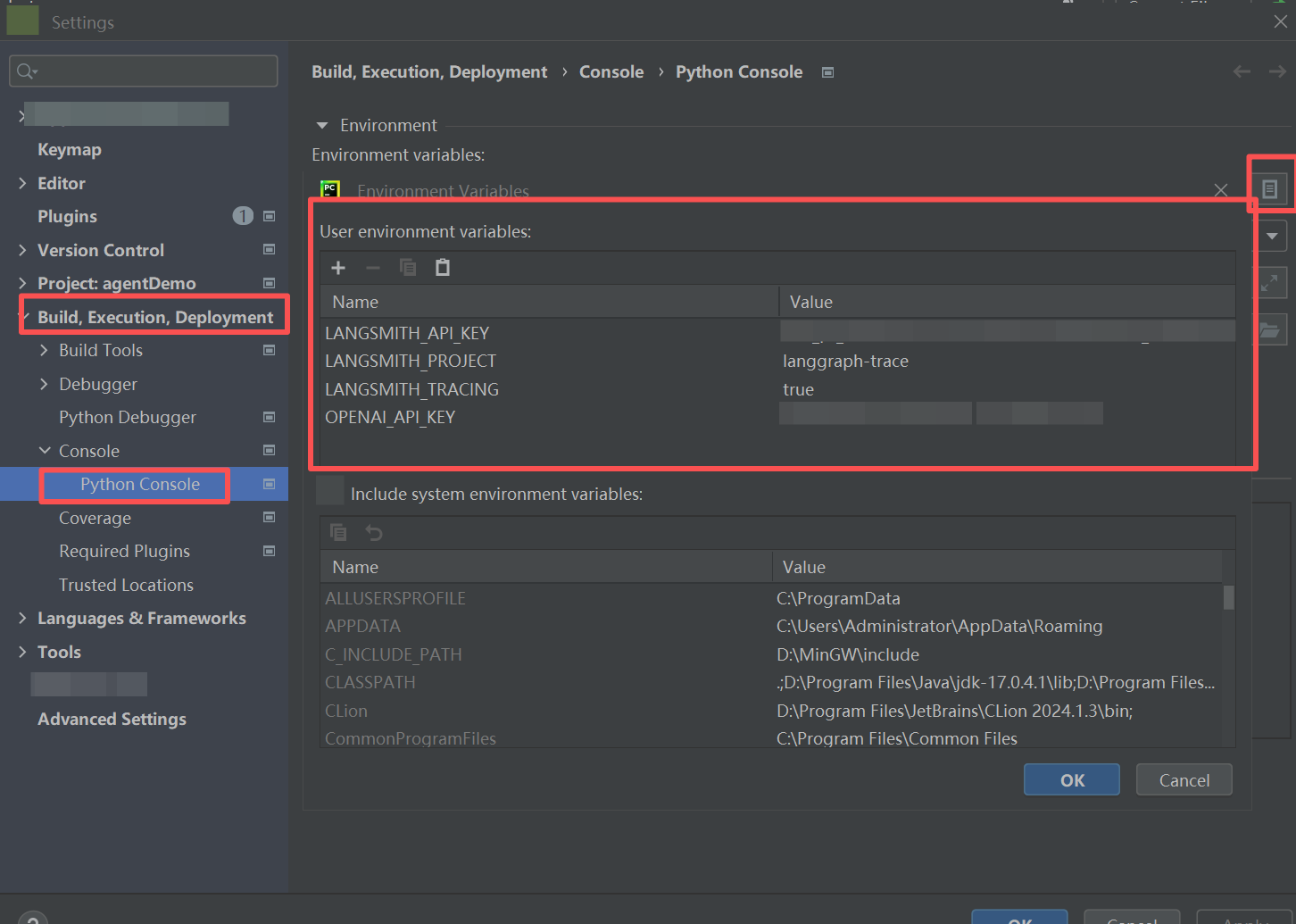

- 如果你用pycharm运行,那么请在pycharm里配置环境变量。

- File → Settings(或按 Ctrl + Alt + S )

- 导航到:Build, Execution, Deployment → Console → Python Console

- 在 Environment variables 中添加变量

- 点击 OK

同样记得重启pycharm使其生效,然后再在pycharm里点击运行脚本。

⚠️ 切记,不要用powershell设置环境变量,然后再在pycharm里运行,亲测不行。 反之亦然