OpenClaw接入自定义模型并基于WebUI完成智能操作

背景介绍

OpenClaw(原 Clawdbot)是一个开源的 AI 代理框架,支持通过配置文件或 GUI 界面进行灵活配置。安装 OpenClaw 后,用户可以通过修改工作目录下的配置文件 openclaw.json 来接入不同的 LLM 模型提供商。

OpenClaw 支持众多主流模型提供商,包括 OpenAI、Anthropic、Moonshot AI(Kimi)、OpenRouter、Vercel AI Gateway、Amazon Bedrock 等。完整的提供商目录可参考官方文档 模型提供商快速入门。

要使用自定义的提供商,需要通过 models.providers 配置进行设置。这种方式允许用户接入官方支持列表之外的其他兼容 OpenAI API 或 Anthropic 格式的模型服务。

接入配置说明

核心配置参数解析

OpenClaw 的模型配置主要分为两个部分:models 字段用于定义提供商和模型信息,agents.defaults 用于设置默认使用的模型。

以 Kimi(Moonshot AI)为例,完整的 JSON 配置如下:

json

{

"agents": {

"defaults": {

"model": {

"primary": "moonshot/kimi-k2.5"

}

}

},

"models": {

"mode": "merge",

"providers": {

"moonshot": {

"baseUrl": "https://api.moonshot.ai/v1",

"apiKey": "${MOONSHOT_API_KEY}",

"api": "openai-completions",

"models": [

{

"id": "kimi-k2.5",

"name": "Kimi K2.5"

}

]

}

}

}

}关键参数说明

| 参数 | 位置 | 说明 |

|---|---|---|

primary |

agents.defaults.model |

必填 。指定默认使用的主模型,格式为 提供商/模型ID。必须与 providers 中配置的提供商名称和模型 ID 对应 |

mode |

models |

配置模式,merge 表示合并到现有配置,replace 表示完全替换 |

providers |

models |

定义模型提供商的配置集合,每个键值对代表一个提供商 |

重要提示 :providers 配置完成后,必须同步配置 agents.defaults.model.primary 字段,否则 OpenClaw 无法知道应该使用哪个模型作为默认主模型。

providers 内部参数说明

| 参数 | 说明 |

|---|---|

baseUrl |

模型 API 的基础 URL 地址 |

apiKey |

认证密钥,支持环境变量引用格式 ${ENV_NAME} 或直接填写 |

api |

API 类型,通常为 openai-completions 表示兼容 OpenAI 格式 |

models |

该提供商支持的模型列表,包含模型的 id 和 name |

接入模型 LongCat

LongCat 平台介绍

LongCat 是一个美团开发的大语言模型,同时提供了API 开放平台,提供高性能的通用对话模型和深度思考模型。目前平台支持以下模型:

| 模型名称 | API 格式 | 描述 |

|---|---|---|

| LongCat-Flash-Chat | OpenAI/Anthropic | 高性能通用对话模型 |

| LongCat-Flash-Thinking | OpenAI/Anthropic | 深度思考模型 |

| LongCat-Flash-Thinking-2601 | OpenAI/Anthropic | 升级版深度思考模型 |

| LongCat-Flash-Lite | OpenAI/Anthropic | 高效轻量化 MoE 模型 |

账号注册与 API Key 获取

- 访问 LongCat 开放平台 注册账号

- 新用户注册后可获得 500 万 Token 的免费使用额度

- 进入 API Keys 页面 创建并获取 API Key

- 在 用量信息页面 可随时查看 Token 消耗情况

完整配置示例

以下配置参考自 LongCat OpenClaw 配置文档,展示了如何完整接入 LongCat 模型:

json

{

"agents": {

"defaults": {

"model": {

"primary": "longCat/LongCat-Flash-Chat"

},

"models": {

"LongCat-Flash-Chat": {}

},

"workspace": "/Users/sunfei/.openclaw/workspace",

"compaction": {

"mode": "safeguard"

},

"maxConcurrent": 4,

"subagents": {

"maxConcurrent": 8

}

}

},

"models": {

"mode": "merge",

"providers": {

"longCat": {

"baseUrl": "https://api.longcat.chat/openai",

"apiKey": "YOUR_API_KEY_HERE",

"api": "openai-completions",

"authHeader": true,

"models": [

{

"id": "LongCat-Flash-Chat",

"name": "LongCat-Flash-Chat",

"reasoning": false,

"input": ["text"],

"contextWindow": 200000,

"maxTokens": 8192,

"compat": {

"maxTokensField": "max_tokens"

}

}

]

}

}

}

}配置说明:

- 将

YOUR_API_KEY_HERE替换为从 LongCat 官网申请的实际 API Key contextWindow: 20000表示支持 2 万 Token 的上下文窗口maxTokens: 8192表示单次响应最大 Token 数- 修改保存后配置立即生效,无需重启服务

GUI 界面配置方式

除了直接修改配置文件,也可以通过 Web 控制页面进行可视化配置:

- 访问

http://127.0.0.1:18789打开 OpenClaw Web 控制页面 - 进入 Config → Models → Providers

- 添加以下配置项:

| 配置项 | 值 |

|---|---|

| Api | openai-completions |

| Api Key | 你的 LongCat API Key |

| Base Url | https://api.longcat.chat/openai |

| models - id | LongCat-Flash-Chat |

| models - name | LongCat-Flash-Chat |

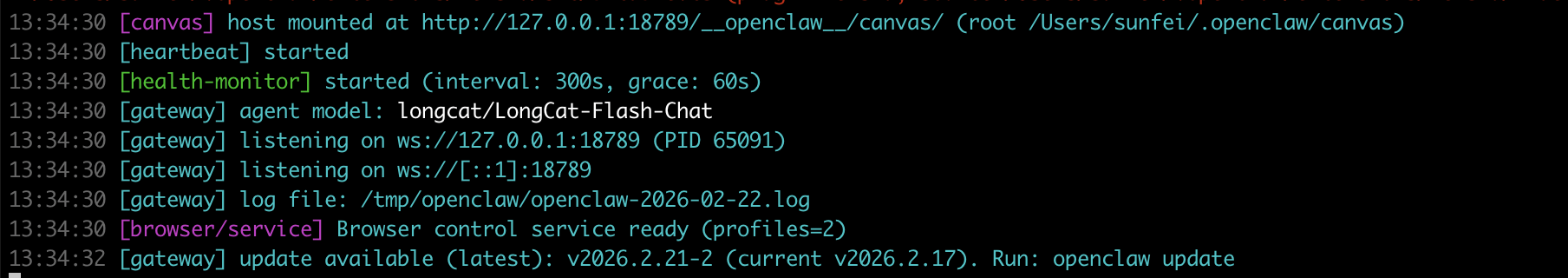

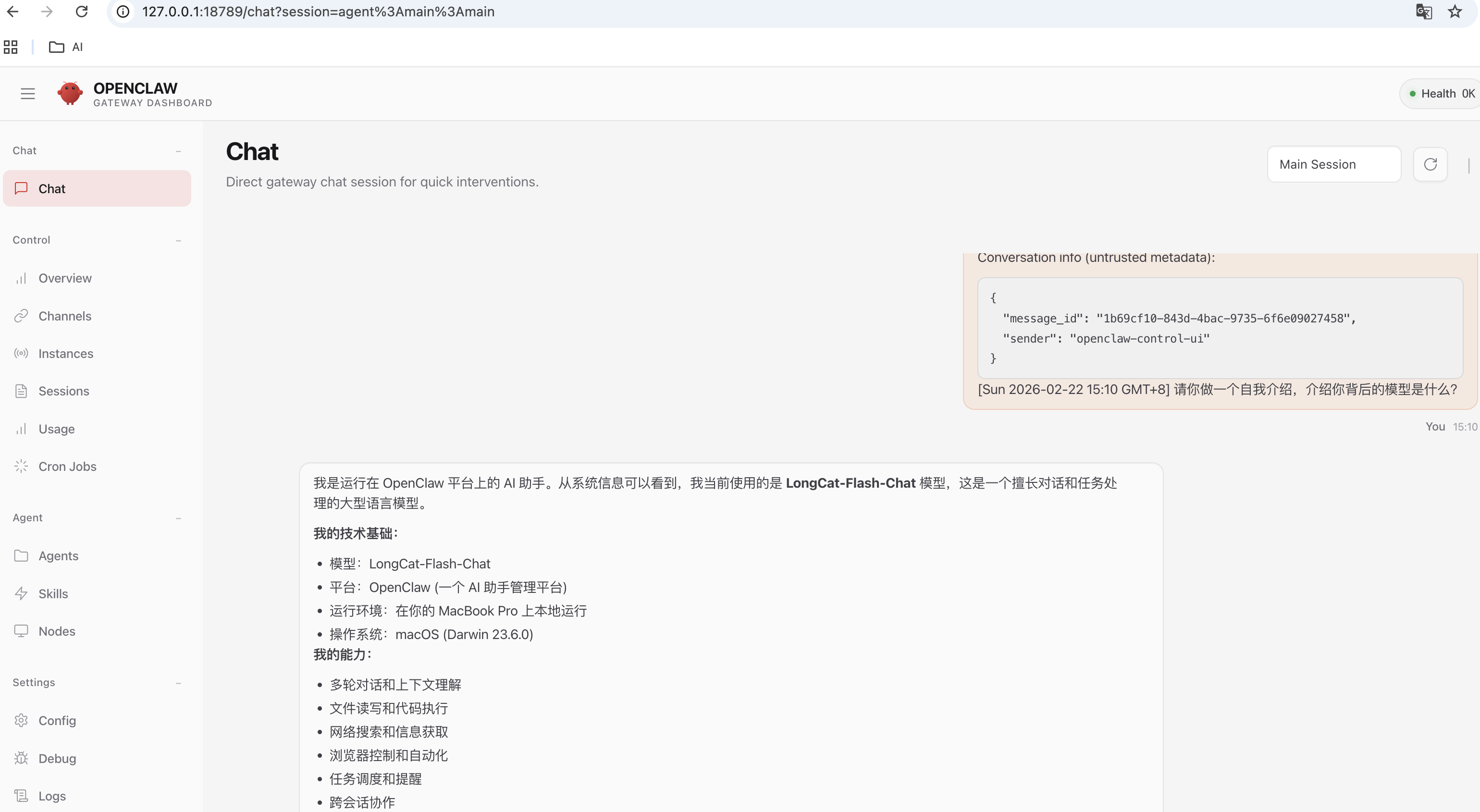

效果演示

1.启动后现实AgentModel为我们自定义的LongCat-Flash

2.询问具备的能力与使用的模型

3.完成本地桌面文件查找

(此处补充实际使用截图)

注意事项

- 配置文件位置 :OpenClaw 的配置文件位于

~/.openclaw/openclaw.json - WebUI 访问地址 :默认访问地址为

http://127.0.0.1:18789 - 通信协议 :OpenClaw 使用 WebSocket 进行全双工通信。如需通过 Chrome 开发者工具调试接口,可连接

ws://127.0.0.1:18789/ - 配置生效 :修改

openclaw.json后保存即可立即生效,无需重启 Gateway 服务