分布式服务架构下的混沌工程实践是一个复杂且系统性的过程。它不仅涉及技术层面的故障注入和监控验证,还需要跨团队的协作和文化认同。

1. 核心指导原则

分布式架构下的故障注入(混沌工程)通常遵循以下流程:

- Steady State(稳态):定义系统正常运行时的关键指标(如 QPS、错误率)。

- Hypothesis(假设):基于业务和架构图,预测注入故障后的系统行为(如"服务降级应触发降级限流")。

- Inject(注入):在可控范围内注入故障(CPU 飙升、网络丢包、服务杀死)。

- Learn(学习):观察监控告警、日志和业务影响,验证假设成立与否

2 落地执行

在分布式环境中,(故障注入)混沌工程主要聚焦在以下四个维度:

(1) 业务链路容错验证:验证单个微服务故障或延迟是否会导致级联故障。

场景:模拟 Service A 调用 Service B 时的网络超时或 B 实例宕机。

目的:确保调用方(Service A)能够快速失败(Fast Fail)并进行降级,避免线程堆积导致全局卡顿。

实践:注入 600ms 的数据库延迟,观察服务限流和监控告警是否如预期触发。

(2) 基础设施弹性验证

分布式系统依赖底层云原生资源(如消息队列、分布式缓存)。

场景:模拟 Kafka broker 故障、Redis 集群网络分区、磁盘 I/O 过高。

目的:验证 PaaS 层面的容错能力,例如流量自动路由、自动故障转移。

实践:对消息队列注入高延迟或丢包,验证消费端是否存在消费堆积和告警延迟。

(3) 流量治理验证

分布式系统往往需要流量调度和分片。

场景:模拟流量切换、灰度发布失败、网关超载。

目的:验证流量调度系统(如 Istio、Nginx Ingress)在压力下的路由策略是否生效。

实践:在网关注入 CPU 飙升,观察流量是否被自动切换至备机。

(4) 监控告警链路验证

确保监控系统的准确性是混沌工程的前提。

场景:注入假设故障(如内存泄漏)。

目的:验证监控系统能否实时捕获异常,告警能否送达对应责任人,是否存在告警误报或漏报。

实践:故障注入后查看监控曲线和钉钉/飞书告警,确保告警信息准确

3 工具结合

工具选择:阿里开源了 ChaosBlade 工具,支持注入 CPU、内存、网络等故障。

案例 1:监控告警验证

实验:对 MySQL 查询注入 600ms 延迟。

预期:慢 SQL 数量激增,监控告警触发。

结果:验证了监控系统对延迟的敏感度和告警流程。

案例 2:实例隔离验证

实验:对 Provider 服务的一个实例注入延迟。

预期:Consumer 服务的 QPS 下降但不至于挂掉。

结果:验证了负载均衡策略能否剔除异常实例。

(2) 平安银行的金融级实践

在金融级分布式系统(如信用卡核心系统)中,混沌工程还强调了合规性:

阶段划分:

第一阶段:验证系统和 PaaS 组件的健壮性。

第二阶段:关注运维团队的应急响应能力。

核心目标:不仅要发现系统技术问题,还要优化运维流程,确保在故障发生时能够快速定位和恢复

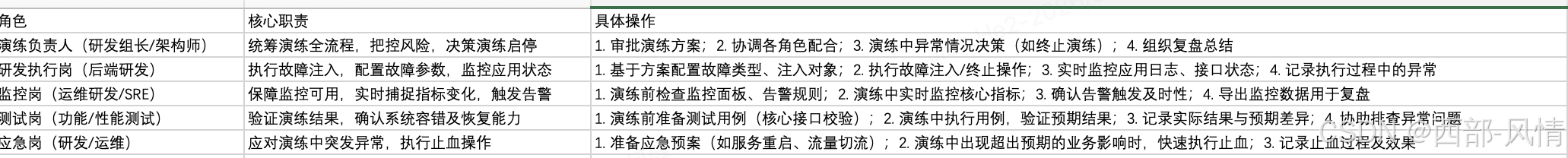

4 角色与职责

5 执行步骤

第1步:演练前置准备

-

明确演练目标

-

聚焦具体场景,避免模糊化(例:验证user-service单实例宕机后,负载均衡是否正常切流;验证Redis阻塞时,接口降级是否生效);

-

明确预期结果(例:单实例宕机后,核心接口QPS无明显下降,错误率<0.5%;Redis阻塞后,降级接口响应时间≤500ms);

-

同步演练范围(明确注入对象、环境、流量占比,禁止涉及生产核心链路)。

-

故障方案设计

-

确定故障类型

-

应用层:接口超时(100ms/500ms/1s)、进程Kill、接口返回异常(500/404)、熔断触发;

-

中间件层:MySQL慢查询、Redis阻塞/连接打满、MQ消息堆积/消费者停摆、Nacos注册中心异常;

-

资源层:CPU 100%、内存OOM(模拟)、磁盘使用率90%+、网络丢包(5%/10%)、网络延迟(100ms/500ms);

-

云原生层(如有):Pod删除、Node不可用、Deployment扩容失败。

-

配置故障参数(明确可落地,避免模糊):

-

注入对象:指定具体服务、实例IP、接口路径、中间件节点(例:user-service 10.0.0.1实例,/api/user/info接口);

-

注入强度:分阶段设置(例:网络丢包先5%,观察5分钟,再提升至10%);

-

注入时长:单场景5-10分钟,全流程不超过30分钟;

-

恢复方式:优先自动恢复(配置故障过期时间),备用人工一键终止(预留操作入口)。

-

评审方案:负责人组织研发、监控、测试岗评审,重点检查"爆炸半径是否可控、恢复方式是否可靠、监控是否覆盖"。

-

前置检查(各岗位分工执行,负责人验收):

-

研发岗:检查故障注入工具可用性(ChaosBlade/ChaosMesh/内部平台),配置好故障参数并测试(确保能正常注入/终止);检查目标服务、中间件运行正常,无前置异常;

-

监控岗:检查核心指标监控面板(QPS、错误率、P95/P99耗时、资源负载、熔断次数),确保数据正常采集;检查告警规则(对应故障场景的告警阈值、接收人),测试告警可达性(短信/企业微信);

-

测试岗:准备核心接口测试用例(手动/自动化),确认测试环境可正常访问,能快速验证接口状态;

-

应急岗:确认应急预案可用(如服务重启脚本、流量切流配置、中间件主从切换步骤),备用资源就绪(如备用实例)。

-

通知同步:演练前30分钟,同步所有参与角色,明确演练开始时间、执行步骤、应急联系人;通知测试环境运维,避免误判为真实故障。

第2步:故障注入执行

- 演练启动:负责人确认所有准备工作完成后,下达"开始演练"指令,研发岗记录启动时间(精确到秒)。

- 分阶段注入故障

- 阶段1:最小强度注入(例:单实例、5%流量、低强度故障),注入后观察2-3分钟,确认无超出预期的业务影响;

- 阶段2:逐步提升强度(如扩大流量占比、提升故障等级),每提升一次,观察1-2分钟,同步记录参数调整及系统状态;

- 操作规范:每次注入/调整参数后,截图留存操作记录(如故障配置页面、注入成功提示);禁止擅自修改未审批的故障参数。

- 实时监控与记录:

- 研发:实时查看目标服务日志、进程状态、接口调用情况,记录异常信息(如接口报错、服务宕机);

- 监控:实时监控核心指标变化,截图留存监控曲线(故障前、故障中、故障后),记录告警触发时间、告警内容;

- 测试:每阶段故障注入后,执行测试用例,验证接口状态、业务流程,记录实际结果与预期结果的差异;

- 应急:全程待命,若出现超出预期的异常(如错误率>5%、核心接口不可用、影响测试环境其他服务),立即上报负责人,按预案执行止血操作。

- 故障终止与恢复(研发岗操作,负责人确认):

- 正常终止:单场景演练完成(达到预设时长),研发岗执行故障终止操作,记录终止时间;确认系统自动恢复,若未自动恢复,手动执行恢复操作(如重启服务、清理故障配置);

- 紧急终止:演练中出现重大异常,负责人下达"紧急终止"指令,研发岗立即终止故障注入,应急岗执行止血操作,快速恢复系统;

- 恢复验证:系统恢复后,测试岗执行核心用例,监控岗确认指标回归正常,研发岗确认服务、中间件运行正常,所有角色签字确认恢复完成。

第3步:演练后复盘与改进

-

数据整理

-

研发:提交故障注入操作记录、异常日志截图、故障恢复过程记录;

-

监控:提交监控指标截图、告警记录(触发时间、响应时间)、监控数据报表;

-

测试:提交测试用例执行结果、实际与预期差异记录;

-

应急:提交应急止血操作记录、止血效果评估。

-

复盘会议

-

复盘内容:

-

演练目标达成情况(哪些场景通过,哪些未通过,原因是什么);

-

执行过程中的问题(如故障注入失败、监控告警延迟、应急操作不熟练);

-

系统暴露的隐患(如接口无熔断、中间件无冗余、负载均衡配置不合理);

-

各角色职责履行情况(是否有遗漏、配合是否顺畅)。

-

会议要求:明确问题责任人、改进措施、完成时限,全程记录复盘纪要(可作为研发团队培训材料)。

-

优化落地(研发岗主导,责任人推进):

-

系统层面:针对暴露的隐患,完成优化(如新增接口熔断配置、调整中间件冗余、优化负载均衡策略);

-

流程层面:针对执行过程中的问题,优化本SOP(如补充故障注入工具操作细节、调整前置检查清单);

-

能力层面:针对应急操作不熟练、监控配置不合理等问题,组织专项培训(如故障应急演练、监控工具使用培训);

-

验证闭环:优化完成后,需通过小型故障注入演练验证效果,确保问题彻底解决,形成闭环记录。

-

文档归档:将演练方案、执行记录、监控截图、复盘纪要、优化记录等所有材料归档(研发团队共享文件夹),便于后续追溯、复用。

6 核心规范与风险控制

6.1 核心操作规范

-

环境规范:所有故障注入演练仅允许在测试、预发环境执行,禁止任何未授权的生产环境演练;预发环境演练需提前1天通知运维团队,做好隔离。

-

工具规范:优先使用公司内部认证的故障注入工具(如内部混沌平台),未认证工具禁止使用;使用开源工具(ChaosBlade/ChaosMesh)时,需由运维研发岗确认安全性,避免工具本身导致系统故障。

-

记录规范:演练全流程需留痕,包括操作记录、监控截图、异常记录、复盘纪要,所有记录需清晰、可追溯(便于后续审计、复用)。

-

强度规范:故障注入需分阶段逐步提升强度,禁止一次性注入高强度故障(如全集群宕机、100%网络丢包),避免测试环境整体崩溃。

6.2 风险控制措施

-

前置风险规避:演练前必须完成监控检查、应急预案准备,明确爆炸半径,禁止演练核心支付、用户登录等影响业务数据的链路。

-

过程风险控制:演练中安排专人实时监控,一旦出现超出预期的异常(如错误率骤升、服务大面积宕机),立即终止故障,执行止血操作,降低影响范围。

-

恢复风险控制:故障终止后,必须验证系统完全恢复(指标回归正常、接口可用、业务流程无异常),避免遗留故障影响后续测试、研发工作。

-

责任追究:若违反本SOP,擅自操作、违规注入故障,导致测试/预发环境崩溃、业务数据异常,将追究相关责任人责任。

7 常用工具操作指引

7.1 ChaosBlade(开源常用,研发可直接操作)

-

工具部署:提前在测试环境目标机器上部署ChaosBlade(参考官方文档,简化部署命令:curl -sSL https://blade.newkitchen.cn/install.sh | bash);

-

常用故障注入命令(直接复制修改参数即可):

-

接口超时:blade create http delay --time 500 --url /api/user/info(注入500ms超时,指定接口);

-

CPU满载:blade create cpu fullload --duration 600(CPU 100%,持续10分钟);

-

进程Kill:blade create process kill --process-name java --signal 9(Kill Java进程);

-

网络丢包:blade create network loss --percent 10 --interface eth0(网卡eth0,丢包10%);

-

终止故障:blade destroy <故障ID>(故障ID可通过blade status查询)。

-

注意事项:执行命令前,确认目标机器、进程、接口正确;终止故障后,检查进程、网络是否恢复正常。

7.2 内部混沌平台(优先使用,更贴合公司业务)

-

操作步骤:登录平台 → 选择演练环境 → 新建演练任务 → 配置故障类型、注入对象、参数 → 提交任务 → 启动演练 → 实时监控 → 终止演练;

-

核心配置:无需手动输入命令,通过页面选择故障类型(如接口超时、Redis阻塞),填写注入对象(服务名称、实例IP)、强度(超时时间、丢包率)、时长,点击启动即可;

-

优势:自带监控面板,可实时查看故障影响;支持自动恢复,可预设终止时间;操作记录自动留存,便于复盘。

8 SOP执行文档与最佳实践

- 本SOP自发布之日起执行,所有研发团队需严格遵守;

- 各研发团队可根据自身业务场景、技术架构,在本SOP基础上补充个性化操作细节(需提交负责人审批后生效);

- 本SOP由公司架构组负责维护,每季度根据演练落地情况、技术迭代情况,更新优化;

- 若演练过程中遇到疑问,可联系架构组、运维研发组,质量架构组提供支持。

9 故障注入(混沌工程)实际案例

9.1 应用层故障------接口超时注入(验证熔断降级有效性)

1. 演练基础信息

- 演练环境:预发环境

- 注入对象:order-service(订单服务)/api/order/create接口(下单核心接口)

- 故障类型:接口超时(分阶段注入100ms、500ms、1s)

- 演练目标:验证接口超时后,熔断降级策略是否生效,是否影响主流程下单功能

- 参与角色:演练负责人(架构师)、研发执行岗(后端研发)、监控岗(SRE)、测试岗

- 工具:ChaosBlade

- 启动压测流量

- 执行过程

- 前置准备:确认mp-order运行正常,熔断配置(超时阈值500ms、熔断触发次数10次/分钟)已生效;监控岗检查接口QPS、P95耗时、熔断次数监控面板正常;质量组准备下单接口测试用例。

- 故障注入:

- 阶段1:注入100ms超时(blade create http delay --time 100 --url /api/order/create),观察3分钟,接口QPS正常(约2000QPS)(理论上可以使用起预发压测流量),错误率0%,未触发熔断;

- 阶段2:注入500ms超时,观察3分钟,接口P95耗时升至520ms,错误率0.3%,熔断触发次数5次/分钟,未触发降级;

- 阶段3:注入1s超时,观察4分钟,接口P95耗时升至1.05s,错误率1.2%,熔断触发次数15次/分钟,降级策略生效(返回默认下单队列提示,后台异步处理)。

- 实时监控:监控岗捕捉到P95耗时尖刺,熔断次数上升,告警在60s内触发(符合规范);研发岗查看接口日志,无异常报错,超时符合注入预期;测试岗执行用例,确认主流程下单正常,降级提示合理。

- 故障终止:演练时长10分钟,研发岗执行终止命令(blade destroy 故障ID),观察2分钟,接口耗时回归正常(P95≈80ms),熔断状态恢复,无遗留故障。

- 核对故障发生时,是否符合0123预期目标

- 问题发现与优化闭环

- 发现问题:1s超时注入时,错误率达1.2%(超出预期0.5%),且降级策略触发延迟约1分钟,部分请求被阻塞;

- 根因分析:熔断触发次数阈值设置过高(10次/分钟),降级策略生效条件未优化;

- 优化措施:调整熔断触发次数至5次/分钟,优化降级生效逻辑(超时≥800ms立即触发降级);

- 验证闭环:优化后,重新注入1s超时,错误率降至0.4%,降级触发延迟≤30s,符合预期。

9.2:中间件层故障------Redis阻塞注入(验证缓存降级与服务容错)

1. 演练基础信息

- 演练环境:预发环境

- 注入对象:famll-product-service(服务商品服务)依赖的Redis实例(缓存商品详情数据)

- 故障类型:Redis阻塞(模拟大key查询导致的阻塞,阻塞时长30s/次)

- 演练目标:验证Redis阻塞时,商品服务是否能降级查询数据库,避免接口雪崩,核心接口(/api/product/detail)可用

- 工具:内部混沌平台(支持Redis故障注入)

2. 执行过程

-

前置准备:确认Redis实例运行正常,商品服务缓存降级配置(Redis超时≥200ms降级查询DB)已配置;监控岗检查Redis阻塞时长、商品服务接口耗时、DB QPS监控;测试岗准备商品详情查询用例。

-

故障注入:通过内部混沌平台新建任务,选择Redis阻塞故障,配置阻塞时长30s/次,注入频率1次/5分钟,启动故障注入。

-

预发环境:启动压测流量请求商品查询请求;

3. 实时监控与记录:

- Redis阻塞触发时,监控告警捕捉到Redis阻塞时长30s,商品服务/api/product/detail接口P95耗时从150ms升至800ms;

- 研发岗查看商品服务日志,发现Redis查询超时,降级策略正常触发,切换至数据库查询;

- 测试岗执行用例,商品详情查询正常,响应时间虽上升但未超时(≤1s),无接口报错;

- 监控发现DB QPS从500QPS升至1200QPS,未超出DB承载上限(2000QPS)。

4. 故障终止:

演练时长15分钟,停止故障注入,观察3分钟,Redis阻塞恢复,商品服务接口耗时回归正常,DB QPS回落至500QPS。

5. 问题发现与优化闭环

-

发现问题:Redis阻塞时,DB QPS骤升,若阻塞频率增加,可能导致DB过载;商品服务降级后,接口耗时偏高(800ms),影响用户体验;

-

优化措施:1. 清理Redis大key,优化商品详情缓存结构(拆分大key);2. 新增本地缓存(Caffeine),作为Redis与DB之间的二级缓存;3. 调整DB连接池参数,提升DB并发承载能力;

-

验证闭环:优化后,重新注入Redis阻塞故障,商品服务接口P95耗时降至400ms,DB QPS升至800QPS,无过载风险。

9.3 :资源层故障------CPU满载注入(验证监控告警与应急响应)

1. 演练基础信息

-

演练环境:预发环境

-

注入对象:mp-order-rpc-service(购物车服务)所在服务器(10.0.0.5,8核16G)

-

故障类型:CPU 100%满载(持续10分钟)

-

演练目标:验证CPU满载时,监控告警是否及时,应急岗是否能快速止血,服务是否会出现宕机、接口不可用情况

-

工具:ChaosBlade

2. 执行过程

-

前置准备:应急岗准备服务器重启脚本、服务重启预案;监控岗检查CPU负载、服务实例存活数、接口错误率监控,设置CPU≥95%持续30s触发P2告警;研发岗确认cart-service运行正常。

-

启动压测流量

-

故障注入:执行命令blade create cpu fullload --duration 600(CPU满载10分钟),注入后1分钟,服务器CPU升至100%。

3. 实时监控与应急响应:

-

注入后35s,监控岗收到CPU满载告警(符合预期,≤60s),立即通知应急岗;

-

注入后1.5分钟,cart-service接口错误率升至3.2%,部分接口超时(P95耗时1.2s),服务实例未宕机;

-

应急岗收到通知后,5分钟内执行止血操作:停止故障注入(blade destroy 故障ID),重启cart-service服务;

-

质量QA执行购物车接口用例,确认止血后2分钟,接口错误率回归0%,CPU负载降至15%,服务恢复正常。

-

故障终止与恢复验证:故障注入总时长8分钟(未达预设10分钟,因错误率超出预期,应急岗紧急止血),恢复后各指标正常,服务无遗留异常。

-

问题发现与优化闭环

-

发现问题:应急响应时间过长(5分钟),未达到"平均止血时间≤30s"的目标;CPU满载时,服务接口错误率超出预期(3.2%>1%),无自动限流策略;

-

优化措施:1. 组织应急岗专项培训,熟练掌握止血操作流程,将应急响应时间目标压缩至≤2分钟;2. 为cart-service新增接口限流策略(CPU≥80%时,限流50%流量);3. 调整CPU告警阈值至90%,提前触发告警;

-

验证闭环:优化后,重新注入CPU满载故障,告警触发时间28s,应急响应时间1.5分钟,接口错误率0.8%,符合预期。

4:云原生层故障------Pod删除注入(验证负载均衡与自愈能力)

1. 演练基础信息

- 演练环境:预发环境(K8s集群)

- 注入对象:user-service(用户服务)的1个Pod(集群共3个Pod,均处于运行状态)

- 故障类型:Pod强制删除(模拟Pod异常宕机)

- 演练目标:验证Pod删除后,K8s负载均衡是否能自动切流,Pod是否能自动重建,用户服务核心接口是否可用

- 工具:ChaosMesh(适配K8s环境)

2. 执行过程

- 前置准备:监控岗检查K8s集群Pod状态、负载均衡流量分配、user-service接口QPS监控;研发岗确认user-service Pod运行正常,负载均衡配置(轮询策略)生效;测试岗准备用户查询、登录接口用例。

- 启动压测流量

- 故障注入:通过ChaosMesh新建Pod删除任务,选择user-service的1个Pod(pod/user-service-7f89d7c6b4-2xqzk),执行强制删除操作。

- 实时监控与记录:

- Pod删除后10s,监控岗发现该Pod状态变为"Terminating",负载均衡自动停止向该Pod分配流量,剩余2个Pod流量均匀分配;

- Pod删除后30s,K8s自动重建新Pod(pod/user-service-7f89d7c6b4-9m7np),重建过程中,user-service接口QPS无明显下降(从3000QPS降至2800QPS),错误率0%;

- Pod删除后3分钟,新Pod启动完成,状态变为"Running",负载均衡恢复向3个Pod分配流量,接口QPS回归3000QPS;

- 测试岗执行用例,确认整个过程中,用户查询、登录接口均正常,无超时、报错情况。

- 故障终止与恢复验证:Pod重建完成后,演练结束(总时长5分钟),所有指标回归正常,负载均衡、Pod自愈功能符合预期。

- 问题发现与优化闭环

- 发现问题:Pod重建耗时较长(3分钟),若多个Pod同时宕机,可能导致服务流量承载不足;负载均衡无故障Pod快速剔除机制,存在10s流量分配延迟;

- 优化措施:1. 优化Pod启动参数,减少镜像拉取、服务初始化时间,将Pod重建时长压缩至≤2分钟;2. 配置K8s liveness探针(每5s检测一次Pod状态),故障Pod快速剔除(≤5s);3. 增加user-service Pod数量至4个,提升集群容错能力;

- 验证闭环:优化后,重新删除1个Pod,Pod重建时长1.8分钟,故障Pod剔除时间4s,服务流量无明显波动,符合预期。

案例总结

上述实例覆盖研发常见故障场景,核心贴合"最小爆炸半径、可观测、可恢复、业务无损"原则,均严格遵循本SOP执行流程。核心启示:1. 故障注入演练需分阶段执行,逐步提升强度,避免一次性引发大面积异常;2. 演练的核心价值的是"发现隐患、优化系统",而非单纯完成演练任务;3. 所有演练均需形成"执行-发现问题-优化-验证"的闭环,才能真正提升系统稳定性;4. 各角色配合顺畅是演练高效执行的关键,需明确职责、熟练掌握操作流程。