如果必须用一句话概括大模型时代最重要的工程发现,那就是:

在模型参数固定的情况下,AI 的能力上限,主要由它在推理时能够同时访问的"有效信息量"所决定。

这不是比喻。

而是一条在工程实践中反复被验证的系统规律。

理解这一点,几乎可以解释过去几年 AI 领域所有看似神奇的能力跃迁。

一、被忽略的事实

模型并不存在"思考工作区"

人们对 AI 的直觉,往往来自对人类大脑的类比。

我们很容易想象:

- 模型内部存在某种"工作空间"

- 在那里持续推理与整合信息

但真实系统结构并非如此。

实际运行方式

大语言模型的本质,是一次性的前馈计算:

Output = f(Input Tokens)在计算过程中:

- Transformer 各层会形成动态的中间特征表示

- 这些向量承载当前上下文的信息整合结果

但它们具有两个关键特征:

✔ 只存在于当前推理过程中

✔ 不会跨上下文持续保留

核心结论

模型没有持续运作的"内部思考空间"。

每一次推理,本质上都是对当前可见信息的一次性整合计算。

二、Context 的真实定义

它不是记忆,而是"可见性边界"

Context 并不是存储结构。

它本质上是一种:

物理约束。

它代表的是:

模型在一次推理中可以同时访问的信息窗口。

Transformer 机制本质

在注意力机制中:

每个 token 都可以对所有可见 token 进行加权聚合。

因此:

Context 就是模型唯一的认知空间。

一个极其重要的理解

Context 并不会直接增加模型能力。

它只做一件事:

定义能力的上限边界。

模型无法理解它"看不到"的信息。

类比人类认知

心理学研究表明:

人类工作记忆容量约为 7±2 信息单元 。

对于大模型来说:

Context Window 本质上就是它的"工作记忆容量"。

三、一个关键认知转折

AI 能力并不只由模型规模决定

传统认知认为:

模型越大 → AI 越强

这一观点并不错误,但并不完整。

能力的真实来源 = 两个维度

参数规模 → 表达能力

决定:

- 能表示多复杂的模式

- 能学习多深层的抽象关系

Context → 认知空间

决定:

- 一次推理能整合多少信息

- 能建立多长距离的依赖关系

能力跃迁的真正条件

当表达能力足够强 + 可见信息足够多时,复杂推理能力才会真正涌现。

⭐ AI 能力本质公式

AI 能力 ≈ 表达能力 × 可见信息量

四、Context 扩展为何会引发"质变"

当 Context 从几百 token 扩展到几十万 token 时:

变化的并不是容量,而是系统性质。

模型开始表现出:

- 跨文档推理

- 长链逻辑一致性

- 全局结构规划

- 复杂任务分解

本质原因只有一个

单次推理中可利用的信息密度大幅提升。

从信息论角度:

AI 能力上限取决于可利用的信息熵,而不仅是参数规模。

五、为什么"给更多信息"会显著提升智能?

当输入信息增加时,会发生三种关键变化。

① 概率空间被强约束

更多条件 → 概率分布收敛

结果:

- 不确定性降低

- 错误空间压缩

- 输出稳定性提高

② 注意力网络复杂度提升

每增加一个 token:

→ 潜在关联关系呈指数增长。

模型构建的是:

更密集的信息连接网络

这使它能:

- 发现远距离依赖

- 跨文档整合信息

- 执行复杂推理

③ 语义空间锚点增多

信息越丰富:

- 语义定位越精确

- 推理路径越稳定

- 输出一致性越高

本质上:

更多信息 = 更稳定的语义坐标系

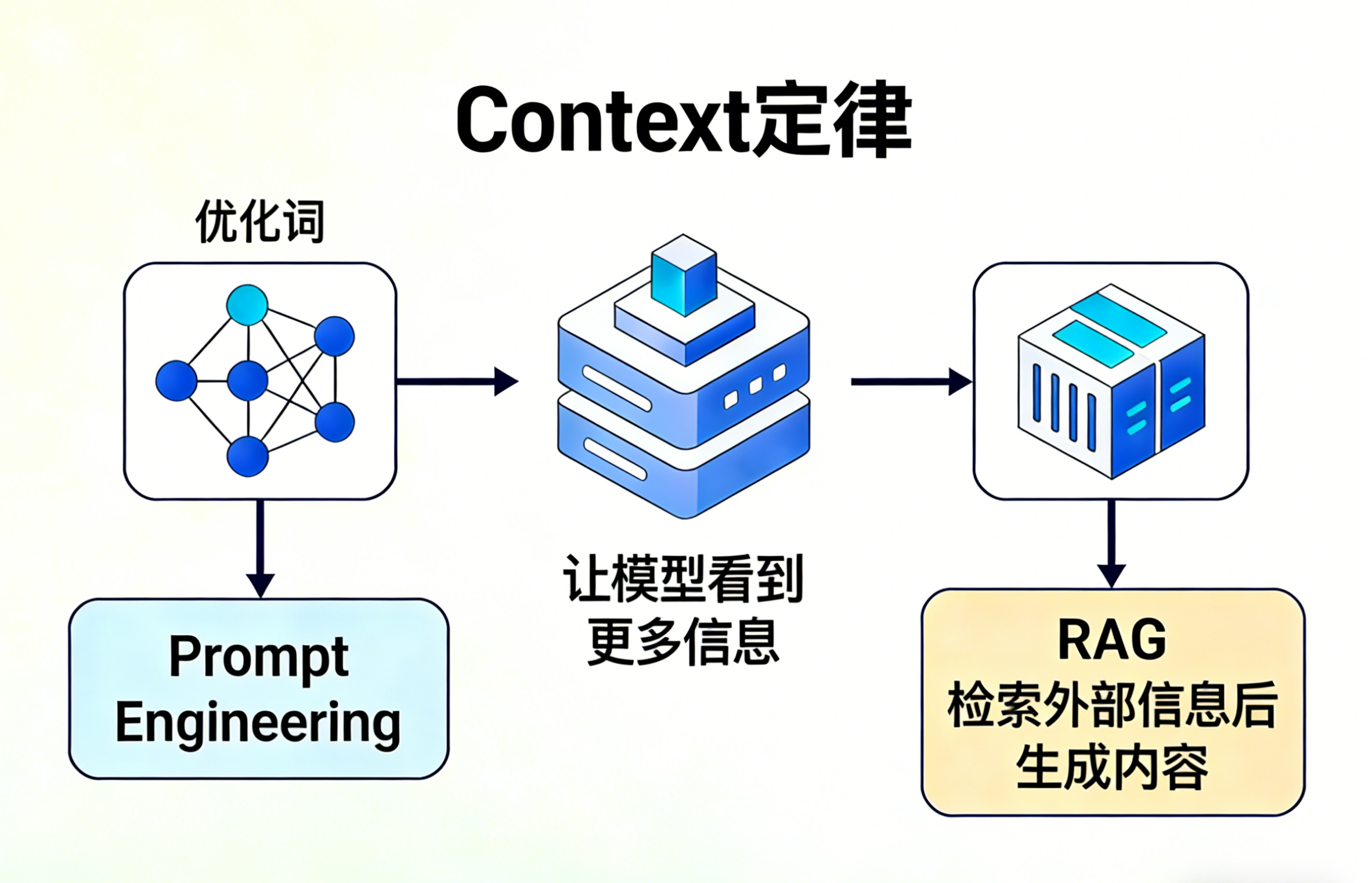

六、Context 定律

AI 工程设计的第一原则

从工程角度看,可以得到一个极其清晰的结论:

大模型不仅是计算系统,更是信息可见性系统。

它的核心限制往往不是算力,而是:

推理时可同时访问的信息量。

所有 AI 工程技术的共同本质

过去几年关键技术看似不同:

- Prompt Engineering

- RAG

- 对话历史

- 外部记忆

- 工具调用

但它们的目标完全一致:

让模型在推理时看到更多正确的信息。

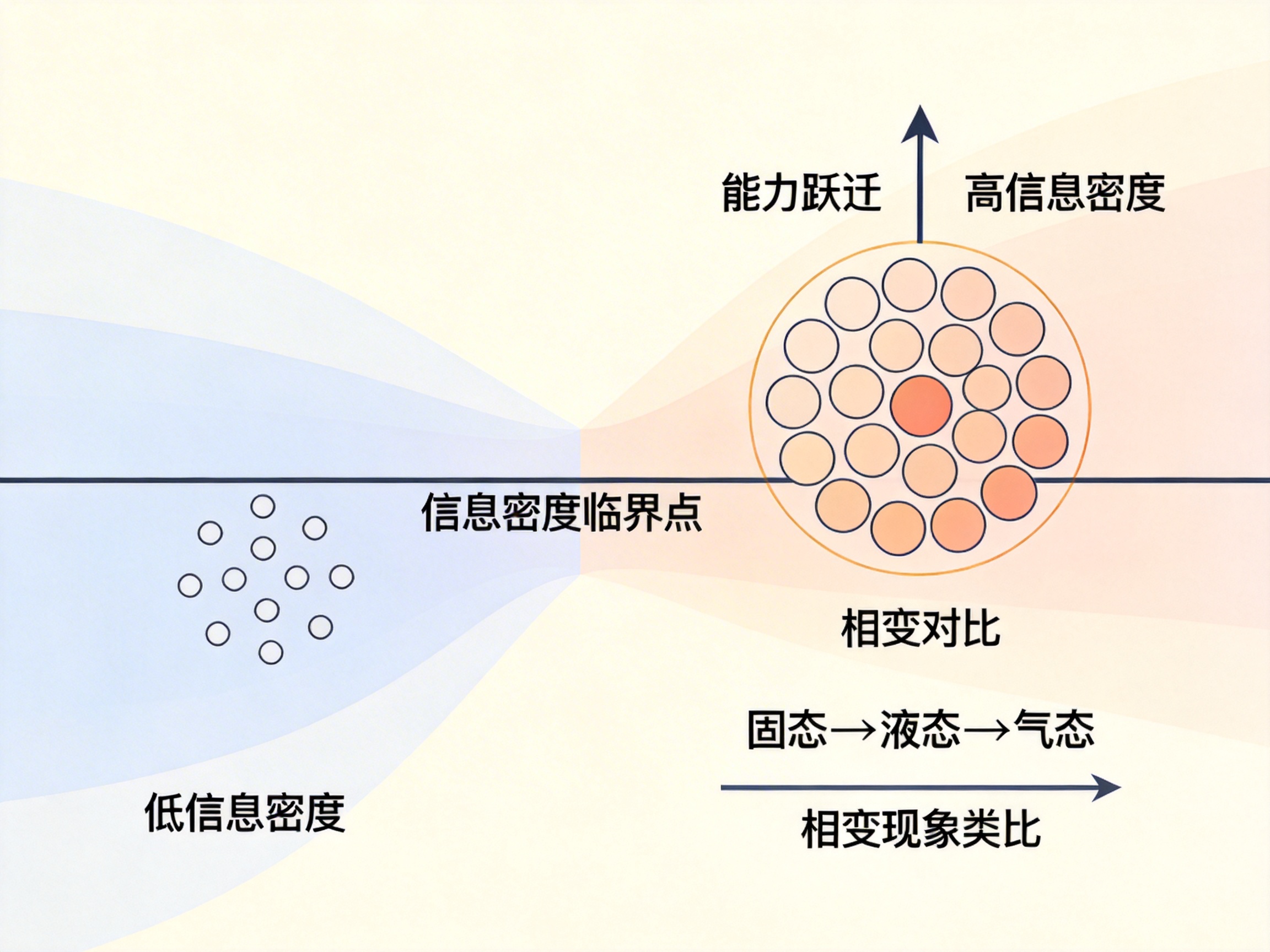

七、智能的真正来源

信息密度跨越临界点

当信息密度达到某个阈值时:

系统会发生能力跃迁。

这并不是模型突然"学会思考"。

而是因为:

信息量首次足以支撑复杂结构推理。

从复杂系统视角看

这是一种典型的相变现象:

- 水达到临界点会汽化

- 网络达到连接密度会形成巨型结构

同样:

当信息密度足够高时,复杂智能行为自然涌现。

八、关于记忆的真正结论

大语言模型本质上是无状态系统:

- 不自动保存历史

- 不跨推理保留内部状态

现实中的"记忆感"来自外部系统:

- 对话历史重放

- 检索增强

- 参数更新

因此:

模型没有内生记忆,但可以在系统支持下表现出稳定记忆行为。

最终总结

一句话理解大模型能力本质

参数规模决定模型能"想多复杂",

Context 决定模型能"看到多少",

真正的智能水平,取决于推理时的信息密度。

```