OpenClaw:开源AI助手平台的革命之路

引言:AI助手的黎明

2023年,ChatGPT的横空出世让全世界看到了人工智能的无限可能。然而,当我们惊叹于大语言模型(LLM)的强大能力时,一个问题始终萦绕在许多技术爱好者和开发者心头:能否在本地运行属于自己的AI助手?

在这个云服务主导的时代,我们的每一次对话、每一个请求都在云端处理,数据隐私成为一个日益严峻的挑战。而就在这样的背景下,一个名为 OpenClaw 的开源项目悄然崛起,它不仅解决了隐私问题,更开创了个人AI助手的全新范式。

一、什么是OpenClaw?

OpenClaw 是一个开源的个人AI助手平台 ,由开发者 @steipete 创建,采用 MIT 许可证完全免费开放。它的核心理念是:让每个人都能够在自己的电脑上运行AI助手,数据完全掌控在自己手中。

1.1 核心特性

OpenClaw 具备以下颠覆性的特性:

- 本地部署:在你的电脑上运行,所有数据处理都在本地完成

- 多平台集成:支持 Discord、Telegram、WhatsApp、iMessage、Slack 等主流通讯平台

- 持久化记忆:记住与你的每一次对话,越用越懂你

- 自主执行:理解意图并自主完成任务,而不仅仅是对话

- 完全开源:MIT 许可证,可自由修改和分发

- 可扩展架构:插件系统支持自定义功能扩展

1.2 为什么选择OpenClaw?

在众多的AI助手方案中,OpenClaw 独树一帜:

| 特性 | OpenClaw | ChatGPT | Claude | 其他开源方案 |

|---|---|---|---|---|

| 本地部署 | ✅ | ❌ | ❌ | 部分 |

| 隐私保护 | ✅ | ❌ | ❌ | ✅ |

| 多平台集成 | ✅ | ❌ | ❌ | ❌ |

| 持久记忆 | ✅ | ✅ | ✅ | ❌ |

| 自主执行 | ✅ | 部分 | 部分 | ❌ |

| 开源免费 | ✅ | ❌ | ❌ | ✅ |

二、OpenClaw的系统架构

OpenClaw 的架构设计堪称优雅,它采用分层架构,将复杂的AI能力封装在简洁的接口之后。

上图展示了OpenClaw完整的五层架构设计,从消息接入到数据存储,每一层都精心设计,确保系统的高可用性和可扩展性。

2.1 消息平台层

OpenClaw 的一大亮点是统一的多平台消息接入能力。无论你习惯使用 Discord、Telegram、WhatsApp,还是苹果的 iMessage,OpenClaw 都能无缝集成。

这一层的核心是消息适配器,它负责:

- 将不同平台的私有协议转换为统一的消息格式

- 处理各平台的认证和授权

- 管理平台特有的功能(如 Discord 的语音频道)

从上图可以看到,OpenClaw 通过中心化的网关架构,实现了六大主流通讯平台的统一接入,用户可以自由选择最熟悉的平台与AI助手交互。

2.2 AI引擎层

这是 OpenClaw 的"大脑",包含多个核心组件:

LLM接口层:支持多种大语言模型

- Claude(Anthropic)

- GPT-4(OpenAI)

- 本地模型(如 LLaMA、Mistral)

意图识别引擎:理解用户想要做什么

- 自然语言处理(NLP)

- 上下文分析

- 参数提取

记忆系统:OpenClaw 的核心竞争力之一

- 工作记忆:当前对话的上下文

- 短期记忆:最近7-30天的交互

- 长期记忆:用户偏好和知识库

2.3 存储层

OpenClaw 使用多种存储方案来满足不同需求:

- SQLite/MySQL:存储结构化数据(用户信息、对话历史)

- 向量数据库(ChromaDB/FAISS):语义检索和RAG

- 文件系统:文档和附件

- Redis:高速缓存

记忆系统是OpenClaw的"灵魂",上图展示了三层记忆架构和完整的RAG(检索增强生成)工作流程,确保AI能够记住重要信息并提供个性化的响应。

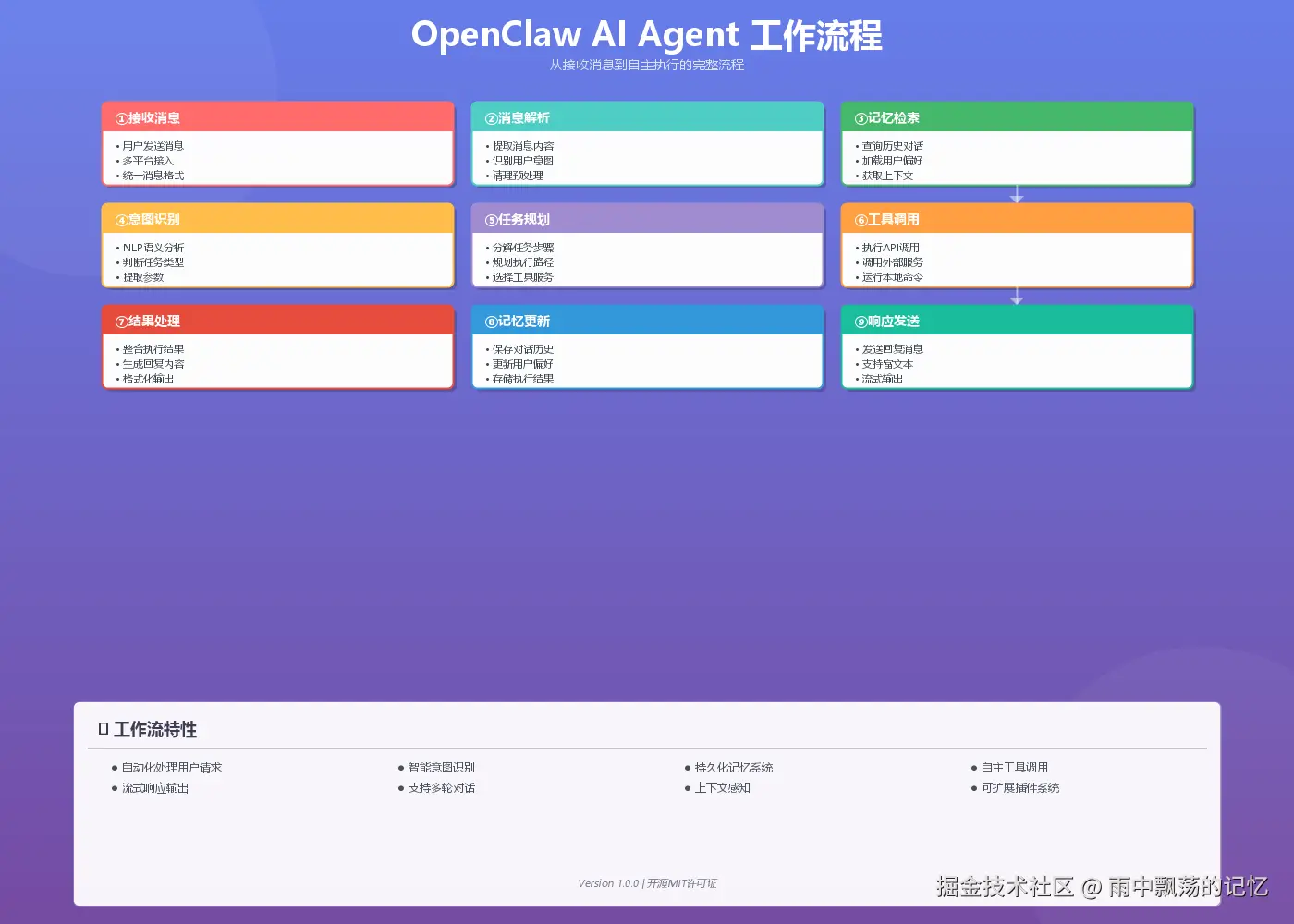

三、AI Agent工作流程

OpenClaw 不仅仅是一个聊天机器人,它是一个真正的AI Agent(智能体) ,能够自主理解意图并执行任务。

上图详细展示了OpenClaw处理用户请求的完整九步流程,从消息接收到响应发送,每一步都经过精心设计。

3.1 完整的处理流程

当一个用户发送消息给 OpenClaw 时,会经历以下九个步骤:

步骤1:接收消息 OpenClaw 通过各个平台的集成接口接收用户消息,将其转换为统一的内部格式。

步骤2:消息解析 提取消息的核心内容,识别用户的真实意图。这一步涉及:

- 文本清理和预处理

- 实体识别(人名、地名、时间等)

- 上下文提取

步骤3:记忆检索 从记忆系统中检索相关信息:

- 查询历史对话记录

- 加载用户偏好设置

- 获取相关背景信息

步骤4:意图识别 使用NLP技术判断用户的意图类型:

- 信息查询

- 任务执行

- 纯聊天

- 紧急求助

步骤5:任务规划 如果用户请求需要执行任务,OpenClaw 会:

- 分解任务为可执行的步骤

- 规划执行路径

- 选择合适的工具或服务

步骤6:工具调用 执行具体的操作:

- 调用外部API(查询天气、发送邮件等)

- 执行本地命令(文件操作、系统控制)

- 与其他服务集成

步骤7:结果处理 整合执行结果,生成回复内容

步骤8:记忆更新 将本次交互存储到记忆系统中,持续学习用户偏好

步骤9:响应发送 通过消息平台发送回复给用户,支持流式输出

3.2 智能决策机制

OpenClaw 的决策机制设计巧妙,在步骤4和步骤6之间有一个智能判断节点:

- 如果需要调用工具,则进入工具调用流程

- 如果可以直接回复,则跳过工具调用,直接生成响应

这种机制使得 OpenClaw 既能够快速响应简单问题,又能够处理复杂的多步骤任务。

四、消息平台集成详解

OpenClaw 的多平台集成能力是其最大的亮点之一。让我们看看它是如何与各大平台无缝对接的。

4.1 Discord集成

Discord 是 OpenClaw 最成熟的支持平台:

优势:

- 丰富的 Bot API

- 支持语音频道

- 活跃的开发者社区

- 优秀的实时消息体验

配置方法:

- 在 Discord Developer Portal 创建 Bot

- 获取 Bot Token

- 配置 OpenClaw 的

config.yaml - 邀请 Bot 到你的服务器

4.2 Telegram集成

Telegram 以其安全性和简洁性著称:

优势:

- 端到端加密

- 轻量级 API

- 全球可用

- 支持文件传输

配置方法:

- 与 @BotFather 对话创建 Bot

- 获取 API Token

- 设置 Webhook 或轮询模式

4.3 iMessage集成(仅限Mac)

这是 OpenClaw 最具特色的功能之一:

优势:

- 原生集成

- 无需额外应用

- 与日常通讯无缝融合

配置方法:

- 在 Mac 上授予脚本访问权限

- 配置 AppleScript 桥接

- 启动 OpenClaw 服务

4.4 WhatsApp Business API

通过 WhatsApp Business API,OpenClaw 可以触达全球20亿用户:

优势:

- 庞大的用户基础

- Business API 支持

- 企业级可靠性

限制:

- 需要申请 Business API 访问权限

- 需要通过 Meta 审核

五、OpenClaw的应用场景

OpenClaw 的应用场景几乎涵盖了个人和企业的方方面面。

上图展示了OpenClaw的八大应用场景,从个人助理到企业协作,从技术开发到内容创作,几乎覆盖了所有可能的AI助手使用场景。

5.1 个人助理场景

日程管理:

- "明天上午10点提醒我开会"

- "查看我本周的日程安排"

- "帮我和王总约个时间"

任务提醒:

- "提醒我周五交报告"

- "每天早上8点提醒我锻炼"

- "购物清单里还有什么?"

邮件处理:

- "帮我写一封请假邮件"

- "总结今天收到的所有邮件"

- "回复张三的邮件说我同意了"

5.2 学习助手场景

知识问答:

- "解释什么是量子纠缠"

- "Python中的装饰器是怎么工作的?"

- "法国大革命是什么时候?"

学习规划:

- "帮我制定一个学习Java的计划"

- "每天提醒我背30个单词"

- "推荐一些关于人工智能的书籍"

笔记整理:

- "把我今天的笔记整理成思维导图"

- "总结这篇文章的核心观点"

- "给这段文字添加关键词"

5.3 技术开发场景

代码生成:

- "用Python写一个快速排序"

- "帮我优化这段SQL查询"

- "创建一个React组件用于表单验证"

Bug调试:

- "这段代码为什么会报错?"

- "帮我找出内存泄漏的原因"

- "如何修复这个 CORS 错误?"

文档辅助:

- "为这个API生成文档"

- "解释这段代码的功能"

- "生成单元测试"

六、OpenClaw部署指南

OpenClaw 的部署非常简单,即使没有深厚的技术背景也能快速上手。

上图提供了三种部署方式的完整指南,包括Docker部署、本地安装和源码构建,以及详细的配置说明。

6.1 系统要求

操作系统:

- macOS 11+(推荐)

- Ubuntu 20.04+

- Windows 10/11(需要WSL)

运行环境:

- Python 3.10 或更高版本

- pip 包管理器

- Git(可选)

硬件要求:

- CPU: 2核心以上

- 内存: 4GB以上

- 磁盘: 500MB可用空间

API密钥:

- Claude API(推荐)

- 或 OpenAI API

- 或本地LLM(如 LLaMA)

6.2 安装方法

方法一:使用 Docker(推荐)

bash

# 拉取镜像

docker pull openclaw/ai-assistant:latest

# 运行容器

docker run -d \

--name openclaw \

-p 8080:8080 \

-v ~/.openclaw:/data \

-e ANTHROPIC_API_KEY=your_key_here \

openclaw/ai-assistant:latest方法二:本地安装

bash

# 克隆仓库

git clone https://github.com/steipete/openclaw.git

cd openclaw

# 安装依赖

pip install -e .

# 初始化配置

openclaw init

# 启动服务

openclaw start方法三:源码构建

bash

# 克隆仓库

git clone https://github.com/steipete/openclaw.git

cd openclaw

# 创建虚拟环境

python -m venv venv

source venv/bin/activate # Linux/Mac

# 或

venv\Scripts\activate # Windows

# 安装开发依赖

pip install -e ".[dev]"

# 运行测试

pytest

# 启动开发服务器

python -m openclaw.cli start6.3 配置文件详解

OpenClaw 使用 YAML 格式的配置文件(config.yaml):

yaml

# LLM配置

llm:

provider: claude # claude/openai/local

model: claude-3-sonnet-20240229

api_key: ${ANTHROPIC_API_KEY} # 从环境变量读取

temperature: 0.7

max_tokens: 4096

# 平台配置

platforms:

discord:

enabled: true

token: ${DISCORD_TOKEN}

command_prefix: "!"

telegram:

enabled: false

token: ${TELEGRAM_TOKEN}

imessage:

enabled: false

# Mac only

# 记忆系统配置

memory:

type: sqlite

path: ./data/openclaw.db

vector_db:

type: chromadb

path: ./data/vectors

# 日志配置

logging:

level: INFO

file: ./logs/openclaw.log

# 安全配置

security:

allowed_users: [] # 留空表示允许所有用户

rate_limit: 100 # 每小时请求数6.4 环境变量设置

为了安全起见,敏感信息应该通过环境变量设置:

ini

# Claude API

export ANTHROPIC_API_KEY="sk-ant-xxx..."

# Discord Bot Token

export DISCORD_TOKEN="MTE...xxx"

# Telegram Bot Token

export TELEGRAM_TOKEN="123456:ABC-DEF...xxx"

# OpenAI API Key(如果使用GPT)

export OPENAI_API_KEY="sk-...xxx"七、OpenClaw的高级功能

7.1 RAG(检索增强生成)

OpenClaw 内置了强大的 RAG 能力,能够结合外部知识库提供更准确的回答:

工作原理:

- 将知识文档向量化存储

- 用户查询时进行语义检索

- 将检索到的相关内容作为上下文

- LLM 基于增强的上下文生成回答

配置方法:

yaml

rag:

enabled: true

chunk_size: 512

chunk_overlap: 50

top_k: 5 # 检索最相关的5个片段

knowledge_base:

- path: ./knowledge/docs

format: markdown

- path: ./knowledge/pdf

format: pdf7.2 工具调用(Function Calling)

OpenClaw 可以调用外部工具和服务:

内置工具:

- 日期时间

- 计算器

- 天气查询

- 邮件发送

- 文件操作

自定义工具:

python

from openclaw.tools import Tool

class WeatherTool(Tool):

name = "weather"

description = "查询指定城市的天气"

def execute(self, city: str) -> str:

# 调用天气API

result = call_weather_api(city)

return f"{city}今天的天气是{result}"

# 注册工具

openclaw.register_tool(WeatherTool())7.3 多Agent协作

OpenClaw 支持多个 AI Agent 协作完成复杂任务:

yaml

agents:

researcher:

role: "研究助理"

capabilities:

- search

- summarize

- analyze

writer:

role: "内容创作"

capabilities:

- write

- edit

- format

reviewer:

role: "审核校对"

capabilities:

- proofread

- fact_check7.4 记忆管理

OpenClaw 的记忆系统支持多种管理策略:

自动记忆:

- 自动保存所有对话

- 智能提取重要信息

- 定期归档旧数据

手动标记:

ini

# 标记重要信息

openclaw.memory.mark_important(

conversation_id="conv_xxx",

content="用户偏好:不喜欢被叫全名"

)记忆检索:

ini

# 搜索相关记忆

memories = openclaw.memory.search(

query="用户喜欢的食物",

limit=5

)八、OpenClaw vs 其他方案

8.1 与云服务对比

| 维度 | OpenClaw | ChatGPT Plus | Claude Pro |

|---|---|---|---|

| 费用 | 免费 | $20/月 | $20/月 |

| 隐私 | 完全本地 | 云端处理 | 云端处理 |

| 定制化 | 完全可定制 | 有限 | 有限 |

| 平台集成 | 多平台 | 仅Web | 仅Web |

| 离线使用 | 支持(本地LLM) | 不支持 | 不支持 |

8.2 与其他开源方案对比

| 方案 | 语言 | 部署难度 | 平台支持 | 记忆系统 |

|---|---|---|---|---|

| OpenClaw | Python | ⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| AutoGPT | Python | ⭐⭐⭐⭐ | ⭐ | ⭐⭐⭐ |

| BabyAGI | Python | ⭐⭐⭐ | ⭐ | ⭐⭐ |

| LangChain | Python | ⭐⭐⭐ | ⭐⭐ | ⭐⭐⭐ |

| AgentGPT | TypeScript | ⭐⭐ | ⭐⭐⭐ | ⭐⭐ |

九、OpenClaw的未来展望

9.1 即将推出的功能

- 语音交互:支持语音输入输出

- 图像理解:GPT-4V级别的多模态能力

- 视频分析:理解视频内容并提取信息

- 更多平台:微信、LINE、KakaoTalk

- 移动应用:iOS和Android原生应用

9.2 社区生态

OpenClaw 拥有活跃的开源社区:

- GitHub :github.com/steipete/op...

- Discord:活跃的开发者社区

- 插件市场:社区贡献的各类插件

- 文档中心:详细的使用文档和教程

9.3 商业化考虑

虽然 OpenClaw 本身是开源免费的,但其生态系统正在催生商业机会:

- 企业版:提供额外的企业功能

- 托管服务:为不想自部署的用户提供托管

- 定制开发:基于 OpenClaw 的定制解决方案

- 培训服务:企业部署和使用的培训

十、实战案例

案例1:个人知识管理助手

场景: 一位研究人员希望用 OpenClaw 管理他的研究笔记和文献。

实施方案:

- 使用 RAG 功能导入所有PDF文献

- 配置每日笔记整理任务

- 设置文献引用自动生成

- 集成到 Telegram 便于随时查询

效果:

- 文献检索效率提升80%

- 自动生成文献综述草稿

- 随时随地通过手机查询知识

案例2:家庭智能中控

场景: 一个技术爱好者希望用 OpenClaw 作为家庭智能化中心。

实施方案:

- 集成 HomeAssistant API

- 配置 iMessage 作为主要交互界面

- 创建家庭共享日历

- 设置购物清单和提醒功能

效果:

- 自然语言控制智能家居

- 家庭日程统一管理

- 购物清单自动同步

- 天气和新闻每日推送

十一、常见问题解答

Q1: OpenClaw 需要联网吗?

A: 如果使用云端 LLM(如 Claude、GPT),需要联网。如果使用本地 LLM(如 LLaMA),可以完全离线运行。

Q2: 我的隐私数据安全吗?

A: OpenClaw 在本地运行,所有数据都存储在你的电脑上。只有当你选择使用云端 LLM 时,查询内容才会发送到对应的 API。建议使用隐私友好的本地模型。

Q3: OpenClaw 支持中文吗?

A: 完全支持!OpenClaw 可以处理几乎所有语言的对话,包括中文、英文、日文、法文等。

Q4: 可以同时接入多个平台吗?

A: 可以!OpenClaw 的设计允许多平台同时运行,你可以在 Discord、Telegram、iMessage 上同时使用同一个 AI 助手。

Q5: OpenClaw 的硬件要求高吗?

A: 如果使用云端 LLM,普通的笔记本就可以运行。如果要使用本地 LLM,建议至少有 16GB 内存和独立的 GPU。

Q6: OpenClaw 可以商用吗?

A: 可以!OpenClaw 使用 MIT 许可证,允许商用。但请注意使用的 LLM 的具体条款。

十二、总结

OpenClaw 代表了 AI 助手的未来方向:

- 隐私优先:数据本地化处理

- 开放透明:开源可审计

- 平台集成:无缝融入日常工作流

- 持续进化:活跃的社区和快速迭代

在这个 AI 飞速发展的时代,OpenClaw 为我们提供了一个独特的选择:既享受前沿的 AI 能力,又保持对数据的完全控制。

无论你是个人用户、开发者,还是企业决策者,OpenClaw 都值得你深入了解和尝试。让我们一起拥抱这个开源 AI 助手的新时代!