在x上又看到一篇文章,觉得还是挺有用的,今天就分享给大家。

这篇文章挺实用的,作者 Alex Finn 分享了如何把 OpenClaw(一个 AI Agent 框架)接入本地模型,从而摆脱 Anthropic API 的费用和限制。核心卖点是:32GB 内存的 Mac Mini 就能跑 Qwen 3.5,效果据说相当于六个月前的 Claude Sonnet 水平,而且完全免费。

说实话,作者对 Qwen 3.5 的赞美有点夸张,"等同于 Sonnet 4.5"这个说法经不起严格检验。但 "用前沿模型做规划 + 本地模型做执行"这个混合架构思路是真的有参考价值------执行占 90% 的 token 消耗,把这部分本地化,省钱效果是实实在在的。操作步骤也给得很清楚,只要跟着做就能跑起来。

如何将 OpenClaw 接入本地模型?

作者目前桌上放了 3 台 Mac Studio,他们都在运行着 Qwen 3.5------一个本地模型,作者认为智能程度接近 Sonnet 4.5。无限 token,没有速率限制,成本就只有电费消耗。而且数据100% 私密,不上传到任何云端服务器,即使断网也能正常工作。

不需要价值一万美元的 Mac Studio,Mac Mini 就够了。

Qwen 3.5 就在前几天刚发布,直接可以装进 32GB 内存里跑。这意味着比基础款高一档的 Mac Mini 就能跑起来,并且性能直逼Sonnet 4.5,24/7 驱动你的 OpenClaw Agent,没有任何 API 费用,数据也不出本地。

目前 OpenClaw 用户最大的抱怨就是限制和价格------接 Anthropic API 的话,每月可能花几千美元,还频繁受到速率限制。本地模型完美的解决了这个问题。

不只是省钱,它还解锁了很多以前不可能实现的用法。没有限制之后,Agent 可以 24/7/365 持续运行。这彻底改变了你和 AI 的关系------从一问一答的对话,变成被动的、常驻的协作:Agent 持续产出价值,自我改进,主动寻找新任务。

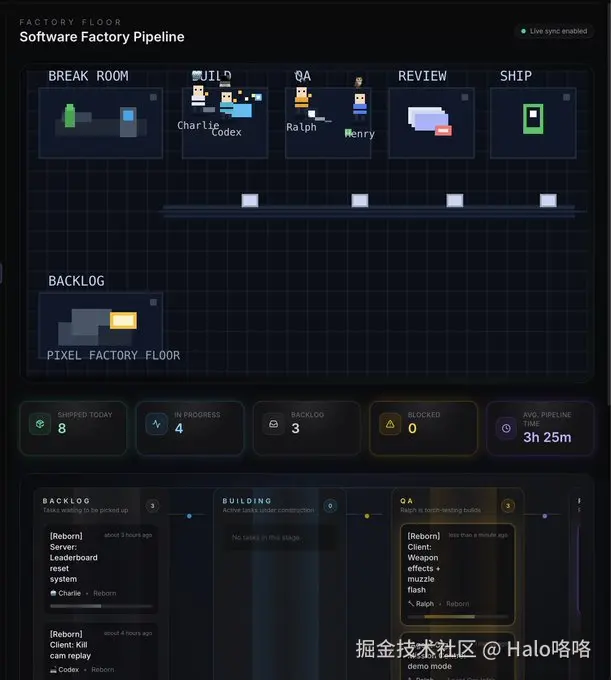

作者目前跑着一个"SaaS 工厂":

- 4 个 OpenClaw Agent 同步协作开发同一个产品,各自领任务,完成后自动寻找下一个,必要时自行创建新任务

- 另一个 Agent(Ralph)负责 QA,审查所有任务,发现问题后直接修改对应 Agent 的记忆并改进它

这是一个完整的闭环自我改进系统。如果用 API 来跑,每月要花好几千;用本地模型(Qwen 和 MiniMax)完全免费,只有电费------而 Mac 电脑的能耗效率相当高。

如何部署本地模型

要跑 Qwen 3.5,至少需要 32GB 内存的 Mac Mini。模型本身占 20GB,留点余量给其他任务用。

如果只有基础款 16GB Mac Mini,也没关系,虽然跑不了这个模型,但可以跑一些更小的模型,处理一些简单任务。

在 32GB 及以上的电脑上部署 Qwen3.5-35B-A3B 的步骤:

- 下载 LM Studio --- lmstudio.ai,免费,拖入 Applications 即可

- 搜索 Qwen3.5-35B-A3B-4bit --- 在 Discover 标签页搜索 "Qwen3.5-35B-A3B",选择 4-bit MLX 版本

- 下载 --- 约 20GB,网速好的话几分钟搞定

- 加载模型 --- 在侧边栏点击它,点 Load,完成。本地 AI 现在已经在跑了

- 接入 OpenClaw --- 告诉你的 OpenClaw 你下载好了,让它把这个模型作为工具来使用

如果内存不足 32GB,可以直接问 OpenClaw:"我的硬件能跑的最好的本地模型是什么?能帮我分担一些任务或改善记忆系统?"

什么时候用本地模型

本地模型的智能水平大约是六到十二个月前的前沿水准,并非当下最强。建议这样搭配:用 Anthropic 或 ChatGPT 作为 OpenClaw 的"大脑"负责规划,用本地模型作为"肌肉"负责执行。

执行阶段占了大约 90% 的 token 消耗,把这部分本地化,省钱效果非常明显。同时也能学到更多关于本地 AI 的知识,在需要时保持数据隐私。

作者判断,年底之前,应该会出现能在单台 Mac Studio 或 Mac Mini 上运行的 Opus 4.6 级别模型------到那时,局面会完全不同。

深度思考

"大脑+肌肉"混合架构是真正有价值的洞察: 规划用前沿 API、执行用本地模型,这个分工符合实际成本结构------执行占 90% 的消耗,本地化收益最大,而规划对质量最敏感,不该将就。

闭环自我改进系统的门槛比听起来低很多: QA Agent 修改其他 Agent 记忆这个设计,意味着系统错误可以被自动收敛。这类结构以前只在大公司的工程团队里出现,现在一个人就能在桌面上跑起来。

本地模型浪潮的真正驱动力是隐私,不只是省钱: 数据不出设备、断网可用,对某些场景(法律、医疗、企业内部数据)的意义远超省 API 费用。作者轻描淡写了这一点,但它可能才是最大的需求来源。

对 Qwen 3.5 性能的描述需要打折扣: "等同于 Sonnet 4.5"是营销语言,实际表现取决于具体任务类型,代码和推理类任务差距通常比基准测试体现的更大。跟着配置跑,自己测才算数。

本地模型最大的价值不是免费,而是让 Agent 从"用完即止"变成"持续运转"------这才是工作流真正被重构的地方。

原文链接:x.com/AlexFinn/st...