原文:Next.js at Enterprise Level

翻译:TUARAN

欢迎关注 前端周刊,每周更新国外论坛的前端热门文章,紧跟时事,掌握前端技术动态。

Next.js 开箱即用,体验通常很顺手------直到流量和复杂度同时上来。本文讨论的是:在不推倒重写的前提下,如何把 Next.js 推到企业级规模,从缓存与 CDN,到横向扩容、API Gateway,再到更上层的架构策略。

Next.js 是一个构建在 React 之上的全栈框架,支持服务端渲染(SSR)与静态站点生成(SSG)。它允许你在服务端构建 UI,同时直接访问数据库、文件系统等服务端资源;并可通过 Server Actions 简化前后端通信。

框架内置了较完善的缓存机制,且配置成本不高,因此对中小型应用来说,默认配置通常就能获得不错效果。

但对于大型企业应用,真正进入生产后往往需要更深的架构理解。要在规模化场景下保持效率与稳健,开发者必须超越默认设置,把一系列高级优化手段组合起来使用。

(原文说明:本文内容由人工撰写,仅由 AI 进行校对。)

问题

在企业级场景里,可扩展性往往是首要指标。默认配置足以快速起步,但随着流量增长,这些默认策略会逐渐演变为瓶颈,并带来:

- 性能不稳定

- 资源利用效率低

- 运维成本上升

要在规模化后依然保持高效和稳定,就需要把系统设计模式、性能优化手段与 Next.js 机制结合起来。

SLA / SLO 与监控体系

定义服务质量:SLA vs SLO

在上线前,应该先明确系统的"非功能性需求"(例如性能、可用性、延迟、错误率等)。文章把这些目标分成两类:

- 定义

- SLA(Service Level Agreement):对用户/客户的正式服务协议。达不到 SLA 可能带来赔偿或法律风险。

- SLO(Service Level Objective):内部的服务目标,通常比 SLA 更严格,用于留出"缓冲区"。

- 为什么要尽早定清楚

这些指标决定了系统是否"可用"。目标通常来自:

- 行业标准:例如 Core Web Vitals。页面加载超过 2 秒可能影响 SEO,进而影响流量和收入。

- 竞争基准:至少要对齐竞争对手体验。

- 安全与关键性:在高风险系统里(例如自动驾驶),实时准确是底线。

- 工程与业务对齐

业务方确定目标,但工程师需要帮助解释技术取舍与每个指标的重要性。越早定清楚,越能更合理地编排架构组件与资源。

如何验证:监控 + 压测

- 监控(Monitoring):在基础设施层面持续采集非功能指标,实时知道当前实现是否达标。

- 压测(Load Testing):上线前用虚拟用户与合成流量模拟真实压力,尽量把问题暴露在生产之前。

Next.js 的生命周期:动态渲染 vs 静态托管

理解 Next.js 内部"请求进来到底发生了什么"对于扩容很关键:当你从单实例变成几十个副本时,清楚每一步才能预测瓶颈。

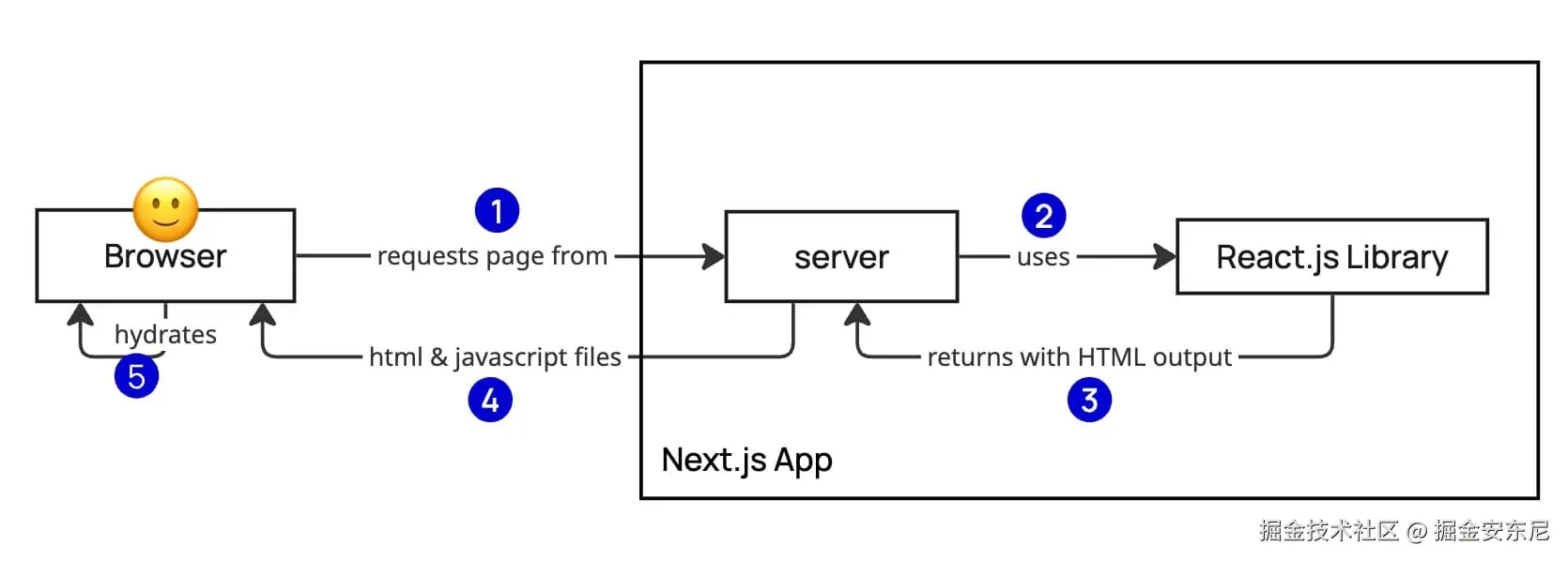

1) 动态请求生命周期(SSR / ISR)

用户请求一个运行中的 Next.js 页面时,服务端大致会经历:

- 渲染:用内部 React 引擎在服务端渲染页面。

- 响应下发 :服务端返回包含:

- HTML:用于浏览器立即显示

- RSC Payload(React Server Components):用于客户端 hydration

- Hydration:浏览器用 RSC payload 把静态 HTML 变成可交互页面。

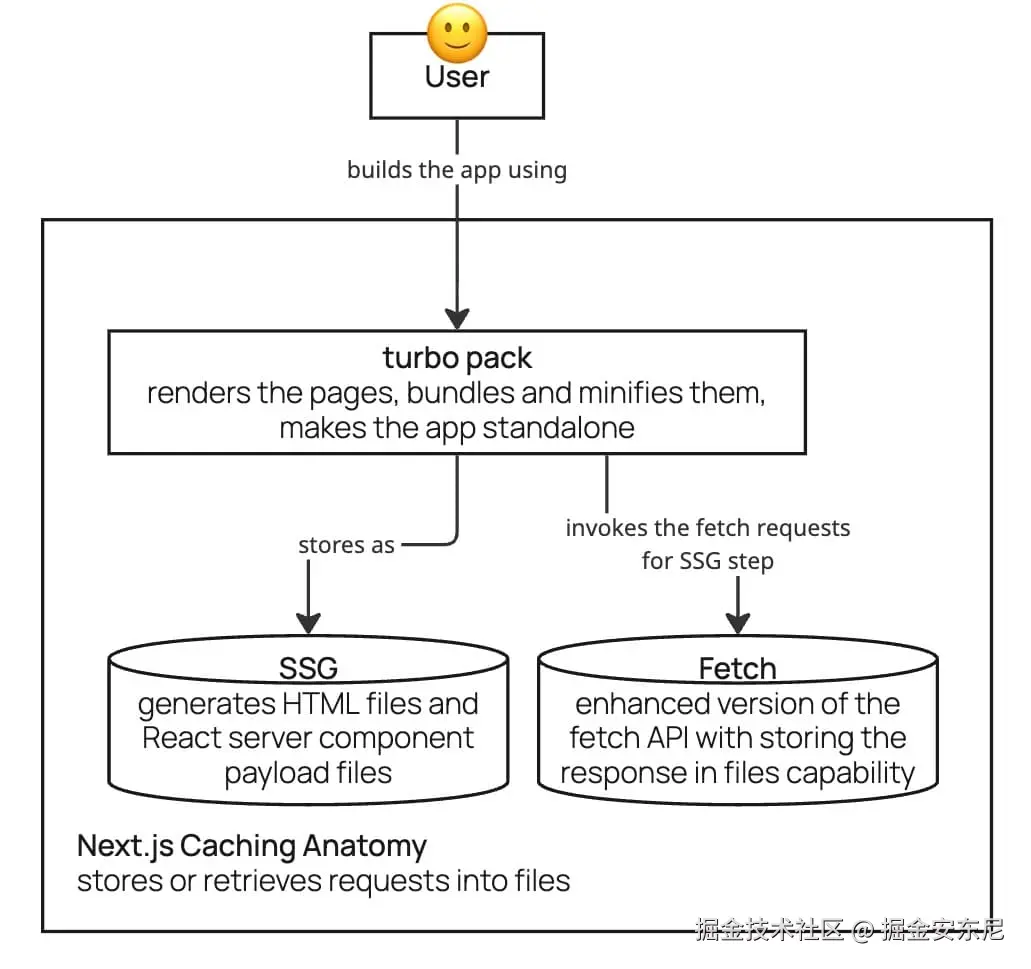

2) 静态方案(SSG)

如果应用完全不依赖服务端资源(纯静态),生命周期会大幅简化:

- 构建时生成:构建阶段一次性生成 HTML/CSS/JS。

- 静态托管:不需要 Node.js 常驻服务,直接由 CDN 或 Nginx/Apache 提供静态文件。

- 扩展优势:静态站点更易扩展,因为消除了每次请求的服务端渲染 CPU 开销。

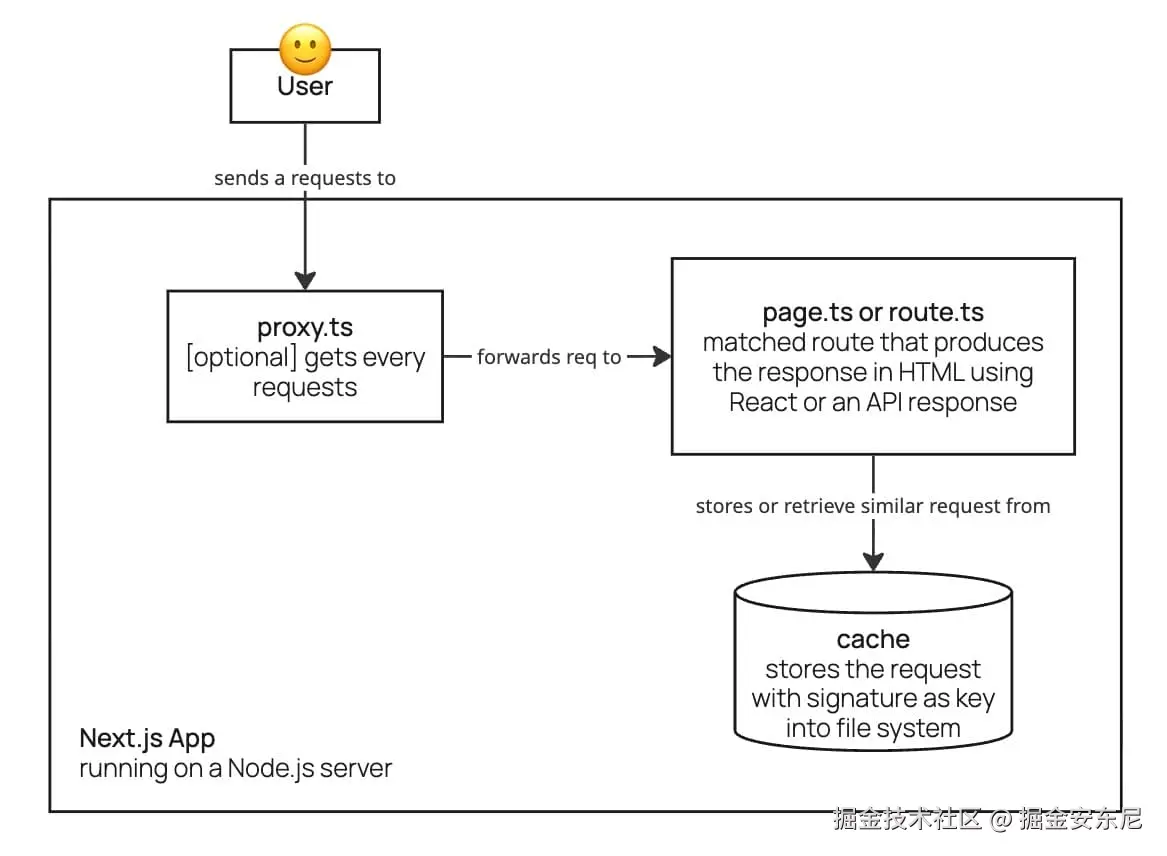

进一步:请求进来后的拦截与缓存

请求进入 Next.js 后,会先经过 proxy.ts(Next.js <15 中叫 middleware)进行鉴权等判断;通过后再路由到具体页面。

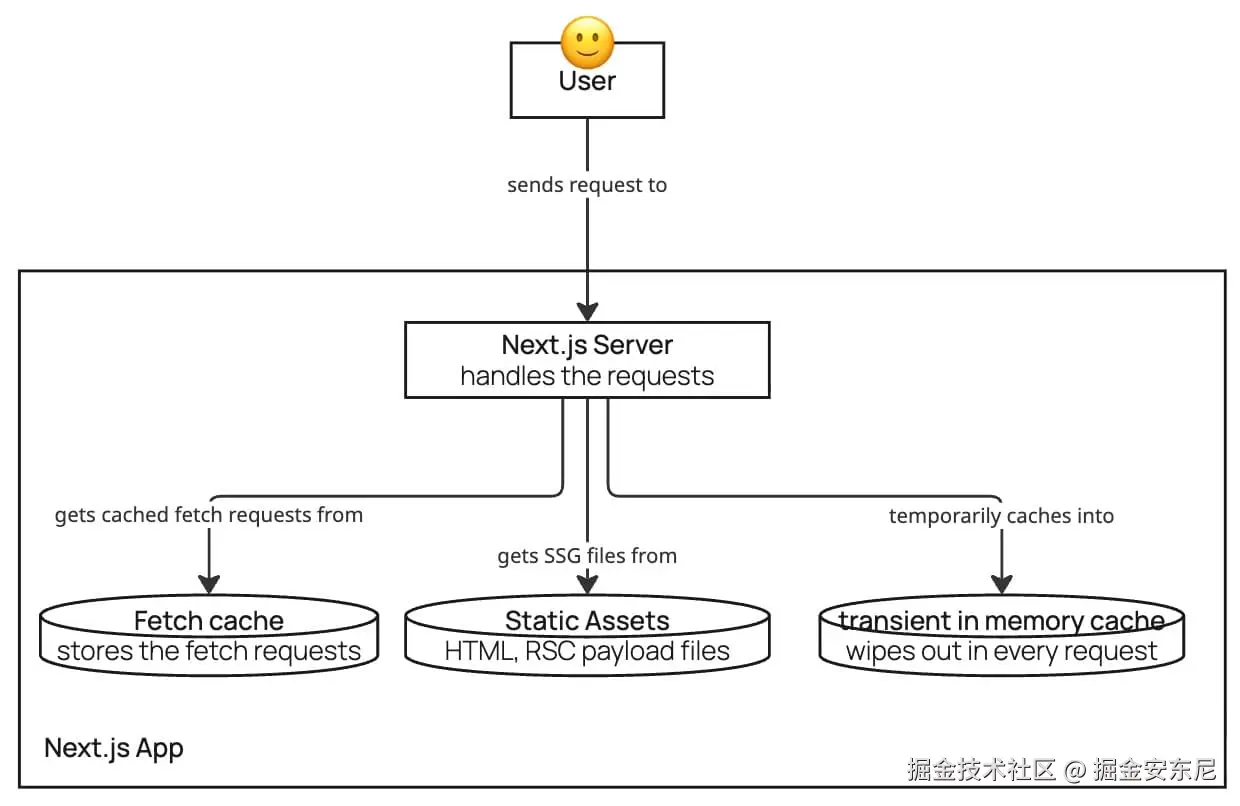

接着,Next.js 会先查内部缓存:

- 如果存在可复用的有效缓存,则直接命中返回。

- 如果没有,则生成响应并缓存,供后续请求复用。

文章强调:Next.js 的缓存发生在多个阶段。

构建阶段(Build time)可能会预生成页面 HTML、静态资源以及 RSC payload 文件------这就是 SSG 的本质:请求还没来,内容已经提前算好了。

运行阶段(Runtime)每个请求也会尝试命中缓存:可能命中预生成 HTML、RSC payload,或命中 fetch 结果(通常落在文件系统缓存里)。如果你额外使用 React cache 或自定义缓存,也会参与最终响应的生成。

一个关键问题是:当你部署多个相同应用实例时,每个实例的本地缓存是彼此隔离的------这会直接引出分布式缓存挑战(后文会讲)。

让 Next.js 先跑快:横向扩容前的"容易收益"

在开始复杂的横向扩容(scale out)之前,先把低成本高收益的优化做掉。

1) CDN

CDN 往往是"ROI 最大、复杂度最低"的优化:合理设置缓存头并接入 CDN,延迟可下降 30%~70%。

示例 1:在 Route Handler 中设置 Cache-Control

ts

// /api/hello/route.ts

import { NextResponse } from "next/server";

export async function GET() {

return NextResponse.json(

{ message: "Hello World" },

{

status: 200,

headers: {

// CDN 缓存:缓存 1 小时,回源再验证期间允许使用旧内容

"Cache-Control": "public, s-maxage=3600, stale-while-revalidate=59",

},

}

);

}示例 2:为静态资源自定义缓存头

ts

// next.config.ts

import type { NextConfig } from "next";

const nextConfig: NextConfig = {

async headers() {

return [

{

// CDN 缓存 /public/images 下的图片 30 天

source: "/images/:path*",

headers: [{ key: "Cache-Control", value: "public, max-age=2592000, immutable" }],

},

{

// Next.js 构建产出的 JS/CSS chunk 缓存 1 年

source: "/_next/static/:path*",

headers: [{ key: "Cache-Control", value: "public, max-age=31536000, immutable" }],

},

];

},

};

export default nextConfig;2) 纵向扩容(Vertical scaling)

纵向扩容依然是快速且有效的策略:通过分析应用逻辑,确定资源基线并为峰值预留 buffer,很多情况下能在"几乎不改代码"的前提下显著提升承载能力。

3) 编码最佳实践

通过工程实践提升性能,避免基础设施过度改造:

- 渲染策略:使用异步组件与 Partial Prerendering(PPR)来更快地交付内容、改善核心指标。

- DOM 优化:控制 DOM 规模,减少过深嵌套,提升 SSR 与客户端渲染性能。

- 保持框架更新 :

- React 19+ 引入 React Compiler(通过配置启用),可自动做 memoization。

- Next.js 16+ 引入

use cache,让组件/Server Actions 的缓存更省力。

文中给了 PPR 的示例(表达的是"静态壳先到,动态内容流式补上"):

ts

// next.config.ts

import type { NextConfig } from "next";

const nextConfig: NextConfig = {

cacheComponents: true,

};

export default nextConfig;

tsx

// app/page.tsx

import { Suspense } from "react";

export default function Page() {

return (

<>

<h1>Static shell (sent immediately)</h1>

<Suspense fallback={<p>Loading...</p>}>

<AsyncContent />

</Suspense>

</>

);

}

async function AsyncContent() {

const data = await fetch("/api/data").then((r) => r.json());

return <div>{data.message}</div>;

}横向扩容:副本与负载均衡

**横向扩容(Horizontal scaling / scale out)**指把同一个服务部署成多个副本,由负载均衡器作为入口分发流量。常见算法包括:

- Round Robin(轮询)

- Weighted Round Robin(加权轮询)

- Least Connections(最少连接)

- IP Hash(按 IP 固定路由,形成粘性会话)

横向扩容的架构挑战

1) 实现无状态(Statelessness)

要想"任意副本都能处理任意请求",应用最好无状态:

- 把会话等状态外置到数据库或全局缓存

- 如果无法做到完全无状态,可通过负载均衡的 IP Hash 实现 Sticky Sessions

2) 分布式缓存问题

Next.js 默认把缓存落到本地文件系统。多实例时,每台机器都有自己的缓存,会导致:

- 冷缓存(cold cache)问题

- 命中率下降

解决方向是引入所有副本可共享的缓存:

- 共享盘(不推荐,容易引入并发与扩展瓶颈)

- Redis 集群(推荐,通过自定义 cache handler 共享缓存)

参考:Next.js 官方示例(Redis Cache Handler)

战略性扩容与自动化

领域驱动扩容:微前端(Micro-Frontends)

不一定要整体复制整个系统。你可以按 DDD(领域驱动设计)把应用拆成多个子域,按热点域独立扩容。例如电商里"商品"域可能需要更多副本,"个人资料"域则少一些。

Kubernetes 自动扩缩容

用 Kubernetes 等平台把容器化的应用按实时负载自动扩缩容:流量高峰时扩容、副本增加;低谷时回收资源,降低成本。

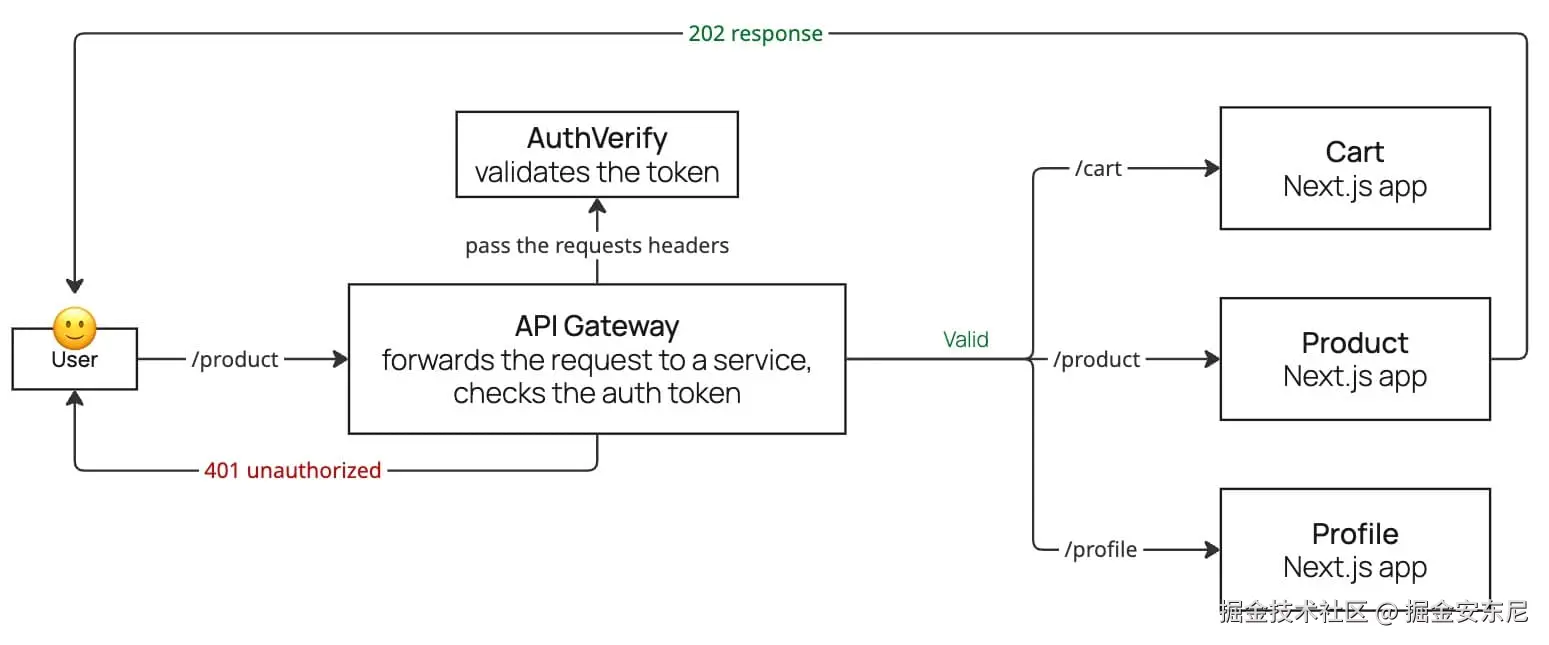

API Gateway

把认证、缓存等横切关注点抽到统一层,可以显著提升可维护性与可扩展性。文章把"鉴权"作为典型例子:当每个应用都在 proxy.ts 里重复做鉴权时,它很适合被抽到 API Gateway。

API Gateway 位于受保护基础设施之前,作为反向代理并负责 TLS 终止。终止 TLS 后,网关与内部服务之间可以走内网 HTTP,降低开销。

文中用 Nginx 配置展示该模式:

nginx

http {

upstream cart_app { server localhost:3001; }

upstream product_app { server localhost:3002; }

upstream profile_app { server localhost:3003; }

server {

listen 80;

location = /auth-verify {

internal;

proxy_pass http://your-auth-api/validate;

proxy_pass_request_body off;

proxy_set_header Content-Length "";

}

location /cart {

auth_request /auth-verify;

proxy_pass http://cart_app;

}

location /product {

auth_request /auth-verify;

proxy_pass http://product_app;

}

location /profile {

auth_request /auth-verify;

proxy_pass http://profile_app;

}

error_page 401 = @error401;

location @error401 {

return 401 "Unauthorized - Invalid Token";

}

}

}优化文件上传:从本地磁盘到对象存储

本地存储的缺点

把用户上传文件直接存到应用服务器本地盘,会带来三类风险:

- 持久性差:硬盘故障或机器宕机可能导致永久丢失

- 扩展性差:大文件传输会吃带宽和 CPU,拖慢处理其他请求

- 基础设施压力:后续再把文件搬到长期存储,徒增内部流量与复杂度

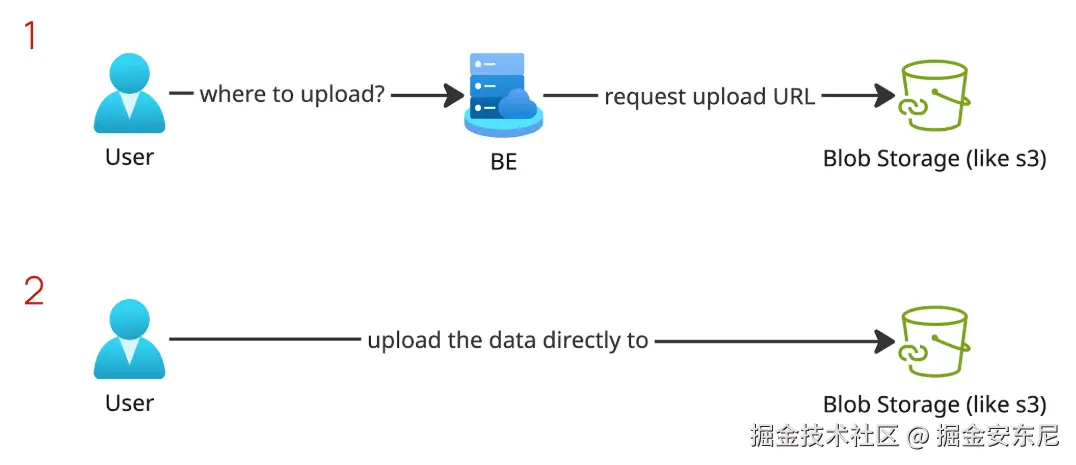

现代方案:Blob Storage + Signed URL

企业级常见做法是使用 S3 / GCS / Azure Blob 等对象存储。关键在于 Signed URL 直传:

- 应用生成临时签名 URL

- 浏览器绕过应用服务器,直接把文件上传到对象存储

这样可以把大流量文件传输从你的应用节点"卸载"出去,提高扩展能力并降低延迟。

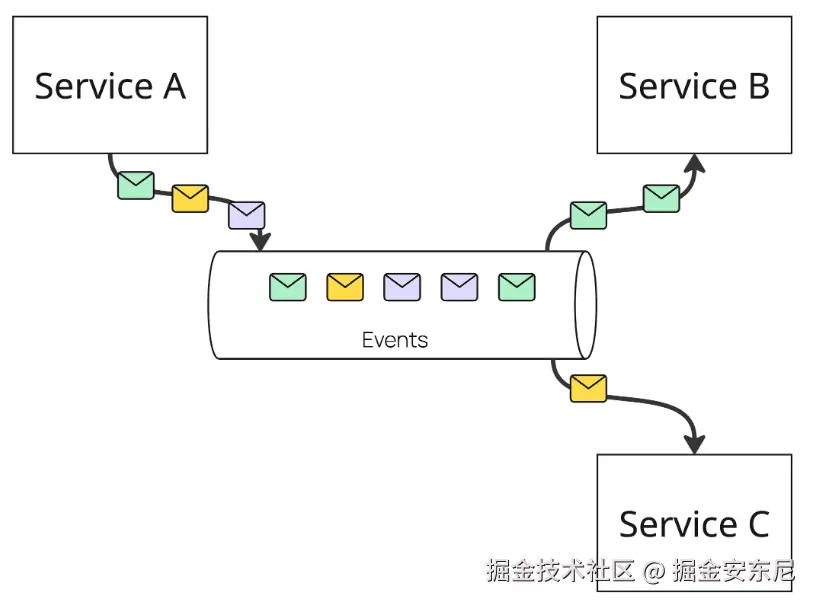

事件驱动架构:应对高并发交互

很多用户行为会触发一串内部调用。例如"加入购物车"可能需要:购物车服务、埋点分析、日志、库存系统(SAP)......当并发很高时,同步串行调用会让系统迅速变慢甚至崩溃。

文章建议用 事件驱动架构(EDA) 解耦:

- 主流程只负责发出事件并快速返回

- 下游任务异步处理

- Kafka 等事件总线可以做缓冲:即便某个老系统很慢,前台请求也不至于被拖垮

- 下游服务短暂故障时,主流程仍可成功,待恢复后再补处理

通信协议优化:HTTP/2 与 gRPC

HTTP/2 的优势

HTTP/2 主要通过:多路复用、二进制分帧、HPACK 头压缩 等特性,解决 HTTP/1.1 的连接与性能瓶颈。

Nginx 启用 HTTP/2 的配置示例:

nginx

server {

listen 443 ssl http2;

server_name api.example.com;

}内部服务通信:gRPC vs REST

对外 API 常用 REST,但内部服务间通信 gRPC 往往更合适:

- 默认基于 HTTP/2

- Protobuf 二进制比 JSON 更小、更省 CPU

- 强类型契约降低协作错误

总结

企业级 Next.js 的关键,是在默认能力之上补齐工程化与架构能力:

- 定清 SLA / SLO 并建立监控与压测

- 理解请求生命周期与缓存行为

- 先做 CDN、缓存头、编码实践等"低成本高收益"优化

- 进入横向扩容后,用共享缓存(例如 Redis)解决多副本命中率问题

- 把鉴权等横切逻辑上移到 API Gateway

- 文件上传用对象存储直传

- 高吞吐交互用事件驱动解耦

- 合适场景引入 HTTP/2 / gRPC

文章最后的建议很务实:不需要一次性把所有手段都上齐。先从你当前最痛的瓶颈开始(例如 CDN 或缓存策略),用 SLO 衡量效果,然后迭代推进。