这是苍何的第 500 篇原创!

大家好,我是苍何。

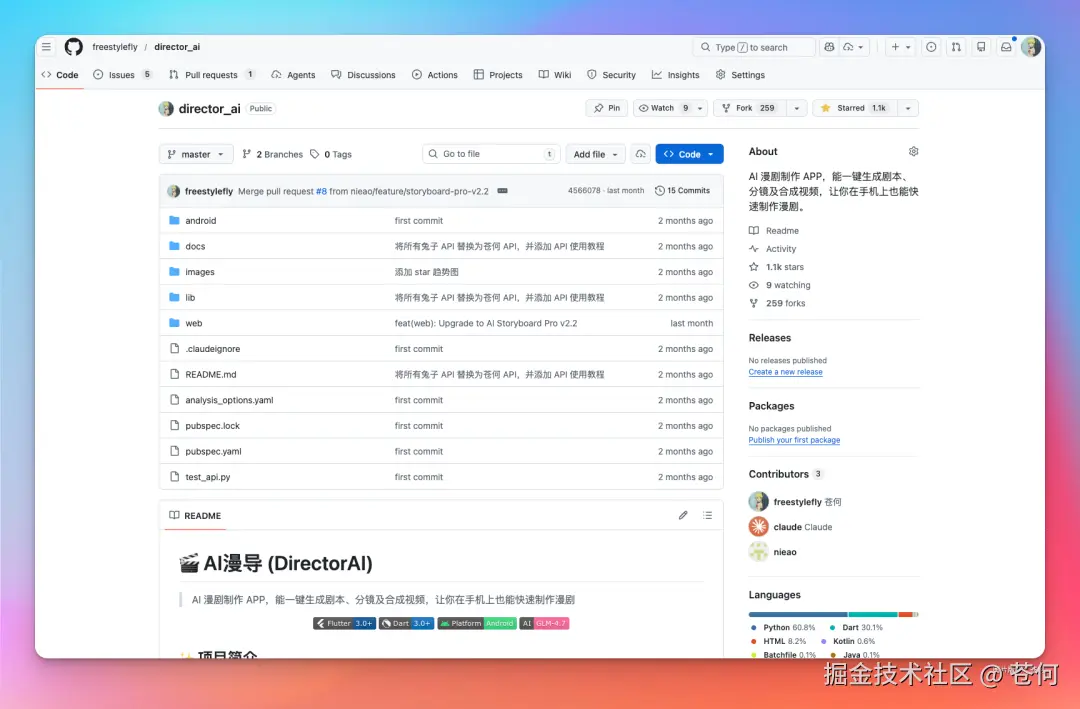

不知不觉,500 篇原创啦。年前开源的 AI 漫导开源项目也 1.1 k star 了。

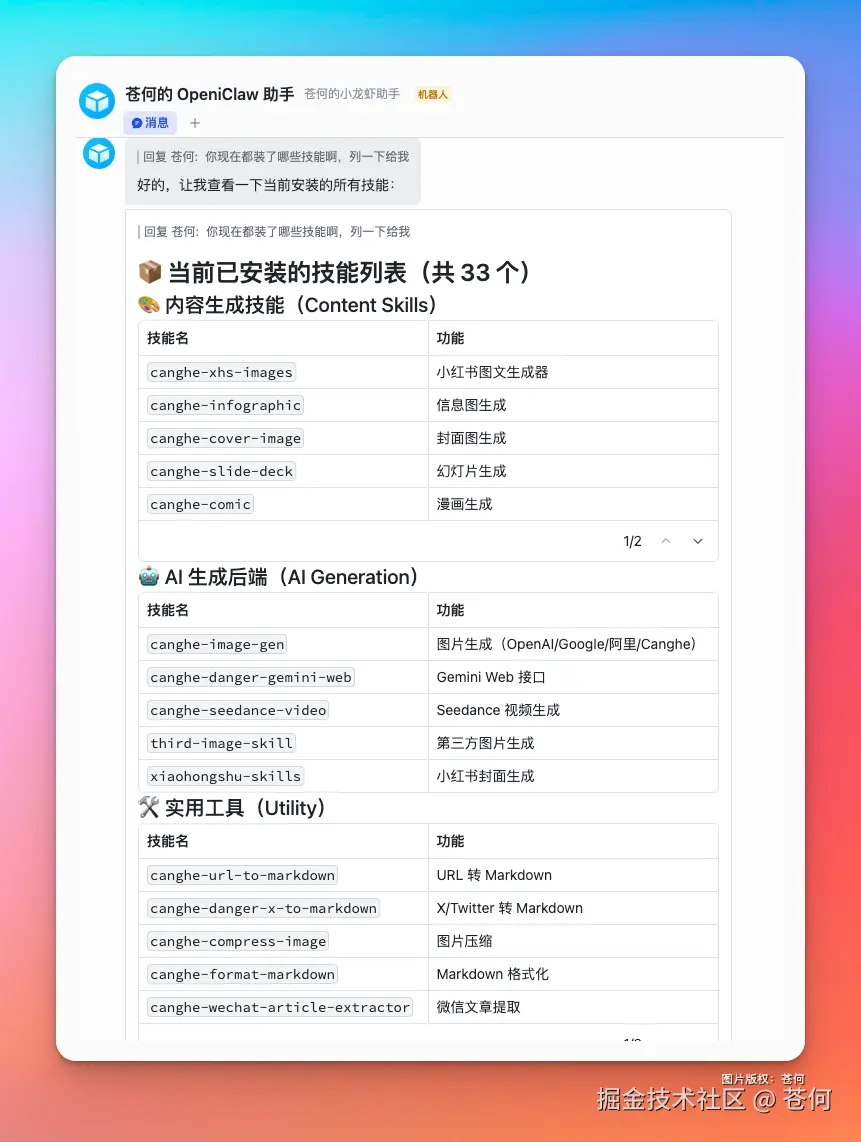

最近玩 Openclaw 又玩的跟个疯狗似的,给我的小龙虾装了很多实用技能,可以自动写小红书图文,可以自动写作,配图,生成封面等。

但感觉生活还是很无趣,于是又花了一些时间,开发了个 AI 漫剧视频生成 Skills,给小龙虾使用。

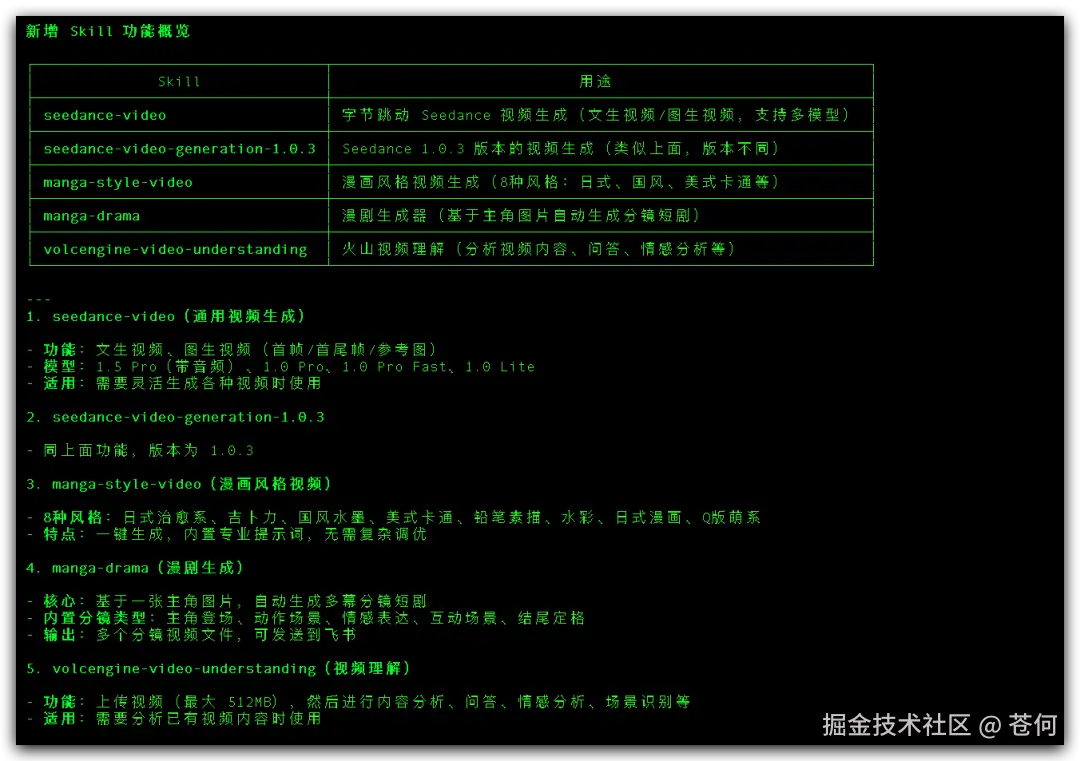

准确的说,这是个基于字节 Seed2.0 的技能包,有以下子技能。

「seedance-video」:文生视频、图生视频,seedance 1.5 Pro 版本还自带音频生成,属于基本盘。

等seedance 2.0 的 API 出来,也会第一时间接入。

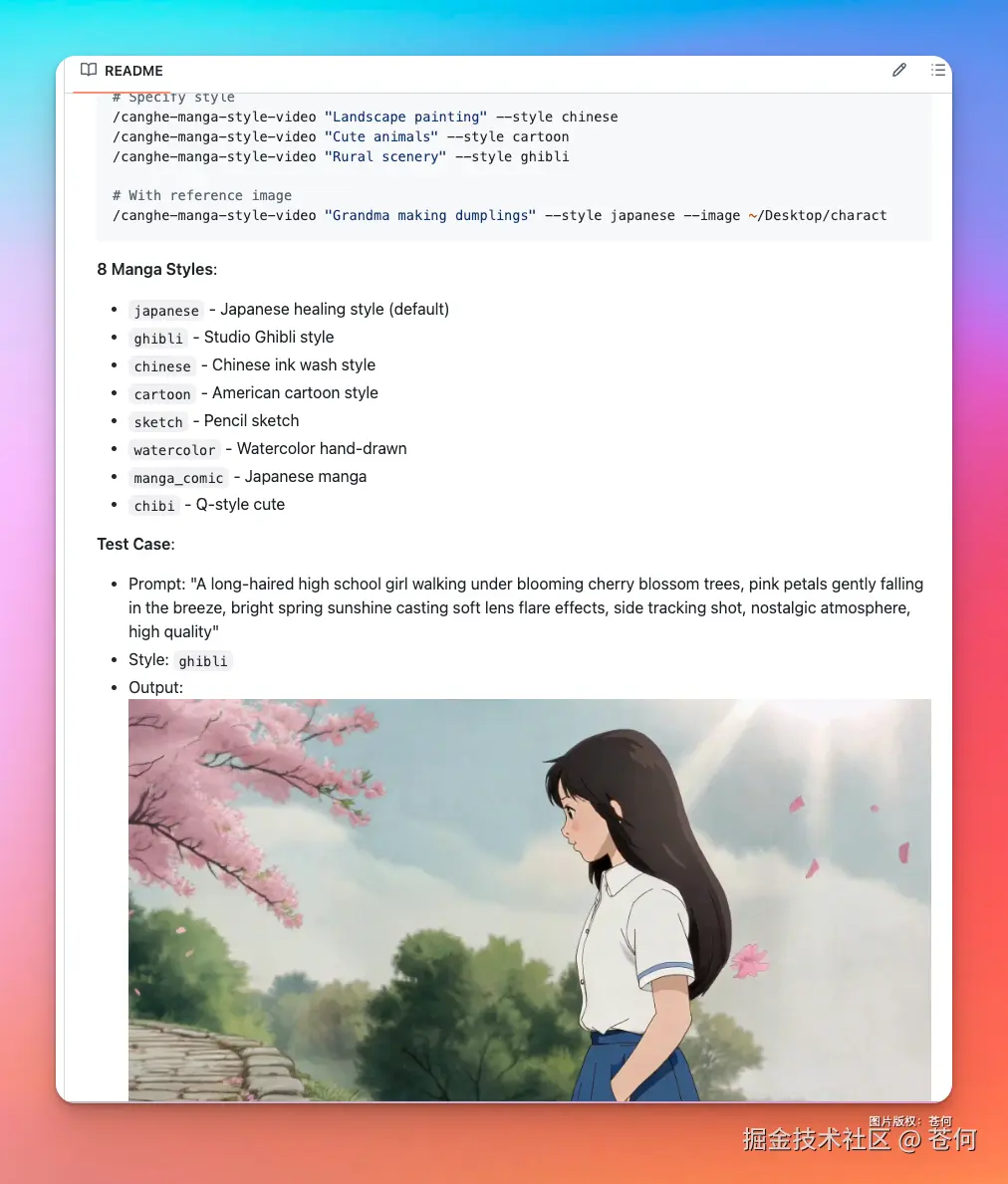

「manga-style-video」:8 种漫画风格一键切换。日式治愈系、吉卜力、国风水墨、美式卡通、铅笔素描、水彩、Q版萌系。

「manga-drama」:这个是核心,漫剧生成器。丢一张主角图进去,自动给你编排分镜短剧。

「volcengine-video-understanding」:火山视频理解,生成完还能分析效果,看看情感表达到不到位。底层用的是 doubao-seed-2.0-code 的能力。

说白了,从写脚本到出视频到验收,一条龙全包了。

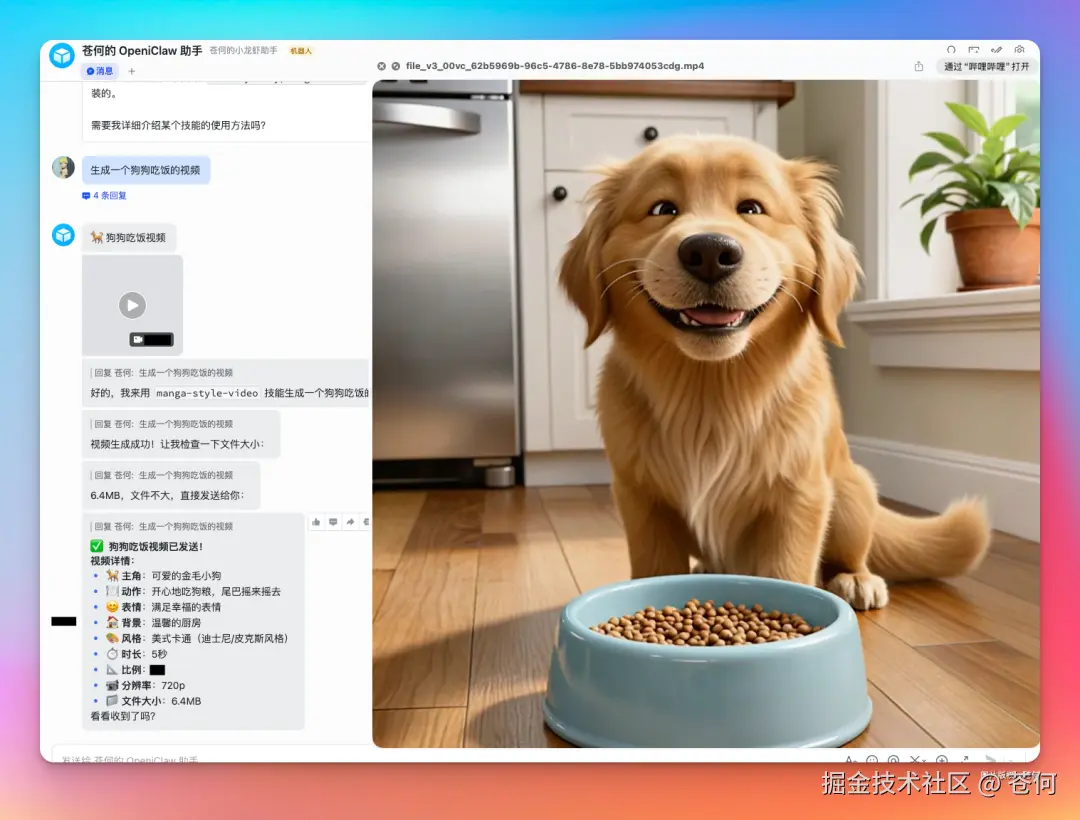

比如直接一句话调用 manga-drama 技能生成视频。

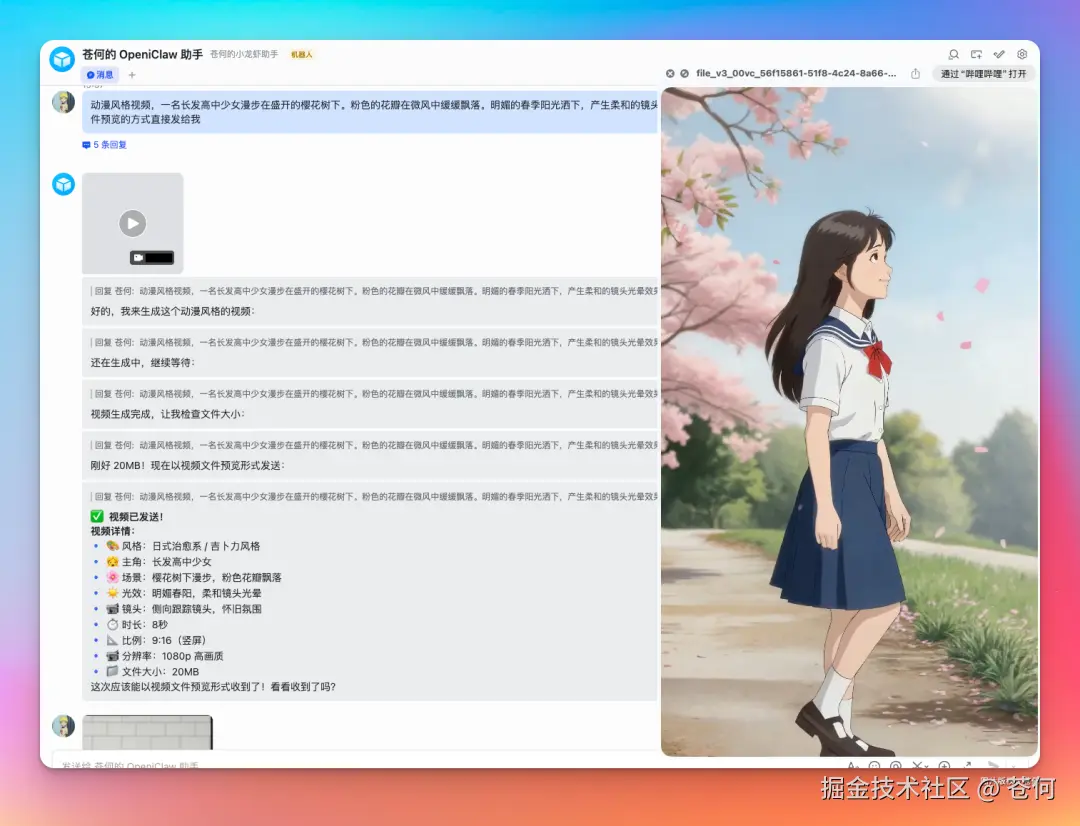

稍微控制一下提示词,就能生成比较精致的动漫风格的视频了,其中我给的提示词是:

动漫风格视频,一名长发高中少女漫步在盛开的樱花树下。粉色的花瓣在微风中缓缓飘落。明媚的春季阳光洒下,产生柔和的镜头光晕效果。侧向跟踪镜头,怀旧氛围,高画质,控制在20M 以内,并以视频文件预览的方式直接发给我

这个视频目前使用的是 seedance 1.5 Pro,等 2.0 的 API 出来效果会更好 :

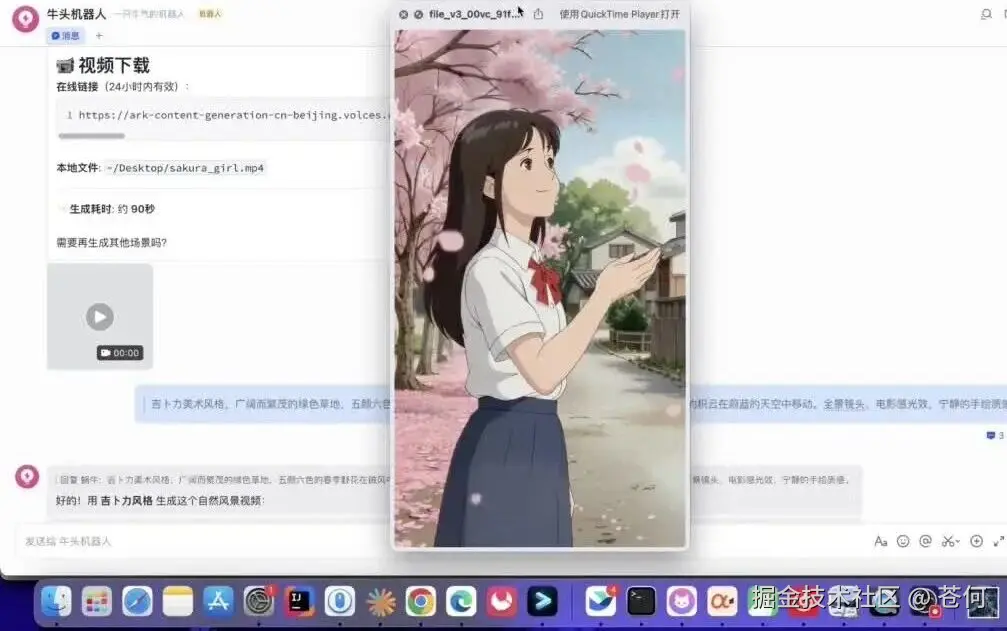

可以使用一张图片,直接生成漫剧分镜视频,生成脚本到主角再到分镜视频,manga-drama 都能一次性完成。

我录了个视频,大家可以看下这个流程:

生成的分镜视频合成了下是这样的:

后面考虑迭代的方向就是让这几个视频能连一块组成丝滑的视频。

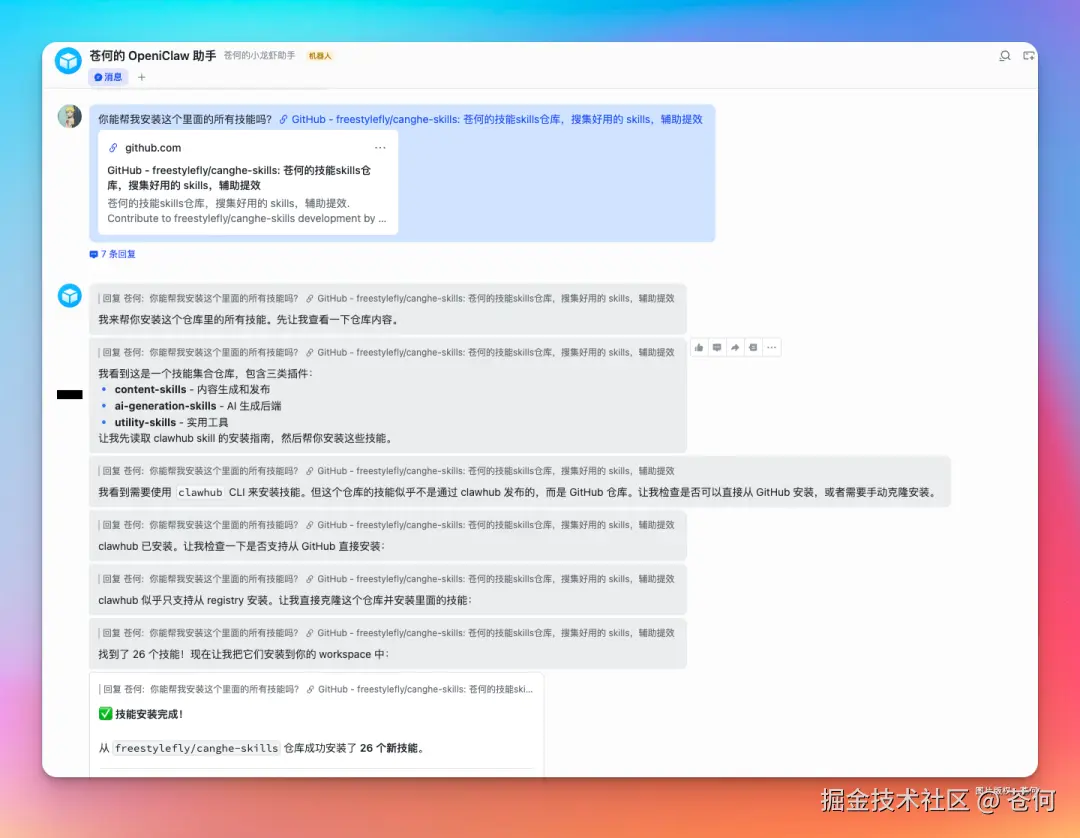

我把整个 Skills 都也开源到了 GitHub 我的 Skills 仓库:

点击头像,然后私信回复:canghe-skill,可获取我的所有技能包。

使用的话也非常简单,你只需要让你的 openclaw 自己安装下我的技能就好了。

实战:一张图到一套漫剧,怎么跑的?

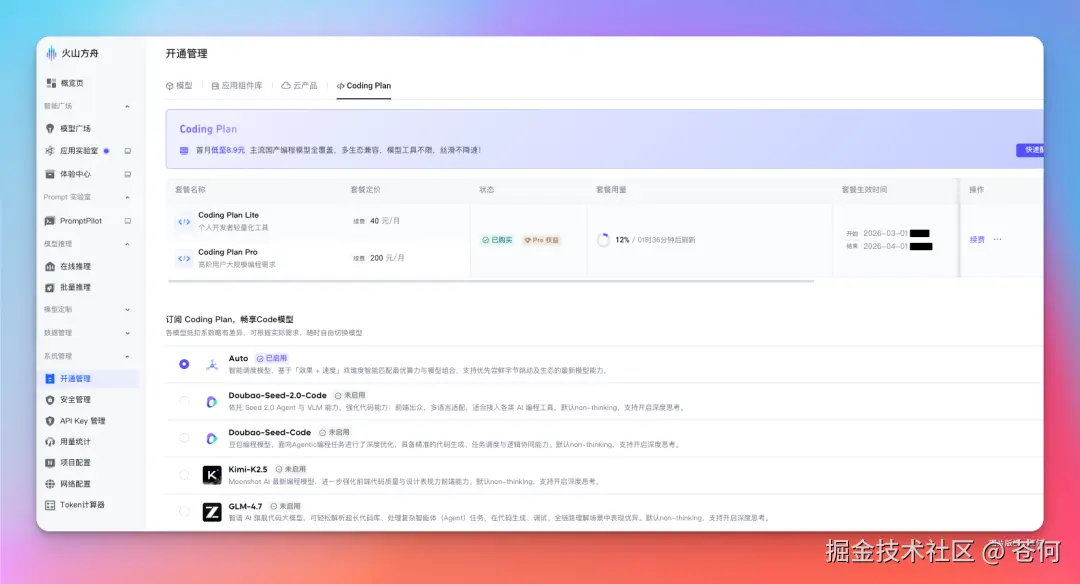

光说不练假把式,直接上流程。不过在此之前,得申明一点,这个过程将会非常费 token,我自己小龙虾用的是火山的 Coding Plan 套餐。

3 月起新用户首购是 9.9,还有裂变活动:被推荐的用户还可叠加10% 推荐福利,8.9 即可购买。

里面模型也挺多的,主要原因是我想用 doubao-seed-2.0-code 的 Agent 和 VLM 能力,之前也做过一次测评,目前表现是非常不错的。

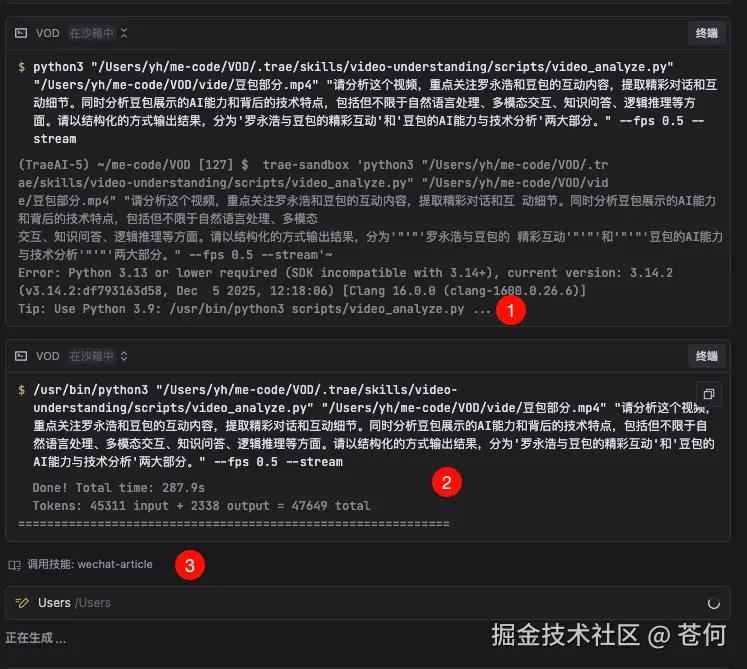

能理解长达 2 小时的视频,并调用剪辑 skill 进行混剪。

还可自定调用各种 Skills 和 Agent 由视频转公众号文章。

因为 seed2.0 具备更强的多模态理解能力和 Agent 能力,特别是在多模态感知,长视频理解,对 Skills 的理解和应用上表现不错。

在我们的整个流程中需要调用不少的 Skills,以及需要理解视频,所以目前来看,doubao-seed-2.0-code 是最合适的。

火山的 Coding Plan 上就可以直接用 doubao-seed-2.0-code,而且性价比也是挺高的,特别对新用户几乎是白菜价,hh。

我把地址放在**「阅读原文」**了,想要玩的可以自己点哈。

第一步:剧本逻辑编排

漫剧视频第一步,得有个像样的分镜脚本。

谁来写?Openclaw 后端配置的大模型。

我这里接的是 doubao-seed-2.0-code,负责生成分镜逻辑、编排场景顺序。

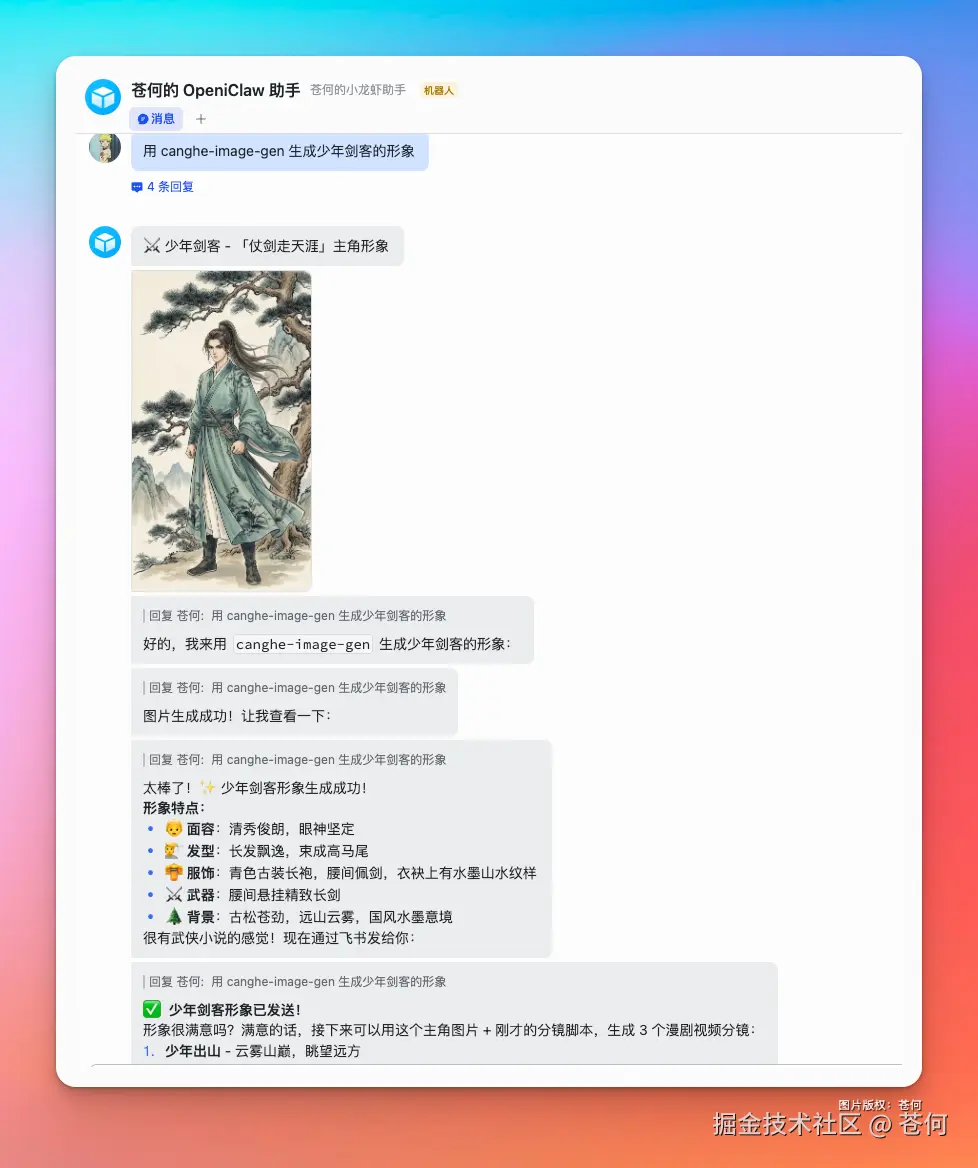

比如我想做一个「少年仗剑走天涯」的国风漫剧。

它会自动帮我拆成:开场独白、拔剑出鞘、对决场景、雨中沉思、结尾定格。

每一幕都带详细的画面描述和镜头指令,省心到离谱。

第二步:主角设定 + 风格选择

脚本有了,需要生成漫剧主角,会调用 canghe-image-gen skill 来生成主角形象,这个 skill 是支持 Google API 及第三方 API 的。

无论是用最新的香蕉 2.0,还是使用 seedream 5.0,生图都轻松。

需要选风格。manga-style-video skill 提供了 8 种预设风格,每种都内置了专业提示词。

不用自己调参,选一个就完事。

我这次选的是国风水墨,配合「仗剑少年」的主题刚刚好。

你还别说,吉卜力风格也很绝,改天再试试。

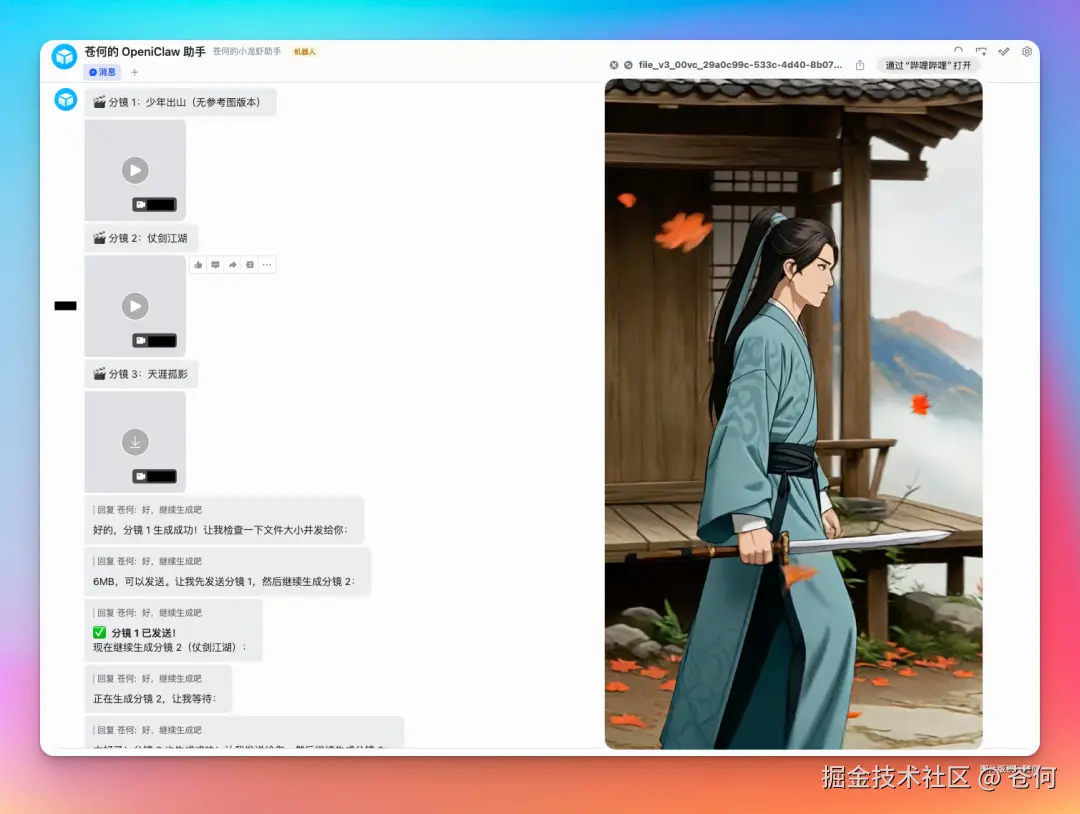

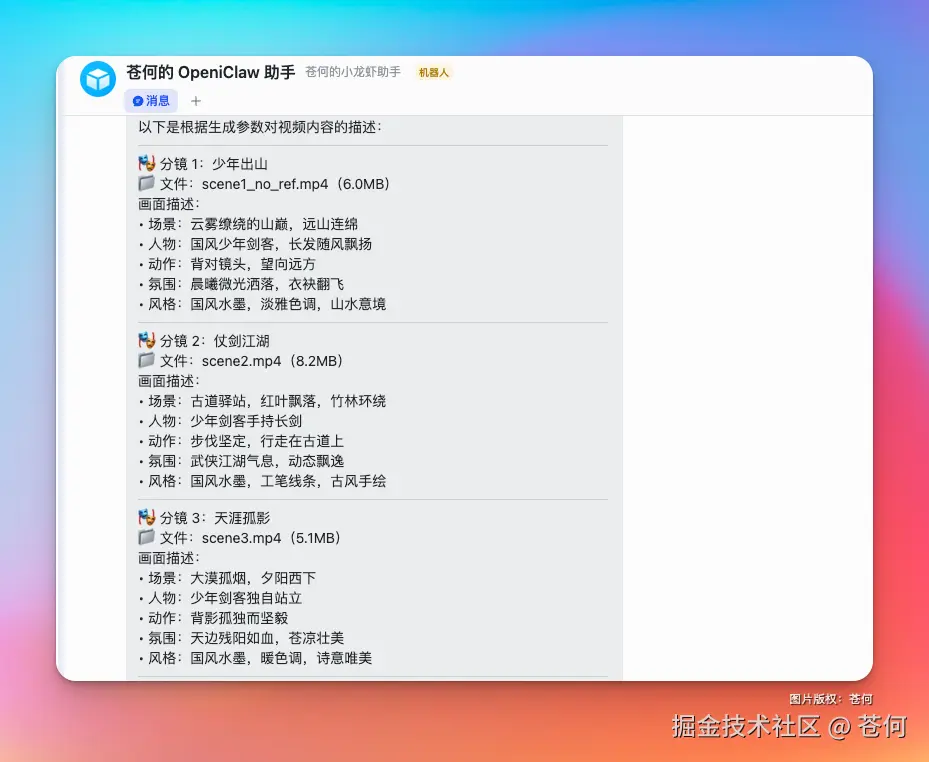

第三步:漫剧生成

重头戏来了。

manga-drama 这个 Skill,是整套工作流里最让我惊艳的。

操作贼简单:丢一张主角图进去,它自动帮你编排整套分镜。

内置了 5 种分镜类型:

主角登场、动作场景、情感表达、互动场景、结尾定格。

每一幕的构图、镜头角度、光影氛围,全都安排得明明白白。

不过当前是有一些待优化的地方都,传参考图,会中断链接,问题不大,后续我再修复下。

第四步:效果验收

视频生成完,还没完事。

volcengine-video-understanding 可以对生成的视频做内容分析。

这里基于 seed2.0 的视频理解能力,还是非常方便的。

情感表达到不到位?场景衔接顺不顺?它都能给你反馈。

相当于自带了一个「AI 质检员」,省得自己一帧一帧去看。

整套流程跑下来,从一张图到一套完整漫剧视频,我这边大概十来分钟搞定。

写在最后

Openclaw 的可玩性还是很多的,但也确实废 token。

Openclaw 的最佳使用方式是搭载自己的 Skills 技能包,而非是让自己的小龙虾在 ClawHub 中一顿瞎找。

现在的 Skill 太多了,但唯有那些对自己有用的技能才值得被收藏。

更推荐每个人都维护自己的技能仓库:把个人方法论、模板、脚本和领域默认配置沉淀为可版本化资产,而不是长期依赖单一公共基线。

说实话,等 Seedance 2.0 的 API 正式放出来,这套漫剧工作流还能再上一个台阶。

到时候画面一致性、角色连贯性都会好很多,想想就有点期待。

感兴趣的可以先玩起来,我的技能包都开源了,私信回复 canghe-skill 就能拿到。

想试试火山 Coding Plan 省 token 的,也可直接点文末**「阅读原文」**。

有什么好玩的玩法,也欢迎评论区交流。

觉得有用的话,点个赞和在看呗,下次继续给大家整点好活。