Netty 4.2 入门指南:从概念到第一个程序

😄生命不息,写作不止

🔥 继续踏上学习之路,学之分享笔记

👊 总有一天我也能像各位大佬一样

🏆 博客首页 @怒放吧德德 To记录领地 @一个有梦有戏的人

🌝分享学习心得,欢迎指正,大家一起学习成长!

转发请携带作者信息 @怒放吧德德(掘金) @一个有梦有戏的人(CSDN)

前言

在Java后端开发中,网络编程是绕不开的话题,而Netty作为高性能异步事件驱动的网络应用框架,几乎成为分布式系统、中间件(如Dubbo、RocketMQ)开发的标配。本文基于Netty 4.2版本,从基础概念入手,讲解核心组件,最后通过一个简单Demo,帮助大家快速上手Netty开发。

1. 什么是Netty

1.1 Netty 核心定位与优势

Netty是由JBoss提供的一个开源、异步、事件驱动的Java网络编程框架,本质上是对Java NIO(New I/O)的封装与优化,解决了原生NIO开发繁琐、易出错、性能优化难度大等问题。

与原生NIO相比,Netty的核心优势的体现在:

- 简化开发:封装了NIO的复杂API,提供简洁易用的接口,开发者无需关注底层IO细节,专注业务逻辑即可;

- 高性能:基于Reactor模式设计,支持高并发、低延迟,能轻松应对百万级连接场景;

- 高可靠性:内置完善的异常处理、连接管理、内存管理机制,稳定性远超原生NIO;

- 可扩展性强:支持自定义协议、编解码,适配各种网络场景(TCP/UDP、HTTP、WebSocket等)。

1.2 Netty 4.2版本关键特性

Netty 4.2版本于2025年4月正式发布,是在4.1版本基础上的升级优化,保持了API的向后兼容性(4.1.x版本可无缝升级),同时带来了多个重要特性:

- 默认启用自适应内存分配器(AdaptiveByteBufAllocator),替代4.1版本的池化分配器,能自动适配工作负载,降低内存占用,提升性能;

- 统一事件循环组实现(MultiThreadIoEventLoopGroup),打破了此前版本中EventLoopGroup与具体传输方式(NIO、Epoll)的耦合,扩展性大幅提升;

- 要求JDK 8及以上版本(JDK 9+支持IO_uring),依托新版本JDK的特性进一步优化性能;

- 增强事件循环的可定制性,支持监控IO处理与任务处理的耗时,方便性能调优。

2. Netty 4.2 核心组件

Netty的核心组件围绕"事件驱动"和"管道模型"设计,各组件分工明确、协同工作,入门阶段只需掌握以下6个核心组件的基础作用即可。

2.1 Channel(通道)

Channel是Netty中表示"网络连接"的核心接口,类比于Java NIO中的Socket,封装了底层的IO操作(读、写、连接、关闭)。每一个客户端与服务器的连接,都会对应一个Channel实例。

Netty 4.2中常用的Channel实现有:NioServerSocketChannel(服务端监听通道)、NioSocketChannel(客户端连接通道),以及针对Linux系统优化的EpollSocketChannel等。

2.2 EventLoop 与 EventLoopGroup(事件循环)

2.2.1 核心作用

EventLoop(事件循环)是Netty的"线程管家",负责处理Channel上的所有IO事件(如连接建立、数据读写)和任务(普通任务、定时任务),采用"单线程绑定单Channel"的设计,避免线程竞争,提升效率。

EventLoopGroup(事件循环组)是多个EventLoop的集合,负责管理EventLoop的生命周期,本质上是一个线程池。在服务端开发中,通常会创建两个EventLoopGroup:

- BossGroup:负责监听客户端连接请求,接收连接后,将Channel交给WorkerGroup处理;

- WorkerGroup:负责处理已建立连接的IO事件(数据读写)。

2.2.2 4.2版本变化

Netty 4.2中,EventLoopGroup的实现得到统一,不再需要为不同传输方式(NIO、Epoll)创建不同的EventLoopGroup,而是通过注入不同的IoHandler实现适配,例如:

// 4.1版本写法:不同传输对应不同EventLoopGroup

new NioEventLoopGroup(); new EpollEventLoopGroup();

// 4.2版本写法:统一使用MultiThreadIoEventLoopGroup

new MultiThreadIoEventLoopGroup(NioIoHandler.newFactory());

2.3 ChannelHandler 与 ChannelPipeline(处理器与管道)

ChannelHandler是Netty中处理业务逻辑的核心组件,负责处理Channel上的入站(数据接收)和出站(数据发送)事件,例如编解码、数据校验、业务逻辑处理等。

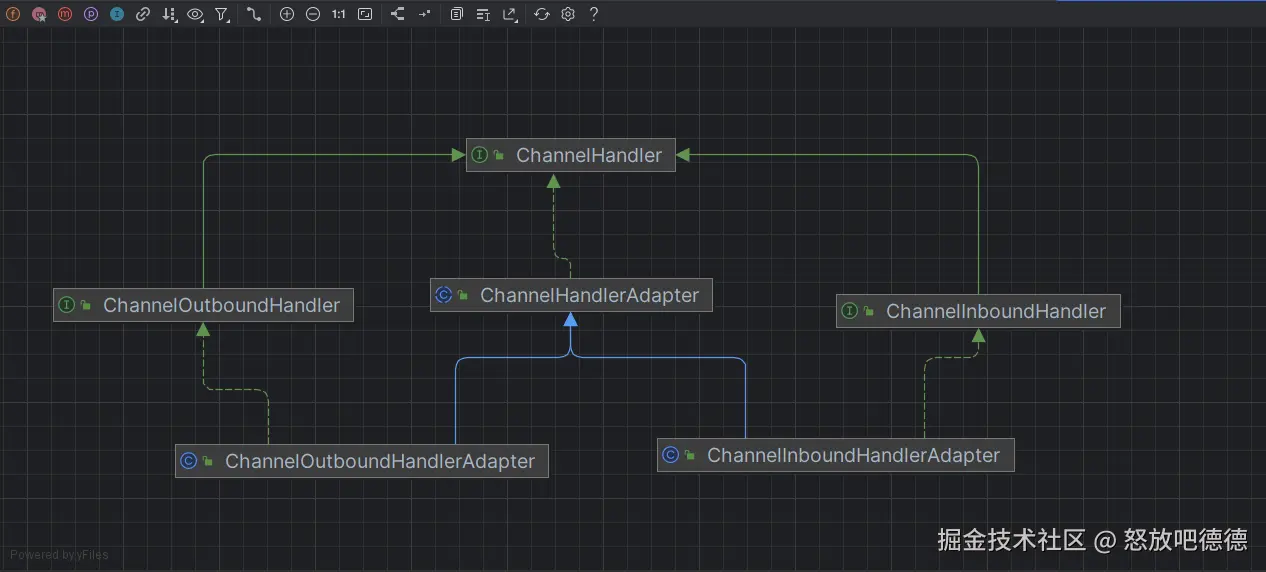

这张图展示了 Netty 中核心的 ChannelHandler 相关接口与类的继承关系,它主要运用了 适配器模式(Adapter Pattern)和装饰器模式(Decorator Pattern) 的思想。

- 类与接口的关系

- ChannelHandler:这是最顶层的接口,定义了处理 Channel 事件的基本契约。

- ChannelInboundHandler 和 ChannelOutboundHandler:这两个接口都继承自

- ChannelHandler,分别定义了处理入站(Inbound,数据从远端到本地)和出站(Outbound,数据从本地到远端)事件的方法。

- ChannelHandlerAdapter:这是一个抽象类,实现了 ChannelHandler 接口,为所有的

- ChannelHandler 提供了默认的空实现。

- ChannelInboundHandlerAdapter 和 ChannelOutboundHandlerAdapter:这两个类分别继承自

- ChannelHandlerAdapter,并分别实现了 ChannelInboundHandler 和

- ChannelOutboundHandler 接口。它们为对应接口的所有方法提供了默认的空实现。

- 用到的设计模式

- 适配器模式(Adapter Pattern)

- 核心作用:ChannelInboundHandlerAdapter 和 ChannelOutboundHandlerAdapter 是典型的适配器。它们将 ChannelInboundHandler 和 ChannelOutboundHandler 接口中定义的大量方法,都提供了默认的空实现。

- 好处:开发者在自定义 Handler 时,只需要继承这些 Adapter 类,并重写自己关心的方法即可,

- 不必实现接口中的所有方法,大大简化了开发。

- 装饰器模式(Decorator Pattern)

- 核心作用:在 Netty 的 ChannelPipeline 中,多个 ChannelHandler 可以串联起来,形成一个处理链。每个 Handler 都可以对数据进行加工、转换或拦截,然后传递给下一个 Handler。

- 好处:这种设计使得功能可以灵活组合和扩展,就像给核心功能不断添加新的 "装饰" 一样。

- 适配器模式(Adapter Pattern)

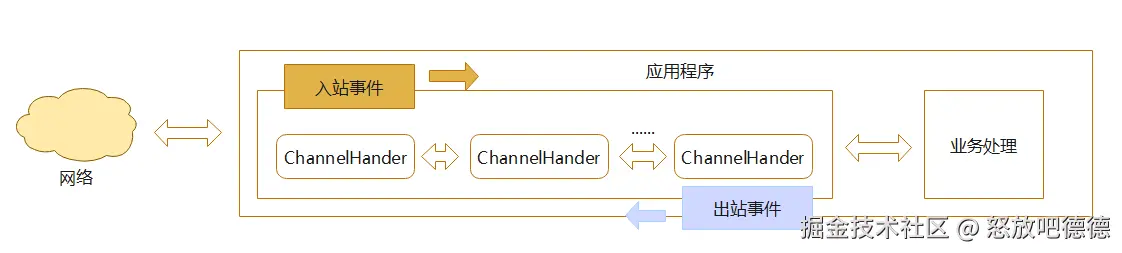

ChannelPipeline(管道)是ChannelHandler的"容器",本质是一个双向链表,将多个ChannelHandler按顺序组织成责任链。当IO事件发生时,事件会沿着Pipeline中的Handler依次传递,实现逻辑的解耦与复用。

常用的ChannelHandler类型:ChannelInboundHandler(处理入站事件)、ChannelOutboundHandler(处理出站事件)。

2.4 ByteBuf(字节缓冲区)

ByteBuf是Netty提供的字节容器,用于替代Java NIO的ByteBuffer,解决了ByteBuffer读写切换繁琐、容量固定等问题。Netty 4.2中,ByteBuf默认使用自适应内存分配器,支持池化、零拷贝、读写索引分离等特性,能有效减少GC压力,提升内存使用效率。

2.5 Bootstrap 与 ServerBootstrap(启动器)

Bootstrap是Netty的"启动工具类",用于快速配置和启动客户端或服务端,封装了繁琐的初始化流程。分为两种:

- Bootstrap:用于启动客户端,只需配置一个EventLoopGroup;

- ServerBootstrap:用于启动服务端,需要配置BossGroup和WorkerGroup两个EventLoopGroup。

2.6 ChannelFuture(异步结果)

Netty的所有IO操作都是异步的,ChannelFuture用于表示异步操作的结果(成功、失败、未完成)。通过ChannelFuture可以注册监听器,在异步操作完成时触发回调,处理结果或异常。

3. 第一个Netty程序(Demo实战)

本Demo实现一个简单的"回声服务":客户端向服务端发送消息,服务端接收消息后,原样返回给客户端,全程基于Netty 4.2版本实现,步骤清晰,可直接复制运行。

3.1 环境准备

3.1.1 JDK版本

要求JDK 8及以上(推荐JDK 11),满足Netty 4.2的运行要求。

3.1.2 Maven依赖

在pom.xml中添加Netty 4.2最新依赖(本文使用4.2.7.Final):

xml

<dependency>

<groupId>io.netty</groupId>

<artifactId>netty-all</artifactId>

<version>4.2.7.Final</version>

</dependency>3.2 服务端实现

服务端负责监听端口、接收客户端连接、处理客户端消息并返回,核心步骤:创建EventLoopGroup、配置ServerBootstrap、定义业务处理器。

java

import io.netty.bootstrap.ServerBootstrap;

import io.netty.channel.ChannelFuture;

import io.netty.channel.ChannelInitializer;

import io.netty.channel.ChannelOption;

import io.netty.channel.MultiThreadIoEventLoopGroup;

import io.netty.channel.nio.NioIoHandler;

import io.netty.channel.socket.SocketChannel;

import io.netty.channel.socket.nio.NioServerSocketChannel;

/**

* Netty 4.2 服务端(回声服务)

*/

public class NettyServer {

// 监听端口

private static final int PORT = 8080;

public static void start() throws InterruptedException {

// 1. 创建EventLoopGroup(4.2版本统一使用MultiThreadIoEventLoopGroup)

// BossGroup:处理客户端连接请求

MultiThreadIoEventLoopGroup bossGroup = new MultiThreadIoEventLoopGroup(NioIoHandler.newFactory());

// WorkerGroup:处理IO事件(数据读写)

MultiThreadIoEventLoopGroup workerGroup = new MultiThreadIoEventLoopGroup(NioIoHandler.newFactory());

try {

// 2. 配置ServerBootstrap(服务端启动器)

ServerBootstrap bootstrap = new ServerBootstrap();

bootstrap.group(bossGroup, workerGroup) // 绑定两个EventLoopGroup

.channel(NioServerSocketChannel.class) // 指定服务端通道实现

.option(ChannelOption.SO_BACKLOG, 128) // 连接队列大小

.childOption(ChannelOption.SO_KEEPALIVE, true) // 保持长连接

.childHandler(new ChannelInitializer<SocketChannel>() {

// 3. 配置通道处理器(当客户端连接建立时,初始化Channel)

@Override

protected void initChannel(SocketChannel ch) throws Exception {

// 向Pipeline中添加自定义处理器(处理业务逻辑)

ch.pipeline().addLast(new NettyServerHandler());

}

});

System.out.println("Netty 4.2 服务端已启动,监听端口:" + PORT);

// 4. 绑定端口,同步等待绑定完成(异步操作的同步阻塞)

ChannelFuture future = bootstrap.bind(PORT).sync();

// 5. 等待通道关闭(阻塞,直到服务端被关闭)

future.channel().closeFuture().sync();

} finally {

// 6. 优雅关闭EventLoopGroup,释放资源

bossGroup.shutdownGracefully().sync();

workerGroup.shutdownGracefully().sync();

}

}

public static void main(String[] args) throws InterruptedException {

NettyServer.start();

}

}

/**

* 服务端自定义处理器(处理客户端消息)

*/

class NettyServerHandler extends io.netty.channel.ChannelInboundHandlerAdapter {

// 当客户端发送消息到服务端时,触发该方法

@Override

public void channelRead(io.netty.channel.ChannelHandlerContext ctx, Object msg) throws Exception {

// 将消息转为Netty的ByteBuf(4.2版本默认使用自适应分配器)

io.netty.buffer.ByteBuf buf = (io.netty.buffer.ByteBuf) msg;

// 读取消息内容(转为字符串)

String message = buf.toString(io.netty.util.CharsetUtil.UTF_8);

System.out.println("服务端收到客户端消息:" + message);

// 原样返回消息给客户端(异步写操作)

ctx.writeAndFlush(msg);

}

// 当通道读取操作完成时,触发该方法

@Override

public void channelReadComplete(io.netty.channel.ChannelHandlerContext ctx) throws Exception {

// 刷新缓冲区,确保消息发送完成

ctx.flush();

}

// 当发生异常时,触发该方法

@Override

public void exceptionCaught(io.netty.channel.ChannelHandlerContext ctx, Throwable cause) throws Exception {

// 打印异常信息

cause.printStackTrace();

// 关闭通道

ctx.close();

}

}3.3 客户端实现

客户端负责连接服务端、发送消息、接收服务端返回的回声消息,核心步骤:创建EventLoopGroup、配置Bootstrap、连接服务端、发送消息。

java

import io.netty.bootstrap.Bootstrap;

import io.netty.channel.ChannelFuture;

import io.netty.channel.ChannelInitializer;

import io.netty.channel.ChannelOption;

import io.netty.channel.MultiThreadIoEventLoopGroup;

import io.netty.channel.nio.NioIoHandler;

import io.netty.channel.socket.SocketChannel;

import io.netty.channel.socket.nio.NioSocketChannel;

/**

* Netty 4.2 客户端(回声服务)

*/

public class NettyClient {

// 服务端IP和端口

private static final String HOST = "127.0.0.1";

private static final int PORT = 8080;

public static void connect() throws InterruptedException {

// 1. 创建EventLoopGroup(客户端只需一个EventLoopGroup)

MultiThreadIoEventLoopGroup group = new MultiThreadIoEventLoopGroup(NioIoHandler.newFactory());

try {

// 2. 配置Bootstrap(客户端启动器)

Bootstrap bootstrap = new Bootstrap();

bootstrap.group(group) // 绑定EventLoopGroup

.channel(NioSocketChannel.class) // 指定客户端通道实现

.option(ChannelOption.SO_KEEPALIVE, true) // 保持长连接

.handler(new ChannelInitializer<SocketChannel>() {

// 3. 配置通道处理器

@Override

protected void initChannel(SocketChannel ch) throws Exception {

// 添加自定义处理器,处理服务端返回的消息

ch.pipeline().addLast(new NettyClientHandler());

}

});

// 4. 连接服务端(异步操作,sync()阻塞等待连接完成)

ChannelFuture future = bootstrap.connect(HOST, PORT).sync();

System.out.println("客户端已连接到服务端:" + HOST + ":" + PORT);

// 5. 向服务端发送消息(获取通道,写入消息)

future.channel().writeAndFlush(io.netty.buffer.Unpooled.copiedBuffer(

"Hello Netty 4.2!这是客户端发送的第一条消息",

io.netty.util.CharsetUtil.UTF_8

));

// 6. 等待通道关闭(阻塞,直到客户端主动关闭)

future.channel().closeFuture().sync();

} finally {

// 7. 优雅关闭EventLoopGroup,释放资源

group.shutdownGracefully().sync();

}

}

public static void main(String[] args) throws InterruptedException {

NettyClient.connect();

}

}

/**

* 客户端自定义处理器(处理服务端返回的消息)

*/

class NettyClientHandler extends io.netty.channel.ChannelInboundHandlerAdapter {

// 当客户端收到服务端返回的消息时,触发该方法

@Override

public void channelRead(io.netty.channel.ChannelHandlerContext ctx, Object msg) throws Exception {

// 读取服务端返回的消息

io.netty.buffer.ByteBuf buf = (io.netty.buffer.ByteBuf) msg;

String message = buf.toString(io.netty.util.CharsetUtil.UTF_8);

System.out.println("客户端收到服务端回声消息:" + message);

}

// 异常处理

@Override

public void exceptionCaught(io.netty.channel.ChannelHandlerContext ctx, Throwable cause) throws Exception {

cause.printStackTrace();

ctx.close();

}

}3.4 运行测试

3.4.1 运行步骤

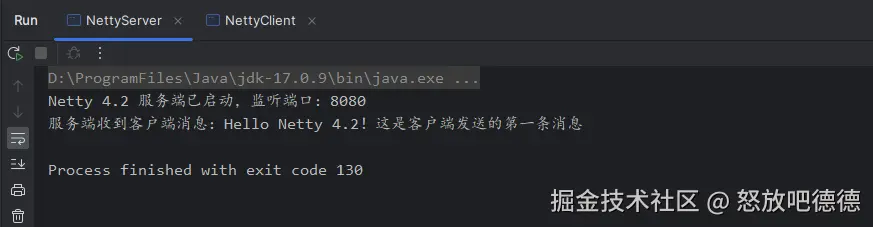

- 先运行NettyServer的main方法,控制台输出"Netty 4.2 服务端已启动,监听端口:8080",表示服务端启动成功;

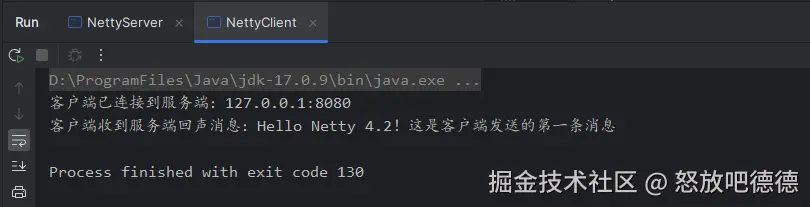

- 再运行NettyClient的main方法,控制台输出"客户端已连接到服务端:127.0.0.1:8080";

- 查看服务端控制台,会输出"服务端收到客户端消息:Hello Netty 4.2!这是客户端发送的第一条消息";

- 查看客户端控制台,会输出"客户端收到服务端回声消息:Hello Netty 4.2!这是客户端发送的第一条消息",表示回声服务正常运行。

3.4.2 运行说明

Demo中使用的是Netty 4.2的新特性(MultiThreadIoEventLoopGroup),同时兼容4.1版本的NioEventLoopGroup(将MultiThreadIoEventLoopGroup替换为NioEventLoopGroup即可正常运行)。

3.5 代码核心说明

- EventLoopGroup:服务端使用两个EventLoopGroup,客户端使用一个,4.2版本统一使用MultiThreadIoEventLoopGroup,适配不同传输方式;

- ChannelInitializer:用于初始化Channel,向Pipeline中添加自定义处理器,处理业务逻辑;

- ByteBuf:客户端发送消息时,使用Unpooled.copiedBuffer创建ByteBuf,服务端接收后原样返回;

- 异步操作:bind()、connect()、writeAndFlush()等方法都是异步的,通过sync()方法实现同步阻塞,等待操作完成。

4. 总结

本文通过"概念→组件→Demo"的流程,讲解了Netty 4.2的入门知识:Netty是基于NIO的高性能网络框架,4.2版本带来了自适应内存分配、统一事件循环组等优化;核心组件分工明确,Channel负责连接,EventLoop负责事件处理,Handler负责业务逻辑;第一个Demo实现了简单的回声服务,帮助大家快速上手Netty的基本开发流程。

转发请携带作者信息 @怒放吧德德 @一个有梦有戏的人

持续创作很不容易,作者将以尽可能的详细把所学知识分享各位开发者,一起进步一起学习。转载请携带链接,转载到微信公众号请勿选择原创,谢谢!

👍创作不易,如有错误请指正,感谢观看!记得点赞哦!👍

谢谢支持!