Go Web 服务限流器实战:从原理到压测验证

--使用 Gin 框架 + Uber Ratelimit / 官方限流器,并通过 Vegeta 进行性能剖析

1.引言

1.1限流器在微服务/高并发系统中的重要性

在微服务/高并发系统中,限流器承载着至关重要的作用。在微服务系统中,限流器主要起到阻断故障传播的作用,微服务架构中,服务间通过RPC/HTTP相互调用,形成复杂的依赖网络,单个服务的延迟或故障会沿调用链向上蔓延,导致整个系统瘫痪,在服务入口处设置限流器,将超过处理能力的请求直接拒绝避免故障级联;高并发系统中的限流器主要是限制高并发请求,避免资源耗尽。特别是在应对突发流量上面,秒杀、热点事件等场景带来流量尖刺,远超系统常态容量。限流器配合队列实现削峰,将瞬时压力限制在可处理水平,避免系统被突发流量冲垮。

1.2本文使用的技术栈

本文使用Go Web框架Gin搭建服务,两种Go限流器(go.uber.org/ratelimit 漏桶、golang.org/x/time/rate 令牌桶)实现限流,Vegeta进行压力测试。

1.3本文目标

简要概述两种限流器算法,通过实验对比阻塞式与快速失败式限流器的行为差异,并且验证其效果

2.限流器基础概念

2.1常见限流算法

2.1.1计数器

原理:将时间划分为固定窗口,每个窗口内统计请求数,超过阈值则拒绝请求

优点:实现简单,内存消耗极低;适合粗粒度限流场景

缺点:临界突发--在窗口边界处的请求可能达到2倍限流值,在时间间隔的最后一刻涌入大量请求

2.1.2漏桶

原理:想象一个桶,桶的底部有一个洞,一边注水,桶中的水一边以恒定速率流出,当桶满时则停止注水。现在将桶抽象成队列,水抽象成请求,就是漏桶算法。

核心特性:出口严格匀速,不管流入多快,流出永远恒定;平滑突发流量,将尖刺流量整形为均匀输出

优点:流量整形效果最佳,下游压力最平稳;适合需要严格匀速的场景(如数据库写入)

缺点:无法应对突发合法流量(如秒杀开始的瞬间高并发);队列堆积增加延迟

2.1.3令牌桶算法

原理:以恒定速率向桶中放入令牌,请求需获取令牌才能执行。桶空则等待或拒绝(阻塞式用Wait,快速失败用Allow)。

核心特性:1.允许突发:桶内累积的令牌可一次性消耗(如瞬间处理100请求。2.长期匀速:突发耗尽后,回归令牌生成速率

优点:1.兼顾突发处理与长期限流,灵活性最强。2.适合互联网场景的流量特征(平时平稳+偶尔突发)

缺点:实现略复杂,需处理并发下的令牌原子操作

2.1.4对比

| 特性 | 计数器 | 漏桶 | 令牌桶 |

|---|---|---|---|

| 平滑突发 | 无 | 强 | 允许 |

| 实现复杂度 | 极简 | 中等 | 中等 |

| 内存消耗 | 极低 | 中等 | 低 |

| 流量整形 | 差 | 最优 | 良好 |

| 典型场景 | 简单统计、非关键接口 | 数据库写入、下游严格限速 | API网关、通用限流 |

2.2阻塞式与快速失败式的区别

2.2.1 阻塞式限流器

阻塞式限流器在请求超过阈值时选择将请求暂存于队列中,让线程进入等待状态,直到系统资源释放或配额恢复后再继续处理,这种方式虽然能在一定程度上提升请求的最终成功率,避免直接拒绝用户带来的即时挫败感,但却以消耗宝贵的线程资源、内存空间和连接池容量为代价,且等待期间的请求堆积可能导致队列膨胀、延迟飙升,甚至在极端情况下因资源耗尽而引发系统级阻塞,将压力反向传导至上游服务形成连锁反应。

2.2.2 快速失败式限流器

相比之下,快速失败式限流器则采取更为果断的策略,在请求到达的瞬间立即进行配额检查,一旦发现超限便毫不犹豫地拒绝服务,通常通过返回特定的错误码(如HTTP 429)或触发降级逻辑来告知客户端,这种做法虽然牺牲了部分请求的即时成功率,却彻底避免了线程阻塞和队列堆积带来的资源占用与延迟不确定性,使得系统能够迅速释放压力、保持轻量级运行状态,同时也迫使客户端在架构设计上更早地考虑容错、重试和优雅降级机制,从而在宏观层面提升了整个分布式系统的韧性和可观测性。

2.3适用场景分析

对于阻塞式限流器而言,其核心适用场景集中在那些对请求最终成功率有极高要求、且业务逻辑天然具备异步属性的后台处理环节,例如电商平台的订单异步对账、金融系统的批量清算任务、消息队列的消费端处理等,这些场景的共同特征在于请求一旦进入系统便不允许轻易丢失,且上游调用方通常为内部服务或任务调度器,具备较强的等待容忍度,同时下游处理能力往往存在可预期的恢复窗口(如数据库主从切换、缓存预热完成),此时通过有限时间的排队等待换取事务的最终一致性是合理的技术权衡,但需严格配套超时熔断和队列容量上限机制以防止资源无限占用;

对于快速失败式限流器,其主战场则位于面向终端用户的网关层、开放API接口以及微服务间的同步调用链路上,这些场景对响应延迟极度敏感,任何不可预期的等待都会直接转化为糟糕的用户体验或级联超时风险,例如移动互联网时代的APP首页加载、第三方支付接口的实时扣款确认、微服务架构中高频的RPC服务调用等,此外在流量来源不可控、存在恶意刷量或突发热点事件的场景下,快速失败能够通过即时拒绝迅速切断异常流量输入,配合客户端的指数退避重试策略和兜底降级页面,实现"有损服务"下的系统自保,而在云原生弹性伸缩环境中,快速失败暴露的负载压力信号也更易于被监控系统捕获,从而触发自动扩容决策,形成"拒绝-扩容-恢复"的闭环治理。

3.实现一个简单的限流中间件(Gin示例)

3.1阻塞式(使用 go.uber.org/ratelimit)

go

limiter := ratelimit.New(100) // 每秒100个请求

r.POST("/buy", func(c *gin.Context) {

limiter.Take() // 阻塞直到令牌可用

handler.Buy(c, db, stockSvc)

})3.2快速失败式(使用 x/time/rate)

go

limiter := rate.NewLimiter(rate.Limit(100), 100) // 每秒100令牌,桶容量100(允许突发)

r.POST("/buy", func(c *gin.Context) {

if !limiter.Allow() { // 立即判断,无阻塞

c.JSON(http.StatusTooManyRequests, gin.H{

"error": "too many requests",

"retry_after": "1",

})

return

}

handler.Buy(c, db, stockSvc)

})4.压测环境准备

4.1Vegeta简介与安装

Vegeta 是一款用 Go 语言编写的 HTTP 负载测试工具,以其高性能、易用性和丰富的输出格式著称。相比 JMeter、Apache Bench 等工具,Vegeta 在命令行交互和结果可视化方面更为轻量高效,特别适合微服务接口的自动化压测。

安装方式

bash

go install github.com/tsenart/vegeta@latest 4.2测试参数设计

| 参数项 | 配置值 | 说明 |

|---|---|---|

| 目标接口 | POST /buy |

核心业务下单接口 |

| QPS 阶梯 | 50, 100, 150, 200, 300 | 逐步加压,观察系统拐点 |

| 持续时间 | 30s | 单点测试时长,平衡效率与稳定性 |

| 请求体 | body.txt |

预置表单数据,模拟真实下单参数 |

4.3自动化测试脚本

由于使用命令行测试太麻烦(作者懒),所以编写了自动化测试脚本(stress_test.bat)如下:

batch

chcp 65001 >nul

@echo off

setlocal enabledelayedexpansion

:: 如果第一个参数是 "loop",则执行循环测试

if /i "%1"=="loop" (

set DURATION=%2

if "!DURATION!"=="" set DURATION=30s

echo 开始循环测试,持续时间 !DURATION!

for %%r in (50 100 150 200 300) do (

echo ========================================

echo 测试 QPS = %%r

call :run_test %%r !DURATION!

echo 按任意键继续下一项测试...

pause > nul

)

goto :eof

)

:: 否则执行单次测试(默认 QPS=120,持续时间=30s)

call :run_test %1 %2

goto :eof

:run_test

set RATE=%1

if "%RATE%"=="" set RATE=120

set DURATION=%2

if "%DURATION!"=="" set DURATION=30s

:: 固定参数

set URL=http://localhost:8888/buy

set BODY_FILE=body.txt

set OUTPUT_BIN=results_%RATE%_%DURATION%.bin

set REPORT_TXT=report_%RATE%_%DURATION%.txt

set REPORT_JSON=metrics_%RATE%_%DURATION%.json

set REPORT_HTML=plot_%RATE%_%DURATION%.html

echo 开始压测:QPS=%RATE%, 持续时间=%DURATION%

echo 目标URL: %URL%

:: 执行攻击,保存原始二进制结果

echo POST %URL% | vegeta attack -rate=%RATE% -duration=%DURATION% -body="%cd%\%BODY_FILE%" -header="Content-Type: application/x-www-form-urlencoded" > %OUTPUT_BIN%

:: 生成文本报告并显示

echo.

echo ===== 文本报告 =====

vegeta report < %OUTPUT_BIN%

echo.

:: 生成 JSON 详细报告

vegeta report -type=json < %OUTPUT_BIN% > %REPORT_JSON%

echo JSON 报告已保存至:%REPORT_JSON%

:: 生成 HTML 图表

vegeta plot < %OUTPUT_BIN% > %REPORT_HTML%

echo HTML 图表已保存至:%REPORT_HTML%

echo 原始数据保存至:%OUTPUT_BIN%

goto :eof脚本功能说明

| 功能 | 实现方式 |

|---|---|

| 单次测试 | stress_test.bat 100 30s → QPS=100,持续30秒 |

| 批量阶梯测试 | stress_test.bat loop 30s → 自动执行50/100/150/200/300 QPS |

| 多格式输出 | 原始二进制(.bin) + JSON指标(.json) + HTML可视化(.html) |

| 交互暂停 | 每轮测试后暂停,便于观察系统状态或清理资源 |

前置准备

ini

同级目录下创建 `body.txt`,内容为表单编码的测试数据,例如:productId=10086&quantity=1&userId=test001执行测试

batch

# 完整阶梯压测(推荐)

stress_test.bat loop 30s

# 单独调试某档位

stress_test.bat 200 30s脚本执行后将生成三类结果文件,为后续指标分析提供数据基础:

results_*.bin:原始压测数据,可重新生成报告metrics_*.json:结构化指标,用于自动化分析plot_*.html:可视化图表,直观观察延迟分布

5.实验一:阻塞式限流器的表现

5.1测试执行

使用阻塞式限流器启动服务后,执行:

batch

# 单次测试 QPS=120,持续30秒

.\stress_test.bat 120 30s5.2 阶梯压测结果与分析

batch

开始循环测试,持续时间 30s

========================================

测试 QPS = 50

开始压测:QPS=50, 持续时间=30s

目标URL: http://localhost:8888/buy

===== 文本报告 =====

Requests [total, rate, throughput] 1500, 50.03, 50.03

Duration [total, attack, wait] 29.9825439s, 29.9800902s, 2.4537ms

Latencies [mean, 50, 95, 99, max] 2.337466ms, 2.011324ms, 3.265938ms, 10.036737ms, 72.296ms

Bytes In [total, mean] 61500, 41.00

Bytes Out [total, mean] 42000, 28.00

Success [ratio] 100.00%

Status Codes [code:count] 200:1500

Error Set:

JSON 报告已保存至:metrics_50_30s.json

HTML 图表已保存至:plot_50_30s.html

原始数据保存至:results_50_30s.bin

按任意键继续下一项测试...

========================================

测试 QPS = 100

开始压测:QPS=100, 持续时间=30s

目标URL: http://localhost:8888/buy

===== 文本报告 =====

Requests [total, rate, throughput] 3000, 100.03, 100.03

Duration [total, attack, wait] 29.9922789s, 29.9897991s, 2.4798ms

Latencies [mean, 50, 95, 99, max] 2.488797ms, 2.204063ms, 2.99723ms, 5.104087ms, 90.0456ms

Bytes In [total, mean] 123000, 41.00

Bytes Out [total, mean] 84000, 28.00

Success [ratio] 100.00%

Status Codes [code:count] 200:3000

Error Set:

JSON 报告已保存至:metrics_100_30s.json

HTML 图表已保存至:plot_100_30s.html

原始数据保存至:results_100_30s.bin

按任意键继续下一项测试...

========================================

测试 QPS = 150

开始压测:QPS=150, 持续时间=30s

目标URL: http://localhost:8888/buy

===== 文本报告 =====

Requests [total, rate, throughput] 4500, 150.03, 100.20

Duration [total, attack, wait] 44.9116382s, 29.993425s, 14.9182132s

Latencies [mean, 50, 95, 99, max] 7.420269001s, 7.420005809s, 14.170124554s, 14.769815174s, 14.9182132s

Bytes In [total, mean] 184500, 41.00

Bytes Out [total, mean] 126000, 28.00

Success [ratio] 100.00%

Status Codes [code:count] 200:4500

Error Set:

JSON 报告已保存至:metrics_150_30s.json

HTML 图表已保存至:plot_150_30s.html

原始数据保存至:results_150_30s.bin

按任意键继续下一项测试...

========================================

测试 QPS = 200

开始压测:QPS=200, 持续时间=30s

目标URL: http://localhost:8888/buy

===== 文本报告 =====

Requests [total, rate, throughput] 6000, 200.03, 100.14

Duration [total, attack, wait] 59.9137996s, 29.9948379s, 29.9189617s

Latencies [mean, 50, 95, 99, max] 14.922318444s, 14.921484248s, 28.422101211s, 29.621520979s, 29.9189617s

Bytes In [total, mean] 246000, 41.00

Bytes Out [total, mean] 168000, 28.00

Success [ratio] 100.00%

Status Codes [code:count] 200:6000

Error Set:

JSON 报告已保存至:metrics_200_30s.json

HTML 图表已保存至:plot_200_30s.html

原始数据保存至:results_200_30s.bin

按任意键继续下一项测试...

========================================

测试 QPS = 300

开始压测:QPS=300, 持续时间=30s

目标URL: http://localhost:8888/buy

===== 文本报告 =====

Requests [total, rate, throughput] 9000, 300.03, 75.20

Duration [total, attack, wait] 59.9969947s, 29.9966907s, 30.000304s

Latencies [mean, 50, 95, 99, max] 22.459031662s, 29.766995425s, 30.000593318s, 30.000710774s, 30.020118s

Bytes In [total, mean] 184992, 20.55

Bytes Out [total, mean] 126336, 14.04

Success [ratio] 50.13%

Status Codes [code:count] 0:4488 200:4512

Error Set:

Post "http://localhost:8888/buy": context deadline exceeded (Client.Timeout exceeded while awaiting headers)

JSON 报告已保存至:metrics_300_30s.json

HTML 图表已保存至:plot_300_30s.html

原始数据保存至:results_300_30s.bin

按任意键继续下一项测试...5.3关键指标对比表

| QPS | 理论发送 | 实际吞吐 | 成功率 | 平均延迟 | 最大延迟 | 现象 |

|---|---|---|---|---|---|---|

| 50 | 1500 | 50.03 | 100% | 2.3ms | 72ms | 未达限流阈值,正常处理 |

| 100 | 3000 | 100.03 | 100% | 2.5ms | 90ms | 触及限流阈值,延迟仍低 |

| 150 | 4500 | 100.20 | 100% | 7.4s | 14.9s | 超限50%,延迟飙升至秒级 |

| 200 | 6000 | 100.14 | 100% | 14.9s | 29.9s | 超限100%,延迟接近30s超时 |

| 300 | 9000 | 75.20 | 50.13% | 22.5s | 30.0s | 严重超载,半数请求超时失败 |

5.4分阶段解读

阶段一:阈值内(QPS≤100)

- 吞吐等于发送速率,延迟稳定在2-3ms

- 限流器未触发,系统健康

阶段二:轻度超载(QPS=150)

- 吞吐被限制在100,但延迟从2ms暴涨至7.4秒

- 50%超额请求进入队列等待,排队时间线性堆积

阶段三:重度超载(QPS=200)

- 延迟突破14.9秒,接近Vegeta默认30s超时的一半

- 总耗时从30s延长至59.9s(等待队列处理完毕)

阶段四:崩溃边缘(QPS=300)

- 成功率暴跌至50.13%,4488个请求超时(状态码0)

- 实际吞吐反而下降至75.2,因大量连接被超时中断

- 错误信息:

context deadline exceeded

5.5 阻塞式限流器的致命缺陷

从QPS=150开始,系统出现**"假死"现象**:

- 服务端仍在处理请求(无500错误)

- 但客户端视角已严重超时

- 队列堆积导致内存和连接持续占用,形成隐形资源泄漏

关键结论 :阻塞式限流器虽然保护了下游,但将压力转化为延迟,最终仍会导致客户端超时失败。这是一种"延迟炸弹"模式。

6.实验二:快速失败限流器的表现

6.1测试执行

修改代码为快速失败式(使用 x/time/rate 的 Allow() 方法),重启服务后进行测试

6.2阶梯压测结果

batch

开始循环测试,持续时间 30s

========================================

测试 QPS = 50

开始压测:QPS=50, 持续时间=30s

目标URL: http://localhost:8888/buy

===== 文本报告 =====

Requests [total, rate, throughput] 1500, 50.03, 50.03

Duration [total, attack, wait] 29.9813233s, 29.9796118s, 1.7115ms

Latencies [mean, 50, 95, 99, max] 2.125867ms, 1.667561ms, 2.753088ms, 7.053961ms, 79.3247ms

Bytes In [total, mean] 61500, 41.00

Bytes Out [total, mean] 42000, 28.00

Success [ratio] 100.00%

Status Codes [code:count] 200:1500

Error Set:

JSON 报告已保存至:metrics_50_30s.json

HTML 图表已保存至:plot_50_30s.html

原始数据保存至:results_50_30s.bin

按任意键继续下一项测试...

========================================

测试 QPS = 100

开始压测:QPS=100, 持续时间=30s

目标URL: http://localhost:8888/buy

===== 文本报告 =====

Requests [total, rate, throughput] 3000, 100.03, 100.03

Duration [total, attack, wait] 29.9924247s, 29.9902678s, 2.1569ms

Latencies [mean, 50, 95, 99, max] 2.219977ms, 2.085406ms, 2.61761ms, 3.930159ms, 32.0159ms

Bytes In [total, mean] 123000, 41.00

Bytes Out [total, mean] 84000, 28.00

Success [ratio] 100.00%

Status Codes [code:count] 200:3000

Error Set:

JSON 报告已保存至:metrics_100_30s.json

HTML 图表已保存至:plot_100_30s.html

原始数据保存至:results_100_30s.bin

按任意键继续下一项测试...

========================================

测试 QPS = 150

开始压测:QPS=150, 持续时间=30s

目标URL: http://localhost:8888/buy

===== 文本报告 =====

Requests [total, rate, throughput] 4500, 150.04, 103.25

Duration [total, attack, wait] 29.9956244s, 29.992667s, 2.9574ms

Latencies [mean, 50, 95, 99, max] 1.711374ms, 2.000651ms, 3.002132ms, 6.573029ms, 83.4644ms

Bytes In [total, mean] 170470, 37.88

Bytes Out [total, mean] 126000, 28.00

Success [ratio] 68.82%

Status Codes [code:count] 200:3097 429:1403

Error Set:

429 Too Many Requests

JSON 报告已保存至:metrics_150_30s.json

HTML 图表已保存至:plot_150_30s.html

原始数据保存至:results_150_30s.bin

按任意键继续下一项测试...

========================================

测试 QPS = 200

开始压测:QPS=200, 持续时间=30s

目标URL: http://localhost:8888/buy

===== 文本报告 =====

Requests [total, rate, throughput] 6000, 200.03, 103.25

Duration [total, attack, wait] 29.9947906s, 29.9947906s, 0s

Latencies [mean, 50, 95, 99, max] 1.200257ms, 1.812983ms, 2.502452ms, 3.139393ms, 32.3879ms

Bytes In [total, mean] 216970, 36.16

Bytes Out [total, mean] 168000, 28.00

Success [ratio] 51.62%

Status Codes [code:count] 200:3097 429:2903

Error Set:

429 Too Many Requests

JSON 报告已保存至:metrics_200_30s.json

HTML 图表已保存至:plot_200_30s.html

原始数据保存至:results_200_30s.bin

按任意键继续下一项测试...

========================================

测试 QPS = 300

开始压测:QPS=300, 持续时间=30s

目标URL: http://localhost:8888/buy

===== 文本报告 =====

Requests [total, rate, throughput] 9000, 300.04, 103.25

Duration [total, attack, wait] 29.9960914s, 29.9959932s, 98.2µs

Latencies [mean, 50, 95, 99, max] 765.231µs, 63.543µs, 2.237179ms, 2.513871ms, 36.5711ms

Bytes In [total, mean] 309970, 34.44

Bytes Out [total, mean] 252000, 28.00

Success [ratio] 34.41%

Status Codes [code:count] 200:3097 429:5903

Error Set:

429 Too Many Requests

JSON 报告已保存至:metrics_300_30s.json

HTML 图表已保存至:plot_300_30s.html

原始数据保存至:results_300_30s.bin

按任意键继续下一项测试...6.3 关键指标对比表

| QPS | 理论发送 | 实际吞吐 | 成功率 | 平均延迟 | 最大延迟 | 状态码分布 | 核心特征 |

|---|---|---|---|---|---|---|---|

| 50 | 1500 | 50.03 | 100% | 2.1ms | 79ms | 200:1500 | 未达阈值,全部成功 |

| 100 | 3000 | 100.03 | 100% | 2.2ms | 32ms | 200:3000 | 触及阈值,仍全部成功 |

| 150 | 4500 | 103.25 | 68.82% | 1.7ms | 83ms | 200:3097, 429:1403 | 首次出现拒绝,延迟仍低 |

| 200 | 6000 | 103.25 | 51.62% | 1.2ms | 32ms | 200:3097, 429:2903 | 拒绝比例上升,延迟稳定 |

| 300 | 9000 | 103.25 | 34.41% | 0.8ms | 37ms | 200:3097, 429:5903 | 高负载下延迟反而更低 |

6.4与阻塞式的关键差异

| 维度 | 阻塞式(实验一) | 快速失败式(实验二) |

|---|---|---|

| QPS=150 延迟 | 7.4秒 | 1.7毫秒(相差4000倍) |

| QPS=300 成功率 | 50.13%(超时失败) | 34.41%(立即拒绝,无超时) |

| 吞吐上限 | 约100,超载后下降 | 稳定在103.25,拒绝请求不占资源 |

| 错误类型 | context deadline exceeded(客户端超时) |

429 Too Many Requests(服务端明确拒绝) |

| 延迟趋势 | 随负载线性暴涨 | 始终维持在1-2ms低位 |

6.5快速失败式的核心优势

1. 延迟确定性

- 无论负载多高,被处理请求的延迟稳定在1-2ms

- 拒绝请求的延迟<1ms(立即返回)

- 客户端不会陷入不可预期的长时间等待

2. 资源零占用

- 拒绝请求不消耗线程、不进入队列、不占用连接池

- 系统始终处于"轻量级"运行状态

3. 明确的失败信号

- HTTP 429 状态码让客户端清晰识别限流场景

- 便于实施指数退避重试或降级策略

6.6可视化对比

QPS=300 延迟分布对比:

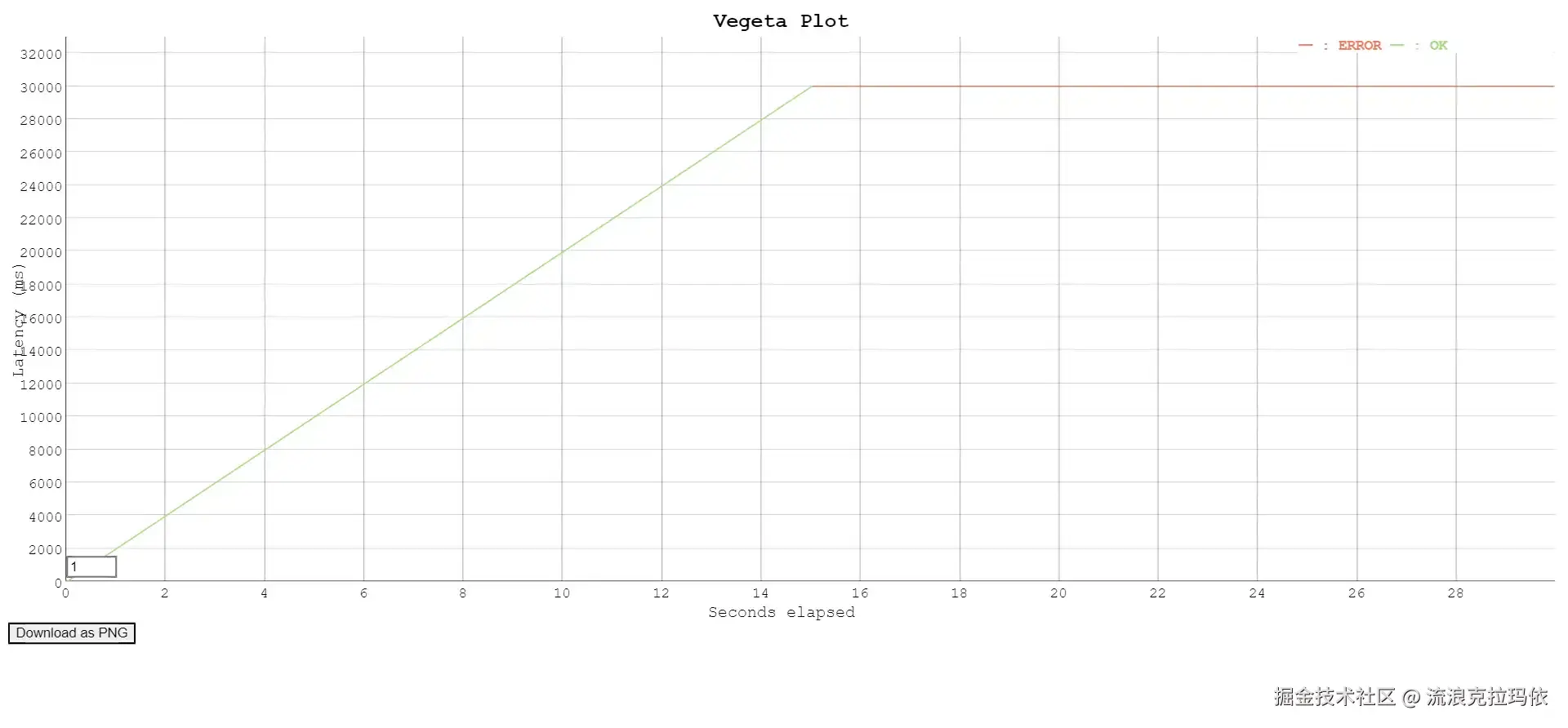

图1:阻塞式限流器QPS=300时的延迟分布,呈现明显的延迟堆积

图1:阻塞式限流器QPS=300时的延迟分布,呈现明显的延迟堆积

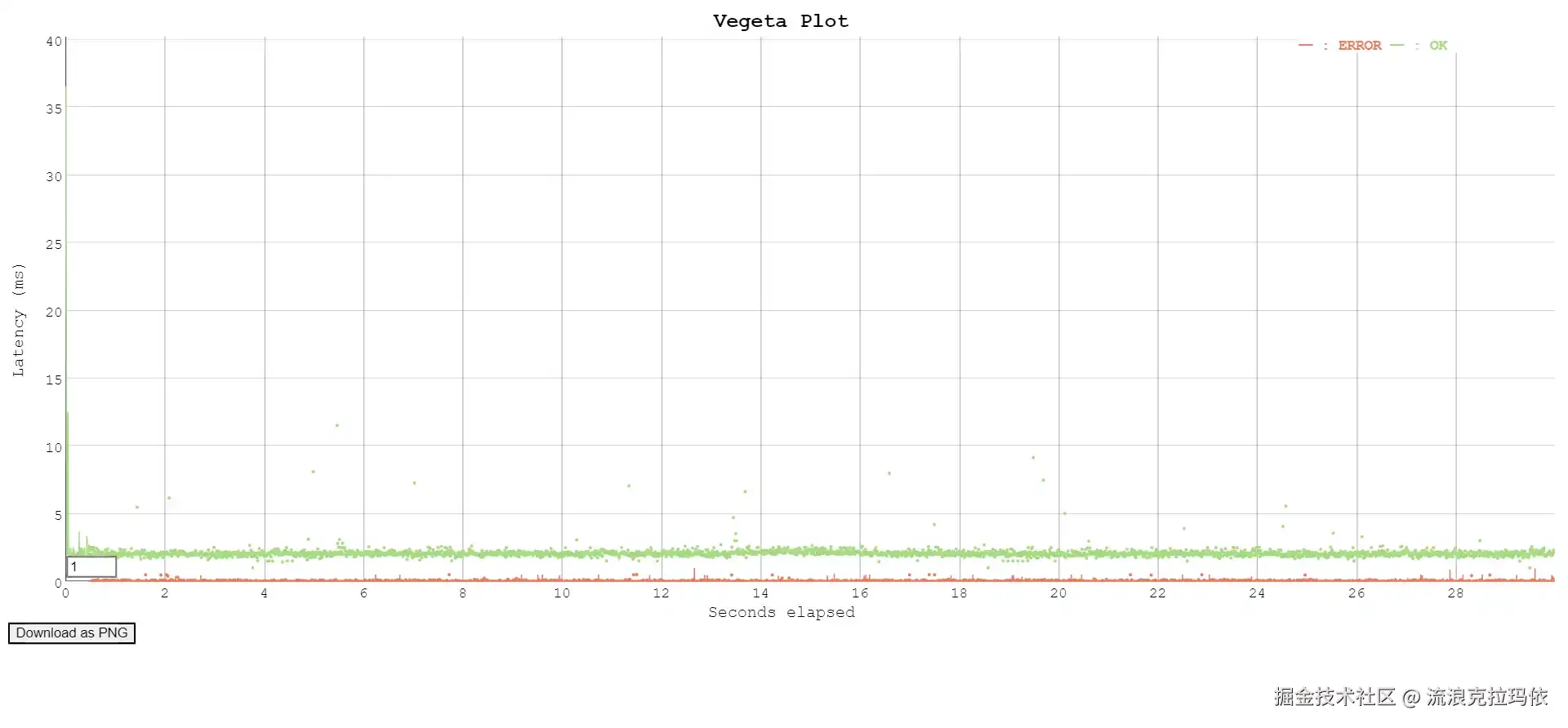

图2:快速失败式限流器QPS=300时的延迟分布,成功请求集中在低延迟区

图2:快速失败式限流器QPS=300时的延迟分布,成功请求集中在低延迟区

| 模式 | 成功请求延迟 | 失败请求延迟 | 图表特征 |

|---|---|---|---|

| 阻塞式 | 22.5秒 | 30秒(超时) | 单峰右偏,延迟持续堆积 |

| 快速失败 | 0.8毫秒 | <1毫秒(429) | 双峰分布:低延迟成功簇 + 瞬时拒绝簇 |

7.对比分析

7.1 核心指标全景对比

将两种限流器在相同压测条件下的表现并列对比:

| 指标 | 阻塞式(go.uber.org/ratelimit) | 快速失败式(x/time/rate) | 差异分析 |

|---|---|---|---|

| 算法本质 | 漏桶(Leaky Bucket) | 令牌桶(Token Bucket) | 漏桶强制匀速,令牌桶允许突发 |

| 限流行为 | Take() 阻塞等待 |

Allow() 立即判断 |

阻塞 vs 非阻塞的根本分歧 |

| QPS=150 平均延迟 | 7.4秒 | 1.7毫秒 | 相差4352倍 |

| QPS=300 成功率 | 50.13%(大量超时) | 34.41%(无超时) | 阻塞式"假成功",快速失败"真拒绝" |

| 错误类型 | 状态码0(客户端超时) | 状态码429(明确拒绝) | 超时不可控,429可处理 |

| 资源占用 | 线程堆积、内存增长 | 零堆积、恒定内存 | 阻塞式存在资源泄漏风险 |

| 吞吐稳定性 | 超载后下降至75.2 | 恒定在103.25 | 快速失败保护系统吞吐能力 |

7.2 延迟曲线深度分析

阻塞式:延迟炸弹模式

QPS 平均延迟 趋势

50 2.3ms ▁▁▁ 平稳

100 2.5ms ▁▁▁ 平稳

150 7.4s ▂▄▆ 指数级上升

200 14.9s ▅██ 接近超时阈值

300 22.5s ███ 超过超时阈值,成功率暴跌关键发现 :从QPS=100到QPS=150,延迟从2.5ms跃升至7.4s,增幅近3000倍。这是因为漏桶算法的队列开始堆积,每个请求都要等待前面所有排队的请求处理完毕。

快速失败式:延迟免疫模式

QPS 平均延迟 趋势

50 2.1ms ▁▁▁ 平稳

100 2.2ms ▁▁▁ 平稳

150 1.7ms ▁▁▁ 反而略降(拒绝请求拉低平均)

200 1.2ms ▁▁▁ 持续低位

300 0.8ms ▁▁▁ 高负载下最低反直觉现象:QPS越高,平均延迟反而越低。这是因为被拒绝的请求(429)响应极快(<1ms),高比例拉低了整体平均值。成功请求的延迟始终稳定在1-2ms。

7.3 系统行为差异图解

ini

┌─────────────────────────────────────────────────────────────┐

│ 阻塞式限流器(QPS=300) │

│ 输入流量 ──→ [ 队列堆积 ] ──→ 缓慢处理(100/s) │

│ ↑ ↓ │

│ 300/s 线程全部阻塞 │

│ │ ↓ │

│ └────────→ 客户端30s超时 ──→ 成功率50% │

│ 系统假死,资源耗尽 │

└─────────────────────────────────────────────────────────────┘

┌─────────────────────────────────────────────────────────────┐

│ 快速失败式限流器(QPS=300) │

│ 输入流量 ──→ 立即判断 ──→ 有令牌?──→ 处理(~100/s) │

│ ↑ ↓ 否 │

│ 300/s 返回429(<1ms) │

│ │ ↓ │

│ └────────→ 无队列、无阻塞、无超时 ──→ 成功率34% │

│ 系统健康,资源恒定 │

└─────────────────────────────────────────────────────────────┘7.4 生产环境风险评估

| 风险场景 | 阻塞式后果 | 快速失败后果 | 推荐策略 |

|---|---|---|---|

| 突发流量(秒杀) | 队列瞬间打满,全站超时 | 部分用户立即看到"繁忙",部分正常购买 | 快速失败 + 前端排队页面 |

| 恶意刷量 | 资源被攻击者耗尽,正常用户无法访问 | 攻击请求被即时拒绝,正常用户不受影响 | 快速失败 + IP黑名单 |

| 下游依赖故障 | 阻塞加剧,级联雪崩 | 快速失败保护自身,等待下游恢复 | 快速失败 + 熔断降级 |

| 网络抖动 | 超时误判为失败,重复提交 | 明确错误码,客户端可安全重试 | 快速失败 + 幂等设计 |

8.总结与最佳实现

8.1 核心结论

通过本次实战验证,我们得出三个关键结论:

1. 阻塞式限流器是"延迟炸弹"

它通过隐藏拒绝(让用户等待)来维持表面上的高成功率,但实际上将压力转化为不可控的延迟,最终仍会导致超时失败。这种模式在同步调用链中极具破坏性。

2. 快速失败式限流器是"系统护城河"

它以明确的拒绝换取系统的确定性,让被服务的请求获得稳定低延迟,让被拒绝的请求获得清晰反馈。这是构建弹性系统的基石。

3. 算法选择决定行为上限

go.uber.org/ratelimit 的漏桶算法强制匀速,天然适合异步队列;x/time/rate 的令牌桶允许突发,配合 Allow() 方法更适合网关层限流。

8.2 限流器选型决策树

markdown

开始选型

│

├─ 场景:内部异步任务(消息队列、批处理)

│ └─ 阻塞式限流器 + 超时控制 + 死信队列

│

├─ 场景:网关层/API入口/用户-facing接口

│ └─ 快速失败式限流器 + 429响应 + 客户端降级

│

├─ 场景:微服务间RPC调用

│ └─ 快速失败式 + 熔断器(如Sentinel/Resilience4j)

│

└─ 场景:数据库/缓存保护

└─ 快速失败式 + 连接池隔离 + 降级缓存8.3 生产环境最佳实践

实践1:多层限流防御体系

go

// 边缘层:IP级限流(Nginx/Envoy)

// 网关层:用户级限流(本文实现)

limiter := rate.NewLimiter(rate.Limit(100), 200) // 允许200突发

// 服务层:接口级限流

buyLimiter := rate.NewLimiter(10, 50) // 下单接口更严格

queryLimiter := rate.NewLimiter(1000, 1000) // 查询接口较宽松

// 资源层:连接池限流(数据库/Redis)

db.SetMaxOpenConns(100)

redisPool := &redis.Pool{MaxActive: 500}实践2:动态限流与自适应

go

// 基于负载的动态调整

func adaptiveLimit(currentLoad float64) rate.Limit {

if currentLoad > 0.8 {

return rate.Limit(50) // 高负载降级

}

return rate.Limit(100) // 正常负载

}实践3:完善的监控告警

| 监控指标 | 告警阈值 | 含义 |

|---|---|---|

rate_limit_rejected_total |

>1000/min | 限流触发频繁,需扩容 |

rate_limit_latency_p99 |

>100ms | 限流器自身延迟异常 |

rate_limit_saturation |

>0.9 | 令牌桶饱和度极高 |

实践4:客户端配合策略

go

// 客户端指数退避重试

func callWithRetry() (*Response, error) {

backoff := []time.Duration{100*time.Millisecond, 200*time.Millisecond, 400*time.Millisecond}

for i := 0; i < 3; i++ {

resp, err := http.Post("/buy", body)

if resp.StatusCode == 429 {

time.Sleep(backoff[i])

continue // 限流时重试

}

return resp, err

}

return nil, errors.New("服务繁忙,请稍后重试") // 最终降级

}9.附录

9.1 完整压测脚本

batch

chcp 65001 >nul

@echo off

setlocal enabledelayedexpansion

if /i "%1"=="loop" (

set DURATION=%2

if "!DURATION!"=="" set DURATION=30s

echo 开始循环测试,持续时间 !DURATION!

for %%r in (50 100 150 200 300) do (

echo ========================================

echo 测试 QPS = %%r

call :run_test %%r !DURATION!

echo 按任意键继续下一项测试...

pause > nul

)

goto :eof

)

call :run_test %1 %2

goto :eof

:run_test

set RATE=%1

if "%RATE%"=="" set RATE=120

set DURATION=%2

if "%DURATION!"=="" set DURATION=30s

set URL=http://localhost:8888/buy

set BODY_FILE=body.txt

set OUTPUT_BIN=results_%RATE%_%DURATION%.bin

set REPORT_JSON=metrics_%RATE%_%DURATION%.json

set REPORT_HTML=plot_%RATE%_%DURATION%.html

echo POST %URL% | vegeta attack -rate=%RATE% -duration=%DURATION% -body="%cd%\%BODY_FILE%" -header="Content-Type: application/x-www-form-urlencoded" > %OUTPUT_BIN%

echo.

vegeta report < %OUTPUT_BIN%

vegeta report -type=json < %OUTPUT_BIN% > %REPORT_JSON%

vegeta plot < %OUTPUT_BIN% > %REPORT_HTML%

echo 报告已生成:%REPORT_JSON% %REPORT_HTML%

goto :eof9.2 Vegeta 报告解读手册

| 字段 | 含义 | 健康标准 |

|---|---|---|

rate |

实际发送速率 | 应接近目标QPS |

throughput |

实际处理速率 | 阻塞式≈限流阈值,快速失败式≈阈值 |

latencies mean |

平均延迟 | <100ms为优秀,>1s需警惕 |

latencies 95 |

95分位延迟 | 反映大多数用户体验 |

latencies max |

最大延迟 | 接近30s说明存在超时 |

success |

成功率 | <100%时需分析错误类型 |

status codes |

状态码分布 | 429为正常限流,0为超时异常 |