一个关于阿里开源AI助理的安装、配置、入坑与理性退出的真实记录

写在前面

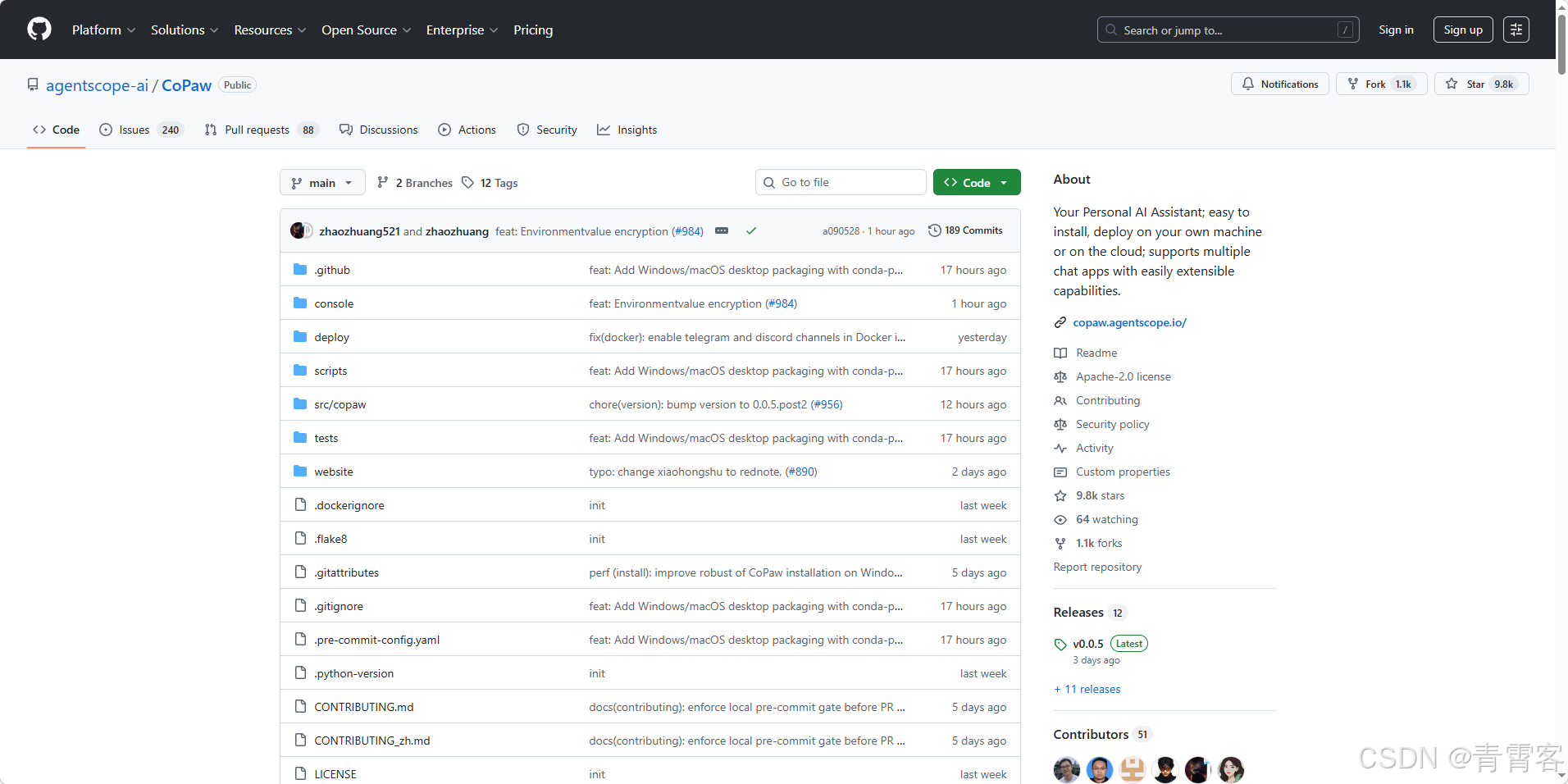

阿里通义实验室开源了 CoPaw(Co Personal Agent Workstation),一款对标 OpenClaw 的本地AI助理框架。作为一个喜欢折腾的开发者,第一时间就上手了。毕竟,谁不想拥有一个"懂你所需,伴你左右"的数字搭档呢?

但现实往往比理想骨感。经过一周的深入体验,完成了从安装、配置Ollama本地模型、接入钉钉机器人的全流程,最终却选择了"放弃"。这篇博客将完整记录这个过程------包括那些官方文档不会告诉你的坑,以及最终为什么决定让它成为"电子遗产"。

一、CoPaw 是什么?值得折腾吗?

CoPaw 是阿里云 AgentScope 团队开源的个人智能体工作台,定位是本地优先的AI助理。它的核心卖点包括:

- 全域触达:支持钉钉、飞书、QQ、Discord、iMessage 等主流IM平台

- 本地部署:数据完全本地存储,支持Ollama/llama.cpp/MLX等本地模型

- 主动执行:通过"心跳机制"实现定时任务和主动推送

- Skills扩展:模块化技能系统,支持自定义Python技能

如果你符合以下特征,CoPaw 可能适合你:

- 对数据隐私极度敏感,不想把个人数据传到云端

- 有稳定的本地算力(至少能跑7B参数模型)

- 需要跨平台的统一AI入口

- 享受折腾开源项目的乐趣

但如果你追求的是开箱即用的稳定性,建议直接关闭这篇文章------后面你会看到为什么。

二、安装部署:从"一键脚本"到"一键崩溃"

2.1 官方推荐的"极简安装"

官方提供了三种安装方式,我首先尝试了最推荐的一键脚本:

macOS/Linux:

bash

curl -fsSL https://copaw.agentscope.io/install.sh | bashWindows (PowerShell):

powershell

irm https://copaw.agentscope.io/install.ps1 | iex第一个坑:网络问题

安装脚本需要下载 uv 包管理器和大量Python依赖。在国内网络环境下,这个"一键"过程可能持续15-30分钟,期间终端没有任何进度提示,光标只是疯狂闪烁,让人怀疑是不是卡死了。

解决方案:提前配置好代理,或者选择源码安装。

2.2 源码安装(推荐)

如果一键脚本失败,或者你想修改代码,建议直接源码安装:

bash

# 克隆仓库

git clone https://github.com/agentscope-ai/CoPaw.git

cd CoPaw

# 初始化 → 启动

copaw init --defaults

copaw app第二个坑:Python版本限制

CoPaw 要求 Python 3.10 ~ 3.13。如果你的系统Python版本不对,需要使用 pyenv 或 conda 切换。

2.3 初始化配置

安装完成后,执行初始化:

bash

# 使用默认配置(跳过交互式问答)

copaw init --defaults

# 启动服务

copaw app服务默认监听 http://127.0.0.1:8088,浏览器打开即可进入Web控制台。

第三个坑:端口占用

如果8088端口被占用,服务会启动失败,但错误提示不明显。建议先检查端口:

bash

lsof -i :8088 # Mac/Linux

netstat -ano | findstr :8088 # Windows三、模型配置:Ollama本地部署实战

这是整个过程中最坑的部分。官方文档对Ollama的支持描述得很美好,但实际操作中充满了陷阱。

3.1 安装Ollama

首先确保本地已安装Ollama并拉取了模型:

bash

# 安装Ollama(官网下载或命令行)

curl -fsSL https://ollama.com/install.sh | sh

# 拉取模型(以Qwen3.5为例)

ollama pull qwen3.5:9b

# 验证安装

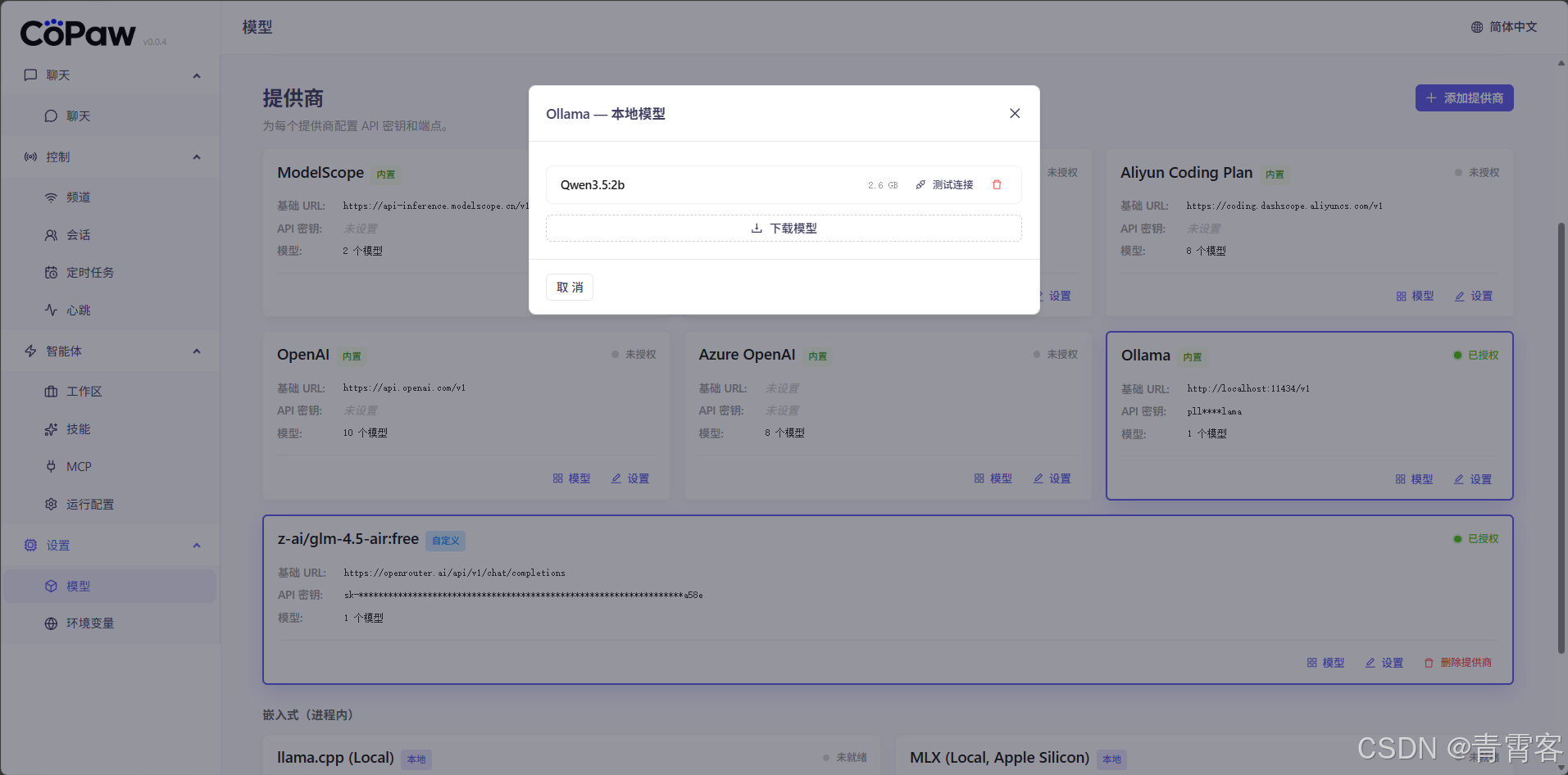

ollama list3.2 CoPaw接入Ollama的"曲线救国"

第四个坑:CoPaw无法使用Ollama自定义安装的第三方gguf模型

也就是说如果直接使用已经通过ollama安装的模型是没有办法接入到CoPaw当中去的,会报错,同时对本地安装的模型自定义名称后也接入CoPaw也会报错。

解决方案:拉取Ollama官网模型

Ollama内置了一个与OpenAI API格式兼容的端点:

bash

ollama pull qwen3.5:9b

在CoPaw的Web控制台中,进入 设置 → 模型 → 选择ollama,按以下配置:

| 配置项 | 值 |

|---|---|

| 提供商名称 | ollama_local |

| Base URL | http://localhost:11434/v1 |

| API Key | ollama(任意字符串,本地不校验) |

然后添加模型:

- 模型名称 :

qwen3.5:9b(必须与ollama list显示的名称完全一致) - 模型类型 :

openai_chat

第五个坑:模型名称大小写敏感

如果模型名称写错(比如大小写不匹配),CoPaw不会报错,但对话时会返回空响应或奇怪的错误。

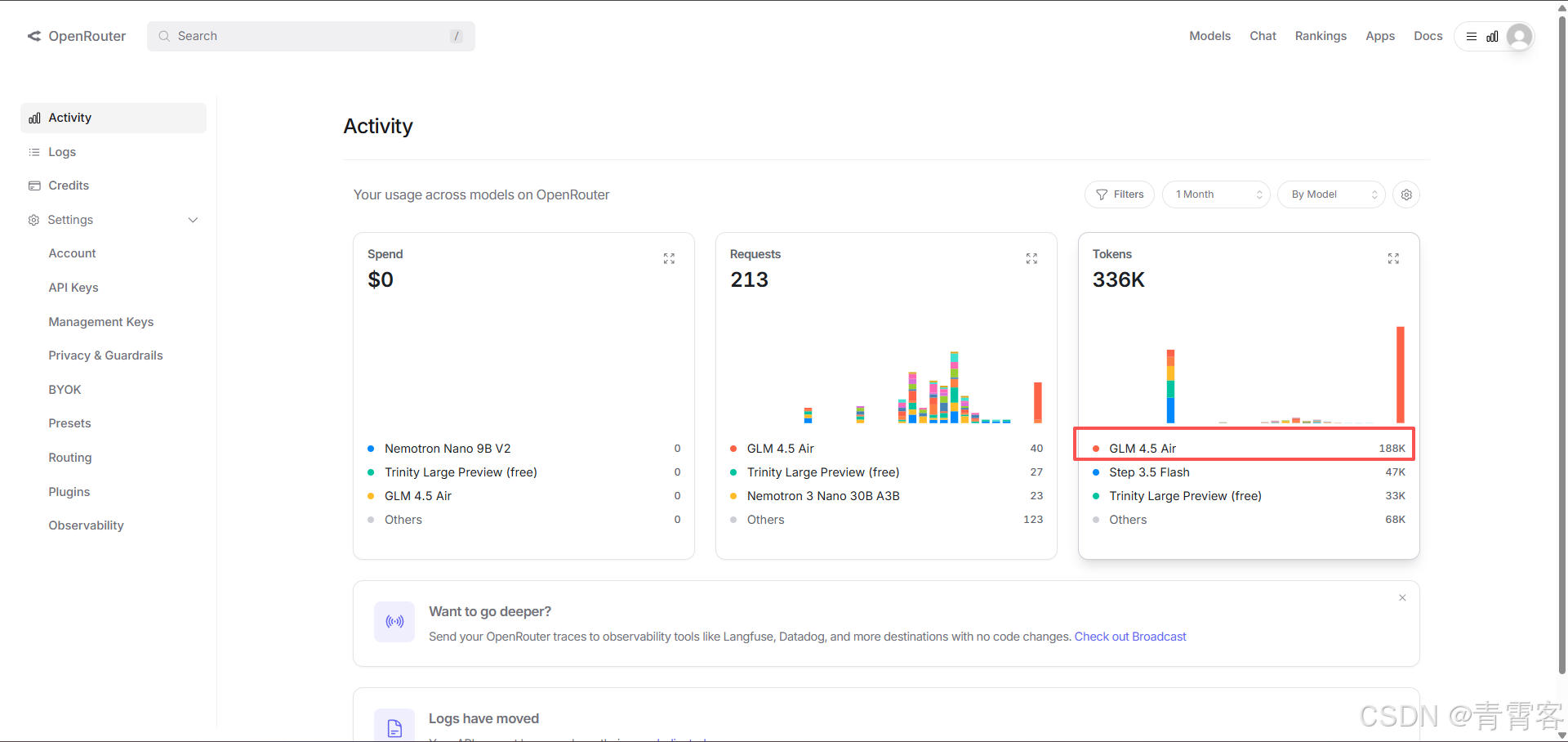

第六个坑:云端大模型API服务token巨量消耗

CoPaw太费token了,一轮对话消耗的token堪比做四五个软件项目,而最终实现的仅仅是整理推送你想要的信息。

3.3 验证Ollama是否可用

在配置CoPaw之前,先验证Ollama的接口是否正常:

bash

ollama run qwen3.5:9b如果返回正常的响应,说明ollama可用。

第七个坑:环境变量不生效

CoPaw的配置优先级可能是:配置文件 > 环境变量 > 默认值。如果Web界面已经保存过配置,环境变量可能被覆盖。建议先删除 ~/.copaw/ 目录下的配置缓存,再重新初始化。

四、钉钉接入:从开发者后台到消息互通

CoPaw的多频道接入是其核心亮点,钉钉作为国内主流办公平台,是必选项。

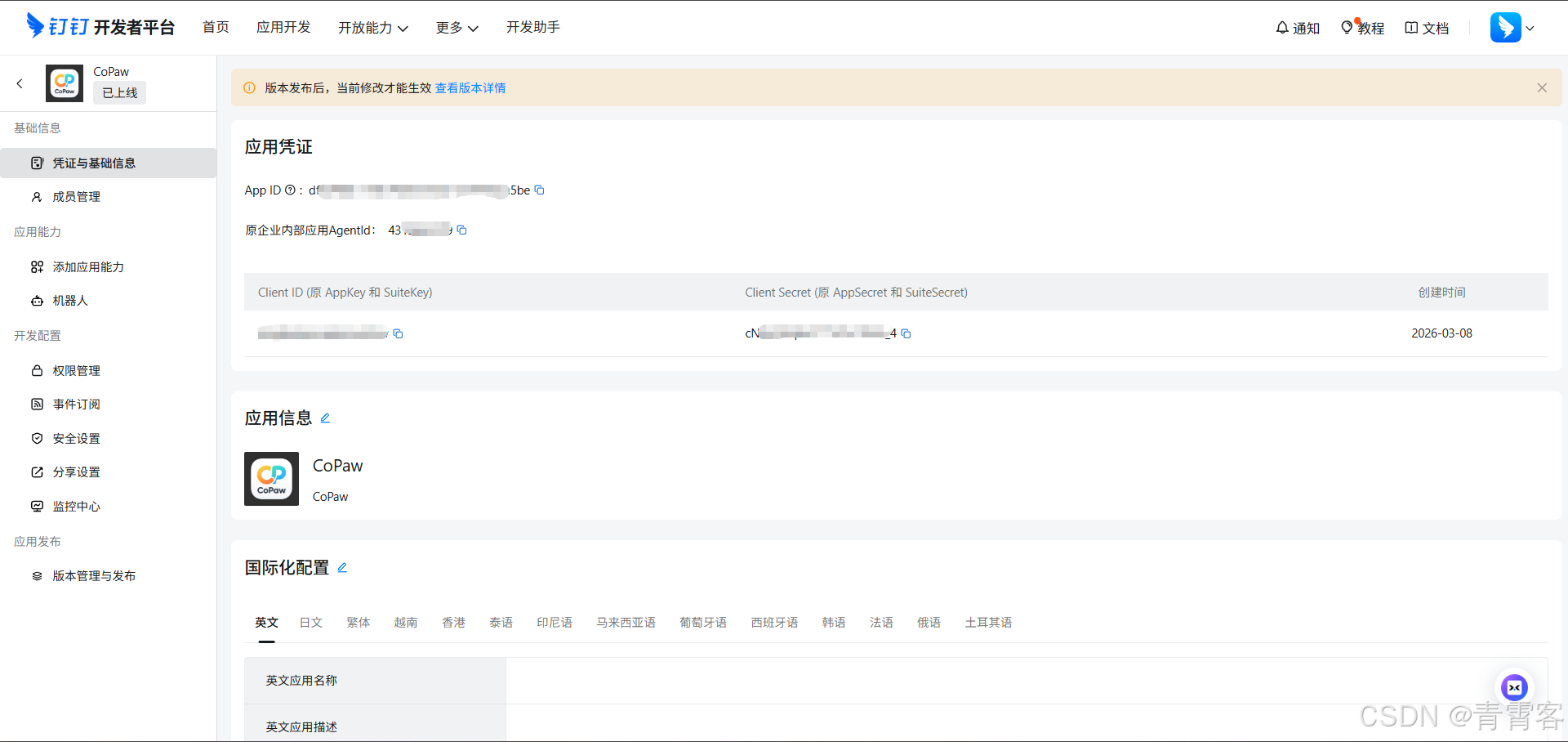

4.1 钉钉开发者后台配置

-

登录钉钉开放平台(https://open.dingtalk.com/)

- 需要有开发者权限的组织,或创建新组织

-

创建应用

- 进入"应用开发" → "企业内部应用" → "钉钉应用" → "创建应用"

- 填写应用名称、描述、图标

-

添加机器人能力

- 在应用详情页,选择"应用能力" → "添加应用能力" → "机器人"

- 关键配置 :消息接收模式选择 Stream模式(流式接收)

- 点击"发布"完成机器人配置

-

获取凭证

- 在"凭证与基础信息"页面,记录:

- Client ID(即AppKey)

- Client Secret(即AppSecret)

- 在"凭证与基础信息"页面,记录:

-

版本发布

- 进入"版本管理与发布" → "创建新版本"

- 填写版本号、更新说明,保存并发布

-

IP白名单(重要)

- 如果CoPaw需要下载用户发送的图片/文件,必须配置服务器出口IP

- 在"安全设置" → "服务器出口IP"中添加运行CoPaw机器的公网IP

- 查询公网IP:

curl ifconfig.me

4.2 CoPaw端配置

在CoPaw Web控制台中:

- 进入"控制" → "频道"

- 点击"钉钉"卡片

- 打开"Enabled"开关

- 填入之前获取的 Client ID 和 Client Secret

- 点击保存

4.3 测试对话

配置完成后,在钉钉中:

- 搜索你创建的机器人名称

- 进入单聊或拉入群聊

- 发送测试消息:

你好,请自我介绍

如果一切正常,CoPaw会通过Ollama本地模型生成回复,并显示在钉钉中。

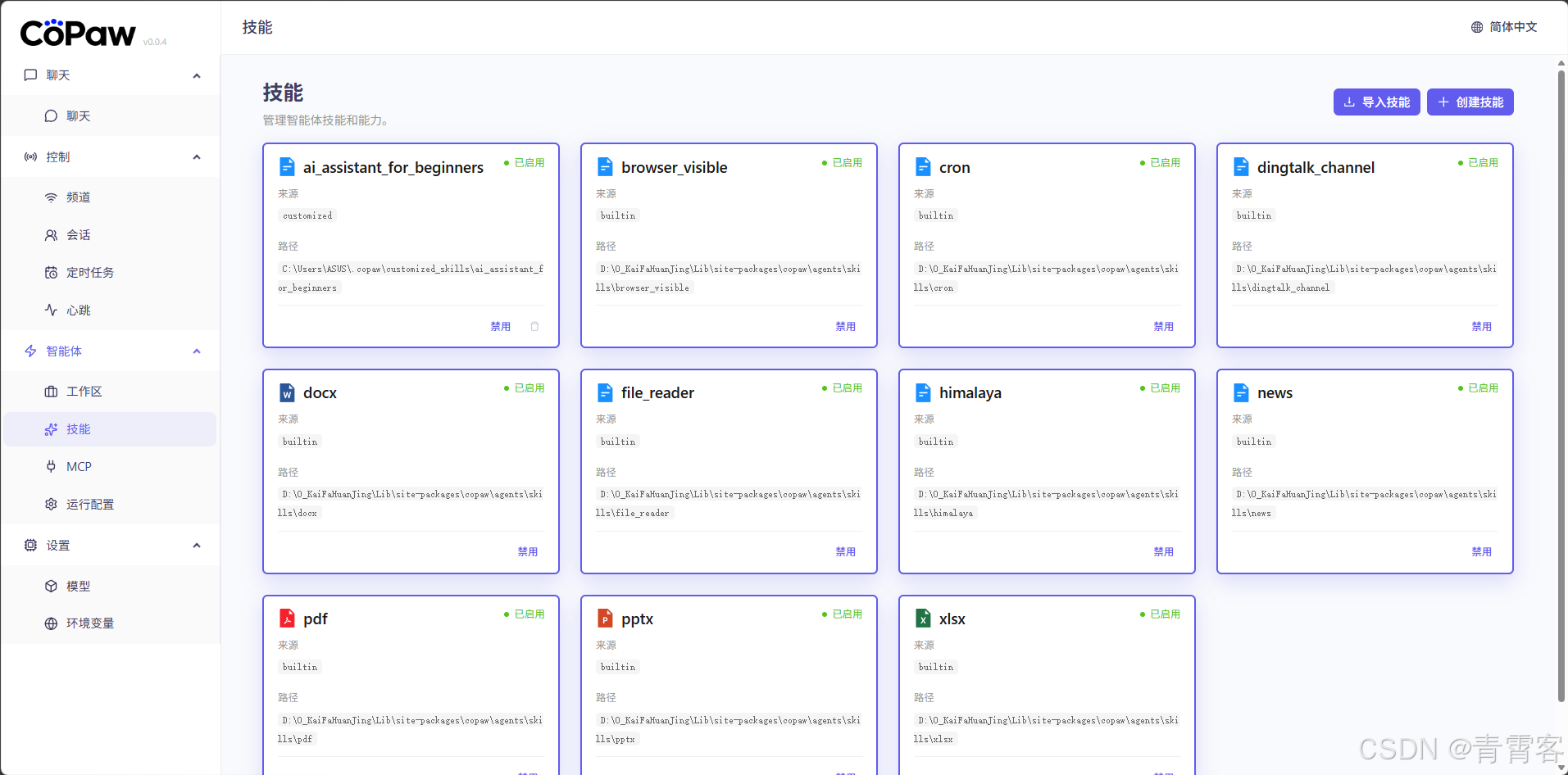

五、进阶配置:Skills与定时任务

CoPaw的Skills系统是其扩展性的核心。内置Skills包括:

- 文件处理:PDF、DOCX、XLSX解析

- 浏览器控制:Playwright自动化

- 新闻摘要:定时抓取热点

- 邮件处理:Himalaya邮件客户端集成

5.1 启用Skills

在Web控制台的"Skills"页面,可以启用/禁用技能。启用后,Agent会在合适的时机自动调用。

5.2 自定义Skill

Skills本质是Python文件,存放在 ~/.copaw/active_skills/ 或 ~/.copaw/customized_skills/ 目录。

一个简单的Skill结构:

python

# ~/.copaw/customized_skills/my_skill.py

from copaw.skills import Skill, skill

@skill

class MySkill(Skill):

name = "my_skill"

description = "我的自定义技能"

def run(self, query: str) -> str:

# 实现逻辑

return f"处理结果:{query}"第八个坑:Skills不自动加载

添加自定义Skill后,需要重启CoPaw,或在控制台手动刷新Skills列表。

六、为什么放弃?------收益、消耗与理性分析

经过一周的深入使用,我最终选择放弃CoPaw作为日常生产力工具。这不是因为技术能力不足,而是基于成本-收益比的理性决策。

6.1 收益侧:它确实能做什么?

- 隐私保护:数据完全本地,适合处理敏感信息

- 多端统一:一个后端服务,同时服务钉钉、飞书等多个前端

- 可扩展性:Skills机制确实灵活,可以自定义工作流

6.2 消耗侧:隐藏成本远超预期

安全问题:

- 系统级权限过高

CoPaw的定位是"做事"而非"聊天",需要获得很高的系统权限才能操控本地文件和应用。一旦授权,它可自主浏览网页、发送邮件、安排日程甚至完成在线支付,这种深度系统访问权限使其成为高风险攻击面 。 - 一键远程代码执行漏洞(CVE-2026-25253)

安全研究员发现毫秒级攻击链:受害者只需访问恶意网页,攻击者即可通过跨站 WebSocket 劫持获取身份验证 Token,建立连接后禁用沙箱和安全提示,最终执行远程代码。漏洞源于服务器未验证 WebSocket 来源标头 。 - 参数注入 RCE(CVE-2026-28363,CVSS 9.9)

safe-bin 白名单校验逻辑存在缺陷,未对 GNU 长选项缩写进行规范化处理。攻击者可通过提交缩写参数(如 --compress-p 代替 --compress-program)绕过过滤,以 root 权限执行任意 Shell 命令 。 - ClawHub 供应链攻击

官方技能市场 ClawHub 近 4000 个技能中,7.1%(283个)存在敏感凭据泄露,包括 API 密钥、密码、信用卡号等。另有 76 个恶意载荷专门用于凭证盗窃和后门安装。攻击者可通过恶意文档植入后门,窃取用户文件或部署勒索软件 。 - 无认证公网暴露

CoPaw 实例直接暴露于公网且未启用任何认证。在无需凭证的情况下就可以成功获取 Anthropic API Key、Telegram Bot Token、Slack 账号及数月完整聊天记录 。 - 架构性安全缺陷

信任边界模糊:部署时缺乏有效权限控制和审计机制

本地信任机制被攻破:对 localhost 来源默认完全信任,未进行严格的 HTTP Header Origin 检查,导致暴力破解风险

Node.js 单进程架构:所有操作在共享内存的单一进程中运行,一个技能可能访问其他集成的凭证

显存/内存黑洞:

- 运行9B参数模型(Qwen3.5:9b,4-bit 量化)需要至少8GB显存 或16GB内存

- CoPaw本身基于Python,内存占用随运行时间持续增长,观察到的内存泄漏现象明显

- 如果启用浏览器控制(Playwright),Chrome实例会额外消耗2-4GB内存

持续的调优负担:

- 本地模型效果不如云端API,需要频繁调整prompt和参数

- 使用云端API会产生巨额的token消耗费用

- Skills的调试没有完善的日志系统,出问题需要翻源码

- 钉钉token定期过期,需要手动更新

- 网络环境变化(如IP变动)需要重新配置白名单

量化估算:

- 初次部署:4-6小时(踩坑+调试)

- 每周维护:1-2小时(处理异常、更新配置、重启服务)

- 月度总投入:8-12小时

6.2.3 工作任务层面的不匹配

场景1:日常问答

- copaw的推理质量明显弱于直接使用deepseek/Claude 3.5 Sonnet等

- 复杂逻辑经常"胡言乱语",需要人工二次验证

- 结论:效率反而低于直接使用云端API

场景2:定时任务

- 需要保持机器24小时开机,电费+硬件损耗成本

- 任务失败没有完善的告警机制,经常错过关键时间点

- 结论:不如云函数(如阿里云函数计算)可靠

场景3:开发任务

- 不管是云端还是本地模型,使用copaw开发的效果不如直接用cline或者trae之类的ide。

- 对开发任务执行会消耗大量的token去新建新的无关紧要的skills(脱裤子放屁,多此一举)。

- 结论:无法承载生产环境负载

6.3 核心矛盾:个人玩具 vs 生产工具

CoPaw的定位是"个人AI助理",但它的架构设计(Python单体应用、JSON文件存储、无数据库)决定了它无法平滑扩展到生产环境。

个人使用场景:

- 你愿意每周花几小时维护一个"赛博宠物"

- 享受折腾开源项目的乐趣

- 对新技术有偏执要求

生产使用场景:

- 需要99.9%的稳定性

- 需要99.9%的安全性

- 多人协作和权限管理

- 与现有企业系统的深度集成

CoPaw卡在中间:

- 对个人用户:太重(需要独立服务器、域名、内网穿透)

- 对企业用户:太轻(无SSO、无审计日志、无高可用架构)

6.4 替代方案对比

| 方案 | 月成本 | 维护时间 | 稳定性 | 隐私性 | 适用场景 |

|---|---|---|---|---|---|

| CoPaw本地部署 | 电费~50元 | 8-12h | ⭐⭐ | ⭐⭐⭐⭐⭐ | 极客玩具 |

| 云端API直连 | 20-100元 | <1h | ⭐⭐⭐⭐⭐ | ⭐⭐ | 日常办公 |

| Dify/Flowise | 云服务器~100元 | 2-3h | ⭐⭐⭐⭐ | ⭐⭐⭐ | 工作流自动化 |

| 钉钉官方AI助理 | 免费/企业版 | 0h | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | 钉钉生态内 |

| Claude/GPT官方 | 20美元 | 0h | ⭐⭐⭐⭐⭐ | ⭐⭐ | 通用助理 |

结论:对于大多数用户,直接购买云端API服务或钉钉官方方案,ROI(投资回报率)远高于自建CoPaw。

七、适合谁?不适合谁?

适合人群

- 开源贡献者:想参与AgentScope生态建设

- 隐私偏执狂:绝不接受数据上云,有本地算力储备

- AI Agent研究者:需要可修改源码的实验平台

- 极客爱好者:享受"自己养AI"的过程,而非结果

不适合人群

- 效率优先者:希望开箱即用,不想折腾配置

- 资源受限者:没有独立服务器或高配个人电脑

- 团队协作需求:需要多人共享、权限管理、审计日志

- 稳定性要求高:不能容忍服务偶尔崩溃或响应延迟

- 安全性要求高:对安全较为敏感的人群,copaw和openclaw一样,装了之后,基本上就是在裸奔。

八、总结与建议

CoPaw是一个技术愿景优秀但工程实现尚不成熟 的项目,反映了当前开源个人助理的普遍困境:理想丰满,现实骨感。

如果你决定尝试:

- 准备一台至少16GB内存的专用机器(不要用主力工作机)

- 使用Docker部署,方便随时销毁重建

- 先接入Console频道测试,稳定后再接钉钉

- 做好每周维护的心理准备

如果你决定放弃 :

这并不意味着技术能力不足,而是理性选择更优解。把省下的时间投入到核心业务或家庭生活中,收益会更高。

参考链接

- CoPaw官网:https://copaw.agentscope.io/

- GitHub仓库:https://github.com/agentscope-ai/CoPaw

- 钉钉开放平台:https://open.dingtalk.com/

- Ollama官网:https://ollama.com/

- AgentScope文档:https://agentscope.io/

免责声明:本文基于CoPaw当前最新版本撰写,后续版本可能已修复部分问题。技术方案选择请根据自身实际情况判断,不构成任何投资或技术决策建议。

本文原创,原创不易,如需转载,请联系作者授权。