一、Ollama私有化部署

1.1 Ollama是什么?

一句话定义:Ollama是一个开源的、轻量级的本地大语言模型运行和管理平台,让你能在自己的电脑上轻松运行各种开源模型(如Llama 3、DeepSeek、Qwen等),就像Docker管理容器一样方便。

下载地址:https://ollama.com/download

2.2 安装Ollama

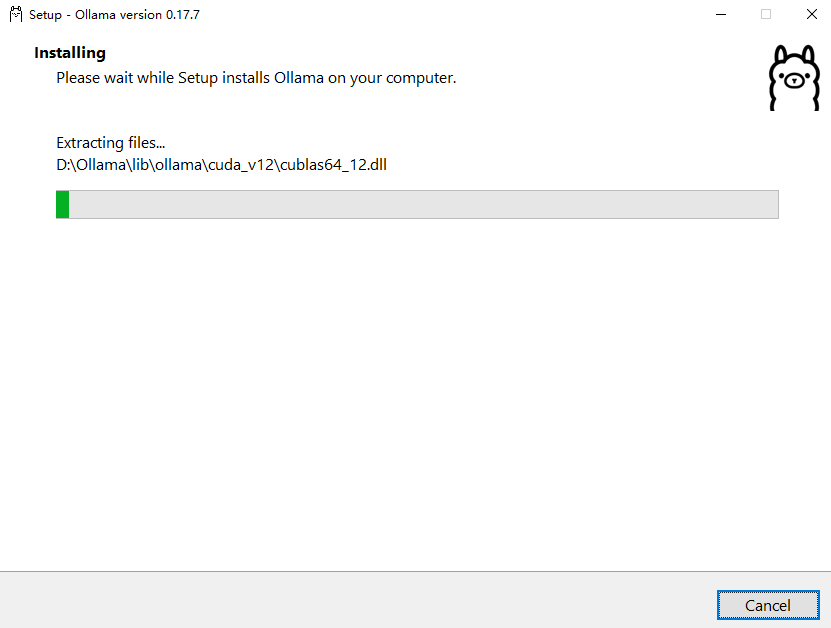

- 使用命令行安装,避免安装到c盘

进入安装包所在目录执行命令安装,点击install,这样安装路径就是我们的指定路径,大模型也会默认下载在我们指定的目录下。

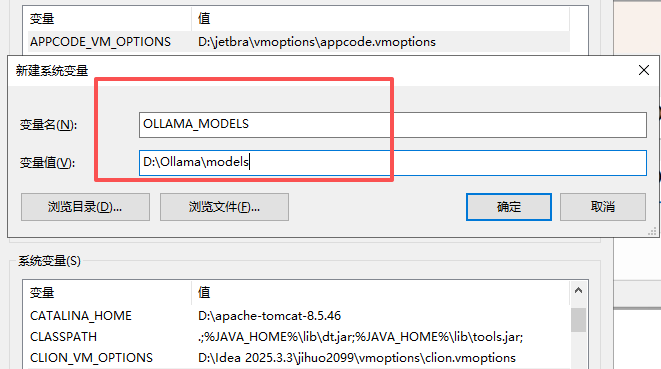

- 新建环境变量,存放大模型数据包的位置

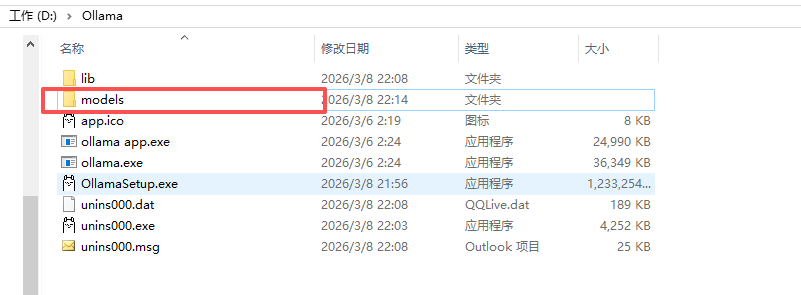

- 停止Ollama客户端,找到c盘下的models文件夹,剪切到新建环境变量的目录下

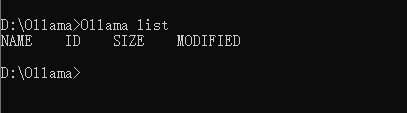

- 删掉c盘下的models文件夹,重启客户端,命令行输入Ollama List,查看大模型资源包是否正常展示(这一步主要是将大模型数据目录转移到 自己的安装盘而非c盘)

- 验证是否安装成功

2.3 安装大模型

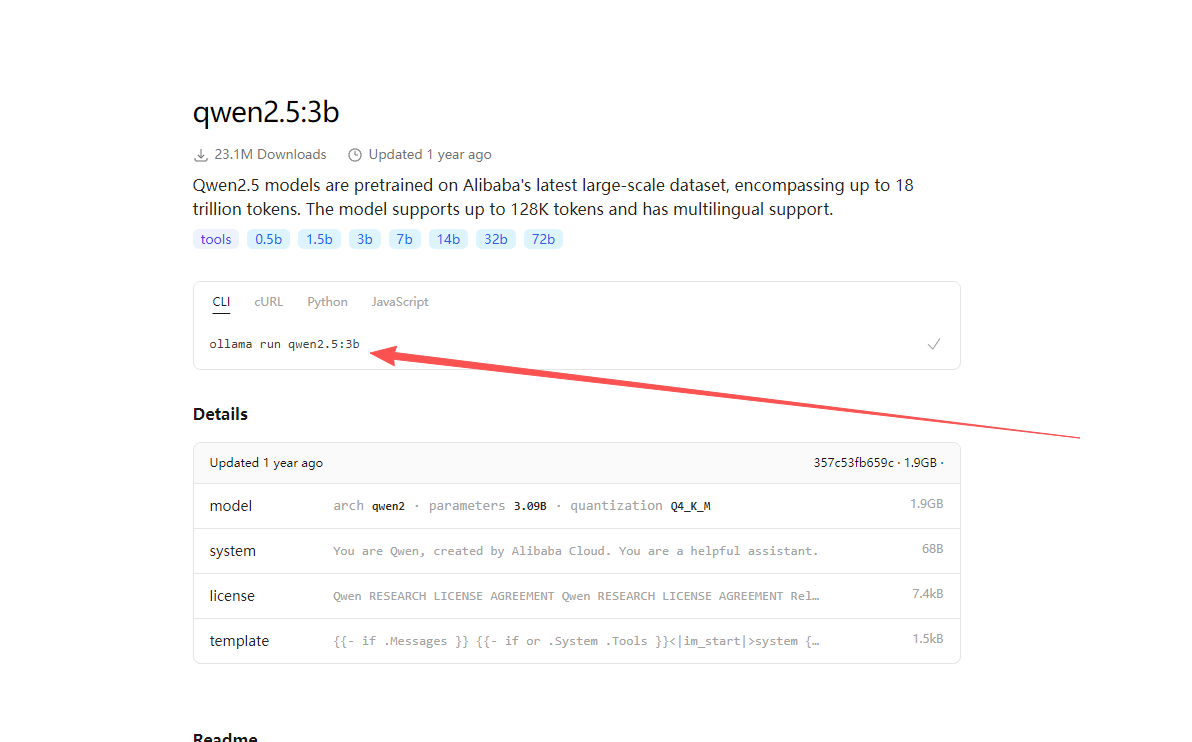

- ollama首页搜索要下载的大模型

- 找到对应的模型,参数越高,占用的电脑磁盘内存越大,显卡要求也越高

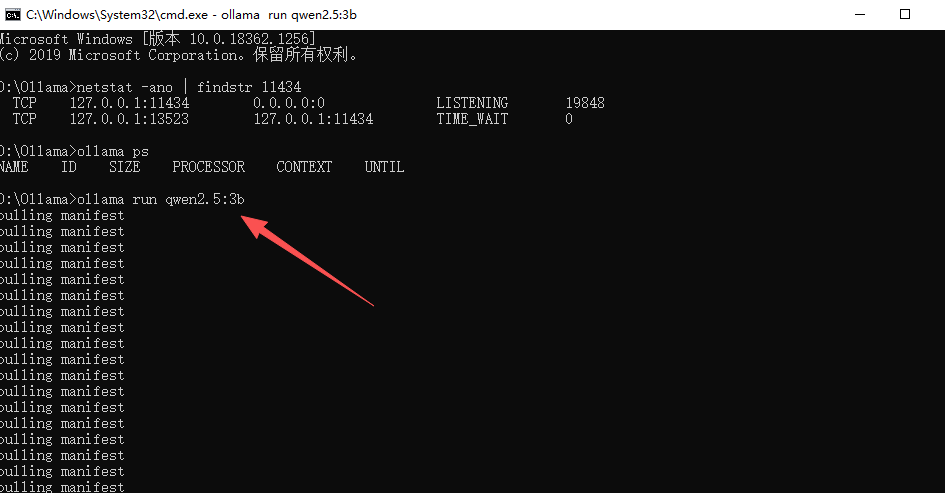

- 我这里下载一个比较小的,拷贝命令执行

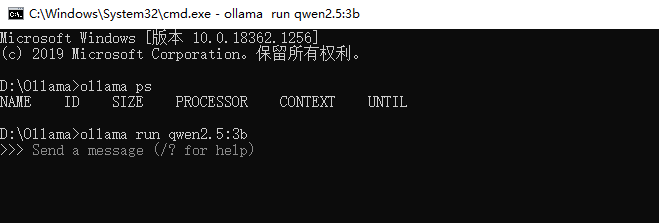

- 下载完成后执行命令ollama run qwen2.5:3b运行安装的大模型实例

2.4 调用本地大模型

- 新建demo2

pom文件主要新增ollama的依赖

<!--ollama-->

<dependency>

<groupId>org.springframework.ai</groupId>

<artifactId>spring-ai-starter-model-ollama</artifactId>

<version>1.0.0</version>

</dependency>-

配置yml文件

server:

port: 8002

servlet:

encoding:

enabled: true

force: true

charset: utf-8spring:

application:

name: demo2

# ====ollama Config=============

ai:

dashscope:

api-key: ${aliQwen-api}

ollama:

base-url: http://localhost:11434

chat:

model: qwen2.5:3b -

编写controller测试

package com.wx.controller;

import jakarta.annotation.Resource;

import org.springframework.ai.chat.model.ChatModel;

import org.springframework.ai.ollama.OllamaChatModel;

import org.springframework.web.bind.annotation.GetMapping;

import org.springframework.web.bind.annotation.RequestParam;

import org.springframework.web.bind.annotation.RestController;

import reactor.core.publisher.Flux;/**

-

@Description

-

@author: wangxin

-

@date: 2026/3/7 20:42

*/

@RestController

public class OllamaController {@Resource(name = "ollamaChatModel")

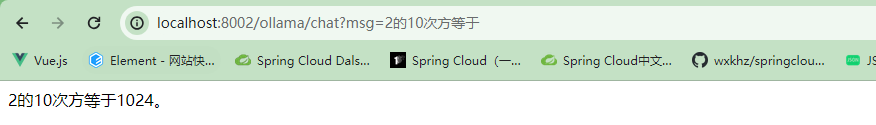

private ChatModel chatModel;@GetMapping("/ollama/chat")

public String testChat(@RequestParam(name = "msg", defaultValue = "你是谁") String msg) {String call = chatModel.call(msg); System.out.println("大模型返回:" + call); return call;}

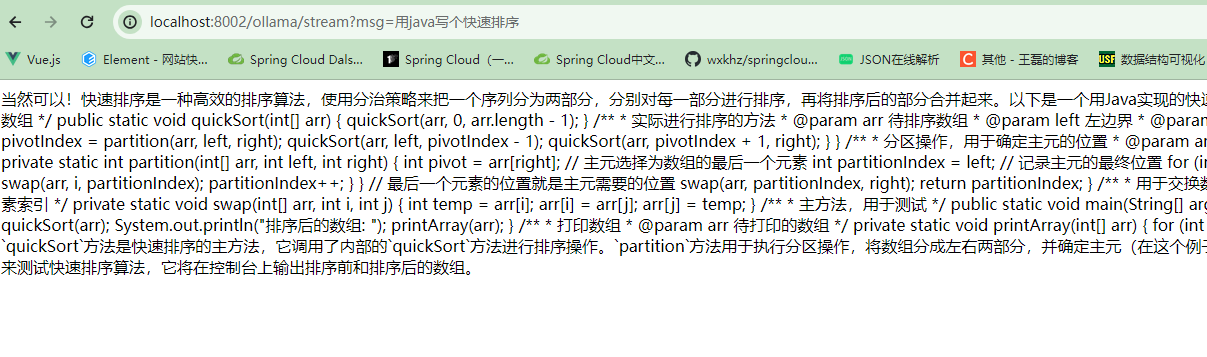

@GetMapping("/ollama/stream")

public Flux<String> testStream(@RequestParam(name = "msg", defaultValue = "你是谁") String msg) {return chatModel.stream(msg);}

}

-