在高并发分布式系统中,IO通信是决定系统吞吐量与响应延迟的核心瓶颈之一。从JDK 1.0的BIO到JDK 1.4的NIO,再到JDK 1.7的AIO,Java IO模型的每一次演进,都围绕着「减少线程阻塞、提升资源利用率、支撑更高并发」这一核心目标。而Reactor模型作为IO多路复用架构的工业级标准,是Netty、Redis、Nginx等高性能组件的核心基石。

很多开发者对IO模型的认知停留在「BIO阻塞、NIO非阻塞」的表层,对Reactor模型的演进逻辑、底层实现与落地坑点一知半解,最终在高并发场景下频繁出现线程膨胀、OOM、吞吐量不足等问题。本文将从UNIX IO底层原理出发,全链路拆解Java BIO/NIO/AIO的核心差异,深度解析Reactor模型的架构演进路径,结合代码示例,帮你彻底吃透高并发IO架构的核心逻辑,既能夯实底层基础,也能解决实际业务问题。

一、IO模型的底层基石:UNIX 5种IO模型标准

所有Java IO模型的底层实现,都严格遵循UNIX操作系统定义的IO模型规范,该规范来自《UNIX网络编程 卷1:套接字联网API》的权威定义。一次完整的IO操作分为两个核心阶段:

-

等待数据准备阶段:内核等待网络数据到达,写入内核缓冲区

-

数据拷贝阶段:内核将数据从内核缓冲区拷贝到用户进程缓冲区

同步与异步的核心区别:数据拷贝阶段,用户线程是否需要主动参与、是否阻塞 ;阻塞与非阻塞的核心区别:数据准备阶段,用户线程是否会被挂起阻塞。

UNIX系统定义了5种标准IO模型,也是Java IO模型的底层原型:

-

阻塞IO(Blocking IO):两个阶段全程阻塞,用户线程发起IO调用后,一直阻塞到数据拷贝完成才返回

-

非阻塞IO(Non-Blocking IO):数据准备阶段非阻塞,用户线程轮询内核数据是否准备好,数据准备完成后,拷贝阶段全程阻塞

-

IO多路复用(IO Multiplexing):核心是多路复用器,单线程监听多个文件描述符(FD),当某个FD有事件就绪时,通知用户线程进行数据读写,数据拷贝阶段阻塞

-

信号驱动IO(Signal-Driven IO):用户线程注册信号回调,数据准备好后内核发送信号,用户线程在信号处理函数中完成数据拷贝,拷贝阶段阻塞

-

异步IO(Asynchronous IO):两个阶段完全非阻塞,用户线程发起IO调用后立即返回,内核完成两个阶段的所有操作后,通过回调通知用户线程,整个过程用户线程完全不参与IO操作

二、项目基础依赖配置

本文所有代码均基于JDK 17编写,采用Maven进行项目管理,完整pom.xml配置如下:

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<groupId>com.jam.demo</groupId>

<artifactId>io-reactor-demo</artifactId>

<version>1.0.0-SNAPSHOT</version>

<properties>

<maven.compiler.source>17</maven.compiler.source>

<maven.compiler.target>17</maven.compiler.target>

<project.build.sourceEncoding>UTF-8</project.build.sourceEncoding>

<spring-core.version>6.1.15</spring-core.version>

<lombok.version>1.18.34</lombok.version>

<guava.version>33.2.1-jre</guava.version>

<fastjson2.version>2.0.53</fastjson2.version>

<netty.version>4.1.112.Final</netty.version>

<mybatis-plus.version>3.5.7</mybatis-plus.version>

<springdoc.version>2.5.0</springdoc.version>

<mysql-connector.version>8.4.0</mysql-connector.version>

</properties>

<dependencies>

<dependency>

<groupId>org.springframework</groupId>

<artifactId>spring-core</artifactId>

<version>${spring-core.version}</version>

</dependency>

<dependency>

<groupId>org.springframework</groupId>

<artifactId>spring-context</artifactId>

<version>${spring-core.version}</version>

</dependency>

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

<version>${lombok.version}</version>

<scope>provided</scope>

</dependency>

<dependency>

<groupId>com.google.guava</groupId>

<artifactId>guava</artifactId>

<version>${guava.version}</version>

</dependency>

<dependency>

<groupId>com.alibaba.fastjson2</groupId>

<artifactId>fastjson2</artifactId>

<version>${fastjson2.version}</version>

</dependency>

<dependency>

<groupId>io.netty</groupId>

<artifactId>netty-all</artifactId>

<version>${netty.version}</version>

</dependency>

<dependency>

<groupId>com.baomidou</groupId>

<artifactId>mybatis-plus-boot-starter</artifactId>

<version>${mybatis-plus.version}</version>

</dependency>

<dependency>

<groupId>org.springdoc</groupId>

<artifactId>springdoc-openapi-starter-webmvc-ui</artifactId>

<version>${springdoc.version}</version>

</dependency>

<dependency>

<groupId>com.mysql</groupId>

<artifactId>mysql-connector-j</artifactId>

<version>${mysql-connector.version}</version>

<scope>runtime</scope>

</dependency>

<dependency>

<groupId>org.slf4j</groupId>

<artifactId>slf4j-api</artifactId>

<version>2.0.16</version>

</dependency>

<dependency>

<groupId>ch.qos.logback</groupId>

<artifactId>logback-classic</artifactId>

<version>1.5.6</version>

</dependency>

</dependencies>

<build>

<plugins>

<plugin>

<groupId>org.apache.maven.plugins</groupId>

<artifactId>maven-compiler-plugin</artifactId>

<version>3.13.0</version>

<configuration>

<source>17</source>

<target>17</target>

<encoding>UTF-8</encoding>

</configuration>

</plugin>

</plugins>

</build>

</project>三、Java IO模型全链路深度解析

3.1 BIO:阻塞IO模型

BIO全称Blocking IO,是JDK 1.0提供的原生IO实现,基于字节流/字符流构建,采用「连接per线程」模型:服务端每接收到一个客户端连接,就创建一个独立的线程处理该连接的所有IO操作与业务逻辑,IO操作的两个阶段全程阻塞。

核心特点

-

编程模型简单,逻辑直观,适合低并发场景

-

线程与连接强绑定,高并发下线程数随连接数线性增长

-

阻塞模式下,线程大部分时间处于空闲等待状态,CPU利用率极低

-

线程膨胀会导致频繁的上下文切换,极端场景下会出现OOM

代码示例

BIO服务端实现

package com.jam.demo.bio;

import lombok.extern.slf4j.Slf4j;

import org.springframework.util.StringUtils;

import java.io.BufferedReader;

import java.io.IOException;

import java.io.InputStreamReader;

import java.io.PrintWriter;

import java.net.ServerSocket;

import java.net.Socket;

import java.util.concurrent.ExecutorService;

import java.util.concurrent.LinkedBlockingQueue;

import java.util.concurrent.ThreadPoolExecutor;

import java.util.concurrent.TimeUnit;

/**

* BIO阻塞IO服务端实现

* @author ken

* @date 2026-03-09

*/

@Slf4j

public class BioServer {

private static final int PORT = 8080;

private static final ExecutorService BUSINESS_THREAD_POOL = new ThreadPoolExecutor(

10,

200,

60L,

TimeUnit.SECONDS,

new LinkedBlockingQueue<>(1024),

r -> new Thread(r, "bio-business-thread-" + r.hashCode()),

new ThreadPoolExecutor.CallerRunsPolicy()

);

public static void main(String[] args) {

try (ServerSocket serverSocket = new ServerSocket(PORT)) {

log.info("BIO服务端启动成功,监听端口:{}", PORT);

while (true) {

Socket socket = serverSocket.accept();

log.info("客户端连接成功,地址:{}", socket.getInetAddress().getHostAddress());

BUSINESS_THREAD_POOL.execute(new ClientHandler(socket));

}

} catch (IOException e) {

log.error("BIO服务端启动异常", e);

} finally {

BUSINESS_THREAD_POOL.shutdown();

}

}

/**

* 客户端连接处理器

*/

@Slf4j

static class ClientHandler implements Runnable {

private final Socket socket;

public ClientHandler(Socket socket) {

this.socket = socket;

}

@Override

public void run() {

try (BufferedReader in = new BufferedReader(new InputStreamReader(socket.getInputStream()));

PrintWriter out = new PrintWriter(socket.getOutputStream(), true)) {

String inputLine;

while ((inputLine = in.readLine()) != null) {

if (!StringUtils.hasText(inputLine)) {

continue;

}

log.info("收到客户端消息:{}", inputLine);

String response = "服务端已收到消息:" + inputLine;

out.println(response);

if ("exit".equalsIgnoreCase(inputLine)) {

log.info("客户端主动断开连接,地址:{}", socket.getInetAddress().getHostAddress());

break;

}

}

} catch (IOException e) {

log.error("客户端连接处理异常", e);

} finally {

try {

if (!socket.isClosed()) {

socket.close();

}

} catch (IOException e) {

log.error("socket关闭异常", e);

}

}

}

}

}BIO客户端实现

package com.jam.demo.bio;

import lombok.extern.slf4j.Slf4j;

import org.springframework.util.StringUtils;

import java.io.BufferedReader;

import java.io.IOException;

import java.io.InputStreamReader;

import java.io.PrintWriter;

import java.net.Socket;

import java.util.Scanner;

/**

* BIO阻塞IO客户端实现

* @author ken

* @date 2026-03-09

*/

@Slf4j

public class BioClient {

private static final String HOST = "127.0.0.1";

private static final int PORT = 8080;

public static void main(String[] args) {

try (Socket socket = new Socket(HOST, PORT);

BufferedReader in = new BufferedReader(new InputStreamReader(socket.getInputStream()));

PrintWriter out = new PrintWriter(socket.getOutputStream(), true);

Scanner scanner = new Scanner(System.in)) {

log.info("BIO客户端启动成功,已连接到服务端:{}:{}", HOST, PORT);

String inputLine;

while (true) {

System.out.print("请输入要发送的消息:");

inputLine = scanner.nextLine();

if (!StringUtils.hasText(inputLine)) {

System.out.println("消息不能为空,请重新输入");

continue;

}

out.println(inputLine);

String response = in.readLine();

log.info("收到服务端响应:{}", response);

if ("exit".equalsIgnoreCase(inputLine)) {

break;

}

}

} catch (IOException e) {

log.error("BIO客户端运行异常", e);

}

}

}核心痛点

BIO的线程模型决定了其无法支撑高并发场景:当并发连接数达到1000时,需要创建1000个处理线程,按每个线程栈默认1M计算,仅线程栈就会占用1G内存,高并发下会出现严重的线程膨胀、频繁上下文切换,最终导致OOM。因此BIO仅适用于连接数少、固定的轻量级场景。

3.2 NIO:IO多路复用模型

NIO全称Non-Blocking IO(也叫New IO),是JDK 1.4引入的非阻塞IO实现,核心基于IO多路复用模型构建,彻底解决了BIO「连接per线程」的痛点,是当前Java网络通信的核心基础。

三大核心组件

NIO的核心由三大组件构成,三者协同实现了非阻塞IO的全流程:

-

Channel:双向通道,对应IO操作的连接,可读可写,支持非阻塞模式,核心实现包括ServerSocketChannel(服务端连接通道)、SocketChannel(客户端通信通道)、FileChannel(文件IO通道)

-

Buffer:缓冲区,本质是一块连续的内存,NIO的所有数据读写都必须经过Buffer,解决了BIO流单向、一次性读写的问题。核心属性包括capacity(容量)、position(当前读写位置)、limit(读写上限);核心方法flip()用于将写模式切换为读模式,clear()用于重置缓冲区为写模式

-

Selector:多路复用器,NIO的核心组件,Linux系统底层基于epoll实现,Windows系统基于select实现。单线程可以管理上万个Channel,监听Channel的就绪事件(OP_ACCEPT连接事件、OP_CONNECT连接完成事件、OP_READ读事件、OP_WRITE写事件),当有事件就绪时,仅唤醒对应线程处理,实现「单线程管理多连接」。

核心执行流程

-

打开ServerSocketChannel,绑定端口,配置为非阻塞模式

-

打开Selector,将ServerSocketChannel注册到Selector上,监听OP_ACCEPT事件

-

Selector线程轮询调用select()方法,阻塞等待就绪事件

-

当OP_ACCEPT事件就绪,接受客户端连接,创建SocketChannel,配置为非阻塞模式,注册到Selector上,监听OP_READ事件

-

当OP_READ事件就绪,从SocketChannel读取数据到Buffer,处理业务逻辑

-

业务处理完成后,将响应数据写入Buffer,通过SocketChannel发送给客户端

代码示例

NIO服务端实现

package com.jam.demo.nio;

import lombok.extern.slf4j.Slf4j;

import org.springframework.util.StringUtils;

import java.io.IOException;

import java.net.InetSocketAddress;

import java.nio.ByteBuffer;

import java.nio.channels.SelectionKey;

import java.nio.channels.Selector;

import java.nio.channels.ServerSocketChannel;

import java.nio.channels.SocketChannel;

import java.nio.charset.StandardCharsets;

import java.util.Iterator;

import java.util.Set;

import java.util.concurrent.ExecutorService;

import java.util.concurrent.LinkedBlockingQueue;

import java.util.concurrent.ThreadPoolExecutor;

import java.util.concurrent.TimeUnit;

/**

* NIO非阻塞IO服务端实现

* @author ken

* @date 2026-03-09

*/

@Slf4j

public class NioServer {

private static final int PORT = 8081;

private static final int BUFFER_SIZE = 1024;

private static final ExecutorService BUSINESS_THREAD_POOL = new ThreadPoolExecutor(

10,

200,

60L,

TimeUnit.SECONDS,

new LinkedBlockingQueue<>(1024),

r -> new Thread(r, "nio-business-thread-" + r.hashCode()),

new ThreadPoolExecutor.CallerRunsPolicy()

);

public static void main(String[] args) {

try (ServerSocketChannel serverSocketChannel = ServerSocketChannel.open();

Selector selector = Selector.open()) {

serverSocketChannel.configureBlocking(false);

serverSocketChannel.socket().bind(new InetSocketAddress(PORT));

serverSocketChannel.register(selector, SelectionKey.OP_ACCEPT);

log.info("NIO服务端启动成功,监听端口:{}", PORT);

while (true) {

int readyChannels = selector.select(1000);

if (readyChannels == 0) {

continue;

}

Set<SelectionKey> selectionKeys = selector.selectedKeys();

Iterator<SelectionKey> iterator = selectionKeys.iterator();

while (iterator.hasNext()) {

SelectionKey key = iterator.next();

iterator.remove();

if (!key.isValid()) {

continue;

}

if (key.isAcceptable()) {

handleAccept(key, selector);

} else if (key.isReadable()) {

handleRead(key);

}

}

}

} catch (IOException e) {

log.error("NIO服务端运行异常", e);

} finally {

BUSINESS_THREAD_POOL.shutdown();

}

}

/**

* 处理客户端连接事件

* @param key 选择键

* @param selector 多路复用器

*/

private static void handleAccept(SelectionKey key, Selector selector) throws IOException {

ServerSocketChannel serverChannel = (ServerSocketChannel) key.channel();

SocketChannel socketChannel = serverChannel.accept();

socketChannel.configureBlocking(false);

socketChannel.register(selector, SelectionKey.OP_READ, ByteBuffer.allocate(BUFFER_SIZE));

log.info("客户端连接成功,地址:{}", socketChannel.getRemoteAddress());

}

/**

* 处理客户端读事件

* @param key 选择键

*/

private static void handleRead(SelectionKey key) {

SocketChannel socketChannel = (SocketChannel) key.channel();

ByteBuffer buffer = (ByteBuffer) key.attachment();

try {

int readBytes = socketChannel.read(buffer);

if (readBytes == -1) {

log.info("客户端主动断开连接,地址:{}", socketChannel.getRemoteAddress());

key.cancel();

socketChannel.close();

return;

}

buffer.flip();

String request = StandardCharsets.UTF_8.decode(buffer).toString();

buffer.clear();

if (!StringUtils.hasText(request)) {

return;

}

log.info("收到客户端消息:{}", request);

BUSINESS_THREAD_POOL.execute(() -> {

try {

String response = "服务端已收到消息:" + request;

socketChannel.write(ByteBuffer.wrap(response.getBytes(StandardCharsets.UTF_8)));

} catch (IOException e) {

log.error("响应客户端消息异常", e);

}

});

} catch (IOException e) {

log.error("读取客户端消息异常", e);

key.cancel();

try {

socketChannel.close();

} catch (IOException ex) {

log.error("socket关闭异常", ex);

}

}

}

}NIO客户端实现

package com.jam.demo.nio;

import lombok.extern.slf4j.Slf4j;

import org.springframework.util.StringUtils;

import java.io.IOException;

import java.net.InetSocketAddress;

import java.nio.ByteBuffer;

import java.nio.channels.SelectionKey;

import java.nio.channels.Selector;

import java.nio.channels.SocketChannel;

import java.nio.charset.StandardCharsets;

import java.util.Iterator;

import java.util.Scanner;

import java.util.Set;

/**

* NIO非阻塞IO客户端实现

* @author ken

* @date 2026-03-09

*/

@Slf4j

public class NioClient {

private static final String HOST = "127.0.0.1";

private static final int PORT = 8081;

private static final int BUFFER_SIZE = 1024;

public static void main(String[] args) {

try (SocketChannel socketChannel = SocketChannel.open();

Selector selector = Selector.open();

Scanner scanner = new Scanner(System.in)) {

socketChannel.configureBlocking(false);

socketChannel.connect(new InetSocketAddress(HOST, PORT));

socketChannel.register(selector, SelectionKey.OP_CONNECT);

log.info("NIO客户端启动成功,正在连接服务端:{}:{}", HOST, PORT);

while (true) {

int readyChannels = selector.select(1000);

if (readyChannels > 0) {

Set<SelectionKey> selectionKeys = selector.selectedKeys();

Iterator<SelectionKey> iterator = selectionKeys.iterator();

while (iterator.hasNext()) {

SelectionKey key = iterator.next();

iterator.remove();

if (!key.isValid()) {

continue;

}

if (key.isConnectable()) {

handleConnect(key, selector);

} else if (key.isReadable()) {

handleRead(key);

}

}

}

if (System.in.available() > 0) {

System.out.print("请输入要发送的消息:");

String inputLine = scanner.nextLine();

if (!StringUtils.hasText(inputLine)) {

System.out.println("消息不能为空,请重新输入");

continue;

}

socketChannel.write(ByteBuffer.wrap(inputLine.getBytes(StandardCharsets.UTF_8)));

if ("exit".equalsIgnoreCase(inputLine)) {

break;

}

}

}

} catch (IOException e) {

log.error("NIO客户端运行异常", e);

}

}

/**

* 处理服务端连接完成事件

* @param key 选择键

* @param selector 多路复用器

*/

private static void handleConnect(SelectionKey key, Selector selector) throws IOException {

SocketChannel socketChannel = (SocketChannel) key.channel();

if (socketChannel.finishConnect()) {

socketChannel.configureBlocking(false);

socketChannel.register(selector, SelectionKey.OP_READ, ByteBuffer.allocate(BUFFER_SIZE));

log.info("成功连接到服务端:{}:{}", HOST, PORT);

}

}

/**

* 处理服务端响应读事件

* @param key 选择键

*/

private static void handleRead(SelectionKey key) throws IOException {

SocketChannel socketChannel = (SocketChannel) key.channel();

ByteBuffer buffer = (ByteBuffer) key.attachment();

int readBytes = socketChannel.read(buffer);

if (readBytes == -1) {

log.info("服务端断开连接");

key.cancel();

socketChannel.close();

return;

}

buffer.flip();

String response = StandardCharsets.UTF_8.decode(buffer).toString();

buffer.clear();

log.info("收到服务端响应:{}", response);

}

}核心优势

-

线程模型优化:单Selector线程可以管理上万连接,线程数不再随连接数线性增长,彻底避免了线程膨胀问题

-

资源利用率高:非阻塞模式下,IO操作不会阻塞线程,线程可以持续处理就绪事件,CPU利用率大幅提升

-

灵活性强:Channel的双向读写能力、Buffer的可复用性,比BIO的流模式更灵活,适配复杂的网络通信场景

3.3 AIO:异步IO模型

AIO全称Asynchronous IO,是JDK 1.7引入的NIO.2规范提供的全异步IO实现,基于Proactor模型构建,是真正的异步非阻塞IO模型。IO操作的两个阶段都由内核完成,用户线程发起IO调用后立即返回,内核完成数据准备和拷贝后,通过回调函数通知用户线程处理业务逻辑。

与NIO的核心区别

很多开发者会混淆NIO与AIO,二者的核心差异在于数据拷贝阶段的处理主体:

-

NIO是同步非阻塞IO:IO多路复用仅解决了数据准备阶段的阻塞,数据拷贝阶段仍需要用户线程主动调用read()方法,阻塞等待拷贝完成,属于同步IO

-

AIO是异步非阻塞IO:数据准备和数据拷贝两个阶段都由内核自动完成,用户线程全程不阻塞,也不需要主动读取数据,内核完成后直接通过回调通知,属于真正的异步IO

三大核心组件

-

AsynchronousChannel:异步通道,核心实现包括AsynchronousServerSocketChannel(服务端异步连接通道)、AsynchronousSocketChannel(客户端异步通信通道)

-

Future:异步调用的返回结果,可通过get()方法阻塞获取结果,或轮询判断异步操作是否完成

-

CompletionHandler:回调接口,定义了completed()(操作成功回调)和failed()(操作失败回调)方法,内核完成IO操作后自动触发,无需用户线程轮询

代码示例

AIO服务端实现

package com.jam.demo.aio;

import lombok.extern.slf4j.Slf4j;

import org.springframework.util.StringUtils;

import java.io.IOException;

import java.net.InetSocketAddress;

import java.nio.ByteBuffer;

import java.nio.channels.AsynchronousServerSocketChannel;

import java.nio.channels.AsynchronousSocketChannel;

import java.nio.channels.CompletionHandler;

import java.nio.charset.StandardCharsets;

import java.util.concurrent.ExecutorService;

import java.util.concurrent.LinkedBlockingQueue;

import java.util.concurrent.ThreadPoolExecutor;

import java.util.concurrent.TimeUnit;

/**

* AIO异步IO服务端实现

* @author ken

* @date 2026-03-09

*/

@Slf4j

public class AioServer {

private static final int PORT = 8082;

private static final int BUFFER_SIZE = 1024;

private static final ExecutorService BUSINESS_THREAD_POOL = new ThreadPoolExecutor(

10,

200,

60L,

TimeUnit.SECONDS,

new LinkedBlockingQueue<>(1024),

r -> new Thread(r, "aio-business-thread-" + r.hashCode()),

new ThreadPoolExecutor.CallerRunsPolicy()

);

public static void main(String[] args) throws IOException, InterruptedException {

AsynchronousServerSocketChannel serverSocketChannel = AsynchronousServerSocketChannel.open();

serverSocketChannel.bind(new InetSocketAddress(PORT));

log.info("AIO服务端启动成功,监听端口:{}", PORT);

serverSocketChannel.accept(null, new CompletionHandler<AsynchronousSocketChannel, Object>() {

@Override

public void completed(AsynchronousSocketChannel socketChannel, Object attachment) {

serverSocketChannel.accept(null, this);

try {

log.info("客户端连接成功,地址:{}", socketChannel.getRemoteAddress());

} catch (IOException e) {

log.error("获取客户端地址异常", e);

}

ByteBuffer buffer = ByteBuffer.allocate(BUFFER_SIZE);

socketChannel.read(buffer, buffer, new ReadCompletionHandler(socketChannel));

}

@Override

public void failed(Throwable exc, Object attachment) {

log.error("客户端连接失败", exc);

}

});

Thread.currentThread().join();

}

/**

* 读事件回调处理器

*/

@Slf4j

static class ReadCompletionHandler implements CompletionHandler<Integer, ByteBuffer> {

private final AsynchronousSocketChannel socketChannel;

public ReadCompletionHandler(AsynchronousSocketChannel socketChannel) {

this.socketChannel = socketChannel;

}

@Override

public void completed(Integer result, ByteBuffer buffer) {

if (result == -1) {

try {

log.info("客户端主动断开连接,地址:{}", socketChannel.getRemoteAddress());

socketChannel.close();

} catch (IOException e) {

log.error("socket关闭异常", e);

}

return;

}

buffer.flip();

String request = StandardCharsets.UTF_8.decode(buffer).toString();

buffer.clear();

if (!StringUtils.hasText(request)) {

socketChannel.read(buffer, buffer, this);

return;

}

log.info("收到客户端消息:{}", request);

BUSINESS_THREAD_POOL.execute(() -> {

String response = "服务端已收到消息:" + request;

ByteBuffer responseBuffer = ByteBuffer.wrap(response.getBytes(StandardCharsets.UTF_8));

socketChannel.write(responseBuffer, responseBuffer, new CompletionHandler<Integer, ByteBuffer>() {

@Override

public void completed(Integer result, ByteBuffer attachment) {

if (attachment.hasRemaining()) {

socketChannel.write(attachment, attachment, this);

} else {

socketChannel.read(buffer, buffer, ReadCompletionHandler.this);

}

}

@Override

public void failed(Throwable exc, ByteBuffer attachment) {

log.error("响应客户端消息异常", exc);

try {

socketChannel.close();

} catch (IOException e) {

log.error("socket关闭异常", e);

}

}

});

});

}

@Override

public void failed(Throwable exc, ByteBuffer attachment) {

log.error("读取客户端消息异常", exc);

try {

socketChannel.close();

} catch (IOException e) {

log.error("socket关闭异常", e);

}

}

}

}AIO客户端实现

package com.jam.demo.aio;

import lombok.extern.slf4j.Slf4j;

import org.springframework.util.StringUtils;

import java.io.IOException;

import java.net.InetSocketAddress;

import java.nio.ByteBuffer;

import java.nio.channels.AsynchronousSocketChannel;

import java.nio.channels.CompletionHandler;

import java.nio.charset.StandardCharsets;

import java.util.Scanner;

import java.util.concurrent.CountDownLatch;

/**

* AIO异步IO客户端实现

* @author ken

* @date 2026-03-09

*/

@Slf4j

public class AioClient {

private static final String HOST = "127.0.0.1";

private static final int PORT = 8082;

private static final int BUFFER_SIZE = 1024;

private static final CountDownLatch CONNECT_LATCH = new CountDownLatch(1);

private static AsynchronousSocketChannel socketChannel;

public static void main(String[] args) throws IOException, InterruptedException {

socketChannel = AsynchronousSocketChannel.open();

socketChannel.connect(new InetSocketAddress(HOST, PORT), null, new CompletionHandler<Void, Object>() {

@Override

public void completed(Void result, Object attachment) {

log.info("成功连接到服务端:{}:{}", HOST, PORT);

CONNECT_LATCH.countDown();

ByteBuffer buffer = ByteBuffer.allocate(BUFFER_SIZE);

socketChannel.read(buffer, buffer, new ReadCompletionHandler(buffer));

}

@Override

public void failed(Throwable exc, Object attachment) {

log.error("连接服务端失败", exc);

CONNECT_LATCH.countDown();

}

});

CONNECT_LATCH.await();

if (!socketChannel.isOpen()) {

return;

}

try (Scanner scanner = new Scanner(System.in)) {

while (true) {

System.out.print("请输入要发送的消息:");

String inputLine = scanner.nextLine();

if (!StringUtils.hasText(inputLine)) {

System.out.println("消息不能为空,请重新输入");

continue;

}

ByteBuffer buffer = ByteBuffer.wrap(inputLine.getBytes(StandardCharsets.UTF_8));

socketChannel.write(buffer, buffer, new CompletionHandler<Integer, ByteBuffer>() {

@Override

public void completed(Integer result, ByteBuffer attachment) {

if (attachment.hasRemaining()) {

socketChannel.write(attachment, attachment, this);

}

}

@Override

public void failed(Throwable exc, ByteBuffer attachment) {

log.error("发送消息异常", exc);

}

});

if ("exit".equalsIgnoreCase(inputLine)) {

break;

}

}

} finally {

if (socketChannel.isOpen()) {

socketChannel.close();

}

}

}

/**

* 读事件回调处理器

*/

@Slf4j

static class ReadCompletionHandler implements CompletionHandler<Integer, ByteBuffer> {

private final ByteBuffer buffer;

public ReadCompletionHandler(ByteBuffer buffer) {

this.buffer = buffer;

}

@Override

public void completed(Integer result, ByteBuffer attachment) {

if (result == -1) {

log.info("服务端断开连接");

return;

}

buffer.flip();

String response = StandardCharsets.UTF_8.decode(buffer).toString();

buffer.clear();

log.info("收到服务端响应:{}", response);

socketChannel.read(buffer, buffer, this);

}

@Override

public void failed(Throwable exc, ByteBuffer attachment) {

log.error("读取服务端响应异常", exc);

}

}

}适用场景与局限性

-

适用场景:连接数多、IO操作耗时久的场景,比如大文件传输、分布式存储IO、数据库读写等

-

局限性:Linux系统下,AIO的底层实现基于epoll模拟,并未实现真正的内核级全异步,网络IO场景下性能不如NIO稳定;Windows系统下AIO的IOCP实现较为成熟,但服务器大多采用Linux系统,因此工业界网络IO场景极少使用AIO,Netty也未对AIO做深度封装,主流方案仍是基于NIO的Reactor模型。

四、Reactor模型架构演进全解析

Reactor模型是一种基于事件驱动的架构设计模式,核心定义来自Doug Lea的经典论文《Scalable IO in Java》,是当前高性能网络通信架构的工业级标准。其核心思想是:将IO事件的监听、分发与业务处理解耦,通过IO多路复用器监听事件,当事件就绪时,将事件分发到对应的Handler处理器执行,实现高并发、高可用的IO处理架构。

Reactor模型包含三个核心角色:

-

Reactor:反应器,负责监听和分发IO事件,绑定多路复用器Selector,是事件分发的核心

-

Acceptor:接受器,负责处理客户端的连接请求,创建对应的Handler处理器

-

Handler:处理器,负责处理具体的IO读写事件和业务逻辑,是业务处理的核心单元

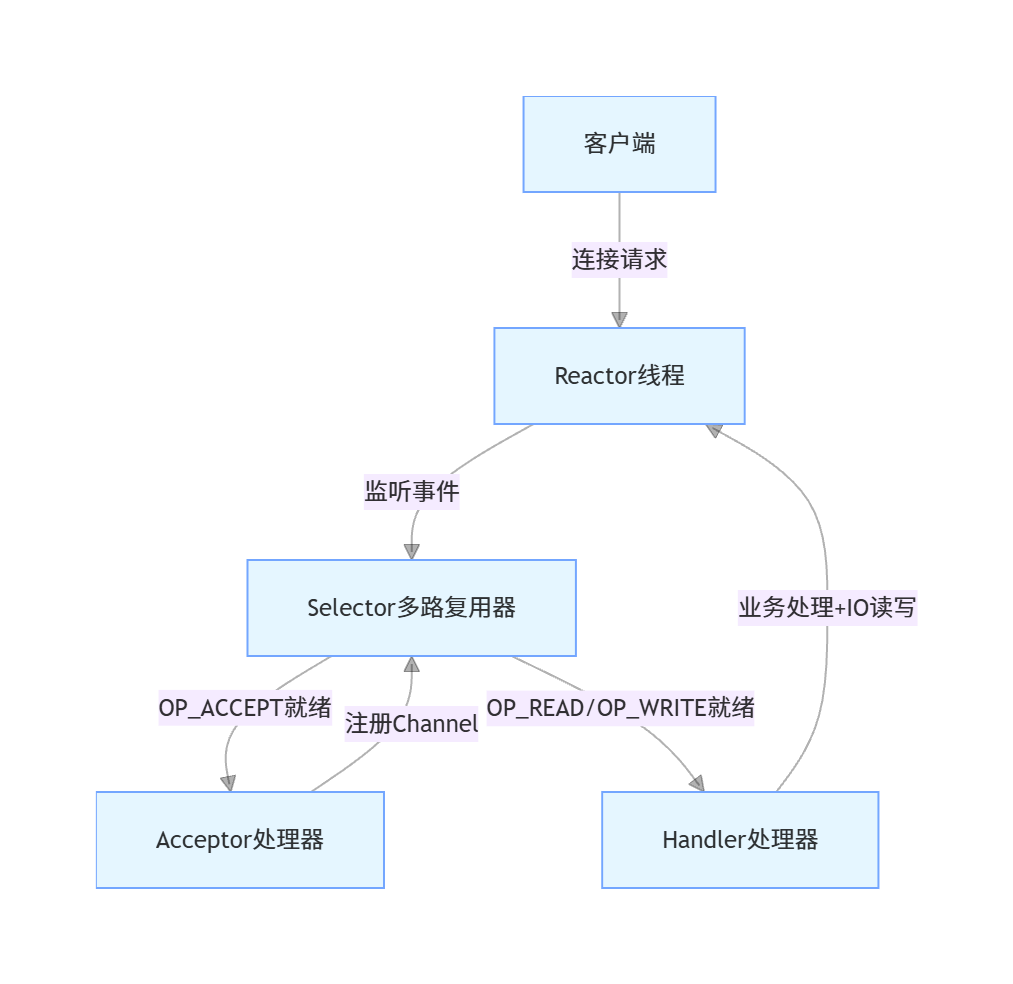

4.1 第一阶段:单Reactor单线程模型

单Reactor单线程模型是Reactor模型的最基础实现,所有的IO操作(accept、read、write)和业务逻辑都在同一个Reactor线程中执行,Reactor线程通过Selector监听所有事件,事件就绪后直接在当前线程中处理。

执行流程图

执行流程

-

Reactor线程启动,初始化Selector和ServerSocketChannel,注册OP_ACCEPT事件

-

客户端发起连接请求,Selector监听到OP_ACCEPT事件就绪,分发给Acceptor处理器

-

Acceptor接受连接,创建SocketChannel,注册到Selector上,监听OP_READ事件

-

客户端发送数据,Selector监听到OP_READ事件就绪,分发给对应的Handler处理器

-

Handler在Reactor线程中完成数据读取、业务处理、数据写入的全流程

优缺点与适用场景

-

优点:模型简单,无线程切换和锁竞争,编程实现简单,适合低并发场景

-

缺点:

-

单线程无法利用多核CPU的性能,业务处理耗时会阻塞整个Reactor线程,导致所有连接的IO处理延迟升高

-

业务逻辑一旦出现阻塞,会导致整个服务无法处理新的连接和请求,可用性极低

-

-

适用场景:连接数少、业务处理耗时极短的场景,比如嵌入式设备的轻量级服务

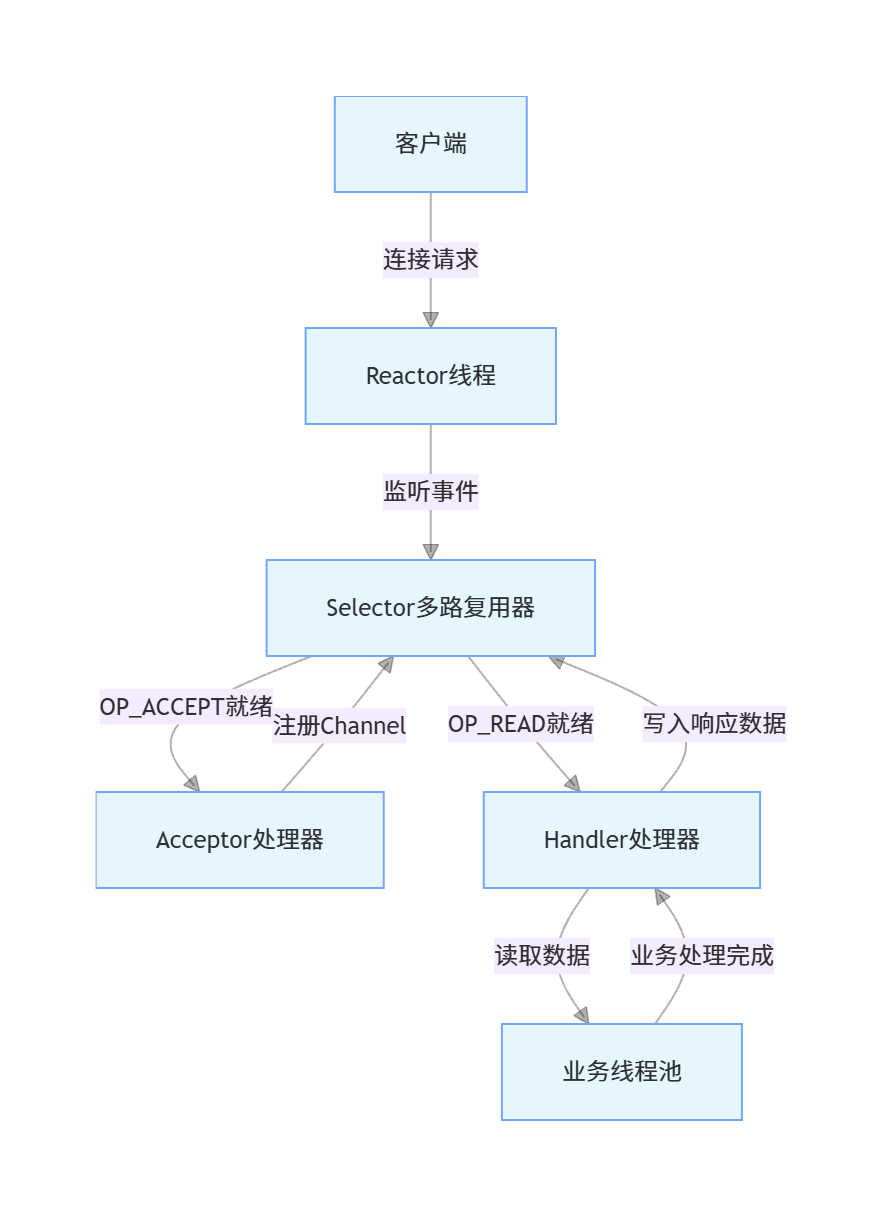

4.2 第二阶段:单Reactor多线程模型

单Reactor多线程模型是对单线程模型的优化,核心演进点是将业务处理逻辑从Reactor线程中剥离,放到独立的业务线程池中执行,Reactor线程只负责IO事件的监听、分发和IO读写操作,不处理耗时的业务逻辑,彻底解决了业务处理阻塞Reactor线程的问题。

执行流程图

执行流程

-

Reactor线程启动,初始化Selector和ServerSocketChannel,注册OP_ACCEPT事件

-

客户端发起连接,Acceptor接受连接,创建SocketChannel,注册到Selector监听OP_READ事件

-

OP_READ事件就绪,Handler读取数据,将数据和业务逻辑封装成任务,提交到业务线程池

-

业务线程池中的线程执行业务逻辑,处理完成后,将结果交给Handler

-

Handler在Reactor线程中完成响应数据的写入操作

优缺点与适用场景

-

优点:

-

Reactor线程只负责IO事件处理,不会被耗时的业务逻辑阻塞,大幅提升了IO处理的吞吐量

-

业务逻辑放到多线程中执行,可以充分利用多核CPU的性能,提升业务处理能力

-

线程职责分离,架构更清晰,可维护性更强

-

-

缺点:

-

所有的IO事件(accept、read、write)都由单个Reactor线程处理,高并发下,海量连接的读写事件会给Reactor线程带来巨大压力,单线程成为系统的性能瓶颈

-

高并发场景下,单个Selector的事件处理能力有限,容易出现事件堆积

-

-

适用场景:中等并发、业务处理耗时较长的场景,比如普通的后端接口服务

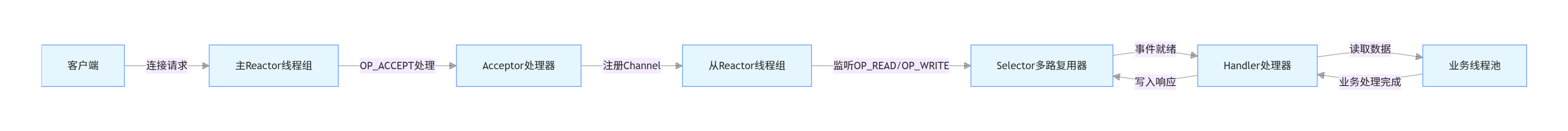

4.3 第三阶段:主从Reactor多线程模型

主从Reactor多线程模型是Reactor模型的最终演进形态,也是工业界的标准实现,Netty、Nginx、Redis等高性能组件均基于该模型构建。核心演进点是将Reactor拆分为主Reactor(MainReactor)和从Reactor(SubReactor),主Reactor只负责处理客户端的连接请求(OP_ACCEPT),从Reactor负责处理已建立连接的读写事件(OP_READ/OP_WRITE),每个从Reactor对应一个独立的线程,实现了IO事件的多线程并行处理,彻底解决了单Reactor的性能瓶颈。

架构图

执行流程

-

主Reactor线程组启动,初始化ServerSocketChannel,注册OP_ACCEPT事件,主Reactor线程只负责监听和处理客户端的连接请求

-

客户端发起连接请求,主Reactor监听到OP_ACCEPT事件就绪,分发给Acceptor处理器

-

Acceptor接受连接,创建SocketChannel,将SocketChannel注册到从Reactor线程组中的某个从Reactor上

-

从Reactor线程负责监听该SocketChannel的OP_READ/OP_WRITE事件,事件就绪后,分发给对应的Handler处理器

-

Handler读取数据,将业务逻辑封装成任务提交到业务线程池执行

-

业务处理完成后,Handler在从Reactor线程中完成响应数据的写入操作

核心优势

-

职责彻底分离:主Reactor只负责连接接入,从Reactor负责连接的IO读写,互不干扰,连接接入不会影响已建立连接的IO处理

-

充分利用多核性能:主从Reactor都是多线程架构,每个Reactor对应一个独立的线程,海量连接的IO事件可以分散到多个从Reactor线程并行处理,彻底解决了单Reactor的性能瓶颈

-

高可用性:单个从Reactor线程的阻塞或异常,只会影响其管理的连接,不会影响整个服务的运行

-

可扩展性强:可以根据服务器的CPU核心数灵活调整从Reactor的线程数,实现性能的线性扩展

- 适用场景:高并发、高吞吐量的场景,比如网关、消息中间件、分布式服务框架等工业级系统

五、Reactor模型工业级落地:Netty核心实现与实战

Netty是基于Java NIO实现的高性能、异步事件驱动的网络通信框架,其核心就是主从Reactor多线程模型,是Java领域网络通信的工业级标准,Dubbo、Spring Cloud Gateway、RocketMQ等主流组件均基于Netty实现。

5.1 Netty的Reactor模型核心架构

Netty对主从Reactor模型做了工业级的封装与优化,核心架构如下:

-

BossGroup:对应主Reactor线程组,负责处理客户端的连接请求,默认线程数为1

-

WorkerGroup:对应从Reactor线程组,负责处理已建立连接的IO读写事件,默认线程数为CPU核心数的2倍

-

NioEventLoop:对应Reactor线程,每个NioEventLoop包含一个独立的Selector和一个任务队列,单线程串行处理所有注册到该NioEventLoop上的Channel的IO事件和任务,避免了线程切换和锁竞争,是Netty高性能的核心之一

-

ChannelHandler:对应Handler处理器,负责处理IO事件和业务逻辑,分为InboundHandler(入站事件处理)和OutboundHandler(出站事件处理),通过Pipeline链式处理,实现了逻辑的解耦和复用

5.2 Netty实战代码

Netty服务端实现

package com.jam.demo.netty;

import io.netty.bootstrap.ServerBootstrap;

import io.netty.channel.ChannelFuture;

import io.netty.channel.ChannelOption;

import io.netty.channel.EventLoopGroup;

import io.netty.channel.nio.NioEventLoopGroup;

import io.netty.channel.socket.nio.NioServerSocketChannel;

import lombok.extern.slf4j.Slf4j;

/**

* Netty服务端实现(主从Reactor模型)

* @author ken

* @date 2026-03-09

*/

@Slf4j

public class NettyServer {

private static final int PORT = 8083;

public static void main(String[] args) {

EventLoopGroup bossGroup = new NioEventLoopGroup(1);

EventLoopGroup workerGroup = new NioEventLoopGroup();

try {

ServerBootstrap bootstrap = new ServerBootstrap();

bootstrap.group(bossGroup, workerGroup)

.channel(NioServerSocketChannel.class)

.option(ChannelOption.SO_BACKLOG, 1024)

.childOption(ChannelOption.SO_KEEPALIVE, true)

.childOption(ChannelOption.TCP_NODELAY, true)

.childHandler(new NettyServerInitializer());

ChannelFuture future = bootstrap.bind(PORT).sync();

log.info("Netty服务端启动成功,监听端口:{}", PORT);

future.channel().closeFuture().sync();

} catch (InterruptedException e) {

log.error("Netty服务端运行异常", e);

Thread.currentThread().interrupt();

} finally {

bossGroup.shutdownGracefully();

workerGroup.shutdownGracefully();

}

}

}Netty服务端初始化器

package com.jam.demo.netty;

import io.netty.channel.ChannelInitializer;

import io.netty.channel.socket.SocketChannel;

import io.netty.handler.codec.string.StringDecoder;

import io.netty.handler.codec.string.StringEncoder;

import io.netty.handler.logging.LogLevel;

import io.netty.handler.logging.LoggingHandler;

import io.netty.util.CharsetUtil;

/**

* Netty服务端通道初始化器

* @author ken

* @date 2026-03-09

*/

public class NettyServerInitializer extends ChannelInitializer<SocketChannel> {

@Override

protected void initChannel(SocketChannel ch) {

ch.pipeline()

.addLast(new LoggingHandler(LogLevel.INFO))

.addLast(new StringDecoder(CharsetUtil.UTF_8))

.addLast(new StringEncoder(CharsetUtil.UTF_8))

.addLast(new NettyServerHandler());

}

}Netty服务端业务处理器

package com.jam.demo.netty;

import io.netty.channel.ChannelHandlerContext;

import io.netty.channel.SimpleChannelInboundHandler;

import lombok.extern.slf4j.Slf4j;

import org.springframework.util.StringUtils;

import java.util.concurrent.ExecutorService;

import java.util.concurrent.LinkedBlockingQueue;

import java.util.concurrent.ThreadPoolExecutor;

import java.util.concurrent.TimeUnit;

/**

* Netty服务端业务处理器

* @author ken

* @date 2026-03-09

*/

@Slf4j

public class NettyServerHandler extends SimpleChannelInboundHandler<String> {

private static final ExecutorService BUSINESS_THREAD_POOL = new ThreadPoolExecutor(

10,

200,

60L,

TimeUnit.SECONDS,

new LinkedBlockingQueue<>(1024),

r -> new Thread(r, "netty-business-thread-" + r.hashCode()),

new ThreadPoolExecutor.CallerRunsPolicy()

);

@Override

public void channelActive(ChannelHandlerContext ctx) {

log.info("客户端连接成功,地址:{}", ctx.channel().remoteAddress());

}

@Override

protected void channelRead0(ChannelHandlerContext ctx, String msg) {

if (!StringUtils.hasText(msg)) {

return;

}

log.info("收到客户端消息:{}", msg);

BUSINESS_THREAD_POOL.execute(() -> {

String response = "服务端已收到消息:" + msg;

ctx.writeAndFlush(response);

if ("exit".equalsIgnoreCase(msg)) {

ctx.close();

}

});

}

@Override

public void channelInactive(ChannelHandlerContext ctx) {

log.info("客户端断开连接,地址:{}", ctx.channel().remoteAddress());

}

@Override

public void exceptionCaught(ChannelHandlerContext ctx, Throwable cause) {

log.error("通道处理异常", cause);

ctx.close();

}

}Netty客户端实现

package com.jam.demo.netty;

import io.netty.bootstrap.Bootstrap;

import io.netty.channel.ChannelFuture;

import io.netty.channel.ChannelOption;

import io.netty.channel.EventLoopGroup;

import io.netty.channel.nio.NioEventLoopGroup;

import io.netty.channel.socket.nio.NioSocketChannel;

import lombok.extern.slf4j.Slf4j;

import org.springframework.util.StringUtils;

import java.util.Scanner;

/**

* Netty客户端实现

* @author ken

* @date 2026-03-09

*/

@Slf4j

public class NettyClient {

private static final String HOST = "127.0.0.1";

private static final int PORT = 8083;

public static void main(String[] args) {

EventLoopGroup workerGroup = new NioEventLoopGroup();

try {

Bootstrap bootstrap = new Bootstrap();

bootstrap.group(workerGroup)

.channel(NioSocketChannel.class)

.option(ChannelOption.SO_KEEPALIVE, true)

.option(ChannelOption.TCP_NODELAY, true)

.handler(new NettyClientInitializer());

ChannelFuture future = bootstrap.connect(HOST, PORT).sync();

log.info("Netty客户端启动成功,已连接到服务端:{}:{}", HOST, PORT);

try (Scanner scanner = new Scanner(System.in)) {

while (true) {

System.out.print("请输入要发送的消息:");

String inputLine = scanner.nextLine();

if (!StringUtils.hasText(inputLine)) {

System.out.println("消息不能为空,请重新输入");

continue;

}

future.channel().writeAndFlush(inputLine);

if ("exit".equalsIgnoreCase(inputLine)) {

future.channel().closeFuture().sync();

break;

}

}

}

} catch (InterruptedException e) {

log.error("Netty客户端运行异常", e);

Thread.currentThread().interrupt();

} finally {

workerGroup.shutdownGracefully();

}

}

}Netty客户端初始化器

package com.jam.demo.netty;

import io.netty.channel.ChannelInitializer;

import io.netty.channel.socket.SocketChannel;

import io.netty.handler.codec.string.StringDecoder;

import io.netty.handler.codec.string.StringEncoder;

import io.netty.util.CharsetUtil;

/**

* Netty客户端通道初始化器

* @author ken

* @date 2026-03-09

*/

public class NettyClientInitializer extends ChannelInitializer<SocketChannel> {

@Override

protected void initChannel(SocketChannel ch) {

ch.pipeline()

.addLast(new StringDecoder(CharsetUtil.UTF_8))

.addLast(new StringEncoder(CharsetUtil.UTF_8))

.addLast(new NettyClientHandler());

}

}Netty客户端业务处理器

package com.jam.demo.netty;

import io.netty.channel.ChannelHandlerContext;

import io.netty.channel.SimpleChannelInboundHandler;

import lombok.extern.slf4j.Slf4j;

/**

* Netty客户端业务处理器

* @author ken

* @date 2026-03-09

*/

@Slf4j

public class NettyClientHandler extends SimpleChannelInboundHandler<String> {

@Override

protected void channelRead0(ChannelHandlerContext ctx, String msg) {

log.info("收到服务端响应:{}", msg);

}

@Override

public void exceptionCaught(ChannelHandlerContext ctx, Throwable cause) {

log.error("客户端通道处理异常", cause);

ctx.close();

}

}5.3 Netty的核心高性能优化

-

串行化处理:每个Channel的所有IO事件都由对应的NioEventLoop单线程串行处理,避免了线程安全问题,消除了锁竞争

-

零拷贝技术:通过CompositeByteBuf实现缓冲区的组合复用,通过FileRegion实现文件传输的零拷贝,减少了数据在内核态和用户态之间的拷贝次数

-

内存池管理:基于PooledByteBufAllocator实现ByteBuf的内存池化,减少了频繁创建和销毁缓冲区的内存开销和GC压力

-

NIO空轮询bug修复:JDK的Selector在Linux下存在epoll空轮询bug,会导致CPU使用率100%,Netty通过计数重建Selector的方式彻底解决了该问题

-

灵活的线程模型:支持自定义BossGroup和WorkerGroup的线程数,支持IO线程和业务线程分离,灵活适配不同的业务场景

六、易混淆知识点深度辨析

6.1 同步IO vs 异步IO

核心判断标准:内核完成数据拷贝的阶段,用户线程是否需要主动参与

-

同步IO:用户线程需要主动调用read/write方法,将数据从内核缓冲区拷贝到用户缓冲区,拷贝阶段用户线程阻塞,BIO/NIO都属于同步IO

-

异步IO:内核自动完成数据从内核缓冲区到用户缓冲区的拷贝,拷贝完成后通过回调通知用户线程,整个过程用户线程完全不参与,AIO属于异步IO

6.2 阻塞IO vs 非阻塞IO

核心判断标准:数据准备阶段,用户线程发起IO调用后是否会被立即挂起

-

阻塞IO:发起IO调用后,线程一直阻塞,直到数据准备完成并拷贝完成才返回,BIO属于阻塞IO

-

非阻塞IO:发起IO调用后,线程立即返回,无需等待数据准备完成,通过轮询或事件通知的方式获取数据就绪状态,NIO属于非阻塞IO

6.3 Reactor模型 vs Proactor模型

-

Reactor模型:基于同步IO实现,核心是「事件就绪后,用户线程主动处理IO读写操作」,属于被动分发事件、主动处理IO,Java NIO、Netty、Nginx都基于Reactor模型

-

Proactor模型:基于异步IO实现,核心是「内核完成IO读写操作后,通过回调通知用户线程处理业务逻辑」,属于主动完成IO、被动处理业务,Windows IOCP、Java AIO基于Proactor模型

6.4 NIO vs AIO 适用场景选择

| 特性 | NIO | AIO |

|---|---|---|

| 底层模型 | 同步非阻塞IO,Reactor模型 | 异步非阻塞IO,Proactor模型 |

| 线程参与度 | 数据拷贝阶段需要用户线程主动参与 | 全程不需要用户线程参与,内核完成后回调 |

| Linux实现成熟度 | 非常成熟,基于epoll,工业级大规模验证 | 底层基于epoll模拟,实现不完善,性能不稳定 |

| 适用场景 | 高并发短连接场景,比如HTTP服务、RPC调用 | 长连接大文件传输、耗时IO操作场景,比如分布式存储 |

| 编程复杂度 | 中等,需要处理Selector事件、Buffer读写 | 较高,需要处理回调逻辑、异步生命周期管理 |

七、高并发IO架构最佳实践与踩坑指南

7.1 线程模型最佳实践

-

IO线程与业务线程必须分离:Reactor线程(IO线程)只负责IO事件的监听和读写,耗时的业务逻辑必须提交到独立的业务线程池执行,绝对不能在IO线程中执行耗时的业务操作,否则会阻塞整个Reactor线程,导致大量连接超时

-

线程数设置规范:Reactor线程数建议设置为CPU核心数的1~2倍,业务线程池的线程数需要根据业务类型调整:CPU密集型建议设置为CPU核心数+1,IO密集型建议设置为CPU核心数*2~4倍

-

避免线程池嵌套:不要在业务线程池中再创建子线程池,会导致线程数不可控,大幅增加上下文切换开销

7.2 NIO/Netty开发核心踩坑点

-

Buffer的flip()方法误用:写入Buffer后,必须调用flip()切换为读模式才能正确读取数据,读模式转写模式必须调用clear()或compact(),否则会出现数据读取异常

-

粘包拆包问题:TCP是面向流的协议,没有消息边界,NIO/Netty开发中必须处理粘包拆包,常用方案包括固定长度、换行符分隔、自定义协议头(长度+内容),Netty提供了LineBasedFrameDecoder、LengthFieldBasedFrameDecoder等开箱即用的解码器

-

堆外内存泄漏:NIO的DirectBuffer是堆外内存,不受JVM GC管理,必须手动释放,否则会导致系统内存溢出;Netty的ByteBuf必须调用release()方法释放,建议使用try-with-resources语法自动释放

-

NIO空轮询bug:JDK NIO的Selector在Linux下存在epoll空轮询bug,会导致CPU使用率100%,生产环境建议直接使用Netty,不要自行原生实现NIO

7.3 TCP参数优化最佳实践

-

SO_REUSEADDR:开启端口复用,避免服务重启后出现端口占用的问题

-

SO_KEEPALIVE:开启TCP保活机制,检测死连接,避免无效连接占用系统资源

-

TCP_NODELAY:禁用Nagle算法,减少小数据包的传输延迟,提升响应速度,适合实时性要求高的场景

-

SO_RCVBUF/SO_SNDBUF:调整TCP接收和发送缓冲区的大小,高并发场景建议调大,默认值一般为32K,可根据业务场景调整为128K或256K

八、总结

Java IO模型的演进,本质是计算机架构发展中「CPU算力」与「IO延迟」不匹配的矛盾推动的。从BIO的「连接per线程」,到NIO的IO多路复用,再到AIO的全异步,每一次演进都在不断减少IO阻塞对线程的占用,最大化提升CPU资源的利用率。Reactor模型作为同步IO场景下的最优架构,经过了数十年的工业级验证,从单线程到主从多线程的演进,完美解决了高并发场景下IO处理的性能瓶颈,是高性能网络通信架构的核心基石。对于绝大多数Java开发者而言,不需要重复造轮子原生实现NIO,Netty作为Reactor模型的成熟实现,已经解决了几乎所有的底层坑点,是高并发网络通信开发的首选。但只有彻底吃透IO模型的底层原理和Reactor模型的演进逻辑,才能在实际开发中用好Netty,写出高可用、高吞吐量的网络通信服务,从容应对高并发场景下的各种挑战。