如何为Agent设计好用的工具:从原型到落地的全流程指南

在大模型Agent应用落地的过程中,工具是连接Agent与真实世界的核心桥梁------Agent的能力边界,永远由其可调用的工具决定。但面向Agent的工具设计,与传统的API/函数开发有着本质区别,用开发后端接口的思路设计Agent工具,往往会出现Agent"不会用、用错、用得低效"的问题。

本文基于Anthropic官方的工程实践,从设计差异、全流程方法、八大核心原则、安全隐私四个维度,拆解面向Agent的工具设计方法论,帮你打造让Agent用得对、用得好、用得高效的工具集。

本文核心收获:

- 理解Agent工具与传统API的核心差异

- 掌握「原型搭建-评测体系-协作优化-结果迭代」的工具设计全流程

- 落地8个Agent工具设计的核心原则,从根源提升工具调用效率

- 做好Agent工具的安全与隐私防护,规避落地风险

一、面向Agent的工具设计,到底有什么不同?

传统软件开发中,工具是确定性系统之间的契约 :一个函数getWeather("NYC"),无论调用多少次,都会以完全相同的方式获取纽约的天气数据,调用方的行为是可预测的。

而面向Agent的工具,是确定性系统与非确定性Agent之间的契约:当用户问"今天需要带伞吗?",Agent的行为是不可预测的------它可能调用天气工具、可能用通用知识回答、可能先询问用户位置,甚至会出现"幻觉"(比如编造天气数据)、完全无法理解工具的使用方式。

核心设计转变

我们不能再用"给开发者写API"的思路设计Agent工具,而是要站在Agent的视角重新思考:

- 开发者能理解的参数缩写、隐含逻辑,Agent可能无法识别;

- 开发者能接受的全量数据返回,会耗尽Agent的有限上下文;

- 开发者能自主组合的多个接口,Agent可能无法完成链式调用。

而实战经验表明:对Agent来说"好用"的工具,对人类来说也同样直观、易懂------让新手开发者能快速上手的工具,大概率也能让Agent正确调用。

二、工具设计的全流程方法:从原型到落地

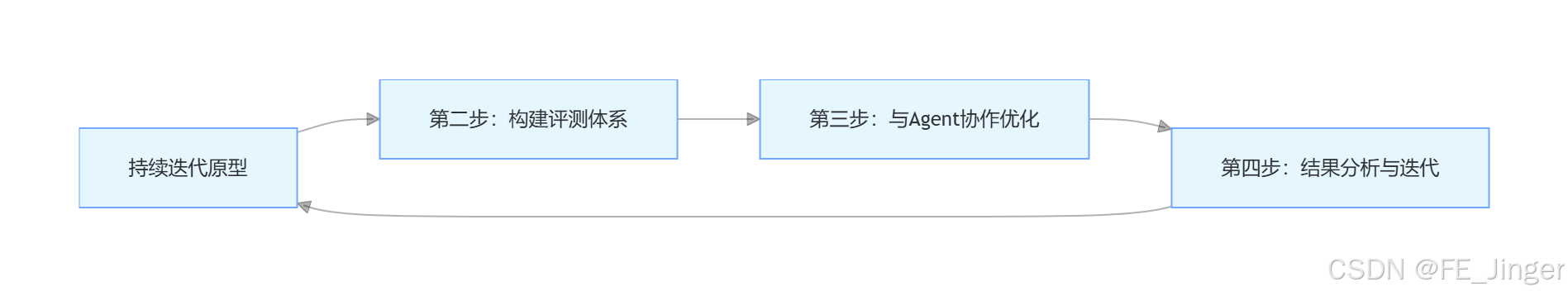

Anthropic沉淀了一套可落地的Agent工具设计全流程,同时能借助Claude本身完成工具的迭代优化,形成**"设计-测试-优化-迭代"**的闭环。整个流程分为四步,环环相扣,缺一不可。

2.1 第一步:搭建快速原型,先跑通再优化

不实际投入使用,永远无法预判Agent对工具的适配度。快速搭建原型的核心是**"轻量、可测、能快速调整"**,而非追求功能完美,具体步骤如下:

- 提供完整的LLM友好文档:如果用Claude编写工具,需为其提供依赖的软件库、API、SDK的纯文本文档,避免复杂的格式和专业缩写;

- 封装为可测试的形式:将工具封装到本地MCP服务或桌面扩展中,快速接入Claude Code/Claude桌面应用,实现一键测试;

- 人工先测,收集反馈:先亲自测试工具的核心功能,找出明显的"粗糙边缘"(如参数歧义、返回结果混乱),再收集真实用户的使用反馈,建立对工具核心使用场景的认知。

2.2 第二步:构建评测体系,量化工具效果

衡量Agent工具的好坏,不能靠"主观感受",必须搭建贴合真实场景的量化评测体系,核心是生成能考验工具真实能力的评测任务,具体做好三件事:

1. 设计高价值的评测任务

基于真实业务场景设计任务,避免过于简单的"沙箱场景"。好的任务需要Agent完成多次工具调用(甚至数十次),贴合真实的业务流程:

- ✅ 优质任务:安排下周和Jane的项目会议,附上上次规划会议的笔记,同时预订可容纳8人的会议室

- ❌ 劣质任务:给jane@acme.corp安排一个会议

2. 制定灵活的结果校验规则

每个评测任务都需要配套可验证的结果/输出标准 ,校验器可以是简单的字符串匹配,也可以用LLM作为"裁判"打分。核心原则:避免过于严格的校验,拒绝因格式、标点、语序等非核心差异,判定正确结果为"错误"。

3. 收集多维度的评测指标

除了核心的任务准确率,还需要收集多维度指标,精准定位工具的问题:

- 工具调用指标:总调用次数、冗余调用次数、错误率;

- 资源消耗指标:token总消耗、单任务耗时;

- 执行质量指标:是否完成所有任务要求、是否出现幻觉。

2.3 第三步:与Agent协作,让Claude帮你优化工具

Agent不仅是工具的使用者,还能成为工具的优化者 。你完全可以借助Claude Code,让Agent自主分析工具问题并完成重构,具体操作:

将评测过程中Agent的执行日志、推理过程、错误信息全部粘贴到Claude Code中,Claude能精准识别以下问题并完成批量优化:

- 工具描述的歧义点、参数定义的模糊性;

- 工具实现与描述的不一致性;

- 高频出现的调用错误对应的工具设计问题。

Anthropic的实战表明:本文中绝大多数Agent工具设计的最佳实践,都来自用Claude Code反复优化内部工具的过程;甚至在SWE-bench基准测试中,优化工具描述的时间,比优化整体提示词的时间还要多。

2.4 第四步:结果分析与迭代,找准问题根源

评测和优化后,需要对结果进行深度分析,找到Agent使用工具的"卡点",并针对性迭代工具设计。重点关注三个维度:

- 阅读推理与执行日志:找出Agent对工具的理解偏差,比如是否误解了参数含义、是否无法识别工具的使用场景;

- 分析工具调用指标:大量冗余调用→优化分页、token限制参数;大量参数错误→补充工具示例、优化参数描述;

- 关注Agent"没说出口的内容":它没有调用的工具、没有提及的逻辑,往往比它输出的内容更重要------这可能意味着工具的边界不清晰、命名有歧义,导致Agent根本没意识到可以使用。

三、工具设计的八大核心原则:让Agent用得高效、不踩坑

经过大量的工程实践,Anthropic总结出8个Agent工具设计的核心原则,覆盖工具选择、命名、返回结果、描述、防错等全维度,是打造"好用的Agent工具"的关键。

原则一:选对要实现的工具,宁缺毋滥

更多工具 ≠ 更好的效果,这是Agent工具设计中最容易踩的坑。很多开发者会不加选择地将现有软件功能、API端点直接封装为Agent工具,完全不考虑是否适合Agent使用。

Agent的上下文是有限的宝贵资源,一个模糊、无用的工具,会挤占优质工具的上下文空间。核心设计方法:

- 优先实现面向任务的高阶工具 ,而非面向操作的低阶工具:比如实现

schedule_event(查找可用时间+安排会议+预订资源),而非拆分出list_users、list_events、create_event三个独立工具; - 工具必须能减少中间输出的上下文消耗 :比如实现

search_logs(仅返回相关日志行+上下文),而非read_logs(返回全量日志); - 合并高频链式调用 的操作:比如实现

get_customer_context,一次性返回客户的基本信息、交易记录、服务备注,而非让Agent多次调用不同工具查询。

原则二:通过命名空间,明确工具边界

当Agent接入数十个MCP服务、数百个工具时,功能重叠、名称模糊的工具,会让Agent频繁选错(比如把Asana的搜索工具当成Jira的搜索工具)。

命名空间(将相关工具归类到统一前缀下)是解决这个问题的核心方法,通过前缀为工具划分清晰的边界,示例:

- 按服务分类 :

asana_search、jira_search、slack_send; - 按资源细分 :

asana_projects_search、asana_users_search、jira_issues_search。

实战表明,命名空间的命名方案(前缀/后缀)会对工具调用准确率产生显著影响,建议通过评测选择最适合自己业务的方式。

原则三:返回高信号内容,而非全量数据

Agent的核心需求是**"用最少的上下文,获取最核心的信息",因此工具的返回结果,必须只提供高信号、高相关度**的内容,优先保证相关性,而非灵活性。

核心设计方法:

- 优先返回自然语言名称、业务语义字段,而非底层技术ID(如UUID、雪花ID):将无意义的UUID转换为有语义的标识,能显著减少Agent的幻觉,提升检索任务准确率;

- 提供响应格式控制 :通过

response_format参数,支持concise(精简)和detailed(详细)两种模式,默认返回精简结果;仅当Agent需要后续工具调用的ID等信息时,再返回详细结果; - 剔除低价值技术字段:比如

mime_type、256px_image_url、file_size等,除非Agent明确需要,否则一律不返回。

原则四:优化返回结果的token效率

上下文是Agent的"生命线",token耗尽意味着Agent无法继续思考,因此必须对工具返回结果做token效率优化。

核心设计方法:

- 实现分页、过滤、截断能力:对可能返回大量内容的工具(如日志查询、文档检索),必须支持分页、关键词过滤,并设置合理的默认返回长度(Anthropic在Claude Code中默认限制2.5万token);

- 截断结果需给出明确提示:如果结果被截断,要告诉Agent"结果已截断,可通过分页/精准过滤获取更多内容",引导其使用更高效的调用方式;

- 错误响应要清晰、可行动 :拒绝返回不透明的错误码(如

error: 400)或堆栈信息,而是明确说明"哪里错了、怎么修正",比如"参数user_id格式错误,需传入数字型ID,示例:12345"。

原则五:像写提示词一样,打磨工具描述与参数定义

工具描述与参数定义,会被直接加载到Agent的上下文中,其质量直接决定Agent能否正确使用工具,需要像优化大模型提示词一样,反复打磨。

核心设计方法:

- 像给新员工讲解一样写描述:把你默认掌握的专业术语、特殊查询格式、底层资源关联关系,全部明确写出来,不留下任何"隐含逻辑";

- 参数命名必须无歧义 :用

user_id而非模糊的user,用start_time而非time,让Agent一眼就能理解参数含义; - 明确输入输出格式:比如"输入为YYYY-MM-DD格式的日期""输出为JSON格式,包含name、id、email三个字段",避免格式歧义;

- 重视微小的描述优化:即使是调整一句话、一个参数名称,也可能带来工具调用效率的巨大提升。Claude Sonnet 3.5能在SWE-bench Verified上达到SOTA效果,核心原因之一就是对工具描述做了精准优化,大幅降低了调用错误率。

原则六:防错设计(Poka-yoke),让Agent难以犯错

Poka-yoke(防错法)是工业设计中的经典理念,核心是**"通过设计,让错误难以发生"**,这一理念同样适用于Agent工具设计------与其让Agent避免犯错,不如让Agent"根本没机会犯错"。

实战案例 :

Anthropic在开发SWE-bench的Agent工具时,发现Agent离开根目录后,使用相对路径会频繁出错。最终的解决方案不是在提示词中反复强调"使用绝对路径",而是直接修改工具,强制要求必须传入绝对文件路径,之后模型再也没有出现过这类错误。

原则七:给工具补充真实的使用示例

纯文字的工具描述,很难让Agent理解复杂的调用逻辑------一个真实的示例,远胜于千言万语。尤其是对于有嵌套参数、业务约定的复杂工具,示例能让Agent快速掌握使用规范,大幅提升调用准确率。

示例设计要求:

- 示例要贴合真实业务场景,避免虚构的无意义场景;

- 包含完整的调用参数、返回结果,清晰展示参数的取值范围、格式要求;

- 对复杂参数做注释说明,让Agent理解参数的设计逻辑。

原则八:站在模型的视角,测试工具的使用

工具设计完成后,做一个简单的"自测":基于当前的描述和参数定义,你能一眼看明白这个工具怎么用吗?

如果作为人类的你,都需要反复阅读才能理解,那模型大概率也无法正确调用。

同时,必须在工作台上运行大量的示例输入 ,模拟Agent的各种使用场景,观察模型会犯哪些错误,并基于这些错误持续迭代工具设计------测试的场景越全面,工具的鲁棒性越强。

四、工具设计的安全与隐私考量:落地的必修课

当Agent工具能访问企业敏感数据(如客户信息、业务日志)、执行修改/删除等破坏性操作时,安全与隐私防护是必须考虑的问题,否则会带来严重的业务风险。核心做好四件事:

1. 最小权限原则

工具仅开放完成任务所需的最小权限,禁止过度授权。比如一个仅用于查询客户信息的工具,不能拥有修改、删除客户信息的权限;一个仅用于读取日志的工具,不能拥有写入日志的权限。

2. 操作可审计

所有的工具调用,都必须留下完整的执行日志,包括调用时间、调用方、传入参数、返回结果、执行状态。日志需长期保存,支持事后的追溯和排查,一旦出现安全问题,能快速定位原因。

3. 破坏性操作二次确认

对于删除、修改、发送消息、执行代码等有破坏性/不可逆的操作 ,必须在工具中设置二次确认机制 。比如Agent调用delete_customer工具时,工具会先校验确认参数,只有传入confirm: true时,才会真正执行删除操作。

4. 隐私数据隔离

通过代码执行沙箱 ,实现敏感数据的"端到端流转",避免敏感数据进入模型的上下文。比如客户的身份证、手机号、银行卡等PII数据,从业务系统通过沙箱流转到另一个系统,全程不经过大模型,从根源上防止隐私数据泄露。

五、总结:Agent工具设计的核心心法

面向Agent的工具设计,本质是**"站在非确定性的视角,设计确定性的工具"**,其核心心法可以总结为三句话:

- 以Agent为中心:不要让Agent适配工具,而是让工具适配Agent的思考方式,做到"直观、易懂、高效";

- 以评测为依据:拒绝主观感受,用量化的评测体系衡量工具效果,让数据指导工具优化;

- 以安全为底线:在工具设计的初期就考虑安全与隐私,而非落地后再补漏洞,做到"设计即安全"。

随着大模型Agent的不断发展,工具的能力会成为决定Agent落地效果的核心因素。掌握本文的全流程方法和八大核心原则,能让你打造出真正"好用"的Agent工具集,让Agent的能力真正落地到真实的业务场景中。

拓展思考

- 你在设计Agent工具时,遇到过哪些"Agent不会用"的问题?根源是什么?

- 如何将企业现有的海量API,筛选并封装为适合Agent使用的工具集?

- 对于多Agent协作的场景,工具设计需要做哪些额外的考量?