近日,澳大利亚阿德莱德大学与瑞士联邦理工学院洛桑分校的研究团队发表了题为《Fast-SmartWay: Panoramic-Free End-to-End Zero-Shot Vision-and-Language Navigation》的研究成果,提出了一款无需全景观测的端到端零射视觉语言导航(VLN-CE)框架,成功解决了传统导航技术延迟高、硬件适配性差的痛点。该研究全程基于Hello Robot 完成实机验证,Hello Robot 具身智能平台的优秀科研适配性成为算法从仿真走向实机的关键支撑,也彰显了其在具身智能领域的平台级科研价值。

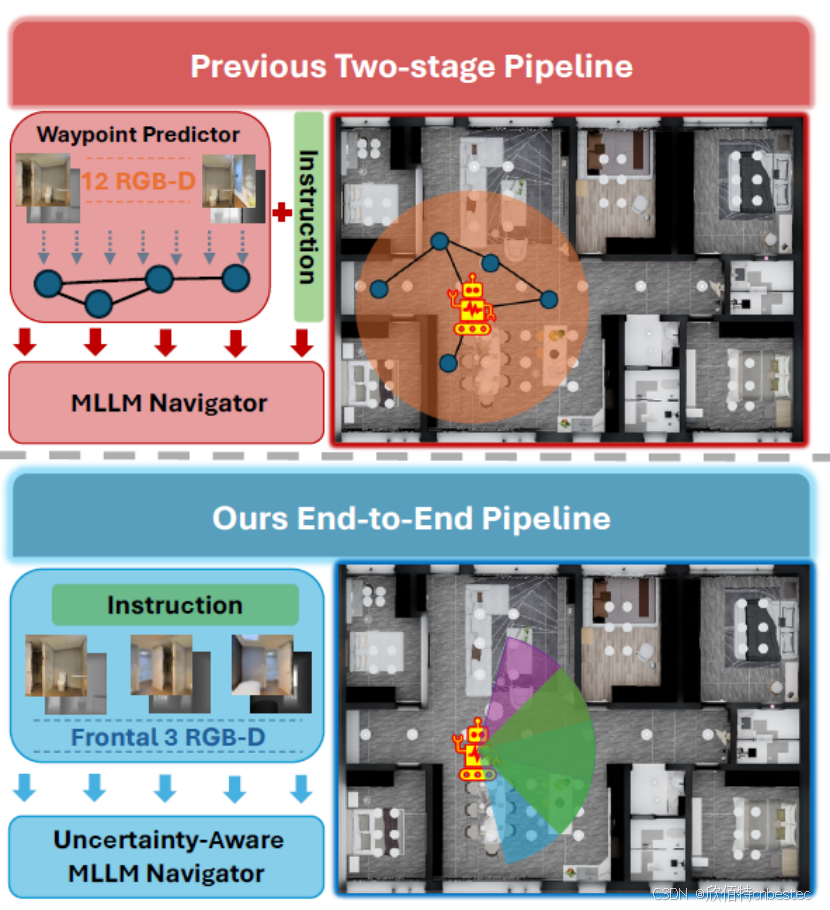

【图 1:传统 VLN-CE 双阶段流程与 Fast-SmartWay 端到端流程对比】

传统 VLN-CE 技术长期受限于两大问题:

一是依赖 360° 全景观测,需要机器人旋转采集 12 视角图像,不仅引入大量延迟,也与仅配备前向相机的常规机器人硬件不符;

二是采用航点预测器 + 导航器的双阶段流程,航点预测仅依赖视觉数据,易与语言指令语义脱节,导致导航决策不佳。这些问题让很多优秀的导航算法难以在实际机器人上部署落地。

Fast-SmartWay 的出现打破了这一困境:

其核心创新在于实现了全景无关的端到端零射导航:

仅通过 3 张正面左、中、右 RGB-D 图像作为视觉输入,直接送入多模态大模型(MLLM)完成动作预测,彻底移除了航点预测器,让感知与决策高度融合。同时,研究团队设计的不确定性感知推理模块,整合了消歧模块和未来 - 过去双向推理机制,既能帮助机器人避开局部最优和死胡同,又能通过历史轨迹分析和未来状态预测,保证全局导航的一致性,大幅提升了复杂环境下的决策鲁棒性。

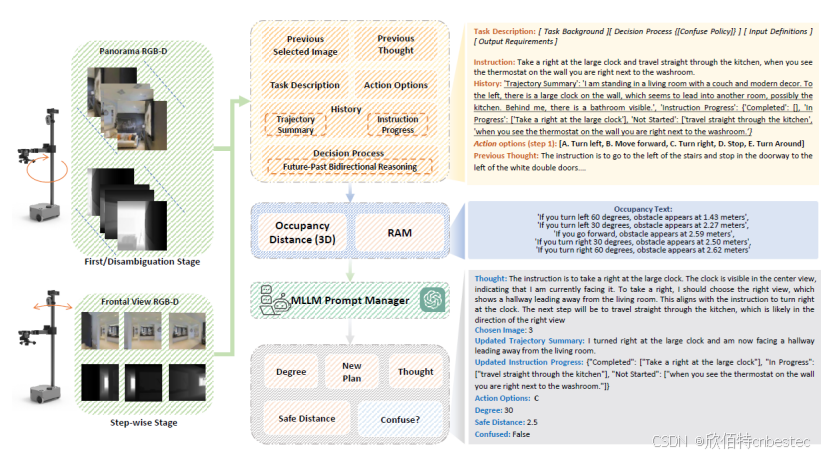

【图 2:Fast-SmartWay 在 Hello Robot 移动操作机器人上的实机测试场景】

该算法的实机验证全程在Hello Robot 移动操作机器人上完成,其搭载的 Intel RealSense D435if RGB-D 相机适配正面三视角的视觉输入设计,可精准采集深度和视觉信息,为算法提供了高质量的硬件数据支撑。实机测试结果显示,Fast-SmartWay 将单步感知时间从 22.40 秒降至 5.13 秒,总处理延迟仅为传统全景方法的 42.4%,同时导航成功率提升至 36%,导航误差降至 2.78 米,实现了效率与精度的双重提升;在 R2R-CE 仿真数据集上,该算法也展现出媲美甚至超越多款全景零射算法的性能。

此次研究也充分验证了Hello Robot 具身智能平台 的科研价值:作为开源的移动操作机器人平台,其硬件设计贴合实际应用场景,深度相机、算力模块的专业配置可无缝对接前沿算法的实机验证需求,能快速实现算法从仿真到真实环境的迁移。而Stretch3作为其核心产品,更能适配室内复杂空间的导航研究,为视觉语言导航、具身智能等领域的科研人员提供了高效、贴合实际的研究载体,大幅降低了算法实机验证的门槛。

从应用前景来看,Fast-SmartWay 无需全景硬件、低延迟的特性,让视觉语言导航技术能在普通移动机器人上部署,可广泛应用于室内服务机器人、工业巡检机器人、智能家居导航等场景。而Hello Robot 移动操作机器人作为算法落地的核心载体,可凭借其灵活的移动性和硬件适配性,推动这些导航技术从实验室走向实际应用。

素材来源:arXiv 论文《Fast-SmartWay: Panoramic-Free End-to-End Zero-Shot Vision-and-Language Navigation》(arXiv:2511.00933v1)

欢迎关注 "欣佰特科技 " ,持续为大家带来 "具身智能领域 "前沿技术及应用!详情可邮件咨询++++sales@cnbestec.com++++