保姆级教程:Win+openclaw+阿里百炼大模型+飞书

参考链接:

(1)阿里百炼大模型官方提供的安装openclaw教程

https://bailian.console.aliyun.com/cn-beijing/?tab=doc#/doc/?type=model\&url=3023085

(2)OpenClaw接入飞书

https://ecloud.10086.cn/op-help-center/doc/article/98177

一、安装node.js

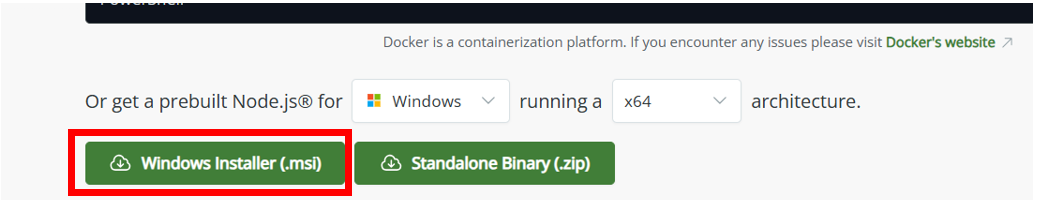

下载网址:https://nodejs.org/en/download/

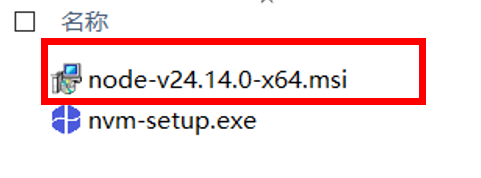

下载好之后如下:

直接双击打开,选择同意,指定自己的安装目录,一路同意安装即可。

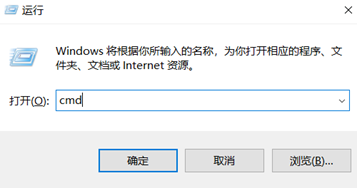

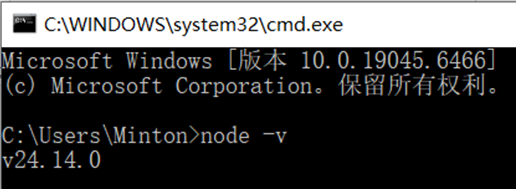

安装好之后,验证是否安装成功:

Win+r然后输入cmd并回车

输入node -v查看node.js的安装版本

二、安装openclaw

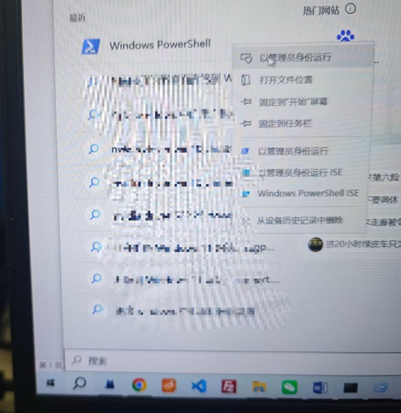

系统左下角搜索power shell并右键:管理员运行

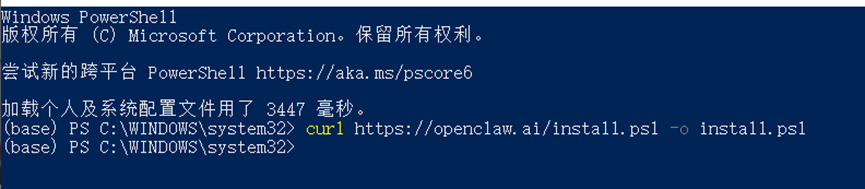

输入下面的指令并敲击回车:

bash

curl https://openclaw.ai/install.ps1 -o install.ps1

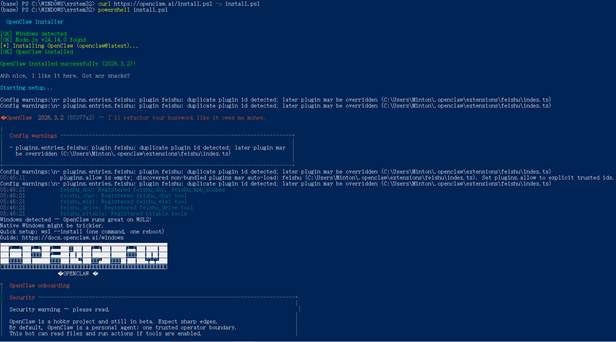

然后输入下面的指令并敲击回车,第一次安装时间比较长(可能是网络问题需要科学上网):

bash

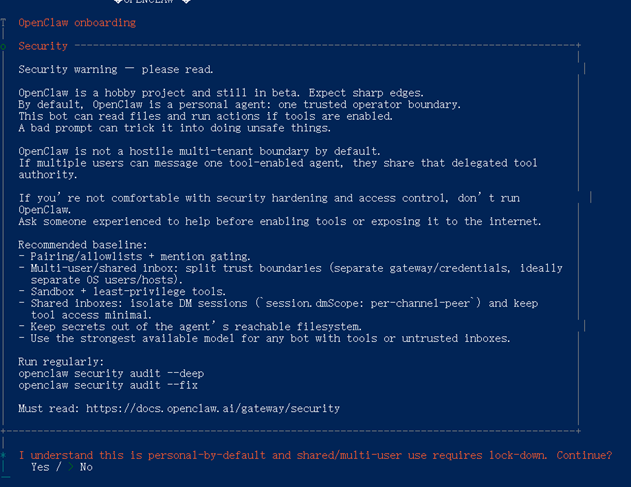

powershell install.ps1等待一会会出现下面的两个画面,一会需要进行选择

然后按方向键,左右来切换选项

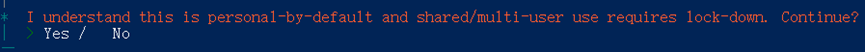

下面选择yes

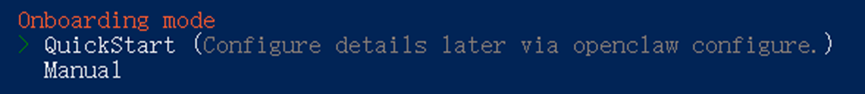

选择QuickStart

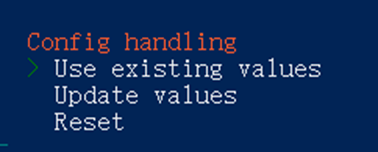

选择Use existing vaules

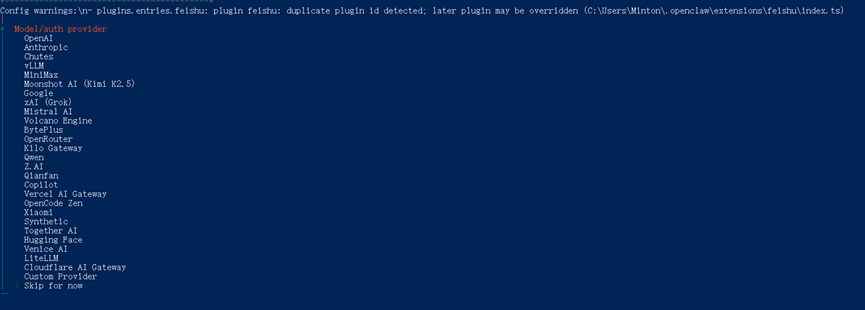

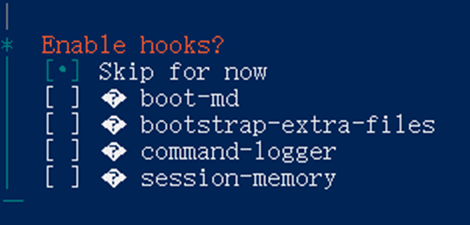

下一步是选择模型,现在先不进行配置,上箭头,选择skip for now

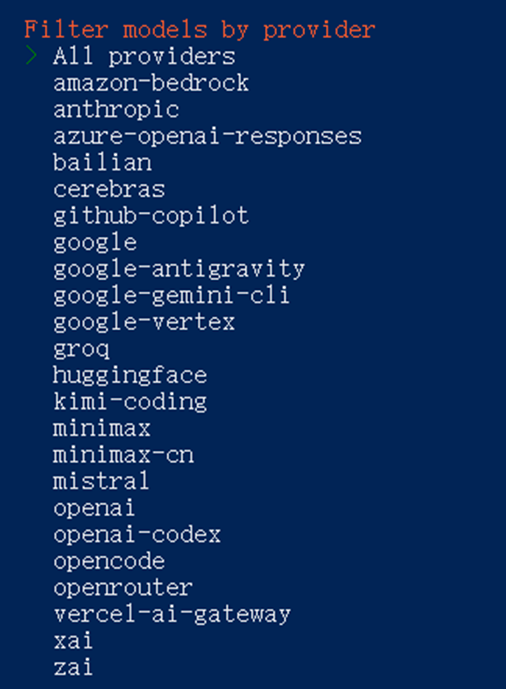

选择All providers

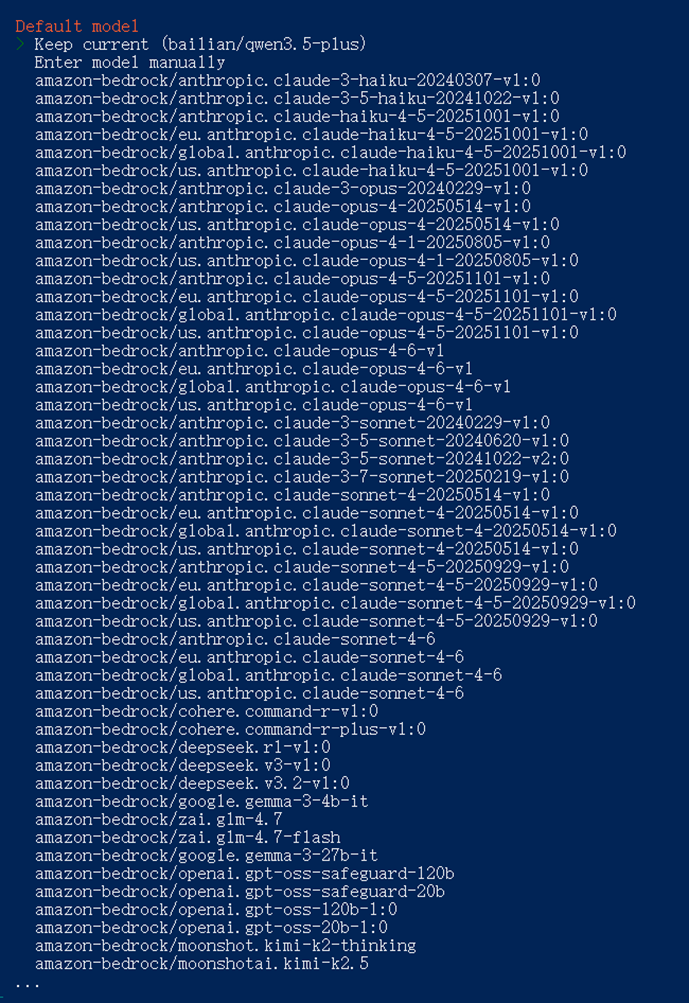

Keep cureent 保持默认即可.(不管后面是啥,认准keep current)

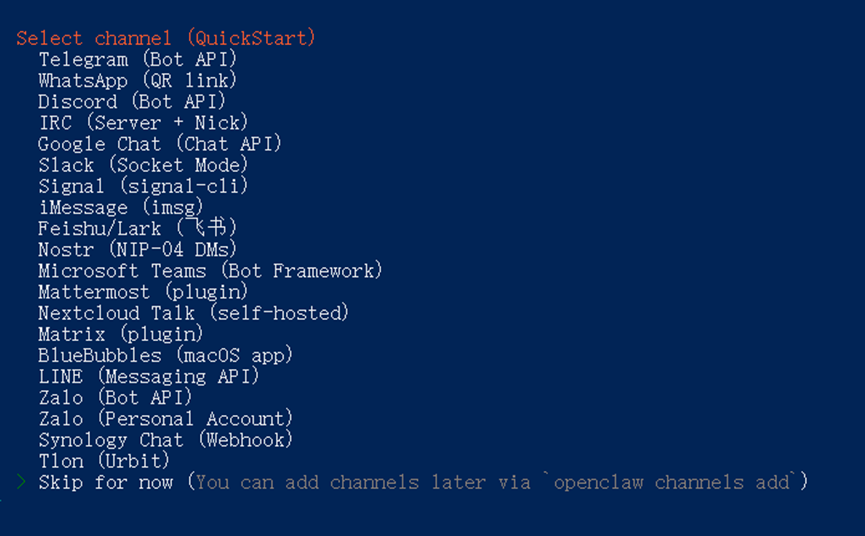

下面是配置应用的,选择跳过skip for now

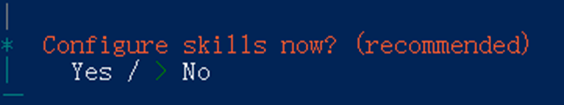

选择no

空格键,进行选择[+]skip for now

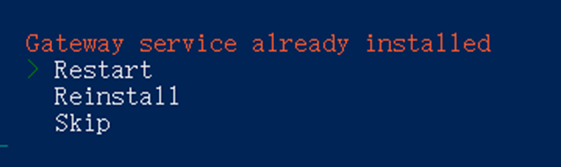

然后restart

然后可能会出一个cmd窗口

然后还会有一个openclaw的web端(用系统默认浏览器打开http://127.0.0.1:18789/)

第一次配置啥都不管,先关闭cmd端,浏览器的web的gui画面也不管。

安装到这算是安装结束了。

三、配置openclaw的大模型

打开C:\Users\Minton.openclaw\openclaw.json 文件 (Minton换成自己的系统的用户名),将下面的内容复制进去。然后需要将下面的YOUR_API_KEY替换成自己的付费API: sk- *

还可以修改默认的模型: "primary": "bailian/qwen3.5-plus"修改成自己想用的模型,比如"primary": "bailian/glm-5"

bash

{

"models": {

"mode": "merge",

"providers": {

"bailian": {

"baseUrl": "https://coding.dashscope.aliyuncs.com/v1",

"apiKey": "YOUR_API_KEY",

"api": "openai-completions",

"models": [

{

"id": "qwen3.5-plus",

"name": "qwen3.5-plus",

"reasoning": false,

"input": ["text", "image"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 1000000,

"maxTokens": 65536

},

{

"id": "qwen3-max-2026-01-23",

"name": "qwen3-max-2026-01-23",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 262144,

"maxTokens": 65536

},

{

"id": "qwen3-coder-next",

"name": "qwen3-coder-next",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 262144,

"maxTokens": 65536

},

{

"id": "qwen3-coder-plus",

"name": "qwen3-coder-plus",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 1000000,

"maxTokens": 65536

},

{

"id": "MiniMax-M2.5",

"name": "MiniMax-M2.5",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 204800,

"maxTokens": 131072

},

{

"id": "glm-5",

"name": "glm-5",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 202752,

"maxTokens": 16384

},

{

"id": "glm-4.7",

"name": "glm-4.7",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 202752,

"maxTokens": 16384

},

{

"id": "kimi-k2.5",

"name": "kimi-k2.5",

"reasoning": false,

"input": ["text", "image"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 262144,

"maxTokens": 32768

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "bailian/qwen3.5-plus"

},

"models": {

"bailian/qwen3.5-plus": {},

"bailian/qwen3-max-2026-01-23": {},

"bailian/qwen3-coder-next": {},

"bailian/qwen3-coder-plus": {},

"bailian/MiniMax-M2.5": {},

"bailian/glm-5": {},

"bailian/glm-4.7": {},

"bailian/kimi-k2.5": {}

}

}

},

"gateway": {

"mode": "local"

}

}四、配置飞书

此部分主要分为四个步骤,第一个是在飞书的开发者平台创建机器人应用,第二个是在openclaw中安装飞书插件,第三个然后配置创建的飞书机器人应用的app的id和密码,使得飞书的机器人和openclaw联动起来。第四个进行验证

1 创建飞书机器人应用

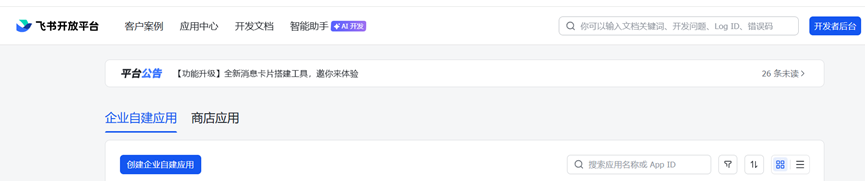

进入网址 https://open.feishu.cn/app?lang=zh-CN ,登录飞书账号

选择开发者后台,选择创建企业自建应用

随便填写以下应用名称和描述,然后创建即可

下一步添加机器人

选择创建版本,填写0.0.1 和介绍中的0.0.1即可发布程序。

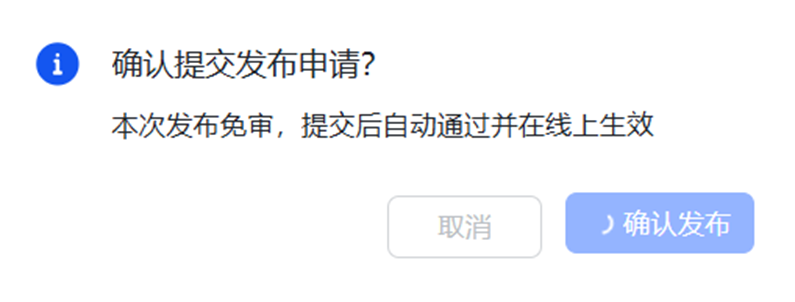

确认发布

2 openclaw配置飞书插件

Powershell中输入openclaw onboard

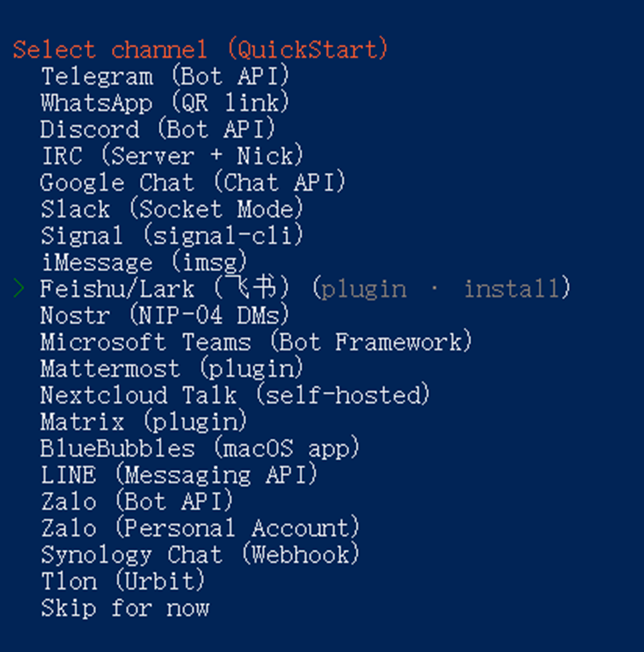

一些默认设置如三中配置openclaw是一样的,但是到了下面的步骤,选择channel中选择飞书

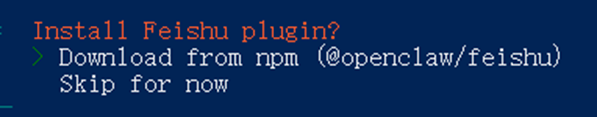

下载feishu的插件

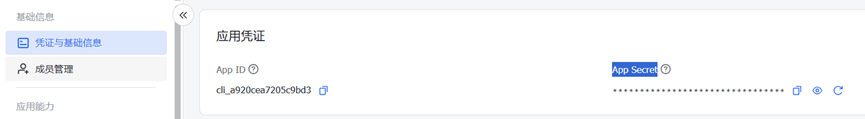

然后后面有一个App Secret 和 App id

复制自己的开发者后台中的 凭证和基础信息 中的对应数据即可,剩余选项选择默认即可。如果有brave search选项可以不选择即可,或者默认都行。

3 配置飞书机器人

这部分参考飞书官网的配置:

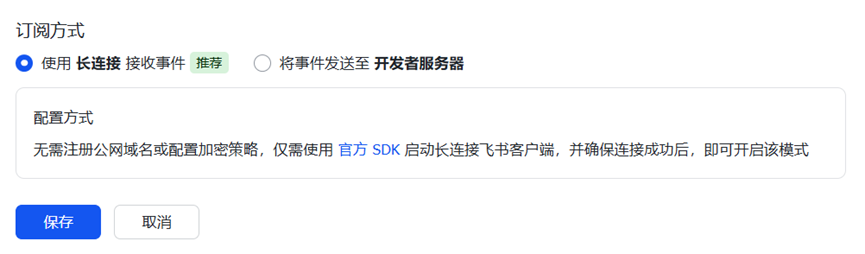

下一步选择 事件与订阅 中的 订阅方式

选择默认的长连接即可保存

点击页面中的 "添加事件",在弹出的事件列表中,选择 "消息与群组" 分类,勾选 "接收消息",点击 "确定",完成事件订阅。

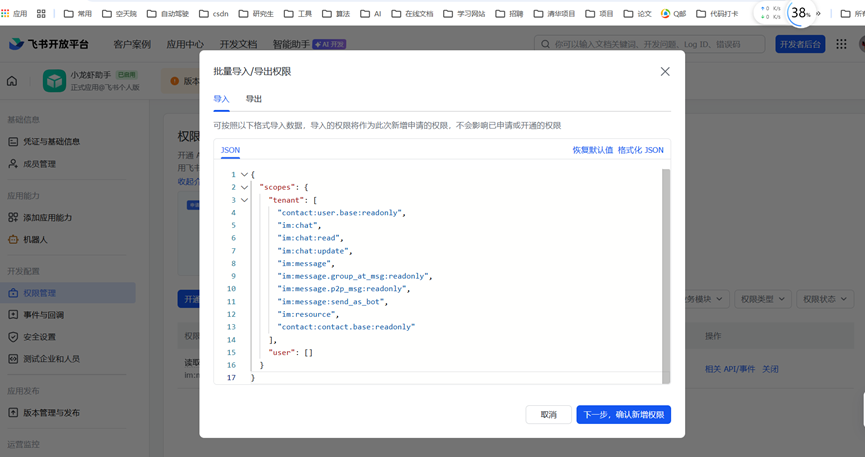

在飞书应用管理页,左侧导航栏找到 "权限管理" 栏目,点击进入。点击页面中的 "批量/导入权限" 按钮,弹出权限导入窗口,输入以下json命令:

bash

{

"scopes": {

"tenant": [

"contact:user.base:readonly",

"im:chat",

"im:chat:read",

"im:chat:update",

"im:message",

"im:message.group_at_msg:readonly",

"im:message.p2p_msg:readonly",

"im:message:send_as_bot",

"im:resource",

"contact:contact.base:readonly"

],

"user": []

}

}

下一步,然后确认

然后发布应用,填写版本号和更新说明即可,然后下拉保存,确认发布

4 开启openclaw网关进行验证

说明:

在Power shell里面输入

openclaw gateway stop # 停止

之后在输入

openclaw gateway #重启

上面这个操作是重启网关 ,后续只说重启网关,即做这两个操作

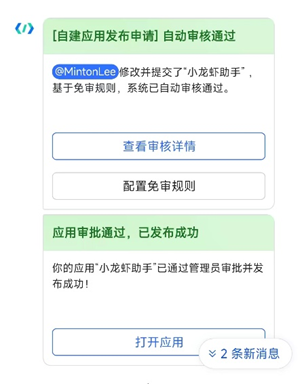

然后飞书里面有消息:

点击最新的 打开应用即可

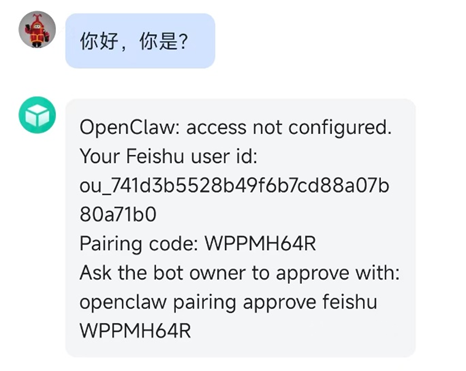

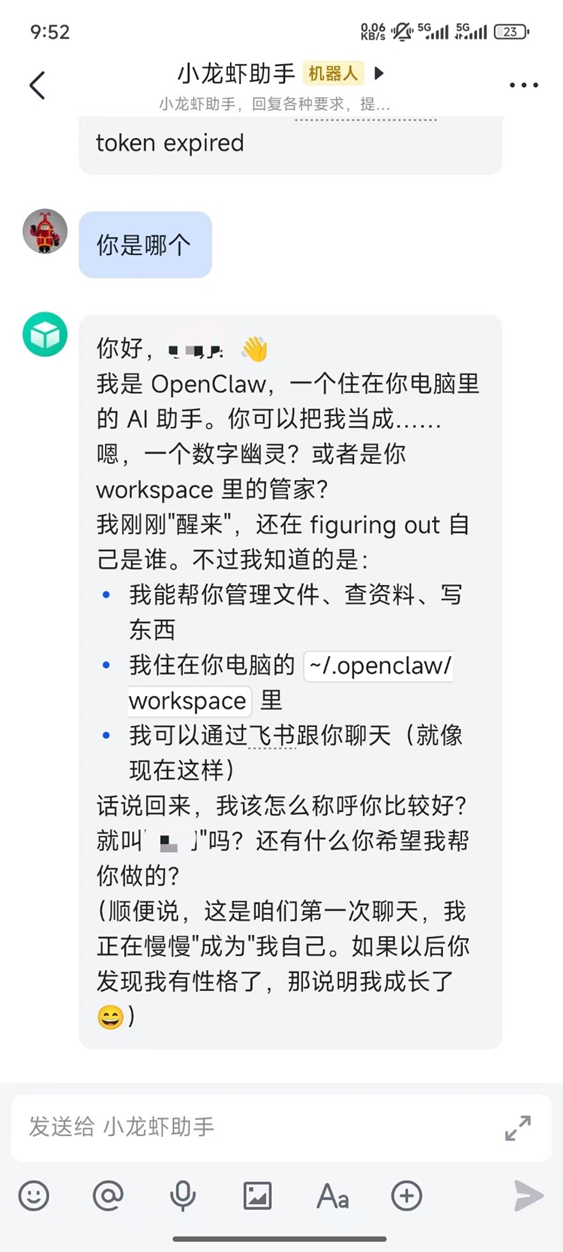

打开应用,开启对话,第一次对话,出现界面如下:

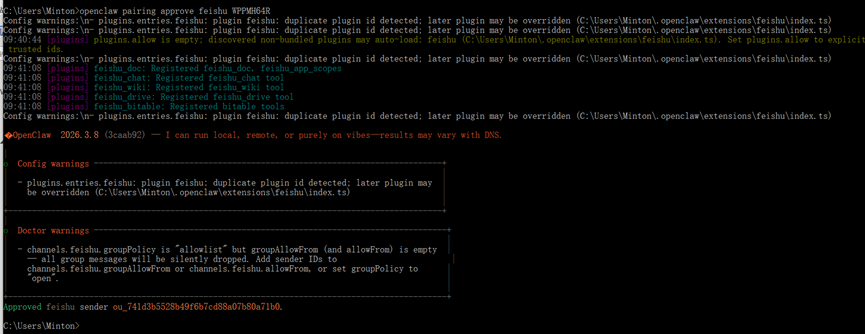

然后把 openclaw pairing approve feishu WPPMH64R

复制,打开一个新的Power shell画面或者cmd 输入即可。WPPMH64R每次是随机的一个验证码,需要更改成对应的系统发给自己的验证码。

这一步骤第一次用的时候需要验证,

然后重启网关 ,后续聊天:

五、错误记录(持续更新中)

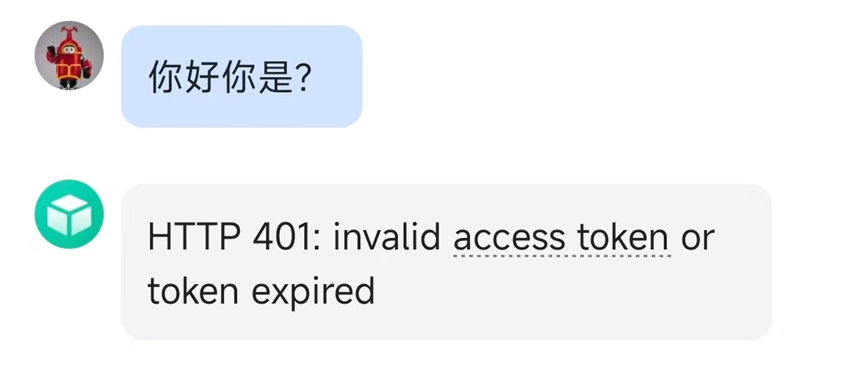

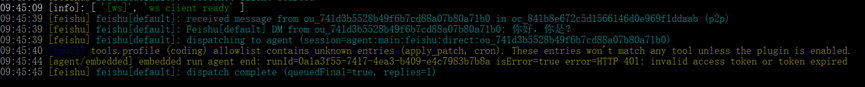

1. 401错误:HTTP 401:invalid access token or token expired

Openclaw gateway窗口输出

解决办法:我这个是大模型的API鉴权失败,忘记在openclaw.json中复制自己的api key了,重新复制一下api然后openclaw gateway stop 然后openclaw gateway即可。