夺回认知主权:生成式 AI 可信治理的技术逻辑与未来图景

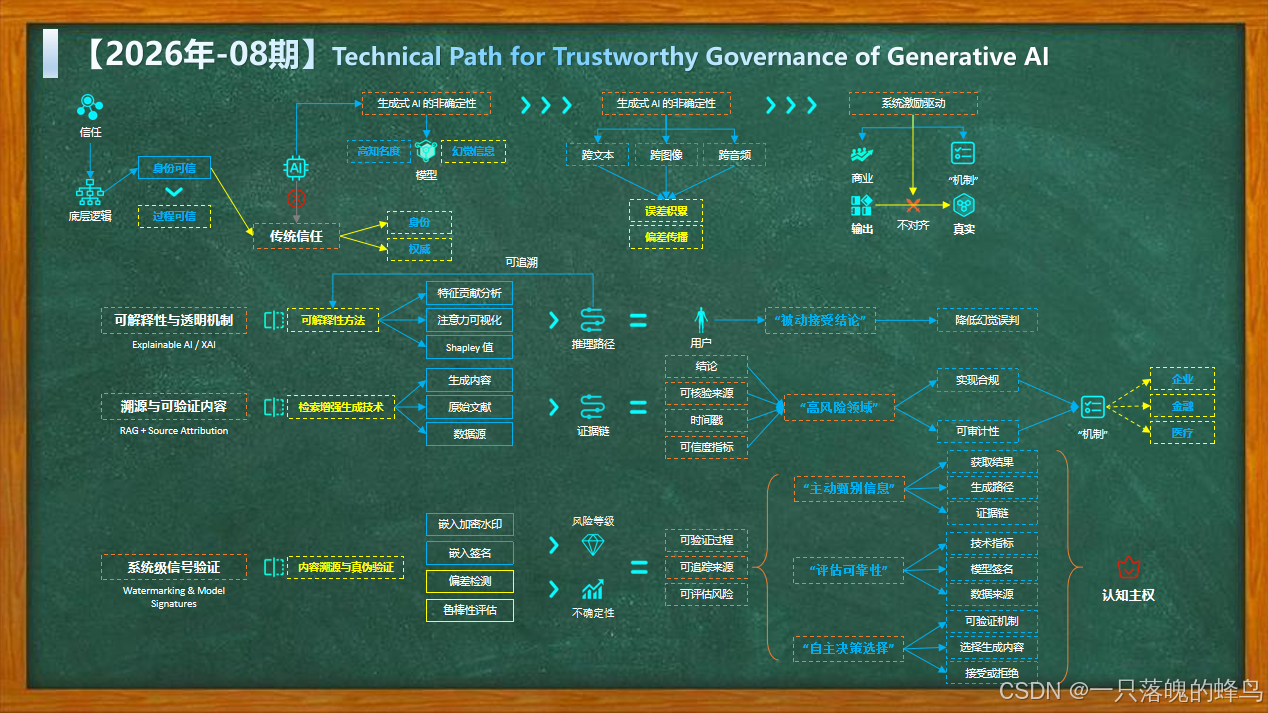

当 ChatGPT 流畅输出虚构论文、AI 绘画伪造新闻照片时,我们正站在一个十字路口:生成式 AI 的创造力空前强大,但 "幻觉""伪造""偏见" 也在瓦解人类对智能系统的传统信任。这张思维导图,正是对这场信任危机的精准拆解与系统性回应 ------ 它不仅揭示了问题根源,更指明了从技术修复到认知主权重建的完整路径。

一、信任的崩塌:传统逻辑为何失效?

在人类社会的传统信任体系中,我们依赖 "身份可信" 与 "过程可信" 来判断信息真伪:作者身份、机构权威、创作流程,是我们采信信息的基石。但生成式 AI 的出现,从根本上动摇了这一逻辑。

首先,生成式 AI 的非确定性是核心病灶。模型在跨文本、跨图像、跨模态生成时,会不断积累误差、传播偏差,甚至在高知名度领域主动生成 "幻觉信息"------ 这些内容看似逻辑自洽、细节丰富,却与事实完全背离。传统信任中 "身份 = 可靠" 的等式,在匿名化、参数化的 AI 模型面前彻底失效。

其次,系统激励的错位加剧了信任危机。商业驱动下,生成式 AI 系统的目标往往是 "最大化用户停留、提升输出流畅度",而非 "输出真实信息"。这种激励机制让模型学会 "讨好" 用户,而非坚守事实,导致 "输出" 与 "真实" 之间出现根本性不对齐。

当我们无法再通过 "作者是谁""机构背书" 来判断信息真伪时,传统信任的大厦已然倾斜,我们必须寻找新的可信治理方案。

二、技术修复:三大支柱重建可信基础

面对信任危机,行业正在构建三大技术支柱,试图从 "可解释、可溯源、可验证" 三个维度,为生成式 AI 打上 "可信标签"。

**第一支柱:可解释性与透明机制(XAI)**可解释性 AI 的核心目标,是让 AI "说出自己的思考过程"。通过特征贡献分析、注意力可视化、Shapley 值等方法,我们可以还原模型生成某段文字、某张图片时的关键依据:哪部分数据影响了最终输出?模型关注了哪些特征?这让用户从 "被动接受结论" 的状态中解脱出来,能够主动识别模型的逻辑漏洞,降低被幻觉误导的风险。

**第二支柱:溯源与可验证内容(RAG + 来源归因)**检索增强生成技术(RAG)为内容可信提供了 "证据链"。模型不再凭空生成内容,而是先从指定数据源、原始文献中检索信息,再基于检索结果生成回复,并明确标注内容来源。这在金融、医疗、企业决策等高风险领域尤为关键 ------ 每一条生成内容都可核验、可审计,既满足合规要求,也让用户能直接追溯信息源头。

第三支柱:系统级信号验证如果说可解释性和溯源是 "内容层面" 的修复,系统级信号验证则是 "底层技术" 的加固。通过在生成内容中嵌入加密水印、模型签名,我们可以实现内容溯源与真伪验证;而偏差检测、鲁棒性评估等技术,则能量化模型输出的风险等级与不确定性,让用户提前感知信息的可靠程度。

三、认知主权:人类在 AI 时代的最终控制权

技术修复的最终目标,并非让 AI 变得 "绝对可信",而是将信息判断的权力交还给人类,实现 "认知主权"。

在这一图景中,用户不再是 AI 输出的被动接收者,而是主动的信息管理者:

- 主动甄别信息:获取生成结果、生成路径与完整证据链,自主判断内容的合理性;

- 评估可靠性:查看技术指标、模型签名、数据来源,量化信息的风险与可信度;

- 自主决策选择:根据自身判断,选择接受或拒绝 AI 输出,甚至自主调整生成内容。

这意味着,AI 不再是 "替代人类思考" 的工具,而是 "辅助人类判断" 的伙伴 ------ 人类始终掌握着最终的认知决策权,这才是 AI 时代最本质的信任。

四、未来展望:可信 AI 不是终点,而是新起点

生成式 AI 的可信治理,从来不是技术问题 alone,而是技术、伦理、法律的协同课题。这张思维导图所描绘的路径,既是当前技术的实践总结,也是未来发展的方向:可解释性将更直观、溯源将更高效、验证将更普惠,而认知主权的理念,也将逐渐融入产品设计、行业规范与公众认知。

当我们能从容地问 AI "你为什么这么说""你的依据是什么",并能自主判断答案的真伪时,我们才真正在 AI 时代站稳了脚跟 ------ 不是恐惧 AI 的不可控,而是拥抱它作为工具的价值,同时牢牢守护人类的认知尊严。

五、总结

这张图清晰勾勒了生成式 AI 从 "信任危机" 到 "认知主权" 的完整逻辑:先诊断传统信任失效的根源,再通过可解释性、溯源验证、系统级检测三大技术路径修复信任,最终让用户夺回信息判断的主动权。它不仅是一份技术蓝图,更是 AI 时代人类与技术关系的核心宣言:AI 可以辅助思考,但认知主权永远属于人类。