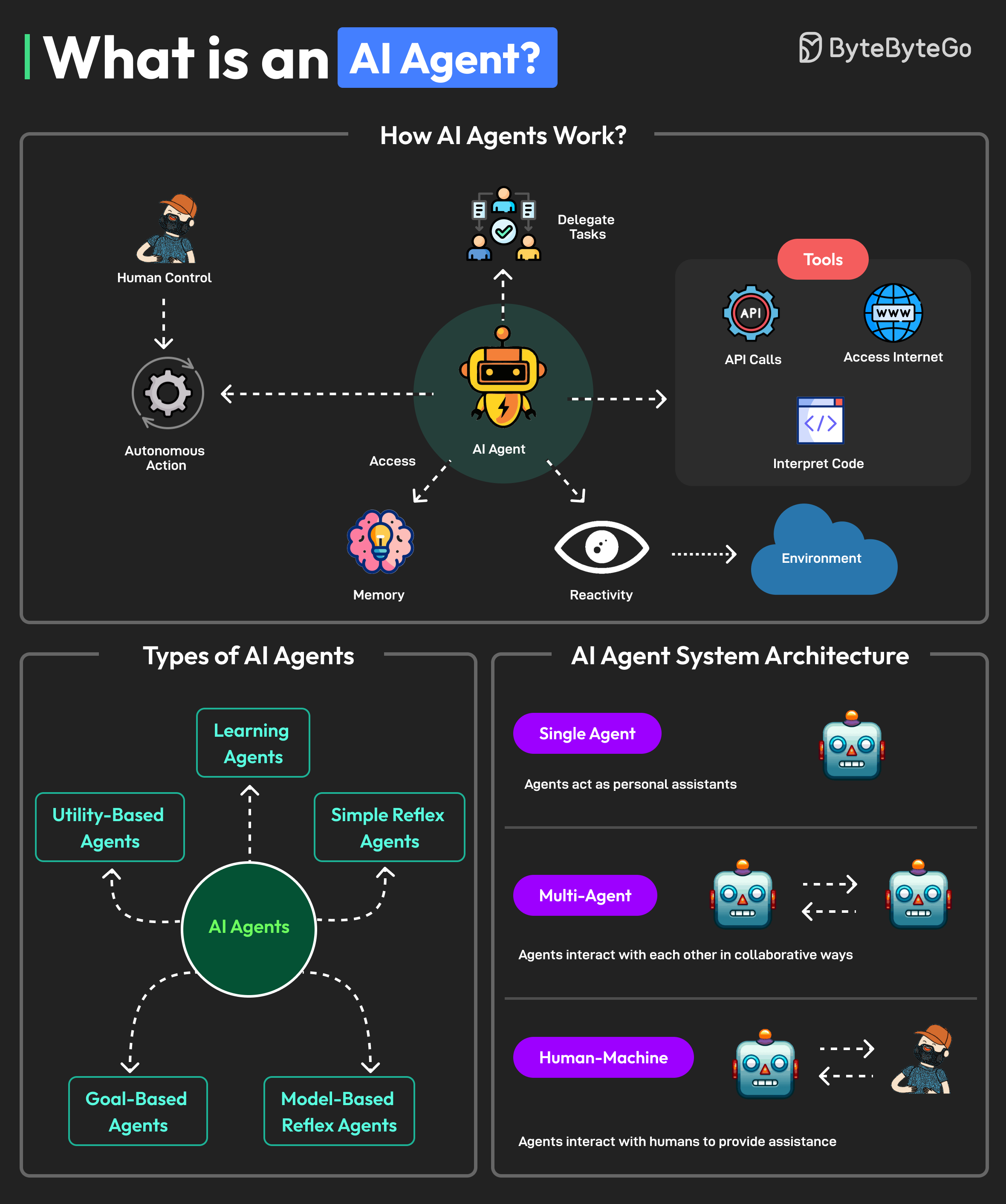

一、核心认知:什么是真正的AI Agent?

经典定义:AI Agent是能感知环境、自主决策、执行动作并持续学习的智能体。它不是简单的对话机器人,而是具备目标导向、上下文感知和工具使用能力的智能系统。

巨人肩膀:

- Russel & Norvig的经典框架(《人工智能:现代方法》)------ 智能体的理性决策基础

- 工具增强(Tool-Augmented)理念------ 语言模型 + 工具 = 真正的能力扩展

- ReAct范式(Yao et al., 2023)------ 思考(Reason)+ 行动(Act)的循环模式

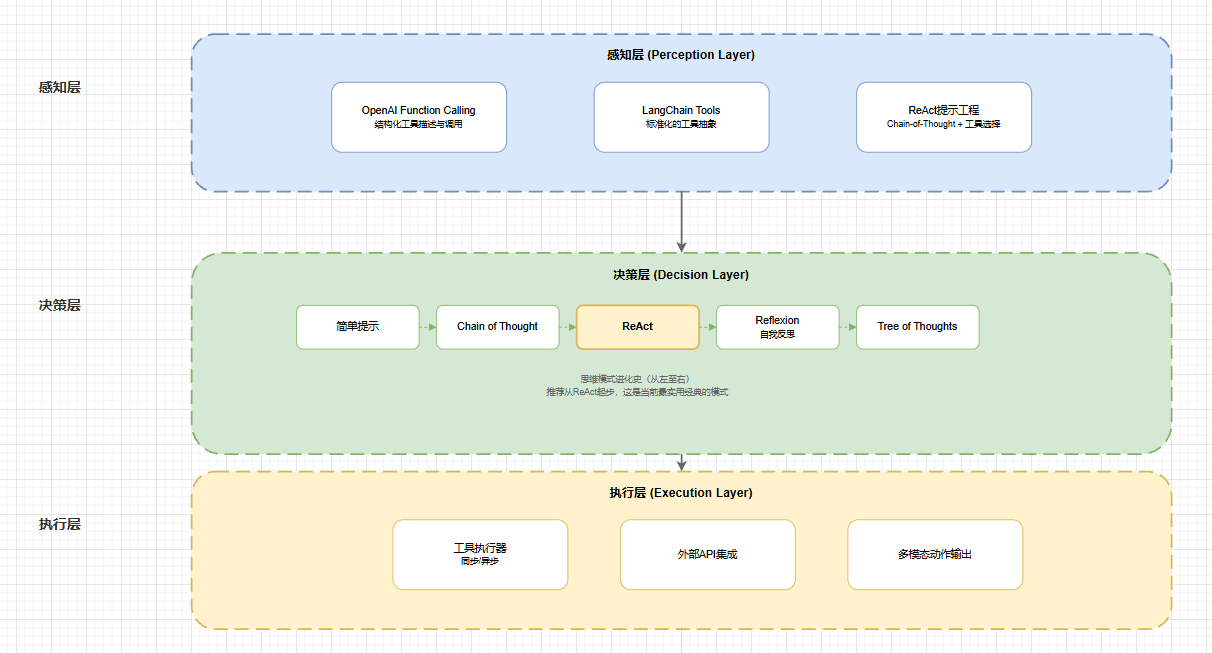

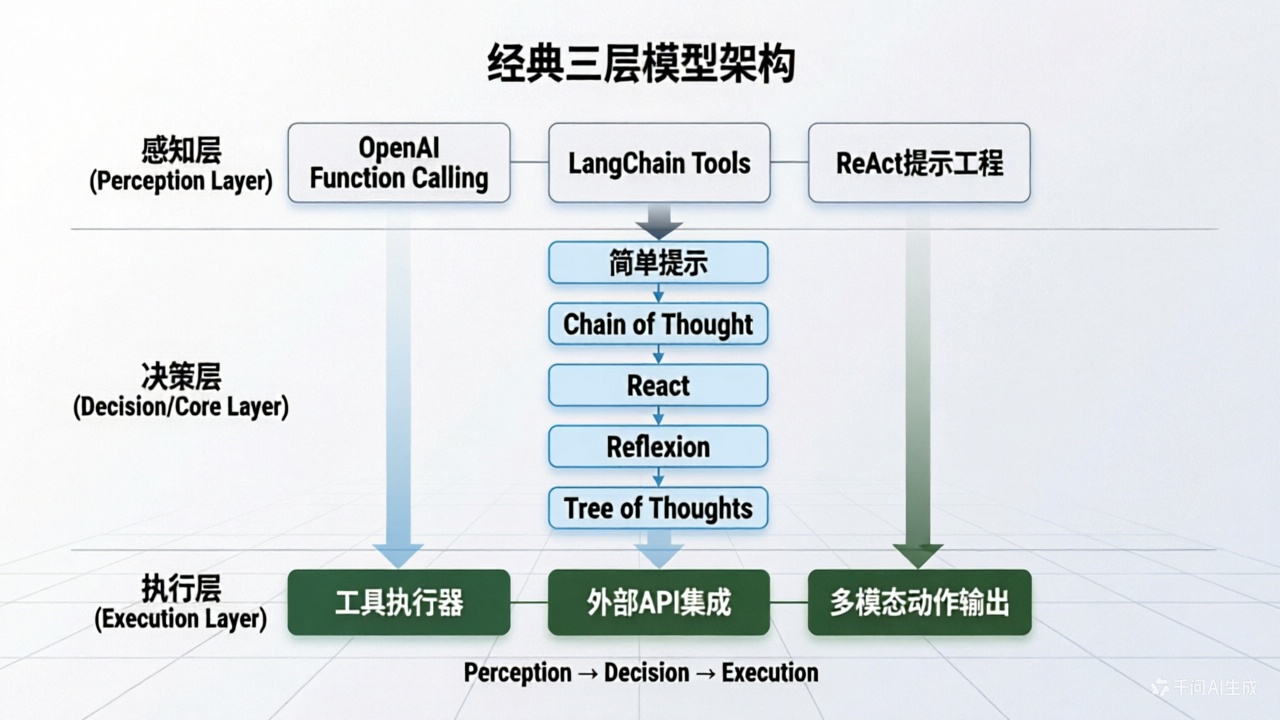

二、架构蓝图:经典的三层模型

1. 感知层(Perception Layer)

经典实现参考:

- OpenAI Function Calling:结构化工具描述与调用

- LangChain Tools:标准化的工具抽象

- ReAct提示工程:Chain-of-Thought + 工具选择2. 决策层(Decision/Core Layer)

思维模式进化史:

1. 简单提示 → 2. Chain of Thought → 3. ReAct → 4. Reflexion(自我反思)→ 5. Tree of Thoughts

推荐从ReAct起步,这是当前最实用经典的模式3. 执行层(Execution Layer)

关键抽象:

- 工具执行器(同步/异步)

- 外部API集成

- 多模态动作输出

三、经典框架实战对比

AutoGPT(开源鼻祖)

- 贡献:确立了Agent = LLM + 记忆 + 工具的范式

- 学习价值:任务分解、长期记忆实现

- 局限:复杂度过高,适合学习而非生产

LangChain

- 核心优势:标准化抽象(Chains, Agents, Tools)

- 经典模式:ReAct, Self-ask, Plan-and-execute

- 入门建议:从LCEL(LangChain Expression Language)开始

LlamaIndex

- 专长领域:检索增强型Agent

- 经典模式:子问题查询、RAG + Agent融合

- 思维提升:学习如何将复杂查询分解为检索子任务

微软Autogen

- 突破性思维:多智能体协作

- 经典场景:开发者+产品经理+测试工程师的Agent团队

- 架构价值:学习智能体间通信模式(GroupChat, Sequential Chat)

四、可反复品味的经典设计模式

模式1:ReAct(思考-行动)循环

python

# 伪代码展现核心逻辑

for _ in range(max_iterations):

# 思考阶段

thought = llm.think(observation, task, history)

# 行动阶段

if needs_tool(thought):

tool, args = parse_tool_call(thought)

observation = execute_tool(tool, args)

else:

break # 任务完成模式2:反思-改进(Reflexion)

1. 执行任务

2. 评估结果

3. 生成改进建议

4. 重新执行(带反思)

→ 人类学习过程的AI映射模式3:分层任务分解(Hieraarchical Task Decomposition)

复杂目标

├── 子目标1

│ ├── 动作1.1

│ └── 动作1.2

└── 子目标2

└── 动作2.1五、实用学习路径:从模仿到创新

建立思维模型

- 精读论文:《ReAct: Synergizing Reasoning and Acting in Language Models》

- 实践:用LangChain实现最简单的ReAct Agent

- 思考题:为什么需要"思考"步骤?直接行动不行吗?

框架深度体验

- LangChain Agent + 3种工具

- LlamaIndex的SubQuestionQueryEngine

- Autogen的双Agent对话

- 关键练习:用不同框架实现同一个需求,对比设计哲学

经典代码阅读

- 必读源码:LangChain的

AgentExecutor类 - 学习重点:错误处理、最大迭代控制、早期停止

- 思维提升:如果你是作者,会如何改进这个架构?

从头实现迷你框架

你的MiniAgent框架应有:

1. 基础工具调用

2. 简单记忆(最后5轮对话)

3. ReAct循环

4. 超时控制

→ 实现后,你才能真正理解框架价值六、反复阅读的经典问题(每周自问)

- 架构问题:我的Agent是"真正自主"还是"复杂脚本"?

- 扩展问题:新增工具时,需要修改多少处代码?

- 健壮问题:工具调用失败时,Agent能恢复吗?

- 评估问题:如何知道我的Agent在变好?(不只是准确率)

七、站在巨人肩膀上看未来

经典永不过时

- 工具使用模式:无论底层模型如何进化,工具调用抽象依然有效

- 思考-行动循环:这是Agent自主性的核心,不会被淘汰

- 记忆设计:短期/长期记忆的平衡是永恒话题

新兴趋势

- 多模态Agent:视觉+语言+行动的融合

- 具身智能:物理世界交互的Agent

- 大规模协作:100+ Agent系统的治理

八、培养架构师思维

- 抽象能力:看到AutoGPT的复杂,能抽象出"记忆-规划-执行"三层

- 模式识别:在不同框架中识别相同的设计模式

- 简单性追求:能用简单循环解决的问题,不用复杂状态机

- 演进思维:今天的生产代码,应是明天重构的对象

经典书单/论文(你的巨人肩膀)

-

必读论文:

- 《ReAct: Synergizing Reasoning and Acting in Language Models》

- 《Toolformer: Language Models Can Teach Themselves to Use Tools》

- 《Reflexion: Language Agents with Verbal Reinforcement Learning》

-

经典书籍章节:

- 《Artificial Intelligence: A Modern Approach》第2章(智能体)

- 《Designing Data-Intensive Applications》第4章(编码与演化)

-

代码库学习:

- LangChain的

langchain/agents模块 - AutoGPT的

agent模块(历史意义大于实用)

- LangChain的

最后赠言:优秀的Agent开发者不是框架的熟练工,而是能够看到框架背后的"为什么"------为什么这样设计?解决了什么问题?留下了什么遗憾?每周用这个框架实现一个小功能,每月阅读一个框架的核心源码,每季度从头实现一个迷你框架。三年后,你会发现自己已拥有真正的"巨人视野"。

现在开始:打开LangChain文档,运行第一个ReAct Agent示例。记住,框架是别人的智慧结晶,但理解它的过程,才是你真正的知识积累。