作者:来自 Elastic Brian BergholmRachael WadeHubert GrzesiekAleta Hubbell

无缝向量化高容量数据,并通过 GPU 加速向量搜索的新黄金标准加快生产上线时间。

总结

- Elastic 与 NVIDIA 合作推出了由 NVIDIA cuVS 提供支持的 GPU 加速向量索引。

- 集成到 NVIDIA AI Factory 验证设计中的 Elasticsearch 提供了经过验证的全栈、预工程化蓝图,用于加速 AI 应用。

- 企业可以比基于 CPU 的方法快 12 倍地向量化海量非结构化数据

组织正在大规模投资 AI。但要实现真正的业务价值,你需要的不仅是能够存储海量数据的基础设施,还需要能够快速搜索和检索上下文的系统。此外,你需要能够推理、学习、回答问题并采取行动的系统,而不仅仅是返回搜索结果。

Elastic 向量索引结合 NVIDIA cuVS GPU 加速消除了企业级 AI 部署的关键障碍,使组织能够向量化海量非结构化数据,并在规模化环境中为现代 AI 解决方案提供所需的准确、实时上下文。

前沿 AI

企业正进入 AI 采用的新阶段,非结构化数据的激增使传统搜索在提取洞察力方面力不从心。因此,组织转向高性能向量数据库和语义搜索,以支持现代 AI 应用,例如生成式 AI (GenAI)、增强检索生成 (RAG) 和 AI 代理。

与此同时,企业正在构建 AI 工厂,以简化 AI 部署、提升性能并最大化 GPU 的效率和容量。结合加速计算与高性能向量搜索的集成堆栈,是推动前沿 AI 面向消费者和企业的最经济高效方案。

高效 AI 可能吗?

当大型企业构建内部生成式 AI 平台,需要高效地从 PB 级企业数据中索引和检索上下文时,成本会立即成为重点。这些 AI 工厂需要尽可能利用每一项优势以降低昂贵的工作负载。

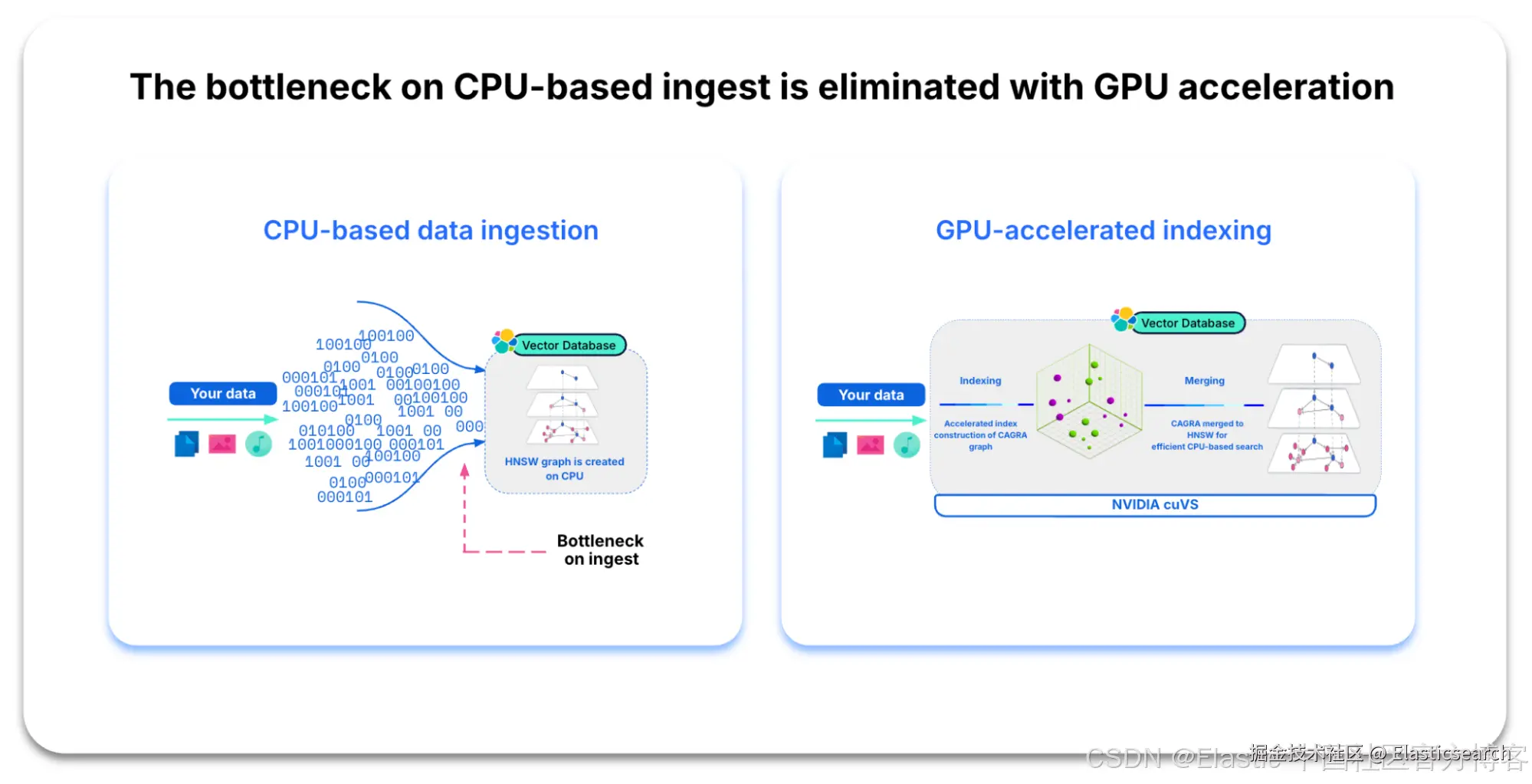

同样,试图扩展向量搜索能力的组织,如果不线性增加 CPU 硬件投入,将难以做到。当你着手构建高性能向量数据库时,你面临的挑战是 CPU 上构建向量索引(HNSW 图)。在比较每个向量时,索引构建可能会产生数百万甚至数十亿次算术操作。随着这种复杂性,还会带来数据摄取瓶颈。再加上索引生命周期操作,如压缩和合并,你的计算开销可能显著增加。

成本优化的向量基础设施

为帮助你克服这些挑战,Elastic 与 NVIDIA 共同推动 Elastic AI 生态系统,重新定义企业构建和扩展 AI 工厂的方式,通过提供 GPU 加速向量搜索和强大的 AI 基础设施,实现下一代实时智能。

通过将 NVIDIA 企业 AI 工厂验证设计与 Elasticsearch 强大的向量数据库结合,组织能够向 AI 代理和 GenAI 应用安全地、大规模地提供更深入的洞察和实时相关数据。

使用 Elastic 与 NVIDIA,你将获得高性能、功能丰富、针对现代 AI 构建的 GPU 加速向量数据库的强大能力。

以下是你可以从该集成中获得的一些优势。

加速部署

通过使用全栈、预工程化系统构建本地 AI 工厂,减少上市时间。Elasticsearch 在 NVIDIA 企业 AI 工厂验证设计中是经过验证和支持的向量数据库,确保为部署代理式 AI 应用提供可靠框架。

快速高效的索引

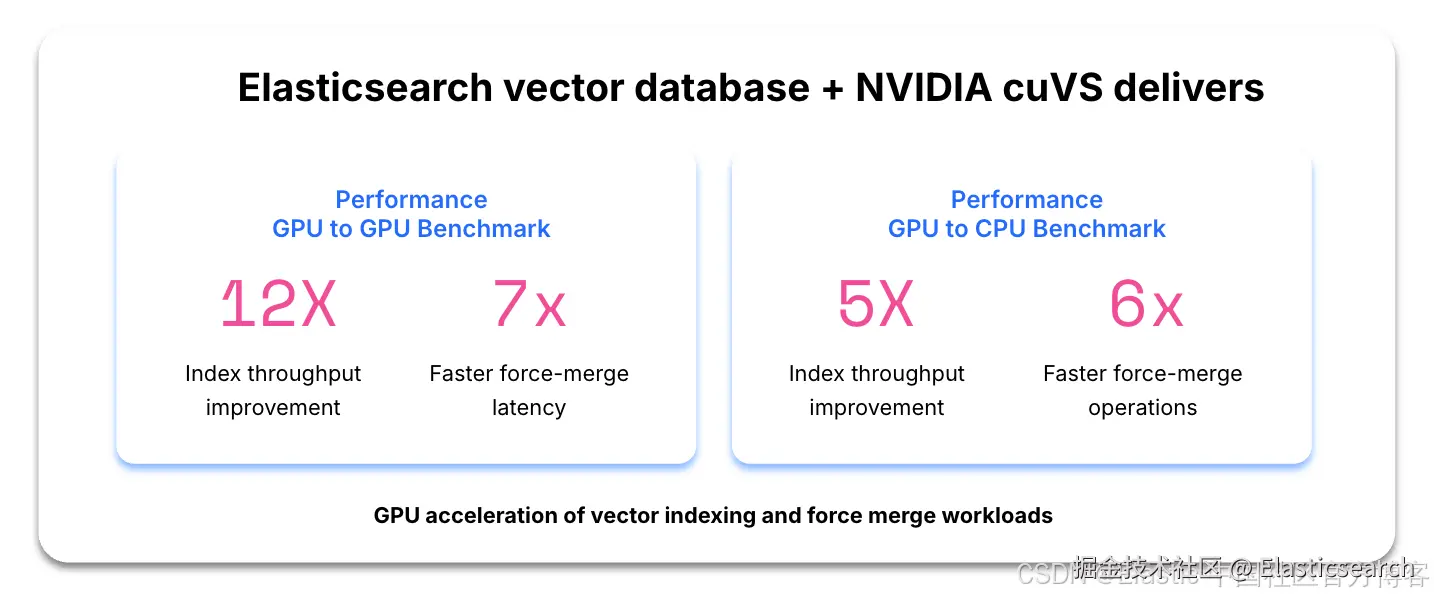

更高效地处理指数级增长的向量嵌入和海量数据。将 NVIDIA cuVS 集成到 Elasticsearch 中,可实现接近 12 倍的索引吞吐量提升和 7 倍更快的强制合并速度。

成本效率与资源优化

将高计算量工作负载卸载到 GPU 可减少 CPU 使用并最大化现有基础设施价值。在成本调整比较下,GPU 加速相比标准 CPU 使用可提供约 5 倍更高的索引吞吐量和 6 倍更快的强制合并操作。

增强的实时查询性能

Elastic 的 NVIDIA 加速向量搜索消除了性能瓶颈,使你的基础设施能够处理海量查询量并实现接近即时的响应时间,从而高效扩展生成式 AI 和 RAG 应用,同时提供实时、相关的洞察。

无缝未来适配与可扩展性

在无需持续手动优化的负担下,保持高性能、经过规模验证的向量数据库。NVIDIA cuVS 优化并加速向量搜索操作,适应不断发展的 NVIDIA GPU 架构和 CUDA 版本,确保 AI 和数据密集型工作负载的高性能与无缝扩展性。

原生 GPU 加速推理与模型管理

消除管理外部推理提供商和基础设施的复杂性。Elastic Inference Service (EIS) 在 Elasticsearch 内部提供原生、高吞吐量推理,利用现代 NVIDIA AI 基础设施在大规模环境下保持低延迟性能。原生部署生产就绪的托管模型,包括 Jina AI 的多语言嵌入和重排序模型,确保精确召回调优和数据主权,无需额外运营开销。

下一步是什么?

Elastic 与 NVIDIA 合作,为依赖向量搜索构建和交付实时 RAG 与 AI 应用的企业提供更多速度、规模和价值。你的团队可以在减少基础设施压力和预算压力的同时,实现大规模性能。

通过将 Elasticsearch 纳入 NVIDIA AI Factory 验证设计,你获得了经过验证的全栈、预工程化蓝图,以加速 AI 应用,实现更高效率和更快上市时间。

NVIDIA cuVS 集成目前在 Elastic 自管理企业客户(版本 9.3)中为技术预览 。预计 2026 年 4 月随版本 9.4 发布全面可用,提供高容量向量搜索和实时上下文检索的生产就绪基础。

了解更多扩展的 Elastic AI 生态系统,下载 Elastic AI 生态系统开发者指南,或在 NVIDIA GTC 上与 Elastic 技术专家交流高性能 AI。访问展位 #3200,观看现场演示,并与 Elastic 专家交流。

本文所述的任何功能或特性发布及时间安排均由 Elastic 全权决定。当前不可用的功能或特性可能无法按时提供,甚至可能不提供。

本文可能使用或提及第三方生成式 AI 工具,其所有权和运营均归各自所有者所有。Elastic 对第三方工具不拥有控制权,并不对其内容、运营或使用承担任何责任,也不对因你使用此类工具可能造成的任何损失或损害负责。使用 AI 工具处理个人、敏感或机密信息时请谨慎。你提交的任何数据可能用于 AI 训练或其他用途。无法保证你提供的信息会被安全或保密保存。在使用任何生成式 AI 工具前,应熟悉其隐私实践和使用条款。

Elastic、Elasticsearch 及相关标记为 Elasticsearch N.V. 在美国及其他国家的商标、徽标或注册商标。所有其他公司和产品名称为其各自所有者的商标、徽标或注册商标。