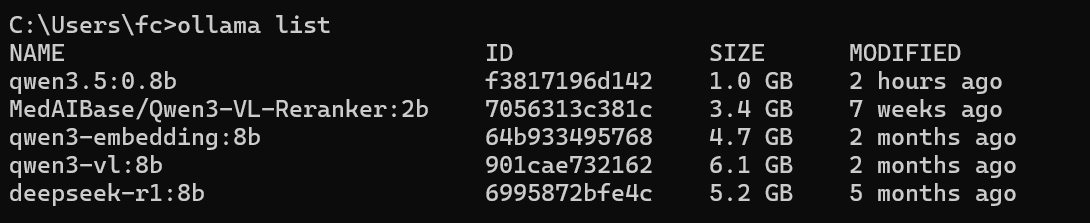

1、需要电脑安装了ollama并且下载了qwen3.5:0.8b的模型,参考我的这篇文章安装和拉取模型:DeepSeek本地部署(ollama、Cherry Studio),注意选择的模型要有tool属性

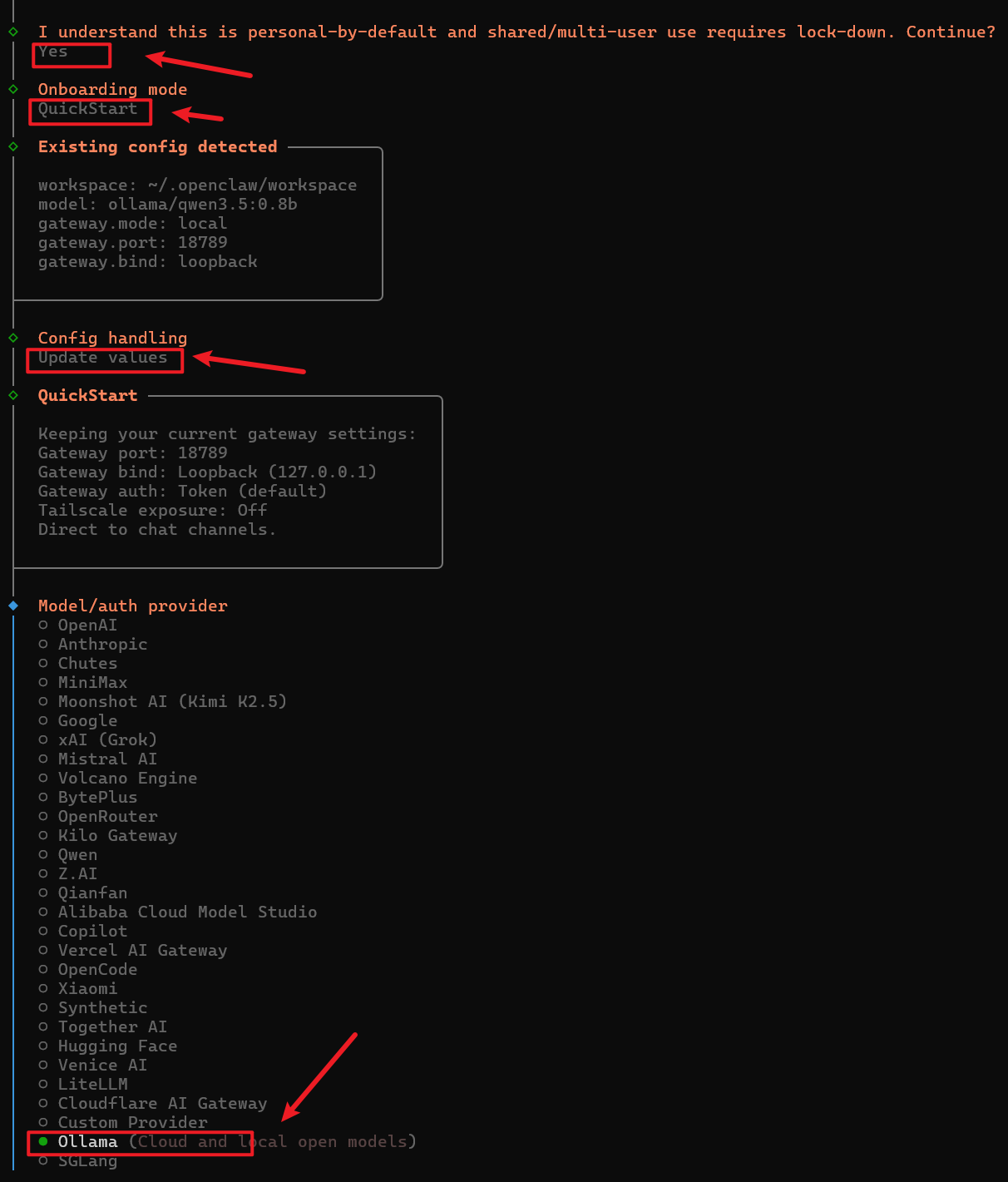

2、在openclaw中,输入下面的命令,进入配置提示页面:

openclaw onboard --install-daemon3、依次进入ollama这个界面,如果没有ollama选项,先别急,点击Skip for now这个选项,下个页面可能就会出现,如果还没出现,卸载了openclaw重新下载(踩坑经验,一直卸载,一直安装,直到有了ollama)

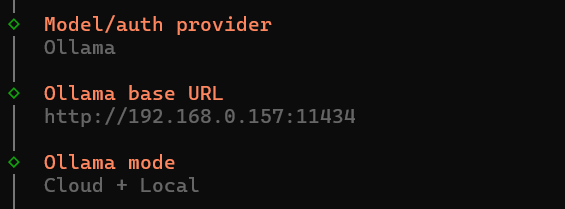

4、接下来会进入ollama的配置界面,前面地址要选自己电脑的IPV4地址,11434是ollama的端口号,要保留。然后选择Cloud+Local

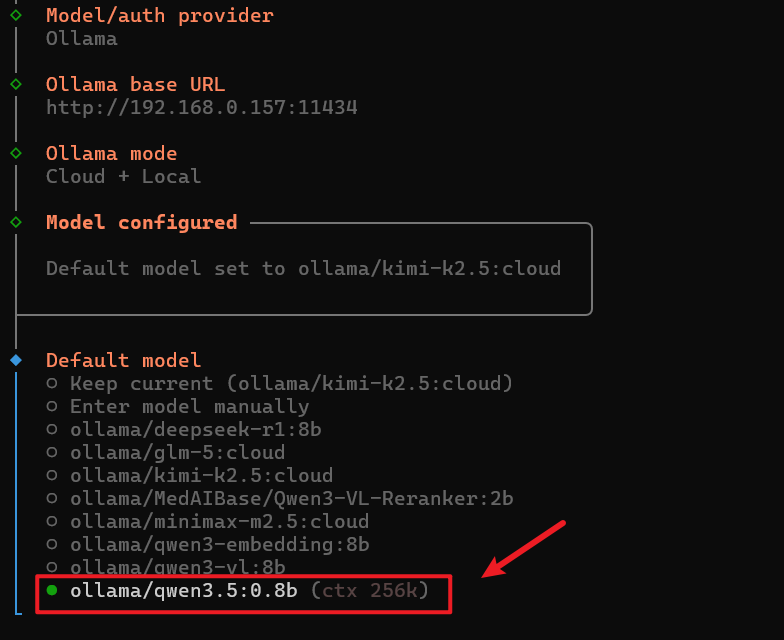

5、接下来就会出现你自己的本地模型(qwen3.5:0.8b),选择它,回车!

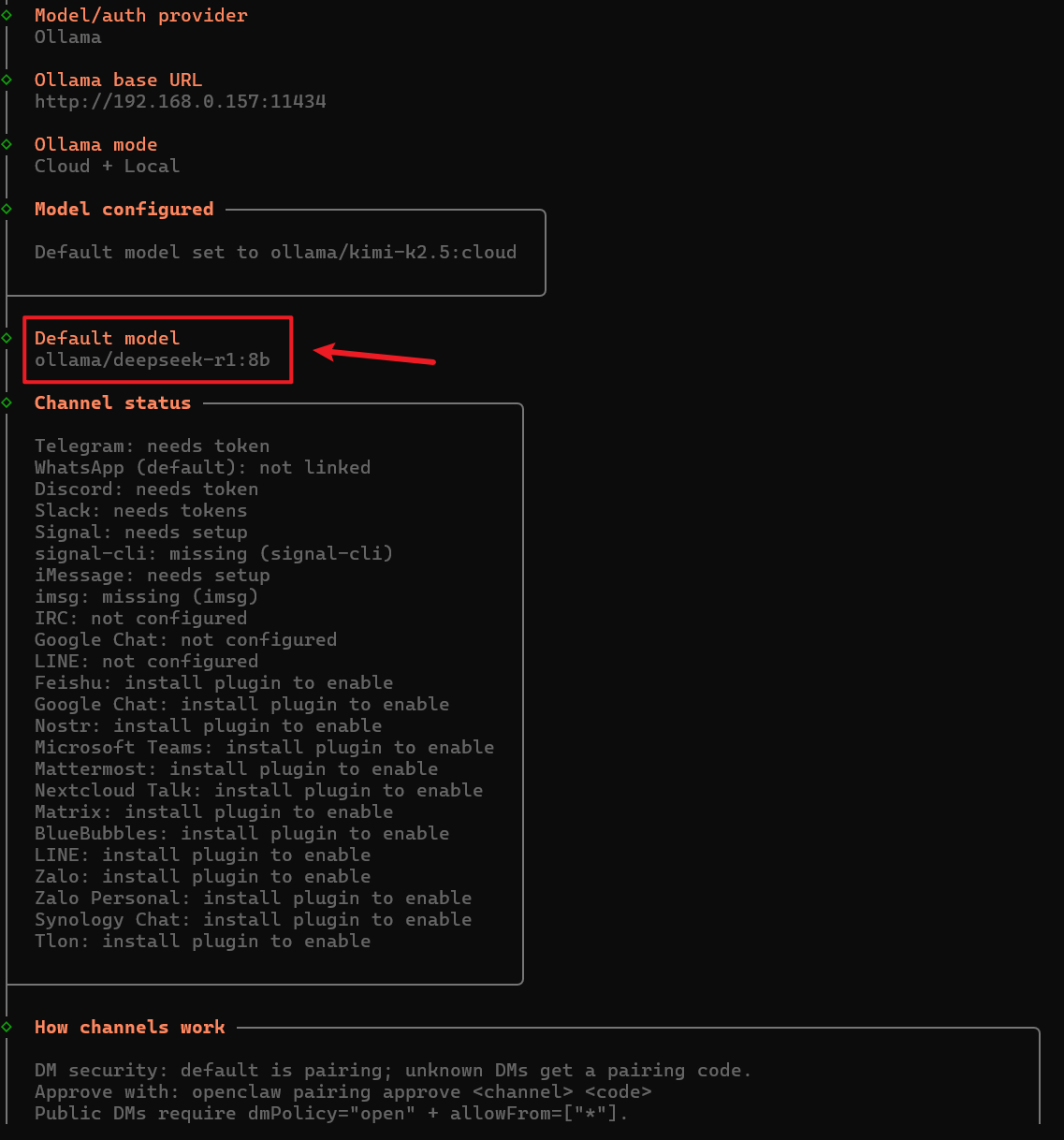

6、有个小细节,需要鼠标拉上去重新看一下Default model这个模型,如果只有你选中的模型,那就是成功的,失败的话,会有一大堆英文。

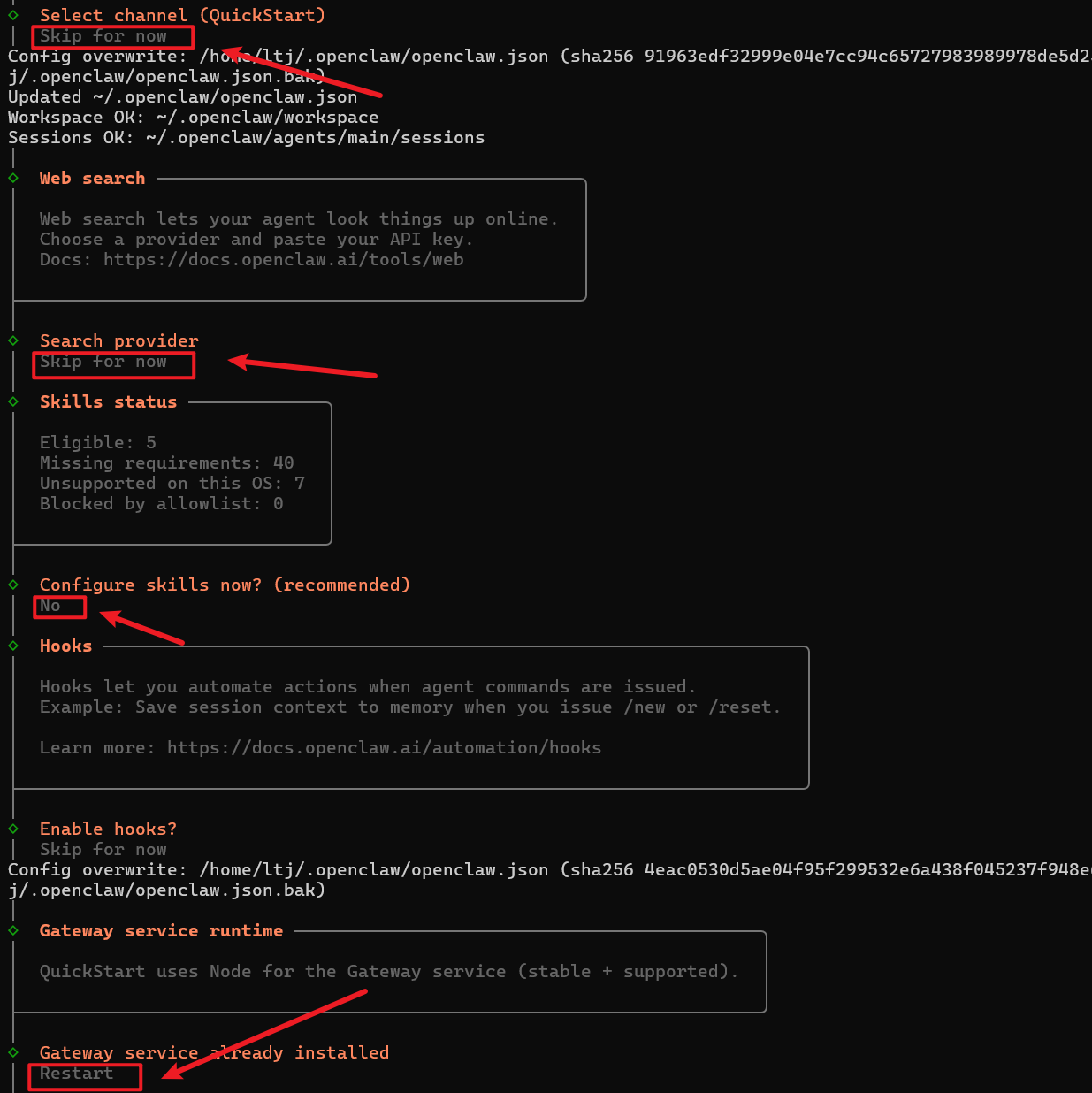

7、接着往下操作(大家应该都会了,就不多说了,跳过,跳过,No,Restart)