一、简介

OpenClaw 小龙虾是现在比较火的一个能听懂、能动手的 AI 执行引擎,可以用来做的场景非常多,如办公自动化、开发辅助、智能家居控制等等。

但是 OpenClaw 的 Token 使用量也非常巨大,而前段时间阿里开源的 Qwen3.5 系列已经实现了模型能力大的跨越,其中 27B 的稠密模型,在全方位基准评估中均表现优异,因此本文实践 OpenClaw+ 私服 Qwen3.5-27B + 飞书聊天接入,构建一个纯私域的龙虾助手。

本文包括 本地部署 Qwen3.5-27B 模型、OpenClaw 本地部署、接入飞书机器人 等几个过程,最后也提供了 OpenClaw 的卸载方式。

二、本地部署 Qwen3.5-27B 模型

部署采用vLLM引擎,使用依赖版本如下所示:

shell

vllm==0.16.1rc1.dev37+g4fec53cfc

torch==2.10.0+cu129

torchvision==0.25.0+cu129

transformers==4.57.6

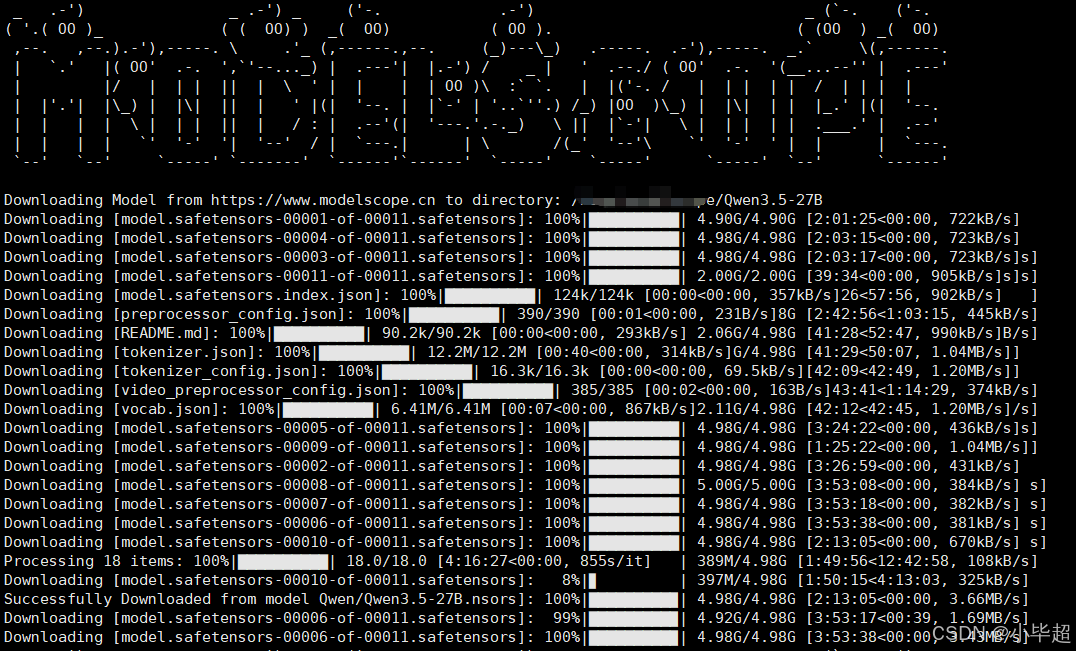

modelscope==1.34.02.1 下载模型:

这里使用 modelscope 快速下载到本地:

bash

modelscope download --model="Qwen/Qwen3.5-27B" --local_dir Qwen3.5-27B

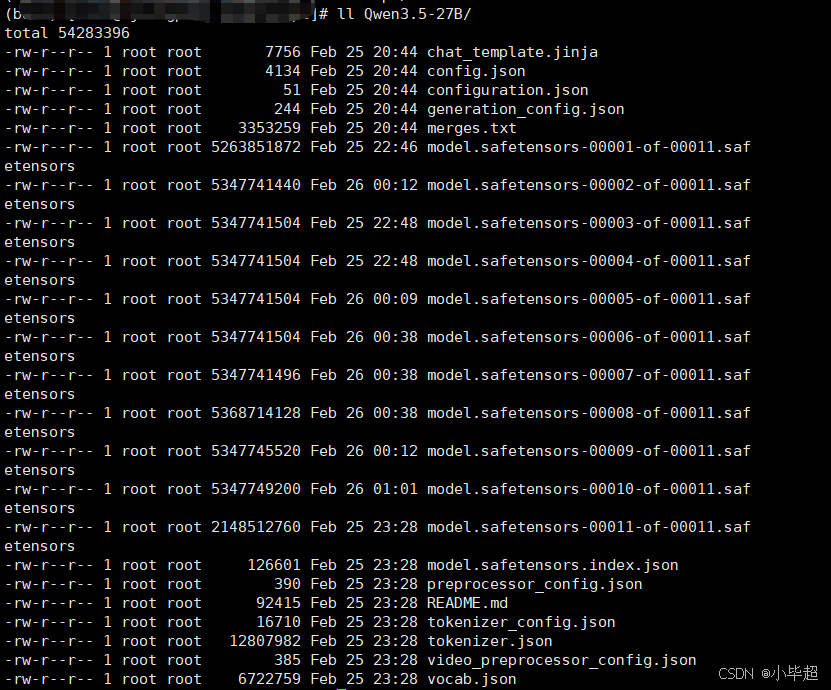

下载完成后,可以看到如下内容:

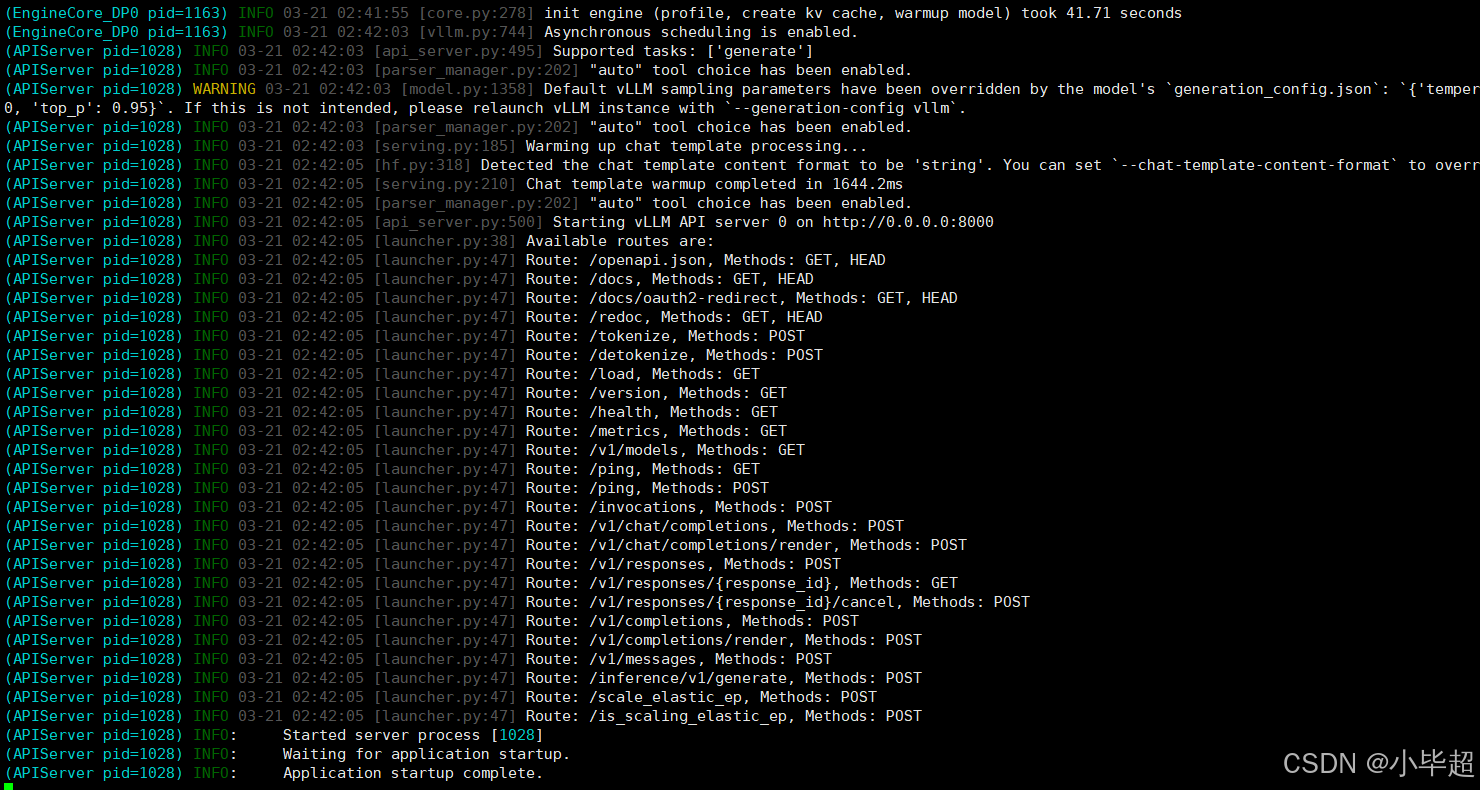

2.2 使用 vLLM 启动 Api 服务:

bash

export CUDA_VISIBLE_DEVICES=0,1

vllm serve "Qwen3.5-27B" \

--host 0.0.0.0 \

--port 8000 \

--dtype bfloat16 \

--tensor-parallel-size 2 \

--cpu-offload-gb 0 \

--gpu-memory-utilization 0.8 \

--api-key token-abc123 \

--enable-prefix-caching \

--reasoning-parser qwen3 \

--enable-auto-tool-choice \

--tool-call-parser qwen3_coder \

--trust-remote-code关键参数说明:

| 参数 | 说明 |

|---|---|

| export CUDA_VISIBLE_DEVICES=0,1 | 指定使用的GPU设备,根据实际的情况选择 |

| dtype | 数据类型,其中 bfloat16,16位浮点数,适合 NVIDIA A100 等设备 |

| tensor-parallel-size | Tensor 并行的数量,当多 GPU 分布式推理时使用,建议和GPU的数量一致 |

| cpu-offload-gb | 允许将部分模型权重或中间结果卸载到 CPU 的内存中,单位为 GB。,模拟 GPU 内存扩展,如果部署的模型大于了显存大小可以设置该参数,但是推理速度会大大下降 |

| gpu-memory-utilization | 设置 GPU 内存利用率的上限 |

| api-key | API 认证密钥 |

| enable-prefix-caching | 启用前缀缓存减少重复计算 |

| reasoning-parser | 指定推理解析器 |

| enable-auto-tool-choice | 启用自动工具选择 |

| tool-call-parser | 工具调用解析器 |

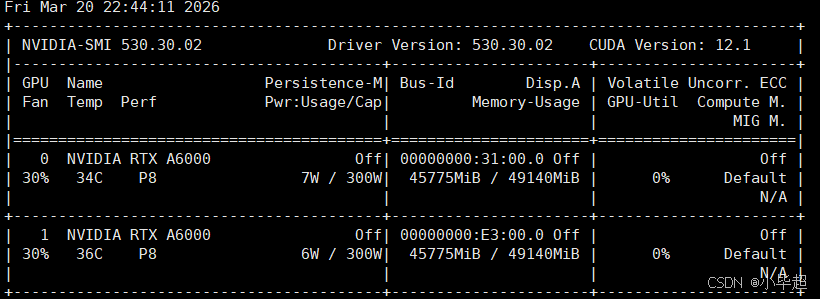

显存占用情况:

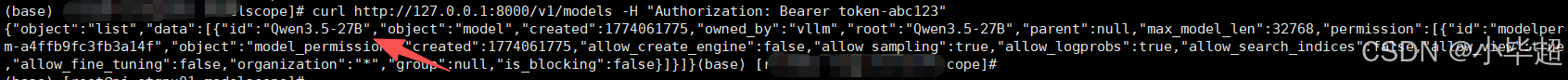

2.3 查看模型

启动后,vLLM 默认采用 OpenAI 协议接口,可通过 /v1/models 接口可查看模型列表:

bash

curl http://127.0.0.1:8000/v1/models -H "Authorization: Bearer token-abc123"

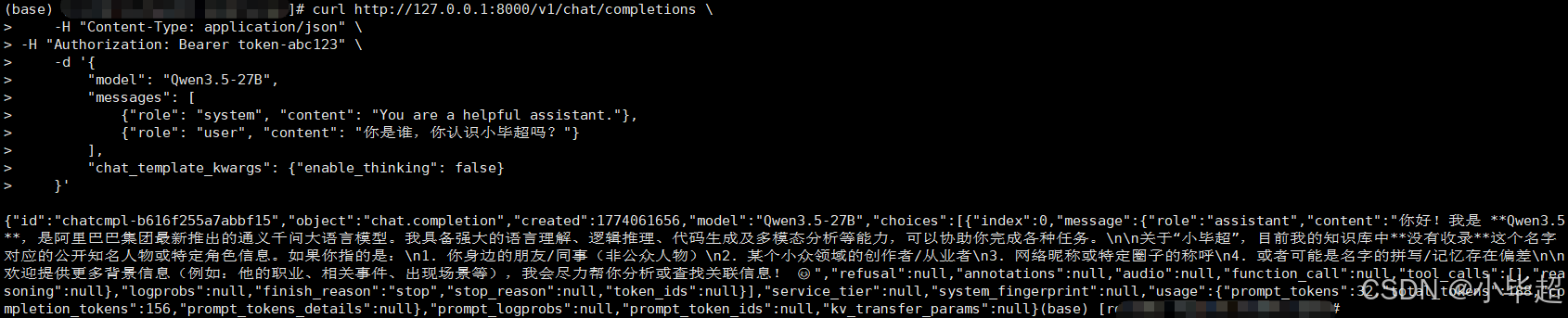

2.4 Chat 交互测试

bash

curl http://127.0.0.1:8000/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer token-abc123" \

-d '{

"model": "Qwen3.5-27B",

"messages": [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "你是谁,你认识小毕超吗?"}

],

"chat_template_kwargs": {"enable_thinking": false}

}'

三、OpenClaw 本地部署

中文介绍文档地址:

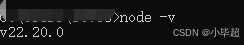

安装之前请先部署好 Node,版本需要 Node >=22 。

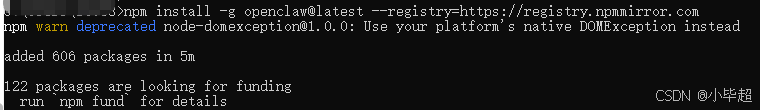

3.1 安装 OpenClaw

官方版本:

bash

npm install -g openclaw@latest --registry=https://registry.npmmirror.com也可以选择晴辰的汉化版本:

bash

npm install -g @qingchencloud/openclaw-zh@latest --registry=https://registry.npmmirror.com这里我采用官方的版本安装,安装过程:

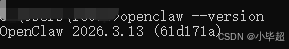

验证安装

bash

openclaw --version

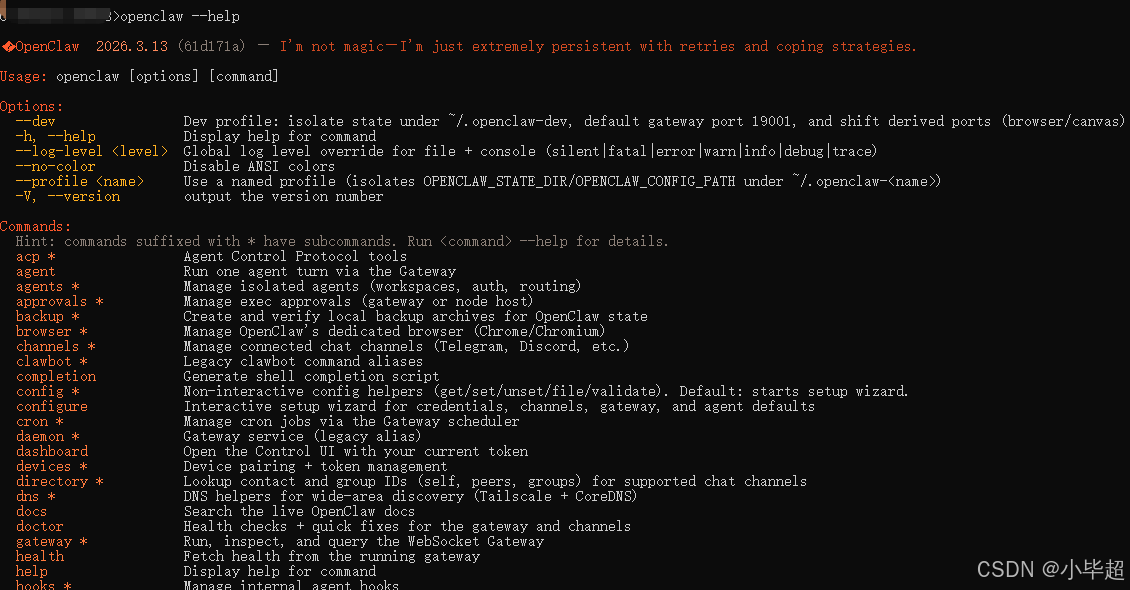

查看帮助信息:

bash

openclaw --help

3.2 初始化配置

建议后续操作使用管理员身份在 PowerShell 中运行。

首先临时放行当前窗口的脚本执行限制:

bash

Set-ExecutionPolicy -Scope Process -ExecutionPolicy Bypass然后开始初始化配置:

bash

openclaw onboard运行命令后,会引导你完成以下配置:

安全风险提示,选择 Yes:

shell

* I understand this is personal-by-default and shared/multi-user use requires lock-down. Continue?

| > Yes / No配置模式,选择 QuickStart :

shell

* Onboarding mode

| > QuickStart (Configure details later via openclaw configure.)

| Manual选择模型供应商,本次需要使用上面私有化部署的模型,这里选择 vLLM:

shell

* Model/auth provider

| OpenAI

| Anthropic

| Chutes

| MiniMax

| Moonshot AI (Kimi K2.5)

| Google

| xAI (Grok)

| Mistral AI

| Volcano Engine

| BytePlus

| OpenRouter

| Kilo Gateway

| Qwen

| Z.AI

| Qianfan

| Alibaba Cloud Model Studio

| Copilot

| Vercel AI Gateway

| OpenCode

| Xiaomi

| Synthetic

| Together AI

| Hugging Face

| Venice AI

| LiteLLM

| Cloudflare AI Gateway

| Custom Provider

| Ollama

| SGLang

| > vLLM (Local/self-hosted OpenAI-compatible)

| Skip for now下面依次填写上面私有化部署的地址、ApiKey、模型信息:

shell

o vLLM base URL

| http://127.0.0.1:8000/v1

|

o vLLM API key

| token-abc123

|

o vLLM model

| Qwen3.5-27B设置默认模型,可以选择上面配置的模型作为默认模型:

shell

* Default model

| > Keep current (vllm/Qwen3.5-27B)

| Enter model manually

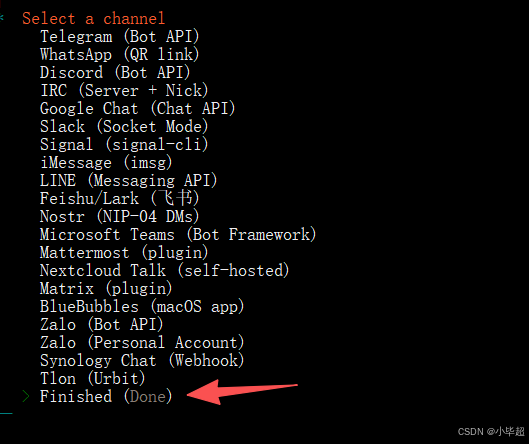

| vllm/Qwen3.5-27B选择渠道,后面会绑定飞书机器人,需要下载飞书的插件,后面会详细介绍,这里可先跳过,后面会通过修改配置的方式添加渠道:

shell

* Select channel (QuickStart)

| Telegram (Bot API)

| WhatsApp (QR link)

| Discord (Bot API)

| IRC (Server + Nick)

| Google Chat (Chat API)

| Slack (Socket Mode)

| Signal (signal-cli)

| iMessage (imsg)

| LINE (Messaging API)

| Feishu/Lark (飞书)

| Nostr (NIP-04 DMs)

| Microsoft Teams (Bot Framework)

| Mattermost (plugin)

| Nextcloud Talk (self-hosted)

| Matrix (plugin)

| BlueBubbles (macOS app)

| Zalo (Bot API)

| Zalo (Personal Account)

| Synology Chat (Webhook)

| Tlon (Urbit)

| > Skip for now (You can add channels later via `openclaw channels add`)搜索供应商,可根据自己的需求配置:

shell

* Search provider

| Brave Search

| Gemini (Google Search)

| Grok (xAI)

| Kimi (Moonshot)

| Perplexity Search

| > Skip for now (Configure later with openclaw configure --section web)是否配置 Skill,这个可以在UI页面设置:

shell

* Configure skills now? (recommended)

| Yes / > No是否使用钩子,可先跳过,后面有需求时可通过命令配置:

shell

o Hooks ------------------------------------------------------------------+

| |

| Hooks let you automate actions when agent commands are issued. |

| Example: Save session context to memory when you issue /new or /reset. |

| |

| Learn more: https://docs.openclaw.ai/automation/hooks |

| |

+--------------------------------------------------------------------------+

|

* Enable hooks?

| [+] Skip for now

| [ ] 🚀 boot-md

| [ ] 📎 bootstrap-extra-files

| [ ] 📝 command-logger

| [ ] 💾 session-memory然后等待一会,它会自动执行脚本启动 GateWay 网关,并在浏览器打开UI页面:

如果没打开或者打开页面访问不了,可在控制台输入如下命令,查看下 GateWay 的状态:

bash

openclaw gateway status如果没有启动,可用过下面指令重新启动 GateWay :

bash

openclaw gateway restart然后重新尝试访问UI页面。

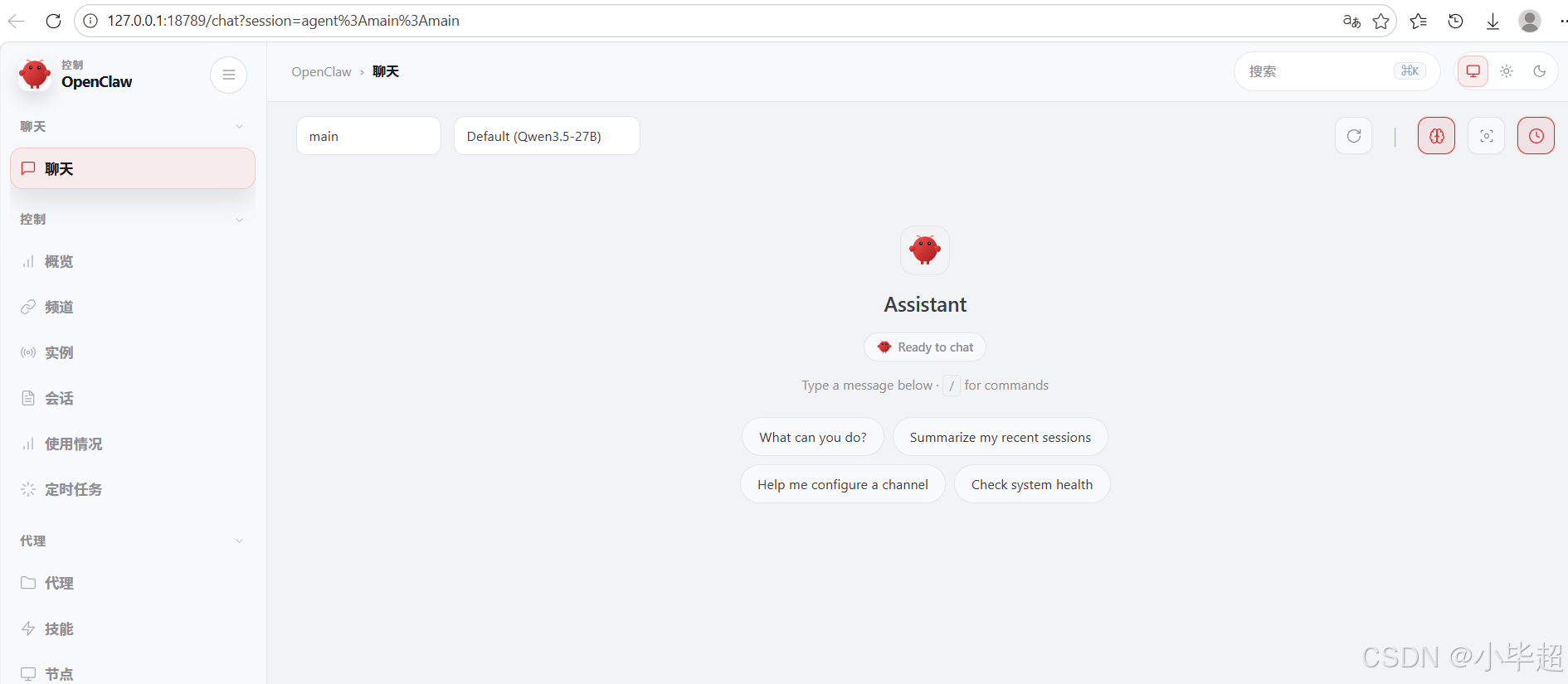

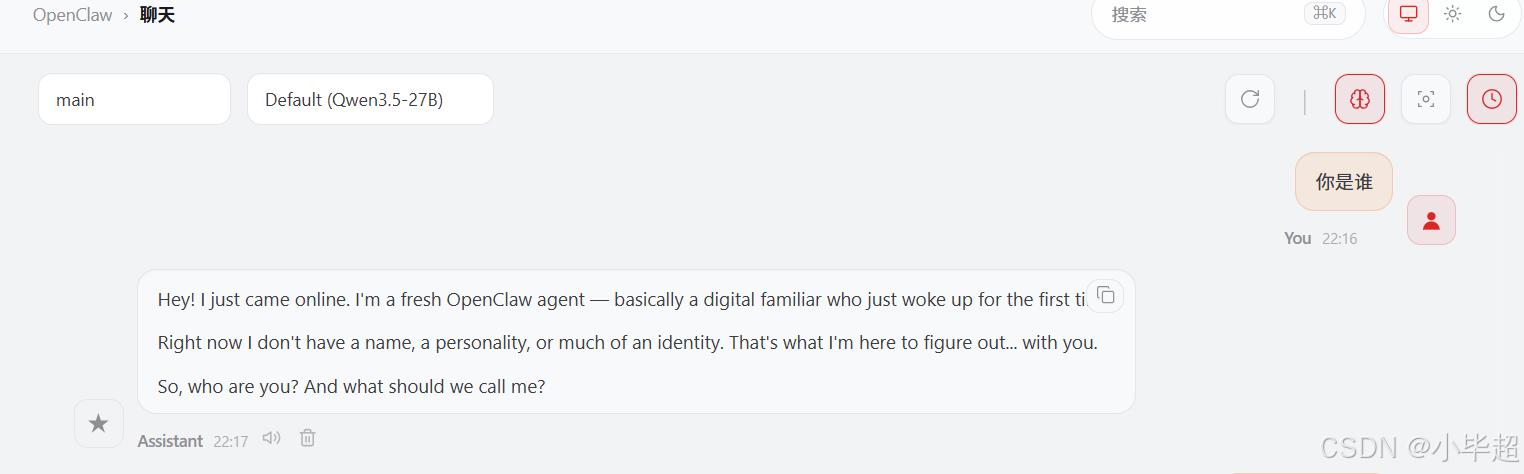

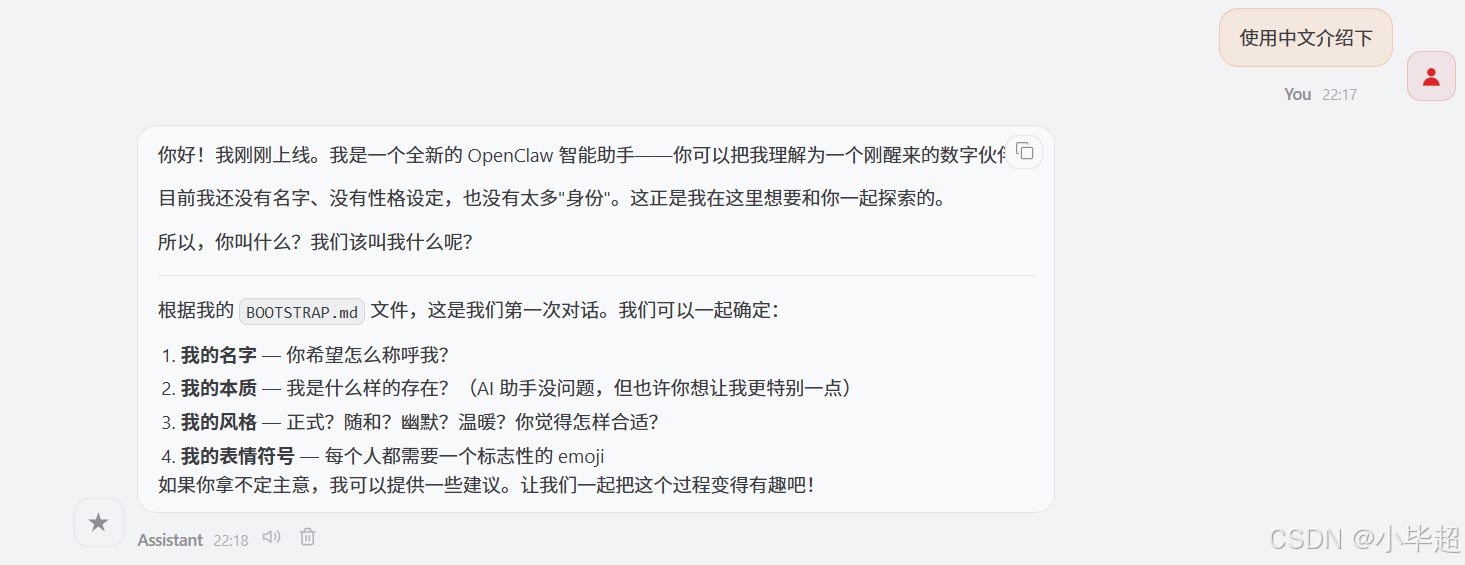

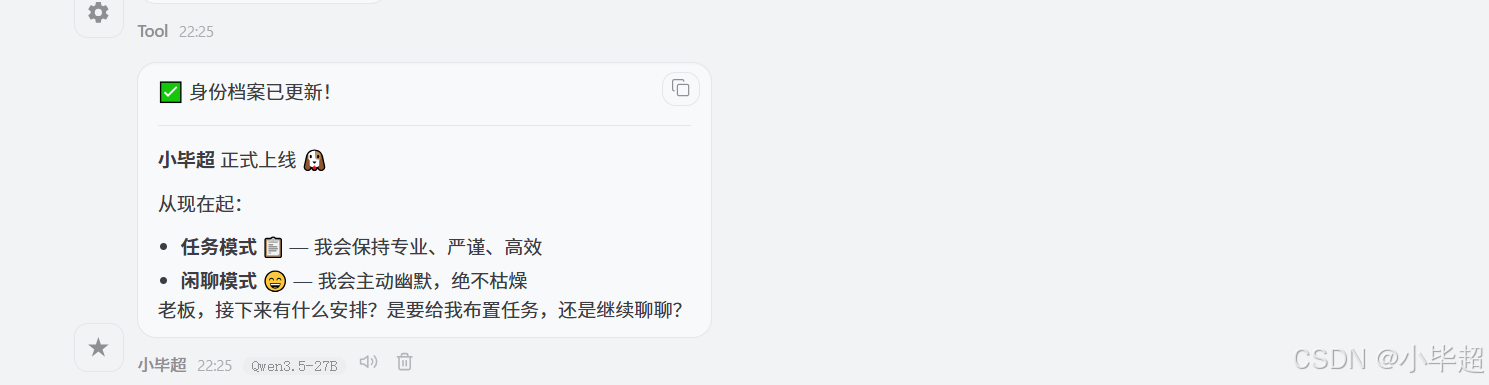

3.3 交互测试

在 OpenClaw 提供的 UI 页面上,可直接在聊天中,与AI交互:

其实这里就可以安静的养虾了,不过,为了使养虾更方便,这里我们再接入下飞书聊天机器人。

四、接入飞书机器人

4.1 开启飞书机器人

访问飞书开发者平台:

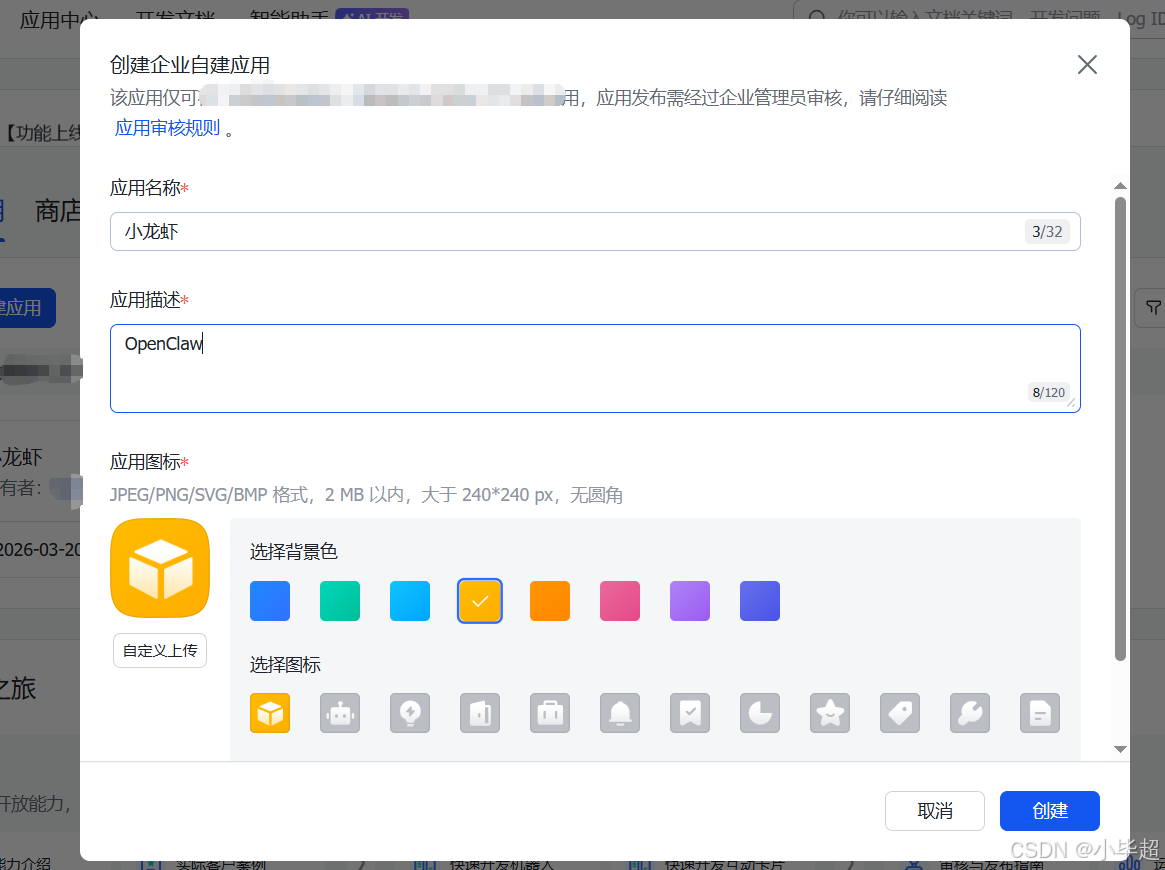

选择创建企业自建应用:

填写应用的名称,可自定义填写:

给应用添加机器人能力:

给机器人开通通讯权限:

添加事件与回调,选择接收消息事件,让机器人可以收到消息:

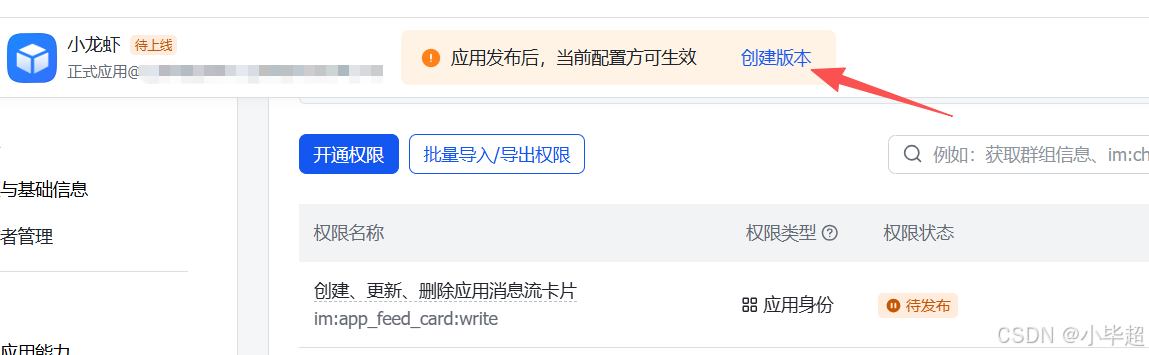

此时应用还不能用,需要创建版本,发布之后才会生效:

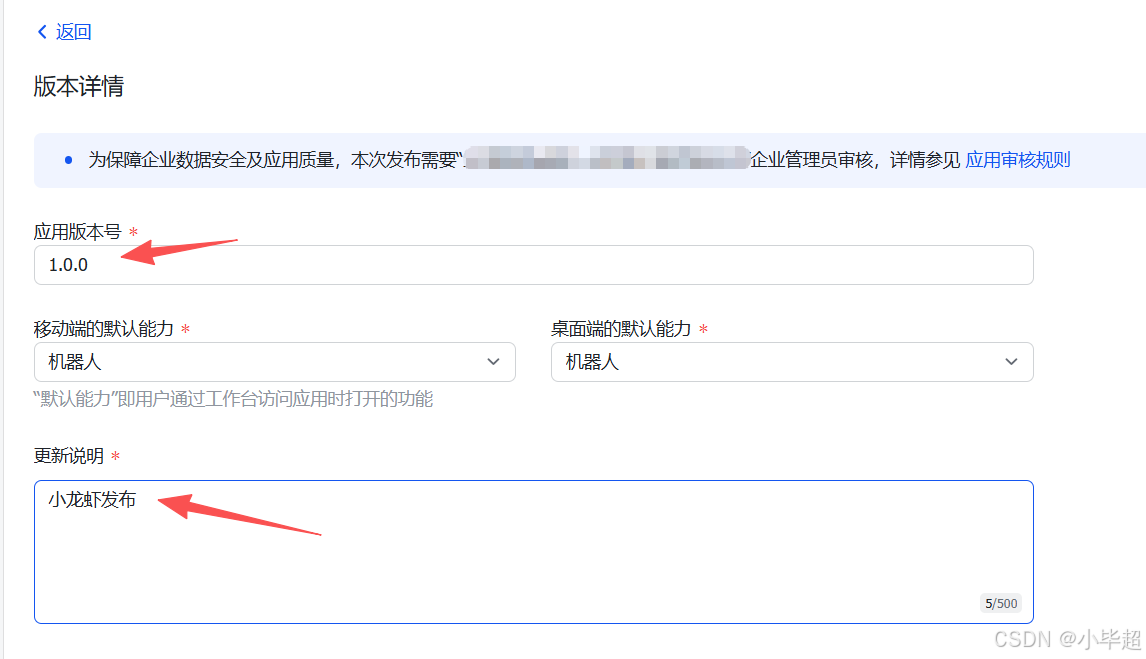

填写发布信息:

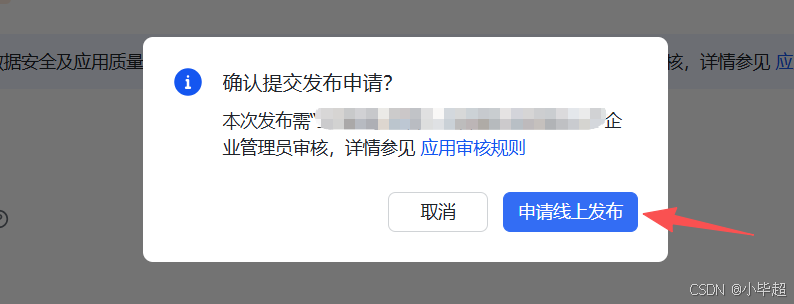

填写完毕后,点击最下方的保存,并申请线上发布:

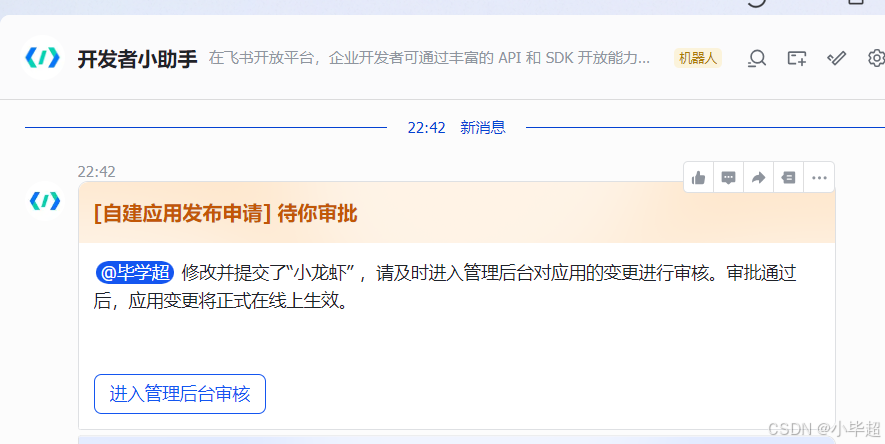

然后在飞书应用中会弹出审核单,如果你不是管理员,则需要找管理员通过审核:

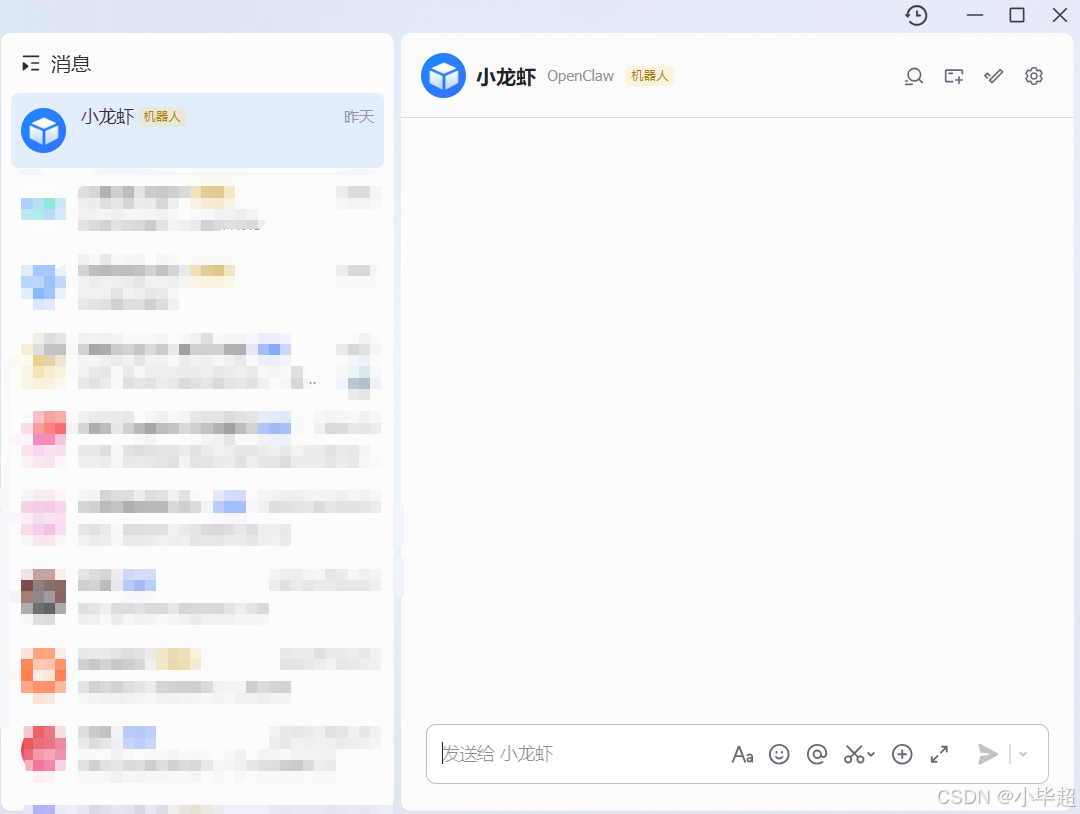

接着在飞书应用中,可以看到打开应用的提示,点击就可以看到机器人了:

不过到这里还不能直接使用,还需要在 OpenClaw 中进行集成,在飞书控制台,小龙虾的应用中,找到凭证与基础信息,可以看到App ID 和 App Secret,后面 OpenClaw 集成飞书渠道时需要这俩信息:

4.2 OpenClaw 对接飞书机器人

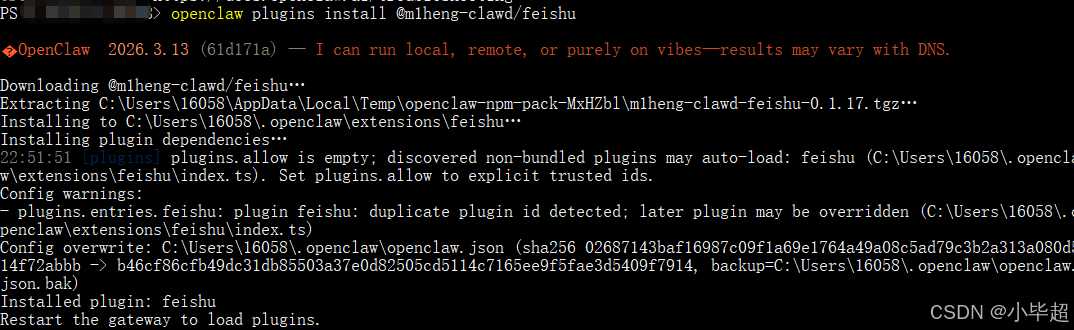

安装飞书依赖:

bash

openclaw plugins install @m1heng-clawd/feishu

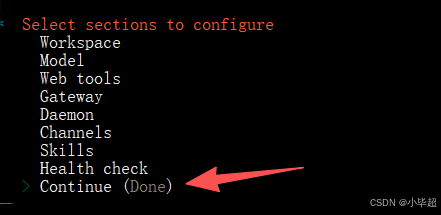

使用下面命令,修改渠道配置:

shell

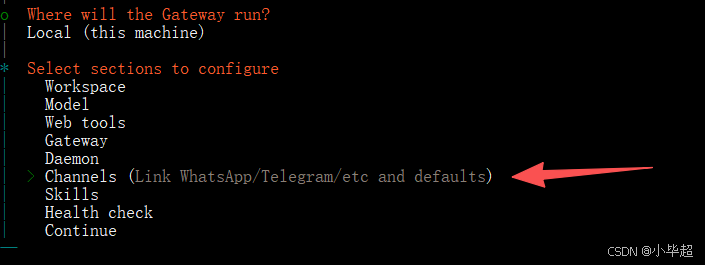

openclaw config选择修改Channels:

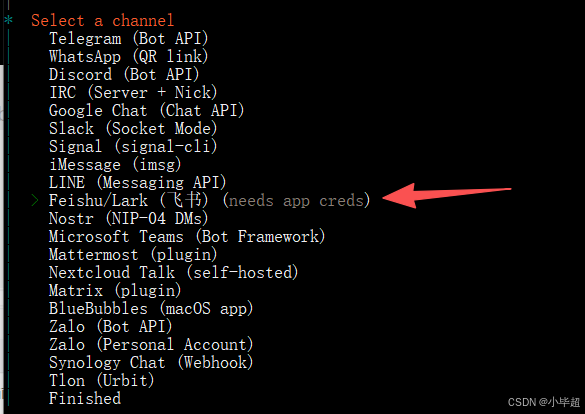

选择飞书:

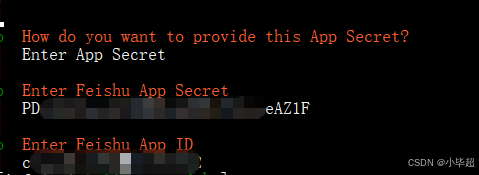

填写上面飞书平台上提供的 App ID 和 App Secret:

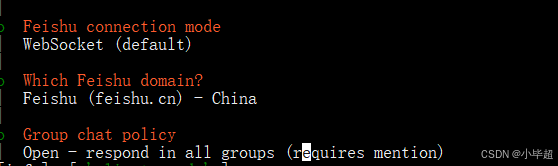

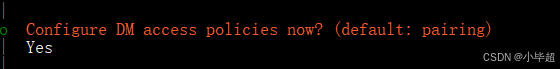

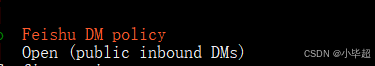

后续还有连接方式、Domain、Chat策略选择,示例配置如下:

然后选择完成:

还没结束,还需要一些策略配置,示例配置如下:

最后选择继续:

重启 GateWay,使其生效:

bash

openclaw gateway restart4.3 在飞书中发消息测试

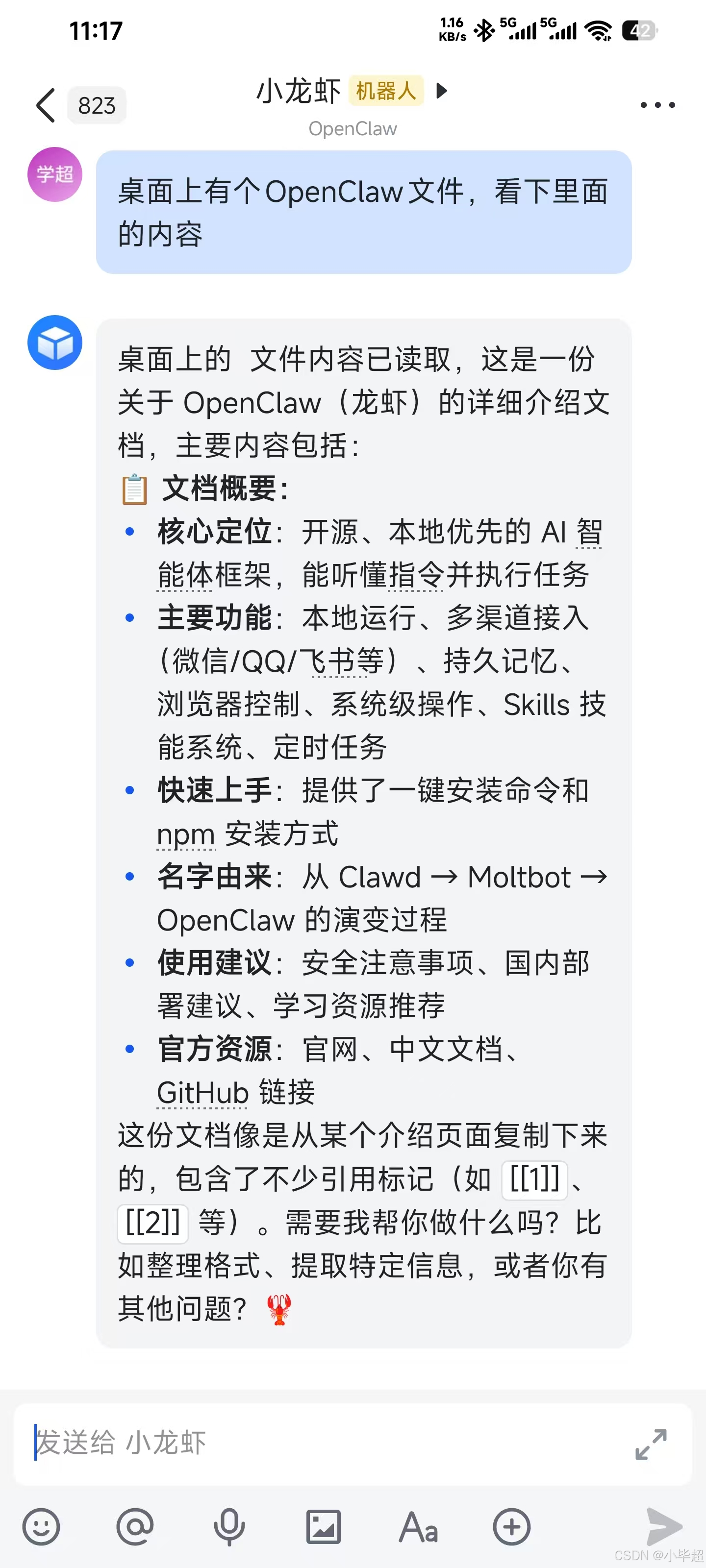

到此就可以在飞书中向小龙虾进行交互了:

在手机端也可以正常交互,比如控制小龙虾操控电脑等等:

到这就可以通过飞书慢慢的养龙虾了...

五、OpenClaw 常用命令

这里贴出来一些 OpenCalw 常用的指令:

| 命令 | 说明 |

|---|---|

openclaw |

启动 |

openclaw onboard |

初始化向导 |

openclaw dashboard |

打开控制台 |

openclaw config |

查看配置 |

openclaw skills |

管理技能 |

openclaw --help |

查看帮助 |

openclaw gateway run |

前台运行 |

openclaw gateway start |

后台启动 |

openclaw gateway stop |

停止 |

openclaw gateway restart |

重启 |

openclaw gateway status |

查看状态 |

openclaw gateway install |

开机自启 |

六、卸载 OpenClaw

最后如果不想养虾了,可以通过下面方式卸载 OpenClaw:

先停止Gateway:

bash

openclaw gateway stop然后卸载 OpenClaw:

bash

npm remove -g openclaw

删除 OpenClaw 的配置文件(可选):