前言

大模型本身具有局限性,1.知识老旧 2.无法联网 3.不能执行实际操作 4.领域知识中深度知识不足。 ---干不了活

AI Agent -- 能力:1.工具调用 2.有专属知识库 3.可以拆解任务。主动执行。大模型+工具。能聊天能做事。

Dify,是一个大模型构造工厂,低代码无代码。100多个主流模型介入,可以满足各种需求。

1.需要安装一个叫docker的应用

这个docker就是一个镜像管理的应用。就是方便环境部署的。

https://www.docker.com/products/docker-desktop/ 这里可以下载。

很不幸啊,实验室电脑撞上版本墙了。这里用已经部署好的宿舍电脑继续实验吧。

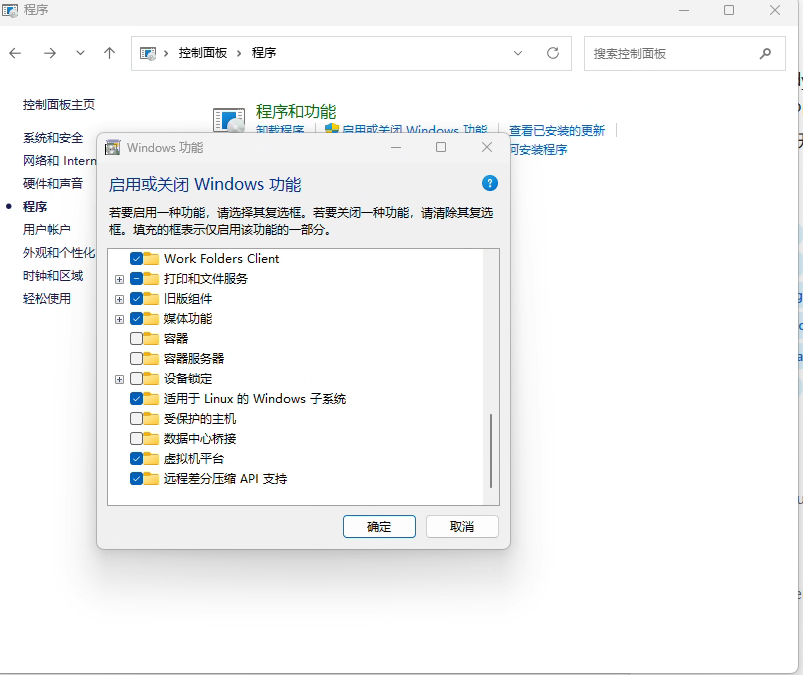

这边需要安装一个WSL,就是一个Linux的编译器吧,不用太过担心对系统的影响。下载好后是这样的:

在系统设置中,需要打开这两项内容

1.适用于Linux的Window子系统

2.虚拟机平台

2.进入dify目录完成环境部署

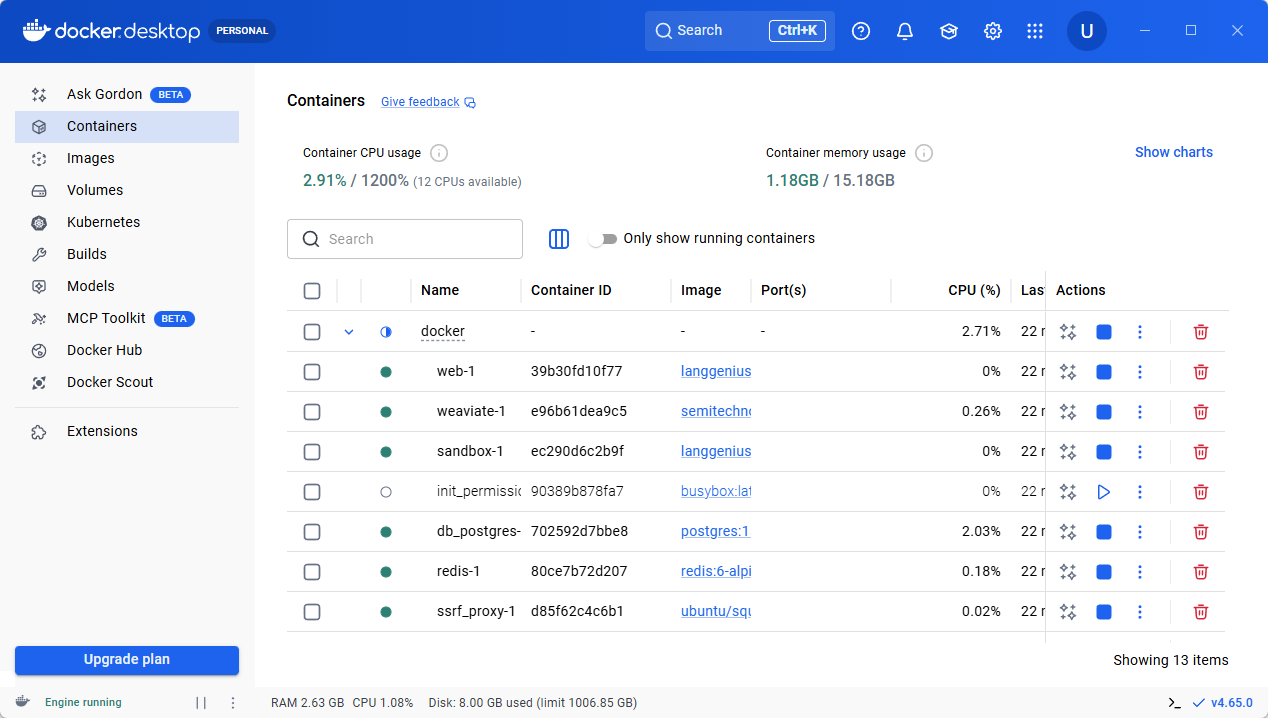

例如我的路径是J:\Dify\dify\docker,在CMD中 cd J:\Dify\dify\docker即可去跳转到dify目录中。然后去cp .env.example .env,这一步是用于重命名环境启动的文件的。然后去docker compose up -d等待环境安装部署即可!!!

安装完之后,可以看到docker中的内容物:下面是正常的样子。

进入dify的网址:http://localhost/signin

3.完成dify部署与安装实现本地大模型与API的调用

本地部署

如果遇到dify转圈圈转很久一直不出现我们想要的东西的时候:

环境重启:1. docker compose down 2. docker compose up -d 执行这两句操作即可。

本地大模型的部署:我们先去下载一个ollma,下载过程很简单,全程点击下一步下一步即可。https://ollama.com/download,在这里选一下是什么系统的下载。

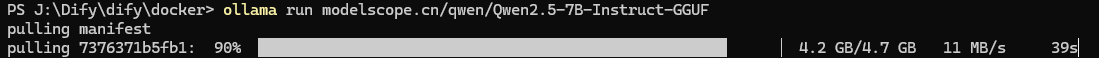

然后进入ollma,我们去下载一些模型,但是ollma的模型库都在外网,国内模型可能一直拉取不下来。所以我们需要通过其他的方式去下载:

ollama run modelscope.cn/qwen/Qwen3-0.6B-GGUF,在命令行中执行这个操作就可以实现ollama模型的国内下载了,因为这个是国内的一个模型库。下载速度蛮快!

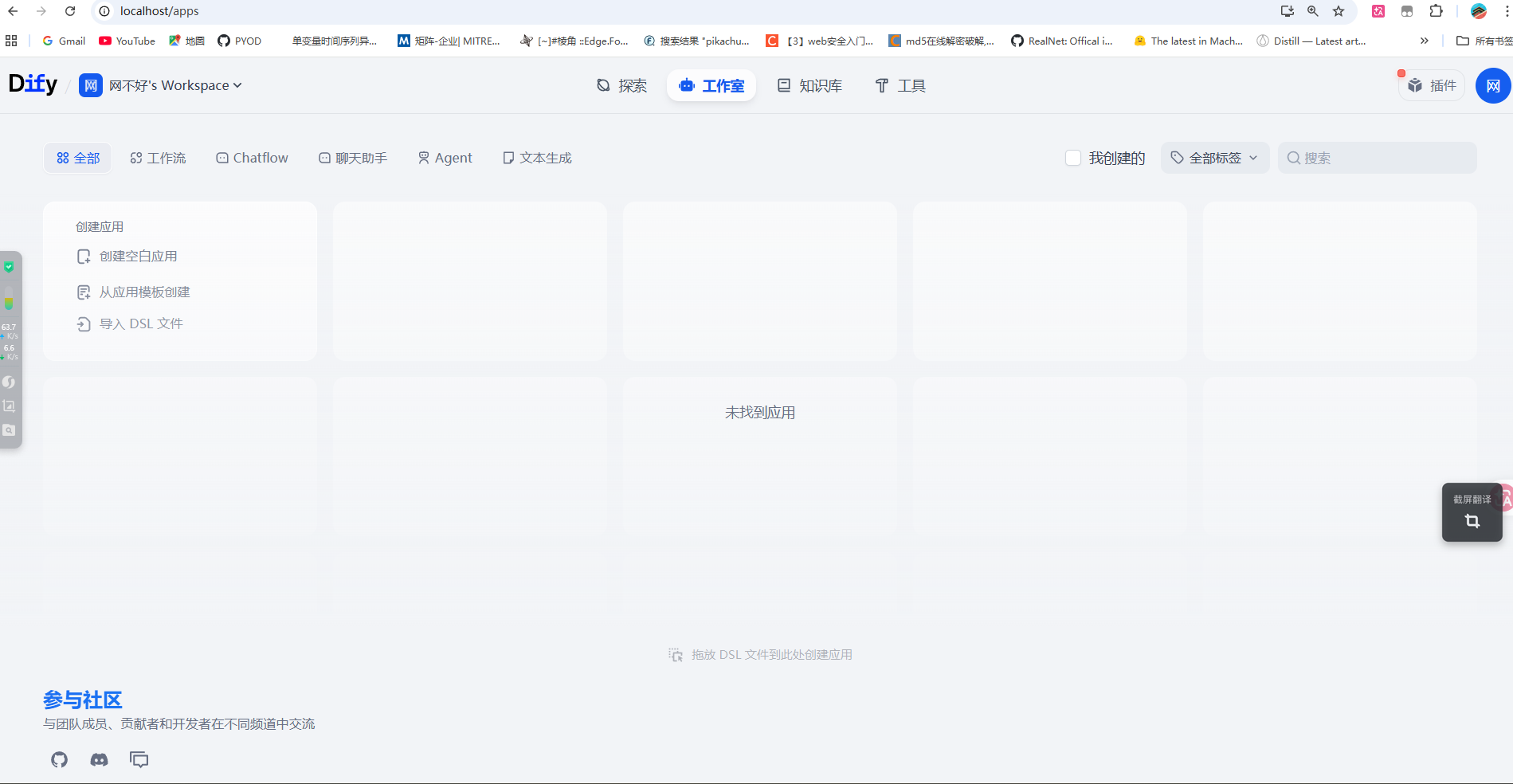

登录进入进入dify后,会有下面这样的图

登录进入进入dify后,会有下面这样的图

下一步点击设置去配置你模型的大脑。

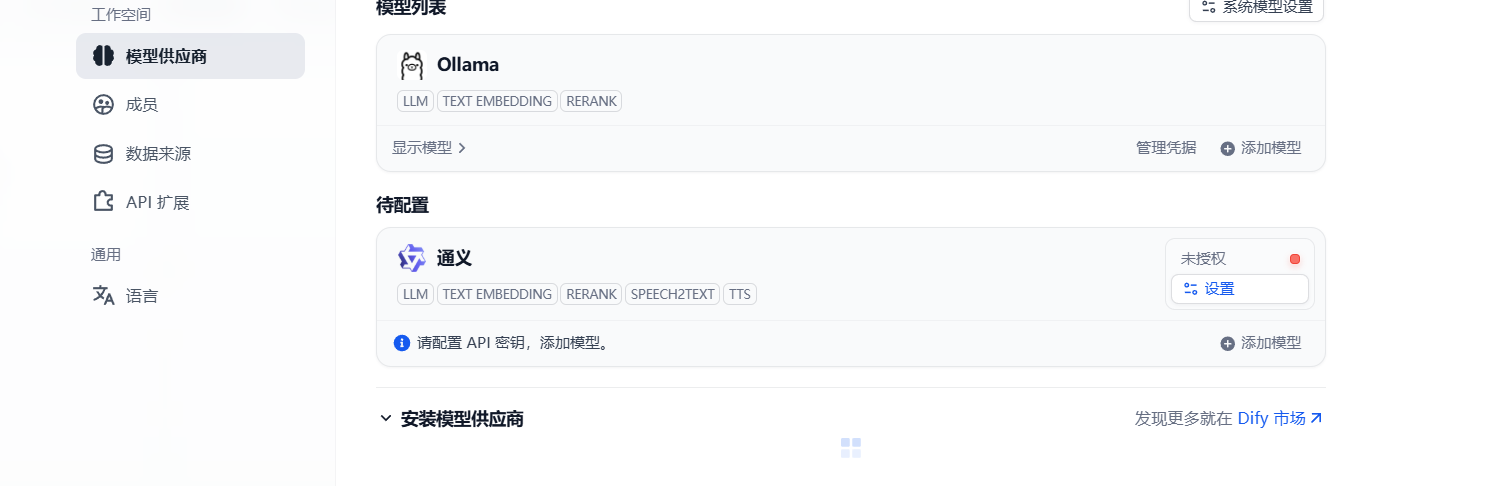

点击其中的模型供应商,我们可以去得到配置文件的地方。去下载ollama。

然后到供应商处去添加模型。模型的名称必须要跟你调用的模型的名称一一对应不然就会报错。

点击创建空白应用,然后就可以去写提示词跟其他的东西了!

然后你就可以得到这样的东西了!

下面我们开始API部署尝试

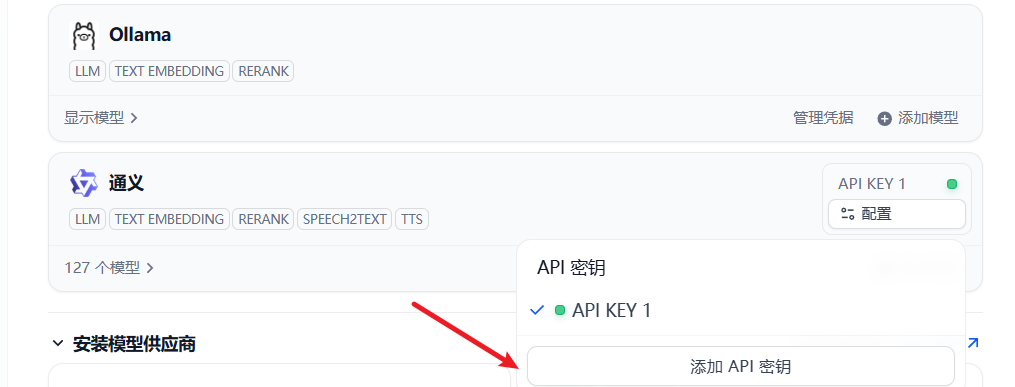

登录阿里云,先去生成一个APIkey,然后回到我们的dify,然后把东西配置上去就可以了。

怎么配置上去呢?需要配置什么呢?在我们刚刚下载ollama的dify扩展组件那边有一个通义千问的扩展,我们也将它下载下来,然后我们去把刚刚得到的阿里云的api加载到API的位置就可以了!

然后现在我们再点击上面的内容,我们就可以去调用千问了,真的是轻轻又松松哈哈哈哈。

整个流程:申请APIkey,下载对应的供应商的插件,然后添加模型的配置与应用。

整个流程:申请APIkey,下载对应的供应商的插件,然后添加模型的配置与应用。