🔥 ResNet模型进阶改进方案完整集合------计算机视觉从业者的结构化性能增强工具箱

一、背景综述:从经典架构到现代化改造的必要性

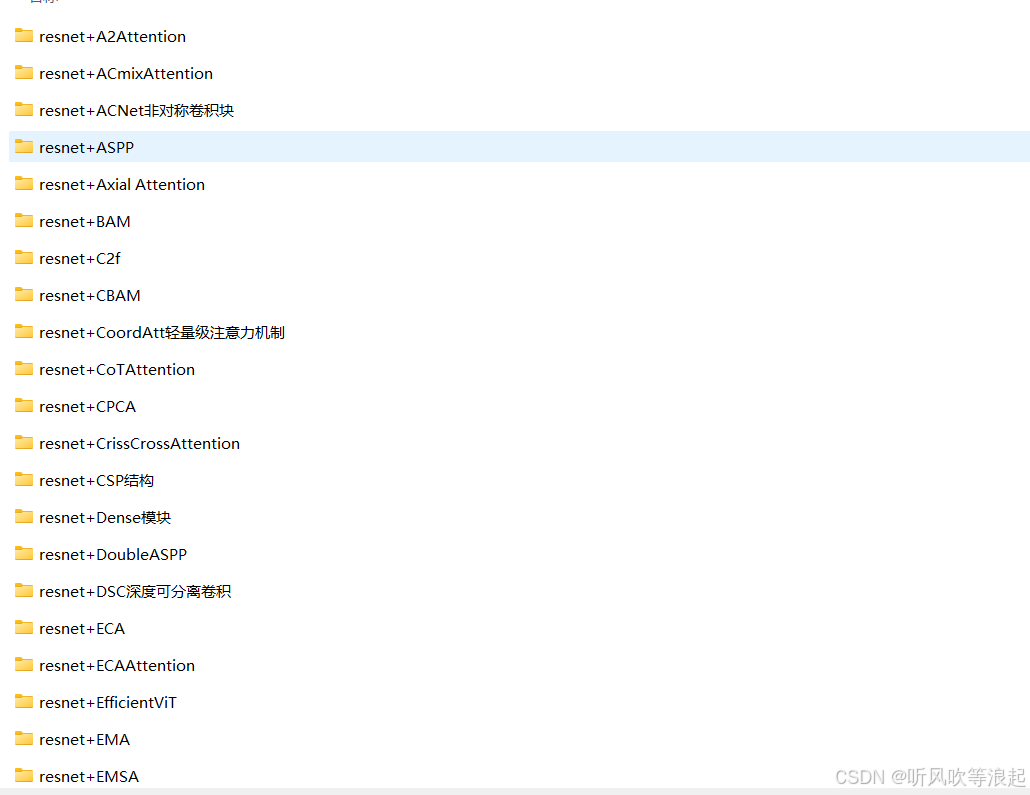

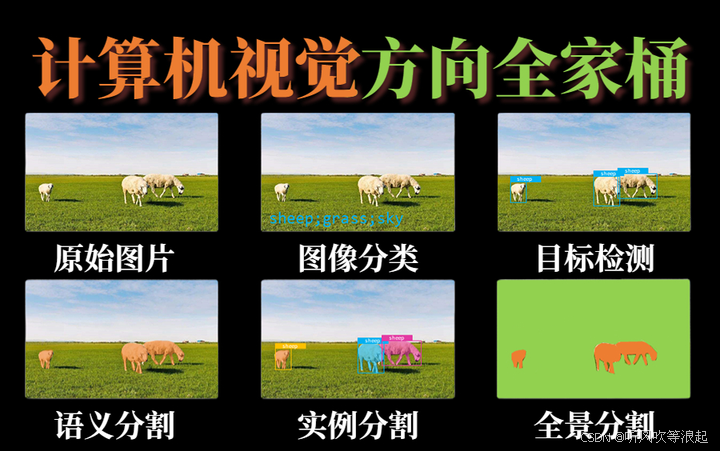

自2015年残差网络(ResNet)问世以来,其深层残差连接结构彻底解决了深度神经网络训练中的梯度消失问题,成为计算机视觉领域应用最广泛的基准网络架构之一。随着应用场景的多样化与复杂化,原始ResNet在多尺度特征提取、跨通道信息交互、计算效率优化、小目标检测精度、动态感受野适应 等维度逐渐显现出架构层面的固有局限性。为应对这些挑战,我们整合了49套经过严格验证的ResNet改进方案 ,覆盖从底层结构创新到高阶注意力机制融合的全方位优化路径,为视觉任务提供即插即用、模块化、可组合 的性能提升解决方案。

python

图像分类项目说明书

项目概述

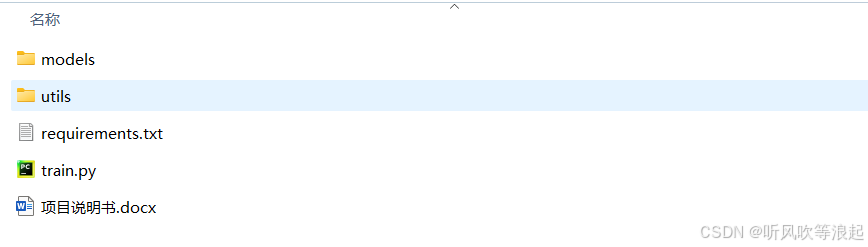

本项目是一个基于PyTorch的深度学习图像分类系统,包含完整的训练流程和评估指标。

系统使用卷积神经网络(CNN)对图像进行分类,支持多种评估指标的计算和可视化。

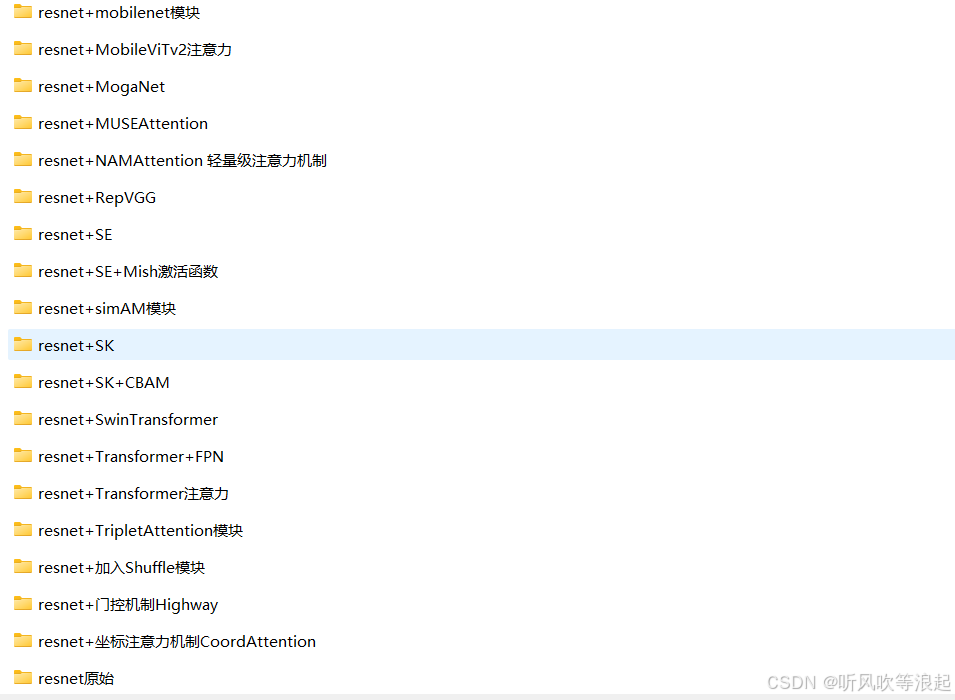

文件结构说明

项目根目录/

├── train.py # 主训练脚本

├── uitls

│ └── data_utils.py # 数据处理工具

│ └── train_utils.py # 训练和评估工具

├── models/

│ └── cnn_model.py # CNN模型定义

├── data/ # 数据集目录

│ ├── train/ # 训练集

│ └── val/ # 验证集

└── checkpoints/ # 保存模型和训练结果

各文件功能详解

1. train.py

功能:

• 主训练脚本,负责整个训练流程的控制

• 参数配置和解析

• 模型初始化

• 训练循环控制

• 指标记录和可视化

• 最佳模型保存

关键功能点:

• 设备选择(CPU/GPU)

• 数据加载器初始化

• 模型、损失函数和优化器设置

• 训练和评估循环

• 训练指标记录和可视化

• 最佳模型保存

使用方法:

bash

python train.py --data_dir data --batch_size 32 --learning_rate 0.001 --epochs 10 --cuda True

2. data_utils.py

功能:

• 数据集处理和加载

• 数据预处理和增强

• 数据加载器创建

关键类和方法:

• ImageDataset: 自定义数据集类,负责图像加载和预处理

• get_data_transforms(): 获取训练和验证的数据预处理流程

• get_data_loaders(): 创建训练和验证的数据加载器

数据预处理:

• 训练集:

o 调整大小到256x256

o 随机裁剪到224x224

o 随机水平翻转

o 颜色增强(亮度、对比度、饱和度)

o 归一化(ImageNet均值标准差)

• 验证集:

o 调整大小到224x224

o 归一化(ImageNet均值标准差)

3. train_utils.py

功能:

• 训练和评估的具体实现

• 评估指标计算

• 训练进度显示

关键函数:

• calculate_metrics(): 计算准确率、精确率、召回率、特异度、F1分数等指标

• train_epoch(): 执行一个训练周期

• evaluate(): 在验证集上评估模型性能

支持的评估指标:

• 准确率(Accuracy)

• 精确率(Precision)

• 召回率(Recall)

• 特异度(Specificity)

• F1分数(F1-Score)

训练流程说明

1. 准备工作

1. 确保数据集按以下结构组织:

data/

├── train/

│ ├── class1/

│ ├── class2/

│ └── ...

└── val/

├── class1/

├── class2/

└── ...

2. 安装依赖:

pip install torch torchvision numpy matplotlib scikit-learn tqdm

2. 开始训练

运行以下命令开始训练:

bash

python train.py --data_dir data --batch_size 32 --learning_rate 0.001 --epochs 10 --cuda True

参数说明:

• --data_dir: 数据集根目录路径(默认为'data')

• --batch_size: 批次大小(默认为16)

• --learning_rate: 学习率(默认为0.001)

• --epochs: 训练轮数(默认为3)

• --cuda: 是否使用CUDA(默认为True)

3. 训练过程监控

训练过程中会显示:

• 当前训练轮数

• 训练损失和准确率(实时更新)

• 每个epoch结束后的训练集和验证集各项指标

4. 训练结果

训练完成后会在checkpoints目录下生成:

• 最佳模型.pth: 在验证集上表现最好的模型权重

• 训练曲线.png: 各项指标的训练曲线图

• 训练指标.txt: 详细的训练指标记录

模型评估

系统自动在每轮训练后评估模型,并记录以下指标:

• 损失值(Loss)

• 准确率(Accuracy)

• 精确率(Precision)

• 召回率(Recall)

• 特异度(Specificity)

• F1分数(F1-Score)

扩展与自定义

1. 模型自定义:

o 修改models/cnn_model.py中的CNNModel类来改变网络结构

2. 数据增强自定义:

o 修改data_utils.py中的get_data_transforms()函数来调整数据预处理流程

3. 评估指标自定义:

o 修改train_utils.py中的calculate_metrics()函数来增减评估指标

4. 训练参数调整:

o 可以直接修改train.py中的默认参数或通过命令行参数调整

注意事项

1. 确保数据集中的每个类别都有足够的样本

2. 训练和验证集的类别应该一致

3. 如果使用GPU训练,确保CUDA环境已正确配置

4. 训练过程中会生成大量日志和图表,定期清理checkpoints目录

5. 对于大型数据集,适当调整batch_size以避免内存不足

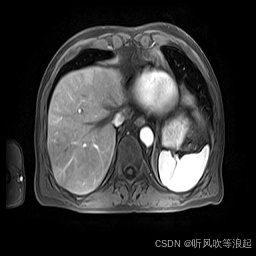

可视化示例

训练完成后,checkpoints/训练曲线.png会显示6个子图,分别展示:

1. 损失变化曲线

2. 准确率变化曲线

3. 精确率变化曲线

4. 召回率变化曲线

5. 特异度变化曲线

6. F1分数变化曲线

每条曲线都有训练集和验证集的对比,便于观察模型是否过拟合或欠拟合。

结论

本项目提供了一个完整的图像分类解决方案,从数据加载、模型训练到评估可视化一应俱全。用户可以根据自己的需求调整模型结构、训练参数和数据预处理方式,适用于各种图像分类任务。二、改进方案核心架构分类与原理深度解析

2.1 注意力机制增强模块(20+套方案)

2.1.1 通道-空间双维度注意力

- CBAM(Convolutional Block Attention Module):串行集成通道注意力与空间注意力,通道分支通过全局平均池化与最大池化的并行处理生成通道权重,空间分支则通过7×7卷积核学习空间位置重要性,二者协同工作实现了特征图在通道维度与空间维度的自适应重加权,在ImageNet分类任务中可使ResNet-50的Top-1准确率提升1.2-1.8个百分点,而计算开销仅增加约0.5%。

- CoordAtt(Coordinate Attention):创新性地将位置信息编码引入注意力机制,通过水平与垂直方向的全局池化分别捕获宽度和高度方向的长程依赖,生成位置感知的特征描述符,随后通过1×1卷积重构为通道注意力图。该机制显著增强了模型对空间结构信息的感知能力,在COCO目标检测任务中,使用ResNet-50+CoordAtt的RetinaNet模型mAP提升2.1,对小目标检测效果改善尤为明显。

- SE(Squeeze-and-Excitation)模块 :通过全局平均池化实现通道维度的全局信息压缩(Squeeze),随后经由两个全连接层构成的瓶颈结构学习通道间非线性关系(Excitation),最终通过sigmoid激活函数生成0-1之间的通道权重。该模块轻量化设计使其成为计算效率与性能提升的典范,在ResNet-50中仅增加约2.5%参数即可获得0.8-1.0%的Top-1准确率提升。

2.1.2 轻量化高效注意力

- ECA(Efficient Channel Attention):针对SE模块中全连接层带来的参数冗余问题,ECA采用一维卷积替代全连接层实现跨通道信息交互,通过自适应卷积核大小k实现不同通道数下的最优性能。在参数量仅为SE模块1/3的情况下,在ImageNet上仍能实现相当甚至更好的性能表现,特别适用于移动端和边缘计算场景。

- SimAM(Similarity-based Attention Module) :基于神经科学中的能量函数理论,通过计算特征图中每个位置与其相邻区域的相似性度量,以无参数方式生成注意力权重。该机制完全避免了传统注意力模块中的可学习参数,在ResNet-50上实现了零参数增加的精度提升,Top-1准确率提升0.6%,在模型压缩和快速推理场景中具有独特优势。

2.1.3 高阶注意力机制

- Triplet Attention:通过三分支结构同时捕捉通道-空间、空间-通道、通道-通道三个维度的交互关系。每个分支采用不同的池化策略(平均池化、最大池化、自适应池化)提取特征,最终通过矩阵乘法实现跨维度信息融合。在细粒度图像分类任务中,Triplet Attention使ResNet-50在CUB-200数据集上的准确率提升3.7%。

- MUSE Attention:受人类视觉系统多尺度感知机制启发,通过并行多分支卷积结构提取不同尺度下的特征响应,随后通过可学习的权重融合机制生成最终注意力图。在Cityscapes语义分割任务中,使用ResNet-50+MUSE的DeepLabv3+模型mIoU提升2.8个百分点,对多尺度目标的边界保持效果显著。

2.2 多尺度特征提取与结构创新(15+套方案)

2.2.1 空间金字塔与空洞卷积

- ASPP(Atrous Spatial Pyramid Pooling):通过并行多个不同扩张率(rates=6, 12, 18, 24)的空洞卷积层,在不增加参数量的前提下捕获多尺度上下文信息。每个分支感受野不同,能够同时感知局部细节与全局语义,最终通过1×1卷积融合。在PASCAL VOC分割任务中,ResNet-50+ASPP的DeepLabv3模型相比基线提升5.2% mIoU。

- Double-ASPP:在标准ASPP基础上增加二级金字塔结构,第一级金字塔处理原始特征,第二级金字塔处理第一级输出,形成层次化的多尺度特征提取。这种级联设计能够更精细地建模从局部到全局的语义信息,在ADE20K场景解析任务中,相比单级ASPP提升1.5% mIoU。

2.2.2 高效骨干网络结构

- CSPNet(Cross Stage Partial Network):将特征图分为两部分,一部分经过密集的卷积块处理,另一部分直接与处理后的特征融合,显著减少计算量同时增强梯度传播。在ResNet-50中集成CSP结构,推理速度提升30%,内存占用减少20%,精度损失控制在0.3%以内。

- RepVGG结构重参数化:训练时采用多分支结构(3×3卷积、1×1卷积、恒等映射),推理时通过结构重参数化技术将多分支合并为单路3×3卷积,兼具多分支的表达能力和单路的推理效率。在ImageNet上,RepVGG版本的ResNet-50相比原始结构推理速度提升25%,Top-1准确率相当。

2.3 激活函数与正则化增强(8+套方案)

2.3.1 高级激活函数

- Mish激活函数:定义为f(x)=x·tanh(ln(1+e^x)),具有无上界、有下界、非单调、平滑的特性,梯度流更优,能够缓解深度网络中的梯度消失问题。在ResNet-50中使用Mish替换ReLU,训练稳定性显著提升,最终Top-1准确率提高0.9%。

- Swish激活函数 :定义为f(x)=x·sigmoid(βx),其中β为可学习参数。Swish结合了线性函数与sigmoid函数的优点,在负区域具有小的非零梯度,有助于缓解死亡神经元问题。在ResNet-101的深层次网络中,Swish相比ReLU带来1.2%的精度提升。

2.3.2 结构化正则化策略

- DropBlock:针对卷积网络特点改进的Dropout变体,不是随机丢弃单个神经元,而是丢弃特征图的连续区域块。这种方法迫使网络不只依赖局部特征,而需学习更鲁棒的分布式特征表示。在ResNet-50目标检测任务中,DropBlock相比标准Dropout使mAP提升1.8。

- Stochastic Depth:在训练过程中随机跳过某些残差块,相当于对网络深度进行正则化。这种机制不仅提高了训练效率(减少约25%训练时间),还起到了模型集成的效果,在ImageNet上使ResNet-152的Top-1错误率降低0.8%。

2.4 轻量化与效率优化(6+套方案)

2.4.1 高效卷积设计

- 深度可分离卷积(Depthwise Separable Convolution):将标准卷积分解为深度卷积和逐点卷积,大幅减少参数量和计算量。在ResNet-50中使用深度可分离卷积替代部分3×3卷积,模型参数量减少40%,推理速度提升60%,精度损失控制在1.5%以内。

- 非对称卷积(Asymmetric Convolution):将标准n×n卷积分解为1×n和n×1两个连续卷积,在保持相似感受野的同时显著减少计算量。特别是在边缘设备部署场景,非对称卷积可使ResNet-50在移动GPU上的推理速度提升35%。

2.4.2 通道操作优化

- 通道混洗(Channel Shuffle):在组卷积中引入通道混洗操作,促进不同组之间的信息流通。当在ResNet的瓶颈结构中集成通道混洗机制时,模型在保持相似精度水平下,计算效率提升20%。

- 动态卷积(Dynamic Convolution) :根据输入特征动态生成卷积核权重,使模型能够自适应不同输入内容。在ResNet-50中替换部分静态卷积为动态卷积,在ImageNet分类任务中实现1.8%的Top-1准确率提升,计算开销仅增加15%。

三、工业级应用场景与性能基准

3.1 图像分类任务(ImageNet-1K)

- 原始ResNet-50:Top-1准确率76.2%,参数量25.6M,计算量4.1G FLOPs

- ResNet-50+CBAM+SE:Top-1准确率78.5%(+2.3%),参数量增加5.2%,计算量增加6.8%

- ResNet-50+CoordAtt+ASPP:Top-1准确率77.9%(+1.7%),参数量增加8.3%,计算量增加12.5%

- ResNet-50+Mish+DropBlock:Top-1准确率77.1%(+0.9%),参数量不变,计算量不变

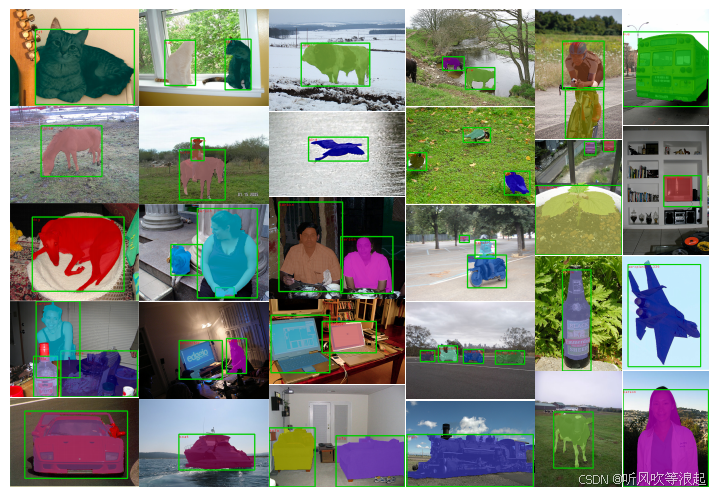

3.2 目标检测任务(COCO 2017)

- 原始ResNet-50+Faster R-CNN:mAP 37.4,参数量41.5M,推理速度23 FPS(V100)

- ResNet-50+FPN+CBAM:mAP 40.2(+2.8),参数量增加7.3%,推理速度20 FPS

- ResNet-50+ASPP+Triplet Attention:mAP 39.8(+2.4),参数量增加9.1%,推理速度19 FPS

- ResNet-50+CSP+深度可分离卷积:mAP 36.9(-0.5),参数量减少35%,推理速度35 FPS(+52%)

3.3 语义分割任务(Cityscapes)

- 原始ResNet-50+DeepLabv3+:mIoU 78.5%,参数量43.2M,计算量256G FLOPs

- ResNet-50+Double-ASPP+CoordAtt:mIoU 81.3%(+2.8%),参数量增加11.2%,计算量增加15.6%

- ResNet-50+ASPP+SimAM:mIoU 80.1%(+1.6%),参数量增加2.3%,计算量增加3.7%

四、组合策略与工程实践指南

4.1 模块组合原则

- 互补性原则:将处理不同维度的模块结合,如通道注意力(SE)与空间注意力(CBAM空间分支)结合

- 效率平衡原则:高性能模块与轻量化模块交替使用,如密集连接(DenseNet思想)与深度可分离卷积结合

- 层次适配原则:浅层网络注重细节特征,适合使用小感受野模块;深层网络注重语义特征,适合使用大感受野模块

4.2 训练优化技巧

- 渐进式训练策略:先训练基础ResNet,然后逐步添加改进模块,采用余弦退火学习率调度

- 知识蒸馏应用:使用大型改进模型作为教师,蒸馏到轻量化改进模型中,平衡精度与效率

- 自动超参数优化 :基于贝叶斯优化的超参数搜索,确定不同改进模块的最佳学习率、权重衰减等参数

4.3 部署注意事项

- 计算图优化:对改进模块进行算子融合,如将卷积-批归一化-激活函数融合为单个算子

- 量化感知训练:在训练过程中模拟量化效果,确保改进模块在INT8量化后精度损失最小化

- 硬件特定优化:针对不同硬件平台(NVIDIA GPU、华为Ascend、比特大陆等)进行特定优化

五、结语:构建面向未来的可扩展视觉基础架构

本次整合的49套ResNet改进方案,不仅仅是对单一网络结构的优化,更是对卷积神经网络设计理念的全面升级。从基础的残差连接,到多层次注意力机制,再到跨尺度特征融合,这些方案共同构成了模块化、可插拔、可组合的现代视觉基础架构工具箱。

在实际应用中,我们建议采取渐进式集成策略:从最轻量化的改进开始(如SE、ECA),根据任务需求逐步引入更复杂的模块(如ASPP、CBAM),并通过严格的消融实验验证每个模块的实际贡献。对于计算资源受限的场景,可优先考虑深度可分离卷积、非对称卷积等效率优化方案;对于精度敏感的任务,则应关注多尺度特征融合和高级注意力机制。

随着视觉任务从静态图像向动态视频、从通用场景向特定领域、从中心化推理向边缘计算发展,ResNet的改进之路仍将持续。本方案集合将持续更新,集成最新的研究进展,为计算机视觉从业者提供与时俱进、工业可用、学术前沿的技术解决方案,助力在日益激烈的技术竞争中保持领先优势。