在步入 Web3 智能合约开发的初期,我们通常会从最基础的资产交互功能入手。本文将结合实际代码与架构原理,带大家梳理 Solidity 中最简单的收款合约(FundMe)的编写逻辑,并深入探讨区块链如何跨越"孤岛"去获取现实世界数据的核心机制------预言机(Oracle)。

笔记来自:17小时最全Web3教程:ERC20,NFT,Hardhat,CCIP跨链_哔哩哔哩_bilibili,十分推荐大家学习该课程!

目录

[一、 FundMe:极简收款合约的构建逻辑](#一、 FundMe:极简收款合约的构建逻辑)

[二、 确定性系统的困境与预言机的引入](#二、 确定性系统的困境与预言机的引入)

[三、 Chainlink 与去中心化数据喂价网络](#三、 Chainlink 与去中心化数据喂价网络)

[1. 去中心化预言机网络(DON)](#1. 去中心化预言机网络(DON))

[2. Data Feed 喂价架构](#2. Data Feed 喂价架构)

一、 FundMe:极简收款合约的构建逻辑

在编写智能合约时,实现资金的收取是最初步的基础操作。我们可以编写一个最简单的收款函数。代码结构示例如下:

javascript

contract FundMe {

// 只有外界可调用------external,payable表示该函数可以用于接收原生通证

function fund() external payable {

}

}代码中,有两个关键字发挥了决定性作用。external关键字表明该函数专供外部网络或其他合约调用。payable则是一个非常核心的修饰符,它直接赋予了该函数接收以太坊原生通证(如 ETH)的能力。

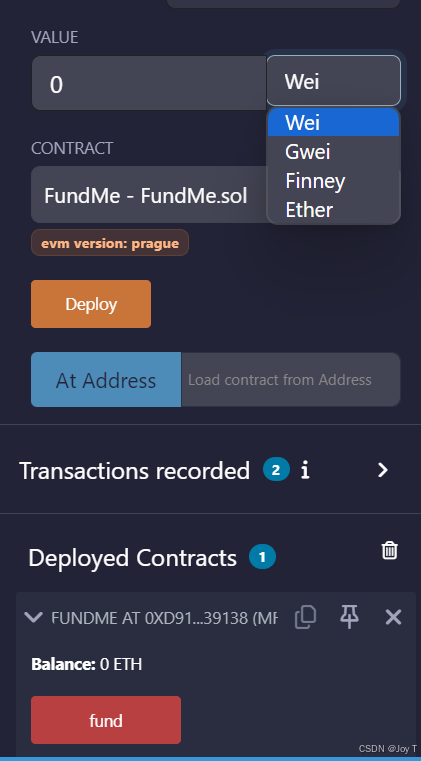

在部署并测试这类转账功能时,我们需要准确掌握以太坊网络中的货币单位换算关系。从微观到宏观,常见的单位依次为Wei、Gwei、Finney 和 Ether。它们之间呈现严格的量级递增关系,具体表现为 9 次方、6 次方和 3 次方的阶梯式跳跃:

在测试环境(如 Remix)中,我们可以直接通过设置面板中的 Value 数值并选择对应的单位,点击 fund 按钮即可尝试对具备收款功能的合约发起转账测试。

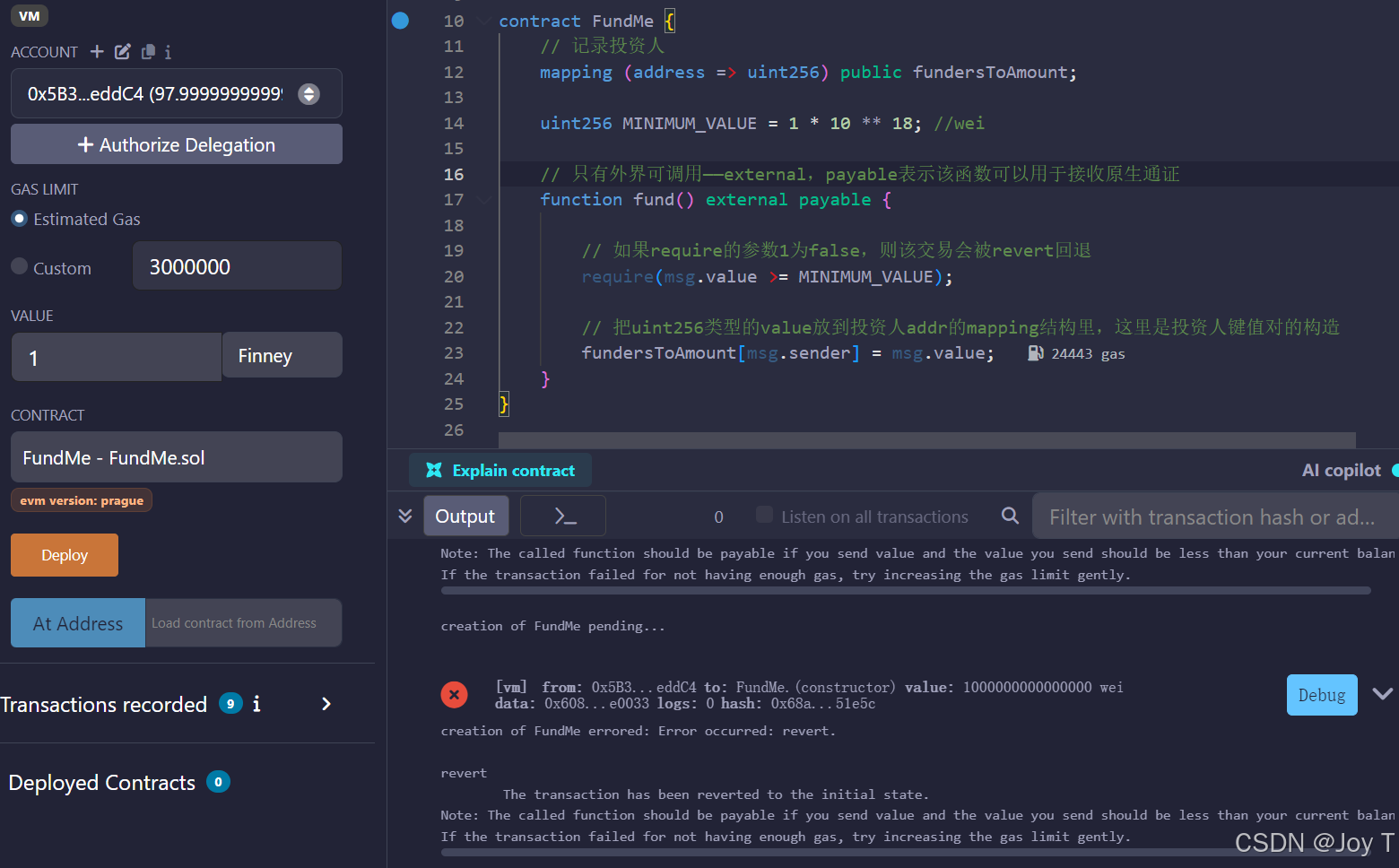

在真实的业务场景中,我们往往需要对投资行为设定最低额度限制。此时,我们会使用**require 关键字** 在函数内部进行条件拦截。

如图,当调用者转入的金额未达到预设的最小值时,require 会触发 revert 回退机制,系统会强行终止当前交易并撤销所有已经发生的状态变更,以保障合约逻辑的严密性。

二、 确定性系统的困境与预言机的引入

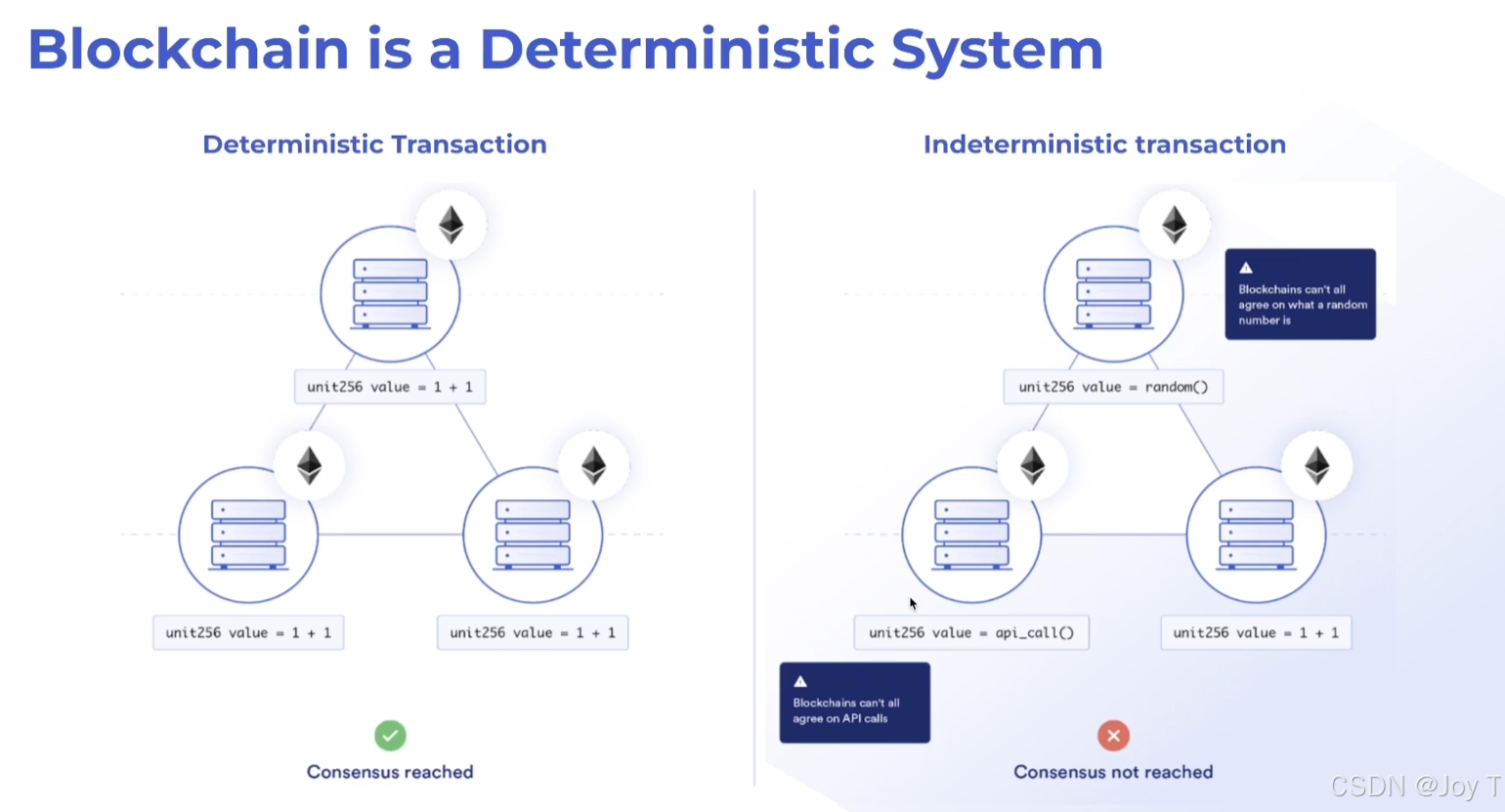

智能合约的运行环境被设计为高度的确定性系统。

非确定性交易(例如获取外部的实时天气或金融资产汇率)由于其结果处于动态变化之中,区块链网络内的各个节点无法对其达成一致的共识。区块链系统需要依靠第三方实体主动将这些非确定性数据打包写入合约内部,合约自身根本无法向外部世界主动发起网络请求去获取数据。

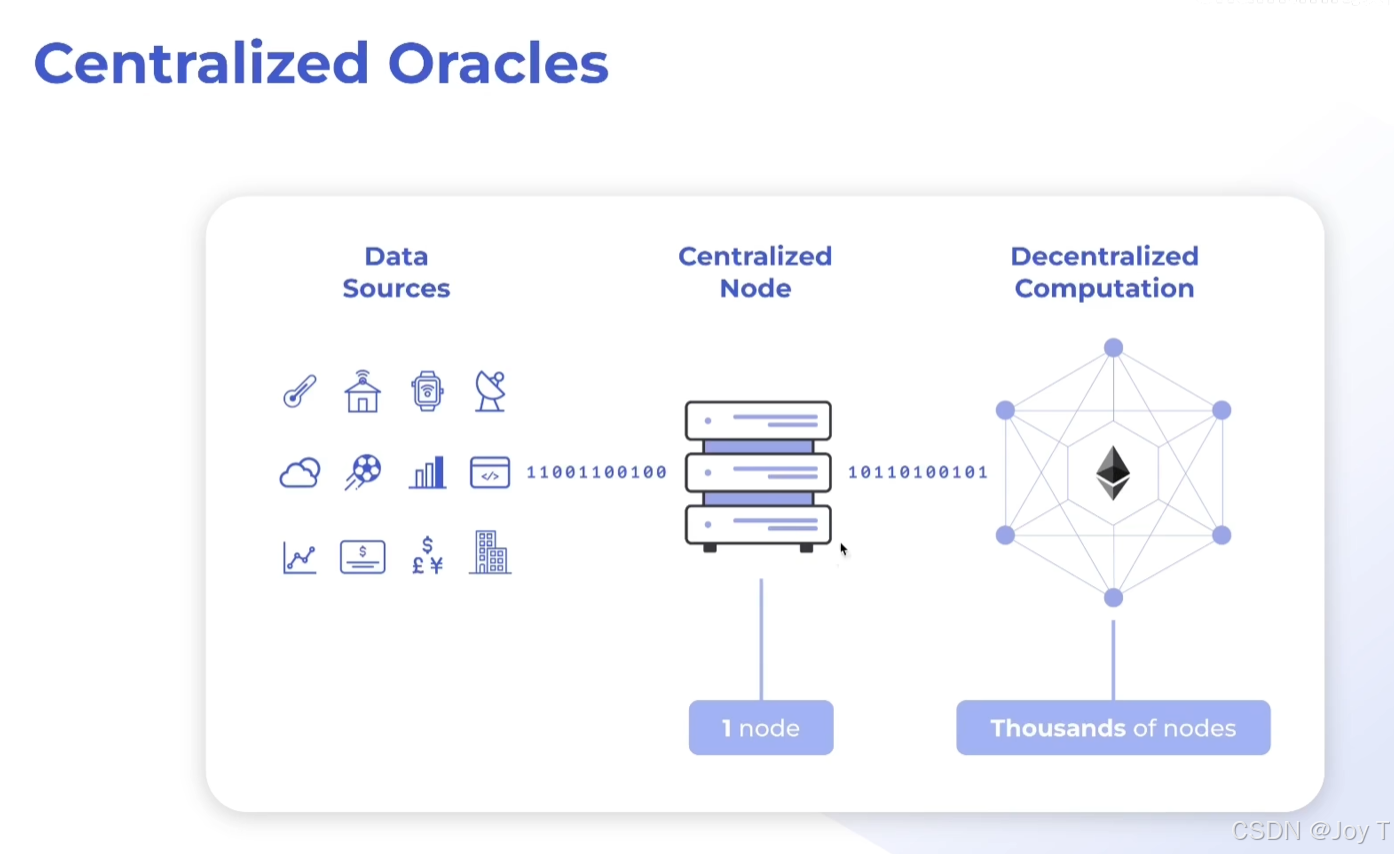

为了建立这种链上与链下的连接,业界最初采用了中心化的预言机方案。这种方案会在链下运行一个独立的服务器集群或单节点,持续监听链上合约发出的数据请求信号。一旦捕捉到请求,该服务器便会根据业务需求从外部 Web2 接口获取相关数据,并将其主动写入区块链。

这种单点架构存在致命的脆弱性。由于数据获取的中间环节高度中心化,单个服务器节点极易发生宕机或被恶意篡改,导致输入合约的数据源可信度极低。

三、 Chainlink 与去中心化数据喂价网络

1. 去中心化预言机网络(DON)

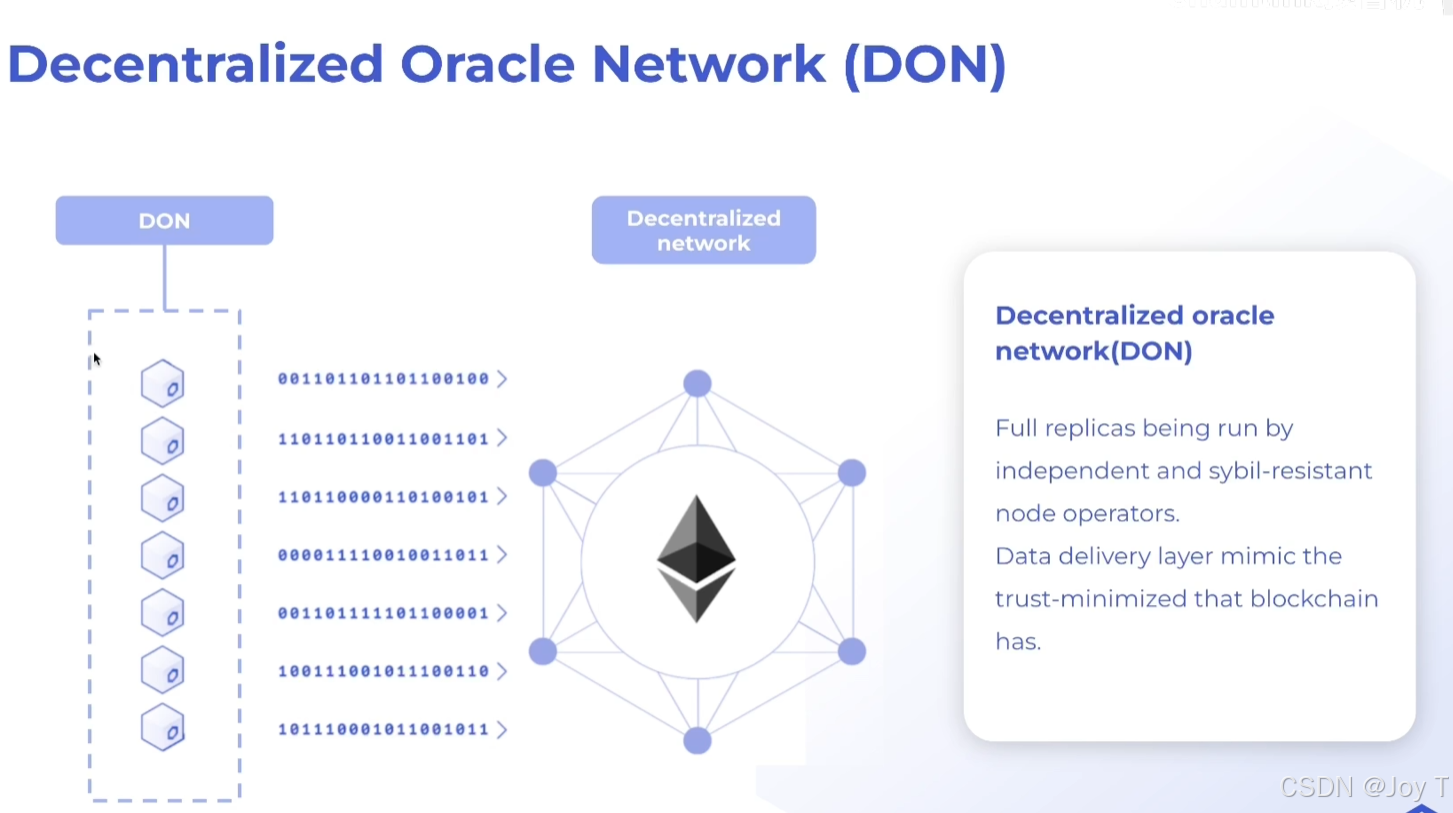

为了彻底解决单点故障风险,技术架构正式演进为去中心化预言机网络(Decentralized Oracle Network, 简称 DON)。在这个网络体系中,每一个独立的运营节点都会通过各自的数据链路去获取同一份外部数据 。随后,这些节点会通过一套类似区块链共识的算法对采集到的海量数据进行聚合处理,并将最终清洗确认的聚合结果安全地转移至以太坊等主网环境之中。

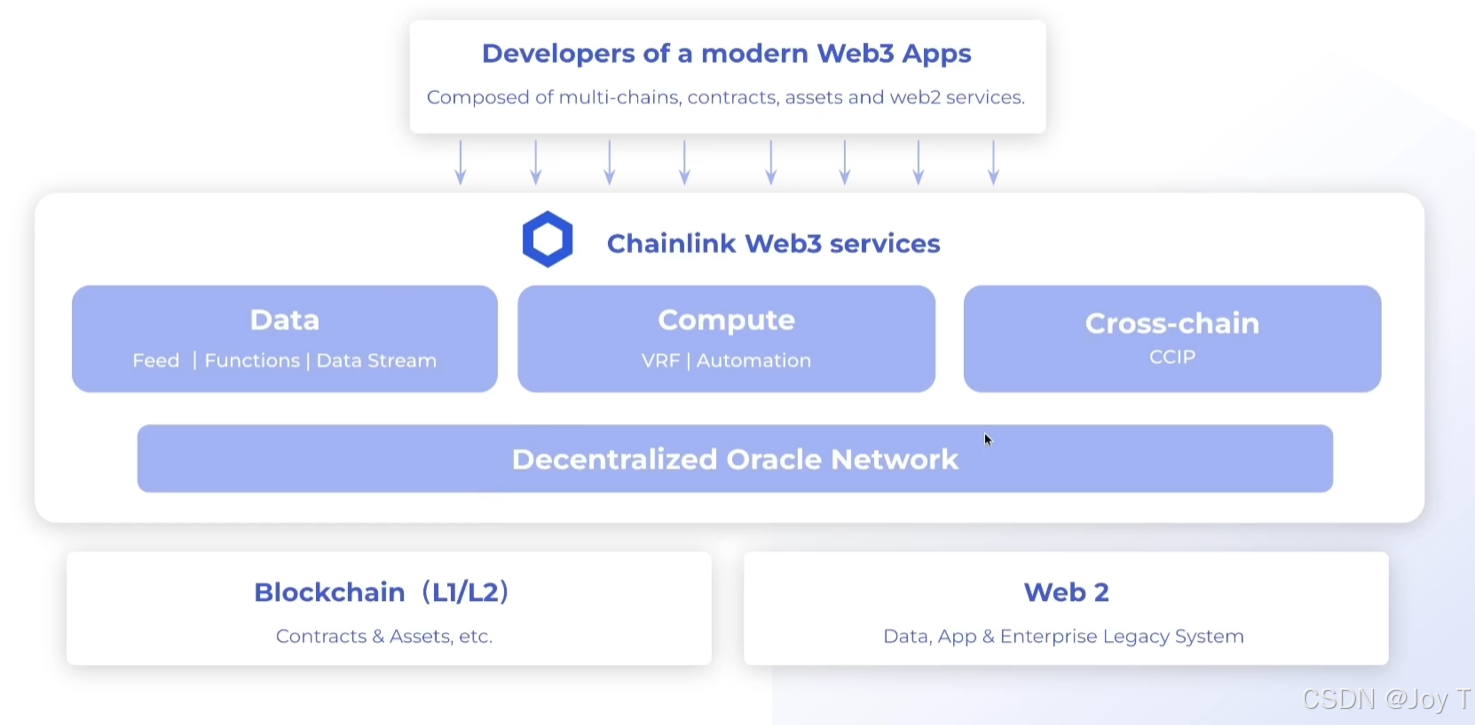

在目前的预言机赛道中,Chainlink 占据了绝对的头部地位。 它的服务版图极其宽广,涵盖了数据服务(Data Feed)、计算服务(如 VRF 随机数生成)以及跨链服务(CCIP)。在初学阶段,我们重点剖析其使用最广泛的数据服务------Data Feed 喂价架构。

2. Data Feed 喂价架构

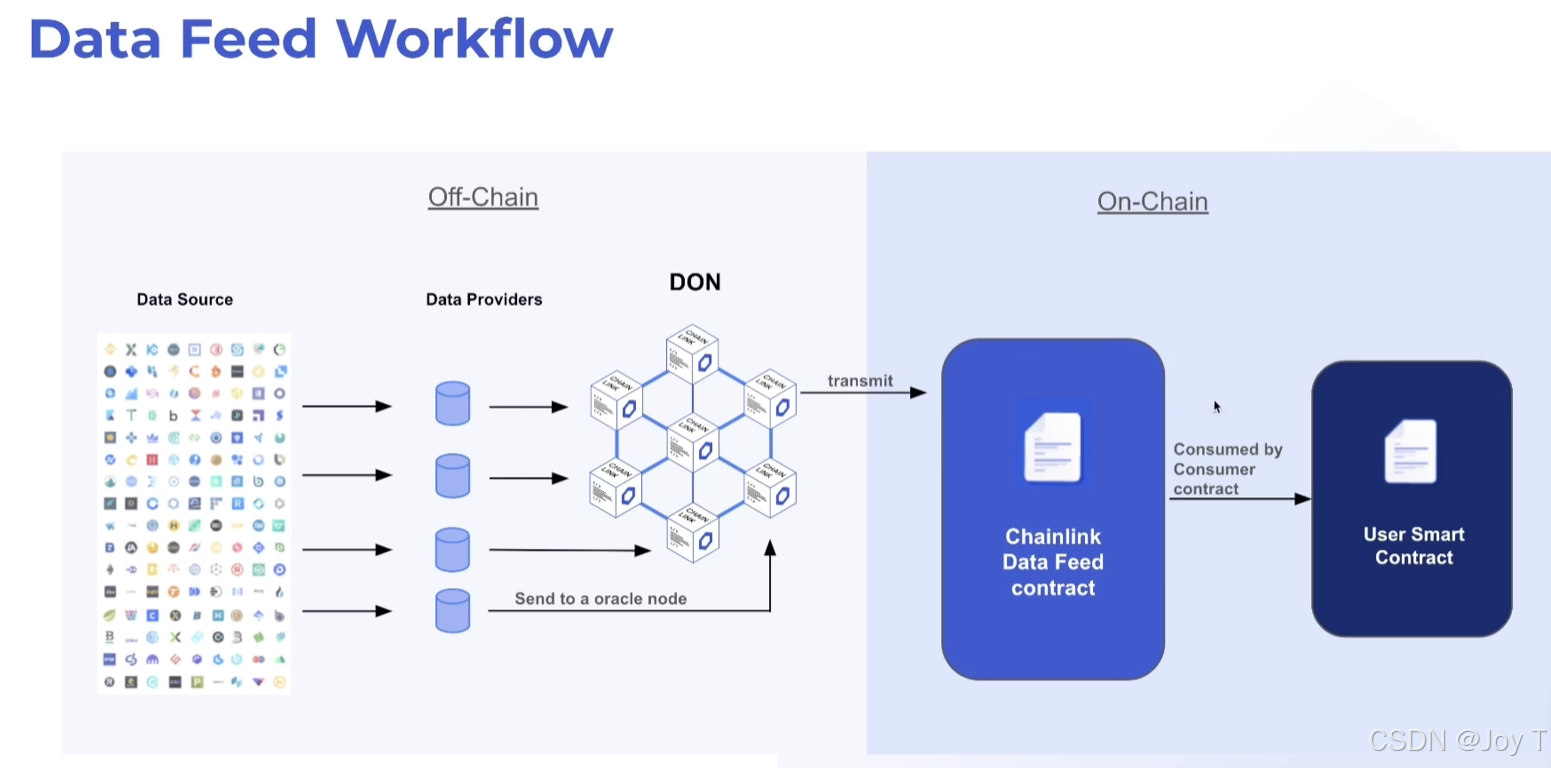

Data Feed 的核心工作流在链上部署了专门的喂价合约。该合约的主要职责是接收来自 DON 聚合计算后的精准结果,随后通过标准化的函数调用,将这些结果数据顺滑地传入开发者的业务智能合约中:

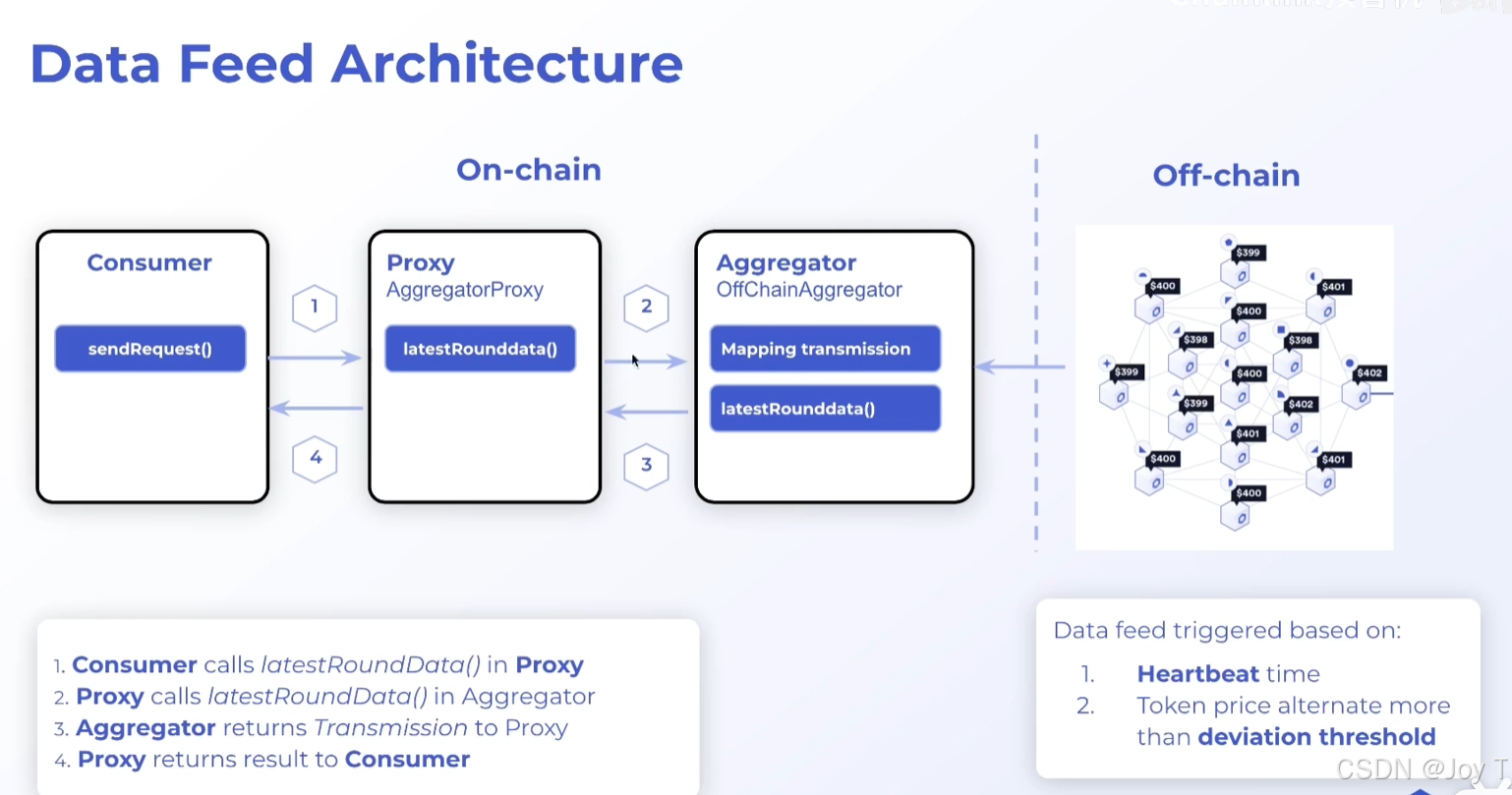

深入探究 Data Feed 的内部架构,发现其数据流转依赖于一系列分层设计的合约组件。其具体核心在于底层运行的 Aggregator(聚合器)合约。该合约会将接收到的最新聚合结果持久化存储于自身的 transmission 数据结构中:

紧接着,数据会被路由分发至上层的 Proxy(代理)合约。我们可以将 Proxy 合约直接理解为面向用户的稳定接口。引入这层代理机制的工程价值极大,它有效隔离了底层逻辑,大幅减少了未来 off-chain 节点和 Aggregator 合约不断迭代升级所带来的用户侧使用复杂度。