说实话这个入门教程也不是特别有必要,因为直接问AI然后验证即可,我这篇就是在AI的指导下操作的。

不过想想还是留作个人记录吧。。

0. Ollama 是什么

AI回答:(仅供参考)

Ollama 是一个开源的命令行工具,让你能在本地电脑上轻松运行、管理和与大型语言模型(LLM)交互。

简单来说,它相当于大语言模型的"Docker"------极大简化了在本地部署和运行 Llama 3、DeepSeek、Mistral 等开源模型的流程。

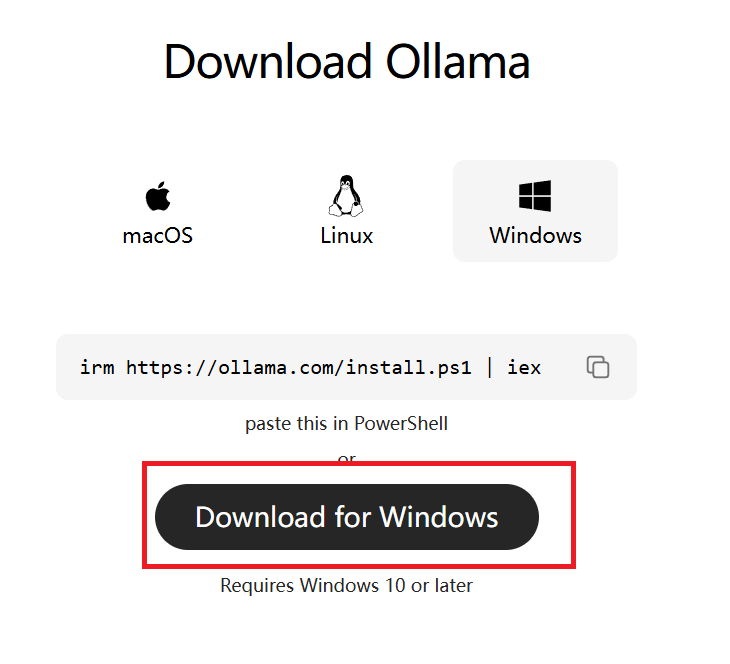

1. 下载

下载页面:https://ollama.com/download

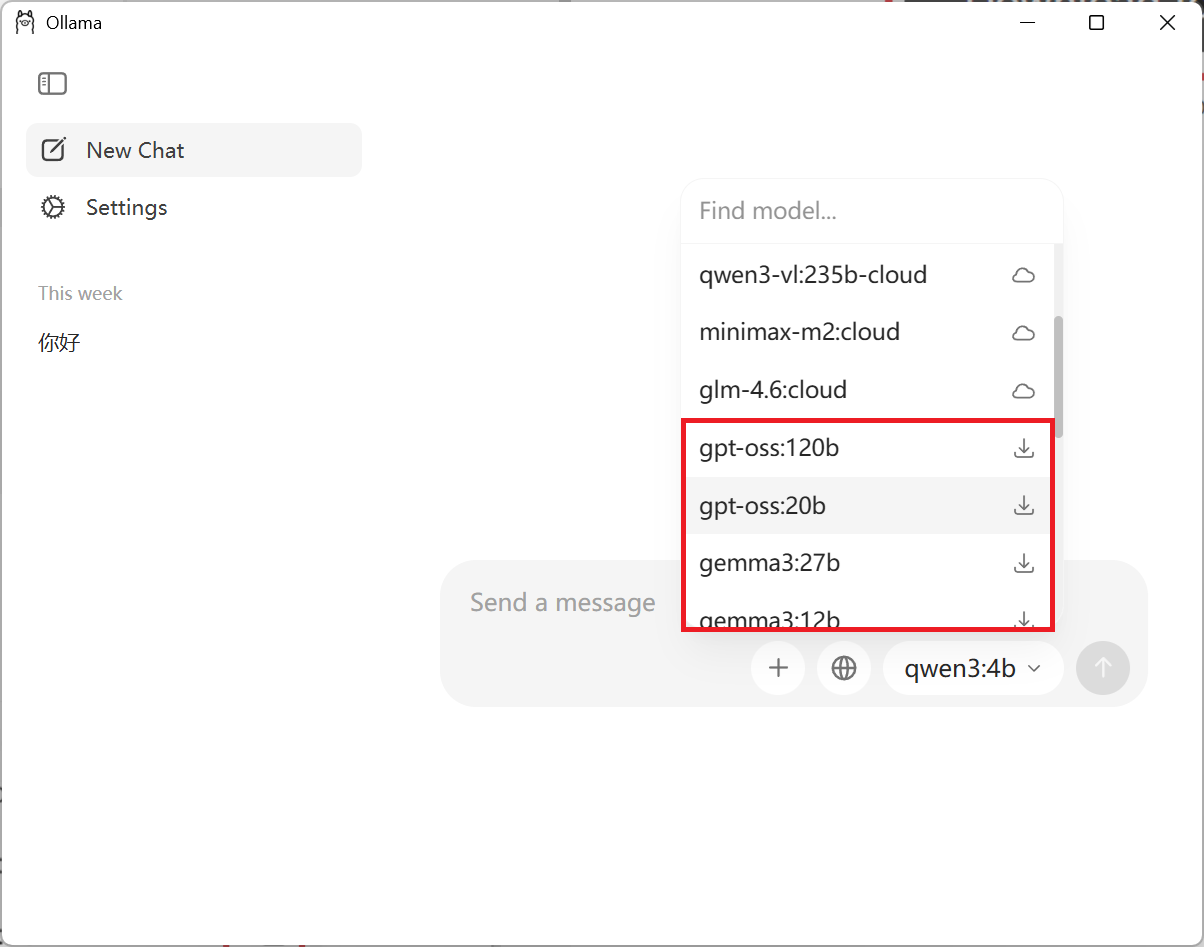

安装完毕后。打开。

可以选一个模型,这里我就选一个下载到本地的而非云端的了,否则感觉跟在网页端和AI对话没啥区别。。

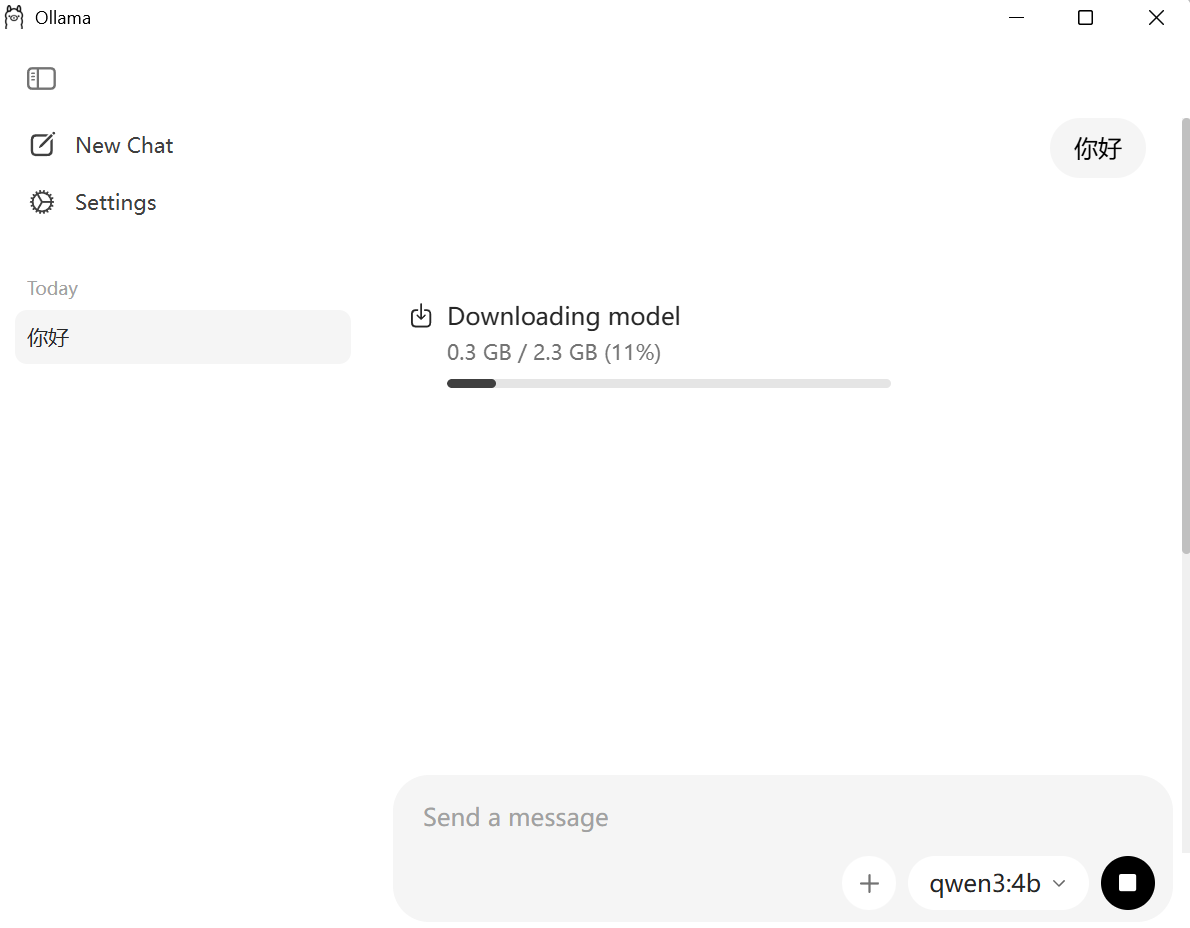

等待下载:

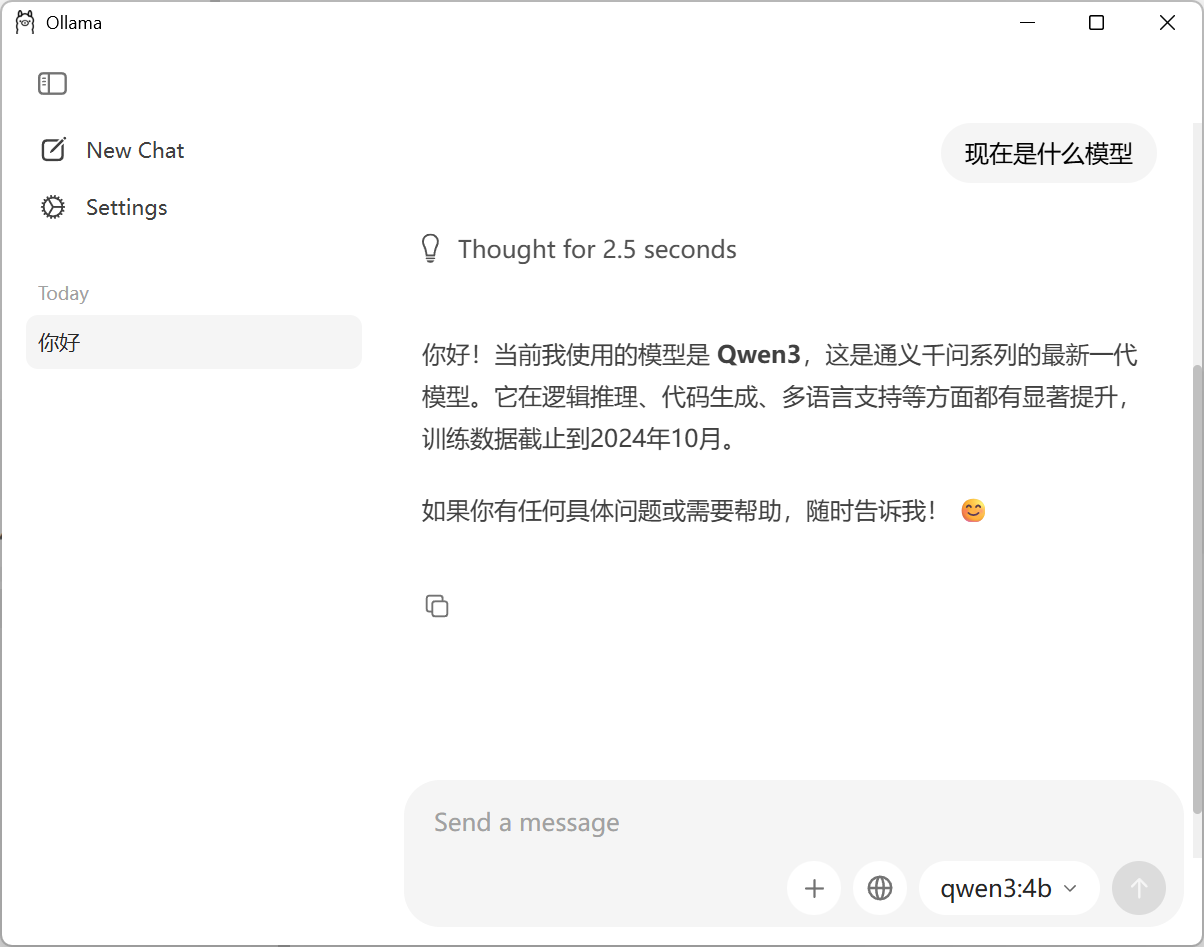

可以对话了:

2. 使用 python 调用大语言模型

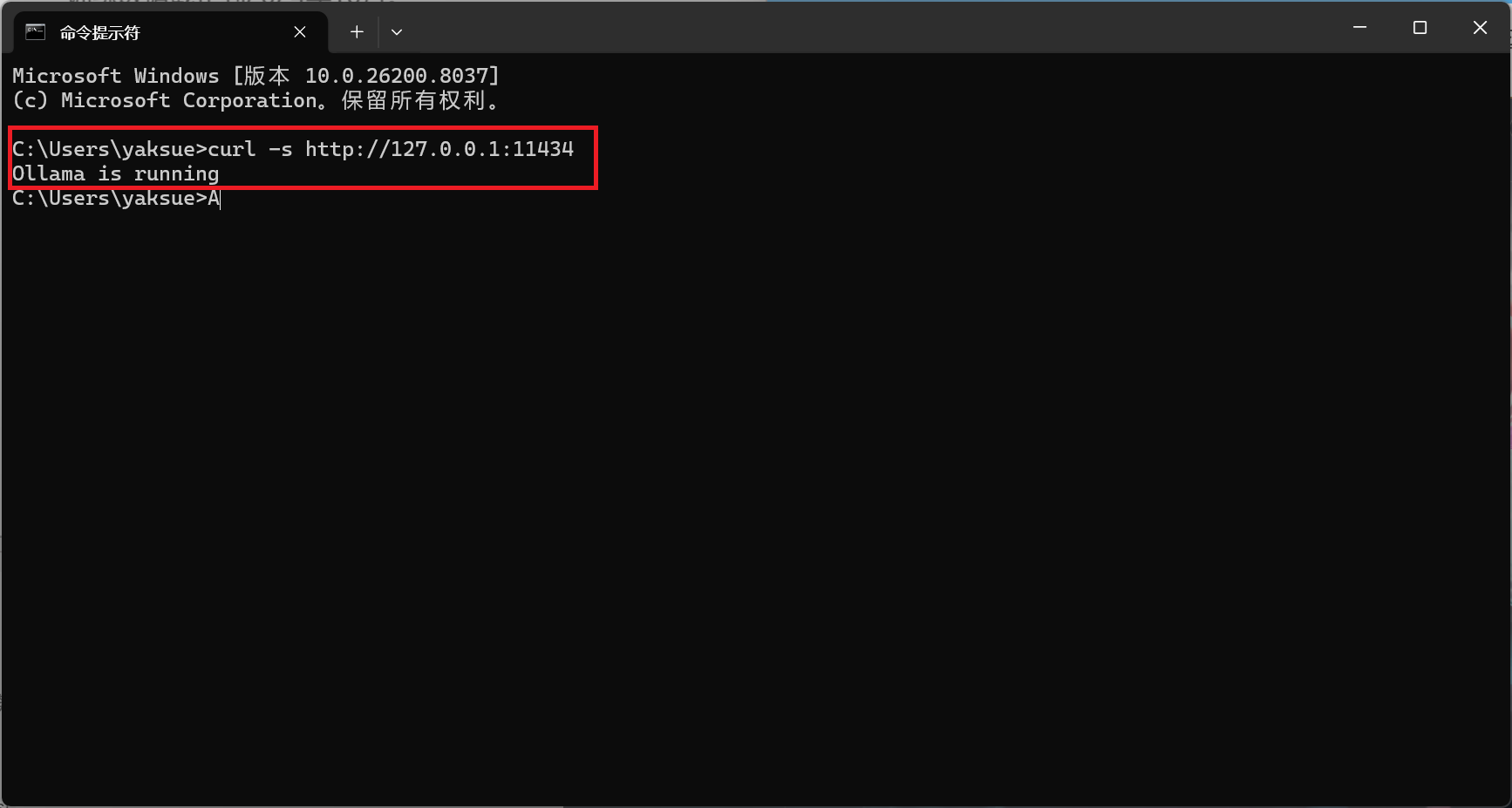

在实际跑python之前,先确认下Ollama服务是否启动了。

执行curl -s http://127.0.0.1:11434,启动的话应该显示 Ollama is running

然后看下模型名字叫啥,cmd中输入ollama list:

我这里就是 qwen3:4b

然后就可以调用如下脚本,向大语言模型发送信息并得到回应了。

注意修改model名字,content中是发的信息,这里是 "你好,你是哪个模型?"。最后打印出回应。

py

import requests

import json

# Ollama API 地址

url = "http://localhost:11434/api/chat"

# 请求体

payload = {

"model": "qwen3:4b",

"messages": [

{"role": "user", "content": "你好,你是哪个模型?"}

],

"stream": False # 非流式返回

}

# 发送 POST 请求

response = requests.post(url, json=payload)

# 解析响应

if response.status_code == 200:

result = response.json()

print(result['message']['content'])

else:

print(f"请求失败: {response.status_code}")(以上脚本也是AI自己写的,有问题的话可以直接问AI)

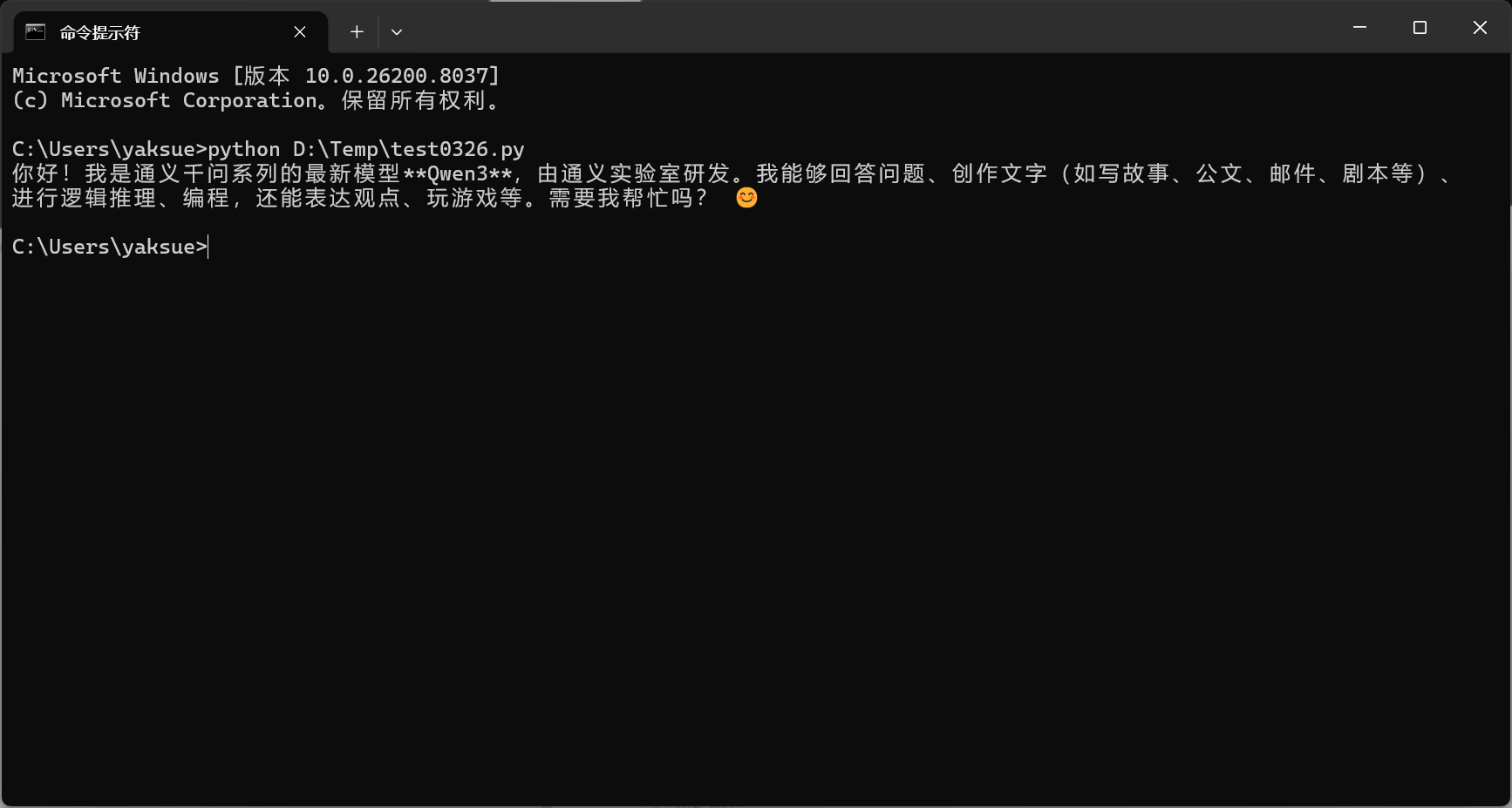

结果: