1:直接修改opencode.json配置文件

可能的配置位置:

*项目根目录:G:\项目名称\opencodeOne\opencode.json 如果没有可以创建

全局配置:C:\Users\dell.config\opencode\ *

json

{

"$schema": "https://opencode.ai/config.json",

"provider": {

"local-ai-server": {

"models": {

"gpt-oss:120b": {

"name": "gpt-oss:120b"

},

" qwen3.5:122b": {

"name": "qwen3.5:122b"

},

"deepseek-r1:70b": {

"name": "deepseek-r1:70b"

},

"qwen3-coder:30b": {

"name": "qwen3-coder:30b"

}

},

"npm": "@ai-sdk/openai-compatible",

"options": {

"apiKey": "",

"baseURL": "http://192.168.11.24:11434//v1"

}

}

}

}这里有三个关键点必须核对:

"baseURL" 必须是 http://ip:11434/v1

"name" 在models对象里写的是 gpt-oss:120b,这是Ollama中模型的实际名称标签,不是随便起的

"npm" 字段固定为 "@ai-sdk/openai-compatible",这是OpenCode用来识别OpenAI兼容服务的标识符

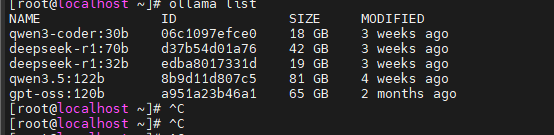

我服务器上的模型有如下

1-1:配置好后重启opencode

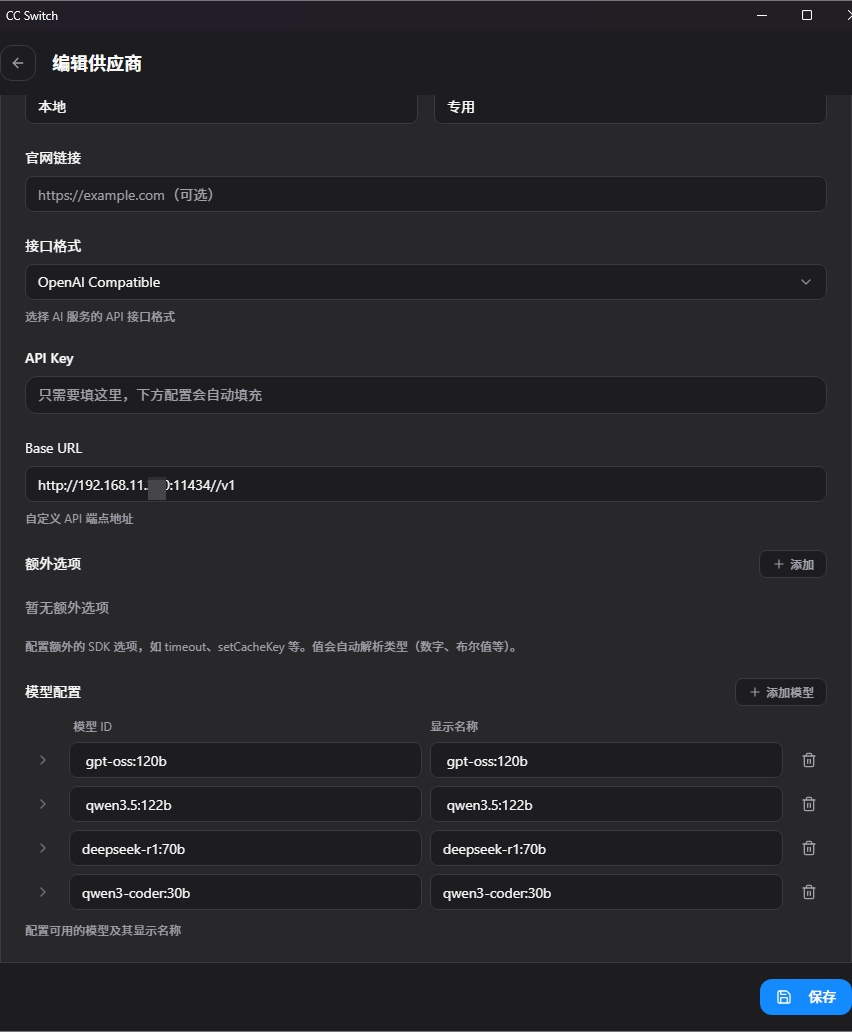

2:使用CC-Switch配置opencode本地模型

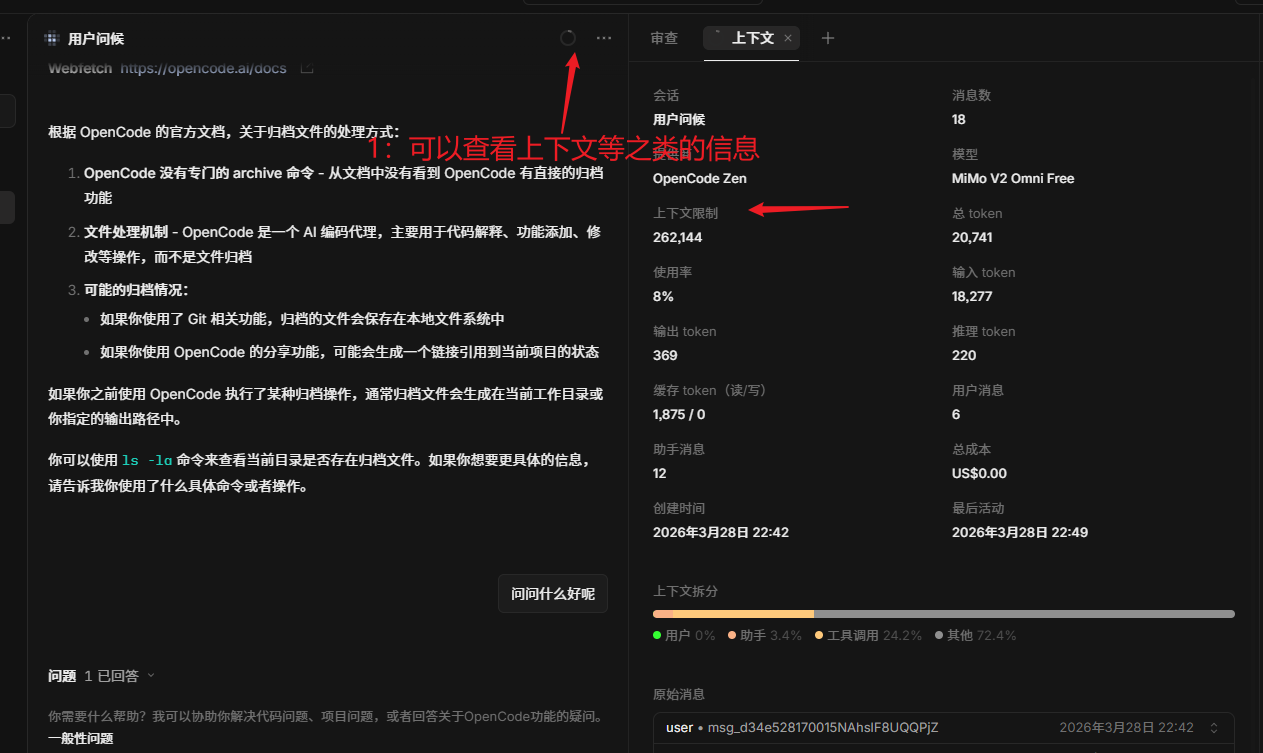

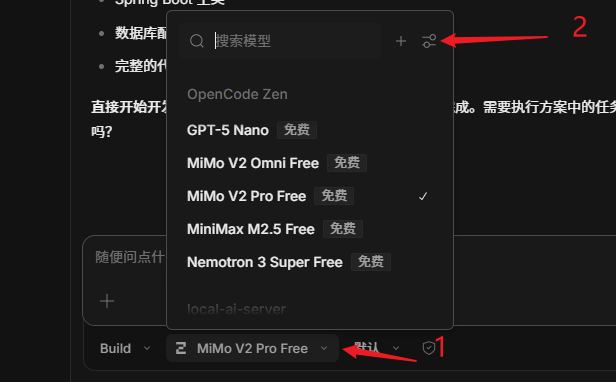

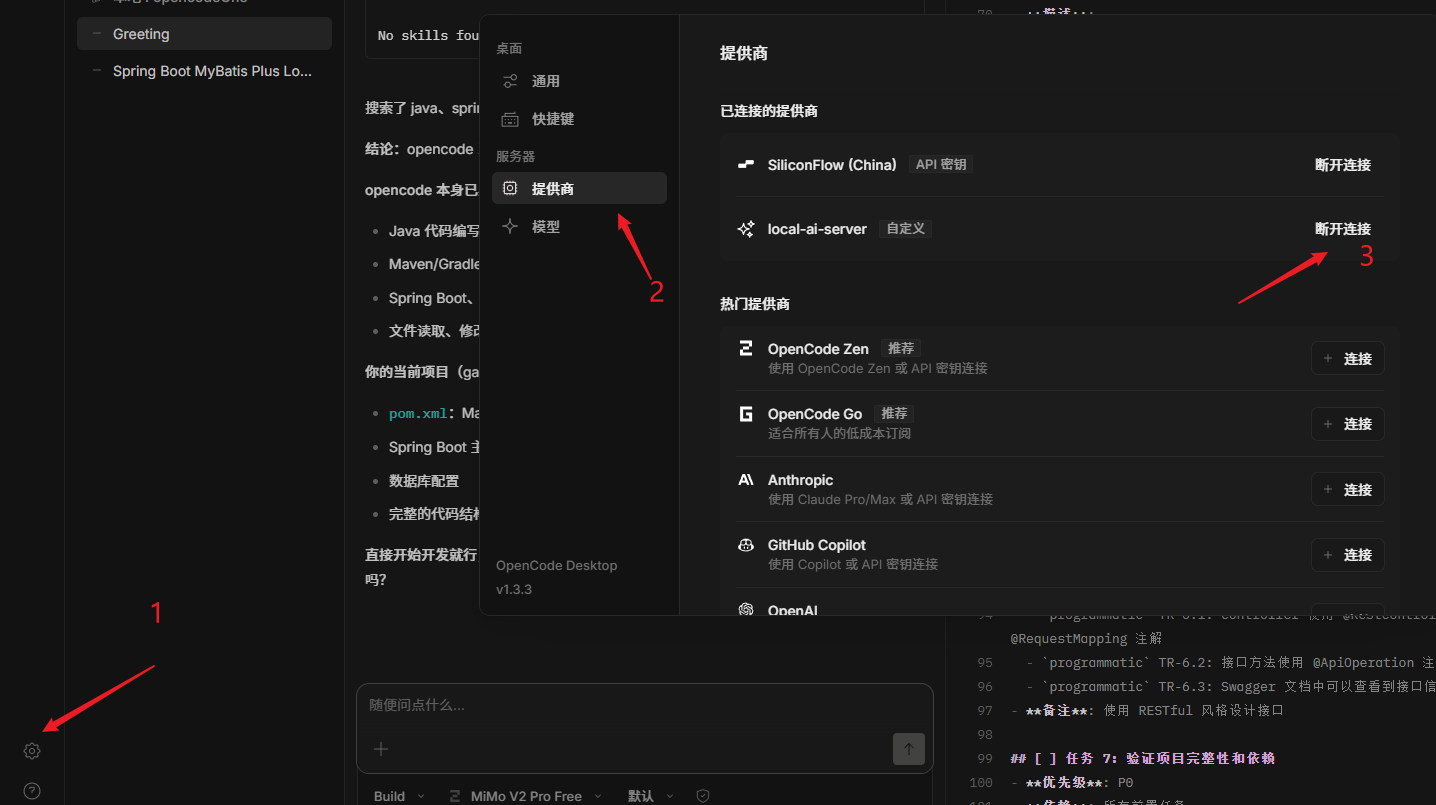

3:opencode桌面应用使用

3-1:启动或者停止指定的模型

3-2:断开连接就会自动删除

3-3:查看详细的模型使用情况信息